Как добавить диск в кластер hyper v

Хранилище в отказоустойчивый кластер можно добавить после предоставления всем узлам кластера доступа к этому хранилищу (изменяя маскирование или зонирование LUN). Необязательно добавлять хранилище в кластер, если хранилище уже перечислено для этого кластера в списке Хранилище оснастки «Диспетчер отказоустойчивости кластеров».

Если хранилище добавляется только для конкретной кластеризованной службы или приложения (в отличие от случая добавления полностью нового хранилища в отказоустойчивый кластер как в единое целое), см. Добавление хранилища для кластеризованной службы или приложения.

Если кластер, который нужно настроить, не отображается, в дереве консоли оснастки «Диспетчер отказоустойчивости кластеров» щелкните правой кнопкой мыши Диспетчер отказоустойчивости кластеров, Управлять кластером, а затем выберите или укажите требуемый кластер.

Если дерево консоли свернуто, разверните дерево кластера, который требуется настроить.

Щелкните правой кнопкой мыши Хранилище, а затем выберите Добавить диск.

Выберите диск или диски, которые нужно добавить.

Дополнительная информация

-

Список дисков, отображаемый при щелчке Хранилище в оснастке «Диспетчер отказоустойчивости кластеров». Если диск уже находится в этом списке, добавлять его в кластер не нужно.

Если добавляемый диск вообще не появляется в программе «Управление дисками» (ни для одного узла), проблема может быть связана с конфигурацией хранилища, которая мешает операционной системе распознать или подключить диск. Обратите внимание, что диски, используемые в этот момент кластером, появятся в программе «Управление дисками» только одного узла (узла, который является текущим владельцем этого диска).

Если добавляемый диск появляется в программе «Управление дисками», но не появляется при выборе Добавить диск, убедитесь, что диск настроен как базовый, а не как динамический диск. В отказоустойчивом кластере могут быть использованы только базовые диски.

Чтобы открыть программу «Управление дисками», нажмите кнопку Пуск, выберите Администрирование, выберите Управление компьютером, а затем выберите Управления дисками. (Если появится диалоговое окно Управление учетными записями пользователей, убедитесь, что в окне указано нужное действие, и выберите ответ Да.)

The Add-VMHardDiskDrive cmdlet adds a hard disk drive to a virtual machine.

Выделение хранилища

- Файловое хранилище можно выделять непосредственно для узлов и кластеров.

- В узлы и кластеры можно добавлять номера LUN.

- Если вы уже подготовили номера LUN в группе узлов, вы можете назначить их узлам и кластерам.

- Если вы подготовили пул носителей в группе узлов, то можете создать номера LUN при выполнении процедуры добавления хранилища в кластер.

- Если необходимо использовать общее хранилище, которым не управляет диспетчер VMM, диски хранилища должны быть доступны всем узлам, чтобы вы могли добавить их. Для всех узлов, которые нужно ввести в состав кластера, следует подготовить один или несколько номеров LUN, а затем на одном из узлов нужно подключить и отформатировать диски хранилища. Обратите внимание на то, что VMM не поддерживает и не блокирует применение асимметричного хранилища, когда рабочая нагрузка может использовать диски, являющиеся общими в подмножестве узлов кластера. Каждый узел кластера должен быть возможным владельцем диска кластера.

- После добавления хранилища iSCSI в узел необходимо создать сеанс для хранилища.

Parameters

Specifies that no error is to be thrown if the specified path is not verified as accessible by the cluster. This parameter is applicable to clustered virtual machines.

| Type: | SwitchParameter |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Runs the cmdlet in a remote session or on a remote computer. Enter a computer name or a session object, such as the output of a New-CimSession or Get-CimSession cmdlet. The default is the current session on the local computer.

| Type: | CimSession [ ] |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies one or more Hyper-V hosts that run this cmdlet. NetBIOS names, IP addresses, and fully qualified domain names are allowable. The default is the local computer. Use localhost or a dot (.) to specify the local computer explicitly.

| Type: | String [ ] |

| Aliases: | PSComputerName |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Prompts you for confirmation before running the cmdlet.

| Type: | SwitchParameter |

| Aliases: | cf |

| Position: | Named |

| Default value: | False |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the number of the location on the controller at which the hard disk drive is to be added. If not specified, the first available location in the controller specified with the ControllerNumber parameter is used.

| Type: | Int32 |

| Position: | 3 |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the number of the controller to which the hard disk drive is to be added. If not specified, this parameter assumes the value of the first available controller at the location specified in the ControllerLocation parameter.

| Type: | Int32 |

| Position: | 2 |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the type of the controller to which the hard disk drive is to be added. If not specified, IDE is attempted first. If the IDE controller port at the specified number and location is already connected to a drive, then it will try to create one on the SCSI controller specified by ControllerNumber. Allowed values are IDE and SCSI.

| Type: | ControllerType |

| Accepted values: | IDE, SCSI |

| Position: | 1 |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies one or more user accounts that have permission to perform this action. The default is the current user.

| Type: | PSCredential [ ] |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the disk number of the offline physical hard drive to be connected as a passthrough disk.

| Type: | UInt32 |

| Aliases: | Number |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | True |

| Accept wildcard characters: | False |

Specifies the maximum normalized I/O operations per second (IOPS) for the hard disk. Hyper-V calculates normalized IOPS as the total size of I/O per second divided by 8 KB.

| Type: | UInt64 |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the minimum normalized I/O operations per second (IOPS) for the hard disk. Hyper-V calculates normalized IOPS as the total size of I/O per second divided by 8 KB.

| Type: | UInt64 |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

| Type: | CacheAttributes |

| Accepted values: | Default, WriteCacheEnabled, WriteCacheAndFUAEnabled, WriteCacheDisabled |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Passes the added Microsoft.HyperV.PowerShell.HardDiskDrive object through to the pipeline.

| Type: | SwitchParameter |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the full path of the hard disk drive file to be added.

| Type: | String |

| Position: | 4 |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the name of the storage Quality of Service (QoS) policy that this cmdlet associates with the hard disk drive.

| Type: | CimInstance |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the unique ID for a storage QoS policy that this cmdlet associates with the hard disk drive.

| Type: | String |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the friendly name of the ISO resource pool to which this virtual hard disk is to be associated.

| Type: | String |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Indicates that the hard disk supports SCSI persistent reservation semantics. Specify this parameter when the hard disk is a shared disk that is used by multiple virtual machines.

| Type: | SwitchParameter |

| Aliases: | ShareVirtualDisk |

| Position: | Named |

| Default value: | None |

| Accept pipeline input: | False |

| Accept wildcard characters: | False |

Specifies the virtual machine to which the hard disk drive is to be added.

| Type: | VirtualMachine [ ] |

| Position: | 0 |

| Default value: | None |

| Accept pipeline input: | True |

| Accept wildcard characters: | False |

Specifies the controller to which the hard disk drive is to be added.

| Type: | VMDriveController |

| Position: | 0 |

| Default value: | None |

| Accept pipeline input: | True |

| Accept wildcard characters: | False |

Specifies the name of the virtual machine to which the hard disk drive is to be added.

Поддержка этой версии Virtual Machine Manager (VMM) прекращена. Рекомендуем перейти на VMM 2022.

Из этой статьи вы узнаете о выделении подготовленного хранилища для узлов и кластеров Hyper-V в структуре System Center Virtual Machine Manager (VMM).

Allocating storage

- You can allocate file storage directly to hosts and clusters.

- You can add LUNs to hosts and clusters:

- If you already provisioned LUNs on a host group, you can assign these to hosts and clusters.

- If you provisioned a storage pool on a host group, you can create LUNs during the procedure to add storage to a cluster.

- If you want to use shared storage that isn't managed by VMM, the storage disks must be available to all hosts or nodes before you can add them. You need to provision one or more LUNs to all hosts you want to cluster, and then mount and format the storage disks on one of the nodes. Note that VMM doesn't support or block the use of asymmetric storage, where a workload can use disks that are shared between a subset of the cluster nodes. Each cluster node must be a possible owner of the cluster disk.

- After adding iSCSI storage to a host, you need to create a new session to the storage.

Examples

Настройка хранилища для кластера Hyper-V

Щелкните СтруктураСерверы>Все узлы. Щелкните правой кнопкой мыши кластер, который требуется настроить, и выберите Свойства. В разделе Имя кластера узлов>Свойства откройте вкладку:

- Доступное хранилище: для добавления, удаления доступного хранилища или его преобразования в общее хранилище (CSV).

- Общие тома: для добавления, удаления общих томов кластера (CSV) или их преобразования в доступное хранилище. Для поддержки общих томов кластера кластер должен использовать по меньшей мере Windows Server 2012.

Настройка хранилища для кластера узлов Обратите внимание на следующее.

- При добавлении доступного хранилища для общих томов кластера (CSV) используйте в номере LUN только буквы и цифры. Обратите внимание на то, что для диска, который уже был инициализирован, нельзя изменить стиль раздела.

- Если вы преобразуете доступное хранилище в общие тома кластера, убедитесь в том, что в кластере отсутствуют виртуальные машины, связанные VHD- или VHDX-файлы, которые находятся в преобразуемом хранилище.

Преобразовывайте тома по одному за раз. После преобразования убедитесь, что логическая единица отображается на вкладке Общие тома.

Когда все готово к фиксации изменений, нажмите кнопку ОК.

This version of Virtual Machine Manager (VMM) has reached the end of support, we recommend you to upgrade to VMM 2022.

Read this article to allocate provisioned storage to Hyper-V hosts and clusters in the System Center - Virtual Machine Manager (VMM) fabric.

Example 3

This example gets a SCSI controller on a virtual machine named Test and then adds physical disk 2 to that controller.

Example 1

Creates a virtual hard disk using file D:\VHDs\disk1.vhdx on virtual machine Test.

Перед началом работы

Перед выделением подготовленного хранилища узлам и кластеру, хранилище необходимо обнаружить и классифицировать в структуре VMM.

- Обнаружение и классификация хранилища

-

. Сведения о классификации.

. Можно выделить весь пул носителей или конкретные логические устройства (LUN).

- Перед выделением хранилища для узлов необходимо выполнить указанные ниже действия.

- MPIO. Если вы используете хранилище Fibre Channel или iSCSI, на каждом узле необходимо включить функцию многопутевого ввода-вывода Multipath I/O (MPIO).

- Если функция MPIO включена до добавления узла, VMM автоматически включит ее для поддерживаемых массивов хранения с помощью модуля DSM от корпорации Майкрософт. При наличии модулей DSM от конкретного поставщика будут использоваться они.

- Если вы добавляете узел в VMM и включаете функцию MPIO позднее, ее необходимо настроить вручную, добавив обнаруженные идентификаторы оборудования для устройств.

- HBA и разделение на зоны. При использовании сети хранения данных (SAN) Fibre Channel на каждом узле должен быть установлен адаптер шины (HBA) и выполнено правильное разделение на зоны.

- iSCSI. Если используется сеть SAN iSCSI, убедитесь в том, что добавлены порталы iSCSI и инициатор iSCSI выполнил вход в массив.

- MPIO. Если вы используете хранилище Fibre Channel или iSCSI, на каждом узле необходимо включить функцию многопутевого ввода-вывода Multipath I/O (MPIO).

- В VMM группа хранения связывает инициаторы узлов, целевые порты и логические устройства.

- Группа хранения содержит один или несколько идентификаторов инициаторов узлов (IQN или WWN) (WWN).

- Группа хранения включает один или несколько целевых портов, а также одно или несколько логических устройств. Инициаторы устройств обращаются к логическим устройствам через целевые порты.

- По умолчанию, когда диспетчер VMM управляет назначением логических единиц, он создает одну группу хранения на каждый автономный узел или узел кластера.

- Для некоторых массивов хранения рекомендуется использовать одну группу хранения для всего кластера, когда инициаторы узлов для всех узлов кластера находятся в одной группе хранения. Для этого следует задать для свойства CreateStorageGroupsPerCluster значение $true, используя командлет Set-SCStorageArray.

Выделение файлового хранилища для автономного узла

Вы можете назначить общую папку на любом узле, на котором нужно создать виртуальные машины, которые будут использовать общую папку в качестве хранилища.

- Щелкните "Структура" >Серверы>Все узлы и выберите узел или узел кластера для настройки.

- Выберите Узел>Свойства>Доступ к узлу. Укажите учетную запись запуска от имени. По умолчанию указывается учетная запись запуска от имени, которая использовалась для добавления узла в VMM. В поле Учетная запись запуска от имени настройте параметры учетной записи. Нельзя использовать учетную запись, применяемую для службы VMM. Обратите внимание на следующее.

- Если в качестве учетной записи службы VMM используется учетная запись домена, добавьте учетную запись домена в группу локальных администраторов на файловом сервере.

- Если в качестве учетной записи службы VMM используется учетная запись локальной системы, добавьте учетную запись компьютера в группу локальных администраторов на файловом сервере. Например, для сервера управления VMM с именем VMMServer01 добавьте учетную запись компьютера VMMServer01$.

- Любой узел или кластер узлов, который обращается к общей папке SMB 3.0, должен быть добавлен в VMM с помощью учетной записи запуска от имени. VMM автоматически использует эту учетную запись для доступа к общим папкам SMB 3.0.

- Если вы указали явные учетные данные пользователя при добавлении узла или кластера узлов, такой узел или кластер можно удалить из VMM, а затем добавить его снова с помощью учетной записи запуска от имени.

- Щелкните Имя узла > СвойстваХранилищеДобавить общую папку.

- В поле Путь к общей папке выберите нужную общую папку SMB 3.0 и нажмите кнопку ОК.

- Чтобы убедиться, что у узла есть доступ к ней, откройте рабочую область Задания, чтобы просмотреть состояние задания. Кроме того, можно снова открыть свойства узла и перейти на вкладку Хранилище. В разделе Общие папки щелкните общую папку SMB 3.0. Убедитесь, что рядом с полем Доступ к общей папке отображается зеленая галочка.

- Повторите эту процедуру для любого изолированного узла, которому необходимо получать доступ к общей папке SMB 3.0, или для всех узлов в кластере.

Example 4

This example gets physical disk 2 and then adds it to a virtual machine named Test.

Allocate file storage to a standalone host

You can assign file shares on any host on which you want to create VMs that will use the file share as storage.

- Click Fabric >Servers >All Hosts, and select the host or cluster node you want to configure.

- Click Host >Properties >Host Access. Specify a Run As account. By default the Run As account that was used to add the host to VMM is listed. In the Run As account box, configure the account settings. You can't use the account that you use for the VMM service. Note that:

- If you used a domain account for the VMM service account, add the domain account to the local Administrators group on the file server.

- If you used the local system account for the VMM service account, add the computer account for the VMM management server to the local Administrators group on the file server. For example, for a VMM management server that is named VMMServer01, add the computer account VMMServer01$.

- Any host or host cluster that accesses the SMB 3.0 file share must have been added to VMM using a Run As account. VMM automatically uses this Run As account to access the SMB 3.0 file share.

- If you specified explicit user credentials when you added a host or host cluster, you can remove the host or cluster from VMM, and then add it again by using a Run As account.

- Click Host Name Properties >Storage >Add File Share.

- In File share path, select the required SMB 3.0 file share, and then click OK.

- To confirm that the host has access, open the Jobs workspace to view the job status. Or, open the host properties again, and then click the Storage tab. Under File Shares, click the SMB 3.0 file share. Verify that a green check mark appears next to Access to file share.

- Repeat this procedure for any standalone host that you want to access the SMB 3.0 file share, or for all nodes in a cluster

Назначение логической единицы автономному узлу

Назначьте существующую единицу или создайте новую, а затем назначьте ее.

В разделе Структура>Серверы>Все узлы щелкните правой кнопкой мыши узел, который нужно настроить, и выберите пункт Свойства.

Если нужно создать логическую единицу, выполните указанные ниже действия.

- На панели инструментов нажмите кнопку Добавить рядом с элементом Диск. Рядом с элементом Логическое устройство выберите Создание логического устройства.

- В разделе "Создание логического устройства" >Пул носителей выберите пул, из которого требуется создать логическую единицу. Укажите имя (только буквы и цифры), описание и размер единицы. Для завершения нажмите кнопку ОК.

Чтобы назначить существующую логическую единицу узлу, на панели инструментов рядом с элементом Диск нажмите кнопку Добавить и выберите нужную логическую единицу.

В списке Логическое устройство выберите логическую единицу, которую вы только что создали.

Если вы хотите отформатировать диск в области Форматировать новый диск, установите флажок Выполнить форматирование этого тома в том NTFS со следующими параметрами и задайте параметры. Обратите внимание, что при выборе параметра Принудительное форматирование даже при наличии файловой системы будут перезаписаны все существующие данные на томе. Если логическая единица имеет некоторые данные и не используется параметр Принудительное форматирование, задание VMM по назначению логической единицы будет завершено с предупреждением. VMM назначает логическую единицу узлу. Диск можно отформатировать позднее.

В разделе Точка подключения выберите параметры подключения. Затем нажмите кнопку ОК, чтобы назначить логическую единицу узлу.

VMM регистрирует логическую единицу хранения на узле и подключает диск хранилища.

- Для просмотра сведений о соответствующем задании откройте рабочую область Задания.

- Чтобы убедиться, что логическая единица назначена, просмотрите сведения на вкладке Хранилище в диалоговом окне Имя узла>Свойства. Только что назначенная логическая единица отображается в области Диск. Выберите новый диск, чтобы просмотреть сведения о нем.

- Если поле Массив в сведениях о диске заполнено, значит, массив хранения управляется VMM.

Чтобы настроить дополнительные параметры диска, откройте на узле раздел "Управление дисками". Для этого нажмите кнопку Пуск, введите diskmgmt.msc в поле поиска и нажмите клавишу ВВОД. Новый диск появляется в списке в виде базового диска. Если было выбрано форматирование диска, диск уже отформатирован и подключен. Щелкните правой кнопкой мыши диск, чтобы просмотреть доступные параметры, такие как Форматировать и Изменить букву диска или путь к диску.

Configure storage for a Hyper-V cluster

Click Fabric Servers > All Hosts. Right-click the cluster you want to configure > Properties. In Host Cluster Name > Properties click a tab:

- Available Storage: for adding available storage, converting available storage to shared storage (CSV), or removing available storage.

- Shared Volumes: for adding cluster shared volumes (CSVs), converting CSVs to available storage, or removing CSVs. The cluster must run at least Windows Server 2012 to support CSVs.

Configure storage for the host cluster. Note that:

- If you add available storage for CSVs, use only alphanumeric characters for a LUN. Note that you can't change the partition style of a disk that has already been initialized.

- If you're converting available storage to CSVs, make sure there are no VMs on the cluster that have their associated .vhd or .vhdx files located on the storage that you want to convert.

Convert volumes one at a time. After conversion, confirm that the logical unit appears on the Shared Volumes tab.

Assign a logical unit to a standalone host

Either assign an existing unit, or create a new one and assign it.

In Fabric > Servers > All Hosts, right-click the host that you want to configure > Properties.

If you want to create a new logical unit:

- On the toolbar, next to Disk, click Add. Next to Logical unit click Create Logical Unit.

- In Create Logical Unit >Storage pool choose the pool from which the create the logical unit. Specify a name (alphanumeric only), a description and the unit size. Click OK to finish.

To assign an existing logical unit to the host, on the toolbar, next to Disk, click Add, and select the logical unit you want to assign.

In the Logical unit list, verify that the logical unit that you just created is selected.

In Format new disk, if you want to format the disk, select Format this volume as NTFS volume with the following settings, and specify the settings. Note that if you select Force format even if a file system is found all existing data on the volume will be overwritten. If the logical unit has existing data, and you do not use the Force Format option, the VMM job to assign the logical unit will complete with a warning. VMM assigns the logical unit to the host. You can format the disk later.

In Mount Point, select the mount options. Then click OK to assign the logical unit to the host.

VMM registers the storage logical unit to the host and mounts the storage disk.

- To view the associated job information, open the Jobs workspace.

- To verify that the logical unit was assigned, view the information on the Storage tab in the Host Name >Properties dialog box. The newly assigned logical unit appears under Disk. Click the new disk to view the disk details.

- If the Array field is populated in the disk details, this indicates that the storage array is under VMM management.

To configure additional disk settings open Disk Management on the host. To open Disk Management, click Start, type diskmgmt.msc in the search box, and then press ENTER. The new disk appears in the list of disks as a basic disk. If you chose to format the disk, the disk is already formatted and online. You can right-click the disk to see the available options, such as Format and Change Drive Letter and Paths.

Before you start

Before you can allocate provisioned storage to hosts and cluster, it should be discovered and classified in the VMM fabric:

- Discover and classify storage:

-

. Learn about classification.

. You can allocate an entire storage pool, or a specific logical unit (LUN).

- Make sure you've completed these steps before you allocate storage to hosts:

- MPIO: If you're using fiber channel or iSCSI storage, the Multipath I/O (MPIO) feature must be enabled on each host.

- If MPIO is already enabled before you add the host, VMM will automatically enable it for supported storage arrays using Microsoft DSM. If you have vendor specific DSMs these will be used.

- If you add a host to VMM and enable MPIO later, you need to configure it manually to add the discover device hardware IDs.

- HBA and zoning: If you're using Fiber Channel storage array network (SAN), each host must have a host bus adapter (HBA) installed, and zoning must be correctly configured.

- iSCSI: If you are using an iSCSI SAN, make sure that iSCSI portals have been added, and that the iSCSI initiator is logged into the array.

- MPIO: If you're using fiber channel or iSCSI storage, the Multipath I/O (MPIO) feature must be enabled on each host.

- In VMM a storage group binds together host initiators, target ports, and logical units.

- A storage group contains one or more host initiator IDs (IQN or WWN) (WWN).

- A storage group also contains one or more target ports and one or more logical units. Logical units are exposed to the host initiators through the target ports.

- By default, when VMM manages the assignment of logical units, VMM creates one storage group per host, either a standalone host or a host cluster node.

- For some storage arrays, it is preferable to use one storage group for the entire cluster, where host initiators for all cluster nodes are contained in a single storage group. To do this, you need to set the CreateStorageGroupsPerCluster property to $true by using the Set-SCStorageArray cmdlet.

Настраиваем отказоустойчивый кластер Hyper-V на базе Windows Server 2012

Уже на этапе планирования будущей виртуальной инфраструктуры следует задуматься об обеспечении высокой доступности ваших виртуальных машин. Если в обычной ситуации временная недоступность одного из серверов еще может быть приемлема, то в случае остановки хоста Hyper-V недоступной окажется значительная часть инфраструктуры. В связи с чем резко вырастает сложность администрирования - остановить или перезагрузить хост в рабочее время практически невозможно, а в случае отказа оборудования или программного сбоя получим ЧП уровня предприятия.

Научиться настраивать MikroTik с нуля или систематизировать уже имеющиеся знания можно на углубленном курсе по администрированию MikroTik. Автор курса, сертифицированный тренер MikroTik Дмитрий Скоромнов, лично проверяет лабораторные работы и контролирует прогресс каждого своего студента. В три раза больше информации, чем в вендорской программе MTCNA, более 20 часов практики и доступ навсегда.

Все это способно серьезно охладить энтузиазм по поводу преимуществ виртуализации, но выход есть и заключается он в создании кластера высокой доступности. Мы уже упоминали о том, что термин "отказоустойчивый" не совсем корректен и поэтому сегодня все чаще используется другая характеристика, более точно отражающая положение дел - "высокодоступный".

Для создания полноценной отказоустойчивой системы требуется исключить любые точки отказа, что в большинстве случаев требует серьезных финансовых вложений. В тоже время большинство ситуаций допускает наличие некоторых точек отказа, если устранение последствий их отказа обойдется дешевле, чем вложение в инфраструктуру. Например, можно отказаться от недешевого отказоустойчивого хранилища в пользу двух недорогих серверов с достаточным числом корзин, один из которых настроен на холодный резерв, в случае отказа первого сервера просто переставляем диски и включаем второй.

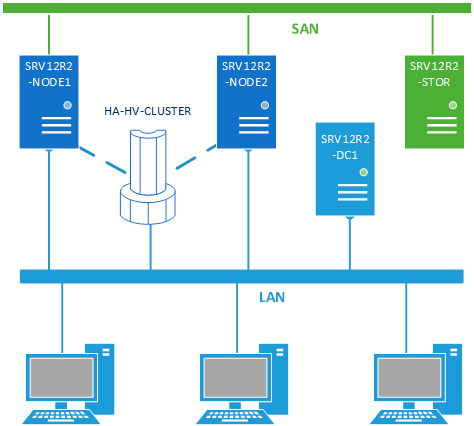

В данном материале мы будем рассматривать наиболее простую конфигурацию отказоустойчивого кластера, состоящего из двух узлов (нод) SRV12R2-NODE1 и SRV12R2-NODE2, каждый из которых работает под управлением Windows Server 2012 R2. Обязательным условием для этих серверов является применение процессоров одного производителя, только Intel или только AMD, в противном случае миграция виртуальных машин между узлами будет невозможна. Каждый узел должен быть подключен к двум сетям: сети предприятия LAN и сети хранения данных SAN.

Вторым обязательным условием для создания кластера является наличие развернутой Active Directory, в нашей схеме она представлена контроллером домена SRV12R2-DC1.

Хранилище выполнено по технологии iSCSI и может быть реализовано на любой подходящей платформе, в данном случае это еще один сервер на Windows Server 2012 R2 - SRV12R2-STOR. Сервер хранилища может быть подключен к сети предприятия и являться членом домена, но это необязательное условие. Пропускная способность сети хранения данных должна быть не ниже 1 Гбит/с.

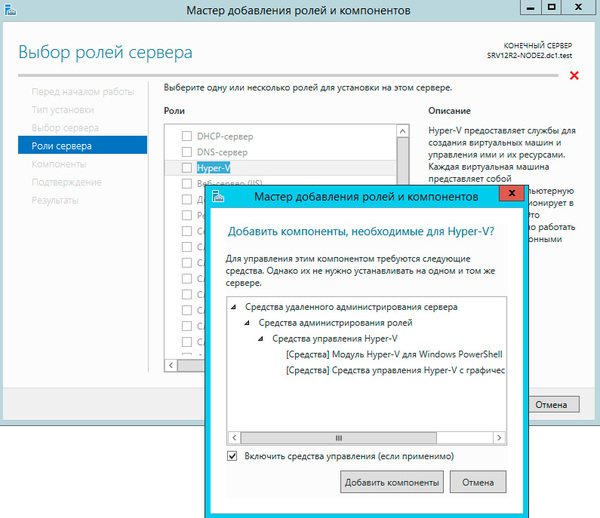

Будем считать, что на оба узла уже установлена операционная система, они введены в домен и сетевые подключения настроены. Откроем Мастер добавления ролей и компонентов и добавим роль Hyper-V.

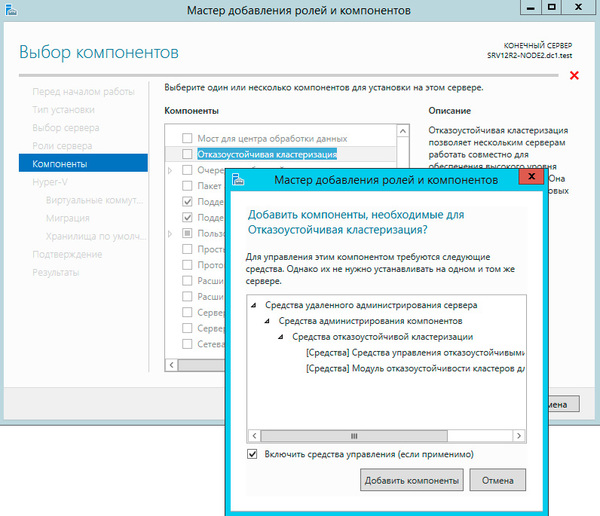

Следующим шагом добавим компоненту Отказоустойчивая кластеризация.

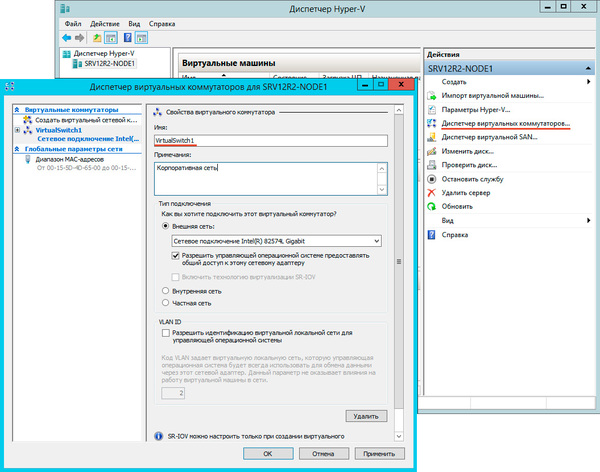

На странице настройки виртуальных коммутаторов выбираем тот сетевой адаптер, который подключен к сети предприятия.

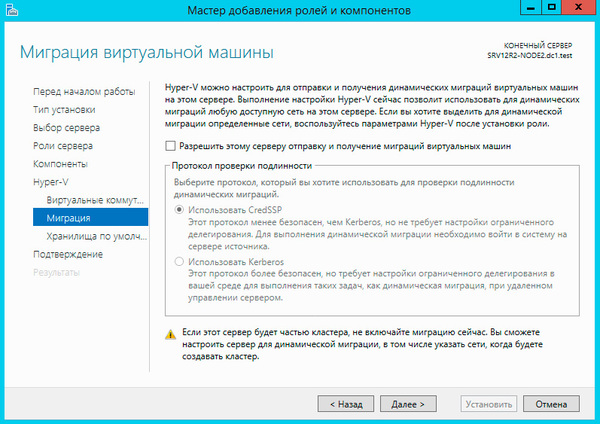

Миграцию виртуальных машин оставляем выключенной.

Остальные параметры оставляем без изменения. Установка роли Hyper-V потребует перезагрузку, после чего аналогичным образом настраиваем второй узел.

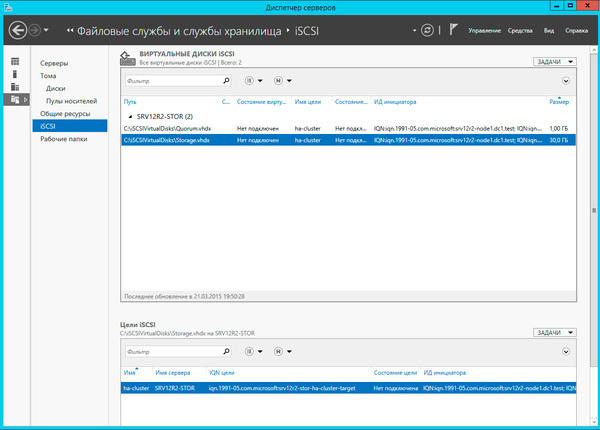

Затем перейдем к серверу хранилища, как настроить iSCSI-хранилище на базе Windows Server 2012 мы рассказывали в данной статье, но это непринципиально, вы можете использовать любой сервер цели iSCSI. Для нормальной работы кластера нам потребуется создать минимум два виртуальных диска: диск свидетеля кворума и диск для хранения виртуальных машин. Диск-свидетель - это служебный ресурс кластера, в рамках данной статьи мы не будем касаться его роли и механизма работы, для него достаточно выделить минимальный размер, в нашем случае 1ГБ.

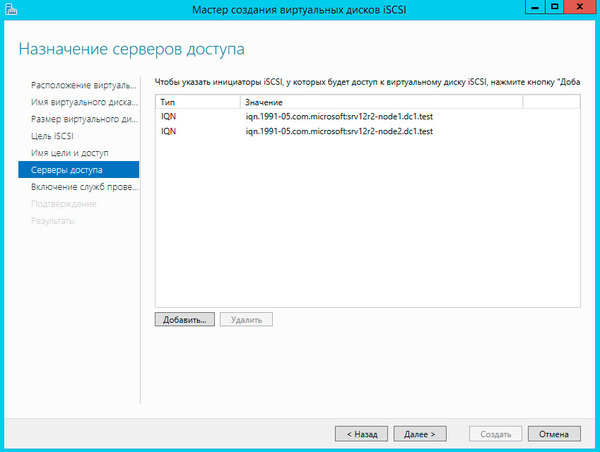

Создайте новую цель iSCSI и разрешите доступ к ней двум инициаторам, в качестве которых будут выступать узлы кластера.

И сопоставьте данной цели созданные виртуальные диски.

Настроив хранилище, вернемся на один из узлов и подключим диски из хранилища. Помните, что если сервер хранилища подключен также к локальной сети, то при подключении к цели iSCSI укажите для доступа сеть хранения данных.

Подключенные диски инициализируем и форматируем.

После чего откроем Диспетчер Hyper-V и перейдем к настройке виртуальных коммутаторов. Их название на обоих узлах должно полностью совпадать.

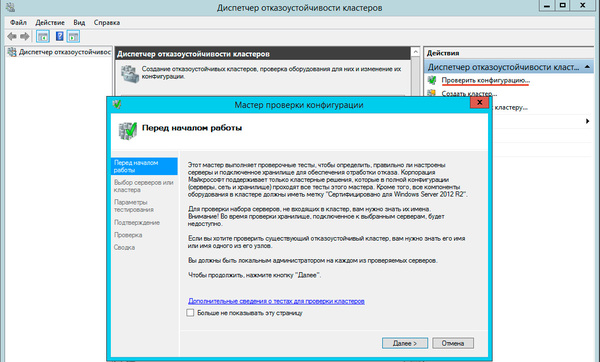

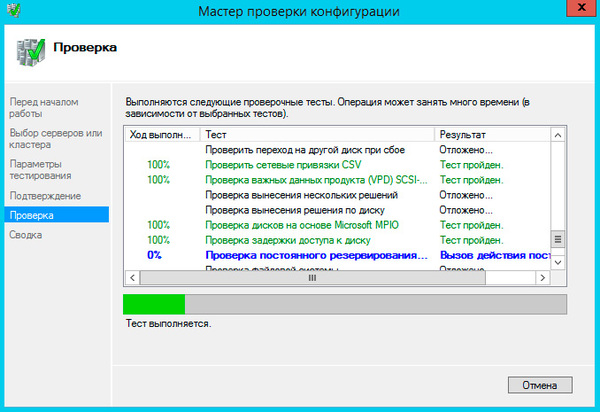

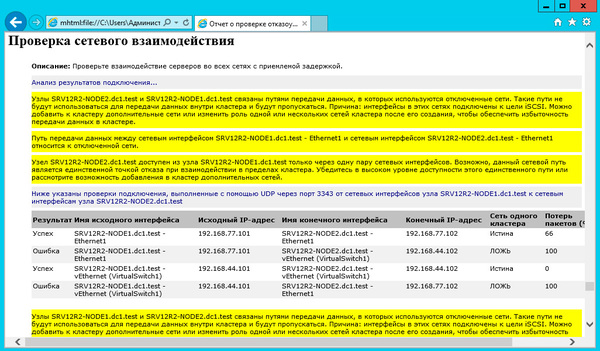

Теперь у нас все готово к созданию кластера. Запустим оснастку Диспетчер отказоустойчивых кластеров и выберем действие Проверить конфигурацию.

В настройках мастера добавим настроенные нами узлы и выберем выполнение всех тестов.

Если существенных ошибок не обнаружено работа мастера завершится и он предложит вам создать на выбранных узлах кластер.

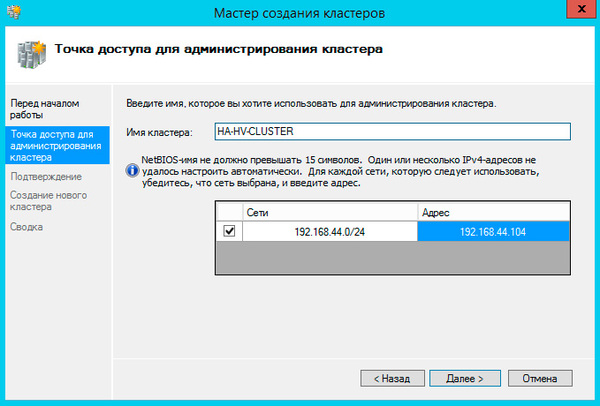

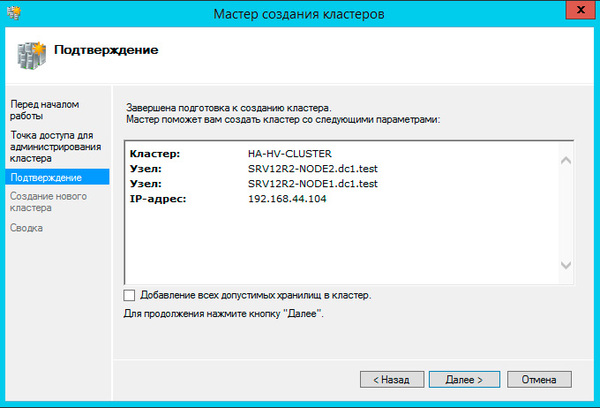

При создании кластера для него создается виртуальный объект, обладающий сетевым именем и адресом. Укажем их в открывшемся Мастере создания кластеров.

На следующем шаге советуем снять флажок Добавление всех допустимых хранилищ в кластер, так как мастер не всегда правильно назначает роли дискам и все равно придется проверять и, при необходимости исправлять, вручную.

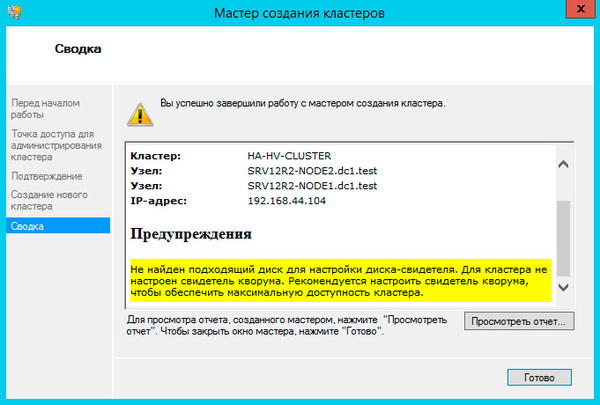

Больше вопросов не последует и мастер сообщит нам, что кластер создан, выдав при этом предупреждение об отсутствии диска-свидетеля.

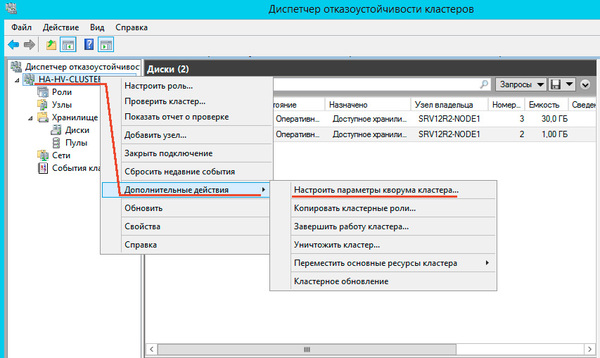

Закроем мастер и развернем дерево слева до уровня Хранилище - Диски, в доступных действиях справа выберем Добавить диск и укажем подключаемые диски в открывшемся окне, в нашем случае их два.

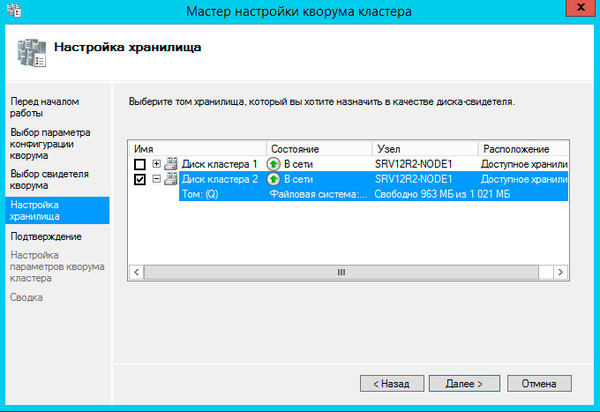

Далее последовательно выбираем: Выбрать свидетель кворума - Настроить диск-свидетель и указываем созданный для этих целей диск.

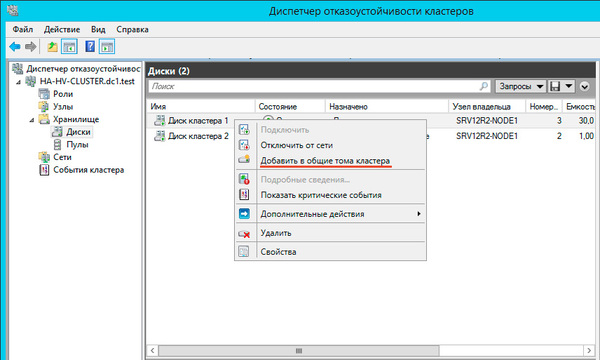

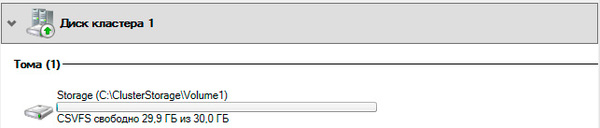

Теперь настроим диск хранилища, с ним все гораздо проще, просто щелкаем на диске правой кнопкой и указываем: Добавить в общие хранилища кластера.

Для того, чтобы диск мог использоваться сразу несколькими участниками кластера на нем создается CSVFS - реализуемая поверх NTFS кластерная файловая система, впервые появившаяся в Windows Server 2008 R2 и позволяющая использовать такие функции как Динамическая (Живая) миграция, т.е. передачу виртуальной машины между узлами кластера без остановки ее работы.

Общие хранилища становятся доступны на всех узлах кластера в расположении C:\ClusterStorage\VolumeN. Обратите внимание, что это не просто папки на системном диске, а точки монтирования общих томов кластера.

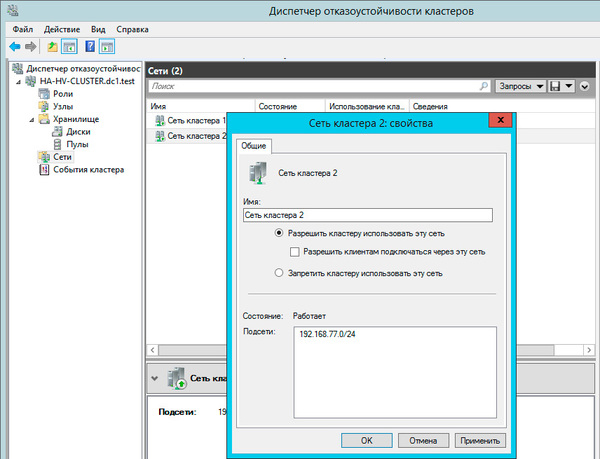

Закончив с дисками, перейдем к настройкам сети, для этого перейдем в раздел Сети. Для сети, которая подключена к сети предприятия указываем Разрешить кластеру использовать эту сеть и Разрешить клиентам подключаться через эту сеть. Для сети хранения данных просто оставим Разрешить кластеру использовать эту сеть, таким образом обеспечив необходимую избыточность сетевых соединений.

На этом настройка кластера закончена. Для работы с кластеризованными виртуальными машинами следует использовать Диспетчер отказоустойчивости кластеров, а не Диспетчер Hyper-V, который предназначен для управления виртуалками расположенными локально.

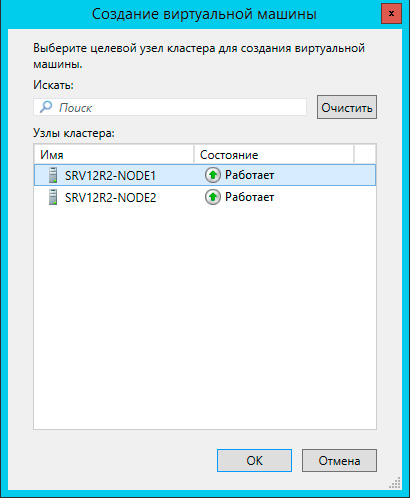

Чтобы создать виртуальную машину перейдите в раздел Роли в меню правой кнопки мыши выберите Виртуальные машины - Создать виртуальную машину, это же можно сделать и через панель Действия справа.

Прежде всего выберите узел, на котором будет создана виртуальная машина. Каждая виртуалка работает на определенном узле кластера, мигрируя на другие узлы при остановке или отказе своей ноды.

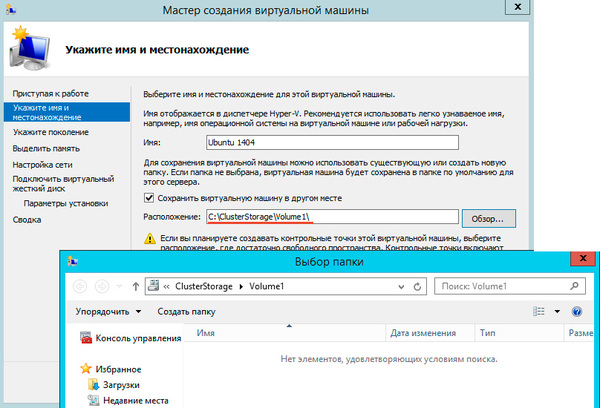

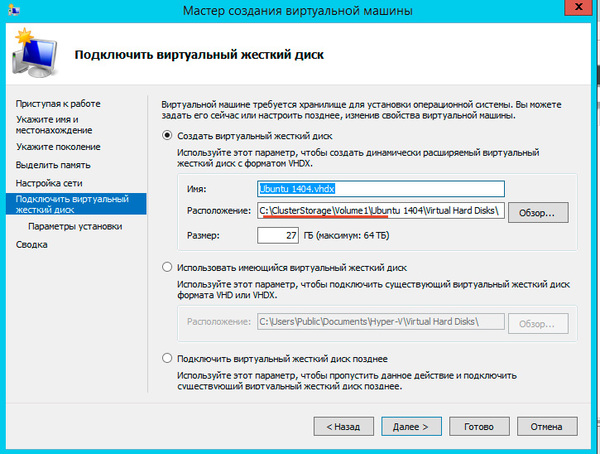

После выбора узла откроется стандартный Мастер создания виртуальной машины, работа с ним не представляет сложности, поэтому остановимся только на значимых моментах. В качестве расположения виртуальной машины обязательно укажите один из общих томов кластера C:\ClusterStorage\VolumeN.

Здесь же должен располагаться и виртуальный жесткий диск, вы также можете использовать уже существующие виртуальные жесткие диски, предварительно скопировав их в общее хранилище.

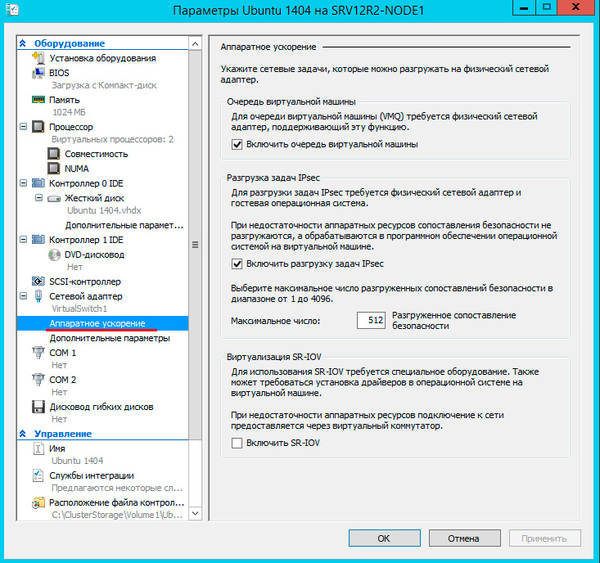

После создания виртуальной машины перейдите в ее Параметры и в пункте Процессоры - Совместимость установите флажок Выполнить перенос на физический компьютер с другой версией процессора, это позволит выполнять миграцию между узлами с разными моделями процессоров одного производителя. Миграция с Intel на AMD или наоборот невозможна.

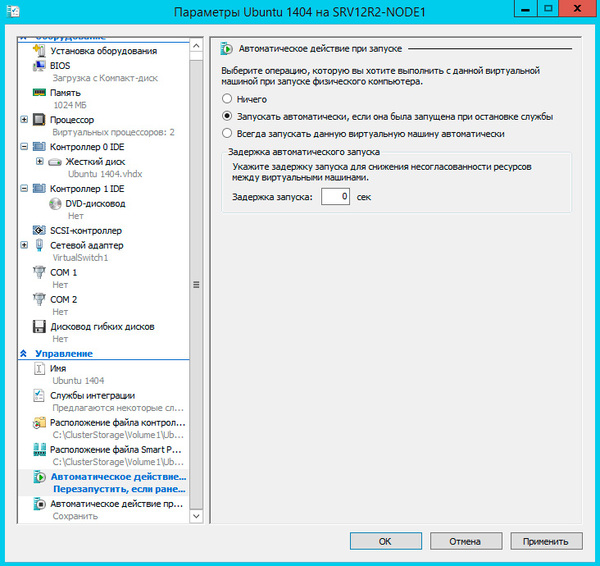

Не забудьте настроить автоматические действия при запуске и завершении работы узла, при большом количестве виртуальных машин не забывайте устанавливать задержку запуска, чтобы избежать чрезмерной нагрузки на систему.

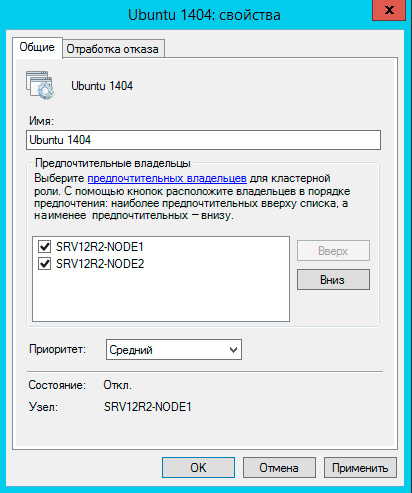

Закончив с Параметрами перейдите в Свойства виртуальной машины и укажите предпочтительные узлы владельцев данной роли в порядке убывания и приоритет, машины имеющие более высокий приоритет мигрируют первыми.

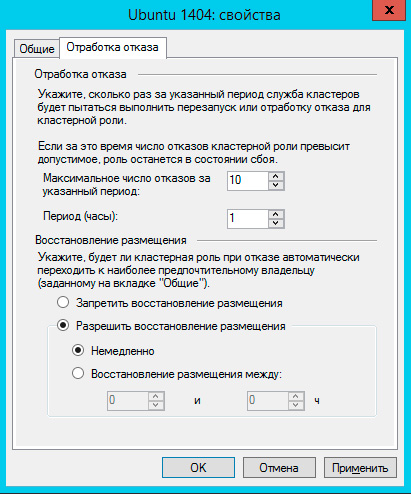

На закладке Обработка отказа задайте количество допустимых отказов для виртуальной машины за единицу времени, помните, что отказом считается не только отказ узла, но и потеря пульса виртуальной машины, например, ее зависание. На время настройки и тестов есть смысл указать значения побольше.

Также настройте Восстановление размещения, эта опция позволяет передавать виртуальные машины обратно наиболее предпочтительному владельцу при восстановлении его нормальной работы. Чтобы избежать чрезмерных нагрузок воспользуйтесь опцией задержки восстановления.

На этом настройка виртуальной машины закончена, можем запускать и работать с ней.

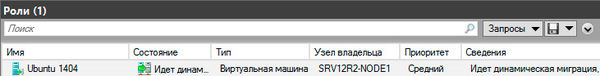

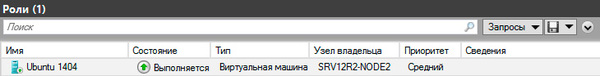

Теперь самое время проверить миграцию, для этого щелкните на машине правой кнопкой мыши и выберите Переместить - Динамическая миграция - Выбрать узел. Виртуалка должна переместиться на выбранную ноду не завершая работы.

Каким образом происходит миграция в рабочей обстановке? Допустим нам надо выключить или перезагрузить первый узел, на котором в данный момент выполняется виртуальная машина. Получив команду на завершение работы узел инициирует передачу виртуальных машин:

Завершение работы приостанавливается до тех пор, пока не будут переданы все виртуальные машины.

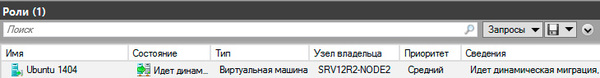

Когда работа узла будет восстановлена, кластер, если включено восстановление размещения, инициирует обратный процесс, передавая виртуальную машину назад предпочтительному владельцу.

Что произойдет если узел, на котором размещены виртуальные машины аварийно выключится или перезагрузится? Все виртуалки также аварийно завершат свою работу, но тут-же будут перезапущены на исправных узлах согласно списка предпочтительных владельцев.

Как мы уже говорили, прижившийся в отечественной технической литературе термин "отказоустойчивый" неверен и более правильно его было бы переводить как "с обработкой отказа", либо использовать понятие "высокая доступность", которое отражает положение дел наиболее верно.

Кластер Hyper-V не обеспечивает отказоустойчивости виртуальным машинам, отказ узла приводит к отказу всех размещенных на нем машин, но он позволяет обеспечить вашим службам высокую доступность, автоматически восстанавливая их работу и обеспечивая минимально возможное время простоя. Также он позволяет значительно облегчить администрирование виртуальной инфраструктуры позволяя перемещать виртуальные машины между узлами без прерывания их работы.

Научиться настраивать MikroTik с нуля или систематизировать уже имеющиеся знания можно на углубленном курсе по администрированию MikroTik. Автор курса, сертифицированный тренер MikroTik Дмитрий Скоромнов, лично проверяет лабораторные работы и контролирует прогресс каждого своего студента. В три раза больше информации, чем в вендорской программе MTCNA, более 20 часов практики и доступ навсегда.

Example 2

Adds a virtual hard disk to SCSI controller number 0 on virtual machine Test.

Читайте также: