Несовместимость монитора и видеокарты может ли быть

Здравствуйте! Сегодня разберемся — может ли монитор не поддерживать видеокарту, по каким причинам такое происходит, как узнать и что делать, если подобное наблюдается.

Для понимания темы также советую ознакомиться: «Все виды разъемов у компьютерных мониторов».

Небольшой совет

Однако при самостоятельной сборке компьютера, рекомендую все-таки, кроме хорошей дискретной видяхи, приобрести также процессор с интегрированной. Почему так?

Во-первых, любое устройство, каким бы совершенным оно не было, может сломаться в самый неподходящий момент. И пока графический ускоритель находится на гарантийном обслуживании, или вы собираете деньги на новый, чтобы вообще не остаться без компьютера, можно воспользоваться встроенной видяхой.

Во-вторых, в жизни, кроме поломки электроники, периодически происходят всякие неприятные казусы, и часто срочно требуется определенная сумма денежек.

В таком случае мощная видеокарта – своеобразная страховка. Удачно продав ее, можно даже за б/у устройство выручить до 80% стоимости. Это не так накладно, чем продавать золото, особенно фамильное, да и временно расстаться с хорошей видеокартой менее болезненно для геймера, чем сразу полностью с компом.

Не дай Бог, конечно, чтобы вам когда-нибудь пригодился в жизни этот совет.

И напоследок советую ознакомиться с публикациями про все разъемы и выходы, которые есть на материнской плате, и какой лучше выбирать кабель для подключения: DVI или HDMI. Буду чертовски признателен каждому персонально, кто сделает репост на эту статью в социальных сетях. Увидимся завтра! Пока!

Приветствую друзья

Сразу коротко ответ:

Может ли монитор не поддерживать видеокарту — редкое явление, касается старых мониторов ЭЛТ или специфических, обычно при наличии VGA и/или DVI на мониторе и видеокарте — они друг с другом будут работать корректно.

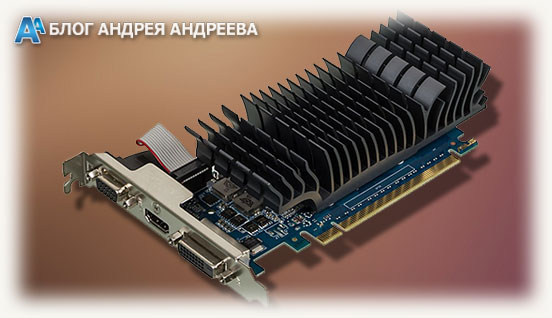

Дискретный графический ускоритель

Такое устройство выполнено в виде отдельного модуля, который монтируется в специальный слот. Оно оборудовано собственными видеопамятью, процессором и системой охлаждения.

Мощная видеокарта сильно греется во время работы, поэтому требует и хорошего охлаждения. Как правило, оборудованы они двумя или тремя большими кулерами, которые могут создавать во время пиковых нагрузок солидный шум.

В зависимости от технических характеристик, такая видеокарта позволяет запускать любые игры. При этом геймер не будет страдать от просадки ФПС, лагов, фризов и вылетов на рабочий стол, если мощность устройства соответствует минимальным системным требованиям игры.И даже если немного не дотягивает, графический ускоритель можно разогнать с помощью специальных утилит. Кроме того, современные видеокарты для передачи видеосигнала часто используют слоты DVI и HDMI (читайте детальнее про разъемы или видео выходы у видеокарт).

Так куда подключать провод?

К той видеокарте, которая мощнее. Если вы купили готовый комп, скорее всего, мощнее будет дискретная видеокарта (однако не помешает уточнить спецификацию). Если дискретной видяхи нет, подключать монитор придется к материнской плате.

Обнаружить необходимый разъем несложно: слот на материнской плате расположен выше и почти всегда вертикально. Порты на дискретном графическом ускорителе, как правило, расположены ниже всего и горизонтально.

К сожалению, если у вас оба типа видеокарт и оба разъема, подключить к системнику два монитора не получится. Вернее, получится, конечно, но работать будет только один. Такое ограничение устанавливается в БИОСе, когда основным назначается один из явных графических ускорителей.

Кстати, если вы решили поэкспериментировать и поменять используемый порт, настройки БИОСа также следует поменять, иначе изображения на мониторе не будет. Следует отметить, что это справедливо только к операционным системам семейства Windows.

В Unix такие ограничения можно обойти, однако необходим очень высокий уровень «красноглазия».

Может возникнуть закономерный вопрос: можно ли выводить изображение с дискретной видеокарты через интерфейс на материнской плате, если один из портов сломался? Увы, тоже нет. Архитектура компьютера такого решения не предусматривает.

В случае, если вы переключили в БИОС необходимые настройки и используете интегрированный графический ускоритель, дискретный продолжает работать в «полусонном» режиме: потребляет энергию и даже шевелит кулером.

Но так как нагрузка не подается, то и потребляемая мощность небольшая.

Поэтому, если есть видеокарта, используйте потенциал компьютера на полную мощность.

Совместимость старых мониторов с новыми видеокартами и наоборот

Оргтехника — такая сфера, где без строгой стандартизации и унификации далеко не уедешь. Брендов, выпускающих различные комплектующие и периферические устройства, как и самих таких девайсов, огромное количество.

Если не внедрить единые протоколы обмена данными между ними, крупные компании потеряют часть клиентов и начнут терпеть убытки, а этого никто не допустит.

Исключением является, пожалуй, только компания Apple с собственной экосистемой, но и там все девайсы можно связать по «родным» протоколам.

В итоге мы имеем следующее: независимо от характеристик монитора — будь то навороченный ЖК экран, работающий на частоте 144 Гц и выдающий изображение разрешением 4К, и не самая новая видеоплата, или, наоборот, высокопроизводительный современный видеоадаптер и древний пузатый монитор. Они должны корректно коннектиться и выдавать изображение.

Конечно, не факт, что при такой конфигурации будут запускаться видеоигры, но уж просмотр фильмов вам гарантирован.

Проблема, с которой может столкнуться пользователь — несовместимость портов. К примеру, старые мониторы были оборудованы гнездом VGA — трапециевидным штекером, маркированным синим цветом. На современных видеоадаптерах, даже в бюджетном сегменте, такой слот сегодня большая редкость.

Но и эта проблема имеет решение. Существуют переходники и конверторы сигнала, чтобы связать любые порты разного вида, в том числе аналоговые с цифровыми. При удачном подборе адаптера все будет корректно работать, даже если порты разные.

Почему нет изображения, если все совместимо

Но не исключено, что при попытке «подружить», казалось бы, вполне совместимые девайсы, может отсутствовать картинка на экране. Из-за чего такое происходит?

Одна из возможных причин — неподходящий переходник. В некоторых случаях требуется не просто переходник, то есть вилка, связывающая разные штекеры в единую электрическую цепь, а именно адаптер, который получает дополнительное питание на преобразующую плату.

Второе, что может вызывать неполадки — разные типы портов DVI. В этом формате есть несколько видов слотов — аналоговый, цифровой и аналогово-цифровой.

Они почти совместимы, но аналоговый порт не будет подавать сигнал на цифровой, и соответственно, наоборот. И даже если в аналогово-цифровой связке все нормально работало, а потом вдруг перестало, не исключено, что на штекере перегорела одна из цепей.

Прочие неполадки в этой области мне не известны. Если вам встречались еще какие-то не стыковки и несоответствия, давайте обсудим в комментариях. О том, что такое разрешение экрана монитора, можно почитать тут. До скорой встречи!

Привет, друзья! Все больше процессоров, представленных на рынке, имеют интегрированный графический ускоритель. Для того, чтобы воспользоваться этими функциями, и материнская плата нужна соответствующая – оборудованная портом для подключения монитора.

Несмотря на то, что прогресс не стоит на месте, это чаще всего не HDMI или DVI-D, а старый добрый VGA.

Сегодня мы с вами разберем, к чему подключать монитор – к материнке или видеокарте и в каких случаях один способ предпочтительнее другого. Советы из этого поста пригодятся всем, кто занимается самостоятельной сборкой компьютера.

Интегрированная видеокарта

Для начала разберем особенности каждого из типов устройств. Интегрированная видеокарта – виртуальное устройство, созданное как дополнительный логический блок в процессоре. Она не имеет собственной видеопамяти и использует оперативную память компьютера.

Технологии развиваются, и сегодня интегрированные видеокарты – довольно мощные устройства, которые способны решить множество поставленных пользователем задач: воспроизведения мультимедийных файлов, работа с графикой, в том числе 3Д, рендеринг видео и даже запуск не слишком требовательных к мощности современных игр (или теплых ламповых шедевров ушедших лет).Одним из преимуществ такой видеокарты можно считать и то, что шума при работе она вообще не издает. Шуметь будет только кулер процессора, но он работает независимо от подаваемой нагрузки.

Недостаток встроенной видеокарты в том, что она по мощности проигрывает даже дискретным устройствам, средней ценовой категории. Если вы заядлый геймер, такой вариант вам однозначно не подходит.

Разбираемся

- В большинстве случаев, если монитор не старше пяти лет или немного больше, и видеокарта такого же возраста, то они в 99% случаев будут совместимы и поддерживать друг друга.

- Видеокарта например может содержать только VGA (обычно это старые видеокарты). А монитор — только DVI. Поэтому их нельзя подключить один к другому, но можно использовать всякие кабели-переходники (лично я не особо советую, возможны глюки). Вообще существует VGA порт, это устаревший, был актуален в эпоху ЭЛТ-мониторов. DVI и HDMI — это уже современные видеоразьемы. DVI можно подключить HDMI. У меня была материнка, там был только HDMI-выход, а монитор был DVI, купил кабель нонейм, при помощи которого можно подключить с HDMI к DVI, все работало нормально.

- Редко — монитор может иметь один тип DVI, а видеокарта другой, и между этими разными типами не предусмотрена передача видеосигнала. Но это редко.

- Иногда может быть такое, что видеокарта выдает большое разрешение, которое не поддерживается монитором. Решение — уменьшить разрешение в безопасном режиме, где оно по умолчанию будет более низким.

Если вы подключили монитор к видеокарте, а картинки нет, то это может быть что угодно. Может у вас есть встроенное видеоядро в процессоре и в биосе выставлено, чтобы это видеоядро было главным. Попробуйте подключить к видеовыходам материнской платы, если они конечно есть. Еще бывает что нет изображения из-за глюка оперативки — ее нужно извлечь из разьемов и потом поставить обратно. Тоже самое можно сделать и с видеокартой.

Но первым делом — проверьте параметры биоса, чтобы там не было указано, что главным адаптером выступает встроенное видеоядро процессора (обозначаться как iGPU, а дискретная видеокарта просто GPU).

Если на мониторе сзади вы видите такие порты:

А на видеокарте тоже такие:

Значит монитор и видеокарта на 99.99% совместимы. Подключить можно как по синему разьему VGA, так и по белому DVI, то есть даже не один, а два способа. Если нет картинки — нужно искать причину в другом.

Жемчужная автор

ntrance

ntrance

Крил

wiper1

Vladlen

wiper1

Alexandr.S

Жемчужная автор

Alexandr.S

Жемчужная автор

Alexandr.S

Домашние страницы сахалинцев. . Фотогалерея Фотографии Сахалина

ants

Alexandr.S

tuzik2062

Morfei

Подключайте телевизор к системнику, выставляйте разрешение 800х600, потом монитор подключайте к системнику

oldz

Жемчужная автор

oldz

Жемчужная автор

oldz

Дискетка

oldz

Gery

Grrr

Жемчужная автор

Rize

Жемчужная автор

с 1 января 2025 года организациям запретят использовать средства защиты информации, страны происхождения которых — иностранные государства, совершающие в отношении России недружественные действия. Это коснётся и средств защиты данных, чьи производители — под юрисдикцией таких государств.

мда - конечно. Что-то я сомневаюсь что к 25 году наши что то сделают вменяемое. БасГов. Госуслуги. все ЕСИА - все тупит по жести. а тут замах на безопасность где нужна бесперебойная и точная работа софта.

влияет ли 2 монитора на производительность - в случае если , они как 2 отдельных моника ,а не как 2й продолжение 1го..

Например , если будет на 1 мониторе фул скрин игра , а на 2м просто ничего не будет открыто , ну или браузер

Влияет на ГП каплю, если он пустой, а если там видос поставить или ещё чё на слабом железе, то буду просадки

Влияет на ГП каплю, если он пустой, а если там видос поставить или ещё чё на слабом железе, то буду просадки

RX 570 4GB видеокарта

i5 3550 процессор

8gb ddr3 1600mhz , но на момент 2го моника будет уже 16gb

ssd crucial 240gb

hdd wd balack 500gb

Попробуй врубить игру на мейн экране, и видос или кинчик на втором, если у тебя будет ещё пару софтин открыто, в теории ты заметишь просадки

Я подумал вопрос в твоей производительности, тогда да, однозначно влияет.

А по поводу производительности ПК, да, тоже бывает

влияет ли 2 монитора на производительность - в случае если , они как 2 отдельных моника ,а не как 2й продолжение 1го..

Например , если будет на 1 мониторе фул скрин игра , а на 2м просто ничего не будет открыто , ну или браузер

Нет.Это просто 2 монитор,он просто выводит изображение на экран,как он может повлиять на производителньость Это если ты,запустишь игру/майнер/браузер и отборвазишь на 2 мониторе то вляить будет и то,моник то тут ни при чем,ты с компа запускаешь все и тупо выводишь на 2 монитор

Влияет на ГП каплю, если он пустой, а если там видос поставить или ещё чё на слабом железе, то буду просадки

1)Вряд ли тот,у кого слабое железо будет покупать себе 2 монитор,кто так делает Сисадмины захудалые разве что

2)Сомневаюсь,что тот 1 и сказал(а):↑

Я подумал вопрос в твоей производительности, тогда да, однозначно влияет.

А по поводу производительности ПК, да, тоже бывает

Каким образом налчие 2 моника может повлиять на призводительность,если комп 1 и ты с него все запускаешь,а не сч моника,который служит средством вывода изображения

Нет и никак не могут.Это просто 2 монитор,он просто выводит изображение на экран,как он может повлиять на производителньость Это если ты,запустишь игру/майнер/браузер и отборвазишь на 2 мониторе то вляить будет и то,моник то тут ни при чем,ты с компа запускаешь все и тупо выводишь на 2 монитор

1)Вряд ли тот,у кого слабое железо будет покупать себе 2 монитор,кто так делает Сисадмины захудалые разве что

2)Сомневаюсь,что тот 1 и

Что за умалишённый бред, второй монитор это доп нагрузка на гпу,

1%(или меньше) доп нагрузки для гпу от просто рабочего стола

если на втором мониторе открыть приложение которое будет сильно нагружать видеокарту то фпс на первом монике сильно упадет.

Да причем тут второй монитор,если ты энивей открываешь приложение через 1 компьютер.Да выведешь ты на второй моник приложение или игру открытую,чтоб она там отображалась,да нагрузхка на комп вырастет и производительность упадет,но сам монитор то не просаживает производителньость

ну просто обычно на втором монике запущено что-то легковесное для гпу, типа браузера, поэтому он особо не влияет.

Так оно обычно и есть,и поэтому не влияет на производителньость.Конечно,если на 2 монике будет игра,то производительность сядет

1%(или меньше) доп нагрузки для гпу от просто рабочего стола

Да причем тут второй монитор,если ты энивей открываешь приложение через 1 компьютер.Да выведешь ты на второй моник приложение или игру открытую,чтоб она там отображалась,да нагрузхка на комп вырастет и производительность упадет,но сам монитор то не просаживает производителньость,правильно?

Так оно обычно и есть,и поэтому не влияет на производителньость.Конечно,если на 2 монике будет игра,то производительность сядет

По твоей логики монитор вообще не просаживает производительность. Второй монитор жрет столько же сколько и первый, и нагрузка будет в зависимости от того что ты там запускаешь. На маке вообще второй моник особенно хай резолюшен довольно сильно душит производительность, ибо там уай гораздо тяжелее виндового

Читайте также: