Как удалить iscsi диск в qnap

В этой статье я хотел бы поделится опытом создания дискового хранилища, который вылился во множество экспериментов, проб, ошибок, находок, приправленных горькими разочарованиями. И, наконец, завершился в неком интересном, относительно бюджетном и быстром хранилище.

Если у вас есть подобная задача или вас просто заинтересовал заголовок, то добро пожаловать под хабракат.

Пролог

Итак, недавно перед нашим отделом встала задача обеспечить кластер из гипервизоров VMware ESXi 5.1 хранилищем большого обьема. На нем же мы запланировали расположить шифрованный maildir для dovecot и “облачное” файловое хранилище. Обязательным условием выделения бюджета было обеспечение места для хранения критически важной для компании информации, причем этот раздел должен быть зашифрован.

Железо

К сожалению, а может и к счастью, под такие амбициозные задачи большим бюджетом нас не обременили. Поэтому позволить себе какое-либо брендовое хранилище мы, как настоящие поклонники максимализма, не могли, и в рамках выделенных материальных ресурсов выбрали следующее железо:

- Серверный корпус Supermicro CSE-836BE16-R920B

Тут было много рассуждений, выбирали количество юнитов, размер жестких дисков, их скорость, корпус или сразу платформа, пересмотрели множество вариантов, покурили интернетов и в итоге остановились на этом варианте, как на оптимальном под наши задачи. - Материнская плата Supermicro MBD-X9DRI-F-O

Главным условием было наличие 4 портов PCI-E x8. - Процессоры Intel Xeon E5-2603

Выбор был прост — на что хватило денег. Вдобавок пришлось ставить 2 процессора сразу, а не сначала один, потом, если надо будет, то докупить, ибо с одним занятым слотом работает только 3 PCI-E, а нам надо было 4. - Диски Seagate Constellation ES.3 ST3000NM0033

SATA потому что дешевле, и в те же деньги мы получали многократно большее количество свободного места, нежели при использовании SAS. - RAID контроллер Adaptec ASR-7805Q

Раз уж это СХД, то с контроллером мелочиться не стали. У этой серии есть SSD кэширование, которое очень бы нам пригодилось, и есть BBU сразу в комплекте, что тоже весьма полезная опция. - SSD диски Intel SSDSC2CW240A310

Они нужны были исключительно для того, чтобы работал MaxCache (он же SSD кэш). - Сетевые карты Intel X520 DA2

Чтобы избежать узкого места на сетевых интерфейсах, надо было обеспечить 10Gb линк между нодами ESXi и СХД. После изучения предложений рынка мы пришли может и к не самому элегантному, но зато к подходящему по цене и скорости варианту с использованием 10 гигабитных сетевых карт.

Реализация

Выдавать таргеты, то бишь выделять ресурсы СХД потребителям, мы решили при помощи iSCSI и NFS. Наиболее разумным и быстрым решением, конечно, было бы использовать FCoE, чтобы не влезать в TCP с соответствующими ему накладными расходами, что, в общем-то можно было бы сделать с нашими сетевыми картами, но, к сожалению, у нас нет SFP свитча с поддержкой FCoE, купить его не было возможности, так как это стоило бы нам 500 т.р. сверху.

Еще раз покурив интернеты, нашли выход из этого в технологии vn2vn, но ESXi научится работать с vn2vn только к 6.x версии, поэтому, не думая дальше, приступили к тому, что есть.

Наш корпоративный стандарт для Linux серверов — CentOS, но в текущем ядре (2.6.32-358) шифрование работает очень медленно, поэтому пришлось использовать в качестве ОС Fedora. Конечно это полигон Red Hat, но в последних ядрах Linux данные шифруются практически “на лету”, а остальное нам, вроде бы, и не нужно.

К тому же текущая 19 версия будет использована как основа для RHEL 7, а следовательно позволит нам в будущем безболезненно перейти на CentOS 7.

Таргеты

Дабы не раздувать статью и не отдаляться от темы я опускаю все неинтересное типа сборки железа, бодания с контроллером, установки ОС и прочего. Также постараюсь как можно меньше описывать сам таргет и ограничиться только его работой с инициатором ESXi.

- правильно работающее кеширование — диски довольно медленные, выжать из себя они могут только 2000 iops;

- максимально высокую скорость работы непосредственно дисковой подсистемы в целом, читай (даешь как можно больше iops).

istgt

iSCSI для VMWare ESXi 5.1 на SCST и Fedora

И теперь, собственно, то, ради чего мы все тут собрались.

Небольшая инструкция по настройке таргета и инициатора ESXi. Я не сразу решил попробовать написать статью на Хабр, поэтому инструкция будет не пошаговой — восстанавливаю по памяти, но в ней будут основные моменты настройки, которые позволили добиться нужных результатов.

Подготовка ESXi 5.1

InitialR2T=No

ImmediateData=Yes

MaxConnections=1

MaxRecvDataSegmentLength=1048576

MaxBurstLength=1048576

FirstBurstLength=65536

DefaultTime2Wait=0

DefaultTime2Retain=0

MaxOutstandingR2T=32

DataPDUInOrder=No

DataSequenceInOrder=No

ErrorRecoveryLevel=0

HeaderDigest=None

DataDigest=None

OFMarker=No

IFMarker=No

OFMarkInt=Reject

IFMarkInt=Reject

Потребуется отключить Interrupt Moderation и LRO для сетевых адаптеров. Сделать это можно командами:

Для того чтобы повторно не устанавливать эти значения, их можно добавить в этот скрипт:

Подготовка Fedora

Скачиваем и устанавливаем в минимальном варианте последнюю версию Fedora.

Обновим систему и перезагрузимся:

Система будет работать только в локальной сети, поэтому я отключил файервол и SELinux:

Настроим сетевые интерфейсы и отключим сервис NetworkManager.service. Он не совместим с BRIDGE интерфейсами, а это было необходимо для NFS.

На сетевых картах отключено LRO.

По рекомендациям от Intel измененны следующие параметры системы:

Подготовка таргета

Для использования SCST рекомендуется добавить патчи в ядро. Это необязательно, но с ними производительность выше.

Во время создания хранилища последняя версия ядра была — 3.10.10-200. К моменту когда вы будете читать статью ядро уже может обновиться, но не думаю, что это сильно повлияет на процесс.

Но для того, чтобы не возникло трудностей опишу подготовку подробно.

Перейдем в его среду:

Установим пакеты для сборки и подготовим исходники ядра:

Теперь потребуются сами патчи. Скачаем SCST из svn репозитория:

Скопируем необходимые пачти в ~/rpmbuild/SOURCES/

Добавляем строчку в конфиг ядра:

Приступим к редактированию kernel.spec.

Добавляем наши патчи, желательно после всех остальных:

Добавляем команду применения патча, рекомендовано добавить после остальных записей:

После завершения сборки устанавливаем ядро firmware и заголовочные файлы ядра:

После успешной, надеюсь, загрузки перейдите в каталог с исходниками SCST и уже пользователем root соберите сам таргет:

После сборки добавьте сервис в автозапуск:

И настройте конфиг в /etc/scst.conf. К примеру мой:

Создайте файлы, разрешающие или запрещающие подключения к таргетам с определенных адресов, если вам это необходимо:

После настройки файлов конфигураци запустите SCST:

Если все было сделано правильно, то в ESXi появится соответствующий таргет.

Надежная очистка диска - это особый способ, с помощью которого сетевой накопитель перезаписывает данные на жестком диске для того, чтобы хранящиеся данные были гарантированно уничтожены без возможности восстановления.

Выполните следующие действия для того чтобы запустить процедуру очистки диска:

1. Подключитесь к веб-интерфейсу сетевого хранилища и откройте Хранение и моментальные снимки.

2. В открывшемся окне перейдите в раздел Диски/VJBOD.

3. Нажмите на кнопку Действие >> Надежная очистка

4. Выберите жесткие диски которые хотите очистить.

В списке отображаются только свободные диски не являющиеся частью RAID и не имеющие ни одного тома.

Если на диске создан пул хранения или привязана iSCSI-диски, нужно предварительно их удалить.

5. Вы можете оставить параметры очистки по умолчанию или выбрать настройки затирания диска.

6. Введите пароль от учетной записи admin и нажмите на кнопку Применить.

7. Процесс очистки диска запущен

8. Состояние очистки диска, вы можете отслеживать в разделе Диски\JBOD.

Оптимизация производительности iSCSI

Если требуется обеспечить высокую производительность системы хранения, например, при использовании виртуализации, в целях оптимизации работы службы iSCSI и дисков сетевого накопителя следуйте приведенным ниже рекомендациям:

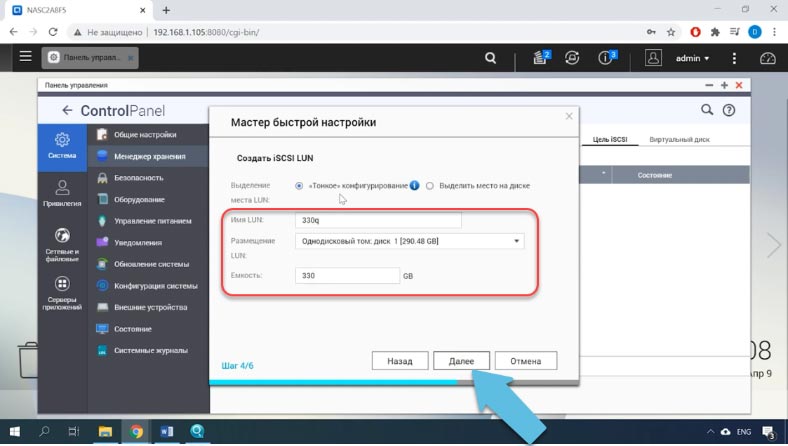

| • | Используйте выделение места на диске: При создании iSCSI LUN, чтобы добиться немного более высокой производительности iSCSI, выберите режим "Выделить место на диске". При этом, однако, будут утеряны все преимущества "тонкого" конфигурирования. |

| • | Создайте несколько LUN: Создайте несколько LUN в соответствии с количеством процессоров сетевого накопителя. Информацию о доступных ресурсах можно посмотреть на странице "Состояние" > "Монитор ресурсов". Если сетевой накопитель оснащен четырьмя процессорами, для достижения оптимальной производительности iSCSI рекомендуется создать четыре или большее число LUN. |

| • | Используйте различные LUN для приложений, генерирующих высокую нагрузку: Распределите приложения, требующие высокой производительности чтения/записи, например, базы данных и виртуальные машины, на различные LUN. Например, при наличии двух виртуальных машин, выполняющие интенсивные операции чтения и записи данных на LUN, рекомендуется создать на сетевом накопителе два LUN, чтобы эффективно распределить нагрузку от двух виртуальных машин. |

Список контроля доступа

Список контроля доступа (расширенный ACL) позволяет настроить политики маскирования LUN для каждого из подключенных инициаторов. Если подключенный инициатор отсутствует в списке, к этому инициатору применяется политика по умолчанию ("Default").

Примечание: Данная функция и ее содержание относятся только к некоторым моделям: Сведения о поддерживаемых моделях можно найти в сравнительной таблице на сайте QNAP.

Чтобы использовать данную функцию, нажмите на "Добавить политику". Введите имя политики и IQN инициатора, после чего назначьте права доступа к каждому из LUN, созданных на сетевом накопителе, и нажмите "Применить" .

Описание каждого из полей приводится в следующей таблице:

Только для чтения

Подключенный инициатор сможет осуществлять только чтение данных с LUN.

Подключенный инициатор сможет осуществлять чтение и запись данных на LUN.

LUN будет невидим для подключенного инициатора.

При отсутствии назначенной политики маскирования LUN для подключенного инициатора iSCSI используется политика по умолчанию. Политикой по умолчания в системе разрешается доступ на чтение и на запись для всех подключенных инициаторов iSCSI. Для изменения политики по умолчанию необходимо щелкнуть на ней и нажать на "Изменить". Чтобы удалить политику, выберите ее и нажмите на "Удалить".

Примечание: Перед редактированием политики маскирования LUN по умолчанию необходимо создать на сетевом накопителе хотя бы один LUN.

Совет: Как найти IQN инициатора?

Запустите инициатор Microsoft iSCSI и перейдите на вкладку "Конфигурация". На ней можно найти IQN инициатора.

В этой статье для новичков, мы обсудим как вернуть данные со iSCSI LUN на примере устройства QNAP TS-412. Как восстановить сетевой диск или достать данные с поврежденного сетевого устройства.

Хотя протокол iSCSI и является достаточно старым, он не теряет свою популярность в построении сетевых хранилищ. Это протокол для взаимодействия и управления системами хранения между серверами и клиентами.

Данный протокол используется для передачи данных по сети и позволяет видеть сетевой носитель как локальный физический, в то время как на самом деле хранилище данных находиться на другом устройстве. Такие носители называют LUN-ами.

LUN – это номер логического объекта. Другими словами, это сетевой диск или его раздел, который имеет свой номер в сети iSCSI. Данный функционал доступен в Synology, QNAP и других серверных устройствах.

NAS vs SAN

Существует два метода доступа к данным, находящимся на другом компьютере: файловый (когда у удалённого компьютера запрашивают файл, а какими файловыми системами это сделано — никого не волнует), характерные представители NFS, CIFS (SMB); и блочный — когда у удалённого компьютера запрашивают блоки с дискового носителя (аналогично тому, как их читают с жёсткого диска). В этом случае запрашивающая сторона сама себе делает на блочном устройстве файловую систему, а сервер, отдающий блочное устройство, знать не знает про файловые системы на нём. Первый метод называют NAS (network attached storage), а второй — SAN (storage area network). Названия вообще указывают на другие признаки (SAN подразумевает выделенную сеть до хранилищ), но так сложилось, что NAS — это файлы, а SAN — это блочные устройства по сети. И хотя все (?) понимают, что это неправильные названия, чем дальше, тем больше они закрепляются.

Как вернуть данные из файла образа iSCSI

Для второго решения нужно «скормить» файл в программу Hetman RAID Recovery.

Откройте утилиту, перейдите во вкладку «Сервис» и нажмите «Монтировать». Укажите путь к образу, чтобы программа его отобразила в поле «образы». Укажите здесь «Все файлы», затем отметьте его и нажмите «Открыть».

В менеджере появится смонтированный носитель. Кликните по нему правой кнопкой мыши и нажмите «Открыть», выберите «Полный анализ», укажите файловую систему и нажмите «Далее», и по завершении Готово. Как видите программа нашла и отобразила данные, которые лежали на сетевом носителе. Чтобы их вернуть, отметьте нужные и нажмите «Восстановить», укажите путь куда их сохранить и кликните еще раз по кнопке. По завершении все они будут в указанной ранее папке.

Как видите второй способ намного проще. Если LUN не был удален, а вышло из строя NAS устройство, достаточно просто смонтировать образ в программу и восстановить информацию.

Полную версию статьи со всеми дополнительными видео уроками смотрите в источнике. А также зайдите на наш Youtube канал, там собраны более 400 обучающих видео.

Abstract: как работает open-iscsi (ISCSI initiator в linux), как его настраивать и чуть-чуть про сам протокол ISCSI.

Лирика: В интернете есть множество статей довольно хорошо объясняющих, как настроить ISCSI target, однако, почему-то, практически нет статей про работу с инициатором. Не смотря на то, что target технически сложнее, административной возни с initiator больше — тут больше запутанных концепций и не очень очевидные принципы работы.

Перед тем, как рассказать про ISCSI — несколько слов о разных типах удалённого доступа к информации в современных сетях.

Как восстановить работоспособность сетевого диска

Для первого решения вам понадобиться подключить пустой накопитель к устройству QNAP, загрузить его и создать новый виртуальный диск. С таким же размером, как и предыдущий. А затем скопировать файл на этот накопитель.

Для копирования образа подключите оба носителя к компьютеру с операционной системой Linux либо воспользуйтесь другими инструментами для доступа к файловой системе QNAP.

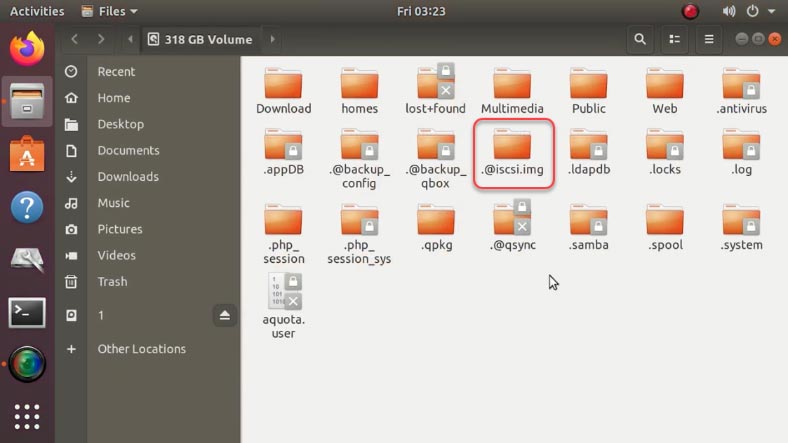

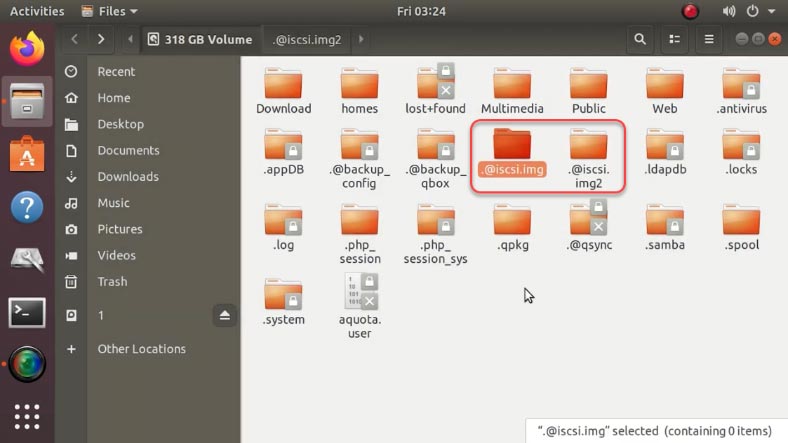

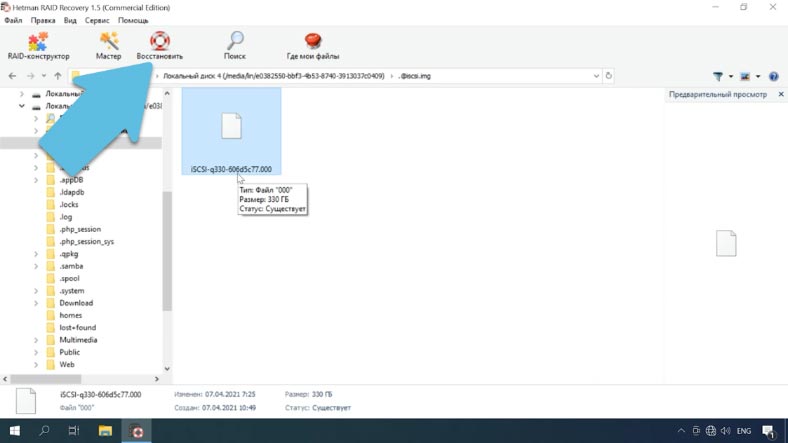

Смонтируйте и откройте новый носитель в файловом менеджере, на смонтированном диске в корне вы найдите папку с таким именем iscsi.img.

Переименуйте данный каталог к примеру, в iscsi.img2, а затем создайте папку с таким же именем iscsi.img.

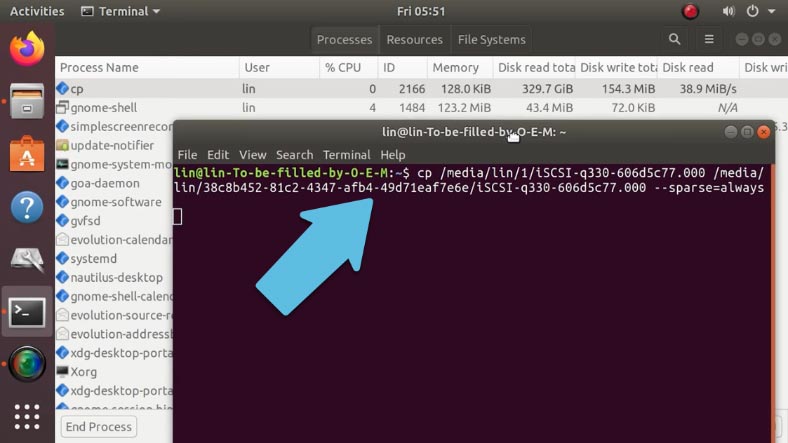

Далее нужно скопировать наш файл в только что созданный каталог. Для этого воспользуемся терминалом, так как нам нужно преобразовать данный образ в разреженный. Сделать это можно, выполнив команду копирования – «cp».

Открываем терминал и вводим следующую команду:

cp /media/lin/1/iSCSI-q330-606d5c77.000 /media/lin/38c8b452-81c2-4347-afb4-49d71eaf7e6e/@iscsi.img/iSCSI-q330-606d5c77.000 --sparse=always

- /media/lin/1/iSCSI-q330-606d5c77.000 – путь к образу.

- /media/lin/38c8b452-81c2-4347-afb4-49d71eaf7e6e/@iscsi.img/iSCSI-q330-606d5c77.000 — путь куда нужно скопировать образ.

- И аргумент --sparse=always — преобразует его в разреженный.

При большом объёме образа, процесс копирования займет довольно продолжительное время.

В терминале не отображается никакой информации о статусе процесса копирования, эту информацию можно посмотреть в системном мониторе, здесь отображается объём скопированной информации, по которому можно, приблизительно, определить, как скоро закончится процесс.

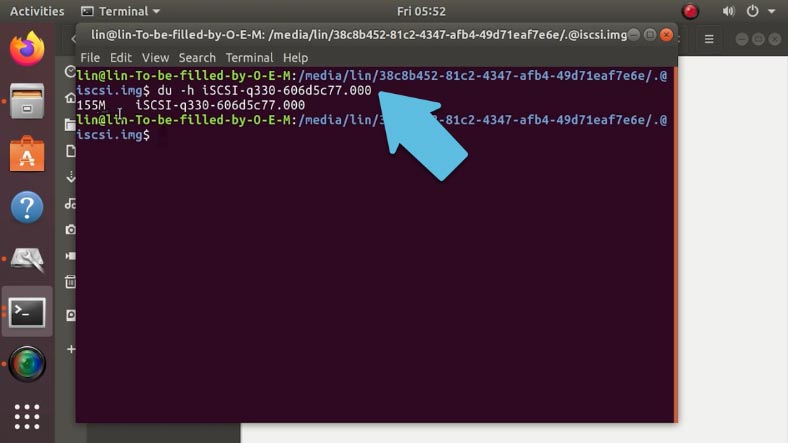

Ну вот файл успешно скопирован на новый носитель, для проверки выполним команду:

du -h iSCSI-q330-606d5c77.000

Открываем данный каталог в терминале и вводим команду с именем.

Как видите образ занимает на диске меньше 200 Мб, хотя его видимый размер составляет 330Гб. 1Гб, 10Гб. 5Гб.

du -h --apparent-size iSCSI-q330-606d5c77.000

Это подтверждение того, что при копировании он был преобразован в разреженный.

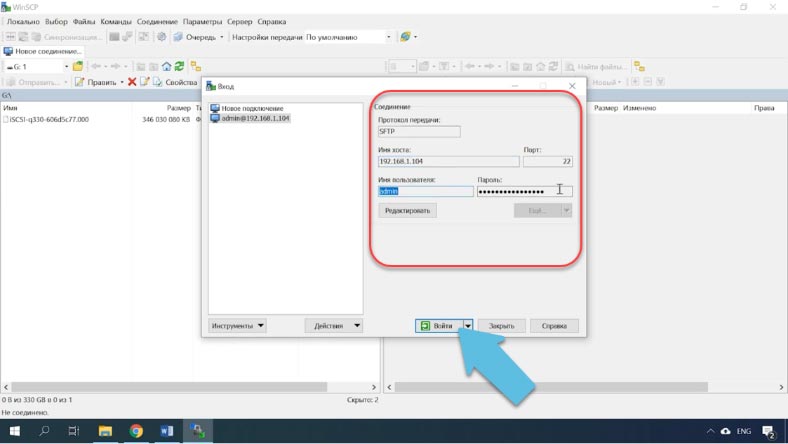

Подключите носитель к устройству QNAP и загрузите его. С помощью Winscp или другой утилиты настройте соединение с сервером. Укажите ip, логин, пароль, и нажмите войти.

Программа Winscp по умолчанию не видит скрытые файлы, так как каталог может быть скрыт сначала нужно включить их отображение. Откройте настройки – Панели – Показывать скрытые файлы.

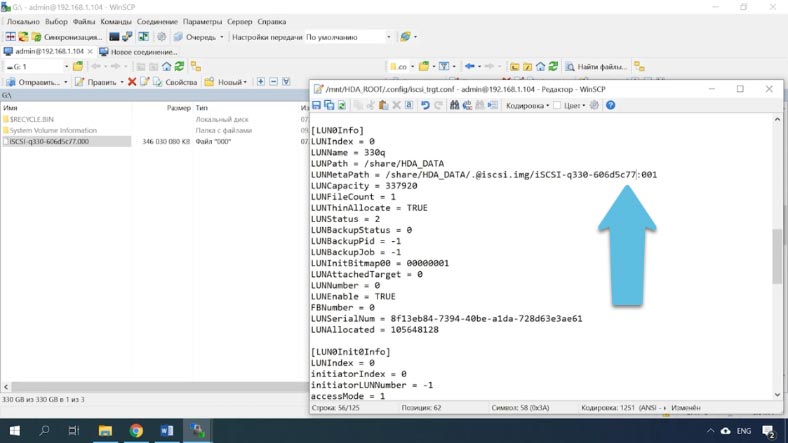

Затем перейдите по такому пути /mnt/HDA_ROOT/.config, найдите файл с названием iscsi_trgt.conf и откройте его. Здесь нужно найти строку LunMetapath и заменить имя нового LUN на имя того файла, который мы восстановили (iSCSI-q330-606d5c77.000).

Число «001» что в конце означает, сколько частей имеет ваш ISCSI. В моем случае он состоит из одного накопителя.

Далее сохраните изменения. Если у вас несколько носителей нужно изменить все их имена.

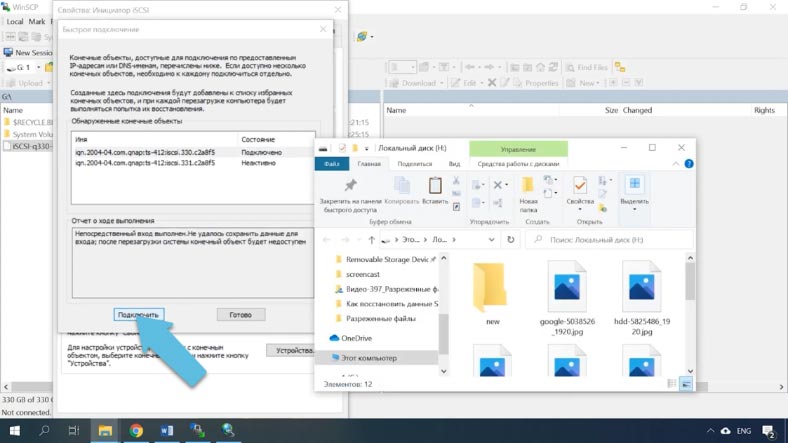

Перезагружаем QNAP и ждем пока он загрузится. После загрузки откройте инициатор iSCSI, и подключите диск повторно. После чего накопитель появится в проводнике со всеми данными.

scsi over tcp

Одним из протоколов доступа к блочным устройствам является iscsi. Буква 'i' в названии относится не к продукции эппл, а к Internet Explorer. По своей сути это 'scsi over tcp'. Сам протокол SCSI (без буквы 'i') — это весьма сложная конструкция, поскольку он может работать через разные физические среды (например, UWSCSI — параллельная шина, SAS — последовательная — но протокол у них один и тот же). Этот протокол позволяет делать куда больше, чем просто «подтыкать диски к компьютеру» (как это придумано в SATA), например, он поддерживает имена устройств, наличие нескольких линков между блочным устройством и потребителем, поддержку коммутации (ага, SAS-коммутатор, такие даже есть в природе), подключение нескольких потребителей к одному блочному устройству и т.д. Другими словами, этот протокол просто просился в качестве основы для сетевого блочного устройства.

Терминология

В мире SCSI приняты следующие термины:

target — тот, кто предоставляет блочное устройство. Ближайший аналог из обычного компьютерного мира — сервер.

initiator — клиент, тот, кто пользуется блочным устройством. Аналог клиента.

WWID — уникальный идентификатор устройства, его имя. Аналог DNS-имени.

LUN — номер «кусочка» диска, к которому идёт обращение. Ближайший аналог — раздел на жёстком диске.

ISCSI приносит следующие изменения: WWID исчезает, на его место приходит понятие IQN (iSCSI Qualified Name) — то есть чистой воды имя, сходное до степени смешения с DNS (с небольшими отличиями). Вот пример IQN: iqn.2011-09.test:name.

IETD и open-iscsi (сервер и клиент под линукс) приносят ещё одну очень важную концепцию, о которой чаще всего не пишут в руководствах по iscsi — portal. Portal — это, если грубо говорить, несколько target'ов, которые анонсируются одним сервером. Аналогии с www нет, но если бы веб-сервер можно было попросить перечислить все свои virtualhosts, то это было бы оно. portal указывает список target'ов и доступные IP, по которым можно обращаться (да-да, iscsi поддерживает несколько маршрутов от initiator к target).

Статья не про target, так что даю очень краткое описание того, что делает target. Он берёт блочное устройство, пришлёпывает к нему имя и LUN и публикет его у себя на портале, после чего позволяет всем желающим (авторизация по вкусу) обращаться к нему.

Вот пример простенького файла конфигурации, думаю, из него будет понятно что делает target (файл конфигурации на примере IET):

(сложный от простого отличается только опциями экспорта). Таким образом, если у нас есть target, то мы хотим его подключить. И тут начинается сложное, потому что у initiator'а своя логика, он совсем не похож на тривиальное mount для nfs.

В качестве инициатора используется open-iscsi. Итак, самое важное — у него есть режимы работы и состояние. Если мы дадим команду не в том режиме или не учтём состояние, результат будет крайне обескураживающий.

- Поиск target'ов (discovery)

- Подключение к target'у

- Работа с подключенным target'ом

Немного о состоянии. После discovery open-iscsi запоминает все найденные target'ы (они хранятся в /etc/iscsi/), другими словами, discovery — операция постоянная, совсем НЕ соответствующая, например, dns resolving). Найденные target можно удалить руками (кстати, частая ошибка — когда у open-iscsi, в результате экспериментов и настройки, пачка найденных target'ов, при попытке логина в которые выползает множество ошибок из-за того, что половина target'ов — старые строчки конфига, которые уже давно не существуют на сервере, но помнятся open-iscsi). Более того, open-iscsi позволяет менять настройки запомненного target'а — и эта «память» влияет на дальнейшую работу с target'ами даже после перезагрузки/перезапуска демона.

Второй вопрос, который многих мучает по-началу — куда оно попадает после подключения? open-iscsi создаёт хоть и сетевое, но БЛОЧНОЕ устройство класса SCSI (не зря же оно «я сказя»), то есть получает букву в семействе /dev/sd, например, /dev/sdc. Используется первая свободная буква, т.к. для всей остальной системы это блочное устройство — типичный жёсткий диск, ничем не отличающийся от подключенного через usb-sata или просто напрямую к sata.

В отличие от SAS/UWSCSI, ISCSI доступно для подключения кому попало. Для защиты от таких, есть логин и пароль (chap), и их передача iscsiadm'у — ещё одна головная боль для начинающих пользователей. Она может осуществляться двумя путями — изменением свойств уже найденного ранее target'а и прописываем логина/пароля в файле конфигурации open-iscsi.

Причина подобных сложностей — в том, что пароль и процесс логина — это атрибуты не пользователя, а системы. ISCSI — это дешёвая версия FC-инфраструктуры, и понятие «пользователь» в контексте человека за клавиатурой тут неприменимо. Если у вас sql-база лежит на блочном устройстве iscsi, то разумеется, вам будет хотеться, чтобы sql-сервер запускался сам, а не после минутки персонального внимания оператора.

Это очень важный файл, потому что помимо логина/пароля он описывает ещё поведение open-iscsi при нахождении ошибок. Он может отдавать ошибку «назад» не сразу, а с некоторой паузой (например, минут в пять, чего достаточно для перезагрузки сервера с данными). Так же там контролируется процесс логина (сколько раз пробовать, сколько ждать между попытками) и всякий тонкий тюнинг самого процесса работы. Заметим, эти параметры довольно важны для работы и вам нужно обязательно понимать, как поведёт ваш iscsi если вынуть сетевой шнурок на 10-20с, например.

Я не очень люблю цитировать легконаходимые маны и строчки, так что приведу типовой сценарий употребения iscsi:

сначала мы находим нужные нам target, для этого мы должны знать IP/dns-имя инициатора: iscsiadm -m discovery -t st -p 192.168.0.1 -t st — это команда send targets.

iscsiadm -m node (список найденного для логина)

iscsiadm -m node -l -T iqn.2011-09.example:data (залогиниться, то есть подключиться и создать блочное устройство).

iscsiadm -m session (вывести список того, к чему подключились)

iscsiadm -m session -P3 (вывести его же, но подробнее — в самом конце вывода будет указание на то, какое блочное устройство какому target'у принадлежит).

iscsiadm - m session -u -T iqn.2011-09.example:data (вылогиниться из конкретной )

iscsiadm -m node -l (залогиниться во все обнаруженные target'ы)

iscsiadm -m node -u (вылогиниться из всех target'ов)

iscsiadm -m node --op delete -T iqn.2011-09.example:data (удалить target из обнаруженных).

Ещё один вопрос, важный в серьёзных решениях — поддержка нескольких маршрутов к источнику. Прелесть iscsi — в использовании обычного ip, который может быть обычным образом обработан, как и любой другой трафик (хотя на практике обычно его не маршрутизируют, а только коммутируют — слишком уж великая там нагрузка). Так вот, iscsi поддерживает multipath в режиме «не сопротивляться». Сам по себе open-iscsi не умеет подключаться к нескольким IP одного target'а. Если его подключить к нескольким IP одного target'а, то это приведёт к появлению нескольких блочных устройств.

Как восстанавливать?

Если вы случайно удалили iSCSI LUN, или удалили данные с него, или же просто не можете получить доступ к файлам, хранящимся на вашем NAS, без стороннего софта для восстановления данных вам не обойтись. Программных решений для восстановления данных со iSCSI накопителей немного. Если вам нужна проверенная утилита, которая способна восстановить информацию с таких дисков воспользуйтесь Hetman RAID Recovery.

Сперва давайте разберем как восстановить утерянный сетевой накопитель.

Прежде чем приступать к процессу восстановления позаботьтесь о наличии накопителя с объёмом превышающим или равным тому сетевому носителю, с которого будете восстанавливать информацию.

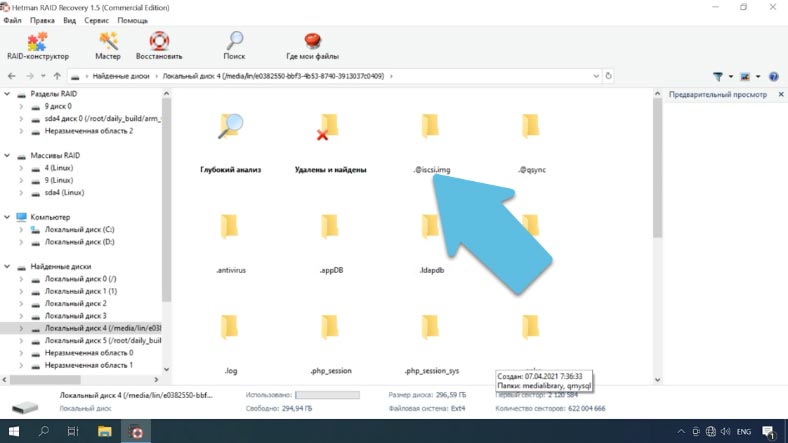

Подключите носитель к операционной системе Windows, затем скачайте, установите и запустите Hetman RAID Recovery, просканируйте нужный носитель.

По завершению анализа вам нужно найти следующую папку «@iSCSI».

Внутри каталога будут лежать все ваши iSCSI LUN носители в виде образов. По размеру определите нужный накопитель, отметьте все важные данные и нажмите «Восстановить».

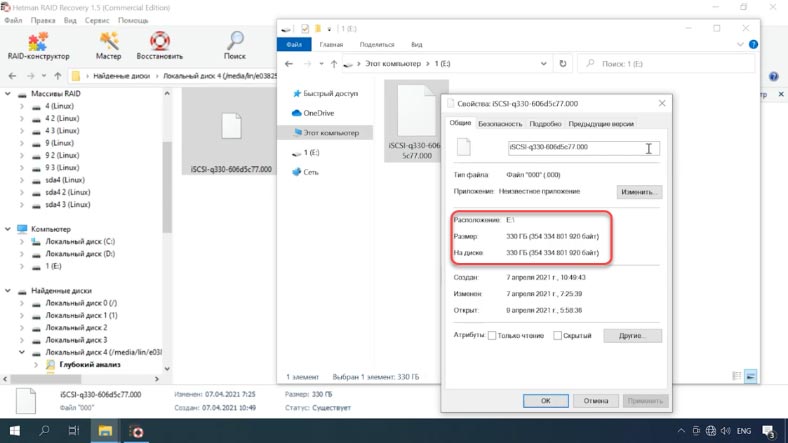

Укажите место куда сохранить и еще раз кликните по кнопке, по завершению процесса файл будет лежать в указанной папке.

Файл перестал быть разреженным, фактически занимаемое место увеличилось до полного размера в 330 Гб.

Теперь есть несколько решений для того, чтобы достать из него информацию:

Первый – восстановить работоспособность сетевого носителя c QNAP.

И второй – загрузить образ в нашу программу, просканировать его и вернуть нужные данные.

Читайте также: