Как разделить нагрузку на 2 видеокарты

Ноутбук сегодня – это не просто печатная машинка, способная работать в любом месте, но и мощное устройство, которое может вполне заменить стационарный компьютер. Процессоры на подобных устройствах используются разные: от слабых до высокопроизводительных, а вот дела с видеоадаптерами обстоят совершенно иначе.

Обычно встроенные графические системы не столь производительны, так что зачастую пользователям приходится устанавливать дополнительные дискретные видеокарты. Но здесь всплывает одно но… А как же ее активировать?

Обо всем это читайте далее, сегодня мы поговорим о всевозможных способах переключения графических карт.

Способ №2. Настройка Панели управления

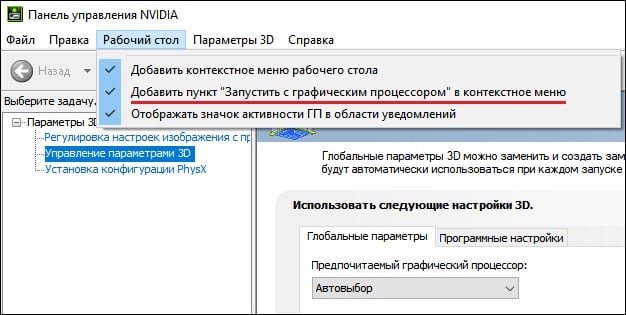

- Вновь запустите «Панель Управления Nvidia» как описано выше;

- Слева выберите пункт «Управление параметрами 3D»;

Выберите указанный параметр

Выберите указанные настройки

Заключение

Перед принятием решения о переходе на SLI/Crossfire стоит взвесить все за и против и решить, стоит ли вообще вкладываться в покупку дополнительной видеокарты, не проще ли вложить деньги в новую и более современную карту. Также заранее нужно выбрать модель, производителя и продумать прочие условия, а только затем приступать к покупке и сборке.

Многие современные ПК оснащены сразу двумя видеокартами – встроенной и дискретной. Встроенная (обычно это видеокарта от Интел) обслуживает несложные офисные задачи. Дискретная (от Нвидиа) работает с громоздкими графическими приложениями. При этом могут возникнуть ситуации, когда для запуска ресурсоёмких графических приложений компьютер ошибочно задействует встроенную плату вместо дополнительной. Как же поступить в данной ситуации? Ниже разберём, каким образом можно переключать видеокарту на вашем ноутбуке с Intel на Nvidia, и какова последовательность шагов при реализации данной операции.

Что необходимо для корректной работы двух видеокарт

Порядок переключения видеокарты на ноутбуке с Intel на nVidia

Задействование адаптеры от Нвидиа на обычно напрямую зависит от созданных на ПК профилей приложений. Если приложение не имеет такого профиля, и при его запуске используется неправильная видеоплата, то вам понадобится создать его. Учтите, что использование карты от Нвидиа для повседневных приложений существенно снижает время автономной работы вашего ноутбука.

Теоретически.

. Данная технология в идеальных условиях будет работать точно так. как ей полагается, а именно - мы получим производительность, кратную числу видеокарт. Правда, достижимо это только в теории, иначе этой статьи бы не было.

Особенности взаимодействия встроенной и дискретной видеокарт

Как известно, корпорация «Intel» выпускает недорогие встроенные в процессор видеоплаты low-end сегмента, призванные снабдить компьютер базовыми графическими возможностями. Такие карты прекрасно подходят для офисных или домашних компьютеров с низкими графическими требованиями.

Напротив, карты от Nvidia предназначены для обслуживания ресурсоёмких графических программ (обычно это современные мощные игры и графические редакторы). Они обладают мощной системой охлаждения и высокой энергоёмкостью.

Обычно компьютер автоматически переключается между ними, задействуя встроенную плату от Интел для простых офисных приложений, и графическую от Нвидиа для большинства игр. Переключение между картами обычно осуществляется с помощью технологии «NVIDIA Optimus» , залогом стабильной работы которой является наличие на ПК самых свежих драйверов для обеих видеокарт.

В случае некорректного переключения между графическими адаптерами (к примеру, встроенная видеоплата используется для запуска мощных игр) возникает необходимость отрегулировать их переключение. Разберёмся, как это можно сделать.

Во многих ноутбуках представлены две видеокарты — от Интел и Нвидиа

Способ №3. Активация через BIOS

С помощью БИОС мы можем также постараться переключить графическую плату на лэптопе. Для этого:

- Перезагрузите ПК, и при его запуске быстро жмите на кнопки «Esc», «Del» или F2 для перехода в БИОС.

- Там выбираем «Advanced» — вкладку «Chipset» (или «Display»).

- В параметре «Graphics Device» ставим «Discrete graphics» или «PCI» (внешняя видеокарта).

Выберите указанную настройку

Как работают две видеокарты

Работоспособность двух видеокарт в паре регулируется специальным программным обеспечением, которое определяет степень нагрузки на графическую систему. В том случае, если требуется больше нагрузки, то происходит отключение встроенной карты и активация дискретного устройства. Часто у пользователей возникает проблема, по которой данной программное обеспечение начинает некорректно работать.

Обычно такая проблема возникает у тех пользователей, которые пытаются самостоятельно выполнить установку графического адаптера. При неправильном подключении он может вовсе оставаться незадействованным, и поэтому игры, программы или видеоролики могут серьезно тормозить. Также ошибки могут возникать из-за неправильных драйверов или отключения необходимых функций в BIOS.

Все нижеуказанные способы будут работать только в том случае, если правильно установлена дискретная видеокарта и загружены все необходимые драйверы.

Способ 1: Официальное программное обеспечение

После установки драйверов для видеокарт Nvidia и AMD устанавливается программное обеспечение, включающее в себя специальное приложение. В случае с первым производителем, устанавливается GeForce Experience, со вторым – AMD Catalyst Control Center. Рассмотрим далее, как с помощью них можно сменить видеокарту.

Почему нет?

Прежде чем мы разберемся с тем, почему все-таки твердо "нет", давайте вспомним, сколько современных проектов поддерживает SLI? Не буду вас томить, ибо таких проектов меньше половины. Это означает, что как минимум в половине проектов прироста от SLI не будет практически никакого.

Иными словами, движок игры, рассчитанный на работу с одной видеокартой, просто не будет давать указаний для работы второй видеокарты (это очень упрощенно), так что вот, теперь перейдем непосредственно к недостаткам:

Технология SLI.

. Позволяет объединить несколько видеокарт в одной системе. Работает это так: изображение делится, после чего одна видеокарта обрабатывает одну часть, а вторая - другую. Изначально экран попросту делился "надвое", и одна видеокарта обрабатывала, к примеру, верхнюю часть, а вторая - нижнюю. Такой способ был практически самым первым и показал себя с худшей стороны.

Позже изображение научились делить самыми разными способами. Вообще работа этой технологии заслуживает отдельной статьи с описанием, поэтому просто примите в голову, что технология SLI - технология, которая позволяет объединить несколько видеокарт для обработки одной картинки.

SLI и Crossfire

SLI и Crossfire – это технологии, созданные NVIDIA и AMD для работы двух или более видеокарт. Обычно два графических процессора устанавливают для повышения производительности своей системы. Однако, если установить две видеокарты — это не будет означать, что производительность будет удвоена. Как правило, прирост наблюдается от 20% и 50%, в зависимости от игры.

Технология SLI почти мертва

В 30-й линейке поддержку NVLink (подросший SLI), получила только одна видеокарта - RTX 3090, которая вроде как вообще является наследницей RTX Titan, то есть - профессиональной видеокартой.

Единственная видеокарта в 30-й линейке (если не брать в расчет профессиональные), способная работать в тандеме.

Единственная видеокарта в 30-й линейке (если не брать в расчет профессиональные), способная работать в тандеме.

Для игр, действительно, брать пару видеокарт смысла не имеет, однако в рабочих задачах вроде 3D моделирования, мощность лишней не бывает. Те программы, как правило, могут загрузить абсолютно все железо, которое имеется на компьютере. Такие дела, господа.

Если статья понравилась - не забудь поставить лайк, подписаться на канал (и исторический тоже ), а также на нашу группу ВК . До скорого!

Разница между SLI и Crossfire. Какую технологию лучше выбрать?

Начать стоит с того, что SLI от NVIDIA более требовательный, в отличие от Crossfire. Чтобы SLI начал работать, нужны 2 видеокарты с одним и тем же графическим процессором, и таким же количеством видеопамяти. С другой стороны, можно комбинировать видеоадаптеры разных производителей, например, от MSI и Asus. Тем не менее, лучше взять обе видеокарты от одного производителя для стабильности. Для соединения видеокарт между собой необходим мост SLI. И последнее, материнские платы SLI, как правило, дороже чем те, которые предлагают Crossfire.

Crossfire от AMD является более гибким. Можно объединить все видеокарты, созданные на одной и той же архитектуре, даже с различным объемом видеопамяти. Например, Crossfire будет работать с видеоадаптерами AMD Radeon RX 580 и AMD Radeon RX 570. Также не всегда нужен мост, который проходит через порты PCI Express на материнской плате. Наконец, Crossfire доступен на гораздо большем количестве материнских плат, которые к тому же дешевле, нежели SLI.

В целом обе эти технологии похожи. Единственное, что нужно иметь в виду, – это затраченный бюджет: какая из двух связок видеокарт принесет наибольшую производительность за одну и ту же цену.

Проблемы, возникающие при работе нескольких графических процессоров ![Проблемы видеокарт]()

Далее речь пойдет об определенные проблемах, которые могут появиться при использовании двух видеокарт.

- Некоторые видеоигры не совместимы с несколькими графическими процессорами. Вы все равно сможете играть в них, но они не будут использовать две видеокарты, а станут задействовать только одну. Для того, чтобы игра была совместима с SLI или Crossfire, она должна иметь профиль для нескольких графических процессоров, а их обычно создают в сотрудничестве между производителем GPU и разработчиком видеоигры.

- Система может начать вылетать. Зачастую это связано с недостатком электропитания. В связи с этим потребуется инвестироваться в новый, более качественный блок питания.

- Больше тепла выделяется в корпусе ПК, потенциально это может привести к перегреву. Для предотвращения повышения температуры, необходимо установить более эффективную систему охлаждения.

- Две графические карты издают больше шума.

- Еще одна распространенная проблема – это микрофризы и разрыв кадров. Эта проблема связана с тем, что графические карты должны очень быстро взаимодействовать друг с другом, иногда это может вызвать проблемы с временем кадра.

Что лучше купить: одну видеокарту последнего поколения или две постарше ![Что лучше]()

Ощутить преимущество двух графических процессоров можно только в том случае, если покупать видеокарты последнего поколения. Но для этого придется потратить куда больше денег, что рядовому пользователю может оказаться не по карману.

Способ №1. Запуск приложения на лэптопе с помощью карты Нвидиа

- Запустите Панель управления вашего ПК;

- Кликните на «Оборудование и Звук» — «Панель управления NVIDIA»;

- После запуска Панели на самом верху кликните на вкладке «Рабочий стол», и поставьте галочку на опции «Запустить с графическим процессором» в контекстное меню;

Установите данную галочку в меню

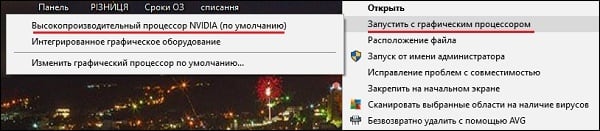

Теперь для запуска нужного приложения с помощью карты от Нвидиа наведите на его ярлык на рабочем столе курсор, щёлкните ПКМ. В появившемся меню выберите опцию «Запустить с графическим процессором» — «Высокопроизводительный процессор NVIDIA».

Выберите запуск с помощью карты от Нвидиа

Как установить несколько видеокарт на один ПК

Подключить две видеокарты не так уж и сложно, с этим справится даже новичок. Просто следуйте инструкции и аккуратно взаимодействуйте с компонентами внутри ПК.

- В разъёмы PCI-e x16 и PCI-e x8 нужно подключить обе видеокарты. Стоит убедиться, что они закреплены качественно, только после этого видеоадаптеры можно прикручивать к корпусу.

- Соединить соответствующие провода от блока питания к графическим картам для подачи электроэнергии.

- Затем подключить видеокарты друг к другу по специальным разъёмам с помощью моста.

- Закрыть корпус, подсоединить электропитание, монитор и прочие периферийные устройства. На этом техническая часть закончена, остается настроить работу в самой системе.

- Запустить ОС и установить драйвера от производителей. Дополнительные утилиты устанавливаются автоматически, поэтому скачивать сторонний софт нет необходимости.

Как только драйвера установятся, Crossfire автоматически начинает работать, дополнительных действий не требуется.

Но для активации SLI необходимо выполнить несколько действий:

- Для начала нужно зайти в «Панель управления Nvidia», открывается нажатием правой кнопки мыши по рабочему столу.

- Найти раздел «Параметры 3D», оттуда перейти в пункт «Настройка SLI».

- В «Конфигурация SLI» включить «Максимальная производительность 3D». После этого нужно сохранить изменения и перезагрузить ОС.

Чтобы всё правильно заработало, нужно учитывать следующие условия:

- У видеокарт должен быть одинаковый графический чип. Например, комбинация из NVIDIA Gefore GTX 1060 и NVIDIA Gefore GTX 1080 не будет работать, поскольку у них разные графические процессоры. Само собой разумеется, чипы от AMD и NVIDIA несовместимы (например, AMD Radeon R9 290X и Nvidia Geforce RTX 2060), ведь они имеют совершенно разных архитектуры.

- Материнская плата должна иметь два порта PCI-Express с совместимой SLI/Crossfire.

- Необходим блок питания, который справится с обеспечением энергией двух видеоадаптеров. Чтобы точно рассчитать, сколько ватт будет потребляться, рекомендуется использовать калькулятор от Cooler Master.

- В комплекте с материнкой должен быть мост, с помощью которого нужно соединить видеокарты.

- Шины PCIE на материнской плате должны находится на достаточном расстоянии друг от друга, чтобы видеоадаптеры влезли, и имели небольшую дистанцию между собой.

GeForce Experience

Если вы владелец Nvidia, то следуйте следующей инструкции для подключения второго видеоадаптера:

Всем доброго времени. Есть две видеокарты: гтх 1080 и, условно, гт740. Необходимо что бы во время серфа по тырнетам была задействована гт740 (на ней же висит монитор), а 1080 была не задействована, а во время нагрузки все вычисления производились на 1080, но вывод на монитор был через гт740. Как заколхозить такую тему? Причина данного костылинга - просто потому что)

Т.к. тема является архивной.

Т.к. тема является архивной.

Т.к. тема является архивной.

Т.к. тема является архивной.

Т.к. тема является архивной.

Попробуйте в настройках видеодрайвера задать приложениям какой картой их обрабатывать.

Или уже пробовали и не помогает?

Т.к. тема является архивной.

Дадада, именно вот эта фишка и интересует, работает ли она?

Проверить пока возможности нет, т.к. нищая карта-затычка будет только через неделю)

Т.к. тема является архивной.

Т.к. тема является архивной.

Т.к. тема является архивной.

Начиная с Windows 10 1803, Microsoft реализовала подобие технологии Optimus, знакомой владельцам ноутбуков. Рендеринг в тяжёлых приложениях осуществляет дискретная видеокарта, а за вывод изображений и обработку 2D отвечает встроенное видеоядро процессора. Видеопоток передаётся по шине PCI-E, выводится через видеовыход материнской платы.

Отсюда вытекают следующие системные требования:

-- Windows 10 1803 или новее

-- платформа Intel как минимум 4 поколения (Haswell) или AMD Ryzen 2200G/2400G, Athlon 240GE, 220GE, 200GE. Есть подтверждения успешной работы на более старых APU (в частности A10-7870K)

-- со слов продавца: не заработает на материнских платах H81/B85/Z87 (т.е. 4 поколения) производства ASUS

-- наличие слота PCI-E x16. Версия роли не играет, ведь карта в любом случае работает в режиме 1.1, а вот количество линий очень важно, ведь по шине не только происходит обмен данными с процессором, но и передаётся видеопоток. PCI-E 1.0 x16 по пропускной способности и без того эквивалентна всего лишь PCI-E 3.0 x4. Ещё большее снижение пропускной способности (например, если использовать слот x8) драматически скажется на производительности.

Любой, кто хотел получить больше производительности от компьютера, несомненно интересовался: «Могу ли я установить дополнительный видеоадаптер на свою материнскую плату и получить вдвое больше производительности вместо того, чтобы покупать более дорогую и новую видеокарту?» Но как правило ответ – нет, не получится заиметь вдвое большую мощность от работы двух графических процессоров. Однако с помощью двух видеокарт повысить производительность возможно, но существуют некоторые ограничения и определенные проблемы.

Заключение

Ниже мы разобрали программные способы того, каким образом можно переключить видеокарту на вашем ноутбуке со встроенной Intel на более мощную nVidia. Если ни одна из указанных альтернатив не подошла, вы можете перейти в Диспетчер устройств, навести курсор на вашу интегрированную графическую плату, нажать ПКМ и выбрать «Отключить». Это насильно переведёт ПК на работу с дискретной видеокартой, но будьте готовы, что лэптоп при этом начнёт работать нестабильно. Потому данную операцию стоит выполнять на свой страх и риск без гарантии в получении требуемого результата.

Наличием двух видеокарт на персональном компьютере уже никого не удивишь, в основном это слабая интегрированная и более мощная дискретная. Использование мощного видео не всегда нужно и постоянная его работа это больше расход энергии, более продуктивная работа систем охлаждения, как результат скорее износятся комплектующие ПК, поэтому часто спрашивают, как использовать интегрированное видео.

Интегрированная видеокарта это впаянный чип в материнскую плату, который для своей работы использует ресурсы оперативной памяти.

Если у вас ноутбук (Ноутбук), то по умолчанию сначала работает интегрированная карта, а дискретная включается автоматически при нагрузке на графику и чаще возникает проблема как привлечь последнюю. Что касается стационарного ПК (Десктоп), то здесь есть несколько нюансов.

Первый, интегрированная видеокарта должна быть включена в BIOS и соответственно настроена. Под настройками подразумевается выделение нужного количества мегабайт памяти, которые будут браться из оперативной.

В зависимости от материнской платы и количества установленной оперативной памяти она бывает разной, следует помнить, чем больше вы отдаете на видеокарту тем меньше остается на обработку других процессов так, что здесь стоит сбалансировать.

Современные интегрированные видеокарты могут выдавать от 64мегабайт до 4 гигабайт на видео при нужном количестве ОЗУ.

Включаем интегрированную графику

В большинстве случаев для того, чтобы задействовать встроенную графику, достаточно подключить монитор к соответствующему разъему на материнской плате, предварительно вынув дискретную видеокарту из слота PCI-E. Если разъемы отсутствуют, то воспользоваться интегрированным видеоядром не представляется возможным.

При самом неблагоприятном исходе, при переключении монитора мы получим черный экран при загрузке, свидетельствующий о том, что встроенная графика отключена в БИОСе материнской платы либо для нее не установлены драйвера, либо и то, и другое. В этом случае подсоединяем монитор к дискретной видеокарте, перезагружаемся и входим в БИОС.

Рассмотрим ситуацию на примере UEFI BIOS, которым управляется большинство современных материнских плат. На главной странице включаем расширенный режим, нажав на кнопку «Дополнительно».

Далее переходим на вкладку с таким же названием («Дополнительно» или «Advanced») и выбираем пункт «Конфигурация системного агента» или «System Agent Configuration».

Затем идем в раздел «Параметры графики» или «Graphics Configuration».

Напротив пункта «Основной дисплей» («Primary Display») нужно выставить значение «iGPU».

Жмем F10, соглашаемся с сохранением параметров, выбрав пункт «Yes», и выключаем компьютер.

Снова подсоединяем монитор к разъему на материнской плате и запускаем машину.

После запуска открываем «Панель управления» и кликаем по ссылке «Диспетчер устройств».

Переходим к ветке «Видеоадаптеры» и видим там «Базовый адаптер Майкрософт». Это устройство в разных редакциях может называться по-разному, но смысл один: это универсальный драйвер графики Windows. Кликаем по адаптеру ПКМ и выбираем пункт «Обновить драйверы».

Затем выбираем автоматический поиск программного обеспечения. Обратите внимание, что системе потребуется доступ в интернет.

Автоматический поиск драйверов для встроенной видеокарты в Диспетчере устройств Windows

После поиска найденный драйвер будет установлен и, после перезагрузки, можно будет пользоваться встроенной графикой.

Отключение встроенного видеоядра

Если у Вас возникла мысль об отключении встроенной видеокарты, то лучше этого не делать, так как в этом действии нет особого смысла. В стационарных компьютерах при подключении дискретного адаптера встроенный отключается автоматически, а на ноутбуках, снабженных переключаемой графикой, вовсе может привести к неработоспособности устройства .

Интегрированные видеокарты разработаны для работы с офисными программами, простыми приложениями и играми, не требующие больших ресурсов. Для их работы требуется меньше питания и не нужно устанавливать дополнительных систем охлаждения. Преимущественно их используют в бюджетных вариантах системных блоков, что дает возможность сэкономить деньги.

периодически работает displayport (пропадает изображение на мониторе)

Да, у меня тоже такое бывает, крайне редко но регулярно, на разных видяшках. Грешу на кабель, но не напрягает, потому не вмешиваюсь.

Раньше это вроде как было невозможно

Разве? Как только у меня появился интегрированное видео, тут же стал им пользоваться. Но этого двумя видяшками (начиная с AGP+PCI) пользовался.

Заметил только, что система не стабильно работает в отдельных сценариях, если и интегрированное видео (Intel HD), и дискретное (Nvidia) использовать – то сон не работал, то тормоза на ровном месте, то еще что-то. В итоге отказался от использования интегрированного, добавил видеокарту просто еще одну в систему. Потом еще одну, третью, но это уже другая история.

как распределяются нагрузки/ресурсы? Если я запускаю игру, то чьи ресурсы она задействует

Не знаю, как в теории, но на практике используются ресурсы той карточки, которая выбрана как "основная" в Windows. Если приложение работает в окне, то при перетаскивании ока на другой монитор, приложение может переключить отрисовку Direct3D на другую карточку (например видео плеер MPC-HC). Но тут от приложения зависит. Чаще основная рендерит, а потом просто через вторую видяшку картинку выводит (в итоге нагружаются обе работой, и часто возникают дополнительные тормоза/проседание FPS).

Всем привет, дорогие друзья. Рад вас видеть! В недавней статье по "технологиям из прошлого" я затронул тему SLI. Раньше было нормой, когда в игровом компьютере стояло несколько видеокарт, которые трудились над одной картинкой.

Что примечательно, даже сегодня некоторые люди рассматривают покупку пары видеокарт в свой компьютер, вместо одной мощной. Почему так делать не стоит?

Нет и еще раз нет

Сразу обозначу пару вещей, которые понятны абсолютно каждому: две видеокарты вдвое дороже, чем одна, они потребляют больше энергии, а значит им нужен более мощный ее источник, и сильнее греются, что значит - экономить на корпусе - совсем не наш вариант.

Реальный прирост производительности в SLI в игре, которая оптимизирована под работу с двумя видеокартами. Однако оптимизация играет роль: обратите внимание на 1 и 0.1%. За тесты спасибо ребятам из PRO Hi-TECH

Реальный прирост производительности в SLI в игре, которая оптимизирована под работу с двумя видеокартами. Однако оптимизация играет роль: обратите внимание на 1 и 0.1%. За тесты спасибо ребятам из PRO Hi-TECH

Кроме того, производители видеокарт что AMD с их Crossfire, что Nvidia с их SLI, что производители игр - все они как-то обходят стороной тему оптимизации и тестирования работы пары видеокарт. Это значит, что разные неприятные ошибки вроде артефактов, будут встречаться гораздо чаще, чем хотелось бы.

А вот что будет, если оптимизации в игре нет. Одна видеокарта показывает производительность лучшую, чем две видеокарты. И если разницу среднего ФПС можно списать на погрешность, то с 1 и 0.1% - уже как-то все очень плохо. За фото все также благодарите ребят из PRO Hi-TECH

А вот что будет, если оптимизации в игре нет. Одна видеокарта показывает производительность лучшую, чем две видеокарты. И если разницу среднего ФПС можно списать на погрешность, то с 1 и 0.1% - уже как-то все очень плохо. За фото все также благодарите ребят из PRO Hi-TECH

Прибавьте к этому и то, что даже если все работает хорошо, то прирост от пары видеокарт не будет двукратным, а в лучшем (очень оптимистичном) случае - процентов 35-40. Ну и надо оно вам?

Зачем нужны две видеокарты на одном ПК

Для начала стоит разобраться, для чего нужны две видеокарты на одном компьютере и какие преимущества они дают:

- Главное достоинство двух графических процессоров – это дополнительное увеличение производительности графики в играх, а также способность поддерживать очень высокие разрешения (2K и 4K), которые требуют больших затрат ресурсов и памяти.

- В некоторых ситуациях может потребоваться большое количество мониторов, например, для рабочего места. Как правило, видеокарта способна работать с 2-3 мониторами, однако если необходимо 4-6 дисплеев, то в таких случаях вторая графическая карта станет идеальным решением.

Читайте также: