Как измеряется длина видеокарты

Новый NVIDIA GeForce RTX 3080-х годов стали почти сладкоежками из-за отличного соотношения цена / производительность, по крайней мере, по сравнению с видеокартами последнего поколения. Если вы собираетесь купить одну из этих графических изображений, вас может беспокоить ее размер относительно того, поместится ли она в коробку вашего ПК, поэтому далее мы расскажем вам, какие габариты топовой RTX 3080 каждого производителя в сравнительный режим, чтобы у вас была сжатая информация и вы могли легко проверить, подходит ли она.

Хотя NVIDIA продает свои собственные модели (Founders Edition), у большинства производителей есть собственные модели с собственным радиатором и, как правило, с заводским разгоном, который еще больше увеличивает их производительность. Проблема в том, что, поскольку каждый сборщик использует свой собственный радиатор, нет стандарта относительно размеров этих видеокарт, поэтому мы увидим его ниже, чтобы вы могли узнать, подходит он или нет в коробке вашего ПК, прежде чем покупать его. или другая модель.

Где на видеокарте написано название модели

Самый сложный способ – снять боковую крышку системного блока, демонтировать дискретную видеокарту и поискать шильдик – специальную наклейку, на которой должен быть указан бренд, модель видеокарты, поставлены значки сертификатов.

Согласно нормативным документам, такая маркировка присутствует всегда. Производитель может указать и любые другие данные.

Так как видеокарта в процессе работы сильно нагревается, клей на шильдике может засохнуть, а сама бумажка отвалится и где-то потеряется. В этом случае следует внимательно осмотреть сам корпус: как правило, большинство производителей наносят маркировку с названием бренда и модели где-нибудь на защитном кожухе.

В плане эксплуатации девайса это не дает никаких плюсов, а вот пара десятков видеокарт на витрине магазина компьютерной техники в распакованном виде с такой маркировкой, выглядит солидно. Можно считать это заботой о ритейлерах (или понтами производителя, который кичится моделью видеокарты – как вам больше нравится).

На ноутбуке такой метод не сработает, если вы плохо разбираетесь в компьютерной технике – без подсказок из интернета с детальными пошаговыми алгоритмами, разбирать портативный компьютер не только сложно, но и немножко страшно: все таки это не пару винтов на компьютере открутить, а уже пару десятков.

К тому же у лэптопов видеокарты часто интегрированы в системную плату или процессор, поэтому разбирать их нет никакого резона.

Переходим к следующему этапу.

Как посчитать пропускную способность памяти

Иногда требуется знать не только битность видеокарты, что сделать несложно (характеристики указаны на сайте производителя), но и битность самой памяти. Как узнать это параметр? Для расчетов нужно частоту памяти умножить на ширину шины в байтах.

Например, 384 бита ֫— это 48 байт. Соответственно, девайс с частотой памяти 6000 МГц будет иметь пропускную способность памяти 288 Гбайт/с. Впрочем, такие расчеты уже лишние. ПСП можно посмотреть с помощью специальной диагностической утилиты — например, той же GPU-Z.

Также советую ознакомиться с публикациями «Что такое GDDR5 на видеокарте» и «Что такое ОС в видеокартах». Буду признателен, если вы поделитесь этой статьей в социальных сетях, чтобы помочь в продвижении моего блога. До скорой встречи!

Руководство покупателя игровой видеокарты

Современные графические процессоры содержат множество функциональных блоков, от количества и характеристик которых зависит и итоговая скорость рендеринга, влияющая на комфортность игры. По сравнительному количеству этих блоков в разных видеочипах можно примерно оценить, насколько быстр тот или иной GPU. Характеристик у видеочипов довольно много, в этом разделе мы рассмотрим лишь самые важные из них.

Тактовая частота видеочипа

Рабочая частота GPU обычно измеряется в мегагерцах, т. е. миллионах тактов в секунду. Эта характеристика прямо влияет на производительность видеочипа — чем она выше, тем больший объем работы GPU может выполнить в единицу времени, обработать большее количество вершин и пикселей. Пример из реальной жизни: частота видеочипа, установленного на плате Radeon HD 6670 равна 840 МГц, а точно такой же чип в модели Radeon HD 6570 работает на частоте в 650 МГц. Соответственно будут отличаться и все основные характеристики производительности. Но далеко не только рабочая частота чипа определяет производительность, на его скорость сильно влияет и сама графическая архитектура: устройство и количество исполнительных блоков, их характеристики и т. п.

В некоторых случаях тактовая частота отдельных блоков GPU отличается от частоты работы остального чипа. То есть, разные части GPU работают на разных частотах, и сделано это для увеличения эффективности, ведь некоторые блоки способны работать на повышенных частотах, а другие — нет. Такими GPU комплектуется большинство видеокарт GeForce от NVIDIA. Из свежих примеров приведём видеочип в модели GTX 580, большая часть которого работает на частоте 772 МГц, а универсальные вычислительные блоки чипа имеют повышенную вдвое частоту — 1544 МГц.

Скорость заполнения (филлрейт)

Скорость заполнения показывает, с какой скоростью видеочип способен отрисовывать пиксели. Различают два типа филлрейта: пиксельный (pixel fill rate) и текстурный (texel rate). Пиксельная скорость заполнения показывает скорость отрисовки пикселей на экране и зависит от рабочей частоты и количества блоков ROP (блоков операций растеризации и блендинга), а текстурная — это скорость выборки текстурных данных, которая зависит от частоты работы и количества текстурных блоков.

Например, пиковый пиксельный филлрейт у GeForce GTX 560 Ti равен 822 (частота чипа) × 32 (количество блоков ROP) = 26304 мегапикселей в секунду, а текстурный — 822 × 64 (кол-во блоков текстурирования) = 52608 мегатекселей/с. Упрощённо дело обстоит так — чем больше первое число — тем быстрее видеокарта может отрисовывать готовые пиксели, а чем больше второе — тем быстрее производится выборка текстурных данных.

Хотя важность "чистого" филлрейта в последнее время заметно снизилась, уступив скорости вычислений, эти параметры всё ещё остаются весьма важными, особенно для игр с несложной геометрией и сравнительно простыми пиксельными и вершинными вычислениями. Так что оба параметра остаются важными и для современных игр, но они должны быть сбалансированы. Поэтому количество блоков ROP в современных видеочипах обычно меньше количества текстурных блоков.

Количество вычислительных (шейдерных) блоков или процессоров

Пожалуй, сейчас эти блоки — главные части видеочипа. Они выполняют специальные программы, известные как шейдеры. Причём, если раньше пиксельные шейдеры выполняли блоки пиксельных шейдеров, а вершинные — вершинные блоки, то с некоторого времени графические архитектуры были унифицированы, и эти универсальные вычислительные блоки стали заниматься различными расчётами: вершинными, пиксельными, геометрическими и даже универсальными вычислениями.

Впервые унифицированная архитектура была применена в видеочипе игровой консоли Microsoft Xbox 360, этот графический процессор был разработан компанией ATI (впоследствии купленной AMD). А в видеочипах для персональных компьютеров унифицированные шейдерные блоки появились ещё в плате NVIDIA GeForce 8800. И с тех пор все новые видеочипы основаны на унифицированной архитектуре, которая имеет универсальный код для разных шейдерных программ (вершинных, пиксельных, геометрических и пр.), и соответствующие унифицированные процессоры могут выполнить любые программы.

По числу вычислительных блоков и их частоте можно сравнивать математическую производительность разных видеокарт. Большая часть игр сейчас ограничена производительностью исполнения пиксельных шейдеров, поэтому количество этих блоков весьма важно. К примеру, если одна модель видеокарты основана на GPU с 384 вычислительными процессорами в его составе, а другая из той же линейки имеет GPU с 192 вычислительными блоками, то при равной частоте вторая будет вдвое медленнее обрабатывать любой тип шейдеров, и в целом будет настолько же производительнее.

Хотя, исключительно на основании одного лишь количества вычислительных блоков делать однозначные выводы о производительности нельзя, обязательно нужно учесть и тактовую частоту и разную архитектуру блоков разных поколений и производителей чипов. Только по этим цифрам можно сравнивать чипы только в пределах одной линейки одного производителя: AMD или NVIDIA. В других же случаях нужно обращать внимание на тесты производительности в интересующих играх или приложениях.

Блоки текстурирования (TMU)

Эти блоки GPU работают совместно с вычислительными процессорами, ими осуществляется выборка и фильтрация текстурных и прочих данных, необходимых для построения сцены и универсальных вычислений. Число текстурных блоков в видеочипе определяет текстурную производительность — то есть скорость выборки текселей из текстур.

Хотя в последнее время больший упор делается на математические расчеты, а часть текстур заменяется процедурными, нагрузка на блоки TMU и сейчас довольно велика, так как кроме основных текстур, выборки необходимо делать и из карт нормалей и смещений, а также внеэкранных буферов рендеринга render target.

С учётом упора многих игр в том числе и в производительность блоков текстурирования, можно сказать, что количество блоков TMU и соответствующая высокая текстурная производительность также являются одними из важнейших параметров для видеочипов. Особенное влияние этот параметр оказывает на скорость рендеринга картинки при использовании анизотропной фильтрации, требующие дополнительных текстурных выборок, а также при сложных алгоритмах мягких теней и новомодных алгоритмах вроде Screen Space Ambient Occlusion.

Блоки операций растеризации (ROP)

Блоки растеризации осуществляют операции записи рассчитанных видеокартой пикселей в буферы и операции их смешивания (блендинга). Как мы уже отмечали выше, производительность блоков ROP влияет на филлрейт и это — одна из основных характеристик видеокарт всех времён. И хотя в последнее время её значение также несколько снизилось, всё ещё попадаются случаи, когда производительность приложений зависит от скорости и количества блоков ROP. Чаще всего это объясняется активным использованием фильтров постобработки и включенным антиалиасингом при высоких игровых настройках.

Ещё раз отметим, что современные видеочипы нельзя оценивать только числом разнообразных блоков и их частотой. Каждая серия GPU использует новую архитектуру, в которой исполнительные блоки сильно отличаются от старых, да и соотношение количества разных блоков может отличаться. Так, блоки ROP компании AMD в некоторых решениях могут выполнять за такт больше работы, чем блоки в решениях NVIDIA, и наоборот. То же самое касается и способностей текстурных блоков TMU — они разные в разных поколениях GPU разных производителей, и это нужно учитывать при сравнении.

Вплоть до последнего времени, количество блоков обработки геометрии было не особенно важным. Одного блока на GPU хватало для большинства задач, так как геометрия в играх была довольно простой и основным упором производительности были математические вычисления. Важность параллельной обработки геометрии и количества соответствующих блоков резко выросли при появлении в DirectX 11 поддержки тесселяции геометрии. Компания NVIDIA первой распараллелила обработку геометрических данных, когда в её чипах семейства GF1xx появилось по несколько соответстующих блоков. Затем, похожее решение выпустила и AMD (только в топовых решениях линейки Radeon HD 6700 на базе чипов Cayman).

В рамках этого материала мы не будем вдаваться в подробности, их можно прочитать в базовых материалах нашего сайта, посвященных DirectX 11-совместимым графическим процессорам. В данном случае для нас важно то, что количество блоков обработки геометрии очень сильно влияет на общую производительность в самых новых играх, использующих тесселяцию, вроде Metro 2033, HAWX 2 и Crysis 2 (с последними патчами). И при выборе современной игровой видеокарты очень важно обращать внимание и на геометрическую производительность.

Собственная память используется видеочипами для хранения необходимых данных: текстур, вершин, данных буферов и т. п. Казалось бы, что чем её больше — тем всегда лучше. Но не всё так просто, оценка мощности видеокарты по объему видеопамяти — это наиболее распространенная ошибка! Значение объёма видеопамяти неопытные пользователи переоценивают чаще всего, до сих пор используя именно его для сравнения разных моделей видеокарт. Оно и понятно — этот параметр указывается в списках характеристик готовых систем одним из первых, да и на коробках видеокарт его пишут крупным шрифтом. Поэтому неискушённому покупателю кажется, что раз памяти в два раза больше, то и скорость у такого решения должна быть в два раза выше. Реальность же от этого мифа отличается тем, что память бывает разных типов и характеристик, а рост производительности растёт лишь до определенного объёма, а после его достижения попросту останавливается.

Так, в каждой игре и при определённых настройках и игровых сценах есть некий объём видеопамяти, которого хватит для всех данных. И хоть ты 4 ГБ видеопамяти туда поставь — у неё не появится причин для ускорения рендеринга, скорость будут ограничивать исполнительные блоки, о которых речь шла выше, а памяти просто будет достаточно. Именно поэтому во многих случаях видеокарта с 1,5 ГБ видеопамяти работает с той же скоростью, что и карта с 3 ГБ (при прочих равных условиях).

Ситуации, когда больший объём памяти приводит к видимому увеличению производительности, существуют — это очень требовательные игры, особенно в сверхвысоких разрешениях и при максимальных настройках качества. Но такие случаи встречаются не всегда и объём памяти учитывать нужно, не забывая о том, что выше определённого объема производительность просто уже не вырастет. Есть у чипов памяти и более важные параметры, такие как ширина шины памяти и её рабочая частота. Эта тема настолько обширна, что подробнее о выборе объёма видеопамяти мы ещё остановимся в шестой части нашего материала.

Ширина шины памяти

Современные игровые видеокарты используют разную ширину шины: от 64 до 384 бит (ранее были чипы и с 512-битной шиной), в зависимости от ценового диапазона и времени выпуска конкретной модели GPU. Для самых дешёвых видеокарт уровня low-end чаще всего используется 64 и реже 128 бит, для среднего уровня от 128 до 256 бит, ну а видеокарты из верхнего ценового диапазона используют шины от 256 до 384 бит шириной. Ширина шины уже не может расти чисто из-за физических ограничений — размер кристалла GPU недостаточен для разводки более чем 512-битной шины, и это обходится слишком дорого. Поэтому наращивание ПСП сейчас осуществляется при помощи использования новых типов памяти (см. далее).

На современные видеокарты устанавливается сразу несколько различных типов памяти. Старую SDR-память с одинарной скоростью передачи уже нигде не встретишь, но и современные типы памяти DDR и GDDR имеют значительно отличающиеся характеристики. Различные типы DDR и GDDR позволяют передавать в два или четыре раза большее количество данных на той же тактовой частоте за единицу времени, и поэтому цифру рабочей частоты зачастую указывают удвоенной или учетверённой, умножая на 2 или 4. Так, если для DDR-памяти указана частота 1400 МГц, то эта память работает на физической частоте в 700 МГц, но указывают так называемую «эффективную» частоту, то есть ту, на которой должна работать SDR-память, чтобы обеспечить такую же пропускную способность. То же самое с GDDR5, но частоту тут даже учетверяют.

Основное преимущество новых типов памяти заключается в возможности работы на больших тактовых частотах, а соответственно — в увеличении пропускной способности по сравнению с предыдущими технологиями. Это достигается за счет увеличенных задержек, которые, впрочем, не так важны для видеокарт. Первой платой, использующей память DDR2, стала NVIDIA GeForce FX 5800 Ultra. С тех пор технологии графической памяти значительно продвинулись, был разработан стандарт GDDR3, который близок к спецификациям DDR2, с некоторыми изменениями специально для видеокарт.

GDDR3 — это специально предназначенная для видеокарт память, с теми же технологиями, что и DDR2, но с улучшенными характеристиками потребления и тепловыделения, что позволило создать микросхемы, работающие на более высоких тактовых частотах. Несмотря на то, что стандарт был разработан в компании ATI, первой видеокартой, её использующей, стала вторая модификация NVIDIA GeForce FX 5700 Ultra, а следующей стала GeForce 6800 Ultra.

GDDR4 — это дальнейшее развитие «графической» памяти, работающее почти в два раза быстрее, чем GDDR3. Основными отличиями GDDR4 от GDDR3, существенными для пользователей, являются в очередной раз повышенные рабочие частоты и сниженное энергопотребление. Технически, память GDDR4 не сильно отличается от GDDR3, это дальнейшее развитие тех же идей. Первыми видеокартами с чипами GDDR4 на борту стали ATI Radeon X1950 XTX, а у компании NVIDIA продукты на базе этого типа памяти не выходили вовсе. Преимущества новых микросхем памяти перед GDDR3 в том, что энергопотребление модулей может быть примерно на треть ниже. Это достигается за счет более низкого номинального напряжения для GDDR4.

Впрочем, GDDR4 не получила широкого распространения даже в решениях AMD. Начиная с GPU семейства RV7x0, контроллерами памяти видеокарт поддерживается новый тип памяти GDDR5, работающий на эффективной учетверённой частоте до 5,5 ГГц и выше (теоретически возможны частоты до 7 ГГц), что даёт пропускную способность до 176 ГБ/с с применением 256-битного интерфейса. Если для повышения ПСП у памяти GDDR3/GDDR4 приходилось использовать 512-битную шину, то переход на использование GDDR5 позволил увеличить производительность вдвое при меньших размерах кристаллов и меньшем потреблении энергии.

Видеопамять самых современных типов — это GDDR3 и GDDR5, она отличается от DDR некоторыми деталями и также работает с удвоенной/учетверённой передачей данных. В этих типах памяти применяются некоторые специальные технологии, позволяющие поднять частоту работы. Так, память GDDR2 обычно работает на более высоких частотах по сравнению с DDR, GDDR3 — на еще более высоких, а GDDR5 обеспечивает максимальную частоту и пропускную способность на данный момент. Но на недорогие модели до сих пор ставят «неграфическую» память DDR3 со значительно меньшей частотой, поэтому нужно выбирать видеокарту внимательнее.

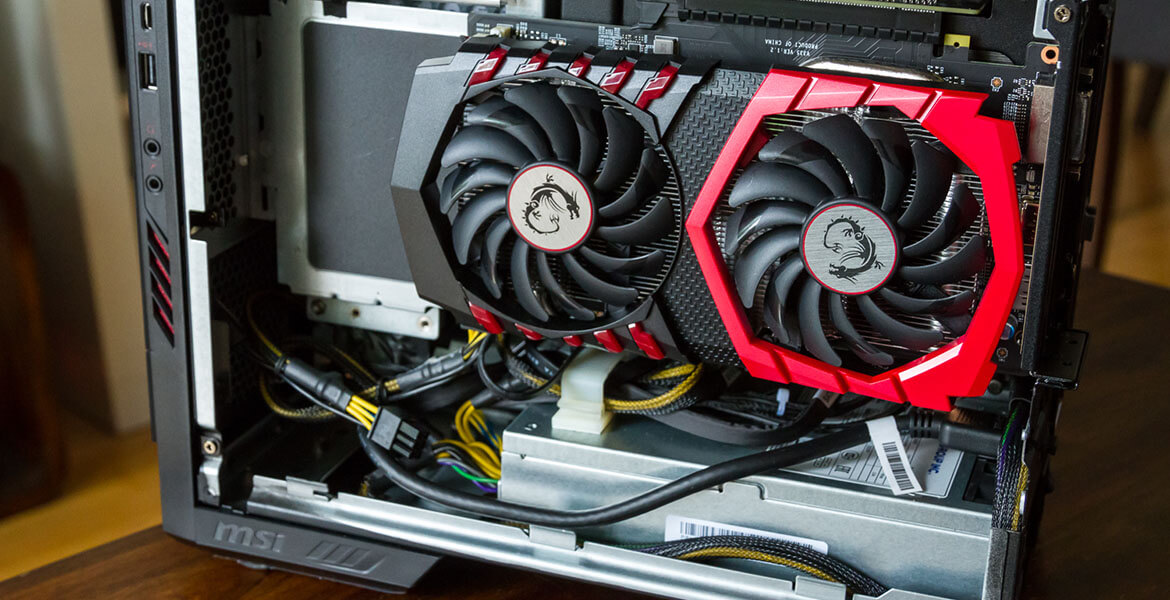

Громоздкий полноценный башенный компьютер (Full Tower) всегда является лучшим выбором, если вы хотите получить место для установки нескольких видеокарт, иметь возможность обновлять компьютер или установить в него накопители вместимостью в несколько терабайт.

- Размер корпуса

- Обращайте внимание на питание

- Низкопрофильные видеокарты

- Рекомендации по выбору карт

- Лучшая для 4K в блоке от малого до среднего: Nvidia GeForce RTX 3070 Founders Edition

- Лучшая для разрешения 1440p и 4K в полукомпактном корпусе: Nvidia GeForce RTX 3060 Ti Founders Edition

- Лучшая для бюджетных компьютеров: Zotac GeForce GTX 1650 Super Twin Fan

- Лучшая для мониторов с высокой частотой обновления на разрешении 1080p: Zotac GeForce GTX 1660 Super Twin Fan

- Лучшая для 1440p и лёгких игр в 4K: Zotac GeForce RTX 2060 Amp

- Лучшая для распространённых игр 1080p: Gigabyte GeForce GTX 1660 OC 6G

- Лучший выбор из прошлого поколения: MSI GeForce GTX 1050 Ti 4G OC

- Лучшая бюджетная при переходе от встроенной графики: Asus Radeon RX 550 4G

- Лучшая для компактных сборок со слабым питанием: Zotac GeForce GTX 1650 OC

Всё больше компьютерных энтузиастов и производителей компьютеров проявляют интерес к компактным и при этом быстрым системам. Многие производители корпусов предлагают модели довольно скромных размеров, где есть место для средних и даже полноразмерных видеокарт.

Например, модель компьютера SilverStone Sugo SG12 размером с коробку для обуви позволяет установить видеокарту длиной более 30 см. В результате можно поставить наиболее крупные из существующих мощных видеокарт, таких как Nvidia GeForce GTX 3080.

Специализированные компактные корпуса часто требуют материнских плат формата MicroATX или Mini-ITX вместо стандартных и обычно менее дорогих полноразмерных плат ATX. Их необычные размеры означают, что здесь способны поместиться большие видеокарты, но не большие материнские платы.

Можно создать игровую систему ещё меньшего размера, используя по-настоящему компактные корпуса вроде Cooler Master Elite 110 с параметрами 275 х 250 х 275 мм. Сюда могут войти процессоры Intel Core i7-9700K или i5-10600K и видеокарты вроде Zotac GeForce GTX 1650 Super Twin Fan и одна из карт на основе GeForce GTX 1660 или GTX 1660 Super. Они не самые мощные из существующих, но поддерживают игры виртуальной реальности и наиболее тяжёлые обычные игры на высоких настройках графики с разрешением 1080p.

Обращайте внимание на питание

Ещё одним фактором при сборке компактного компьютера является прокладка кабелей от блока питания. Многие карты обладают силовыми коннекторами наверху, многие компактные корпуса и Mini-ITX поддерживают подобный дизайн, но некоторые предпочитают контакты на задней стороне карты.

Если вы уже работаете в ограниченном пространстве и каждый сантиметр видеокарты на счету, нужно убедиться, что когда вы подключаете её к блоку питания, остаётся достаточно места для других компонентов.

При этом нужно знать, что многие компактные видеокарты обходятся без подключения кабеля от блока питания. Моделям вроде Zotac GeForce GTX 1650 OC хватает питания от слота PCI Express, куда они установлены.

Оптимальная и максимальная пропускная способность

Благодаря унификации значений не слишком много. Сегодня в продаже можно найти устройства с такой битностью:

64 бита — довольно распространенные бюджетные графические адаптеры. Мощности хватит для работы, а также запуска простеньких игр — например, какой-нибудь браузерки или казуальной «Веселой фермы». Для игр ААА класса не подходят.

128 бит — средний ценовой сегмент. Такие видеокарты идеально подходят для домашнего мультимедийного центра. Можно запускать «тяжелые» программы типа Photoshop или 3D Max. Рендеринг видео тоже возможен, но времени на это уйдет много. Требовательные игры будут работать, но на средних настройках качества графики.

256 или 384 бита — топовый сегмент. Мощные графические ускорители, «заточенные» под видеоигры. Как правило, остальные параметры, а именно частоты процессора и памяти, не отстают от битности. Стоят дорого, зато и современные игры «летают» на максимальных и ультра настройках.Хочу добавить, что эта классификация скорее условная, так как по одной лишь пропускной способности некорректно судить о возможностях графического адаптера.

По результатам тестов, лучше видеоадаптер с большими частотами памяти и чипа, но меньшей битностью, чем наоборот. Если стоит выбор, то при прочих равных условиях лучше взять девайс с большей пропускной способностью.

Размер корпуса

При выборе видеокарты наиболее важным параметром является доступное для её установки место в корпусе. Часто это указывается в разделе спецификаций или в онлайн-руководстве. Желающие самостоятельно могут снять боковую панель корпуса и примерно оценить доступное пространство при помощи рулетки или линейки.

Внутри корпуса нужно найти участок, где располагаются защёлки на слоте PCI Express, обычно сзади. Это место, где разъёмы видеокарты выступают через заднюю сторону системного блока. Измеряя отсюда, параллельно слоту PCI Express, куда устанавливаются видеокарты, ищите первое препятствие.

Это и будет максимальная длина карты, если на ней нет выступающих на конце разъёмов для подключения питания. Если есть, нужно сделать поправку на них. Чаще всего такие разъёмы находятся наверху современных видеокарт.

Если вы хотите установить мощную игровую видеокарту, нужно убедиться в наличии пространства для установки карты на два слота расширения. Почти все такие карты занимают именно два слота. Некоторые очень компактные компьютерные корпуса могут не обладать достаточным пространством между слотом PCI Express и ближайшей стенкой корпуса. Это может помешать установить видеокарту нужного размера.

Если вы обновляете существующий компьютер, желательно проверить хотя бы на глаз.

Расстояние между участком с крепежами и ближайшим объектом на другой стороне корпуса, вроде отсека для жёстких дисков или стенки самого корпуса, определяет, карта какой длины может поместиться. Если свободного пространства в системном блоке 262 мм или больше, можно будет установить по крайней мере некоторые современные мощные карты, в том числе на основе моделей Nvidia GeForce RTX 3070 и GeForce RTX 3080.

AMD среди таких мощных карт предлагаются Radeon RX 6800 и RX 6800 XT, референсные версии которых имеют длину как раз 262 мм. Некоторые карты сторонних производителей длиннее и намного, так что нужно проверять. Например, можно найти карты GeForce RTX 3070 длиной меньше 250 мм, а некоторые RTX 3060 Ti длиннее чем 300 мм. Смотрите спецификации.

Для небольших системных блоков, где есть место для полноразмерных видеокарт, нужна карта с воздушным охлаждением длиной 200 мм или меньше. Часто это корпуса с материнскими платами Mini-ITX, где место очень ограниченно. 200 мм может показаться минимальным значением, но по меркам игровых мощных видеокарт это немного. Однако, даже в таком случае существуют варианты.

Специальные утилиты

Естественно, данных, которые собирают штатные средства Виндовс, может оказаться недостаточно, так как часто приходится узнавать более детальную спецификацию. Для таких случаев существует несколько специальных программ, собирающих детальные сведения о всех компонентах компьютера:

Особой разницы в функциональности этих программ не замечено: все они собирают аналогичные данные, которые могут потребоваться при планировании последующего апгрейда. Интересующая информация обычно находится в разделе «Видеоадаптер» или «Графический ускоритель».

Важно! Утилиты, предназначенные для разгона графического ускорителя, как правило, диагностику не проводят и всю необходимую информацию не собирают. Не стоит устанавливать для этих целей MSI Afterburner, ASUS GPU Tweak или Gigabyte OC Guru.

О том, как подобрать игры по системным требованиям рекомендую, почитать здесь.

Также для вас будут полезны публикации «Из чего состоит видеокарта для компьютера» и «Разрядность шины памяти на видеокарте – что это такое». Буду признателен всем, кто расшарит(поделиться) этот пост в социальных сетях. До завтра!

О том, как проверить производительность видеокарты, можно почитать тут.

Размеры лучшей RTX 3080

Самая большая проблема для многих пользователей относительно размеров их видеокарты может заключаться в количестве слотов, которые она занимает по ширине, поскольку, если у вас есть небольшая коробка, особенно mini ITX, или если вы используете другую карту расширения или собираетесь использовать конфигурации различные видеокарты, это могло вызвать несовместимость.

Что касается размеров RTX 3080, которые мы видим в таблице, мы находим, что самый широкий - это Гигабайт AORUS MASTR , шириной 70 мм и шириной в три паза, за которыми следует EVGA FTW3 ULTRA Игры с 2.75 пазами (в этом случае точный размер в мм производителем не указан). Zotac Trinity OC и ASUS Варианты ROG STRIX занимают 2.5 слота шириной, остальные же не должны создавать проблем, так как занимают обычные 2 слота.

Второй из размеров, который может больше всего беспокоить пользователей, - это длина, поскольку, хотя в большинстве корпусов ПК много места, многие из них не соответствуют требованиям и не поддерживают графику длиной более 28 см, что составляет 30 см стандарт для midi (полу-башня ) форматировать коробки. Большинство RTX 3080, за исключением эталонных моделей NVIDIA и PNY, имеют длину более 12 дюймов, и на самом деле самая длинная из них - MSI Gaming X Trio, длина которой превышает 12 дюймов. Осторожнее с этим.

Наконец, что касается высоты видеокарты, то у большинства людей обычно не возникает проблем; При нормальном расположении в корпусе ПК высота видеокарты соответствует ширине корпуса, а ее совместимость можно увидеть в спецификации высоты ЦП радиатор, который он поддерживает. Большинство корпусов ПК поддерживают радиаторы высотой 160 миллиметров и более, поэтому, поскольку ни один из RTX 3080 не превышает этих размеров, ни у кого не должно возникнуть проблем. Однако обратите внимание, что разъемы питания PCIe в некоторых случаях составляют до дюйма или около того от этого размера, поэтому будьте осторожны с этим. В любом случае, перед тем, как запускать покупку одной из этих видеокарт, не помешает также проверить эту размерность.

Теперь вы знаете, сколько измеряет RTX 3080 из самого высокого диапазона каждого из основных сборщиков, поэтому с помощью этих измерений и проверки совместимости вашего бокса вы сможете узнать, подходят ли они к нему или нет.

report this ad

Приветствую! Может случиться такое, что, задумываясь об апгрейде компьютера, пользователь не помнит основные характеристики своей видеокарты. Как правило, апгрейд всегда подразумевает установку более мощных компонентов – системные требования приложений и игр постоянно растут, и мощностей, достаточных еще пару лет назад, на текущий момент уже может не хватать.

Сегодня поговорим о том, как посмотреть параметры видеокарты – не только на компьютере, но и другими способами.

Штатные средства Виндовс

Эти способы работают на любой версии операционной системы старше на windows 7, в том числе на 8.1 или на windows 10.

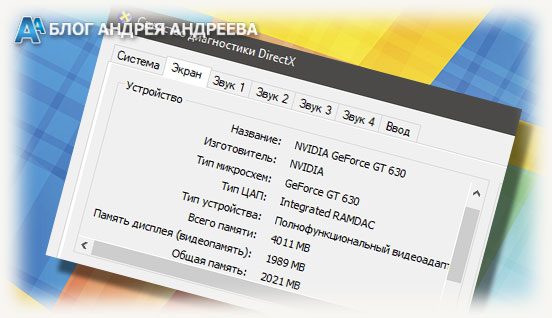

Первый вариант – воспользоваться средством диагностики библиотек DirectX. Для этого нажмите кнопку «Пуск» и в строке «Выполнить» введите команду dxdiag, после чего запустите найденный EXE файл.

В открывшемся окне во вкладке «Экран» представлены самые важные параметры графического ускорителя: модель графического чипа, тип ЦАП, количество видеопамяти. Для примера: nvidia geforce gtx 650, Integrated RAMDAC, 2048 МБ.Второй способ узнать модель используемого на ПК видеоадаптера: кликнуть правой кнопкой мышки по рабочему столу и в контекстном меню выбрать «Разрешение экрана». После перехода по ссылке «Дополнительные параметры» можно узнать те же сведения, что указаны выше, плюс версию BIOS, используемую видеокартой.

Третий способ – кликнуть по кнопке «Пуск» и в правой части открывшегося окна выбрать «Панель управления», а оттуда перейти в Диспетчер устройств. Во вкладке «Видеоадаптеры» кликните правой кнопкой мыши по используемой видеокарте и выберите пункт «Свойства». Во вкладке «Общие» указана модель устройства.

Как определить или посмотреть модель видеокарты: самый простой способ

Вся спецификация указана на коробке и в сопутствующей документации – инструкции или гарантийном талоне. В большинстве случаев, упаковка после покупки нового девайса бережно прячется пользователем, так как во время поломки при отсутствии тары, могут возникнуть проблемы с гарантийным обслуживанием.

Конечно, с точки зрения законодательства — это немного уже перегиб, так как для ремонта достаточно одного гарантийного талона, однако недобросовестные продавцы могут искать любые причины, чтобы не ремонтировать девайс бесплатно. Тем самым они подталкивают владельца неисправного устройства к платному ремонту или покупке нового.

Что может понадобиться из этих данных? Из спецификации можно узнать бренд и марку используемого графического чипа, частоту работы этого компонента и видеопамяти, ее тип, объем, возможность разгона и другую важную информацию. Если упаковка и документы утеряны или где-то затерялись, переходим к следующему пункту.

Что такое шина данных

Как вы, вероятно, уже знаете, основные компоненты, которыми определяется производительность видеоадаптера — графический чип и видеопамять. Соединяются между собой они специальным каналом, который называется шиной данных.

Пропускная способность, или же битность — «ширина» этого канала, которая измеряется в битах. Она определяет количество информации, которой могут обменяться графический процессор и память видеокарты за единицу времени. Логично, что чем больше эта цифра, тем лучше.

Для игр это особенно актуально: в современных видеоиграх, требовательных к вычислительной мощности, часто ширина канала помимо прочих характеристик определяет, будет игра лагать или нет.

Если же включены сглаживание и анизотропная фильтрация, добавляющие красоты эффектам и игровым объектам, графическая плата с малой битностью попросту захлебнется от такого потока данных.

Читайте также: