Как использовать обе видеокарты и подключить vga

Многие из вас наверняка видели у друзей и знакомых сразу два подключенных к одному системному блоку монитора, ну или второй монитор, подключенный к ноутбуку, сегодня мы разберем этот вопрос, научимся подключать одновременно сразу два монитора к одному ноутбуку или компьютеру.

Самое главное то, чтобы компьютер или ноутбук, который у вас есть, имел как минимум два видеовыхода, тогда все получится. В наш современный век практически на всех компьютерах и ноутбуках есть данная возможность.

На самом деле в том чтобы подключить одновременно два монитора к ноутбуку или компьютеру совсем не сложно. Для начала нам необходимо определиться с тем, к какому разъему и каким кабелем мы будем подключаться.

Как на мониторе, так и на видеокарте компьютера или ноутбука существует три варианта видеовыходов:

Самым лучшим и качественным считается HDMI разъем, это самый современный и высокоскоростной разъем для передачи изображения, но он есть не у каждой видеокарты и монитора, поэтому сегодня мы рассмотрим самый популярный интерфейс подключения, аналоговый, или VGA. Все вы видели такой разъем у себя дома и на компьютере и на мониторе, вот как он выглядит:

На ноутбуках видеовыходы обычно находятся, где то сбоку, вот например, так:

Подключение все это с помощью VGA-кабеля, вы так же видели его у себя дома неоднократно:

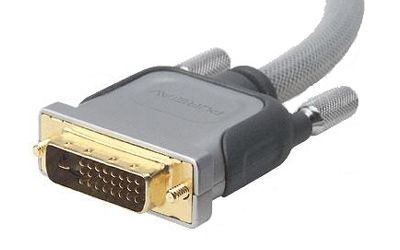

Бывает такое, что на мониторе или на видеокарте есть только DVI разъем, вот так:

Тогда нам понадобится переходник с DVI на VGA

- Вот мы, кажется, и разобрались, что нам потребуется для подключения второго монитора к компьютеру. Осталось только сказать, что если у вас есть и на мониторе и на компьютере DVI или HDMI, вы можете подключиться с помощью этих разъемов, они более современные и качественные, а разницы в настройке не будет никакой.

- После того как мы нужным кабелем подключили второй монитор к ноутбуку или к компьютеру, переходим к его настройке в самой системе. Мы будем настраивать в системе Windows 7 Professional, настройка подойдет и для Windows 8, а так же для Windows XP, будут лишь незначительные расхождения.

- Нажимаем правой кнопкой мыши на рабочем столе, на любом пустом месте, и выбираем пункт «Разрешение экрана».

- В появившемся окне нажимаем кнопку «Найти»

- После этого вы увидите как в пункте «Дисплей» изменится параметр с «Устройство отображения» на «Несколько мониторов», возможно у вас собьется разрешение экрана, тогда вам нужно еще раз выбрать необходимое для вас разрешение, и нажимаем клавишу «Применить».

- Теперь наши мониторы работают вместе, и картинка на одном мониторе полностью дублируется и на втором, но можно изменить режим отображения двух мониторов, всего режимов 4, рассмотрим их по порядку:

- Дублировать экраны. В этом режиме на двух мониторах одновременно отображаются одни и те же действия.

- Расширить экраны. В этом режиме ваш монитор как бы становится шире, вы можете перетаскивать окна и программы с одного монитора на другой. Это очень удобно, например, когда вы одновременно работаете в нескольких программах, или же вам нужен доступ сразу к нескольким документам, чтобы постоянно не сворачивать документы по очереди, их можно просто разбросать по двум мониторам.

- «Отобразить рабочий стол только на 1». В этом режиме картинка будет отображаться только на мониторе под цифрой 1, второй монитор в это время будет просто черным.

- «Отобразить рабочий стол только на 2». В этом режиме наоборот, вся картинка будет на втором мониторе, а первый будет неактивным.

В заключение можно сказать, что по возможности, для получения картинки более высокого качества, лучше использовать цифровые разъемы DVI и HDMI. Разъем VGA является аналоговым, но за неимением других вариантов можно спокойно использовать и его. Вот и все, мы настроили работу двух мониторов на одном компьютере.

Способ №2. Настройка Панели управления

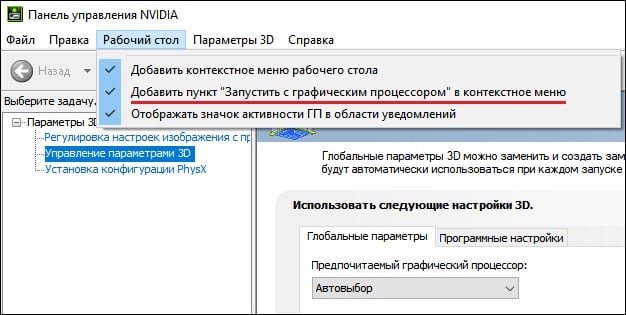

- Вновь запустите «Панель Управления Nvidia» как описано выше;

- Слева выберите пункт «Управление параметрами 3D»;

Выберите указанный параметр

Выберите указанные настройки

1 комментарий к “Одновременное подключение двух мониторов к одному компьютеру или ноутбуку”

Я себе так подключил два монитора , один еще квадратного соотношения сторон lg1953tr , через аналог и 22 » lg широкоформатку через vga , видеокарта ati 5750 , на которой один выход vga , а второй аналог. Ну , что могу сказать , прикольно вышло , но из-за того , что один имеет макс. разрешение 1280*1024 ,а второй 1980*1080 и они физически разные в размерах чудно выходит смотреть , на них фильмы , сильно виден переход , да и общий контраст нельзя подобрать , плюс ко всему углы обзора разные , и общая разрешалка падает из-за старого монитора . в игры играть сложновато , но для фильмов если не сильно придираться , то довольно таки круто. Трансформеры смотрел и новый день независимости понравилось.

Может все таки есть проги для улучшения разрешения или все , что выставил в ати катализе ето максимально возможные варианты?

Всем хай, народ подскажите пожалуйста, имею ноут в выходами hdmi и vga, не могу подключить одновременно 2 монитора через эти выходы, работает либо один, либо второй, как сделать чтоб работали оба одновременно плюс экран ноута? гугл не помог.

При VGA подключении:

+ возможно (зависит от модели ТВ) ТВ будет сразу отключаться/включаться при отсутствии сигнала с ПК

+ возможно (зависит от модели ТВ) четкость и отклик будут лучше изза отсутствия "улучшалок" изображения для отображения сигнала с VGA

– возможно снижение четкости картинки, особенно если воспользуетесь дешевым VGA кабелем. Сигнал все же аналоговый.

– звук прийдется выводить отдельным кабелем, а не через тот же HDMI. Но это не проблема, если у вас отдельная аккустика.

Для HDMI/DVI-D ситуация противоположная.

При RGB все совсем плохо, высокого разрешения и четкости не будет.

Просто попробуйте оба варианта, VGA/HDMI(DVI-D) и поймете, какой больше подходит вам и вашему ТВ.

Руководство покупателя игровой видеокарты

На выбор видеокарты также может повлиять и имеющийся или предполагаемый к приобретению монитор. Или даже мониторы (во множественном числе). Так, для современных LCD-мониторов с цифровыми входами очень желательно, чтобы на видеокарте был разъём DVI, HDMI или DisplayPort. К счастью, на всех современных решениях сейчас есть такие порты, а зачастую и все вместе. Ещё одна тонкость заключается в том, что если требуется разрешение выше 1920×1200 по цифровому выходу DVI, то обязательно нужно подключать видеокарту к монитору при помощи разъёма и кабеля с поддержкой Dual-Link DVI. Впрочем, сейчас с этим проблем уже нет. Рассмотрим основные разъёмы, использующиеся для подключения устройств отображения информации.

Аналоговый D-Sub разъём (также известен как VGA -выход или DB-15F )

Это давно известный всем и привычный 15-контактный разъём для подключения аналоговых мониторов. Сокращение VGA расшифровывается как video graphics array (массив пикселей) или video graphics adapter (видеоадаптер). Разъём предназначен для вывода аналогового сигнала, на качество которого может влиять множество разных факторов, таких, как качество RAMDAC и аналоговых цепей, поэтому качество получаемой картинки может отличаться на разных видеокартах. Кроме того, в современных видеокартах качеству аналогового выхода уделяется меньше внимания, и для получения чёткой картинки на высоких разрешениях лучше использовать цифровое подключение.

Разъёмы D-Sub были фактически единственным стандартом до времени широкого распространения LCD-мониторов. Такие выходы и сейчас часто используются для подключения LCD-мониторов, но лишь бюджетных моделей, которые плохо подходят для игр. Для подключения современных мониторов и проекторов рекомендуется использовать цифровые интерфейсы, одним из наиболее распространенных из которых является DVI.

Разъём DVI (вариации: DVI-I и DVI-D )

DVI — это стандартный интерфейс, чаще всего использующийся для вывода цифрового видеосигнала на ЖК-мониторы, за исключением самых дешевых. На фотографии показана довольно старая видеокарта с тремя разъёмами: D-Sub, S-Video и DVI. Существует три типа DVI-разъёмов: DVI-D (цифровой), DVI-A (аналоговый) и DVI-I (integrated — комбинированный или универсальный):

DVI-D — исключительно цифровое подключение, позволяющее избежать потерь в качестве из-за двойной конвертации цифрового сигнала в аналоговый и из аналогового в цифровой. Этот тип подключения предоставляет максимально качественную картинку, он выводит сигнал только в цифровом виде, к нему могут быть подключены цифровые LCD-мониторы с DVI-входами или профессиональные ЭЛТ-мониторы со встроенным RAMDAC и входом DVI (весьма редкие экземпляры, особенно сейчас). От DVI-I этот разъём отличается физическим отсутствием части контактов, и переходник DVI-to-D-Sub, о котором речь пойдет далее, в него не воткнуть. Чаще всего этот тип DVI применяется в системных платах с интегрированным видеоядром, на видеокартах он встречается реже.

DVI-A — это довольно редкий тип аналогового подключения по DVI, предназначенного для вывода аналогового изображения на ЭЛТ-приемники. В этом случае сигнал ухудшается из-за двойного цифрово-аналогового и аналогово-цифрового преобразования, его качество соответствует качеству стандартного VGA-подключения. В природе почти не встречается.

DVI-I — это комбинация двух вышеописанных вариантов, способная на передачу как аналогового сигнала, так и цифрового. Этот тип применяется в видеоплатах наиболее часто, он универсален и при помощи специальных переходников, идущих в комплекте поставки большинства видеокарт, к нему можно подключить также и обычный аналоговый ЭЛТ-монитор со входом DB-15F. Вот как выглядят эти переходники:

Во всех современных видеокартах есть хотя бы один DVI-выход, а то и два универсальных разъёма DVI-I. D-Sub чаще всего отсутствуют (но их можно подключать при помощи переходников, см. выше), кроме, опять же, бюджетных моделей. Для передачи цифровых данных используется или одноканальное решение DVI Single-Link, или двухканальное — Dual-Link. Формат передачи Single-Link использует один TMDS-передатчик (165 МГц), а Dual-Link — два, он удваивает пропускную способность и позволяет получать разрешения экрана выше, чем 1920×1080 и 1920×1200 на 60 Гц, поддерживая режимы очень высокого разрешения, вроде 2560×1600. Поэтому для самых крупных LCD-мониторов с большим разрешением, таких как 30-дюймовые модели, а также мониторов, предназначенных для вывода стереокартинки, обязательно будет нужна видеокарта с двухканальным выходом DVI Dual-Link или HDMI версии 1.3.

В последнее время широкое распространение получил новый бытовой интерфейс — High Definition Multimedia Interface. Этот стандарт обеспечивает одновременную передачу визуальной и звуковой информации по одному кабелю, он разработан для телевидения и кино, но и пользователи ПК могут использовать его для вывода видеоданных при помощи HDMI-разъёма.

На фото слева — HDMI, справа — DVI-I. HDMI-выходы на видеокартах сейчас встречаются уже довольно часто, и таких моделей всё больше, особенно в случае видеокарт, предназначенных для создания медиацентров. Просмотр видеоданных высокого разрешения на компьютере требует видеокарты и монитора, поддерживающих систему защиты содержимого HDCP, и соединенных кабелем HDMI или DVI. Видеокарты не обязательно должны нести разъём HDMI на борту, в остальных случаях подключение HDMI-кабеля осуществляется и через переходник на DVI:

HDMI — это очередная попытка стандартизации универсального подключения для цифровых аудио- и видеоприложений. Оно сразу же получило мощную поддержку со стороны гигантов электронной индустрии (в группу компаний, занимающихся разработкой стандарта, входят такие компании, как Sony, Toshiba, Hitachi, Panasonic, Thomson, Philips и Silicon Image), и большинство современных устройств вывода высокого разрешения имеет хотя бы один такой разъём. HDMI позволяет передавать защищенные от копирования звук и изображение в цифровом формате по одному кабелю, стандарт первой версии основывается на пропускной способности 5 Гбит/с, а HDMI 1.3 расширил этот предел до 10,2 Гбит/с.

HDMI 1.3 — это обновленная спецификация стандарта с увеличенной пропускной способностью интерфейса, увеличенной частотой синхронизации до 340 МГц, что позволяет подключать дисплеи высокого разрешения, поддерживающие большее количество цветов (форматы с глубиной цвета вплоть до 48 бит). Новой версией спецификации определяется и поддержка новых стандартов Dolby для передачи сжатого звука без потерь в качестве. Кроме этого, появились и другие нововведения, в спецификации 1.3 был описан новый разъём mini-HDMI, меньший по размеру по сравнению с оригинальным. Такие разъёмы также используются на видеокартах.

HDMI 1.4b — это последняя новая версия данного стандарта, вышедшая не так давно. В HDMI 1.4 появились следующие основные нововведения: поддержка формата стереоотображения (также называемого «3D») с поочередной передачей кадров и активными очками для просмотра, поддержка Fast Ethernet-соединения HDMI Ethernet Channel для передачи данных, реверсивный аудиоканал, позволяющий передавать цифровой звук в обратном направлении, поддержка форматов разрешения 3840×2160 до 30 Гц и 4096×2160 до 24 Гц, поддержка новых цветовых пространств и самый маленький разъём micro-HDMI.

В HDMI 1.4a поддержка стереоотображения была значительно улучшена, появились новые режимы Side-by-Side и Top-and-Bottom в дополнение к режимам спецификации 1.4. И наконец, совсем свежее обновление стандарта HDMI 1.4b произошло буквально несколько недель назад, и нововведения этой версии пока неизвестны широкой публике, да и устройств с его поддержкой пока что на рынке нет.

Собственно, наличие именно разъёма HDMI на видеокарте необязательно, во многих случаях его может заменить переходник с DVI на HDMI. Он несложен и поэтому прилагается в комплекте большинства современных видеокарт. Мало того, современные GPU имеют встроенный аудиочип, необходимый для поддержки передачи звука по HDMI. На всех современных видеокартах AMD и NVIDIA нет необходимости во внешнем аудиорешении и соответствующих соединительных кабелях, и передавать аудиосигнал с внешней звуковой карты не нужно.

Передача видео- и аудиосигнала по одному HDMI-разъёму востребована прежде всего на картах среднего и низшего уровней, которые устанавливают в маленькие и тихие баребоны, используемые в качестве медиацентров, хотя и в игровых решениях HDMI применяется часто, во многом из-за распространения бытовой техники с такими разъёмами.

Постепенно, в дополнение к распространенным видеоинтерфейсам DVI и HDMI, на рынке появляются решения с интерфейсом DisplayPort. Single-Link DVI передаёт видеосигнал с разрешением до 1920×1080 пикселей, частотой 60 Гц и 8 бит на компоненту цвета, Dual-Link позволяет передавать 2560×1600 на частоте 60 Гц, но уже 3840×2400 пикселей при тех же условиях для Dual-Link DVI недоступны. У HDMI почти те же ограничения, версия 1.3 поддерживает передачу сигнала с разрешением до 2560×1600 точек с частотой 60 Гц и 8 бит на компоненту цвета (на более низких разрешениях — и 16 бит). Хотя максимальные возможности у DisplayPort немногим выше, чем у Dual-Link DVI, лишь 2560×2048 пикселей при 60 Гц и 8 бит на цветовой канал, но у него есть поддержка 10-битного цвета на канал при разрешении 2560×1600, а также 12 бит для формата 1080p.

Первая версия цифрового видеоинтерфейса DisplayPort была принята VESA (Video Electronics Standards Association) весной 2006 года. Она определяет новый универсальный цифровой интерфейс, не подлежащий лицензированию и не облагаемый выплатами, предназначенный для соединения компьютеров и мониторов, а также другой мультимедийной техники. В группу VESA DisplayPort, продвигающую стандарт, входят крупные производители электроники: AMD, NVIDIA, Dell, HP, Intel, Lenovo, Molex, Philips, Samsung.

Основным соперником DisplayPort является разъём HDMI с поддержкой защиты от записи HDCP, хотя он предназначен скорее для соединения бытовых цифровых устройств, вроде плееров и HDTV-панелей. Ещё одним конкурентом раньше можно было назвать Unified Display Interface — менее дорогую альтернативу разъёмам HDMI и DVI, но основной её разработчик, компания Intel, отказалась от продвижения стандарта в пользу DisplayPort.

Отсутствие лицензионных выплат важно для производителей, ведь за использование в своей продукции интерфейса HDMI они обязаны выплачивать лицензионные сборы организации HDMI Licensing, которая затем делит средства между держателями прав на стандарт: Panasonic, Philips, Hitachi, Silicon Image, Sony, Thomson и Toshiba. Отказ от HDMI в пользу аналогичного «бесплатного» универсального интерфейса сэкономит производителям видеокарт и мониторов приличные средства — понятно, почему им DisplayPort понравился.

Технически, разъём DisplayPort поддерживает до четырёх линий передачи данных, по каждой из которых можно передавать 1,3, 2,2 или 4,3 гигабит/с, всего до 17,28 гигабит/с. Поддерживаются режимы с глубиной цвета от 6 до 16 бит на цветовой канал. Дополнительный двунаправленный канал, предназначенный для передачи команд и управляющей информации, работает на скорости 1 мегабит/с или 720 мегабит/с и используется для обслуживания работы основного канала, а также передачи сигналов VESA EDID и VESA MCCS. Также, в отличие от DVI, тактовый сигнал передаётся по сигнальным линиям, а не отдельно, и декодируется приёмником.

Обновленная версия стандарта — 1.1, появилась через год после 1.0. Её нововведениями стала поддержка защиты от копирования HDCP, важная при просмотре защищенного контента с дисков Blu-ray и HD DVD, и поддержка волоконно-оптических кабелей в дополнение к обычным медным. Последнее позволяет передавать сигнал на ещё бо́льшие расстояния без потерь в качестве.

В DisplayPort 1.2, утверждённом в 2009 году, была вдвое увеличена пропускная способность интерфейса, до 17,28 гигабит/с, что позволило поддержать более высокие разрешения, частоту обновления экрана и глубину цвета. Также именно в 1.2 появилась поддержка передачи нескольких потоков по одному соединению для подключения нескольких мониторов, поддержка форматов стереоотображения и цветовых пространств xvYCC, scRGB и Adobe RGB. Появился и уменьшенный разъём Mini-DisplayPort для портативных устройств.

Полноразмерный внешний разъём DisplayPort имеет 20 контактов, его физический размер можно сравнить со всем известными разъёмами USB. Новый тип разъёма уже можно увидеть на многих современных видеокартах и мониторах, внешне он похож и на HDMI, и на USB, но также может быть оснащён защёлками на разъёмах, аналогичным тем, что предусмотрены в Serial ATA.

Перед тем как AMD купила компанию ATI, последняя сообщила о поставках видеокарт с разъёмами DisplayPort — уже в начале 2007 года, но слияние компаний отодвинуло это появление на какое-то время. В дальнейшем AMD объявила DisplayPort стандартным разъёмом в рамках платформы Fusion, подразумевающей унифицированную архитектуру центрального и графического процессоров в одном чипе, а также будущих мобильных платформ. NVIDIA не отстаёт от соперника, выпуская широкий ассортимент видеокарт с поддержкой DisplayPort.

Из производителей мониторов, объявивших о поддержке и анонсировавших DisplayPort-продукты, первыми стали Samsung и Dell. Естественно, такую поддержку получили сначала новые мониторы с большим размером диагонали экрана и высоким разрешением. Существуют переходники DisplayPort-to-HDMI и DisplayPort-to-DVI, а также DisplayPort-to-VGA, преобразующий цифровой сигнал в аналоговый. То есть даже в случае присутствия на видеокарте исключительно разъёмов DisplayPort, их можно будет подключить к любому типу монитора.

Кроме вышеперечисленных разъёмов, на старых видеокартах также иногда встречаются композитный разъём и S-Video (S-VHS) с четырьмя или семью штырьками. Чаще всего они используются для вывода сигнала на устаревшие аналоговые телевизионные приемники, и даже на S-Video композитный сигнал зачастую получают смешиванием, что негативно влияет на качество картинки. S-Video лучше по качеству, чем композитный «тюльпан», но оба они уступают компонентному выходу YPbPr. Такой разъём есть на некоторых мониторах и телевизорах высокого разрешения, сигнал по нему передается в аналоговой форме и по качеству сравним с интерфейсом D-Sub. Впрочем, в случае современных видеокарт и мониторов обращать внимание на все аналоговые разъёмы просто не имеет никакого смысла.

Многие современные ПК оснащены сразу двумя видеокартами – встроенной и дискретной. Встроенная (обычно это видеокарта от Интел) обслуживает несложные офисные задачи. Дискретная (от Нвидиа) работает с громоздкими графическими приложениями. При этом могут возникнуть ситуации, когда для запуска ресурсоёмких графических приложений компьютер ошибочно задействует встроенную плату вместо дополнительной. Как же поступить в данной ситуации? Ниже разберём, каким образом можно переключать видеокарту на вашем ноутбуке с Intel на Nvidia, и какова последовательность шагов при реализации данной операции.

Порядок переключения видеокарты на ноутбуке с Intel на nVidia

Задействование адаптеры от Нвидиа на обычно напрямую зависит от созданных на ПК профилей приложений. Если приложение не имеет такого профиля, и при его запуске используется неправильная видеоплата, то вам понадобится создать его. Учтите, что использование карты от Нвидиа для повседневных приложений существенно снижает время автономной работы вашего ноутбука.

Способ №3. Активация через BIOS

С помощью БИОС мы можем также постараться переключить графическую плату на лэптопе. Для этого:

- Перезагрузите ПК, и при его запуске быстро жмите на кнопки «Esc», «Del» или F2 для перехода в БИОС.

- Там выбираем «Advanced» — вкладку «Chipset» (или «Display»).

- В параметре «Graphics Device» ставим «Discrete graphics» или «PCI» (внешняя видеокарта).

Выберите указанную настройку

Способ №1. Запуск приложения на лэптопе с помощью карты Нвидиа

- Запустите Панель управления вашего ПК;

- Кликните на «Оборудование и Звук» — «Панель управления NVIDIA»;

- После запуска Панели на самом верху кликните на вкладке «Рабочий стол», и поставьте галочку на опции «Запустить с графическим процессором» в контекстное меню;

Установите данную галочку в меню

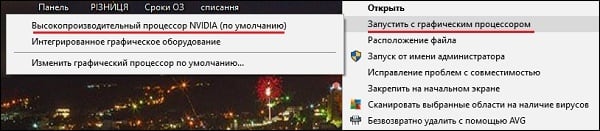

Теперь для запуска нужного приложения с помощью карты от Нвидиа наведите на его ярлык на рабочем столе курсор, щёлкните ПКМ. В появившемся меню выберите опцию «Запустить с графическим процессором» — «Высокопроизводительный процессор NVIDIA».

Выберите запуск с помощью карты от Нвидиа

Может быть полезно:

Может быть полезно:

Заключение

Ниже мы разобрали программные способы того, каким образом можно переключить видеокарту на вашем ноутбуке со встроенной Intel на более мощную nVidia. Если ни одна из указанных альтернатив не подошла, вы можете перейти в Диспетчер устройств, навести курсор на вашу интегрированную графическую плату, нажать ПКМ и выбрать «Отключить». Это насильно переведёт ПК на работу с дискретной видеокартой, но будьте готовы, что лэптоп при этом начнёт работать нестабильно. Потому данную операцию стоит выполнять на свой страх и риск без гарантии в получении требуемого результата.

Наличием двух видеокарт на персональном компьютере уже никого не удивишь, в основном это слабая интегрированная и более мощная дискретная. Использование мощного видео не всегда нужно и постоянная его работа это больше расход энергии, более продуктивная работа систем охлаждения, как результат скорее износятся комплектующие ПК, поэтому часто спрашивают, как использовать интегрированное видео.

Интегрированная видеокарта это впаянный чип в материнскую плату, который для своей работы использует ресурсы оперативной памяти.

Если у вас ноутбук (Ноутбук), то по умолчанию сначала работает интегрированная карта, а дискретная включается автоматически при нагрузке на графику и чаще возникает проблема как привлечь последнюю. Что касается стационарного ПК (Десктоп), то здесь есть несколько нюансов.

Первый, интегрированная видеокарта должна быть включена в BIOS и соответственно настроена. Под настройками подразумевается выделение нужного количества мегабайт памяти, которые будут браться из оперативной.

В зависимости от материнской платы и количества установленной оперативной памяти она бывает разной, следует помнить, чем больше вы отдаете на видеокарту тем меньше остается на обработку других процессов так, что здесь стоит сбалансировать.

Современные интегрированные видеокарты могут выдавать от 64мегабайт до 4 гигабайт на видео при нужном количестве ОЗУ.

Включаем интегрированную графику

В большинстве случаев для того, чтобы задействовать встроенную графику, достаточно подключить монитор к соответствующему разъему на материнской плате, предварительно вынув дискретную видеокарту из слота PCI-E. Если разъемы отсутствуют, то воспользоваться интегрированным видеоядром не представляется возможным.

При самом неблагоприятном исходе, при переключении монитора мы получим черный экран при загрузке, свидетельствующий о том, что встроенная графика отключена в БИОСе материнской платы либо для нее не установлены драйвера, либо и то, и другое. В этом случае подсоединяем монитор к дискретной видеокарте, перезагружаемся и входим в БИОС.

Рассмотрим ситуацию на примере UEFI BIOS, которым управляется большинство современных материнских плат. На главной странице включаем расширенный режим, нажав на кнопку «Дополнительно».

Далее переходим на вкладку с таким же названием («Дополнительно» или «Advanced») и выбираем пункт «Конфигурация системного агента» или «System Agent Configuration».

Затем идем в раздел «Параметры графики» или «Graphics Configuration».

Напротив пункта «Основной дисплей» («Primary Display») нужно выставить значение «iGPU».

Жмем F10, соглашаемся с сохранением параметров, выбрав пункт «Yes», и выключаем компьютер.

Снова подсоединяем монитор к разъему на материнской плате и запускаем машину.

После запуска открываем «Панель управления» и кликаем по ссылке «Диспетчер устройств».

Переходим к ветке «Видеоадаптеры» и видим там «Базовый адаптер Майкрософт». Это устройство в разных редакциях может называться по-разному, но смысл один: это универсальный драйвер графики Windows. Кликаем по адаптеру ПКМ и выбираем пункт «Обновить драйверы».

Затем выбираем автоматический поиск программного обеспечения. Обратите внимание, что системе потребуется доступ в интернет.

Автоматический поиск драйверов для встроенной видеокарты в Диспетчере устройств Windows

После поиска найденный драйвер будет установлен и, после перезагрузки, можно будет пользоваться встроенной графикой.

Отключение встроенного видеоядра

Если у Вас возникла мысль об отключении встроенной видеокарты, то лучше этого не делать, так как в этом действии нет особого смысла. В стационарных компьютерах при подключении дискретного адаптера встроенный отключается автоматически, а на ноутбуках, снабженных переключаемой графикой, вовсе может привести к неработоспособности устройства .

Интегрированные видеокарты разработаны для работы с офисными программами, простыми приложениями и играми, не требующие больших ресурсов. Для их работы требуется меньше питания и не нужно устанавливать дополнительных систем охлаждения. Преимущественно их используют в бюджетных вариантах системных блоков, что дает возможность сэкономить деньги.

периодически работает displayport (пропадает изображение на мониторе)

Да, у меня тоже такое бывает, крайне редко но регулярно, на разных видяшках. Грешу на кабель, но не напрягает, потому не вмешиваюсь.

Раньше это вроде как было невозможно

Разве? Как только у меня появился интегрированное видео, тут же стал им пользоваться. Но этого двумя видяшками (начиная с AGP+PCI) пользовался.

Заметил только, что система не стабильно работает в отдельных сценариях, если и интегрированное видео (Intel HD), и дискретное (Nvidia) использовать – то сон не работал, то тормоза на ровном месте, то еще что-то. В итоге отказался от использования интегрированного, добавил видеокарту просто еще одну в систему. Потом еще одну, третью, но это уже другая история.

как распределяются нагрузки/ресурсы? Если я запускаю игру, то чьи ресурсы она задействует

Не знаю, как в теории, но на практике используются ресурсы той карточки, которая выбрана как "основная" в Windows. Если приложение работает в окне, то при перетаскивании ока на другой монитор, приложение может переключить отрисовку Direct3D на другую карточку (например видео плеер MPC-HC). Но тут от приложения зависит. Чаще основная рендерит, а потом просто через вторую видяшку картинку выводит (в итоге нагружаются обе работой, и часто возникают дополнительные тормоза/проседание FPS).

У меня 2 монитора VGA. А на материнке только один VGA вход. Если я подключу видеокарту и к ней второй монитор VGA то они будут работать?

Можно, если ваша материнка поддерживает одновременную работу дискретной и встроенной графики.

Если нет, то выход только один - использовать видеокарту с двумя выходами.

а если я такой кабель подключу к материнке и 2 монитора к нему они будут работать?)

zaychonok_lisa, Это раздвоитель сигнала, с ним оба монитора будут показывать одну и ту же картинку.

Чтобы можно было вывести на второй монитор отдельную картинку, нужна вторая видеокарта.

А что, на D-Sub бывает хорошая картинка? Если ТС использует такой монитор, что-то мне подсказывает, что ему все равно.

Конвертер пригодится, если:

- на плате есть HDMI выход (определяется по спекам и визуально, вы в вопросе\комментарии по этому поводу ничего не писали)

- он работает (т.е. (а) не сломан, и (б) на нем есть сигнал - иногда отдельные выходы могут присутствовать физически, но быть отключенными или вовсе незадействованными)

- плата может поддерживать одновременно два монитора (смотреть спеки на матплату\что там выводит графику - надо полагать, iGPU процессора, я привык к дискретным картам и за этим не слежу)

- конвертер в правильнубю сторону (HDMI->D-Sub, а не наоборот) - по ссылке написано, что так оно и есть

- конвертер рабочий (UGREEN неплохой бренд, так что, скорее всего, здесь проблем быть не должно)

- качество вас устроит (в комментариях, например, пишут "Для того, чтобы выйти на разрешение 1920*1080 пришлось установить "custom resolution" в настройке видеокарты")

В общем случае - можно. Но:

- В BIOS нужно принудительно включить режим встроенной графики (с AUTO на включено).

- Процессор таки должен иметь видеоядро - в вашем случае имеет (а, например, intel серии i*-****F - не имеет).

- У слабой видеокарты наверняка будет возможность подключить 2 VGA (1 через переходник), так что может и огород городить не за чем.

- Установить драйверы и настроить мониторы в операционной системе.

- Ускорение на каждом порту будет от той видюхи, к которой оно подключено. Т.е. запустить 2 окна c тяжелой игрой на разных мониторах - не выйдет. А например ускорение CAD приложений может работать намного лучше на встроенной, так что при переходе на видеокарту могут наоборот начаться тормоза.

Если на видеокарте есть VGA значит скорее всего есть и DVI-I, используйте переходник DVI-I - VGA для подключения второго монитора

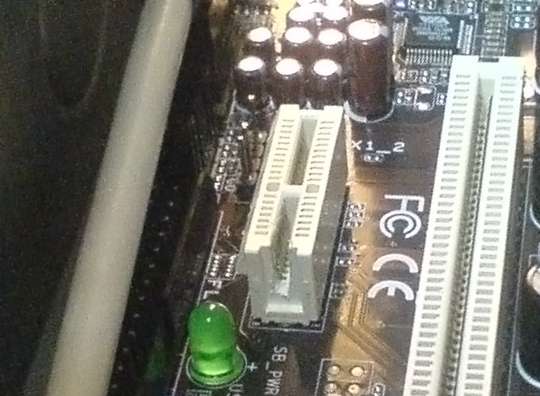

Если в компьютере имеются 2 видеовыхода и захотелось подключить 3 монитора, то с некоторой вероятностью сделать это просто добавлением второй видеокарты не удастся — не все материнские платы имеют 2 разъёма PCI Express X16, а в многочисленные разъёмы PCI Express X1 видеокарты обычного размера не встанут из-за несовместимости по разъёму. Не все знают, что на самом деле установка длинного разъёма X16 в короткий слот возможна, поэтому не обязательно для 3-го монитора покупать другую и более дорогую материнскую плату. Способам расширения потенциальных возможностей компьютера посвящена эта статья, а также она развеивает сомнения и опасения о том, что что-то при доработке платы напильником не получится. Час работы — и 3-й монитор к Вашей системе будет подключен.

Проблема установки 2 видеокарт существует из-за того, что большинство слотов PCI-Express x1 имеют пластмассовый бортик на конце, дальнем от стенки корпуса компьютера, а видеокарты не имеют прорези для совместимости с бортиком. Как показывается ниже, проблема решается простым прорезанием этого бортика.

Для чего это может понадобиться?

1) Для установки 3-го монитора в систему.

Все способы предполагают материальные затраты и более ограниченный выбор вариантов конфигурации. Если уже имеется плата со свободным слотом PCI-Express x1 и видеокарта с разъёмом PCI-Express x16, проще поступить так, как описано ниже.

Способ 1.6) Сделать прорезь на любом разъёме PCIe X1, удобном для установки видеокарты.

(рис. 6)

2) Для подключения видеокарт в режиме Crossfire.

Строго говоря, для этого режима предусмотрены специальные материнские платы. Но, возможно, решение будет работать и с любой парой разъёмов PCIe (не проверялось).

Процесс доработки разъёма.

Перед работой убедитесь, что на материнской плате действительно будет свободное место для установки свободно висящего «хвоста» разъёма PCI-Express x16. Могут быть детали (конденсаторы, другие разъёмы), которые, в лучшем случае, удастся перепаять, разместив в другом положении.

Прорезание стенки достаточно просто, но требует соблюдения нескольких технических моментов в плане аккуратности операции.

1) материнскую плату лучше вынуть из корпуса, так как неосторожным движением можно повредить целостность разъёма или окружающих деталей;

2) прорезание выполнять так, чтобы не треснула пластмасса разъёма в основании. Поэтому, не использовать кусачки, резать острым скальпелем или лезвием для строительного ножа, соскабливая мелкими кусками или дремелем (машинкой для боров с установленной циркулярной пилой или наждачным диском), но осторожно, чтобы не повредить контакты. Нарушение целостности пластмассы тоже может привести к раздвиганию контактов, ненадёжному соединению.

3) срезая кусочки пластмассы острым ножом, следует быть очень осторожным, чтобы не срезать пружинящие контакты, которые находятся буквально в миллиметре от места операции. Если резать неострым ножом, на процедуру уходит времени 25-30 минут, а контакты, вероятнее, оказываются более защищены тем, что неострое лезвие их не перережет. На практике, у меня один контакт отогнулся вовнутрь, в пространство для текстолита карты, но затем его удалось подогнуть обратно.

4) пластмассу срезать до уровня дна разъёма; на фото показан процесс последовательного выскабливания стенки разъёма до нужной глубины:

(рис. 7)

5) перед установкой видеокарты внимательно проверить, что контакты не загнуты вовнутрь и видеокарта их не повредит.

6) при установке видеокарты — проверить, не прикоснётся ли оголённый разъём видеокарты проводящих поверхностей (радиаторы, детали). Если есть такая опасность, изолировать разъём или поверхности хотя бы скотчем или толстой бумагой, прикреплённой к карте.

(рис. 8)

7) После установки 2-й видеокарты — закрепить её за корпус, так как точка крепления за один маленький разъём PCIe довольно опасна для целостности самого разъёма.

На практике, я игнорировал рекомендацию (1), потому что места для работ внутри корпуса хватало и пользовался неострым б/у-лезвием. Стружки изнутри разъёма выдувал через трубку от шариковой ручки (использование офисных инструментов).

(рис. 9)

Столь незначительный набор инструментов (лезвие, трубка, возможно — скотч) и около часа времени на установку — небольшая плата за возможность подключения 3-го монитора. Может быть, он окажется лишним, но проверить удобство работы с ним и без него лишним не будет.

(рис. 10)

Установка 3-го монитора в системе (Windows XP)

При включении компьютера на вторую карту видеосигнал сначала не подаётся, дисплей сообщает о неподключённом кабеле. Операционная система без проблем обнаруживает видеокарту и подключает драйвер, если это карта того же производителя, что и первая, ранее установленная. WinXP просит перезапустить себя после автоустановки драйвера без каких-либо специальных действий для этого. После перезапуска система стала видеть монитор на второй видеокарте, а монитор обнаружил подключение кабеля.

(рис. 12)

(Интересно, что 2-й монитор на 1-й видеокарте пронумеровался в системе третьим.)

После активации монитора в свойствах дисплея (возможно, потребуется запуск мастера подключения мониторов, зависит от драйвера) на нём появляется фон рабочего стола.

(рис. 13)

Остаётся настроить разрешение и частоту подключения. При установке монитора ЭЛТ не забываем установить частоту развёртки не менее 70 Гц, чтобы не пользоваться 60 Гц по умолчанию. Для LCD-мониторов такое действие не нужно.

(рис. 14)

Если производители чипов (NVidia, ATI, Matrox) разные, нужно установить второй драйвер — обычно, по отзывам из других статей, они уживаются вместе (UPD: по подсказке Jeditobe и подтверждению guessss_who, Windows Vista не поддерживает одновременно драйверы разных производителей видеокарт. XP и Win7 этим не страдают.). В настройках дисплея из системы подключается нужное количество дополнительных мониторов. Результат:

(рис. 15)

В других статьях были неоднократные измерения производительности видеокарт на разъёме PCI-Express x1, в которых показано, что все видеокарты уровня ниже ATI 3850 / GF 9800 в любых режимах и играх ведут себя практически одинаково по сравнению с разъёмом PCI-Express x16 — им хватает предельного потока данных через 1 канал PCI-Express, равного 250 Мбайт/с в одну сторону (500 Мбайт/с в обе).

Если для видеокарты не стоят игровые задачи или она маломощная, то решение на PCIе x1 почти не будет уступать другим решениям с более дорогой материнской платой (кроме некоторых очень требовательных приложений наподобие Microsoft Flight Simulator, Crysis, Call Of Duty 4).

Особенности взаимодействия встроенной и дискретной видеокарт

Как известно, корпорация «Intel» выпускает недорогие встроенные в процессор видеоплаты low-end сегмента, призванные снабдить компьютер базовыми графическими возможностями. Такие карты прекрасно подходят для офисных или домашних компьютеров с низкими графическими требованиями.

Напротив, карты от Nvidia предназначены для обслуживания ресурсоёмких графических программ (обычно это современные мощные игры и графические редакторы). Они обладают мощной системой охлаждения и высокой энергоёмкостью.

Обычно компьютер автоматически переключается между ними, задействуя встроенную плату от Интел для простых офисных приложений, и графическую от Нвидиа для большинства игр. Переключение между картами обычно осуществляется с помощью технологии «NVIDIA Optimus» , залогом стабильной работы которой является наличие на ПК самых свежих драйверов для обеих видеокарт.

В случае некорректного переключения между графическими адаптерами (к примеру, встроенная видеоплата используется для запуска мощных игр) возникает необходимость отрегулировать их переключение. Разберёмся, как это можно сделать.

Во многих ноутбуках представлены две видеокарты — от Интел и Нвидиа

Читайте также: