Как делятся вычислительные системы по типу эвм или процессоров

По типу ЭВМ или процессоров, используемых для построения ВС, различают однородные и неоднородные системы. Однородные вычислительные системы предполагают комплексирование однотипных ЭВМ (процессоров), а неоднородные – разнотипных ЭВМ (процессоров).

В однородных системах значительно упрощаются разработка и обслуживание технических и программных (в основном это операционные системы) средств. В них обеспечивается возможность стандартизации и унификации соединений и процедур взаимодействия элементов системы. Упрощается обслуживание систем, облегчаются модернизация и их развитие.

Неоднородные системы находят применение и в микропроцессорных системах. Многие ЭВМ, в том числе и ПЭВМ, могут использовать сопроцессоры: десятичной арифметики, матричные и т.п.

Суперкомпьютеры и особенности их архитектуры

К суперкомпьютерам относятся мощные многопроцессорные вычислительные машины с быстродействием сотни миллионов — десятки миллиардов операций в секунду. Создать такие высокопроизводительные компьютеры на одном микропроцессоре (МП) не представляется возможным ввиду ограничения, обусловленного конечным значением скорости распространения электромагнитных волн (300 000 км/с), т.к. время распространения сигнала на расстояние несколько миллиметров (линейный размер стороны МП) при быстродействии 100 млрд операций/с становится соизмеримым со временем выполнения одной операции. Поэтому суперкомпьютеры создаются в виде высокопараллельных многопроцессорных вычислительных систем (МПВС).

- Магистральные (конвейерные) МПВС, у которых процессор одновременно выполняет разные операции над последовательным потоком обрабатываемых данных. По принятой классификации такие МПВС относятся к системам с многократным потоком команд и однократным потоком данных (МКОД или MISD — Multiple Instruction Single Data).

- Векторные МПВС, у которых все процессоры одновременно выполняют одну команду над различными данными — однократный поток команд с многократным потоком данных (ОКМД или SIMD — Single Instruction Multiple Data).

- Матричные МПВС, у которых микропроцессор одновременно выполняет разные операции над последовательными потоками обрабатываемых данных —многократный поток команд с многократным потоком данных (МКМД или MIMD — Multiple Instruction Multiple Data).

- структура MIMD в классическом ее варианте;

- параллельно-конвейерная модификация, иначе MMISD, то есть многопроцессорная (Multiple) MISD-архитектура;

- параллельно-векторная модификация, иначе MSIMD, то есть многопроцессорная SIMD-архитектура.

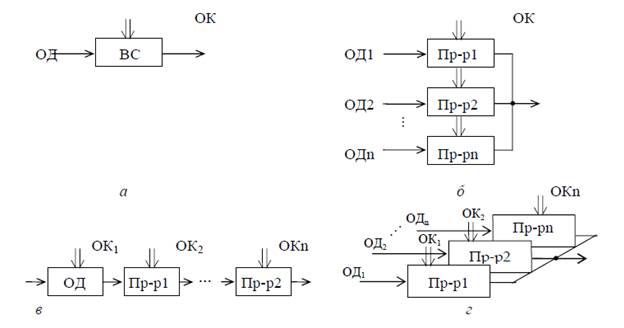

Рис. 3. Условные структуры однопроцессорной (SISD) и названных многопроцессорных ВС

Кластерные суперкомпьютеры и особенности их архитектуры

Существует технология построения больших компьютеров и суперкомпьютеров на базе кластерных решений. По мнению многих специалистов, на смену отдельным, независимым суперкомпьютерам должны прийти группы высокопроизводительных серверов, объединяемых в кластер.

Кластер - это связанный набор полноценных компьютеров, используемый в качестве единого вычислительного ресурса.

Удобство построения кластерных ВС заключается в том, что можно гибко регулировать необходимую производительность системы, подключая к кластеру с помощью специальных аппаратных и программных интерфейсов обычные серийные серверы до тех пор, пока не будет получен суперкомпьютер требуемой мощности. Кластеризация позволяет манипулировать группой серверов как одной системой, упрощая управление и повышая надежность.

Важной особенностью кластеров является обеспечение доступа любого сервера к любому блоку как оперативной, так и дисковой памяти. Эта проблема успешно решается, например, объединением систем SMP-архитектуры на базе автономных серверов для организации общего поля оперативной памяти и использованием дисковых систем RAID для памяти внешней (SMP — Shared Memory multiprocessing, технология мультипроцессирования с разделением памяти).

Для создания кластеров обычно используются либо простые однопроцессорные персональные компьютеры, либо двух- или четырех- процессорные SMP-серверы. При этом не накладывается никаких ограничений на состав и архитектуру узлов. Каждый из узлов может функционировать под управлением своей собственной операционной системы. Чаще всего используются стандартные ОС: Linux, FreeBSD, Solaris, Unix, Windows NT. В тех случаях, когда узлы кластера неоднородны, то говорят о гетерогенных кластерах.

- Первый подход применяется при создании небольших кластерных систем. В кластер объединяются полнофункциональные компьютеры, которые продолжают работать и как самостоятельные единицы, например, компьютеры учебного класса или рабочие станции лаборатории.

- Второй подход применяется в тех случаях, когда целенаправленно создается мощный вычислительный ресурс. Тогда системные блоки компьютеров компактно размещаются в специальных стойках, а для управления системой и для запуска задач выделяется один или несколько полнофункциональных компьютеров, называемых хост-компьютерами. В этом случае нет необходимости снабжать компьютеры вычислительных узлов графическими картами, мониторами, дисковыми накопителями и другим периферийным оборудованием, что значительно удешевляет стоимость системы.

- высокая суммарная производительность;

- высокая надежность работы системы;

- наилучшее соотношение производительность/стоимость;

- возможность динамического перераспределения нагрузок между серверами;

- легкая масштабируемость, то есть наращивание вычислительной мощности путем подключения дополнительных серверов;

- удобство управления и контроля работы системы.

- задержки разработки и принятия общих стандартов;

- большая доля нестандартных и закрытых разработок различных фирм, затрудняющих их совместное использование;

- трудности управления одновременным доступом к файлам;

- сложности с управлением конфигурацией, настройкой, развертыванием, оповещениями серверов о сбоях и т.п.

1 пример из «жизни» систем

- память: T2-P: PC1600/PC2100/PC2700/PC3200, до 2Гб, 2 DIMM слота

- память: T2-R: PC1600/PC2100/PC2700, до 2Гб, 2 DIMM слота;

- материнская плата: P4P8T, Intel 865G / ICH 5, 800/533/400МГц FSB

- материнская плата: P4R8T, ATI RS300/IXP200, 800/533/400MГц FSB;

- видео: интегрированная 64Mб

- ATI Radeon 9100, DVI, 64Mб;

- слоты: одинаковы для обеих систем: PCI, AGP 8x;

- сеть: 10/100Mбит/с, Wireless 802.11b WiFi

- сеть: 10/100Мбит/с;

- аудио: 6-канальный AC97 S/PDIF выход кнопки Audio DJ, Audio CD, FM radio studio

- аудио: 6-канальный AC97 S/PDIF выход;

- карты памяти: Compact Flash Type I/II, Microdrive, Memory Stick, Memory Stick Pro, Secure Digital, MultiMedia Card, Smart Media Card

- карты памяти: нет;

- отсеки для приводов: 3.5 FDD, 3.5 HDD, 5.25 ODD

- отсеки для приводов: 3.5 FDD, 3.5 HDD, 5.25 ODD;

- выходы на задней панели: 4xUSB 2.0, PS/2 клавиатура, PS/2 мышь, VGA (D-SUB), Game / MIDI, RJ-45 LAN (10/100 Мбит/с), Line-in/out, выход динамиков, FM антенна, антенна адаптера 802.11b, GIGA LAN, ТВ-тюнер

- выходы на задней панели: 2xUSB 2.0, PS/2 клавиатура, PS/2 мышь, VGA (D-SUB), Game / MIDI, RJ-45 LAN(10/100 Мбит/с), Line-in/out, выход наушников, FM антенна

Blue Gene будет установлен в Ливерморскую национальную лабораторию им. Лоуренса. Основные его задачи - моделирование погодных условий и изучение космического пространства.

Blue Gene будет состоять из 130 тысяч процессоров, и его производительность будет составлять 360 терафлопс.

Чипы IBM используются в системе, неформально называемой Big Mac. PowerPC 970 состоит из 1100 двухпроцессорных компьютеров Apple G5, занимая в общем списке третью строчку, с производительностью в 10,3 триллионов операций в секунду.

Процессоры Opteron используются в 2816-процессорном кластере, и его производительность составляет 8 триллионов операций в секунду.

Интересен факт, что общая производительность 500 лучших систем растет экспоненциально, увеличиваясь в десять раз примерно каждые четыре года. Порог в 1000 терафлопов (триллионов операций в секунду) планируется достигнуть к 2005 году.

Самые прочные позиции в списке у HP или IBM: соотношение числа систем - 165 против 159 в пользу HP

По типу ЭВМ или процессоров, используемых для построения ВС, различают однородныесистемы, предполагающие объединение однотипных ЭВМ и неоднородныесистемы, предполагающие объединение разнотипных ЭВМ.

В однородных системах значительно упрощается разработка и обслуживание технических и программных (в основном ОС) средств. В них обеспечивается возможность стандартизации и унификации соединений и процедур взаимодействия элементов системы. Упрощается обслуживание систем, облегчается модернизация и их развитие.

В неоднородныхВС соединяемые элементы ВС очень сильно отличаются по своим техническим и функциональным характеристикам. Обычно это связано с необходимостью параллельного выполнения многофункциональной обработки. Так, при построении сетевых ММС объединяются в комплексы коммуникационные ЭВМ, выполняющие функции связи, контроля получаемой и передаваемой информации, формирование пакетов задач и т.д., и ЭВМ обработки данных, выполняющие собственно обработку данных.

Классификация ВС по степени территориальной разобщенности вычислительных модулей

(Слайд 3)

ВС делятся на системы совмещенного (сосредоточенного) и распределенного (разобщенного) типов. Обычно такое деление касается только многомашинных систем (ММС).

Многопроцессорные системы (МПС) относятся к системам совмещенного типа. Два уровня их интеграции: система с процессорами на одном кристалле (многоядерность) - система из нескольких параллельно работающих процессоров в одной ЭВМ (многопроцессорность).

В совмещенных и распределенных MMС сильно различается оперативность взаимодействия в зависимости от удаленности ЭВМ. Как правило, все выпускаемые в мире ЭВМ имеют средства прямого взаимодействия и средства подключения к сетям ЭВМ. Для ПК такими средствами являются модемы и сетевые карты.

Классификация ВС по методам управления элементами ВС

(Слайд 3)

По методам управления элементами ВС различают централизованные, децентрализованныеи сосмешанным управлением. Помимо параллельных вычислений, производимых элементами системы, необходимо выделять и контролировать ресурсы на обеспечение управления этими вычислениями, распределять нагрузку между элементами ВС и координировать их взаимодействие.

В централизованныхВСза это отвечает главная (диспетчерская) ЭВМ (процессор). Эти функции могут передаваться и другой ЭВМ (процессору), что способствует повышению надежности системы. Централизованные системы имеют более простые ОС.

В децентрализованныхсистемахфункции управления распределены между ее элементами. Каждая ЭВМ (процессор) системы сохраняет известную автономию. Это наиболее перспективные ВС.

В системах сосмешаннымуправлениемсовмещаются процедуры централизованного и децентрализованного управления. Перераспределение функций осуществляется в ходе вычислительного процесса, исходя из сложившейся ситуации.

Прочие классификационные признаки ВС

(Слайд 3)

По принципу закрепления вычислительных функций за отдельными ЭВМ (процессорами) различают системы сжесткимиплавающимзакреплениемфункций. В зависимости от типа ВС следует решать задачи статического или динамического размещения программных модулей и массивов данных, обеспечивая необходимую гибкость системы и надежность ее функционирования.

По режиму работы ВС различают системы, работающие в оперативноми неоперативномвременныхрежимах. Первые, как правило, используют режим реального масштаба времени. Этот режим характеризуется жесткими ограничениями на время решения задач в системе и предполагает высокую степень автоматизации процедур ввода-вывода и обработки данных.

Архитектура вычислительных систем

Архитектура ВС - совокупность характеристик и параметров, определяющих функционально-логическую и структурную организацию системы и затрагивающий в основном уровень параллельно работающих вычислителей.

Классификация архитектур была предложена М. Флинном (М. Flynn) в начале 60-х гг. XX в. В основу такой классификации заложено два возможных вида параллелизма:

· независимость потоков заданий (команд),существующих в системе,

· независимость (несвязанность) данных, обрабатываемых в каждом потоке.

С появлением систем, ориентированных на потоки данных и использование ассоциативной обработки, данная классификация может быть некорректной. Но она является справедливой для ВС, в которых вычислительные модули построены на принципах классической структуры ЭВМ:

· ОКОД - одиночный поток команд - одиночный поток данных (SISD - Single Instruction Single Data -одиночный поток инструкций - одиночный поток данных)(Слайд 7);

Архитектура ОКОД(содним вычислителем) охватывает все однопроцессорные и одномашинные варианты систем. Все ЭВМ классической структуры попадают в этот класс. Здесь параллелизм вычислений обеспечивается путем совмещения выполнения операций отдельными блоками АЛУ, а также параллельной работой устройств ввода-вывода информации и процессора.

· ОКМД - одиночный поток команд - множественный поток данных (SIMD- Single Instruction Multiple Data - одиночный поток инструкций - множественный поток данных) (Слайд 8);

Архитектура ОКМДпредполагает создание структур векторной или матричной обработки. Системы этого типа обычно строятся как однородные, т.е. процессорные элементы, входящие в систему, идентичны и все они управляются одной и той же последовательностью команд. Однако каждый процессор обрабатывает свой поток данных - задачи обработки матриц или векторов (массивов), задачи решения систем линейных и нелинейных алгебраических и дифференциальных уравнений, задачи теории поля и др. В структурах данной архитектуры, как правило, соединения между процессорами напоминают матрицу.

· МКОД - множественный поток команд - одиночный поток данных (MISD - Multiple Instruction Single Data - множественный поток инструкций - одиночный поток данных) (Слайд 9);

Архитектура МКОДпредполагает построение своеобразного процессорного конвейера, в котором результаты обработки передаются от одного процессора к другому по цепочке. В современных ЭВМ по этому принципу реализована схема совмещения операций, в которой параллельно работают различные функциональные блоки, и каждый из них делает свою часть в общем цикле обработки команды.

· МКМД - множественный поток команд - множественный поток данных (MIMD - Multiple Instruction Multiple Data - множественный поток инструкций - множественный поток данных) (Слайд 10).

Архитектура МКМДпредполагает, что все процессоры системы работают с различными программами и с индивидуальным набором данных. В простейшем случае они могут быть автономны и независимы. Такая схема использования ВС часто применяется во многих крупных вычислительных центрах для увеличения пропускной способности центра.

МКМД - архитектура является наиболее перспективной для вычислительных систем. Ей присущи все перечисленные виды параллелизма. Этот класс дает большое разнообразие структур, сильно отличающихся друг от друга своими характеристиками (См. Рис. 2-10).

3. Многопроцессорные структуры ВС (пример построения)

Процессоры Power7, разработка которых обошлась в 3 млрд. долл., содержат от 6 до 8 ядер на одном кристалле, каждое из которых способно поддерживать до четырех потоков вычислений, а также кэш-память eDRAM третьего уровня. Процессоры выполнены на основе 45-нанометровой технологии, содержат более миллиарда транзисторов, работают на тактовых частотах до 4,14 ГГц. Они могут выполнять 32 параллельные задачи, что в четыре раза превышает возможности предыдущего процессора Power6.

На базе этих процессоров выпущена линейка серверов (Слайд 11):

1. Бизнес-сервер начального уровня IBM Power 750 Express предназначен для ИС предприятий среднего масштаба и имеет четыре процессорных разъема, что позволяет использовать в вычислениях до 32 процессорных ядер.

2. Сервер IBM Power 755, также содержащий до 32ядер, оптимизирован для выполнения аналитических приложений, включая моделирование погодных условий, расчеты в области химии и физики.

3. Бизнес-сервер корпоративного класса IBM Power 770 может содержать до 64 ядер Power7 и рекомендован для решения критически важных задач предприятий.

4. Бизнес-сервер корпоративного класса IBM Power 780, также содержащий до 64 ядер является масштабируемым сервером старшего класса и применяется для решения таких ресурсоемких задач, как, например, обработка и анализ транзакций в системах, управляющих сетями энергоснабжения.

Для процессоров Power7 разработан ряд новых технологий:

· технология TurboCore позволяет перераспределять ресурсы каждого процессора, выделяя активным ядрам, работающим на максимальной частоте, кэш-память других ядер, а также их каналы взаимодействия с оперативной памятью;

· технология Intelligent Threads дает возможность оптимизировать нагрузку, динамически выбирая число потоков, поддерживаемых каждым ядром;

· технология EnergyScale позволяет варьировать тактовую частоту, снижая потребление электроэнергии.

В конце 2010 года в IBM планировали выпустить серверы на базе Power7, содержащие до 256 ядер.

Суперкомпьютеры

В общем виде, под суперкомпьютеромпринято понимать высокопараллельную многопроцессорную ВС с быстродействием порядка от 100 000 MFloPS; емкостью оперативной памяти от 10 Гбайт, дисковой памяти от10 Тбайт (1 Тбайт = 1000 Гбайт) и разрядностью 64-128 бит (Слайд 12).

Производительность современных суперкомпьютеров измеряется в терафлопах (триллионах операций с плавающей запятой в секунду) и петафлопах (квадрильонах операций с плавающей запятой в секунду). Иногда используются термины «терафлопс» и «петафлопс».

Создать такиевысокопроизводительные компьютеры на одном микропроцессоре (МП) не представляется возможным ввиду ограничения, обусловленного конечным значениемскорости распространения электромагнитных волн (300 000 км/с). Времяраспространения сигнала на расстояние несколько миллиметров (линейный размер стороныМП) при быстродействии 100 млрд. операций/с становится соизмеримым со временем выполнения одной операции.

В суперкомпьютерах используются три варианта архитектуры МПВС (Слайд 13):

· МКМД - структура в классическом ее варианте (например, в раннем классическом суперкомпьютере ЭБР фирмы Burrought);

· параллельно-конвейерная модификация, иначе MКОД, то есть многопроцессорная МКОД -структура (например, в первых отечественных суперкомпьютерах «Эльбрус 3,4»);

· параллельно-векторная модификация, иначе ОКМД, то есть многопроцессорная ОКМД -структура (например, в современных суперкомпьютерах Cray).

Наибольшую эффективность показала ОКМД - структура, поэтому в современных суперкомпьютерах чаще всего используется именно она (суперкомпьютеры фирмCray, Fujitsu, NEC, Hitachi и т. д.).

Суперкомпьютеры можно использовать для моделирования систем безопасности, двигателей машин, расчета траектории движения тайфунов, планирования и оптимизации грузоперевозок, для видеомонтажа, спецэффектов и анимации в кино и на телевидении и многих других сложных задач.

История создания

(Слайд 14).

Первый суперкомпьютер был задуман в 1960 исоздан в 1972 году (машина ILLIAC-IV с производительностью 20 MFloPS), начинаяс 1974 года лидерство в разработке суперкомпьютеров захватила фирма GrayResearch.

В СССР, начиная с 70-х годов ХХ века, практически все ЭВМ, малые ЭВМ и ПК за редким исключением (ЭВМ «Рута 110») копировали зарубежные разработки и, в первую очередь, разработки фирм США. Но среди лучших суперкомпьютеров в свое время были и оригинальные отечественные суперкомпьютеры.

В СССР была разработана, реализовывалась государственная программа разработки суперкомпьютеров, впоследствии практически замороженная. В рамках этой программы были разработаны и выпущены как суперкомпьютеры, повторяющие архитектуру Cray («Электроника СС БИС»), так и оригинальные разработки: ЕС 1191 (1200 MFloPS), офисные варианты ЕС 1195 (50 MFloPS), ЕС 1191.01 (500 MFloPS), ЕС 1191.10 (2000 MFloPS) и «Эльбрус» модификаций 1,2,3.

Суперкомпьютер «Эльбрус ЗБ» в процессе разработки достиг производительности 20 000 MFloPS.

Использовались операционные системы «Эльбрус» и UNIX, поддерживающие большое число языков программирования: Эль, Фортран, Паскаль, Кобол, Пролог и т. д.

Для суперкомпьютера «Эльбрус» был разработан «Эль2К» - один из первых в мире микропроцессоров имеющий VLIW-архитектуру.

В декабре 1996года фирма Intel объявила о создании суперкомпьютера Sandia, впервые в мире преодолевшего терафлопный барьер быстродействия. За 1 час 40 минут компьютер выполнил 6,4 квдрл. вычислений с плавающей запятой.

Конфигурация представляла собой 57 шкафов, содержащих более 7000 процессоров PentiumPro с тактовой частотой 200 МГц и оперативную память 454 Гбайт. Окончательный вариант суперкомпьютера имел производительность 1,4 TFLoPS. Он состоит из 86 шкафов общей площадью 160 кв. м. В этих шкафах размещается 573 Гбайт оперативной и 2250 Гбайт дисковой памяти. Масса компьютера составляла около 45 тонн, а пиковое потребление энергии — 850 кВт.

Современные суперкомпьютеры

(Слайд 15).

Суперкомпьютеры используются в различных областях, где требуются сложные вычисления и обрабатываются огромные массивы изменяющейся информации. Например, для моделирования в области космоса и авиастроения, для моделирования систем безопасности, двигателей машин, расчета траектории движения тайфунов, планирования и оптимизации грузоперевозок, для видеомонтажа, спецэффектов и анимации в кино и на телевидении и др:

1. Суперкомпьютер Cray XT4с увеличенной производительностью (в сравнении с Cray XT3) создан в 2007 году на процессорах AMD - двуядерных чипах Opteron.. Он поддерживает до 30 тыс. процессоров Opteron, подключаемых при помощи чипов Cray SeaStar 2, которые используют возможности шины Hiper-TransSport и ускоряют обмен данными между процессорами. Вопреки традициям типичной кластерной архитектуры (См. ниже), у Cray ХТ4 каждый процессор имеет собственную микросхему для связи с соседними. Суперкомпьютер совместим с четырехъядерными процессорами AMD.

2. Суперкомпьютер BlueGene/L с пиковой производительностью в 478,2 терафлопа (478,2 триллиона операций в секунду) в начале 2008 года был самым быстрым на Земле.

3. Суперкомпьютер Pleiades. NASA совместно с SGI и Intel в 2009 году начала создание одного из самых быстрых суперкомпьютеров на Земле. Новый суперкомпьютер будет использоваться в Калифорнийском исследовательском центреЭймс (Ames Research Center) для различных имитационных задач и задач по моделированию. К 2012 году планируется нарастить мощность до 10 петафлоп.

Производительность нынешнего суперкомпьютера NASA, Columbia, составляет 88,88 терафлопса. Он используется для изучения поведения гиперзвукового самолета, имитации высадки посадочных модулей и моделирования ткани скафандра.

4. Суперкомпьютер Blue Water. К 2011 году IBM планирует создать еще один суперкомпьютер Blue Water, мощность которого составит не менее петафлопа. Заказчиком этого вычислительного комплекса является Национальный центр прикладных систем для суперкомпьютеров при университете штата Иллинойс.

Его основой станут 200 тыс. процессорных ядер и свыше 1 петабайта оперативной памяти. Общая емкость его дисковых накопителей составит 10 петабайт.

5. Суперкомпьютер Dawning 5000. Китай является второй страной, после США, сумевшей в 2008 году создать суперкомпьютер производительностью более 100 терафлоп. У Dawning 5000 пиковая производительность достигает 230 терафлоп. Dawning 5000 в том году вошел в десятку мощнейших суперкомпьютеров мира. Кроме того, Китай планирует создать к 2011 году петафлоповый суперкомпьютер Шугуан-5000. Его основой станут китайские процессоры Godson 3.

6. Суперкомпьютер Sequoia. Компания IBM в 2009 году объявила о планах построения в Ливерморской национальной лаборатории министерства энергетики США суперкомпьютера Sequoia, мощность которого составит 20 петафлоп. Он будет включать 1,6 млн. процессоров. Объем оперативной памяти системы составит 1,6 петабайта.Площадь, которую будет занимать Sequoia, составит 318 кв.м.

Предполагается, что его запустят в 2012 годудля изучения ядерного оружия, в частности, для моделирования его испытаний.

Представители IBM подчеркивают, Sequoia может использоваться и в мирных целях. В частности, этот суперкомпьютер способен моделировать погодные изменения в 40 раз быстрее используемых в настоящее время систем. Для моделирования землетрясения ему понадобится в 50 раз меньше времени, чем современным вычислительным комплексам.

Под вычислительной системой (ВС) будем понимать совокупность взаимосвязанных и взаимодействующих процессоров или ЭВМ, периферийного оборудования и программного обеспечения, предназначенную для сбора, хранения, обработки и распределения информации.

Основными классификационными признаками ВС являются признаки структурной и функциональной организации вычислительной системы:

по типу – многомашинные и многопроцессорные.

по типу ЭВМ или процессоров - однородные и неоднородные.

по степени территориальной разобщенности вычислительных модулей – сосредоточенные и разобщенные.

по методам управления - централизованные, децентрализованные и со смешанным управлением.

по принципу закрепления вычислительных функций за отдельными ЭВМ - с жестким и плавающим закреплением функций.

по режиму работы - работающие в оперативном и неоперативном временных режимах.

Первые, как правило, используют режим реального времени. Этот режим характеризуется жесткими ограничениями на время решения задач в системе и предполагает высокую степень автоматизации процедур ввода-вывода и обработки данных.

Архитектура и типовые структуры вычислительных систем.

Основным отличием ВС от компьютеров является наличие в их структурах нескольких вычислителей (компьютеров или процессоров). Поэтому они способны выполнять параллельные вычисления.

Классификация М. Флинна.

независимость потоков заданий (команд), существующих в системе

независимость (несвязанность) данных, обрабатываемых в каждом потоке.

Основные архитектуры ВС:

а) Одиночный поток команд – одиночный поток данных (ОКОД)

все однопроцессорные и одномашинные варианты систем, то есть системы с одним вычислителем. Все ЭВМ классической структуры попадают в этот класс. Здесь параллелизм вычислений обеспечивается путем совмещения выполнения операций отдельными блоками АЛУ, а также параллельной работой устройств ввода-вывода информации и процессора. Закономерности организации вычислительного процесса в этих структурах достаточно хорошо изучены.

б) Одиночный поток команд – множественный поток данных (ОКМД)

создание структур векторной или матричной обработки. Системы этого типа обычно строятся как однородные: процессорные элементы, входящие в систему, идентичны, и все они управляются одной и той же последовательностью команд. Однако каждый процессор обрабатывает свой поток данных. Под эту схему хорошо подходят задачи обработки матриц или векторов (массивов), задачи решения систем линейных и нелинейных, алгебраических и дифференциальных уравнений, задачи теории поля и др. В структурах данной архитектуры желательно обеспечивать соединения между процессорами, соответствующие реализуемым математическим зависимостям. Как правило, эти связи напоминают матрицу, в которой каждый процессорный элемент связан с соседними. Векторный или матричный тип вычислений является необходимым атрибутом любой суперЭВМ.

в) Множественный поток команд – одиночный поток данных (МКОД)

построение своеобразного процессорного конвейера, в котором результаты обработки передаются от одного процессора к другому по цепочке. Выгоды такого вида обработки понятны. Однако в большинстве алгоритмов очень трудно выявить подобный, регулярный характер в вычислениях. Кроме того, на практике нельзя обеспечить и «большую длину» такого конвейера, при которой достигается наивысший эффект. Вместе с тем конвейерная схема нашла применение в так называемых скалярных процессорах суперЭВМ, в которых они применяются как специальные процессоры для поддержки векторной обработки.

г) Множественный поток команд – множественный поток данных (МКМД)

все процессоры системы работают с различными программами и с индивидуальным набором данных. В простейшем случае они могут быть автономны и независимы. Такая схема использования ВС часто применяется на многих крупных вычислительных центрах для увеличения пропускной способности центра.

Кластеры

Кластер – это группа взаимно соединенных вычислительных систем (узлов), работающих совместно, составляя единый вычислительный ресурс и создавая иллюзию наличия единственной ВМ.

Перед кластерами ставятся две задачи:

1) достичь большой вычислительной мощности;

2) обеспечить повышенную надежность ВС

В качестве узлов кластеров могут использоваться как одинаковые ВС (гомогенные кластеры), так и разные (гетерогенные кластеры). По своей архитектуре кластерная ВС является слабо связанной системой.

Преимущества, достигаемые с помощью кластеризации:

1) Абсолютная масштабируемость. Возможно создание больших кластеров, превосходящих по вычислительной мощности даже самые производительные одиночные ВМ. Кластер в состоянии содержать десятки узлов, каждый из которых представляет собой мультиплексор.

2) Наращиваемая масштабируемость. Кластер строится так, что его можно наращивать, добавляя новые узлы небольшими порциями.

3) Высокий коэффициент готовности. Поскольку каждый узел кластера – самостоятельная ВМ или ВС, отказ одного из узлов не приводит к потере работоспособности кластера. Во многих системах отказоустойчивость автоматически поддерживается программным обеспечением.

4) Превосходное соотношение цена/производительность. Кластер любой производительности можно создать, соединяя стандартные ВМ, при этом его стоимость будет ниже, чем у одиночной ВМ с эквивалентной вычислительной мощностью.

На уровне аппаратного обеспечения кластер – это просто совокупность независимых вычислительных систем, объединенных сетью.

Узлы кластера контролируют работоспособность друг друга и обмениваются специфической информацией. Контроль работоспособности осуществляется с помощью специального сигнала, называемого heart-beat («сердцебиение»). Этот сигнал передается узлами кластера друг другу, чтобы подтвердить их нормальное функционирование.

Неотъемлемой частью кластера является специализированное программное обеспечение (ПО), на которое возлагается задача обеспечения бесперебойной работы при отказе одного или нескольких узлов. Такое ПО производит перераспределение вычислительной нагрузки при отказе одного или нескольких узлов кластера, а также восстановление вычислений при сбое в узле. Кроме того, при наличии в кластере совместно используемых дисков кластерное ПО поддерживает единую файловую систему.

Существуют следующие методы кластеризации:

1) Пассивное резервирование. Вторичный сервер при отказе первичного берет управление на себя.

2) Резервирование с активным вторичным сервером. Вторичный сервер, как и первичный, используется при решении задач.

3) Самостоятельные серверы. Самостоятельные серверы имеют собственные диски, а данные постоянно копируются с первичного сервера на вторичный.

4) Серверы с подключением ко всем дискам. Серверы подключены к одним и тем же дискам, но каждый сервер владеет своей их частью. Если один из серверов отказывает, то управление его дисками берет на себя другой сервер.

5) Серверы с совместно используемыми дисками. Множество серверов работают в режиме коллективного доступа к дискам.

Топологии сетей

Термин «топология» характеризует физическое расположение компьютеров, кабелей и других компонентов сети.

Топология сети обуславливает ее характеристики. В частности выбор той или иной топологии влияет на:

· состав необходимого сетевого оборудования;

· характеристики сетевого оборудования;

· возможности расширения сети;

· способ управления сетью.

Каждая топология сети налагает ряд условий. Например, она может диктовать не только тип кабеля, но и способ его прокладки.

Базовые топологии

- шина (bus) - компьютеры подключены вдоль одного кабеля, топология называется шиной;

Используется один кабель, именуемый магистралью или сегментом, вдоль которого подключены все компьютеры сети; данные передаются всем компьютерам в сети; однако информацию принимает тот, адрес которого соответствует адресу получателя. Причем в каждый момент времени, только один компьютер может вести передачу.

Преимущества: отсутствие дополнительного активного оборудования (например повторителей) делает такие сети простыми и недорогими.

Недостаток линейной топологии заключается в ограничениях по размеру сети, ее функциональности и расширяемости.

- звезда (star) - компьютеры подключены к сегментам кабеля, исходящим из одной точки или концентратора

Преимущество: если нарушится работа в одном компьютере или выйдет из строя кабель, соединяющий один компьютер, то только этот компьютер не сможет получать и передавать сигналы. На остальные компьютеры в сети это не повлияет. Общая скорость работы сети ограничивается только пропускной способностью концентратора.

Недостаток: так как все компьютеры подключены к центральной точке, для больших сетей значительно увеличивается расход кабеля. К тому же если центральный компонент выйдет из строя, нарушится работа всей сети.

- кольцо (ring) - кабель, к которому подключены компьютеры, замкнут в кольцо

В отличии от пассивной топологии «шина», здесь каждый компьютер выступает в роли репитора, усиливая сигналы и передавая их следующему компьютеру.

Наиболее существенный ее недостаток заключается в том, что при выходе из строя хотя бы одного устройства отказывалась функционировать вся сеть.

Модель OSI

«Эталонная модель взаимодействия открытых систем» (OSI) - является концептуальной основой, описывающей правила и процедуры обмена данными при организации сеанса связи, которые должны быть реализованы как в аппаратных, так и в программных средствах сетей. Она разделяет функции в сети на семь уровней: прикладной, представительный, сеансовый, транспортный, сетевой, канальный и физический.

Система передачи информации

Для существования и распространения информация должна быть обязательно связана с какой-либо материальной основой – без неё она не может проявляться, передаваться и сохраняться. Материальным носителем информации может быть бумага, воздух, лазерный диск, электромагнитное поле и т.д. При этом хранение информации связано с некоторой характеристикой носителя, которая не меняется с течением времени, а передача информации – наоборот, с характеристикой, которая изменяется с течением времени. Изменение характеристики носителя, которое используется для представления информации, называется сигналом.

Линия связи – это физическая среда, которая используется для распространения сигналов в нужном направлении.

Каналом связи называют средства односторонней передачи данных. Они создаются по линиям связи. Одна и та же линия связи может служить одновременно для реализации нескольких каналов связи. Существует два основных метода разделения линии связи:

– временное мультиплексирование – разделение по времени, при котором каждому каналу выделяется некоторый интервал времени;

– частотное мультиплексирование – разделение по частоте, при котором каналу выделяется некоторая полоса частот.

Основными характеристиками линии связи являются:

– амплитудно-частотная характеристика – показывает, как затухает амплитуда синусоиды на выходе линии связи по сравнению с амплитудой на её входе для всех возможных частот передаваемого сигнала;

– полоса пропускания – это непрерывный диапазон частот, для которого отношение амплитуды выходного сигнала к входному превышает некоторый заранее заданный предел (обычно 0,5);

– затухание – относительное уменьшение амплитуды или мощности сигнала при передаче по линии сигнала определённой частоты;

– помехоустойчивость – способность уменьшать уровень помех, создаваемых во внешней среде;

– пропускная способность – максимальное количество информации, передаваемое в единицу времени без потерь и искажений;

– достоверность передачи данных – характеризует вероятность искажения для каждого передаваемого бита данных;

Физическая среда является основой, на которой строятся физические средства соединения. В качестве физической среды широко используются эфир, металлы, оптическое стекло и кварц. Среда передачи данных может включать как кабельные, так и беспроводные технологии.

Сетевое оборудование

Всё оборудование, используемое в компьютерных сетях, можно условно разделить на три группы:

– аппаратура передачи данных – используется для соединения компьютеров или локальных сетей с линией связи;

– оконечное оборудование данных – это аппаратура пользователя линии связи, вырабатывающая данные для передачи по линии связи и подключаемая непосредственно к аппаратуре передачи данных;

– промежуточная аппаратура – используется для улучшения качества сигнала и создания постоянного составного канала связи между двумя абонентами сети.

Повторитель (repeater) – физически соединяет различные сегменты кабеля локальной сети и передаёт сигналы из одного сегмента сети в другой, улучшая его качество, позволяя тем самым преодолеть ограничения на длину линий связи.

Концентратор (hub) – устройство для соединения нескольких компьютеров в локальную сеть, являясь её центральным соединительным узлом. Он не способен регулировать потоки данных, а лишь передаёт сигнал от порта к порту, т.е. все устройства, подключённые к концентратору, получают одну и ту же информацию.

Коммутатор (switch) – устройство, предназначенное для соединения нескольких узлов компьютерной сети в пределах одного сегмента. В отличие от концентратора, который осуществляет широковещательную рассылку пакетов, коммутатор передаёт данные только целевому устройству, а также он разрешает возникающие на портах коллизии.

Структурированная кабельная система – это набор коммутационных элементов (кабелей, разъёмов, коннекторов, кроссовых панелей и шкафов), а также методика их совместного использования, которая позволяет создавать регулярные, легко расширяемые структуры связей в вычислительных сетях

Мост (bridge) – это программно-аппаратный комплекс, который соединяет локальные сети между собой, а также локальные сети и удалённые рабочие станции, позволяет им взаимодействовать друг с другом для расширения возможностей сбора и обмена данными. Они могут соединять две или более сети с одинаковыми протоколами взаимодействия, одинаковыми типами среды передачи и одинаковой структурой адресации.

Маршрутизатор (router) – это устройство, которое собирает информацию о топологии межсетевых соединений и на её основании пересылает данные в сеть назначения, что позволяет более эффективно, чем мосты, изолировать поток данных отдельных сегментов сети друг от друга.

Шлюзы (gateway) соединяют сети с разными протоколами, типами системного и прикладного программного обеспечения, преобразуя проходящие через них сигналы

В настоящее время персональные компьютеры (ПК) повсеместно используются практически во всех сферах человеческой деятельности. Но, с точки зрения эволюции ЭВМ, стандартный ПК представляет собой частный случай – однопроцессорную одномашинную вычислительную систему. Для изучения более высокоуровневых вычислительных систем, а именно - многомашинных и многопроцессорных ВС, необходимо остановиться на их основных определениях и принципах классификации..

Определение и классификация вычислительных систем

Вычислительные машины (ЭВМ) с середины ХХ века прошли путь, отмеченный частыми сменами поколений компьютеров и характеризующийся рядом закономерностей:

· доминирование классической структуры ЭВМ (структура фон Неймана), основанной на методах последовательных вычислений;

· основное направление совершенствования ЭВМ - рост производительности (быстродействия) и интеллектуальности вычислительных средств;

· совершенствование ЭВМ – комплекс решений по всем уровням построения и функционирования ЭВМ;

· исчерпание возможностей методов последовательных вычислений - переход к параллельным вычислениям на базе построения многопроцессорных систем и сетей, объединяющих большое количество отдельных процессоров и (или) компьютеров.

Под вычислительной системой (ВС)понимается совокупность взаимосвязанных и взаимодействующих процессоров или ЭВМ, периферийного оборудования и программного обеспечения, предназначенная для сбора, хранения, обработки и распределения информации(Слайд 2).

Отличительной особенностью ВС по отношению к ЭВМ является наличие в них нескольких вычислителей, реализующих параллельную обработку. Создание ВС преследует следующие основные цели:

· повышение производительности системы за счет ускорения процессов обработки данных,

· повышение надежности и достоверности вычислений,

· предоставление пользователям дополнительных сервисных услуг и т.д.

Основные принципы построения ВС:

· возможность работы в разных режимах;

· модульность структуры технических и программных средств, что позволяет совершенствовать и модернизировать вычислительные системы без коренных их переделок;

· унификация и стандартизация технических и программных решений;

· иерархия в организации управления процессами;

· способность систем к адаптации, самонастройке и самоорганизации;

· обеспечение необходимым сервисом пользователей при выполнении вычислений.

СтруктураВС - это совокупность комплекса ее элементов и их связей. В качестве элементов ВС выступают отдельные ЭВМ и процессоры. В ВС, относящихся к классу больших систем, можно отдельно рассматривать структуры технических, программных средств, структуры управления и т.д.

Классификация ВС по назначению

ВС делятся на (Слайд 3) универсальные, предназначенные для решения самых различных задач, и специализированные,предназначенные для решения узкого класса задач.

Специализация ВС может устанавливаться различными средствами:

1. сама структура системы (количество параллельно работающих элементов, связи между ними и т.д.) может быть ориентирована на определенные виды обработки информации: матричные вычисления, решение алгебраических, дифференциальных и интегральных уравнений и т.п.

2. специализация ВС может закладываться включением в их состав специального оборудования и специальных пакетов обслуживания техники.

Классификация ВС по типу построения

По типу построения ВС могут строиться на базе нескольких компьютеров (многомашинная ВС) или на базе нескольких процессоров (многопроцессорная ВС).

Многомашинная ВСсодержит некоторое число компьютеров, информационно взаимодействующих между собой. Машины могут находиться рядом друг с другом, а могут быть удалены друг от друга на некоторое, иногда значительное расстояние (вычислительные сети).

Многомашинные вычислительные системы(ММС) появились исторически первыми. Уже при использовании ЭВМ первых поколений возникали задачи повышения производительности, надежности и достоверности вычислений (Слайд 4).

Варианты 1 и 2 обеспечивают режим повышенной надежности - одна из машин выполняет вычисления, а другая находится в «горячем» или «холодном» резерве, т. е. в готовности заменить основную ЭВМ.

Вариант 3 соответствует случаю, когда обе машины обеспечивают один из двух возможных параллельных режимов вычислений:

1. обе ЭВМ решают одну и ту же задачу и периодически сверяют результаты решения, обеспечивая режим повышенной достоверности и уменьшение вероятности появления ошибок. Примерно так построены управляющие бортовые вычислительные комплексы космических аппаратов и др.;

2. обе ЭВМ работают параллельно, но обрабатывают собственные потоки заданий. Возможность обмена информацией между машинами сохраняется. Этот вид работы относится к режиму повышенной производительности. Она широко используется в практике организации работ на крупных вычислительных центрах, оснащенных несколькими ЭВМ высокой производительности.

В многомашинных ВСкаждый компьютер работает под управлением своей операционной системы (ОС). А поскольку обмен информацией между машинами выполняется под управлением ОС, взаимодействующих друг с другом, динамические характеристики процедур обмена несколько ухудшаются (требуется время на согласование работы самих ОС).

Информационное взаимодействие компьютеров в многомашинной ВС может быть организовано на 3-х уровнях (Слайд 5):

1. На уровне процессоров - при непосредственном взаимодействии процессоров друг с другом информационная связь реализуется через регистры процессорной памяти и требует наличия в ОС весьма сложных специальных программ.

2. На уровне оперативной памяти - взаимодействие на уровне оперативной памяти (ОП) сводится к программной реализации общего поля оперативной памяти(ООП), что проще, но требует существенной модификации ОС. Под общим полем имеется в виду равнодоступность модулей памяти: все модули памяти доступны всем процессорам и каналам связи.

3. На уровне каналов связи - взаимодействие организуется наиболее просто, и может быть достигнуто внешними по отношению к ОС программами - драйверами, обеспечивающими доступ от каналов связи одной машины к внешним устройствам других (формируется общее поле внешней памяти и общий доступ к устройствам ввода-вывода).

Ввиду сложности организации информационного взаимодействия на 1-м и 2-м уровняхв большинстве многомашинных ВС используется 3-й уровень, хотя и динамические характеристики (в первую очередь быстродействие), и показатели надежности таких систем существенно ниже.

В многопроцессорной ВС (МПС) (Слайд 6) имеется несколько информационно взаимодействующих между собой процессоров. В качестве общего ресурса они имеют общую оперативную память (ООП), обеспечивающую общий доступ к внешней памяти и устройствам ввода-вывода. МПС работает под управлением единой ОС, общей для всех процессоров, что существенно улучшает динамические характеристики ВС, но предъявляет к ОС высокие требования.

Более быстрый обмен информацией между процессорами и более быстрое реагирование на ситуации, возникающие в системе, большая степень резервирования устройств системы (система сохраняет работоспособность, пока работоспособны хотя бы по одному модулю каждого типа устройств) приводят к существенному повышению быстродействия и надежности многопроцессорных ВС (по сравнению с многомашинными ВС 3-го уровня).

Типичным примером массовых многомашинных ВС могут служить компьютерныесети, примером многопроцессорных ВС — суперкомпьютеры.

Классификация вычислительных систем

Существует большое количество признаков, по которым классифицируют вычислительные системы.

- универсальные

- специализированные.

- многомашинные

- многопроцессорные

- процессоров;

- оперативной памяти;

- каналов связи.

- однородные системы

- неоднородные системы.

- централизованные

- децентрализованные

- со смешанным управлением.

- территориально-сосредоточенные –это когда все компоненты располагаются в непосредственной близости друг от друга;

- распределенные –это когда компоненты могут располагаться на значительном расстоянии, например, вычислительные сети;

- структурно-одноуровневые –это когда имеется лишь один общий уровень обработки данных;

- многоуровневые(иерархические) структуры –это когда в иерархических ВС машины или процессоры распределены по разным уровням обработки информации, некоторые машины (процессоры) могут специализироваться на выполнении определенных функций.

Взаимодействие на уровне оперативной памяти (ОП) сводится к программной реализации общего поля оперативной памяти, что несколько проще, но также требует существенной модификации ОС. Под общим полем имеется в виду равнодоступность модулей памяти: все модули памяти доступны всем процессорам и каналам связи.

На уровне каналов связи взаимодействие организуется наиболее просто и может быть достигнуто внешними по отношению к ОС программами-драйверами, обеспечивающими доступ от каналов связи одной машины к внешним устройствам других (формируется общее поле внешней памяти и общий доступ к устройствам ввода-вывода).

Все вышесказанное иллюстрируется схемой взаимодействия компьютеров в двухмашинной ВС, представленной на рис. 1.

Рис. 1. Схема взаимодействия компьютеров в двухмашинной ВС

Ввиду сложности организации информационного взаимодействия на 1-м и 2-м уровнях в большинстве многомашинных ВС используется 3-й уровень, хотя и динамические характеристики (в первую очередь быстродействие), и показатели надежности таких систем существенно ниже.

Многопроцессорные системы (МПС) содержат несколько процессоров, информационно взаимодействующих между собой либо на уровне регистров процессорной памяти, либо на уровне ОП. Этот тип взаимодействия используется в большинстве случаев, ибо организуется значительно проще и сводится к созданию общего поля оперативной памяти для всех процессоров. Общий доступ к внешней памяти и устройствам ввода-вывода обеспечивается обычно через каналы ОП. Важным является и то, что многопроцессорная вычислительная система работает под управлением единой ОС, общей для всех процессоров. Это существенно улучшает динамические характеристики ВС, но требует наличия специальной, весьма сложной ОС.

Однако МПС имеют и существенные недостатки. Они, в первую очередь, связаны с использованием ресурсов общей оперативной памяти. При большом количестве объединяемых процессоров возможно возникновение конфликтных ситуаций, в которых несколько процессоров обращаются с операциями типа ”чтение” и ”запись” к одним и тем же ячейкам памяти. Помимо процессоров к ОП подключаются все процессоры ввода-вывода, средства измерения времени и т.д. Поэтому вторым серьезным недостатком МПС является проблема коммутации и доступа абонентов к ОП. Процедуры взаимодействия очень сильно усложняют структуру ОС МПС. Опыт построения подобных систем показал, что они эффективны при небольшом числе объединяемых процессоров (от 2 до 10). Схема взаимодействия процессоров в ВС показана на схеме рис. 2. Типичным примером массовых многомашинных ВС могут служить компьютерные сети, примером многопроцессорных ВС — суперкомпьютеры.

Рис. 2. Схема взаимодействия процессоров в ВС

Неоднородная ВС включает в свой состав различные типы компьютеров или процессоров. При построении системы приходится учитывать их различные технические и функциональные характеристики, что существенно усложняет создание и обслуживание неоднородных систем.

В децентрализованных системах функции управления распределены между ее элементами. Каждая ЭВМ (процессор) системы сохраняет известную автономию, а необходимое взаимодействие между элементами устанавливается по специальным наборам сигналов. С развитием ВС и, в частности, сетей ЭВМ, интерес к децентрализованным системам постоянно растет.

В системах со смешанным управлением совмещаются процедуры централизованного и децентрализованного управления. Перераспределение функций осуществляется в ходе вычислительного процесса, исходя из сложившейся ситуации.

По принципу закрепления вычислительных функций за отдельными ЭВМ (процессорами) различают системы с жестким и плавающим закреплением функций. В зависимости от типа ВС следует решать задачи статического или динамического размещения программных модулей и массивов данных, обеспечивая необходимую гибкость системы и надежность ее функционирования.

На рис. 3 представлена принципиальная схема классификации вычислительных систем.

Рис. 3. Принципиальная схема классификации вычислительных систем.

Классификация по степени территориальной разобщённости

По степени территориальной разобщенности, вычислительные системы делятся на системы совмещенного (сосредоточенного) и распределенного (разобщенного) типов. Обычно такое деление касается только многомашинных вычислительных систем. Многопроцессорные системы относятся к системам совмещенного типа.

Учитывая успехи микроэлектроники, это совмещение может быть очень глубоким. В настоящее время появилась возможность иметь в одном кристалле несколько параллельно работающих процессоров. ЭВМ с многоядерным процессором является многопроцессорной вычислительной системой совмещённого типа.

Классификация по режиму работы

По режиму работы различают вычислительные системы, работающие в оперативном временном режиме и в неоперативном временном режиме. Оперативный – это режим реального времени. Он характеризуется жесткими ограничениями на время решения задач в системе и предполагает высокую степень автоматизации процедур ввода-вывода и обработки данных.

Как правило, вычислительные системы используют для управления технологическим процессом в реальном масштабе времени, когда обработка информации должна производиться за время, не превышающее время течения самого процесса. От вычислительных систем в этом случае требуется много: большое быстродействие и высокий уровень надежности, чрезвычайная оперативность и "живучесть", т.е. способность выполнять возлагаемые на нее функции даже при выходе из строя каких-то элементов. Современные ЭВМ еще не обеспечивают выполнение этих требований, поэтому приходится создавать специализированные вычислительные системы.

В декабре 2008 года в России создан вычислительная система (супер-ЭВМ), способная выполнять 27 триллионов операций в секунду, что в 10.000 раз больше, чем у предшествующей супер-ЭВМ. Вычислительная система установлена в Гидрометцентре России. Она включает в себя 30.000 микропроцессоров. Потребляемая мощность равна 500 КВт. Система охлаждения используется антифриз (который течет по трубам охлаждения).

Типы архитектур вычислительных систем, их особенности, преимущества и недостатки Типы архитектур вычислительных систем

Архитектура вычислительной системы – это совокупность характеристик и параметров, определяющих функционально-логическую и структурную организацию системы.

Поскольку вычислительные системы появились как параллельные системы, то и рассмотрим классификацию архитектур под этой точкой зрения. Классификация архитектур была предложена М. Флинном в начале 60-х годов. Это классификация по взаимодействию потоков команд и потоков данных.

В основу классификации архитектур вычислительных систем заложено два возможных вида параллелизма: независимость потоков команд, существующих в системе, и независимость (не связанность) данных, обрабатываемых в каждом потоке. Классификация до настоящего времени не потеряла своего значения. Однако, как и любая классификация, она носит временный и условный характер. Своим долголетием она обязана тому, что оказалась справедливой для вычислительных систем, в которых ЭВМ и процессоры реализуют программные последовательные методы вычислений. С появлением систем, ориентированных на потоки данных и использование ассоциативной обработки, данная классификация может быть некорректной.

В основу классификации вычислительных систем с параллельной обработкой положено понятие потока. Под потоком понимается последовательность команд или данных, обрабатываемая процессором.

Классификация основана на рассмотрении числа потоков команд и потоков данных и описывает четыре базовых архитектуры.

В связи с кризисом классической структуры ЭВМ дальнейшее поступательное развитие вычислительной техники напрямую связано с переходом к параллельным вычислениям, с идеями построения многопроцессорных систем и сетей, объединяющих большое количество отдельных процессоров и (или) ЭВМ. Здесь появляются огромные возможности совершенствования средств вычислительной техники. Но следует отметить, что при несомненных практических достижениях в области параллельных вычислений, до настоящего времени отсутствует их единая теоретическая база.

Термин вычислительная система появился в начале - середине 60-х гг. при появлении ЭВМ III поколения. Это время знаменовалось переходом на новую элементную базу - интегральные схемы. Следствием этого явилось появление новых технических решений: разделение процессов обработки информации и ее ввода-вывода, множественный доступ и коллективное использование вычислительных ресурсов в пространстве и во времени. Появились сложные режимы работы ЭВМ - многопользовательская и многопрограммная обработка.

Под вычислительной системой (ВС) понимают совокупность взаимосвязанных и взаимодействующих процессоров или ЭВМ, периферийного оборудования и программного обеспечения, предназначенную для сбора, хранения, обработки и распределения информации.

Отличительной особенностью ВС по отношению к ЭВМ является наличие в них нескольких вычислителей, реализующих параллельную обработку. Создание ВС преследует следующие основные цели: повышение производительности системы за счет ускорения процессов обработки данных, повышение надежности и достоверности вычислений, предоставление пользователям дополнительных сервисных услуг и т.д.

Параллелизм в вычислениях в значительной степени усложняет управление вычислительным процессом, использование технических и программных ресурсов. Эти функции выполняет операционная система ВС.

Читайте также: