Gm206 300 a1 какая видеокарта

Таблица графических процессоров GeForce 8 и последующих.

Условное обозначение графического процессора

Идентификатор шины PCI графического процессора

Частота вычислительных блоков в режиме 3D , МГц

Частота работы шейдерных процессоров (SPU) при использовании 3D функций

Частота блоков рендеринга в режиме 3D , МГц

Частота работы блоков рендеринга (TMU и ROP) при использовании 3D функций

Частота GPU в режиме Boost , МГц

Тактовая частота GPU в режиме ускорения

Технологический процесс , нм

Технологическая норма изготовления графического процессора

Число шейдерных процессоров (SPU)

Число блоков наложения текстур (TMU)

Число блоков растеризации (ROP)

Максимально накладываемых текстур за проход

Вычислительная производительность , гигафлопс

Вычислительная производительность , гигафлопс

Cкорость заполнения сцены , млн. пикселей/с

Fillrate, без текстурирования

Cкорость заполнения сцены , млн. текселей/с

Fillrate, с текстурированием

Поддерживаемые типы видеопамяти

Максимальный объем видеопамяти , МБ

Максимальный поддерживаемый графическим процессором объем видеопамяти

Ширина шины видеопамяти , бит

Частота шины видеопамяти , МГц

Опорная частота шины данных, ½ от DDR

Полоса пропускания шины видеопамяти , ГБ/с

Поддерживаемые шины компьютера

Поддерживаемые графическим процессором режимы NVIDIA SLI

Универсальные шейдеры , версия

Максимальная поддерживаемая версия универсальных шейдеров

Поддерживаемые алгоритмы тесселяции

Кубические карты среды (CEM)

Наложение рельефа (Bump mapping)

Поддерживаемые алгоритмы наложения рельефа

Объемные (3D) текстуры

Поддерживаемые алгоритмы сжатия текстур

Paletted (indexed) текстуры

Поддержка текстур с индексированной цветовой палитрой

Текстуры произвольного размера

Поддержка текстур с размерами, не кратными 2

Максимальный размер текстур , пикселей

Форматы буфера глубины

Поддерживаемые форматы буфера глубины

Поддержка технологии NVIDIA UltraShadow

Поддержка технологии синхронизации кадра с дисплеем

Степени анизотропной фильтрации (AF)

Степени полноэкранного сглаживания (FSAA)

Максимальная глубина цвета на канал , бит

Внутренняя для 3D рендеринга

Расширенный динамический диапазон цветопередачи (HDR) , бит

Параллельный рендеринг (MRT)

Рендеринг одновременно в № буферов

Поддерживаемые уровни декодирования видео

Поддерживаемые уровни декодирования видео

Поддерживаемые уровни декодирования видео

Поддерживаемые уровни декодирования видео

Декодирование MPEG-4 Part 2

Поддерживаемые уровни декодирования видео

Декодирование AVC MVC

Ускорение декодирования для Blu-Ray 3D

Аппаратное декодирование HEVC

Поддержка декодирования двух видеопотоков одновременно

Максимальное разрешение MPEG1/MPEG2 , пикселей

Макимальное разрешение, при котором поддерживается аппаратное ускорение декодирования MPEG1/MPEG2

Максимальное разрешение H.264

Макимальное разрешение, при котором поддерживается аппаратное ускорение декодирования H.264

Related News

- Mar 1st 2022 NVIDIA DLSS Source Code Leaked (83)

- Jan 17th 2022 NVIDIA's Custom RTX 3090 Ti Graphics Cards Reach $4,000 Pricing in Europe (111)

- Mar 26th 2022 NVIDIA GeForce RTX 4090/4080 to Feature up to 24 GB of GDDR6X Memory and 600 Watt Board Power (107)

- Dec 2nd 2021 NVIDIA GeForce RTX 2060 12GB Has CUDA Core Count Rivaling RTX 2060 SUPER (99)

- Mar 23rd 2022 NVIDIA H100 is a Compute Monster with 80 Billion Transistors, New Compute Units and HBM3 Memory (29)

- Mar 2nd 2022 NVIDIA "Ada Lovelace" Streaming Multiprocessor Counts Surface (40)

- Apr 27th 2022 NVIDIA Allegedly Testing a 900 Watt TGP Ada Lovelace AD102 GPU (102)

- Mar 2nd 2022 NVIDIA Data-breach: Hackers Demand GeForce Drivers be Made Open-Source (42)

- Jan 29th 2022 NVIDIA "Hopper" Might Have Huge 1000 mm² Die, Monolithic Design (60)

- Apr 25th 2022 NVIDIA RTX 40-series "Ada" GPUs to Stick to PCI-Express Gen 4 (20)

EVGA GeForce GTX 960 SuperSC ACX 2.0+

Описание на сайте производителя – ссылка.

Своих поклонников порадовала и компания EVGA, выпустив GeForce GTX 960 с обновленной системой охлаждения ACX 2.0+. По словам разработчиков, в нее вошли все самые передовые технологии.

В отличие от видеокарты, рассмотренной выше, EVGA GTX 960 SuperSC ACX 2.0+ не обладает особо интересным дизайном, за исключением двух крупных вентиляторов и общей длины в 257 мм.

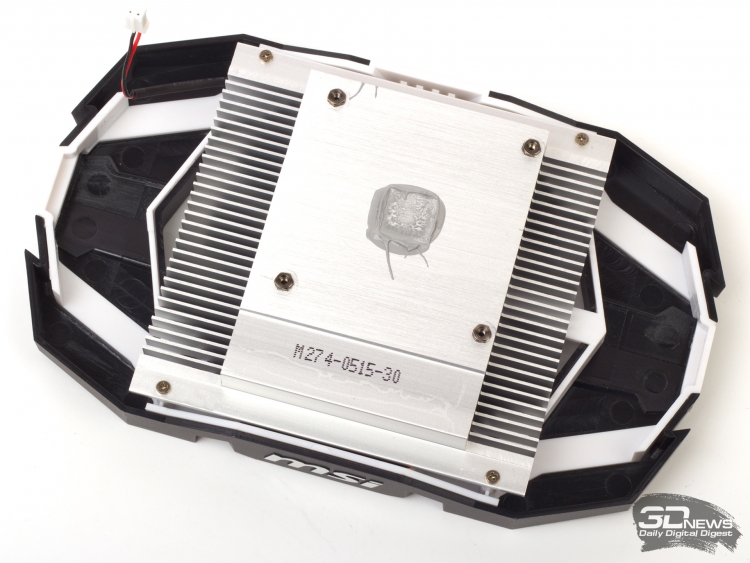

Система охлаждения ACX переживает не первое перерождение, и, честно говоря, я уже сбился со счета, какая передо мной очередная модификация. В одной из презентаций разработчики рассказывали, что откажутся от продольных ребер из-за необходимости загибать тепловые трубки и тратить часть эффективности при теплообмене, что можно видеть на фотографии ниже. Сам кулер состоит из множества алюминиевых никелированных пластин сложной геометрической формы. В основании расположена медная пластина для контакта с графическим процессором и распределения тепла между всеми элементами СО с помощью трех 10 мм тепловых трубок.

За активную часть отвечает пара вертушек хорошо знакомой нам фирмы Power Logic c диаметром крыльчатки 88 мм. Их маркировка PLA09215B12H, заявленные характеристики: напряжение 12 В, потребляемый ток 0.55 А.

Не забыли инженеры и о силовой части видеокарты и микросхемах видеопамяти, накрытых единой металлической пластиной без оребрения.

При обзоре EVGA GeForce GTX 960 SuperSC ACX 2.0+ сходства с другими версиями не обнаружено, это еще один плюс в копилку разработчиков. В модели используется качественная элементная база, например, танталовые конденсаторы и транзисторы типа DirectFET.

Система питания видеокарты построена по усиленной схеме 6+2, где шесть фаз отводится для GPU и две – для памяти, в качестве ШИМ-контроллера применен NCP81174.

Стоит упомянуть и переключатель между двумя версиями BIOS – «Slave» и «Master».

В отличие от варианта референсного дизайна, разработчики сделали шаг вперед и установили один разъем 8pin дополнительного питания, что вырисовывает неплохие перспективы для оверклокинга.

Видеокарта EVGA изначально оснащена высоким заводским разгоном, о чем говорит суффикс SuperSC, что расшифровывается как Super SuperClocked. Базовый разгон по ядру составляет до 1279 МГц против 1127 МГц у эталонной GeForce GTX 960, в режиме Boost – 1342 МГц (при напряжении 1.206 В) против 1178 МГц. Частота памяти осталась без изменений – 1753 МГц.

В 3D благодаря технологии GPU Boost версии 2.0 частота видеоядра увеличивается вплоть до 1455-1468 МГц, что влечет за собой рост производительности.

При этом алгоритм системы охлаждения настроен так, что позволяет графическому процессору прогреться до 60°C, после чего в работу вступают вентиляторы.

В таком режиме температура GPU может достигать 70°C, а вертушки вращаются со скоростью 880 об/мин. Система охлаждения остается достаточно тихой.

С более детальным обзором EVGA GeForce GTX 960 SuperSC ACX 2.0+ можно ознакомиться в материале «Обзор и тестирование видеокарт EVGA GeForce GTX 960 SuperSC ACX 2.0+ и Gigabyte GeForce GTX 960 Mini».

Подпишитесь на наш канал в Яндекс.Дзен или telegram-канал @overclockers_news - это удобные способы следить за новыми материалами на сайте. С картинками, расширенными описаниями и без рекламы.

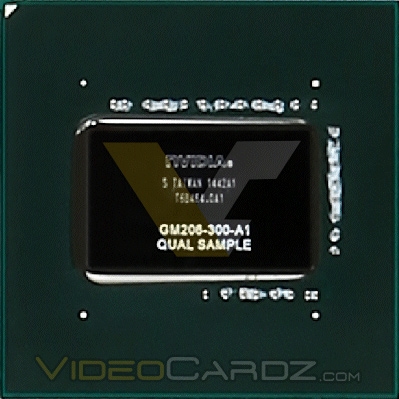

Один из веб-сайтов опубликовал фотографию того, что он называет графическим процессором GM206, который станет сердцем видеокарты NVIDIA GeForce GTX 960. Изображение проливает свет на ряд деталей о данной микросхеме.

Если фото, опубликованное сайтом VideoCardz, является подлинным изображением графического чипа GM206, то это подтверждает две важные вещи. Во-первых, NVIDIA имеет на руках пока не анонсированный GPU с кодовым именем GM206. Во-вторых, новая микросхема меньше, чем GM204, из чего следует, что она нацелена на другой сегмент рынка. Процессор маркирован как “GM206-300-A1”, это может означать, что мы имеем дело с первой коммерческой версией данного GPU.

Новая микросхема GM206 имеет несколько отличную от GM204 упаковку, на которой отсутствует металлический каркас, что указывает на то, что на данный GPU не планируется устанавливать массивную систему охлаждения, которая потенциально может повредить кремниевый чип. Точный размер кристалла определить крайне сложно, но учитывая, что, по слухам, графический процессор имеет шину памяти шириной 128 бит (и соответствующую упаковку уменьшенного размера), чип должен быть достаточно мал. Кроме того, его прямоугольная форма означает, что NVIDIA хочет максимизировать число таких чипов на подложке во время производства.

Полностью новый дизайн графического процессора, уменьшенные размеры, относительно узкая шина памяти, прямоугольная форма и некоторые другие вещи показывают, что NVIDIA намерена максимально оптимизировать стоимость изготовления микросхемы и графических адаптеров на её основе. Это означает, что NVIDIA имеет довольно большие планы на GM206.

Недорогие графические карты с высокой производительностью, как правило, становятся бестселлерами среди игроков. Но хотя и принято говорить о соотношении цены и производительности, следует понимать, что пользователи не станут приобретать графические адаптеры, которые не удовлетворяют определённым критериям производительности, которые растут каждый день.

Низкая цена позволит NVIDIA и её партнёрам представить самые разные решения на основе GM206. Небольшая микросхема и относительно узкая шина памяти дадут возможность снижать цену на GeForce GTX 960 до очень низких значений. Но смогут ли подобные графические адаптеры показывать достойную производительность в играх, а значит, стать популярными в среде игроков? Судя по всему, это покажет только время. По слухам, NVIDIA планирует официально представить GeForce GTX 960 уже 22 января. Ждать осталось недолго.

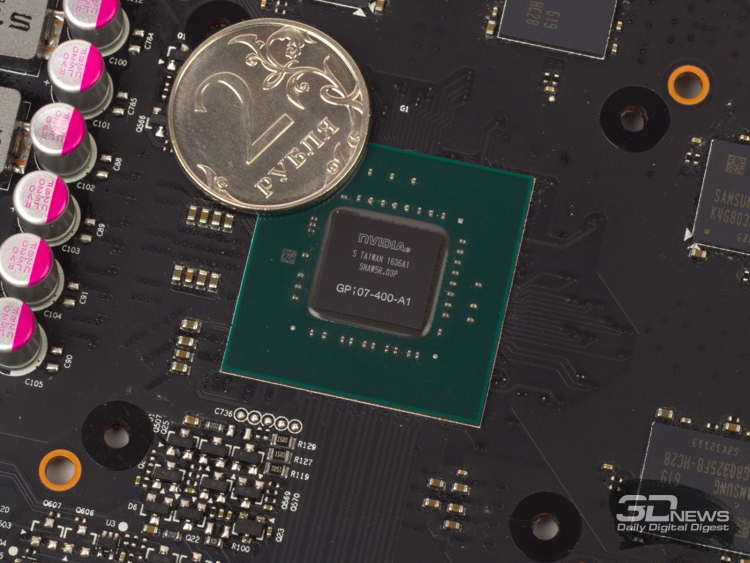

Две бюджетные видеокарты без разъема дополнительного питания приносят архитектуру Pascal в диапазон $109–139. В отличие от старших GPU, графический процессор GP107 производится по нормам 14 нм FinFET на мощностях Samsung — посмотрим, как это повлияло на частоты и энергопотребление в сравнении с ядром AMD Polaris 11, построенным на идентичном техпроцессе

25 октября поступили в продажу две модели видеоускорителей NVIDIA с архитектурой Pascal для бюджетных игровых ПК. Если во времена Maxwell NVIDIA начинала внедрение новой архитектуры с нижнего ценового сегмента (а AMD в Polaris начала с середины), то семейство Pascal разворачивается в классической последовательности — от флагманского продукта к наиболее доступному.

Предыдущие анонсы NVIDIA в этом году позволили составить полное представление о том, что собой представляет архитектура Pascal. На данный момент NVIDIA наслаждается отсутствием конкуренции в высшем ценовом диапазоне, поскольку AMD еще не выпустила равного соперника на базе техпроцесса нового поколения для GeForce GTX 1070/1080. А видеокарта NVIDIA TITAN X позволяет представить, как будет выглядеть новый флагманский продукт тогда, когда NVIDIA сочтет нужным расширить семейство игровых ускорителей в сторону еще большей производительности.

Среднюю категорию по цене и быстродействию в семействе Pascal образуют GeForce GTX 1060 и GTX 1060 3 Гбайт (последний мы рассматриваем отдельно, так как он отличается не только объемом RAM, но и конфигурацией графического ядра). Здесь AMD сумела представить альтернативный выбор в виде ускорителей Radeon RX 470 и RX 480 на чипе Polaris 10, обладающих адекватным соотношением производительности и цены.

Ну а новейшие GeForce GTX 1050 и GTX 1050 Ti представляют собой видеокарты для игровых ПК начального уровня и HTPC (Home Theater PC). На первый взгляд они выглядят скромным дополнением к линейке Pascal, не заслуживающим столь пристального внимания, которое снискали их старшие предшественники. Однако не стоит пренебрегать новинками лишь только потому, что они не имеют ценности в глазах хардкорных геймеров. GTX 1050/1050 Ti — важное явление в своем роде как с практической, так и с теоретической точки зрения.

Младшие видеокарты на базе Pascal заполняют нишу, которая осталась вакантной в линейке GeForce 900, и с технической точки зрения являются наследниками скорее GeForce GTX 750/750 Ti (GPU GM107), нежели GeForce GTX 950. Хотя эти видеокарты формально относятся к одному классу, NVIDIA не выпустила графического процессора на замену GM107 в 900-й линейке, основанной на архитектуре Maxwell второго поколения (чипы GM2xx). Как следствие, GTX 950 на базе частично заблокированного чипа GM206 не соответствует энергоэффективности GTX 750 Ti, что помешало создать столь же компактные видеокарты, лишенные разъема дополнительного питания. Таким образом, GTX 1050/1050 Ti, в отличие от прочих моделей 10-й серии с архитектурной точки зрения представляет собой шаг не в одно, а в полтора поколения. Если же прибавить к возросшей производительности на ватт, которую обеспечил техпроцесс следующего поколения, новые мультимедийные возможности Pascal (аппаратный кодек HEVC, видеоинтерфейсы HDMI 2.0b и DisplayPort 1.3/1.4), то новинки начнут выглядеть весьма перспективно.

Есть и второй аспект, который делает GTX 1050/1050 Ti интригующим объектом исследования. В долгожданном переходе графических процессоров с нормы 28 нм на техпроцесс 14/16 нм мы увидели, как разработчики микросхем, которые в прошлые годы неизменно заказывали производство на фабрике TSMC, пошли разными путями. NVIDIA продолжила пользоваться услугами TSMC для процессоров Pascal по технологии 16 нм FinFET, в то время как AMD переметнулась к GlobalFoundries, лицензировавшей технологию 14 нм FinFET у Samsung.

Теперь настал конец и многолетнему эксклюзивному сотрудничеству NVIDIA c TSMC, ведь в документации на GTX 1050/1050 Ti указано, что чип GP107 выполнен по норме 14 нм FinFET. Как известно, в последний раз NVIDIA прибегла к услугам другого производителя в 2003 году — для производства чипов NV3x из семейства карт GeForce FX. Официально компания не раскрывает имя своего подрядчика, но, согласно сторонним источникам, им стал Samsung. К слову, пусть вас не смущает слово TAIWAN в маркировке GPU (как и полное совпадение формата, в котором кодируется период производства и степпинг чипа). Да, фабрика Samsung с технологией 14 нм FinFET находится в Техасе, США, но, когда NVIDIA выпускала GPU серии NV3x на американской фабрике IBM, чипы были промаркированы как корейские. Видимо, NVIDIA просто собирает GPU в корпуса либо делает с ними что-либо еще на территории Тайваня.

Как бы то ни было, по «энергетическим» характеристикам GP107 может отличаться от своих старших собратьев, выпущенных TSMC. Кроме того, результаты тестирования GTX 1050/1050 Ti приблизят нас к ответу на вопрос, почему новейшие графические процессоры AMD выступили столь бледно в плане частотного потенциала и производительности на ватт. В какой степени разница по этим параметрам между Pascal и Polaris обусловлена особенностями архитектуры, а в какой — производственным фактором? Впрочем, если сделать поправку на то, что две компании могли воплотить техпроцесс 14 нм FinFET по-разному, то проверка GP107 в деле сможет снять подозрения лишь с технологии как таковой, а не с фабрики GlobalFoundries в штате Нью-Йорк, США, которая занимается выпуском соответствующих микросхем, или инженеров Advanced Micro Devices.

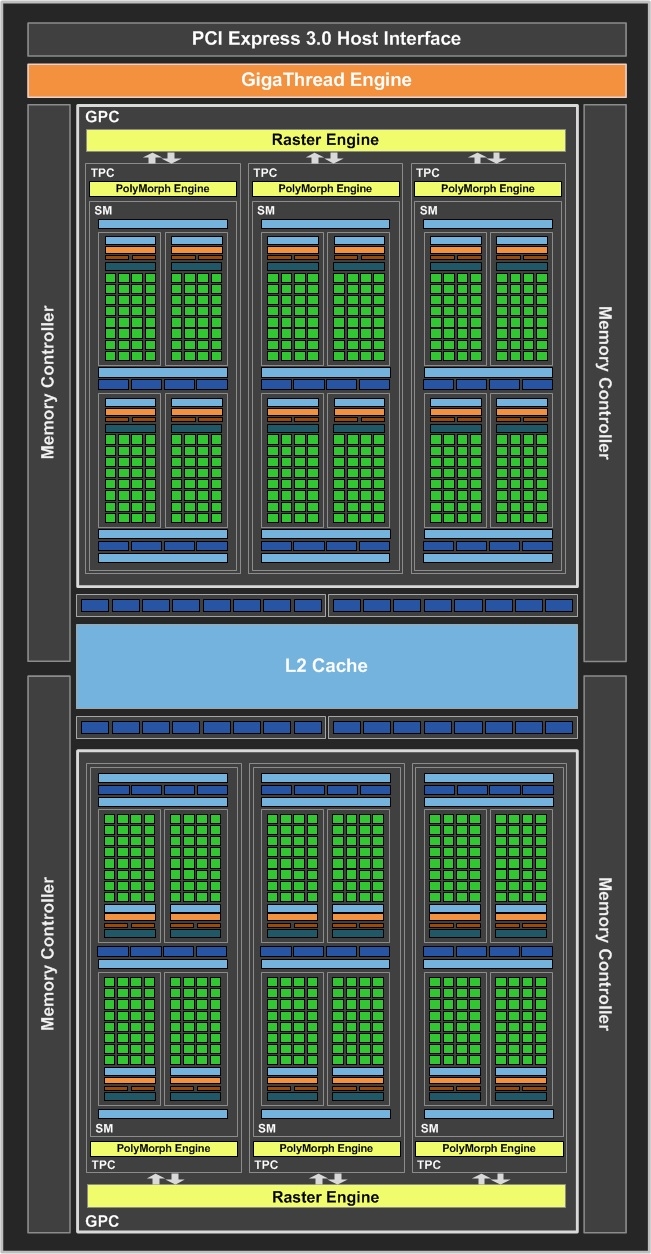

GP107 в полной мере воплощает принципы, заложенные в архитектуре Pascal применительно к GPU игрового класса (в отличие от GP100, имеющего свои особенности). От старших чипов — GP106, GP104, GP102 — он отличается лишь числом вычислительных блоков и объемом кешей различного назначения.

Логическая схема GP107 включает два GPC (Graphics Processing Cluster), каждый из которых состоит из блока Raster Engine, выполняющего первоначальные стадии рендеринга (определение граней полигонов, проекция и отсечение невидимых пикселов) и трех SM (Stream Multiprocessor). Каждый из последних, в свою очередь, содержит геометрический движок PolyMorph Engine, 128 32-битных ядер CUDA, 4 64-битных ядра CUDA, 8 текстурных модулей и секцию кеша L1. Как и другие игровые GPU в семействе Pascal, GP107 отличается от Maxwell увеличенным объемом L1 (с 24 до 48 Кбайт).

Таким образом, в отношении шейдерной и текстурной пропускной способности на мегагерц частоты полнофункциональный GP107 сделал шаг вперед относительно GM107 и соответствует «порезанному» GM206 в составе GeForce GTX 950. В back-end процессора, представленном кешем L2, массивом ROP и четырьмя 32-битными контроллерами памяти, также есть очевидные изменения.

В силу того, что архитектура Pascal обладает прогрессивной компрессией цвета, а контроллеры позволяют работать с памятью на существенно большей частоте, чем в GM107 (7000 вместо 5400 Мбит/с на контакт), разработчикам понадобилось удвоить количество ROP по сравнению с GM107. Одновременно появилась возможность сэкономить транзисторный бюджет на кеш-памяти второго уровня (1 Мбайт против 2 Мбайт в GM107).

Блок-схема NVIDIA GP107

Тем не менее процессор получился весьма крупным для своей категории: число транзисторов в GP107 составляет 3,3 млрд. Разумеется, часть этого объема была израсходована на реализацию многочисленных новых функций, представленных в архитектуре Pascal, поэтому по числу транзисторов GP107 не только существенно «разбух» относительно GM107 (1,87 млрд), но и обходит GM206 (2,94 млрд). Вот краткий список нововведений архитектуры Pascal:

- улучшенная компрессия цвета с соотношениями вплоть до 8:1;

- функция Simultaneous Multi-Projection геометрического движка PolyMorph Engine, позволяющая за один проход создавать вплоть до 16 проекций геометрии сцены (для VR и систем с несколькими дисплеями в конфигурации NVIDIA Surround);

- возможность прерывания (preemption) в процессе исполнения draw call (при рендеринге) и потока команд (при вычислениях), которая вместе с динамическим распределением вычислительных ресурсов GPU обеспечивает полноценную поддержку асинхронных вычислений (Async Compute) — дополнительного источника быстродействия в играх под API DirectX 12 и сниженной латентности в VR;

- аппаратное декодирование и кодирование видео в форматах H.264, H.265 (HEVC) и VP9;

- контроллер дисплея, совместимый с интерфейсами DisplayPort 1.3/1.4 и HDMI 2.b. Поддержка высокого динамического диапазона (HDR);

- шина SLI с повышенной пропускной способностью (соответствующие блоки, вероятнее всего, исключены из GP107 в связи с отсутствием поддержки SLI).

На базе процессора GP107 NVIDIA выпустила две видеокарты, из которых GTX 1050 Ti комплектуется полнофункциональным ядром и 4 Гбайт RAM. В GTX 1050 отключен один из шести SM, а штатный объем видеопамяти составляет 2 Гбайт.

Первое, что бросается в глаза, когда смотришь в спецификации видеокарт, это консервативные тактовые частоты по сравнению с таковыми в моделях GTX 1060 и старше. До момента, когда NVIDIA распространила подробную документацию на GTX 1050/1050 Ti, это вызывало определенное смущение в прессе. Нетрудно придти к преждевременному выводу о том, что смена производственной линии на 14 нм FinFET по технологии Samsung заразила GPU NVIDIA той же болезнью, от которой пострадал Polaris. Однако разработчик утверждает, что ограничивающим фактором стал тепловой пакет, установленный на уровне 75 Вт, для того, чтобы партнеры NVIDIA могли выпустить видеокарты, не требующие дополнительного питания. В эмпирической части обзора мы еще увидим, каких частот в действительности может достигнуть GP107.

Также любопытно, что GTX 1050 обладает повышенными частотами GPU по сравнению с «титановой» версией. По данным NVIDIA, младшая из двух новинок обладает втрое большим быстродействием в играх, чем GeForce GTX 650, и чуть более чем на 50 % превосходит GeForce GTX 750 Ti.

| Производитель | NVIDIA | |||||

| Модель | GeForce GTX 750 Ti | GeForce GTX 950 | GeForce GTX 1050 | GeForce GTX 1050 Ti | GeForce GTX 1060 3GB | GeForce GTX 1060 |

| Графический процессор | ||||||

| Название | GM107 | GM206 | GP107 | GP107 | GP106 | GP106 |

| Микроархитектура | Maxwell | Maxwell 2 | Pascal | Pascal | Pascal | Pascal |

| Техпроцесс, нм | 28 нм | 28 нм | 14 нм FinFET | 14 нм FinFET | 16 нм FinFET | 16 нм FinFET |

| Число транзисторов, млн | 1 870 | 2 940 | 3 300 | 3 300 | 4 400 | 4 400 |

| Тактовая частота, МГц: Base Clock / Boost Clock | 1 020 / 1 085 | 1 024 / 1 188 | 1 354 / 1 455 | 1 290 / 1 392 | 1 506 / 1 708 | 1 506 / 1 708 |

| Число шейдерных ALU | 640 | 768 | 640 | 768 | 1 152 | 1 280 |

| Число блоков наложения текстур | 40 | 48 | 40 | 48 | 72 | 80 |

| Число ROP | 16 | 32 | 32 | 32 | 48 | 48 |

| Оперативная память | ||||||

| Разрядность шины, бит | 128 | 128 | 128 | 128 | 192 | 192 |

| Тип микросхем | GDDR5 SDRAM | GDDR5 SDRAM | GDDR5 SDRAM | GDDR5 SDRAM | GDDR5 SDRAM | GDDR5 SDRAM |

| Тактовая частота, МГц (пропускная способность на контакт, Мбит/с) | 1 350 (5 400) | 1 652,5 (6 610) | 1 750 (7 000) | 1 750 (7 000) | 2 000 (8 000) | 2 000 (8 000) |

| Объем, Мбайт | 1 024 / 2 048 | 2 048 / 4 096 | 2 048 | 4 096 | 3 072 | 6 144 |

| Шина ввода/вывода | PCI Express 3.0 x16 | |||||

| Производительность | ||||||

| Пиковая производительность FP32, GFLOPS (из расчета максимальной указанной частоты) | 1 389 | 1 823 | 1 862 | 2 138 | 3 935 | 4 373 |

| Производительность FP32/FP64 | 1/32 | 1/32 | 1/32 | 1/32 | 1/32 | 1/32 |

| Пропускная способность оперативной памяти, Гбайт/с | 86 | 106 | 112 | 112 | 192 | 192 |

| Вывод изображения | ||||||

| Интерфейсы вывода изображения | DL DVI-D, DisplayPort 1.2, HDMI 2.0 | DL DVI-D, DisplayPort 1.2, HDMI 2.0 | DL DVI-D, DisplayPort 1.3/1.4, HDMI 2.0b | DL DVI-D, DisplayPort 1.3/1.4, HDMI 2.0b | DL DVI-D, DisplayPort 1.3/1.4, HDMI 2.0b | DL DVI-D, DisplayPort 1.3/1.4, HDMI 2.0b |

| TDP, Вт | 60 | 90 | 75 | 75 | 120 | 120 |

| Рекомендованная розничная цена на момент выхода (США, без налога, (Founders Edition/нереференсных видеокарт), $ | 149 | 109 | 109 | 139 | 199 | 249/299 |

| Рекомендованная розничная цена на момент выхода, Россия, ( Founders Edition/нереференсных видеокарт ), руб. | 5 490 | 12 490 | 8 490 | 10 490 | — | 18 990 / — |

Официальные цены на GTX 1050 и GTX 1050 Ti установлены на уровне $109 и $139 соответственно (рынок США, без налога на продажи). Российские — 8 490 руб. и 10 490 руб. соответственно.

Однако рыночная ниша, на которую нацелены новинки, уже освоена конкурирующими продуктами конкурента. AMD парировала выход GeForce GTX 1050/1050 Ti снижением цен на модификации Radeon RX 460 с 2 и 4 Гбайт RAM — c $109/139 до $89/99. Новая российская цена объявлена для младшей версии видеокарты — 7 530 руб.

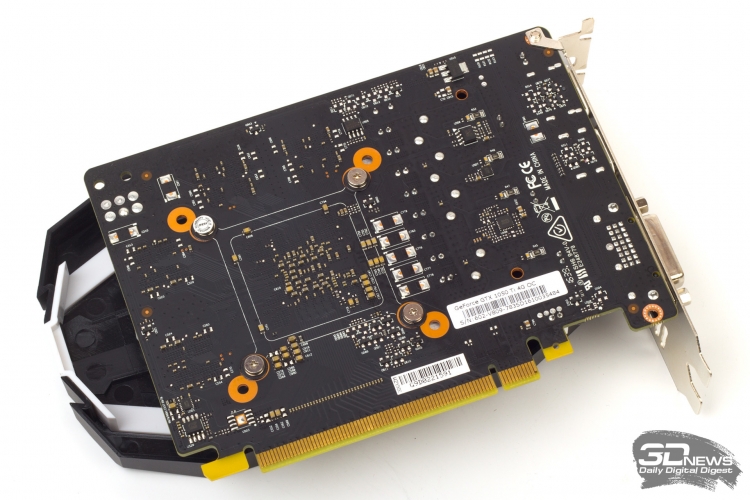

NVIDIA не подготовила референсной версии GeForce GTX 1050/1050 Ti, в отличие от GeForce GTX 750/750 Ti. Вместо этого производители с первого дня продаж начнут продавать видеокарты собственного дизайна. Для тестирования нам предоставили образцы MSI GeForce GTX 1050 2G OC и GeForce GTX 1050 Ti 4G OC — довольно простые реализации новых моделей, обладающие немного повышенными тактовыми частотами GPU: 1 404 / 1 518 МГц и 1341 / 1455 МГц для GTX 1050 и GTX 1050 Ti соответственно. В тестировании тактовые частоты видеокарт MSI были приведены к референсным значениям.

С виду две видеокарты MSI абсолютно одинаковы. На компактной плате установлена система охлаждения простейшей конструкции: монолитный фрезерованный радиатор и единственная крупная крыльчатка.

Более подробно описывать внешний вид устройства и конструкцию системы охлаждения в данном случае не имеет смысла — фотографии говорят за себя.

Единственное, что отличает GeForce GTX 1050 Ti от GTX 1050 в данной серии видеокарт, — это микросхемы RAM вдвое более высокой емкости. По остальным признакам устройства идентичны, включая четырехфазную систему питания: три фазы для GPU и одна — для чипов RAM.

Микросхемы памяти изготовлены Samsung и рассчитаны на эффективную частоту 7 ГГц.

Оглавление

Nvidia GeForce GTX 960

Эталонный вариант видеокарты GeForce GTX 960 в конечном счете так и не был представлен Nvidia, что развязало руки партнерам по выпуску моделей на ее основе: калифорнийский производитель предъявил лишь основные технические характеристики графического ускорителя, от которых стоит отталкиваться. Далее вся инициатива перешла разработчикам.

Теперь мы можем лишь догадываться, как должна была выглядеть эталонная модель GeForce GTX 960, но были шансы, что она унаследовала бы облик GeForce GTX 760, ставшей любимицей публики за хорошее соотношение производительности и цены. А это черный пластиковый кожух с декоративными вставками и размещенный в головной части тангенциальный вентилятор, воздушный поток от которого, пройдя через радиатор, выходит сквозь решетку на задней панели.

Если обратиться к технической спецификации, то компания Nvidia говорит о своей видеокарте в общих чертах, и хотя она не была представлена, но фигурируют даже значения длины и ширины. Стандартные видеовыходы описаны блекло – это HDMI, DisplayPort и DVI-I.

Силовая часть выполнена по схеме 4+1 (GPU, Mem). Система питания ядра реализована на контроллере NCP81174 – это классический выбор для всей линейки графических ускорителей GeForce GTX 9xx. Поскольку он лишен умной шины, то управлять питанием придется через драйвер видеокарты. Номинальное напряжение для всех GeForce GTX 960 установлено равным 1.2 В. Предусмотрен небольшой запас, приблизительно 0.1 В.

реклама

GeForce GTX 960 основана на графическом процессоре Nvidia GM206 (Maxwell 2.x) в модификации GM206-300-A1, произведенном по 28 нм техпроцессу. В его состав входят 8 активных SMX-блоков, 1024 ядра CUDA и 32 блока растеризации. Базовая частота видеоядра составляет 1127 МГц (Boost до 1178 МГц) при напряжении 1.2 В, памяти – 1753 МГц.

Вот и все, что мы хотели рассказать об эталонной модели, которая так и не увидела свет. Пора переходить к версиям оригинального дизайна.

Вступление

Несколько месяцев назад состоялся официальный анонс новинки средне-бюджетного класса. Нам представили последнего на данный момент представителя новой линейки компании Nvidia, основанного на хорошо зарекомендовавшей себя архитектуре Maxwell (28 нм) – GeForce GTX 960.

реклама

Модель относится к графическим ускорителям среднего класса и построена на базе GPU GM206, содержащего 2.9 млрд транзисторов, 1024 ядра CUDA, 64 текстурных блока и 32 блока растеризации, а также пару 64-разрядных контроллеров памяти стандарта GDDR5. Ожидалось, что она будет прямым наследником GeForce GTX 760, однако на практике все оказалось печальнее, нежели предполагалось. Как вы уже знаете, все дело в ряде технических ограничений, реализованных в видеокарте инженерами компании. Это и всего 2 Гбайта видеопамяти, и шина памяти 128 бит. Причем если в первом случае все поправимо, благо можно купить версию с объемом 4 Гбайта, то со вторым придется лишь смириться.

В данном материале мы постараемся рассмотреть все интересные модели GeForce GTX 960, находящиеся в продаже в российской рознице. Как и ранее, обзор моделей разных производителей пойдет в алфавитном порядке, чтобы избежать путаницы.

22 Comments on NVIDIA GM206-300 Silicon Pictured

if it is indead half of the gtx 980, i dont see how it would compete with gtx 680/770, maybe with the 760 at a lower price, still it would be more probable a 1280sp comfiguration, double 750ti, but the die size seem to disagree lol

nunomoreira10if it is indead half of the gtx 980, i dont see how it would compete with gtx 680/770, maybe with the 760 at a lower price, still it would be more probable a 1280sp comfiguration, double 750ti, but the die size seem to disagree lol

The 980 competes with and beats the 780 despite having a smaller bus width and just over half the shaders.

you guys are jumping so quick to pure speculation. Maxwell and Kepler are different architectures, and the lossless compression algorithm for the limited memory bandwidth seems to be working well on 970/980. I'll reserve performance judgement till we see 960 and 960Ti reviews

The way I see it, the GTX980 is almost exactly double the performance of a GTX760. So it sounds pretty reasonable that cutting it exactly in half would yield similar performance to a GTX760 at a much lower power consumption.

I mean, yeah it isn't that exciting to go from a 760 to a 960 and get no performance improvement. But the power difference will be insane. And if nVidia decides to ramp up the clocks, because the power consumption allows it, then it may just be possible to get close to 770 performance.

Of course they could have snuck a few extra shaders in there too. They could be doubling the 750ti, which would give it 1280 shaders.

I'm going to wait for the performance numbers, and just as importantly the price, before calling this a disappointment. And also remember they'll likely have a 960ti that is carved out of GM204.

hojnikbYeah, looks like 960 is gonna be another dissapointment from nvidia as far as midrange is concerned.

The first 28nm GPU was launched in 2011, that's 3 . years ago and counting. The worst node change in history. And they still try to sell you crap.

Keep buying, guys!

It is not crazy who eats it but the one who gives him.!

960 is so bad that they are afraid even to mention the process node in the articles about it.

Sure :rolleyes: Because people blindly follow that company, it's like the sect built by Apple with their iphones which actually have no competitive advantages whatsoever but still people blindly throw multiple times more money. And this have the potential to be dramatically improved with people's own cost optimisations.

Nvidia was unhappy with TSMC 3 years ago.

However, according to the diagram, we have already been in that area of the graph which points to logical move to the new process, back in mid 2014.

Intel is now on 14nm, and GPU makers are still struggling with 28nm products.

What the. is going wrong with these guys? :(

Sony Xperia Sactually have no competitive advantages whatsoever but still people blindly throw multiple times more money

The 970 had a colossal advantage. It outperformed the AMD cards, it used less power, and it cost so much less that AMD had to axe their prices severely. The 970 went on to score stupendously high in almost every review, and became one of the best selling GPUs of the decade.

So it does have competitive advantage in literally every area, and it didn't cost multiple times more money. What's more, it was built on 28nm, which just goes to show GPU makers from all manufacturers can produce far more than they have been on the same node. All you have to do is create an amazing architecture.

NVidia (like every other company) is not here to make people happy. These people run businesses. Businesses exist to make money by making smart decisions and producing good products. They're not out here to do us a favour, they're trying to sell us a product. They did just that, and if AMD were in the same position, they'd do the same.

RCoonThey're not out here to do us a favour, they're trying to sell us a product. They did just that, and if AMD were in the same position, they'd do the same.

The AMD 280s and 290s came out at a fairly decent price. Then, Bitcoin miners snatched them up in a big way, inflating prices for them. We suffered with those artificially high GPU prices for a long time until recently when the 970 and 980 were released.

Does anyone know why we're see silicone that's rectangle not square? That doesn't fly with logic to use the round wafer sufficiently?

RCoonThe 970 had a colossal advantage. It outperformed the AMD cards, it used less power, and it cost so much less that AMD had to axe their prices severely.

It doesn't outperform the R9 290X, especially at Full 4K. It uses a bit of less power, bu I highly doubt it would matter so much in the end.

Both are at virtually identical prices. And yes, prices from AMD needed to be adjusted accordingly but it has always been happening in both directions.

RCoonThe 970 went on to score stupendously high in almost every review, and became one of the best selling GPUs of the decade.

RCoon. it was built on 28nm, which just goes to show GPU makers from all manufacturers can produce far more than they have been on the same node. All you have to do is create an amazing architecture.

Don't speak about 28nm anymore. These amazing architectures need to be on fine next-gen process now.

We are lagging with the progress.

4K should have already been affordable mainstream.

CasecutterDoes anyone know why we're see silicone that's rectangle not square? That doesn't fly with logic to use the round wafer sufficiently?

Sony Xperia SIt doesn't outperform the R9 290X, especially at Full 4K. It uses a bit of less power, bu I highly doubt it would matter so much in the end.

Hahahha, thats the biggest understatment yet.

120W more is quite alot.

Sony Xperia SIt doesn't outperform the R9 290X, especially at Full 4K. It uses a bit of less power, bu I highly doubt it would matter so much in the end.

The GTX970 matches the 290X at Full 4K, but it outperforms the 290X at 1440p and 1080p.

As for the power usage, no one seems to want to accept it but Hawaii consumes more power than Fermi did! And not just a little bit more either, we're talking a good 40-50w more under load. What really amazes me is that Fermi at least outperformed the competition. Hawaii doesn't outperform the competition, yet I don't really see any hate towards Hawaii but everyone hated on Fermi. And the difference between Fermi and Cayman was about 40w, the difference between Hawaii and GM204 is 100w!

Sony Xperia SDon't speak about 28nm anymore. These amazing architectures need to be on fine next-gen process now.

"Matches", according to TPU's own review, is 5% more performance for the R9 290X.

At lower resolutions things go opposite but it is obvious that the R9 290X is still the more capable graphics card.

"Matches", according to TPU's own review, is 5% more performance for the R9 290X.

At lower resolutions things go opposite but it is obvious that the R9 290X is still the more capable graphics card.

"Matches", according to TPU's own review, is 5% more performance for the R9 290X.

At lower resolutions things go opposite but it is obvious that the R9 290X is still the more capable graphics card.

I'm not sure what review you're looking at but:

That looks like a 3% advantage to the 290x to me, which is completely unnoticeable. And even more, only a 1% difference for the 970 in the review. That is as close to matching performance as you are going to get from two very different cards.

Not to mention the GTX970 overclocks better than the 290x does. But yeah, keep holding on to that dream that the 290X is the better card.

Yep, that isn't how you read those graphs. The graph being normalized for the GTX980 G1 makes the other percentage gaps seem higher the further away from 100% you get. That is why you have to use a graph normalized to either the GTX970 or 290X. A 1 or 2% gap becomes a 4 or 5% gap when your 20% away from the reference point of the graph.

that leaked chart was almost spot on, this normal 960gtx 128bit is around 760gtx perf./ sightly faster.

Sony Xperia SThe first 28nm GPU was launched in 2011, that's 3 . years ago and counting. The worst node change in history.

Yeah 28nm is dragging on, but I'm pretty sure it's been refined along the way, so it not exactly like the initial 2011 28nm runs.

xorbeYeah 28nm is dragging on, but I'm pretty sure it's been refined along the way, so it not exactly like the initial 2011 28nm runs.

God's let's hope so. the initial production was so bad TSMC halted production end Jan-February 212 to fix problems. They tried to hush it hiding it in Chinese New Year slowdown. It took a good 3 weeks to get acceptable production restarted.

Несколько месяцев назад состоялся официальный анонс модели средне-бюджетного класса. Нам представили последнего на данный момент представителя новой линейки Nvidia, основанного на хорошо зарекомендовавшей себя архитектуре Maxwell (28 нм) – GeForce GTX 960. В данном материале мы постараемся рассмотреть все интересные версии GeForce GTX 960, находящиеся в продаже в российской рознице.

Вступление, Nvidia GeForce GTX 960, ASUS GeForce GTX 960 Strix, EVGA GeForce GTX 960 SuperSC ACX 2.0+

Модельный ряд GeForce GTX 960

Related News

- Mar 1st 2022 NVIDIA DLSS Source Code Leaked (83)

- Jan 17th 2022 NVIDIA's Custom RTX 3090 Ti Graphics Cards Reach $4,000 Pricing in Europe (111)

- Mar 26th 2022 NVIDIA GeForce RTX 4090/4080 to Feature up to 24 GB of GDDR6X Memory and 600 Watt Board Power (107)

- Dec 2nd 2021 NVIDIA GeForce RTX 2060 12GB Has CUDA Core Count Rivaling RTX 2060 SUPER (99)

- Mar 23rd 2022 NVIDIA H100 is a Compute Monster with 80 Billion Transistors, New Compute Units and HBM3 Memory (29)

- Mar 2nd 2022 NVIDIA "Ada Lovelace" Streaming Multiprocessor Counts Surface (40)

- Apr 27th 2022 NVIDIA Allegedly Testing a 900 Watt TGP Ada Lovelace AD102 GPU (102)

- Mar 2nd 2022 NVIDIA Data-breach: Hackers Demand GeForce Drivers be Made Open-Source (42)

- Jan 29th 2022 NVIDIA "Hopper" Might Have Huge 1000 mm² Die, Monolithic Design (60)

- Apr 25th 2022 NVIDIA RTX 40-series "Ada" GPUs to Stick to PCI-Express Gen 4 (20)

ASUS GeForce GTX 960 Strix

Описание на сайте производителя – ссылка.

Не так давно компания ASUS представила миру линейку видеокарт ASUS Strix, куда вошла и рассматриваемая модель ASUS GeForce GTX 960 Strix. Новинка может похвастать не только качественным исполнением и заводским разгоном, но и оригинальной системой охлаждения с технологией 0dB FAN.

Длина видеокарты составляет 217 мм, она занимает два слота расширения. В качестве охладителя используется радиатор с продольным расположением ребер, насчитывающий 47 алюминиевых пластин, которые пронизаны четырьмя тепловыми трубками: центральными 8 мм и крайними 6 мм. Применяется технология прямого контакта, жаль лишь, что графический процессор соприкасается не со всеми из них.

В системе охлаждения DirectCU II используются два вентилятора с диаметром крыльчатки 74 мм, которые в режиме простоя выключаются. Они изготовлены фирмой FirstD, маркировка FD7010H12S, их характеристики – напряжение 12 В, потребляемый ток 0.35 А.

Что касается силовой части, то она оснащена небольшим радиатором, который отводит тепло через специальную термопрокладку. Вся задняя часть печатной платы закрыта черной металлической пластиной.

Печатная плата ASUS GeForce GTX 960 Strix получила длину всего 170 мм, и очень напоминает нам PCB своих предшественников – ASUS GeForce GTX 670/ GTX 760 DirectCU Mini. Инженеры использовали качественную элементную базу, соответствующую фирменной концепции Super Alloy Power – в нее входят твердотельные конденсаторы, дроссели с ферритовым сердечником, а также тантал-полимерные конденсаторы.

Видеокарта оборудована пятифазным (4+1, GPU/Memory) стабилизатором питания, который управляется ШИМ-контроллером uP1608TK производства компании uPI Semiconductor.

реклама

Как и следовало ожидать, в качестве разъема дополнительного питания используется один шестиконтактный, аналогично эталонной версии.

В номинальном режиме работы частота графического ядра была повышена относительно рекомендаций Nvidia и составляет 1253 МГц. Учитывая поддержку технологии Nvidia GPU Boost 2.0, в турборежиме частота графического процессора в среднем составляет 1392-1405 МГц. Небольшие изменения коснулись и видеопамяти, которая функционирует при 1800 МГц против эталонных 1753 МГц.

В режиме автоматического регулирования скорости вращения лопастей при максимальной нагрузке графического ядра его температура зафиксировалась на отметке 63°C, что является отличным результатом.

Однако скорость вращения крыльчаток вентиляторов при этом составляла 55% от максимальной – около 1750 об/мин. В таком режиме уровень шума был средним: разработчикам стоило бы, пожертвовав парой градусов, сделать модель чуть тише, что было бы хорошим решением.

Читайте также: