Vmware evc mode что это

Enhanced vMotion Compatibility (EVC) is a cluster feature that ensures CPU compatibility between hosts in a cluster, so that you can seamlessly migrate virtual machines within the EVC cluster. You can also enable, disable, or change the EVC mode at the virtual machine level. The per-VM EVC feature facilitates the migration of the virtual machine beyond the cluster and across vCenter Server systems and data centers that have different processors.

Starting with vSphere 7.0 Update 1, you can take advantage of the EVC feature for Virtual Shared Graphics Acceleration (vSGA). vSGA allows multiple virtual machines to share GPUs installed on ESXi hosts and leverage the 3D graphics acceleration capabilities.

The EVC mode of a virtual machine is independent from the EVC mode defined at the cluster level. The cluster-based EVC mode limits the CPU features a host exposes to virtual machines. The per-VM EVC mode determines the set of host CPU features that a virtual machine requires to power on and migrate.

By default, when you power on a newly created virtual machine, it inherits the feature set of its parent EVC cluster or host. However, you can change the EVC mode for each virtual machine separately. You can raise or lower the EVC mode of a virtual machine. Lowering the EVC mode increases the CPU compatibility of the virtual machine. You can also use the API calls to customize the EVC mode further.

Per-VM EVC

EVC is a cluster level setting that supports virtual machine mobility within a cluster. When a virtual machine is moved to another cluster, either on-prem or in a hybrid cloud environment, it loses its EVC configuration depending on the destination environment. Next to that, it is challenging to change a cluster EVC baseline in a environment with live workloads.

By implementing per-VM EVC, the EVC mode becomes an attribute of the virtual machine rather than the specific processor generation it happens to be booted on in the cluster. This helps to be more flexible with EVC enablement and baselines. We introduced the per-VM EVC feature in vSphere 6.7. Virtual machine hardware version 14 or up is required to enable per-VM EVC. When a virtual machine is powered off, you can change the per-VM EVC baseline.

The per-EVC configuration is saved in the vmx file. The vmx file is the file used as a value dictionary that provides the configuration of the virtual machine. If the virtual machine is migrated to another cluster, the per-EVC configuration is moving along with the virtual machine itself. The vmx file will contain featMask.vm.cpuid lines like the following when per-VM EVC is enabled:

featMask.vm.cpuid.Intel = “Val:1”

featMask.vm.cpuid.FAMILY = “Val:6”

featMask.vm.cpuid.MODEL = “Val:0x4f”

featMask.vm.cpuid.STEPPING = “Val:0”

featMask.vm.cpuid.NUMLEVELS = “Val:0xd”

Customer Feedback

A recent Twitter poll showed some interesting results and feedback. It looks like 80% of our customers are in fact using EVC. However, taking a look at our telemetry data, the number of EVC enabled clusters or virtual machines showed a slightly different picture. It’s good to see that a large proportion of our customer-base already benefits from EVC by having it enabled on their clusters and/or virtual machines.

Going through the comments, the general consensus around having EVC enabled by default differs. We see a lot of customers that understand enabling EVC in a brownfield environment is challenging, so they opt to enable EVC from the start. On the other hand, we see customers who didn’t enable EVC because they have a uniform clusters and don’t see the value of having it enabled. It is important to understand that the EVC feature itself has zero overhead on your virtual infrastructure. However, it can save you from the burden of enabling cluster EVC later on when you might want to scale your cluster with additional hosts that might contain newer CPU versions.

Another concern of customer is the impact on performance. What about workloads that cannot use the latest and greatest CPU instructions because of the configured EVC baseline? It does depend on the workloads, but overall we don’t see significant impact on performance because of all new CPU instructions not being exposed to the application running inside the guest OS. We did release a paper that goes into detail on this topic.

To enable EVC on a live environment with virtual machines powered on, you would need to power down the virtual machines in order to change the EVC configuration. This is an area where per-VM EVC helps. Check out this extensive post by Kyle Ruddy on how you can enable per-VM EVC in an automated way.

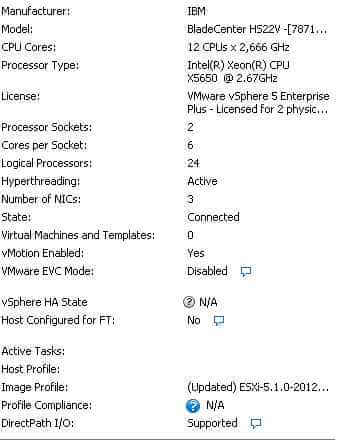

Требования для одновременной миграции vMotion

Вы должны убедиться, что сеть vMotion имеет выделенную полосу пропускания не менее 250 Мбит/с на одновременный сеанс vMotion. Большая пропускная способность позволяет быстрее выполнять миграции. Увеличение пропускной способности в результате применения методов оптимизации WAN не учитывается при ограничении 250 Мбит/с.

Check EVC Configurations

To gain insights of your environment and what EVC configurations are used, scripting can be utilized. The following snippets allows for creating an overview that includes the virtual machines and the virtual machine EVC level next to the cluster EVC level. Because it is tabular data, it is easily exported to a CSV file by adding | ConvertTo-CSV.

Running this PowerCLI command will give you insights on what EVC baselines are configured when EVC is enabled. When the cluster EVC mode is enabled, the script will show the used baseline. It also shows the VM hardware version because per-EVC is only available for VM hardware version 14 and up. If a virtual machine is configured with per-VM EVC, the baseline could differ from the cluster EVC configuration. In the following explamary output you’ll notice the virtual machine ‘DB01’ with a different per-VM EVC baseline as opposed to the cluster setting.

This is a supported situation. However, if a virtual machine per-VM EVC baseline is higher than supported by the ESXi hosts in the cluster, the virtual machines will not power on because there is no host compatible with its per-VM EVC baseline.

You should always verify if your ESXi hosts support the configured EVC baselines to ensure it can accommodate the virtual machines running a per-VM EVC configuration. If you need information about your ESXi hosts and what the maximum supported EVC level is, you could issue the following PowerCLI command: Get-VMHost | Select-Object Name,ProcessorType,MaxEVCMode

The output shows you the ESXi hosts, what CPU packages they are running, and the maximum supported EVC baseline.

As stated before, the key takeaway is that the general recommendation is to have EVC enabled. For a more granular approach and hybrid cloud support, the per-VM EVC feature is a good starting point when implementing EVC in your virtual infrastructure. Having the EVC feature enabled will allow you to benefit from workload mobility to the fullest!

Filter Tags

Application Acceleration vSphere Enhanced vMotion Compatibility (EVC) vMotion Document Technical Overview Intermediate Manage Migrate Optimize

vSphere Enhanced vMotion Compatibility (EVC) ensures that workloads can be live migrated, using vMotion, between ESXi hosts in a cluster that are running different CPU generations. The general recommendation is to have EVC enabled as it will help you in the future where you’ll be scaling your clusters with new hosts that might contain new CPU models. To enable EVC in a brownfield scenario can be challenging. That’s why we stress to have it enabled from the get-go. This blog post will go into details about EVC and the per-VM EVC feature.

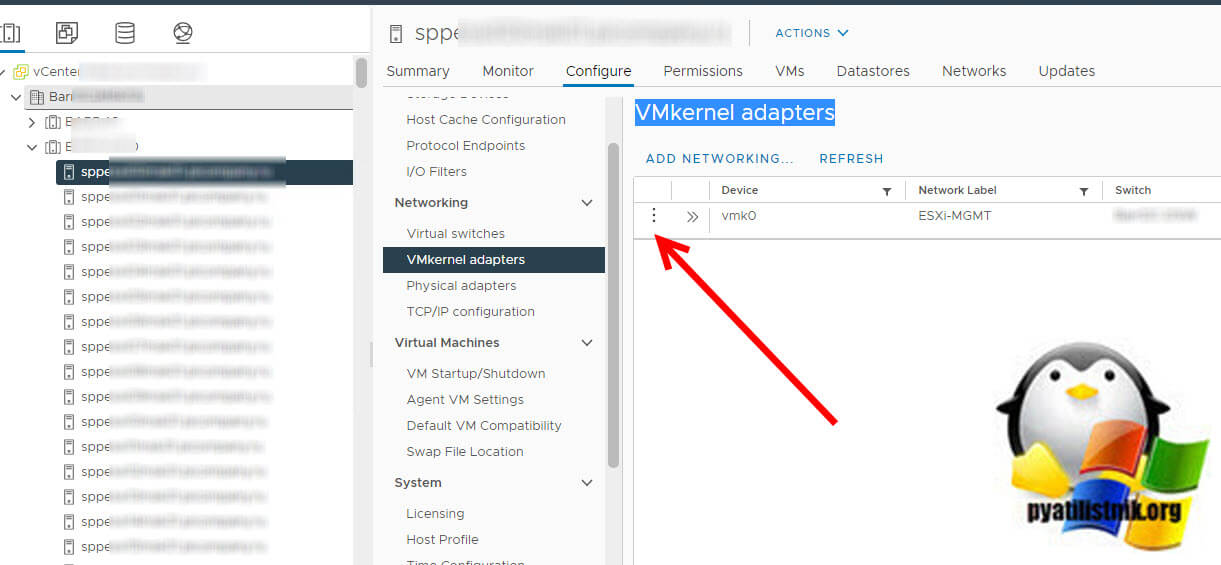

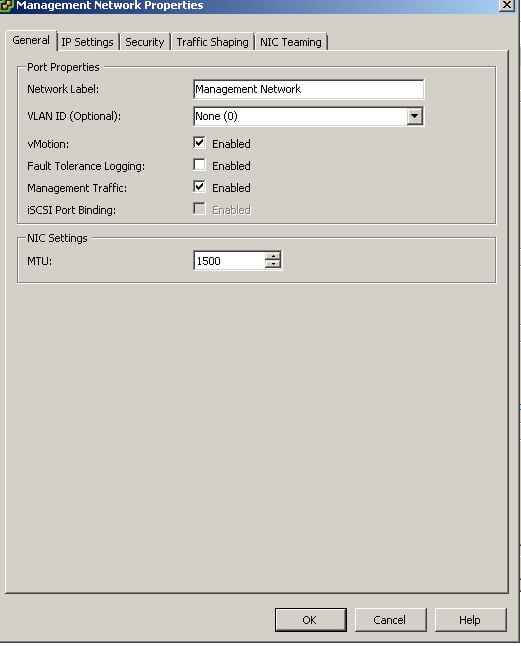

Как включить Vmotion в vCenter 7

Давайте покажу как активируется vMotion на хостах ESXI 7 через vCenter 7. Откройте HTML клиента и выберите нужный вам хост, перейдите на вкладку "Configure - Networking - VMkernel adapters". У вас тут будет список интерфейсов VMkernel. Слева вы можете увидеть совершенно непримечательную кнопку в виде трех вертикальных точек, нажмите ее.

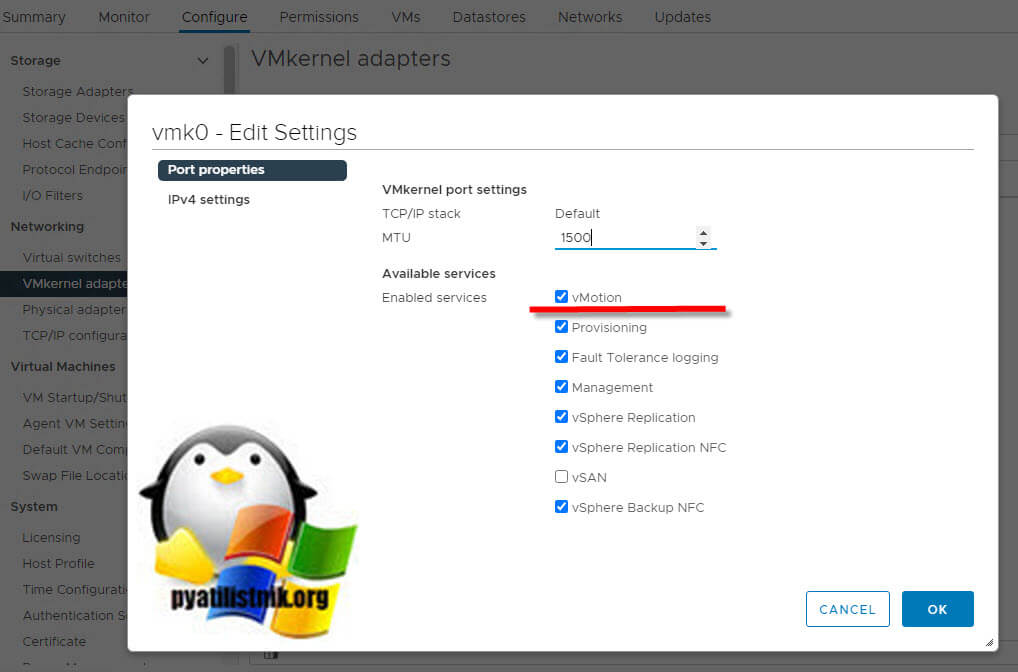

Далее вам остается просто активировать на данном VMkernel нужную галку "vMotion". Так, что если вы до этого не знали, где активируется vMotion в vCenter 7, то вам придется попотеть в поисках данной кнопки.

Если у вас остались вопросы, то пишите их в комментариях, либо можете посмотреть видео, там рассказано, немного подробнее.

Что такое EVC (Enhanced vMotion Compatibility) описано тут первый способ мы рассмотрели ранее. Теперь посмотри второй и третий способ.

В этой статье собрал основные моменты и рецепты по конфигурированию VMotion и связанных с этим процессом побочных действий, а также некоторые рекомендации. В свое время, когда я знакомился с живой миграцией, то столкнулся с некоторыми подводными камнями, пришлось читать много доков и информации. Поехали!

Для VMotion надо:

- vCenter;

- Кластер в vCenter (нужен для активации EVC, если EVC не используется, то можно и без кластера);

- Общее хранилище ВМ (iSCSI, NFS, FC), необходимо чтобы все хосты в кластере с VMotion имели доступ к хранилищу;

- Одинаковая конфигурация виртуальной сети на всех хостах в кластере с VMotion (название порт групп, VLAN ID и т.п.). Не обязательно идентичная должна быть конфигурация сетки. Главное чтобы совпадала конфигурация основных порт групп к которым привязаны мигрируемые ВМ. Ну и порт группы на хостах должны иметь одинаковый доступ к физической сети;

- Процессоры на хостах должны иметь одинаковый набор инструкций и быть близкими друг к другу по функциям и инструкциям. В идеале один тип CPU или же одно поколение и один и тот же набор инструкций (например, линейка Intel Xeon 54XX). Это главное и главный подводный камень. Частота и другие параметры CPU не важны. Также важна основная архитектура и производитель, например, совместить хосты с Intel и AMD CPU не получится;

- Интерфейс VMkernel с включенной опцией VMotion;

Теперь немного о CPU и совместимости.

Если у Вас одна линейка CPU с одинаковыми инструкциями на всех хостах, то проблем нет. А вот если разные, то тут будут проблемы. При миграции ВМ мастер сразу выдаст предупреждение на несовпадение масок CPU. Это можно обойти при условии, что CPU находятся близко друг к другу по функциям и инструкциям.

Способ третий.

Глобальное изменение масок в файле конфигурации vCenter’а. Если Вам не подходит EVC, а нужен VMotion, а также у Вас разные поколения CPU и много ВМ, то это именно то что доктор прописал. Описание способа доступо в этом KB и начинается с пункта Global Masking with ESX Server 2.x and Later .

Теперь о самой настройки VMotion.

Тут все просто. Выше я уже приводил что необходимо для работы VMotion. И так у нас есть общий LUN с ВМ, кластере в vCenter. Также настройки сетевой конфигурации идентичны на всех хостах. На всех хостах идентичные CPU по инструкциям или же включено EVC/подправлены маски. Осталось малое, сконфигурировать VMotion для работы.

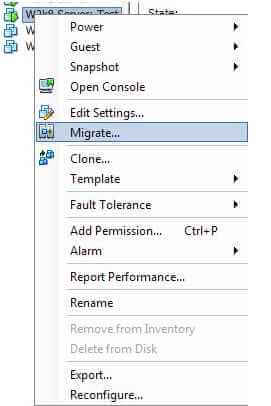

Первое что нужно сделать это добавить порт VMkernel и при конфигурирование поставить галочку VMotion на всех хостах. Подробно описывать сей процесс не буду, так как уже делал заметку о VMkernel ранее. В принципе на этом и все с конфигурацией. Далее еще проще. Выбираем нужную ВМ в клиенте vSphere, клик правой кнопкой мыши — >Migrate.

Как включить EVC (Enhanced vMotion Compatibility) в vMware Esxi 5.x.x-05

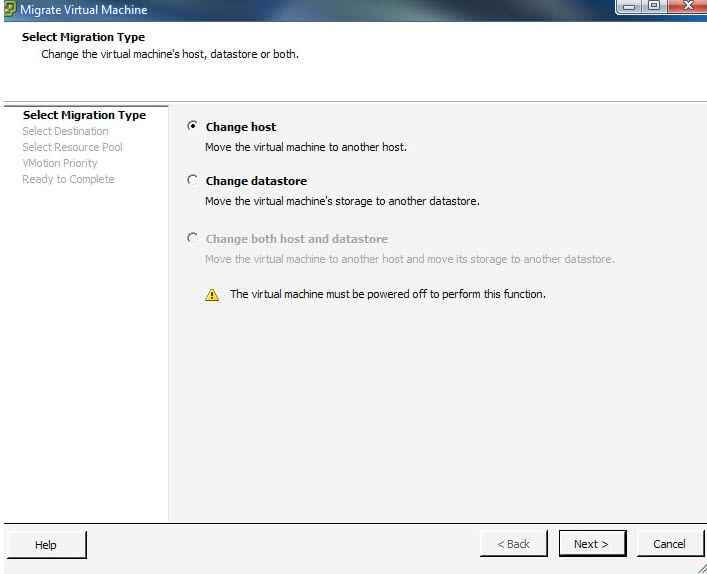

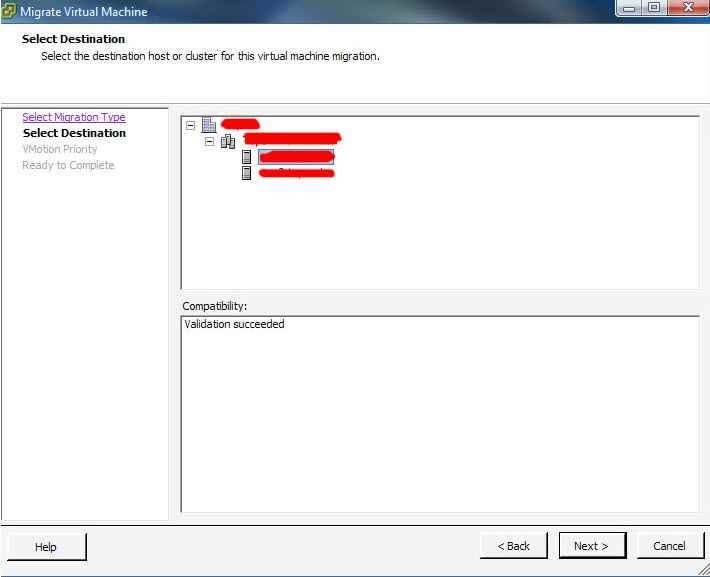

Открывается мастер. Выбираем Change host.

Как включить EVC (Enhanced vMotion Compatibility) в vMware Esxi 5.x.x-06

Далее выбираем нужный хост, на который будет переезжать ВМ. При правильной конфигурации, мастер скажет, что валидация успешна.

Как включить EVC (Enhanced vMotion Compatibility) в vMware Esxi 5.x.x-07

Далее будут еще две странички мастера. Страничка приоритета VMotion, тут можно оставить то что предлагает мастер, и последняя страница со сводной инфой. Все жмем Finish и ждем когда ВМ мигрируется на новый хост.

vSphere Enhanced vMotion Compatibility (EVC) ensures that workloads can be live migrated, using vMotion, between ESXi hosts in a cluster that are running different CPU generations. The general recommendation is to have EVC enabled as it will help you in the future where you’ll be scaling your clusters with new hosts that might contain new CPU models. To enable EVC in a brownfield scenario can be challenging. That’s why we stress to have it enabled from the get-go. This blog post will go into details about EVC and the per-VM EVC feature.

Если вы мигрируете включенную виртуальную машину, то время миграции будет сильно зависеть от размера оперативной памяти выделенной виртуальной машине и интенсивности ее изменения

Per-VM EVC

EVC is a cluster level setting that supports virtual machine mobility within a cluster. When a virtual machine is moved to another cluster, either on-prem or in a hybrid cloud environment, it loses its EVC configuration depending on the destination environment. Next to that, it is challenging to change a cluster EVC baseline in a environment with live workloads.

By implementing per-VM EVC, the EVC mode becomes an attribute of the virtual machine rather than the specific processor generation it happens to be booted on in the cluster. This helps to be more flexible with EVC enablement and baselines. We introduced the per-VM EVC feature in vSphere 6.7. Virtual machine hardware version 14 or up is required to enable per-VM EVC. When a virtual machine is powered off, you can change the per-VM EVC baseline.

The per-EVC configuration is saved in the vmx file. The vmx file is the file used as a value dictionary that provides the configuration of the virtual machine. If the virtual machine is migrated to another cluster, the per-EVC configuration is moving along with the virtual machine itself. The vmx file will contain featMask.vm.cpuid lines like the following when per-VM EVC is enabled:

featMask.vm.cpuid.Intel = “Val:1”

featMask.vm.cpuid.FAMILY = “Val:6”

featMask.vm.cpuid.MODEL = “Val:0x4f”

featMask.vm.cpuid.STEPPING = “Val:0”

featMask.vm.cpuid.NUMLEVELS = “Val:0xd”

Check EVC Configurations

To gain insights of your environment and what EVC configurations are used, scripting can be utilized. The following snippets allows for creating an overview that includes the virtual machines and the virtual machine EVC level next to the cluster EVC level. Because it is tabular data, it is easily exported to a CSV file by adding | ConvertTo-CSV.

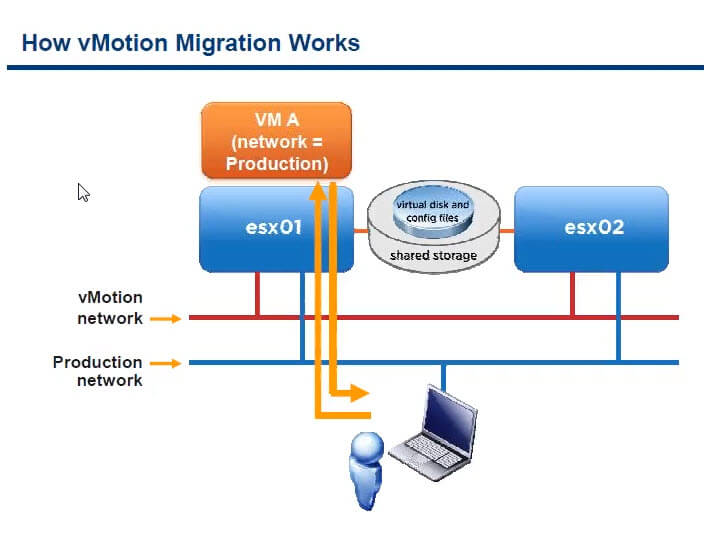

Как работает vmotion vmware

Ниже представлена картинка, как работает технология vmotion при миграции виртуальной машины на хосте Vmware ESXI.

How does EVC work?

The way EVC allows for uniform vMotion compatibility, is by enforcing a CPUID (instruction) baseline for the virtual machines running on the ESXi hosts. That means EVC will allow and expose CPU instruction-sets to the virtual machines depending on the chosen and supported compatibility level. If you would add a newer host to the cluster, containing newer CPU packages, EVC would potentially hide the new CPU instructions to the virtual machines. By doing so, EVC ensures that all virtual machines in the cluster are running on the same CPU instructions allowing for virtual machines to be live migrated (vMotion) between the ESXi hosts.

EVC determines what instructions to mask from the guest OS by using the CPUID. Basically, you can look at the CPUID being an API for the CPU. It allows EVC to learn what instruction-sets the CPU is capable of doing, and what instructions needs to be masked depending on the configured EVC baseline. When EVC is enabled on the cluster, all ESXi hosts in the cluster must adhere to that setting.

This VMware KB article goes into more detail about all current EVC baselines and what CPU instructions they expose to the virtual machines.

VMotion с несколькими сетевыми картами

Вы можете настроить несколько сетевых адаптеров для vMotion, добавив два или более сетевых адаптера к требуемому стандартному или распределенному коммутатору. Дополнительные сведения см. В статье базы знаний KB 2007467 .

Cluster-Level EVC and Per-VM EVC

There are several differences between the way the EVC feature works at the host cluster level and at the virtual machine level.

- Unlike cluster-based EVC, you can change the per-VM EVC mode only when the virtual machine is powered off.

- With cluster-based EVC, when you migrate a virtual machine out of the EVC cluster, a power cycle resets the EVC mode that the virtual machine has. With Per-VM EVC, the EVC mode becomes an attribute of the virtual machine. A power cycle does not affect the compatibility of the virtual machine with different processors.

- When you configure EVC at the virtual machine level, the per-VM EVC mode overrides cluster-based EVC. If you do not configure per-VM EVC, when you power on the virtual machine, it inherits the EVC mode of its parent EVC cluster or host.

- If a virtual machine is in an EVC cluster and the per-VM EVC is also enabled, the EVC mode of the virtual machine cannot exceed the EVC mode of the EVC cluster in which the virtual machine runs. The baseline feature set that you configure for the virtual machine cannot contain more CPU features than the baseline feature set applied to the hosts in the EVC cluster. For example, if you configure a cluster with the Intel "Merom" Generation EVC mode, you should not configure a virtual machine with any other Intel baseline feature set. All other sets contain more CPU features than the Intel "Merom" Generation feature set and as a result of such configuration, the virtual machine fails to power on.

To learn more about EVC clusters, see the vCenter Server and Host Management guide.

Всем привет! Сегодня я познакомлю вас с тем, что такое VMotion в vmware Sphere и как ее включить на вашем хосте виртуализации, ну и расскажу принципы его работы. Уверен, что для многих начинающих инженеров по виртуализации, эта информация будет очень полезной и нужной, для понимания процессов на вашем гипервизоре. Без vMotion сейчас очень сложно представить кластер Vmware.

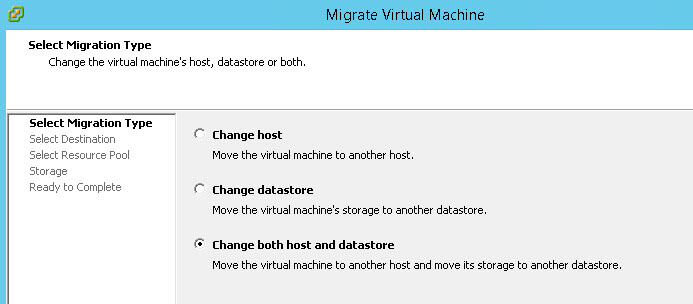

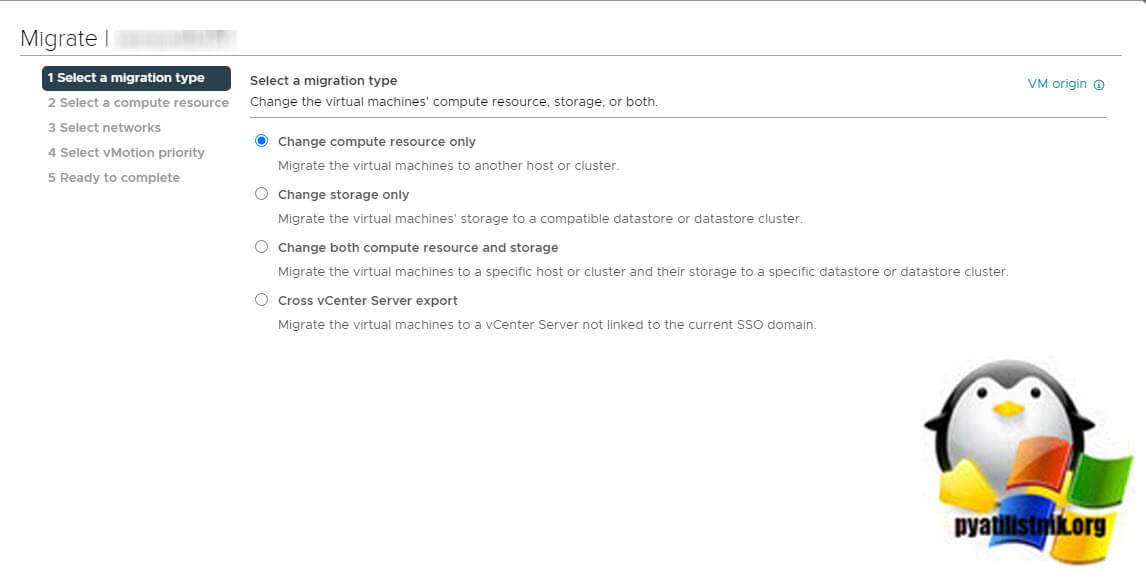

Виды VMware vMotion

У компании VMware есть целый пласт технологий, который относится к vMotion, давайте я покажу из каких видом он состоит и для чего используется:

- Change compute resource only vMotion - Это обычный, классический вид миграции между хостами ESXI, виртуальный сервер переезжает на ресурсы (CPU, RAM) другого сервера ESXI.

- Change storage only - это описанная мной ранее Storage vMotion.

- Change both compute resource and storage vMotion - это перемещение виртуальной машины и ее дисков на другой хост и хранилище

- Cross vCenter Server export - Перенос на другой сервер vCenter

- Shared-Nothing vMotion – миграция ВМ между серверами ESXi по сети без использования общего хранилища (требуется L2 сеть)

- Long Distance vMotion - Многие компании делают отказоустойчивые решения и могут легко растягивать свою инфраструктуру между несколькими цодами. Для таких задач, есть решение "Long Distance vMotion", которое позволяет переносить виртуальные машины между удаленными площадками максимальная задержка Round Trip Time до 150 мс, в том числе в L3-сетях). Идет под капотом vCenter 6 и выше.

- Cross-Cloud Cold и Hot Migration - Это миграция между облачной vCenter и наземной, все как в Active Directory on premise и Azure

- Encrypted vSphere vMotion - Это шифрование виртуальной машины при передаче по сети, фишка vSphere 6.5 и выше

Long-Distance vMotion миграция на большие расстояния

Если у вас есть соответствующая лицензия, примененная к вашей среде, вы можете выполнять надежные миграции между узлами, разделенными большим временем задержки при передаче в оба конца сети. Максимальное поддерживаемое время приема-передачи по сети для миграции vMotion составляет 150 миллисекунд. Это время возврата позволяет вам переносить виртуальные машины в другое географическое место на большее расстояние.

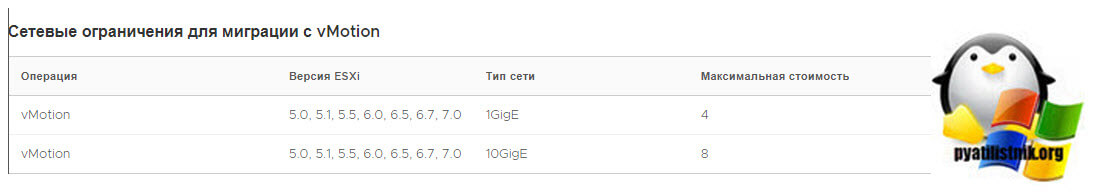

Ограничения на одновременные миграции

vCenter Server устанавливает ограничения на количество одновременных операций миграции и подготовки виртуальных машин, которые могут выполняться на каждом узле, сети и хранилище данных. Каждой операции, такой как миграция с помощью vMotion или клонирование виртуальной машины, назначается стоимость ресурсов. Каждый хост, хранилище данных или сетевой ресурс имеет максимальную стоимость, которую он может поддерживать в любой момент. Любая новая операция миграции или подготовки, которая приводит к превышению максимальной стоимости ресурса, не выполняется немедленно, а ставится в очередь до тех пор, пока другие операции не завершатся и не освободят ресурсы. Для продолжения операции должны быть соблюдены все ограничения для сети, хранилища данных и хоста.

vMotion без общего хранилища, одновременная миграция виртуальных машин на другой хост и хранилище данных, представляет собой комбинацию vMotion и Storage vMotion. Эта миграция наследует затраты на сеть, хост и хранилище данных, связанные с этими операциями. vMotion без общего хранилища эквивалентен Storage vMotion с сетевой стоимостью 1.

Сетевые ограничения применяются только к миграции с vMotion. Сетевые ограничения зависят от версии ESXi и типа сети. Все миграции с vMotion имеют стоимость сетевых ресурсов 1.

Ограничения хранилища данных применяются к миграции с vMotion и Storage vMotion. Миграция с vMotion требует ресурсов, равных 1, по сравнению с хранилищем данных общей виртуальной машины. Миграция с помощью Storage vMotion требует ресурсов 16 по отношению к исходному хранилищу данных и 16 по отношению к целевому хранилищу данных.

- Ограничения на хост применяются к миграции с vMotion, Storage vMotion и другим операциям подготовки, таким как клонирование, развертывание и холодная миграция. Для всех хостов максимальная стоимость хоста равна 8. Например, на хосте ESXi 5.0 вы можете выполнить 2 операции Storage vMotion или 1 операцию Storage vMotion и 4 операции vMotion.

How does EVC work?

The way EVC allows for uniform vMotion compatibility, is by enforcing a CPUID (instruction) baseline for the virtual machines running on the ESXi hosts. That means EVC will allow and expose CPU instruction-sets to the virtual machines depending on the chosen and supported compatibility level. If you would add a newer host to the cluster, containing newer CPU packages, EVC would potentially hide the new CPU instructions to the virtual machines. By doing so, EVC ensures that all virtual machines in the cluster are running on the same CPU instructions allowing for virtual machines to be live migrated (vMotion) between the ESXi hosts.

EVC determines what instructions to mask from the guest OS by using the CPUID. Basically, you can look at the CPUID being an API for the CPU. It allows EVC to learn what instruction-sets the CPU is capable of doing, and what instructions needs to be masked depending on the configured EVC baseline. When EVC is enabled on the cluster, all ESXi hosts in the cluster must adhere to that setting.

This VMware KB article goes into more detail about all current EVC baselines and what CPU instructions they expose to the virtual machines.

Customer Feedback

A recent Twitter poll showed some interesting results and feedback. It looks like 80% of our customers are in fact using EVC. However, taking a look at our telemetry data, the number of EVC enabled clusters or virtual machines showed a slightly different picture. It’s good to see that a large proportion of our customer-base already benefits from EVC by having it enabled on their clusters and/or virtual machines.

Going through the comments, the general consensus around having EVC enabled by default differs. We see a lot of customers that understand enabling EVC in a brownfield environment is challenging, so they opt to enable EVC from the start. On the other hand, we see customers who didn’t enable EVC because they have a uniform clusters and don’t see the value of having it enabled. It is important to understand that the EVC feature itself has zero overhead on your virtual infrastructure. However, it can save you from the burden of enabling cluster EVC later on when you might want to scale your cluster with additional hosts that might contain newer CPU versions.

Another concern of customer is the impact on performance. What about workloads that cannot use the latest and greatest CPU instructions because of the configured EVC baseline? It does depend on the workloads, but overall we don’t see significant impact on performance because of all new CPU instructions not being exposed to the application running inside the guest OS. We did release a paper that goes into detail on this topic.

To enable EVC on a live environment with virtual machines powered on, you would need to power down the virtual machines in order to change the EVC configuration. This is an area where per-VM EVC helps. Check out this extensive post by Kyle Ruddy on how you can enable per-VM EVC in an automated way.

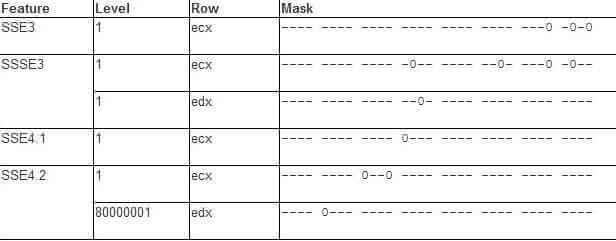

Второй способ.

Первое что нужно сделать это прочитать вот этот KB от VMware .

Если с английским плохо, читаем дальше. Опишу, как изменить маску по примеру приведенному выше для CPU x5400 и x5500.

Из KB для Intel CPU дана вот такая таблица.

Как включить EVC (Enhanced vMotion Compatibility) в vMware Esxi 5.x.x-01

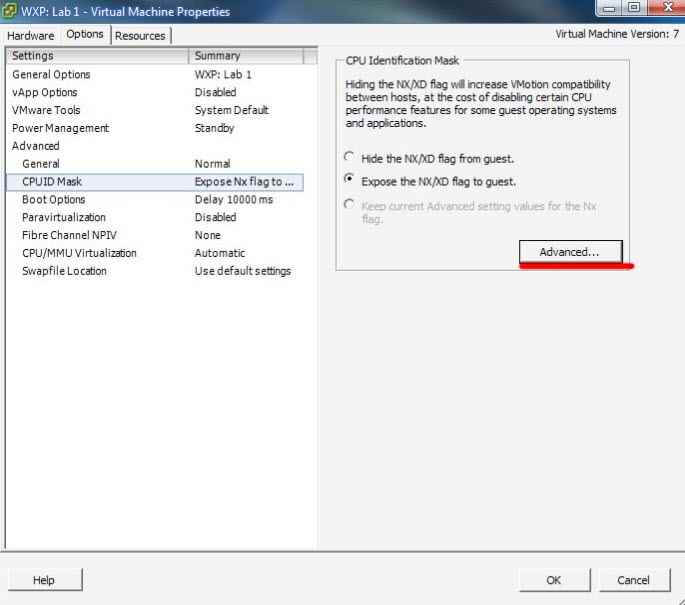

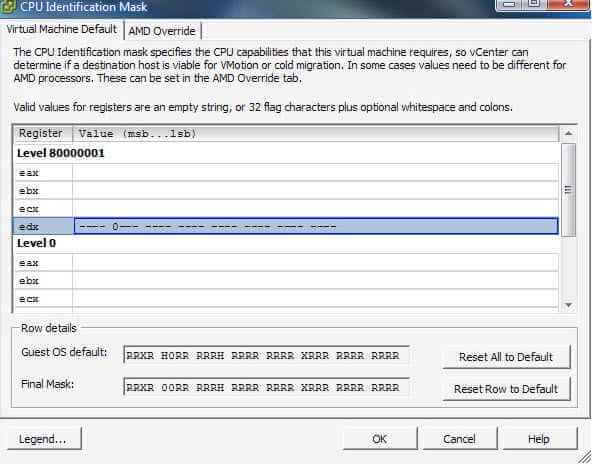

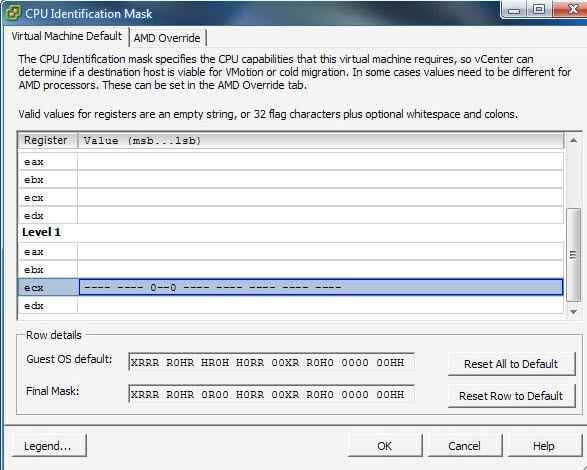

Отличие инструкций между семействами CPU x5400 и x5500 только в поддержки SSE 4.2 у последнего. Поэтому в маске нужно указать, чтобы не использовались данные инструкции. Все очень просто. Выключаем нужную ВМ. Идем в ее свойства. Вкладка Options -> CPUID Mask.

Как включить EVC (Enhanced vMotion Compatibility) в vMware Esxi 5.x.x-02

Как включить EVC (Enhanced vMotion Compatibility) в vMware Esxi 5.x.x-03

Далее находим следующую строчку, и пишем как указано в таблице из KB —- —- 0—0 —- —- —- —- —-

Как включить EVC (Enhanced vMotion Compatibility) в vMware Esxi 5.x.x-04

Все применяем нужные изменения. Ждем когда закончится реконфигурация ВМ и запускаем ее. Все теперь данную ВМ можно спокойно мигрировать. Мастер VMotion не должен выдавать предупреждений по поводу несовпадения масок.

Как включить Vmotion в ESXI 5.5

Открываем сферу, выбираем нужный хост и переходим в Configuration

Выбираем Networking.- нужный свитч и Properties

Как включить VMotion В vmware Sphere 5.x и мигрировать vm-02

Management Network-Edit и ставим заветную галку на против пункта vMotion

Как включить VMotion В vmware Sphere 5.x и мигрировать vm-03

Теперь в суммарной конфигурации видно, что все включено, об этом говорит статус "Vmotion Enable".

Как включить VMotion В vmware Sphere 5.x и мигрировать vm-04

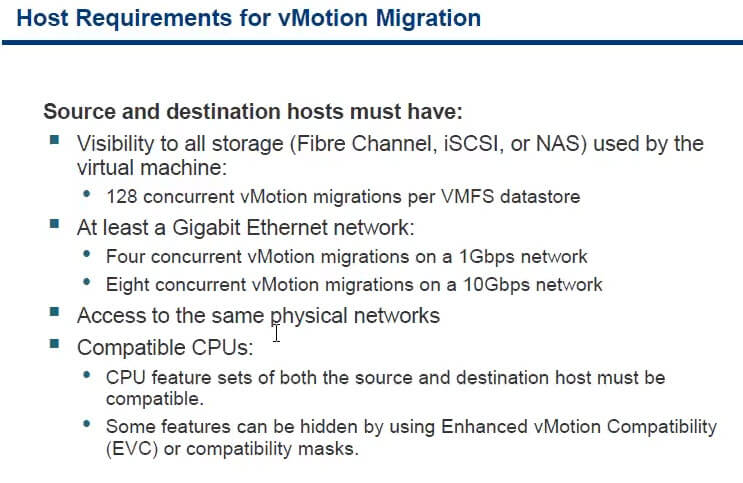

Требования к Vmware vmotion

Ниже представлена картинка с основными требованиями к данной технологии

- Минимум гигабитная сеть, желательно выделенная - Настройте каждый хост как минимум с одним сетевым интерфейсом для трафика vMotion. Чтобы обеспечить безопасную передачу данных, сеть vMotion должна быть безопасной сетью, доступной только доверенным сторонам. Дополнительная пропускная способность значительно улучшает производительность vMotion. Когда вы переносите виртуальную машину с помощью vMotion без использования общего хранилища, содержимое виртуального диска также передается по сети.

- Совместимость процессоров

- Доступ по сети - Для миграции с помощью vMotion требуются правильно настроенные сетевые интерфейсы на исходном и целевом хостах.

- vSphere 6.5 и более поздние версии позволяют шифровать сетевой трафик с помощью vMotion. Зашифрованный vMotion зависит от конфигурации хоста или от совместимости между исходным и целевым хостами.

- На каждом хосте настройте группу портов VMkernel для vMotion

- Чтобы трафик vMotion маршрутизировался через IP-подсети, включите стек vMotion TCP/IP на узле

Читайте также: