Будет ли работать freesync через переходник с hdmi на displayport

Две главные технологии для игровых мониторов и главный спор сезона, уже обгоняющий дисциплину «Да зачем мне 144 Гц?».

Так что выбрать, когда до черной пятницы остался месяц, а до Нового Года – два?

Да что там частота 144 – разгоняйте до 165 герц, а то и берите с 240. «Окей, братиш», а потом, после знакомства с новыми мониторами, условным Asus ROG SWIFT, озадачитесь вопросом о G-Sync и FreeSync.

Почему спор? Да потому что G-Sync – технология от Nvidia, а FreeSync разработала и продает компания AMD. Соответственно, где есть цвета двух этих фирм, зеленый и красный, там случается борьба мнений и вкусов. А настоящий вопрос должен быть один: «Зачем мне вообще дисплей с G-Sync или с FreeSync?».

В первую очередь это победа над тирингом (Screen tearing). Многие наверняка замечали на мониторах артефакты, которые заставляли сомневаться в качестве экрана и проверять его на механические повреждения. Нет, все дело в знакомых всем прыгающим цифрам в углу экрана и фиксированной частоте монитора.

Из-за разницы FPS (частоты смены кадров) в игре и частоты монитора (35 и 60, например), обычный монитор, вроде условного бюджетного монитора DELL за 5 тысяч рублей, отображает сразу два кадра, происходит разрыв, кому-то рвущий глаза, а кому-то греющий душу ламповой ностальгией по детству.

Разрывы компенсируются синхронизацией кадровой частоты игры с частотой развёртки монитора (V-SYNC или вертикальной синхронизацией). Она спасет как от скачков FPS, так и от дрожания изображения.

Но улучшение заметно далеко не в каждом случае: если вдруг FPS видеокарты ниже частоты монитора, то некоторые игры откликаются с задержкой. В таком случае, конечно, поможет галочка напротив буферизации в настройках игры.

Так, закончив максимально короткий экскурс в проблему, вокруг которой эстеты до сих пор разводят срачи, погружаясь в дебри компьютерной безграмотности, вернемся к нашим G-Sync и FreeSync.

Мощности игровых систем растут, а кадры в играх все еще скачут – пора уже давно ввести вынужденную синхронизацию частот монитора и видеокарты. И она уже есть, встречаем адаптивную вертикальную синхронизацию, исправляющую проблему разрыва и дрожания кадров.

И G-Sync, и FreeSync одинаково успешно справляются с задачей. Но мониторы с G-Sync ощутимо дороже, так как для работы технологии требуется специальный чип для вычислений, в цену которого можно купить еще один дешевенький монитор за 10 тысяч рублей. И из двух доступных портов, DisplayPort и HDMI, адаптивную синхронизацию поддерживает только первый.

FreeSync не требует никаких чипов, проводов, дополнительных карт и всего прочего. Мониторы с этой технологией зачастую поддерживают DVI и VGA и в какой-то мере обеспечивают адаптивную синхронизацию через HDMI. Эффект более выгодного предложения – самые дешевые мониторы с FreeSync не поддерживают компенсацию низкой частоты кадров (Low Framerate Compensation), а все вычисления для синхронизации проводят за счет видеокарты.

Следовательно, без LFC через HDMI при падении кадровой частоты ниже 40 при частотном диапазоне монитора от 40 Гц до 100 Гц (разница в 2.5 между минимумом и максимумом) вы снова встретите уже такие родные выпадания, подергивания и разрывы. Хвала Маре, что лишь кадров, а не кишок. Но обидно за впустую потраченные деньги.

Окей, весь цимес в порте, к которому монитор подсоединяется. Значит, выбор монитора зависит от видеокарты! Но мало кто может одновременно купить и то, и другое вместе.

Ах, этот выбор карточки! Так много способов попасть впросак, от этой самой синхронизации до поддержки SLI. Придется выбирать между GeForce 600 и Radeon Rx 200, либо из более свежих решений. Или купить процессор AMD со встроенным графическим ядром – тогда FreeSync заработает с более слабой карточкой от Nvidia.

Кстати, для поклонников соревновательных шутеров данная тема не так важна, им важнее монитор, причем желателен экран с частотой развертки от 120 Гц. А если вы поклонник красивых современных игр с глубоким сюжетом и качественной графикой, то придется задуматься.

Игры все хорошеют, и для них уже появились две новые технологии: G-Sync HDR и FreeSync 2. Обе поддерживают широкий динамический диапазон HDR, технологии уменьшения задержки отображения и пресловутую LFC. Сейчас выходит не так уж много видеоигр с 4K, но эти технологии точно обеспечат плавную игру без разрывов кадров. За огромную цену.

2000 долларов за монитор, который выглядит как мечта тридцатилетнего девственника, большую часть жизни проводящего в Ultime Online и в играх с большим количеством плотных женских ягодиц в узких штанах (мм, гилти плеже). А вы думали, что женские персонажи в играх с режимом от третьего лица сделаны для феминисток? Как бы не так.

Придется в очередной раз отметить, что красный стул не отличается от зеленого практически ничем, кроме ориентированности под видеокарты от определенного производителя. Но многие технофаги будут несогласны. Спросим же у членов команды сайта.

- Какой монитор будет лучше, с G-Sуnс или с FreeSync?

Cмотря какая карта. G-Sync от Nvidia, а Freesync от AMD. В принципе, большинство придерживается зелёных, так что наверно с G-sync.

- Кого выбираешь? Nvidia G-Sync или AMD FreeSync?

Я знаю, что 95% доступен только FreeSync, поскольку наценка за чип Nvidia ощутимо влияет на цену монитора. Соответственно, минимальный комплект от Nvidia раза в 2-3 дороже.

Но давайте еще объективно взглянем на обе технологии. Из-за склонности Nvidia к проприетарному программному обеспечению, мониторы G-Sync подключаются только через DisplayPort и HDMI, причем синхронизация заработает только через DisplayPort. Кроме того, для ее работы нужен чип, который стоит в районе 10 тысяч рублей.

10 тысяч рублей стоит очень средний монитор. Чахлый монитор G-Sync обойдется в 30 тысяч, великолепный в 90 тысяч, а средняя цена за такое роскошество – 50 тысяч рублей. Зато чип позволяет компенсировать размытие на экране, связанное с низким откликом монитора. Ну и про LFC не забываем – очень полезно для мониторов с высоким значением минимальной частоты обновления экрана. Кроме того, большинство таких мониторов можно разогнать.

FreeSync позволяет подключаться через HDMI, кабели для которого дешевле, и использовать синхронизацию. Последнее время технология подбирается и к LFC, и к компенсации низкого отклика монитора. Однако все имеет свою цену.

Мониторы с FreeSync стоят от 5 тысяч до 80 тысяч рублей. Увы, в более дешевых мониторах не будет и половины преимуществ G-Sync, но зато средний монитор стоит дешевле на 10-15 тысяч, чем аналогичный с G-Sync. Но при этом используется ресурс видеокарты. Напомним, что каждая технология поддерживает карточки только собственного производства. Вот и думайте, стоит ли нагружать Rx 200 еще больше.

Две новые технологии, FreeSync 2 HDR и G-Sync HDR, практически не уступают друг другу. Это поддержка HDR-мониторов, ULMB и LFC. Ну и переключения между SDR для работы и HDR для развлечений. Картинка с FreeSync 2 будут как минимум в два раза ярче и красочней, чем у обычных мониторов, но в списке продукции пока всего три монитора.

Говорят, что подключение через DisplayPort 1.3 и 1.4 может привести к зависаниям системы на фазе загрузки ОС, а сама технология требует Windows 10, но такие мелкие разборы совместимости карточек, версий портов и необходимого ПО уже в компетенции техноблогеров, а не игровых журналистов.

А на чьей стороне вы?

Всех ПК-геймеров планеты Земля, да и консольных игроков тоже, объединяет одна проблема — вертикальные разрывы изображения. И вроде бы есть куча технологий которые решают эту проблему:

- V-Sync,

- G-Sync,

- FreeSync

- А ведь еще есть Adaptive Sync

- А в HDMI 2.1 недавно добавили VRR.

Давайте сегодня раз и навсегда разберемся в технологиях адаптивной синхронизации изображения.

Для тех кто не в курсе. А в чём собственно проблема?

Чтобы изображение появилось на экране, должно произойти, как минимум, две вещи:

- графический процессор должен подготовить кадр и передать его на монитор,

- ваш монитор должен показать этот кадр.

Обычные мониторы работают на частоте 60 Гц, то есть способны выводить 60 кадров в секунду, а игровые на 144 Гц и выше.

А вот графический процессор живет в совершенно ином мире. В играх постоянно всё меняется: колышется листва, журчит ручеёк, враги выпрыгивают из-за угла. Каждый кадр отличается по своей сложности, поэтому на их просчет уходит разное количество времени.

Иными словами, у монитора частота кадров постоянная, а у видеокарты переменная.

Вот и выходит, что за один цикл обновления монитора видеокарта может подготовить больше одного кадра или меньше.

Из-за этого мало того что страдает плавность картинки, так еще и появляются артефакты в виде вертикальных разрывов изображения. Кстати, при просмотре фильмов тоже могут появляться такие артефакты, потому что кино снимают в 24 к/с.

V-Sync

Очевидно проблема требовала решения, и еще на заре компьютерных игр оно появилось! Название у этого решения — вертикальная синхронизация или V-Sync. Наверняка вы встречали такую опцию как в настройках видеокарты, так и в играх.

Работает эта штука достаточно топорно. Фактически она просто принуждает видеокарту выводить кадры с частотой кратной частоте обновления экрана. Например, если у вас монитор 60 Гц, то максимальное количество кадров в секунду тоже будет 60, даже если ваша видеокарта способна на большее. И в общем-то часто такое ограничение вполне уместно, если у видеокарты хватает мощи и нет просадок ниже 60 к/с, но если они есть — начинаются проблемы.

При включенной вертикальной синхронизации, следующее кратное значение — это 30 к/с. Поэтому даже если ваш фреймрейт просел фактически всего на пару кадров, вы всё равно увидите падение до 30 к/с. Такой перепад мало того, что большой и очень визуально ощутимый, так ещё и будет происходить с небольшим лагом. Поэтому если стабильного FPS в 60 к/с или 30 не достичь, то включать V-Sync вообще нет никакого смысла.

Справедливости ради, чем выше герцовка монитора, тем больше мы имеем кратных значений, на которых может работать синхронизация. Поэтому на игровых мониторах V-Sync работает куда лучше.

Но история с кратными значениями — не самая главная проблема технологии. Есть другой неочевидный недостаток: вертикальная синхронизация — увеличивает задержку ввода, то есть создаёт Input Lag.

Игра медленнее реагирует на ваши действия, всё происходит с задержками и как-то плывёт в молоке, поэтому прицелиться становится гораздо сложнее. Почему так происходит?

Это интересно, смотрите! Каждый кадр рассчитывается и выводится на экран через один и тот же конвейер. Упростим его до трёх этапов.

- Каждое ваше действие, например щелчок мышки надо как-то интерпретировать и обновить состояние игры. За это отвечает центральный процессор (синяя полоса на картинке ниже). Центральный процессор подготавливает кадры для графического процессора и помещает их в очередь рендеринга графического процессора.

- Затем графический процессор (зелёная полоса) берет эти подготовленные кадры из очереди и рендерит их.

- Только потом эти кадры выводятся на дисплей (серая полосочка на картинке).

Ну и в чём проблема, спросите вы? Дело в том, что ЦП не берется за подготовку следующего кадра, пока предыдущий не будет выведен на экран. Поэтому ограничивая количество выводимых кадров в угоду синхронизации с дисплеем, мы фактически увеличиваем задержки с которыми обновляется состояние игры! И если в каких-то простеньких играх типа пасьянса такие вещи допустимы, то в соревновательных играх вертикальная синхронизация может стать серьёзной помехой.

G-Sync

Но переживать не стоит, так как решение появилось еще в 2013 году. Именно тогда компания NVIDIA представила свою технологию адаптивной синхронизации — G-Sync. В отличие от старой технологии, G-Sync позволяет подстраивать не видеокарту под частоту обновления монитора, а наоборот заставляет монитор менять свою частоту под видеокарту!

Представляете? Так тоже можно было!

В результате мы получаем потрясающе плавную картинку без вертикальных разрывов и задержки ввода! Просто сказка! G-Sync также работает в огромном диапазоне частот. Изначально это было от 30 до 144 Гц, а сейчас уже есть поддержка до 360 Гц и может даже выше, тут скорее всё зависит от монитора.

А если фреймрейт падает ниже 60 Гц G-Sync умеет дублировать пропущенные кадры.

Получаются сплошные плюсы и проблема решена еще в 2013 году? Так почему же мы до сих пор об этом говорим?

Ну как сказать. Во-первых, эта технология закрытая, соответственно, G-Sync работает только с карточками NVIDIA, но это пол беды.

Все волшебные функции G-Sync стали возможны благодаря специальному чипу, который необходимо встроить в монитор. Естественно, эти чипы производит тоже NVIDIA и стоят они недешево. Поэтому мониторы с поддержкой G-sync в среднем стоят на 250-300$ дороже и таких моделей очень мало. То есть получилась классная, и для 2013 года революционная технология, но не универсальная и дорогая.

VESA Adaptive Sync

Поэтому уже спустя год, в 2014, Ассоциация стандартизации Video Electronics Standards Association или VESA представила открытую технологию Adaptive Sync, которая умеет, в принципе, всё то же самое, что и G-Sync, но без дорогостоящих чипов и работает на частотах от 9 до 240 Гц! Неплохо да?

Но для внедрения технологии нужно, чтобы её поддержку внедрили в прошивку и драйвер монитора, драйвер видеокарты, операционной системы и в игры!

А также необходимо наличие DisplayPort версии не ниже 1.2a, так как технология стала частью именно Display Port. Как видите, чтобы технология взлетела, нужно было проделать много работы. И этой работой занималась компания AMD.

AMD FreeSync

В 2015 году AMD внедрили Adaptive Sync в драйвера своих видеокарт и назвали технологию FreeSync. Реализация от AMD быстро получила очень широкое распространение. Добавить поддержку FreeSync в монитор оказалось настолько дешево, что сейчас сложнее найти игровой монитор без этой фичи, чем с ней.

Но AMD не остановились на просто внедрении стандарта от VESA. Также они добавили поддержку HDMI, начиная с версии 1.4. А в 2017 выпустили FreeSync 2, в который добавилась поддержка HDR и компенсацию низкой частоты кадров, как в G-SYNC.

Кстати, чуть позже, FreeSync 2 переименовали в более элитное FreeSync Premium Pro, а обычный FreeSync для мониторов с частотой 120 Гц и выше стали называть FreeSync Premium. Хотя такие маркетинговые финты я не одобряю, но в остальном сплошной респект AMD за популяризацию стандарта.

Кстати, NVIDIA также в 2017 году добавила поддержку HDR и назвала это всё G-Sync Ultimate.

И вроде бы всё классно, в команде у красных и у зеленых есть по своей шикарной технологии. Но что делать, если у тебя видеокарта от NVIDIA, ты хочешь нормальную поддержку G-Sync, но покупать дорогущий монитор с этой технологией совсем не хочется? Или наоборот — не покупать же Radeon только потому что у тебя монитор с FreeSync?

До недавнего времени выбора не было никакого. Хочешь подешевле и побольше выбор мониторов - покупай Radeon. В другом случае, придется раскошелиться.

G-Sync Compatible

Но в 2019 году NVIDIA пошли навстречу покупателям и добавили поддержку стандарта VESA Adaptive Sync в драйвера для своих видеокарт серии RTX, а также для карточки GTX 1080. А значит теперь можно легко насладиться лучшим из двух миров: взять себе карточку от NVIDIA и монитор с FreeSync по вкусу. Вот только есть проблема. Если на FreeSync мониторе не написано G-Sync Compatible — значит он не был протестирован NVIDIA на совместимость и никаких гарантий, что всё будет работать нормально, вам никто не даёт. А NVIDIA тестирует далеко не все, и далеко не самые доступные модели.

Поэтому инициативу по тестированию в свои руки взяло интернет-сообщество. Они составили табличку с огромным списком протестированных пользователями мониторов.

С мониторами, кажется, разобрались. Но как быть, если хочется поиграть на большом экране телевизора через консоль или ПК. Будет ли работать адаптивная синхронизация? Спешу вас порадовать — будет! При условии что ваш ТВ оснащен портом HDMI версии 2.1, в который добавили технологию переменной частоты обновления VRR - Variable Refresh Rate.

Причём всё будет работать и с видеокартами от NVIDIA и с Radeon. Всё потому, что VRR — это та же самая технология VESA Adaptive Sync, но теперь она стала ещё и частью стандарта HDMI 2.1. Именно таким образом адаптивная синхронизация реализована в консолях нового поколения. А также, вы удивитесь, в Xbox One S и One X. Да, в коробки текущего поколения от Microsoft VRR завезли даже раньше, чем HDMI 2.1.

Итоги

Что, в итоге спустя 6 лет после своего появления, технология Adaptive Sync стала фактически отраслевым стандартом. Захватив видеокарты от AMD и NVIDIA, телевизоры и даже интегрированная графика от Intel в 11-м поколении процессоров теперь поддерживает эту технологию. А это значит, что в светлом будущем мы будем жить без единого разрыва, по крайней мере, вертикального!

USB-C предлагает новые потрясающие возможности, включая подключение внешних мониторов по USB-порту. Распространены недорогие конвертеры USB-C на DisplayPort и HDMI. Также часто встречаются хабы USB-C с поддержкой внешних мониторов, однако попытки разобраться в их возможностях и ограничениях могут сильно вас запутать. Некоторые из них совместимы с Mac, некоторые – нет. Некоторым нужны драйвера. Очень сильно разнится поддержка разрешений и частоты обновления. Некоторые рекламируются как «не предназначенные для игр». Делаются упоминания об альтернативных режимах, дуальных режимах, и прочем. Цены разнятся от $20 до $300+, причем функции у тех и других очень похожи. Что вообще происходит?

Это инструкция по передаче видео высокого разрешения по USB-C, которую я хотел бы в своё время иметь. Если вы хотите подключить монитор высокого разрешения к своему компьютеру, имеющему выход USB-C, читайте далее.

Компромиссы по пропускной способности: всё дело в полосах

USB-C коннектор с 24 контактами является ключом к пониманию.

У коннекторов USB-C есть четыре дифференциальных разных пары, или «полосы», для передачи данных на высокой скорости. Есть и пятая пара, D+ и D-, передающая данные в старом стиле USB 2.0.

Посмотрим, что происходит при добавлении в эту кучу DisplayPort:

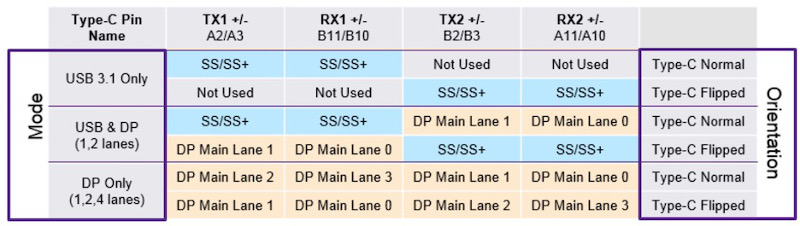

USB 3.1 Gen 2 использует только две из четырёх полос, как показано в двух верхних строках таблицы. Две остальные пропадают зря (их будет использовать USB 3.2). Две этих полосы можно переделать на поддержку родного сигнала DisplayPort, используя то, что называют DisplayPort Alternate Mode – это показано в средних строках. В данном случае коннектор USB-C работает как коннектор DisplayPort другой формы и дополнительными проводами для данных USB. Быстродействие USB 3.1 не теряет. Для компьютера и внешнего монитора это выглядит ровно как обычное соединение DisplayPort.

Две полосы DisplayPort обеспечивают достаточную пропускную способность для одного внешнего монитора разрешения до 4К и 30 Гц. Для фильмов сойдёт, но работать с десктопами Windows или MacOS на 30 Гц жестоко. Для поддержки частоты обновления в 60 Гц нужно уменьшить разрешение до 2К.

Если вам нужно 4К 60 Гц, 5К или несколько внешних мониторов, придётся использовать DisplayPort Alternate Mode со всеми четырьмя полосами для передачи данных DisplayPort, как показано в нижних строках таблицы. Для компьютера и внешнего монитора это всё ещё выглядит как обычное соединение DisplayPort. Однако для данных USB 3.1 полос уже не остаётся. Остаётся только старая пара D+/D-, обеспечивающая медленные данные USB 2.0. Это значит, что никакой USB-C хаб, использующий эту технологию для передачи видео 4К 60 Гц не может иметь портов USB 3.1.

Также можно поддерживать внешние мониторы с DisplayPort, не используя выделенных полос для DisplayPort Alternate Mode, и для этого есть два разных подхода. Если в порту USB-C компьютера есть поддержка Thunderbolt 3, тогда данные DisplayPort можно передавать внутри данных Thunderbolt. Тогда видеоданные становятся ещё одним типом макетов данных, уплотнённых вместе со всем остальным. У Thunderbolt 3 достаточно пропускной способности, чтобы таким способом поддерживать несколько соединений на 4К60, и ещё останется место для данных USB 3.1

Это круто, однако хабы для Thunderbolt 3 дороги, а у компьютера должна быть поддержка Thunderbolt 3, чего у многих нет. Также для компьютера это выглядит по-другому – в отличие от DisplayPort Alternate Mode, тут нет никаких родных сигналов DisplayPort и прямой связи с GPU компьютера. Не знаю, есть ли из-за этого задержка обработки видео, или это всё волшебным образом обрабатывается в чипсете без потери скорости. Полагаю, что потери нет.

4 полосы для видео

Такие хабы поддерживают внешние мониторы вплоть до 4К60, или, возможно, 5К, но данные передают только по USB 2.0. Это не быстро, но достаточно для клавиатуры, мыши и простых принтеров. Должны работать на любом компьютере с поддержкой DisplayPort Alternate Mode, и стоят обычно порядка $30.

Cable Matters 201046 $38 – 1x DisplayPort, power, ethernet, 1x USB2

Cable Matters 201055 $58 – 2x DisplayPort, power, ethernet, 2x USB2

Monoprice 24274 $28 – 1x DisplayPort, power

Cable Matters 201026 $20 – 1x DisplayPort, power

Baseus B07P713FPD $25 – 1x DisplayPort, power

Забудьте про HDMI

В первую очередь необходимо сконцентрироваться на подключении к разъёму DisplayPort и забыть про HDMI. Вы не найдёте хаба USB-C, возможности которого с использованием порта HDMI превосходят возможности с использованием DisplayPort, однако же можно найти хабы, которые через DisplayPort предлагают большее разрешение и частоту обновления. Подозреваю, что большинство хабов с поддержкой HDMI внутри просто работают через DisplayPort и конвертер DisplayPort – HDMI. Всё оттого, что видео через DisplayPort на USB-C с одной и той же частотой и разрешением можно передавать более эффективно, чем через HDMI.

Коннекторы DualMode DisplayPort++ способны работать как коннекторы HDMI с простым пассивным адаптером (он преобразует 3,3 В в 5 В). Обычные коннекторы DisplayPort такого не умеют, и требуют активного HDMI-адаптера. Других отличий между двумя этими типами DisplayPort я не знаю.

Так и какие у нас варианты?

Учитывая всё вышесказанной, можно разбить USB-C хабы на четыре категории на основании того, как они работают с видео. Вот примеры из каждой категории.

DisplayLink

Другой способ поддержки внешних мониторов без выделения полос – DisplayLink. Эта технология сжимает видео на стороне хоста, отправляет его по USB 3.1 в виде данных общего назначения, и превращает обратно в видео на другом конце при помощи особого чипа типа DL-6950. Это похоже на доступ к экрану рабочего компьютера из дома по системе удалённого рабочего стола, только всё это происходит на одном вашем же рабочем столе.

DisplayLink хорошо подходит для запихивания видео высокого разрешения в низкоскоростное соединение типа USB, или поддержки нескольких внешних мониторов без использования Thunderbolt. Однако при наличии альтернатив лучше избегать DisplayLink. Вот его недостатки:

- Требуется драйвер на стороне хоста. Доступность и совместимость драйверов для Mac/Linux практически нулевая. Поэтому некоторые хабы USB-C идут с пометкой о несовместимости с Mac.

- Драйвер может замедлить работу компьютера. Он реализует поддержку виртуальной видеокарты, на лету сжимающей данные, что нагружает проц.

- При большой занятости компьютера или изобилии трафика по USB на видео будут появляться артефакты. Пикселизация, задержки, выпадение кадров и другие проблемы. Поэтому некоторые USB-C хабы идут с пометкой «не для игр».

2 полосы для видео

Такие хабы поддерживают внешние мониторы вплоть до 4К30, и данные по USB 3.1. Многие из них рекламируются, как «4К», без указания частоты обновления. Должны работать на любом компьютере с поддержкой DisplayPort Alternate Mode, и стоят обычно порядка $30-$150.

1. Если я подключу монитор к видюхе по Displayport'у, то у меня появится возможность использовать Freesync.

А как насчет Freesync Premium? Будет ли именно он работать, или я останусь с обычным фрисинком?

Как я понял, он отличается тем, что он подгоняет герцовку монитора к текущим фпс на экране. То есть у тебя 50 фпс - 50 гц будет, 55 стало фпс - герцовка поднялась до 55 и так далее. А обычный фрисинк этого не делает.

2. Тут вопрос возможно тупой, но все же: как я понимаю фрисинк в первую очередь устраняет разрывы. Дело в том, что разрывы меня не беспокоят особо, я их почти не встречаю в играх, либо это я так думаю что не встречаю.

А встречаю я то, что у меня не во всех ААА держит не то чтобы 144 фпс, а хотя бы 120. В новой батле вообще 75-90.

И когда происходит дроп кадров на 20-40 фпс (ну просадка например на пару секунд), то это ощущается пиздец как. Поможет ли фрисинк с этим? Уберет ли он это ощутимое чувство просадки фпс, ощущение что игра залагала, хотя у меня фпс то 80+ остается даже после просадки?

Просто просадка с 120 до 80 не должна же по идее ощущаться, а на деле она охуеть как ощущается.

Поизучав в интернете инфу, нашел только 2 лагеря - первый говорят, что раз попробовав Freesync, назад пути нет. А вторые считают ее бесполезной технологией.

Freesync только для карточек амуде

У меня монитор с Freesync Premium Pro.

Видеокарта Nvidia 1070 Ti.

Монитор подключен кабелем Display Port.

В драйвере Nvidia подключение отображается как G-Sync с VRR (в настройках видео Windows 10 тоже следует включить VRR).

Тиринга нет, в случае просадки фпс ниже порога - частота кадров монитора удваивается, вставляется дополнительный кадр.

Все работает плавно, не вижу смысла отказываться от данной технологии.

Если она есть - надо включать, глаза спасибо скажут.

Спасибо, я уже заказал DP 1.3

жду

Премиум особо от обычного фрисинка не отличается. Просто там есть механизм компенсации кадров, когда частота падает ниже рабочей монитора. К примеру, моник у тебя работает в диапазоне 45-144 Гц, фпс просел до 30, монитор начинает удваивать кадры, по итогу у тебя вместо 30 стало 60 гц.

Да, помогает

У тебя, грубо говоря, нет очереди кадров. Кадр готов - он сразу выводится

А так, при 80фпс на 120герц панели монитору приходится ждать нового "окна", чтобы вывести картинку

От этого получается так, что ты ощущаешь лаги

Freesync Premium - это когда минимум 120 герц и есть компенсация кадров (то есть при очень низком фпс - он дублируется и просадок все равно нет), обычный фрисинк также помогает

На 144 гц бесполезная. Она поможет убрать тирринг, а просадки с 120 до 80 так же будут ощущаться. Если у тебя 144 гц моник, выруби и забудь.

Я и не врубал, у меня по HDMI подключено, но думал прикупить DP если вдруг технология чудо сотворит

У меня g-sync, но вроде, ничем не отличаются. Моник 240гц. Сначала я радовался, что можно теперь играть в ААА проекты без разрывов и плавающей мышки(верт. синх.), но по итогу. все меньше крутых проектов выходит, а в тех, что выходят, уже и верт. синх. не так "плавает", поэтому смысла в этой технологии примерно 0.

Приятный "бонус", но переплаты НЕ стоит.

FreeSync Premium это ближе к VRR. Устраняет видимые тормоза при падении FPS.

Вот и я об этом, но заработает ли Premium на карточке Nvidia?

Чтобы у тебя картинка плавная была тебе нужен апгрейд компа, а не монитора. Freesync общается с видеокартой и цепляет с неё сколько кадров в секунду она выдаёт и подстраивает герцовку монитора под частоту кадров - ВСЁ, оно не делат картинку хоть как-то плавнее или ещё что-то. Freesync убирает tethering (разрывы картинки) и ничего больше. Просто задачу вертикальной синхронизации, которая раньше обычно вешалась на видеокарту теперь можно повесить на монитор освободив сколько то процентов нагрузки с видеокарты. Ни для чего другого это технология не была предназначена.

Про кабели: ты ХОЧЕШЬ использовать DisplayPort без всяких НО или чего-то ещё, тупо потому, что он лучше. Не забивай себе HDMI на мониторе, потом туда можно будет какую-нибудь консоль подоткнуть и свитчиться между компом и консолькой. Сейчас на большинстве моников либо есть динамики и/или прямой вывод ауидо, поэтому это делает такой сетап ещё удобнее в разы.

Не мучай себе голову и читай матчасть, или на крайняк нормальный обзор монитора смотри перед покупкой.

Она делает картинку плавнее, когда фпс совпадает с герцовкой. При статичной частоте обновления моника малейшее отклонение фпс от этой частоты вызывает дерганную картинку. На мониторе с фрисинком частота подстраивается под фпс и картинка остается плавной в определенном диапазоне фпс.

У меня вроде как в монике есть фрисинк - а включить немогу - всевремя скритий.. непонтяно. наверно версии не совпадают или ещё что то.

должен быть подключен через Display port и видеокарта минимум серии GTX 10xx, короче в интернете есть вся инфа, если у тебя всё подходит то и всё работать должно.

FreeSync и Gsync - именно что про устранение разрывов. Устранять ощущение просадок оно не будет.

1. Да, появится.

2. Нет, не уберет.

про устранение разрывов это банально vsync, эти штуки как раз должны картинку немного плавнее делать, учитывая что герцовка монитора динамически подстраивается под фпс

Как я понял, он отличается тем, что он подгоняет герцовку монитора к текущим фпс на экране. То есть у тебя 50 фпс - 50 гц будет, 55 стало фпс - герцовка поднялась до 55 и так далее. А обычный фрисинк этого не делает.

Именно это же и делает обычный фрисинк. Не?

Поможет ли фрисинк с этим?

Ну вот у меня моник с обычным фрисинком, в том же ведьмаке, например, фпс может скакать от 90 до 130. Я эти просадки вообще вообще не чувствую. Но не знаю, замешан ли в этом фрисинк, или просто 144 герц панель. Или вообще хз почему.

Это продолжение,серий моих гайдов, "Для тех кому неймется)

С моей статьей, по разгону герцовки экрана ноутбука,вы можете ознакомиться ТУТ

(она уже устарела и вряд-ли работает,как-то руки не доходили её обновить)

ВОТ более актуальная версия от другого типа.

Около года назад,пересел с ноута на ПК,моник у меня самый обычный 60гц,сначала я погнал его до 78гц,но спустя какое-то время,

мне удалось взять 95гц,это уже его максимум. И сегодня мне удалось активировать на моём мониторе - FreeSync.

Все тесты в FreeSync DEMO (софт для проверки FreeSync) и играх - проходит на ура,чувствуется активация технологии в целом.

И так приступим:

1 Разгон монитора (если необходимо)

Качаем утилиту CRU,распаковываем в папку,в ней будет 4 файла.

Запускаем файл CRU от имени администратора

в главном окне,в самом верху,должен определиться ваш монитор и в скобках отмечен как активный (Active)

В графе Timing (режим матрицы),выбираем один из вариантов,которые я отметил цифрами,можете перепробывать все режимы,на режимах 1 и 2,

мне удалось взять 78гц,это стандартные режимы для большинства матриц,а вот 95гц я взял уже на режиме 3

(правда в этом режиме,есть небольшое мыльцо шрифтов в Windows)

но оно почти незаметно,нужно прям приглядываться,для меня герцовка важнее,тут уже на ваш выбор.

После выбора нужного режима,прописываем нужную герцовку и жмём ОК,как показанно на рисунке ниже.

В окне Detailed resolutions рядом с вашим родным разрешением,появится еще одно,созданное вами с указанной герцовкой.

Жмём ОК в нижней части окна программы,после запускаем файл restart64 (для х64) или restart (для х86) версии Windows.

Экран моргнёт пару раз,если будет писать о неподдерживаемом разрешении или просто чёрный экран,нажмите F8

после идем в доп настройки дисплея в Windows,и выбираем появившеюся герцовку,если сама не применилась.

Не буду расписывать все аспекты работы с CRU,кому нужно,найдут гайды в сети.

После того как найдете для себя предел герцовки вашего монитора,можно приступать к следующему шагу.

2 Активация FreeSync.

Открываем CRU,идём в нижнее окно Extension blocks,на активной строке,как показано на рисунке ниже,

жмём Edit..

Выставляем значения как на рисунке и жмём ОК

В окне Data blocks жмём Add.. и добавляем из списка параметр FreeSync range,жмём ОК

прописываем в нём диапазон герцовки.

Рекомендую от 40 до значения герцовки вашего монитора с учётом разгона минус 1 гц,

т.е при герцовке моего монитора в 95гц,я выставил диапазон от 40-94

Если выставить выше или ровно по герцовке,то при запуске игр,у вас периодически,будет тухнуть монитор.

Жмём ОК во всех окнах и после закрытия CRU,снова запускаем файл Restart х64 (для х64) или restart (для х86) версии Windows.

После перезагрузки драйвера видеокарты (это и есть несколько морганий)

идём в Adrenaline (у кого карта Radeon ),во вкладке настроек дисплея,активируем параметр FreeSync (может называться VRR)

Для карт Nvidia ,идём в панель управления Nvidia > Управление параметрами 3D > Глобальные параметры и находим пункт "Технология монитора"

и выбираем G-Sync Compatible

После всех манипуляций,можете проверить достигнутый результат,в программе FreeSync DEMO,ссылка на неё есть в начале гайда.

Либо можно проверить ТУТ.

Если вы наломаете дров,то вернуться к исходным значениям,можно файлом reset-all из папки CRU.

Всем МИР

Читайте также: