Зависит ли частота монитора от видеокарты

В предыдущих статьях мы рассказали вам о десятках популярных мифов, касающихся процессоров, видеокарт, материнских плат, ОЗУ, блоков питания и SSD. Теперь же поговорим о не менее важном компоненте ПК — о мониторе, про которые за последние пару десятков лет придумали не меньшее число мифов. Как всегда текстовая версия под видео 👇🏻

Миф №1. Мониторы с частотой 100-240 Гц не нужны, так как человеческий глаз не видит больше 24 кадров в секунду.

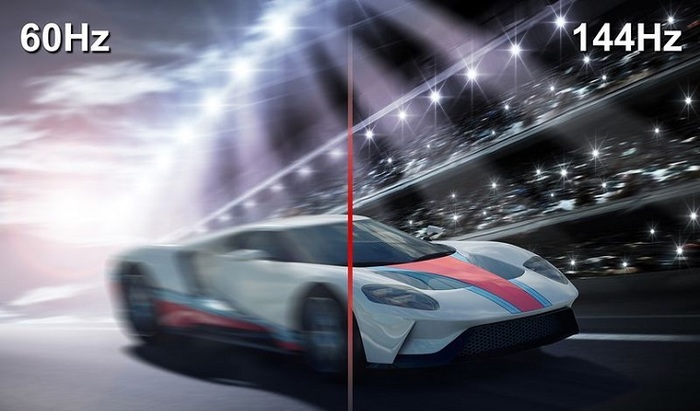

Миф стар как мир, и идет он от того, что для плавности видео хватает 24 кадров в секунду. Но не стоит забывать, что в видео каждый кадр немного смазан, то есть содержит часть предыдущего, поэтому переход между кадрами заметен меньше. В играх же каждый кадр четкий — это легко понять, делая скриншоты, поэтому тут 24 кадров не хватит, картинка будет казаться дерганной. А вот какая нужна частота обновления монитора (и соответственно FPS), чтобы ощутить плавность, индивидуально для каждого человека, но в общем и целом большинство людей без проблем заметят на глаз разницу между 60 и 144 Гц.

Миф №2. IPS-мониторы лучше, чем MVA/TN.

Очень часто на различных форумах или от консультантов в магазинах электроники можно услышать, что самые лучшие мониторы идут на IPS-матрицах. На деле это не совсем так — все зависит от того, какой смысл вкладывать в слово «лучшие». Так, у IPS действительно лучшие углы обзора и сочнее цвета, но при этом у TN ниже задержка, поэтому киберспортивные 120-240 Гц матрицы с задержкой в 1-3 мс в подавляющем большинстве случаев базируются именно на этой старой технологии. Матрицы MVA по задержкам и цветам находятся между IPS и TN, но зато их плюс — очень высокая контрастность (2000-3000:1), что позволяет добиться глубокого черного цвета. Так что в итоге не нужно всегда брать IPS — лучше проанализировать свой спектр задач и выбрать под него оптимальный тип матрицы.

Миф №3. Мониторы портят глаза.

Поэтому наилучшим выходом будет поиск в интернете цветового профиля для своей матрицы: да, матрицы с одинаковой маркировкой все же будут немного различаться по цветам, но в любом случае такой цветовой профиль приблизит картинку к идеальной. Но а если вы готовы раскошелиться — всегда можно заказать калибровку у профессионалов: в таком случае вы получите самую лучшую возможную картинку именно для вашей матрицы.

Миф №5. Монитор должен стоять на расстоянии вытянутой руки.

В огромном количестве руководств для начинающих пользователей ПК пишется, что монитор должен находиться на расстоянии 50-60 см от глаз. Что делать людям со слабой близорукостью, которые не носят очки и у которых картинка на таком расстоянии размывается, там обычно не уточняется.

На деле глаз при работе с монитором должен находиться в состоянии покоя аккомодации — говоря простым языком, он должен без напряжения фокусироваться на изображении естественным образом. Расстояние, на котором проявляется это состояния, зависит от множества факторов, таких как яркость монитора, возраст, освещение, ношение очков и т.д. Так что «грести всех под одну гребенку» тут не стоит, и каждый волен сидеть за монитором так, чтобы его глаза напрягались как можно меньше.

Миф №6. G-Sync работает при любой частоте кадров.

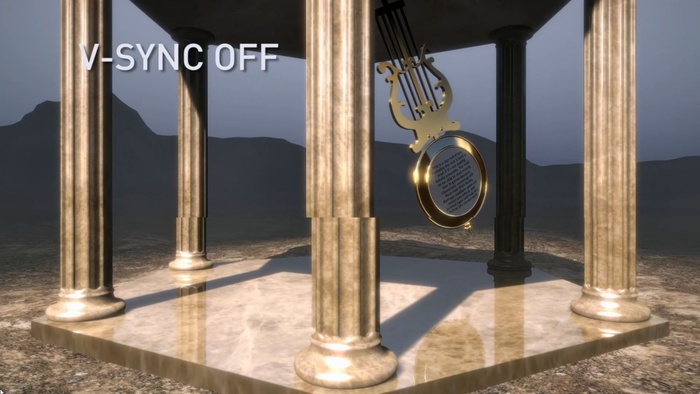

NVIDIA G-Sync — технология, применяемая в видеокартах NVIDIA и предназначенная для автоматической подстройки частоты кадров монитора под частоту кадров сигнала с видеокарты. Фича достаточно дорогая, если зайти на E-каталог, в раздел мониторы и отфильтровать модели с G-Sync вы обнаружите, что самый дешевый монитор стоит от 20000 рублей. Игровые модели стоят еще дороже, ценник легко перевливает за 40 и даже 60 тысяч.

Технологии G-Sync не один год, и достаточно дорогие мониторы с ней наделяют чуть ли не мифическими свойствами. На деле они всего лишь делают картинку несколько плавнее, убирай разрывы кадров, которые получаются при отключенной вертикальной синхронизации. И немногие знают, что у этой технологии есть ограничение сверху: она перестает работать, если на экран выдается больше кадров, чем герцовка монитора. Иными словами, если вы играете на G-Sync мониторе с частотой 100 Гц в игру с 120 fps - вы все равно будете видеть разрывы кадров. Так что если ваш монитор поддерживает эту технологию - имеет смысл принудительно ограничить максимальный fps герцовкой монитора.

Миф №7. G-Sync больше не нужен — современные видеокарты от Nvidia научились работать с FreeSync.

Да, действительно, около полугода назад Nvidia в своих драйверах реализовала поддержку бесплатного стандарта Adaptive-Sync (он же FreeSync) для видеокарт 1000 и 2000 линейки. Особенность этого стандарта в том, что он, как и G-Sync, позволяет синхронизировать частоту обновления монитора с частотой кадров в играх, тем самым убирая разрывы изображения. И с учетом того, что FreeSync бесплатен, то мониторы с ним стоят дешевле, чем с G-Sync.

Казалось бы — вот оно счастье, больше не нужно переплачивать за G-Sync? Как бы не так: Nvidia решила протестировать доступные на рынке мониторы с «вражеской» технологией, и на деле 100% совместимость (G-Sync Compatible) на данный момент имеют лишь 28 из 503 протестированных решений.

Разумеется, это не значит, что другие мониторы с FreeSync работать не будут — включить его можно для любого решения в настройках графического драйвера от Nvidia, но вот за различные артефакты изображения, небольшой диапазон работы этой технологии, подергивания картинки и прочие проблемы «зеленая» компания ответственности не несет.

Так что если вам говорят, что любой FreeSync-монитор отлично работает с видеокартами Nvidia — не верьте, на деле картинку уровня G-Sync обеспечивают лишь считанные проценты таких мониторов, поэтому перед покупкой внимательно читайте в обзорах, как обстоят дела с поддержкой этой технологии — если она вам, конечно, нужна. Полный список мониторов на сайте Nvidia Статья на hardwareluxx о том, почему только 6% мониторов получают сертификат G-SYNC Compatible

Миф №8. Яркость монитора должна быть максимально высокой.

Пожалуй, это один из самых вредных для глаз мифов — на деле яркость монитора должна быть сравнимой с яркостью окружения, в офисе это обычно около 150-200 кандел на квадратный метр. Очень высокая яркость приведет к дополнительному напряжению мышц глазного яблока, что приведет к более быстрому их утомлению, а это, в свою очередь, негативно скажется на остроте зрения. Пожалуй, единственное исключение — это игры: тут большая яркость поможет лучше различать врагов в темноте, но при обычных задачах ее лучше снижать до указанного выше уровня.

Миф №9. Разные цифровые выходы дают картинку разного качества.

Миф тянется с 90ых годов, когда банально от замены VGA-кабеля качество картинки могло измениться. Разумеется, с цифровым подключением таких проблем нет — разница между HDMI, DVI и DisplayPort заключается только в различных максимальных разрешениях и возможности выводить звук. Поэтому если указанные выше кабели и коннекторы не повреждены, то картинка будет абсолютно идентичной.

Миф №10. Чем шире цветовой охват монитора, тем лучше.

Это не совсем миф, это скорее просто лишняя трата денег. В последнее время стало появляться все больше мониторов с широкими цветовыми охватами: Apple использует DCI-P3, еще одним известным можно считать AdobeRGB. Стоят обычно решения со 100% покрытием этих цветовых пространств дорого, а толку от них для рядового пользователя нет совсем: подавляющее большинство изображений, видео и игр заточены под стандарт sRGB, поэтому можно сэкономить и брать мониторы с максимальным покрытием этого стандарта, разницы в большинстве задач вы не заметите.

Миф №11. Рядом с монитором должен стоять кактус. А желательно парочка. И обязательно защитную пленку на экран наклеить нужно.

О, эти кактусы, которые в 90ых и нулевых встречались чуть ли не в каждом офисе — миф о том, что они нейтрализуют вредное излучение ЭЛТ-мониторов, был невероятно популярен. А в самых запущенных случаях на монитор наклеивали еще и специальную защитную пленку, которая опять же должна была спасти от страшного и опасного излучения кинескопа.

Конечно, на деле оба способа абсолютно не помогали, ибо в «пузатых» мониторах того времени уже была защита от тормозного рентгеновского излучения (например, стекло легировали свинцом, а блоки строчной развертки имели защиту от высокого напряжения). Так что ЭЛТ-мониторы были вредны лишь для глаз, а от этого мифа выиграли только продавцы кактусов. Забавно, но даже с массовым переходом на ЖК-мониторы до сих пор в офисах можно встретить рядом с ними кактусы — так велика сила этого мифа.

Засматриваетесь на 4K UHD-мониторы, но ваш лаптоп не поддерживает высокие разрешения? Купили монитор и миритесь с частотой обновления в 30Гц? Повремените с апгрейдом.

TL;DR: 3840×2160@43 Гц, 3200×1800@60 Гц, 2560×1440@86 Гц на Intel HD 3000 Sandy Bridge; 3840×2160@52 Гц на Intel Iris 5100 Haswell.

Высокочастотные матрицы

А что на счет мониторов с высокой частотой опроса (от 100 Гц), нужны ли они? В основном такие пригодятся геймерам, потому что игровой процесс становится намного более плавным, и чем больше фреймов способен отобразить монитор, тем «мягче» будет меняться игровое окружение. Однако стоит понимать, что под такие мониторы требуется мощная видеокарта, выработка которой будет 144+ FPS. Если она будет вырабатывать лишь 100 кадров, то даже на 144-герцовом мониторе вы увидите лишь эти 100 кадров, ни больше, ни меньше.

Но ведь, у всего есть свой предел, верно? Сколько кадров сможет «распознать» человеческий глаз? Какой показатель герцовки является оптимальным для среднестатистического пользователя? Ответить на этот вопрос довольно трудно, поскольку всё зависит от индивидуальных особенной каждого человека. Всё мы разные. Чья-то скорость реакции составляет 0,2 секунды, чья-то — более секунды. Кто-то хорошо видит в темноте, кто-то плохо. Кто-то слышит высокочастотные звуки, а кто-то нет.

Нельзя определенно точно сказать, что именно вы заметите разницу между 60 и 144 герцами. Но, как показывают исследования, человеческий глаз способен распознавать не одну сотню кадров в секунду, если вообще можно так выразиться. Мы думаем, что стоит в любом случае попробовать. Лично мы уже никогда не вернемся на 60-герцовые экраны.

Стандартные и нестандартные стандарты

Современным мониторам и видеокартам нет никакого дела до фиксированных разрешений и таймингов времен DMT, они могут работать в широком диапазоне разрешений и частот обновления. Давайте посмотрим в техпаспорт моего монитора:

| Поддерживаемая горизонтальная частота развертки | 31-140 кГц |

| Поддерживаемая вертикальная частота развертки | 29-76 Гц |

| Режим | Частота горизонтальной развертки | Частота вертикальной развертки | Частота пикселизации | Полярность синхронизации |

|---|---|---|---|---|

| VESA, 3840×2160 | 133.3 кГц | 60.0 Гц | 533.25 МГц | H+/V- |

Дело в частоте пикселизации. Многие видеокарты, а тем более интегрированное в процессор видео, имеют железные ограничения частоты пикселизации, а из-за того, что в EDID монитора нет максимального разрешения с меньшей частотой вертикальной развертки вследствие ограниченности его размера, компьютер не может использовать максимальное разрешение.

К сожалению, производители редко публикуют максимальную частоту пикселизации видеочипов, ограничиваясь максимальным поддерживаемым разрешением, но для интересующих меня карт я нашел необходимую информацию:

Intel HD 3000 (Sandy Bridge): 389 кГц

Haswell ULT (-U): 450 кГц

Haswell ULX (-Y): 337 кГц

Кто виноват?

Во многом проблема похожа на имевшуюся 5-10 лет назад с FullHD телевизорами, которые при подключении к компьютеру умудрялись выводить изображение не “пиксель-в-пиксель” со всеми вытекающими из этого проблемами при попытке использовать их в качестве монитора.

Но если там это можно было объяснить конспирологическими заговорами изготовителей, производящих как мониторы, так и телевизоры («Зачем вам подключать телевизор к компьютеру, если мы вам можем предложить купить у нас еще и отдельный монитор?»), то в случае с 4k мониторами с подключением FullHD подобная логика не срабатывает. Скорее наоборот — многие потенциальные покупатели, готовые купить 4k монитор к своему старому компьютеру вынуждены ждать или апгрейда своего компьютера, или появления 4k мониторов с целочисленным масштабированием.

Возможно, что как и в случае с FullHD телевизорами, производители мониторов в один прекрасный момент зададутся вопросом как в анекдоте: «А что, так можно было?», и научат свои 4k мониторы integer scaling.

Впрочем, постепенно такие мониторы уже появляются. В статье Марата Таналина есть специальная рубрика Прогресс: Мониторы, которая постепенно начинает наполняться, пока к сожалению слишком медленно, но обычные пользователи могут попробовать это ускорить.

Что делать?

Но это всё в будущем, а что делать, если уже сейчас хочется приобрести 4k монитор, а имеющийся компьютер не имеет соответствующего видеоинтерфейса.

Попробуем рассмотреть несколько возможных сценариев действий (список открытый):

• Приобрести 4k монитор одновременно с новым компьютером (или после его приобретения)

Это конечно идеальный вариант, соответствующий эпиграфу статьи «Богатым и здоровым быть лучше, чем бедным и больным», но увы, не всегда реализуемый по экономическим причинам.

• Приобрести 4k монитор, одновременно поменяв видеокарту в имеющемся компьютере на современную (путь и не самую мощную)

Это безусловно дешевле, чем предыдущий сценарий, но при нынешних ценах стоимость средней игровой видеокарты может составлять как минимум треть, а то и половину стоимости нового домашнего компьютера, и вполне сопоставима с ценой 4k монитора (а то и существенно больше).

Так что единовременные затраты хоть и окажутся несколько меньше, чем в предыдущем сценарии, но всё равно весьма существенными, практически вдвое больше стоимости собственно самого 4k монитора.

Кроме того, новая видеокарта, которую хотелось бы иметь на будущем компьютере, в который она со временем могла бы перейти, может оказаться несовместимой с имеющимся системным блоком, и поэтому придется искать какое-то компромиссное решение, и этот компромисс потом перекочует в новый компьютер.

Конечно можно временно взять видеокарту-“затычку” для PCI-E, и какое-то время использовать её.

Но во-первых такая “затычка” тоже небесплатная (нам ведь нужна достаточно современная “затычка”, с 4k видеоинтерфейсом).

Во-вторых если имеющаяся старая видеокарта относительно мощная, то по сути такой ugrade в отношении 3D приложений получится downgrade-ом. А если перспектива приобретения нового компьютера ограничивается не несколькими месяцами, а годом/годами, то всё получается совсем печально…

Ну а в третьих, после приобретения нового компьютера эта “затычка” окажется не нужна, т.е. по сути это дополнительные расходы (да, я знаю о существовании Avito, но «это другая история»).

Словом, тут есть над чем подумать…

• Вместо 4k монитора приобрести QHD монитор, который сможет работать с имеющимся компьютером

Это наверное был бы оптимальный сценарий в данной ситуации, если исходить только из рациональности решения.

Но вот эмоционально… А что если все-таки хочется именно 4k монитор. Все-таки такие приобретения должны приносить и эмоциональное удовлетворение.

Кроме того, в некоторых случаях QHD монитор даст только количественное, но не качественное улучшение восприятия.

Например, как я уже цитировал себя в первой статье

(Картинка кликабельная, смотреть строго при 100% масштабе)

(впрочем, ее я тоже «вижу, но не замечаю»).

Но при приобретении нового монитора мне хотелось бы качественного изменения, чтобы и не видеть, и не замечать…

Но повторяю, это очень индивидуально, и то, что нравится/не-нравится мне (ну, или кому-то еще) совершенно необязательно должно нравиться/не-нравится всем.

То же и с усталостью глаз.

Для меня например более комфортны были неслаженные шрифты Windows XP, и я с трудом переходил на сглаженные, когда последние версии браузеров под Windows XP стали некорректно отображать свои шрифты при отключенных настройках сглаживания.

Но если уж сглаженные, то ClearType с субпиксельным рендерингом (тут я разницу замечаю).

- Отметим, что на 4k мониторах с integer scaling обычный субпиксельный рендеринг шрифтов ClearTupe работать не будет из-за «нестандартной» структуры суммарного “2x2-пикселя”

И тут мы переходим к четвертому сценарию:

• Приобрести 4k монитор, подключив его к старому компьютеру по FullHD интерфейсу

Ну что же, такой сценарий тоже имеет право на существование.

В этом случае главное — заранее убедиться, что Вы действительно «не замечаете» замыливание шрифтов (воспринимаете его, как сглаживание), и САМОЕ ГЛАВНОЕ — убедиться, что у Вас при этом не устают глаза.

У меня при работе на таком мониторе глаза начинают уставать буквально через полчаса-час (хотя тут может играет роль чужой монитор с чужими непривычными для меня настройками), но замыленные шрифты на нём я и вижу, и замечаю.

Проверять это конечно желательно до приобретения монитора, и не за 5 минут в демонстрационном зале магазина на неизвестно как настроенном мониторе. Я понимаю, что с этим могут быть проблемы, ведь не у каждого юзверя есть свободный доступ к 4k монитору, на котором он мог бы несколько часов свободно поработать, экспериментируя с настройками, разрешениями и т.п., но тут уже каждый должен искать сам.

Ну а если изображение на 4k мониторе при FullHD сигнале Вас не устраивает, и устают глаза, то не всё еще потеряно — есть пятый сценарий:

• Приобрести 4k монитор, подключить его к старому компьютеру по 4k видеоинтерфейсу с частотй кадров 30 FPS

Как мы уже говорили в самом начале, старые версии HDMI и DisplayPort в принципе официально поддерживают вывод 4k сигнала, но только с частотой кадров 24-25-30 Hz.

Главное, чтобы видеокарта компьютера согласилась отдать, а 4k монитор согласился работать с сигналом такой частоты. Хотя теоретически проблем с этим быть не должно, но…

Конечно 25 Hz или 30 Hz это уже может быть заметно даже при офисной работе или веб-сёрфинге (например, при скроллинге) — ощущение, что ваш компьютер резко постарел, но тут уже выбирать не приходится.*

- Однако существуют твики, о который следующий сценарий

• Приобрести 4k монитор, подключить его к старому компьютеру по 4k видеоинтерфейсу, и с помощью твиков увеличить частоту кадров более 30 FPS

Тут мы вступаем в область шаманства, усидчивости, прямизны рук, и везения.

Но результат может стоить того.

Например в статье Используем высокие разрешения на неподдерживающих их видеокартах ValdikSS подробно описывает, как ему удалось подключить 4k монитор Dell P2415Q к старому лаптопу Lenovo ThinkPad X220 в режиме 4k@44.1, что уже подходит для комфортной работы.

Но для этого и 4k монитор должен согласиться с такой частотой работать (хотя и не обязан).

В общем, тут много неизвестных…

Можно ли заранее рассчитывать на такой сценарий при покупке 4k монитора?

Если вы знаете, как работать с таймингами, и вы готовы попрактиковаться с этим на имеющемся мониторе, то может быть…

В конце концов в случае неудачи у вас останется предыдущий сценарий.

-

Есть ещё одно паллиативное решение, которое может позволить еще несколько поднять частоту кадров — попробовать переключить видеоинтерфейс из цветовой субдискретизации 4:4:4 в 4:2:2.

Конечно в обычных условиях это КРАЙНЕ НЕЖЕЛАТЕЛЬНО, поскольку при этом вдвое снижается цветовое разрешение по горизонтали, но зато это существенно снижает необходимую полосу пропускания видеоинтерфейса, и в сочетании с вышеописанным методом теоретически это может позволить еще несколько поднять частоту кадров.

Тестовая картинка оттуда

Если же ничего не получится, то обязательно нужно вернуть эту настройку назад, поэтому повторю еще раз, что в общем случае режим 4:2:2 крайне нежелательный, при этом вдвое снижается цветовое разрешение по горизонтали, и кроме того на цветных шрифтах/фонах могут возникнуть цветные ореолы, но на мониторах с очень мелким пикселем это может оказаться не очень заметным, зато может помочь несколько поднять частоту кадров.

• Отложить на какое-то время приобретение 4k монитора, и ждать

- Ждать, когда рано или поздно Вы поменяете свой компьютер на новый, с современным видеоинтерфейсом;

- Ждать, когда Вы в своем имеющемся системном блоке проведете плановую замену видеокарты на более современную;

- Ждать, когда у Вас отпадет необходимость использования одного из старых системных блоков, который пока сохраняется в Вашем (и в частности моём) зоопарке;

- Ждать, когда появится подходящий 4k монитор с Integer scaling, который вы сможете более-менее безболезненно подключить в FullHD режиме к вашему старому компьютеру.

Всё вышесказанное носит дискуссионный характер, надеюсь на конструктивное обсуждение…

Какой компьютер и монитор у Вас в настоящее время? [если их несколько с разными вариантами подключения, то можно выбрать несколько вариантов ответа]

Про то, что можно разогнать процессор, видеокарту или ОЗУ, слышали, я думаю, большинство пользователей ПК. Однако про то, что можно разогнать еще и монитор, знают немногие, причем зачастую разница от его разгона существеннее и заметнее, чем от разгона другого железа. Также она еще и безопаснее, но об этом ниже.

Для начала — что же подразумевается под разгоном матрицы монитора? Подразумевается увеличение частоты обновления монитора со стандартных 60 Гц и на сколько получится — 70-75, бывает и 120, и даже 150 Гц (!). Зачем это нужно? Чтобы повысить плавность картинки. Что означает, что частота обновления монитора — 60 Гц? Это означает, что картинка на экране меняется ровно 60 раз в секунду. При этом видеокарта может выдавать как меньшее количество fps, так и большее. Если количество кадров, выдаваемых видеокартой, меньше частоты обновления, то, значит, какой-то кадр будет дважды (а то и трижды) выведен на экран, что может привести к ощутимым задержкам. Если же количество кадров, выдаваемых видеокартой, больше частоты обновления монитора, то получится так, что на экран будет выдаваться сразу два-три кадра, что приведет к артефактам:

Компромиссом является установка вертикальной синхронизации. В чем ее суть? Она жестко привязывает один кадр, подготовленный видеокартой, к одному обновлению картинки на мониторе. И тут, если ваша видеокарта выдает стабильно больше кадров, чем частота обновления монитора, то вы получите идеальную плавную картинку, ну а ваша видеокарта при этом временами не будет загружена на 100% и будет отдыхать. И именно такой режим работы зачастую используется в системе — к примеру, когда вы скроллите в браузере, артефактов вы не видите, и при этом скроллинг плавный.

Поднятие частоты обновления монитора убивает сразу двух зайцев: во-первых, теперь вертикальная синхронизация будет идти на более высокой частоте, а значит плавность еще повысится (думаю, все видели разницу в роликах на YouTube с 30 и 60 кадрами? Вот тут также). Во-вторых, если ваша видеокарта в играх выдавала больше 60 кадров в секунду, то теперь порог появления артефактов отодвигается до новой частоты обновления, при этом информация на экране будет обновляться чаще, что достаточно важно для динамических игр.

Разумеется, возникает вопрос — насколько это безопасно? Гораздо безопаснее разгона железа: если монитор не может работать на заданной частоте, он просто не включится. Если на заданной частоте он заработал — значит, никаких проблем у вас не будет. Перегрев ему, как в случае с разгоном процессора или видеокарты, точно не грозит.

Теперь, когда немного разобрались с теорией, можно перейти к практике. Первое, что нужно знать — гонится любой монитор и даже матрицы ноутбуков, но тут есть сразу несколько сдерживающих факторов. Первый — это способ подключения: через DVI при разрешении 1920x1080 вы вряд ли получите свыше 65 Гц — сказывается достаточно низкая пропускная способность интерфейса. Через старые HDMI (до 1.4) при том же разрешении вы скорее всего сможете получить частоту около 75-85 Гц. Ну а через новые HDMI (1.4-2.0), Thunderbolt или DisplayPort ограничений практически нет — можно и 120-165 Гц получить. Аналогично зачастую нет ограничения у матриц ноутбуков, подключенных напрямую к плате. Второй сдерживающий фактор — сама матрица, вернее ее контроллер. Бывает, что даже с быстрым подключением при повышении частоты появляются некоторые артефакты изображения — увы, тут уже ничего не сделаешь, кроме как снижать частоту до последней стабильной.

Теперь поговорим о том, как разгонять. Владельцам видеокарт от Nvidia тут везет — для них алгоритм прост: нужно зайти в панель управления Nvidia, перейти на вкладку «Изменение разрешения», нажать на кнопку «Настройка», в открывшемся окне поставить галку на включении режимов, не поддерживаемых дисплеем, после чего нажать на кнопку «Создать собственное разрешение», и в открывшемся окне мы наконец-то получаем доступ к изменению частоты обновления:

Частоту стоит поднимать на 3-5 Гц, после чего нажимать на кнопку «Тест». Если никаких артефактов не появилось и изображение есть — поднимаете частоту еще выше. Как только появились артефакты или исчезло изображение — снижаете до предыдущей рабочей частоты, и дальше поднимаете уже по 1 Гц — в общем, тут все ровно как при обычном разгоне видеокарты. После того, как нашли нужную частоту обновления, просто сохраняете полученную конфигурацию, и она появится в пользовательских разрешениях.

Как видите, тут риска никакого — если монитор «не завелся» на указанной вами частоте, через 20 секунд система откатит значение частоты на дефолтное. Увы — все так хорошо только с видеокартами от Nvidia, с видеокартами от AMD или Intel все хуже — там в настройках драйвера частоту увеличить нельзя, однако есть универсальное приложение, которое поможет это сделать — называется оно Custom Resolution Utility (CRU), скачать его последнюю версию можно тут.

Сразу предупрежу — проблема программы в том, что у нее нет кнопки Тест, как в случае с Nvidia, поэтому частоты применяются сразу и бесповоротно. Так что если после выставления частоты вы видите черный экран — вам поможет или подключение второго монитора и возврат настроек на дефолтные, или же заход через безопасный режим и проделывание того же самого.

Работать с программой достаточно просто — вы ее запускаете, удаляете все разрешения из стандартных и снимаем все галочки слева (у себя я этого проделывать не буду, ибо уже разогнал матрицу через настройки Nvidia):

Теперь под окном с Detailed resolutions нажимаем на кнопку Add, выставляем Automatic - LCD Reduced и ниже меняем частоту обновления:

Тут принцип тот же — увеличиваем частоту на 3-5 Гц, нажимаем ОК, все сохраняем и перезагружаемся. Теперь заходим в панель AMD (или Intel) и выставляем новую частоту:

Вот, в общем-то, и все — как видите, ничего трудного или опасного нет.

Ну и остается последний вопрос — раз разгоняются почти все матрицы, то почему этого не делают производители с завода? Тут все просто: есть такое понятие, как стандарт, и для частоты обновления мониторов он уже достаточно давно составляет 60 Гц. Поэтому производители, даже если матрица способна работать на 70-80 Гц, все равно ограничивают ее частоту на стандартных 60 Гц. Во-вторых — зачастую все упирается уже в способ подключения. К примеру, передать 1080р60 можно по любому интерфейсу, хоть DVI, хоть Thunderbolt 3. А вот для 1080р80 уже нужен специальный кабель — DVI и старые HDMI уже не подходят. И чтобы не создавать путаницу, производители опять же ограничились 60 герцами.

Что касается вопроса, разгонять или не разгонять — решать вам и только вам. Если у вас получилось увеличить частоту с 60 до 65 Гц — то смысла в таком разгоне нет, разницу вы не увидите. А вот при разгоне уже до 75 и выше Гц разница становится явно видной, так что игра тут стоит свеч. Также следует учитывать, что после разгона повысится нагрузка на видеокарту при обычной работе — ведь ей теперь придется выдавать больше кадров в секунду, так что если вы разгоняете матрицу на ноутбуке — следует учитывать, что у вас несколько снизится время автономной работы.

Игровые мониторы уже давно преодолели планку в 100 Гц. И все же это маркетинг или прорывная технология? Пытаемся разобраться.

Современные процессоры покоряют новые вершины тактовой частоты и разрастаются в количестве ядер и потоков. Жесткие диски с каждым годом уверенно прибавляют в объемах. Проводные интерфейсы улучшают показатели пропускной способности.

А что на счет мониторов? Разработчики создают новые технологии, призванные улучшить качество картинки. Однако это не единственное направление эволюции экранов. Новые премиальные модели имеют очень высокую частоту опроса и этот показатель регулярно улучшается. Но что это такое? Как это связано с производительностью видеокарты? Что такое кадры в секунду? И стоит ли обращать внимание на высокогерцовые мониторы? Обо всём этом сегодня и поговорим.

Заключение

Не стоит слепо верить технической документации на монитор. В ходе исследований оказалось, что ограничение по вертикальной частоте аж 86 Гц, вместо 76 Гц по заявлению производителя. Таким образом, я могу наслаждаться плавной картинкой, хоть и в не в самом высоком разрешении

В статье Простой способ получения ”Flicker-Off”: «отключение» ШИМ мерцания подсветки LCD мониторов и телевизоров я обозначил несколько смежных тем, заслуживающих на мой взгляд отдельного разговора, который мы сейчас продолжим.

В этой статья с провокативным названием рассмотрим возможность подключения 4k монитора к относительно старому компьютеру без поддержки (или с неполной поддержкой) такого разрешения, более подробно поговорим о масштабировании изображения с integer scaling (целочисленным коэффициентом масштабирования), а также затронем другие связанные с этим вопросы.

— vs —

Конечно это весьма специфический круг вопросов, поэтому статья вряд ли будет интересна обладателям современных компьютеров, способных полноценно работать с 4k мониторами. Ну, если только убедиться в правильности своего выбора, о чём они и так наверняка знают :-)

А вот владельцев относительно старого «железа», которые собираются приобретать новый монитора «на вырост», с расчетом заменить остальное через годик-другой, или (как в моем случае) использующих с одним монитором несколько системных блоков, один из которых довольно старый — добро пожаловать под кат

Сразу оговорюсь, что статья не содержит однозначных рекомендаций по выбору и настройке в духе «делай раз, делай два. » — только информация, которая для многих может оказаться неочевидной, и из которой нужно будет сделать правильные для себя выводы, желательно до приобретения нового монитора, «чтобы потом не было мучительно больно».

Еще одна предварительная оговорка:

Да, я знаю о существовании мониторов с разрешением QHD (иногда неверно называемых 2k), но в силу ряда причин, которые будут понятны по ходу, в статье рассматривается противостояние именно FullHD vs 4k. Ну а в конце выводы можно будет сделать и для других разрешений.

Предыстория

Давным-давно, когда все мониторы были большими и кинескопными, компьютеры использовали фиксированные разрешения и тайминги для вывода изображения на экран. Тайминги были описаны в стандарте Display Monitor Timings (DMT), и не существовало универсального метода расчета таймингов для использования нестандартного разрешения. Мониторы отправляли компьютеру информацию о себе через специальный протокол Extended display identification data (EDID), который содержал DMT-таблицу с поддерживаемыми режимами. Шло время, мониторам стало не хватать разрешений из DMT. В 1999 году VESA представляет Generalized Timing Formula (GTF) — универсальный способ расчета таймингов для любого разрешения (с определенной точностью). Всего через 3 года, в 2002 году, его заменил стандарт Coordinated Video Timings (CVT), в котором описывается способ чуть более точного рассчитывания таймингов.

Оба стандарта были созданы с учетом особенностей хода луча в электро-лучевой трубке, вводились специальные задержки для того, чтобы магнитное поле успело измениться. Жидкокристаллические мониторы, напротив, таких задержек не требуют, поэтому для них был разработан стандарт CVT Reduced Blanking (CVT-R или CVT-RB), который является копией CVT без задержек для CRT, что позволило значительно снизить требуемую пропускную способность интерфейса. В 2013 году вышло обновление CVT-R c индексом v2, но, к сожалению, открытого описания стандарта в интернете нет, а сама VESA продает его за $350.

История

Герцы в мониторах: что это такое?

Герцовка монитора — это значение, показывающее, как часто обновляется изображение. Измеряется оно в герцах. Подавляющее большинство современных мониторов имеет частоту обновления 60 Гц. Однако этот показатель напрямую зависит от производительности видеокарты. Скорость обработки видеокартой измеряется в кадрах в секунду (FPS, framerate). Для того чтобы лучше понимать, как все это работает, давайте разберем на примере.

Предположим ваша видеокарта в какой-то игре выдает 80 кадров в секунду. Это значит, что при текущей нагрузке, изображение в игре будет меняться со скоростью в 80 FPS. Но это просто выработка железа. Отображением картинки занимается монитор. Предположим, что частота опроса вашей матрицы составляет 60 Гц. В таком случае, он не сможет отобразить большее количество кадров, чем его герцовка. Получается, что бесполезно иметь мощное железо и бюджетный монитор?

С одной стороны, это действительно так. Пусть у вас будет хоть 1000 FPS, на 60-герцовом мониторе вы увидеть лишь 60 кадров из этой тысячи. Но все мы прекрасно понимаем, что нагрузка в играх не является статичной и во время особо динамичных сцен, фреймрейт может ощутимо просесть. Получается, что всё же необходимо иметь небольшой запас избыточных кадров.

У меня не получается!

Убедитесь, что вы подключаете монитор через DisplayPort 1.2. HDMI 1.4 не позволяет использовать частоту пикселизации выше 340 МГц, в то время как для DisplayPort (HBR2) верхнее ограничение равно 540 МГц. Также удостоверьтесь, что ваш монитор поддерживает частоту обновления выше 30 Гц на максимальном разрешении, т.к. ранние модели этим грешили.

Подключение LCD монитора к компьютеру

Как известно, LCD дисплеи дают качественное изображение только при разрешении сигнала, совпадающим с нативным разрешением их матрицы. В этом их отличие от аналоговых CRT дисплеев, одновременно и сильная, и слабая их сторона.

- Здесь и далее рассматривается цифровое подключение

- Можно подключить 4k монитор по HDMI 1.4, или DisplayPort 1.0, но в этом случае частота кадров будет 30Hz, но об этом чуть ниже.

Например, некоторые видеокарты GeForce 900 Series имеют только HDMI 1.4, видеокарты AMD 2015 года тоже имеют лишь HDMI 1.4, да и на более новых высокоскоростной видеоинтерфейс не всегда распаян.

Возникает неприятная ситуация, когда не совсем старая видеокарта, вполне удовлетворяющая минимальным требованиям майнинга крипты современных игр, ну а тем более вполне пригодная для офисной работы, при приобретении 4k монитора требует замены на что-то более новое, пусть и даже более слабое в 3D, но с видеоинтерфейсом 4K@60.

Но «если нельзя, но очень хочется, то (может быть) можно»?

На этом остановимся подробнее.

Предыстория

Давным-давно, когда все мониторы были большими и кинескопными, компьютеры использовали фиксированные разрешения и тайминги для вывода изображения на экран. Тайминги были описаны в стандарте Display Monitor Timings (DMT), и не существовало универсального метода расчета таймингов для использования нестандартного разрешения. Мониторы отправляли компьютеру информацию о себе через специальный протокол Extended display identification data (EDID), который содержал DMT-таблицу с поддерживаемыми режимами. Шло время, мониторам стало не хватать разрешений из DMT. В 1999 году VESA представляет Generalized Timing Formula (GTF) — универсальный способ расчета таймингов для любого разрешения (с определенной точностью). Всего через 3 года, в 2002 году, его заменил стандарт Coordinated Video Timings (CVT), в котором описывается способ чуть более точного рассчитывания таймингов.

Оба стандарта были созданы с учетом особенностей хода луча в электро-лучевой трубке, вводились специальные задержки для того, чтобы магнитное поле успело измениться. Жидкокристаллические мониторы, напротив, таких задержек не требуют, поэтому для них был разработан стандарт CVT Reduced Blanking (CVT-R или CVT-RB), который является копией CVT без задержек для CRT, что позволило значительно снизить требуемую пропускную способность интерфейса. В 2013 году вышло обновление CVT-R c индексом v2, но, к сожалению, открытого описания стандарта в интернете нет, а сама VESA продает его за $350.

Что делать и что сделать?

Ответ очевиден — нужно уменьшить частоту пикселизации! Ее уменьшение приведет и к уменьшению частоты обновления монитора. Как нам это сделать? Нам нужно сгенерировать так называемый modeline — информацию о таймингах для видеокарты и монитора. В сети можно найти множество генераторов modeline, но большинство из них безнадежно устарели и ничего не знают о стандарте CVT-R, который мы и будем использовать. Я рекомендую вам воспользоваться umc под Linux, PowerStrip под Windows и SwitchResX под Mac OS. К слову, SwitchResX — единственная программа, которая может рассчитывать modeline по стандарту CVT-R2, но мой монитор его не поддерживает.

Modeline содержит следующую структуру:

Посмотрите на таблицу выше: минимальная вертикальная частота обновления моего монитора может равняться 29 Гц.

Давайте сгенерируем modeline для разрешения 3840×2160 с частотой обновления в 30 Гц:

Как видим, частота пикселизации с данным режимом будет установлена в 262.75 МГц, что далеко от ограничений моего видеоадаптера.

Давайте попробуем установить и активировать наш режим:

Если все прошло удачно, вы увидите картинку в «неподдерживаемом» вашей картой разрешении на мониторе. Ура!

У нас все еще есть большой запас по частоте пикселизации, да и вряд ли кому-то будет комфортно использовать монитор с частотой обновления в 30 Гц, поэтому мы будем увеличивать ее до тех пор, пока частота пикселизации не приблизится к значению в 389 МГц — пределу моего видеоадаптера. Путем нехитрых манипуляций удалось установить, что при такой частоте мы получаем вертикальную развертку в 44.1 Гц.

Не блеск, но жить можно!

Как можно заметить, частота горизонтальной развертки — 97.25 кГц — вполне в диапазоне поддерживаемых монитором. Как в случае с вертикальной разверткой, так и в случае с разрешением, монитору нет дела до конкретных режимов, поэтому мы можем использовать 3200×1800 при 60 Гц — еще не такое низкое разрешение, как 2560×1440, и с привычной частотой обновления.

- Отредактировать EDID монитора и указывать его драйверу

- Добавить modeline в настройки Xorg

Для второго способа достаточно создать файл с Xorg-секцией «Monitor» и поместить его в /etc/X11/xorg.conf.d/ :

Где Identifier — название вашего видеовыхода согласно xrandr. Опцией «PreferredMode» можно задать режим, который будет выбран по умолчанию.

2160 / 1080 = 2, или 2 x 2 = 4?

- Здесь и далее говорим о мониторах с соотношением сторон 16:9. Для мониторов с другими пропорциями ситуация аналогичная.

Просто, как «дважды два четыре»!

На подавляющем большинстве 4k мониторов и телевизоров FullHD сигнал масштабируется в два раза по какому-то более сложному алгоритму, чем простейший Nearest neighbor (при котором получился бы вывод “пиксель-в-2x2-пикселя”), при этом затрагиваются не только соседние пиксели в строке (это бы ещё можно было назвать «сглаживанием»), но и соседние строки (а вот это уже печально).

И в результате изображение получается замыленным, размытым.

Рассмотрим следующую картинку с примерами отображения надписи шрифтом Arial 10pt на трех разных экранах:

- В верхней строке FullHD монитор, нативное разрешение, масштаб 100%

- В нижней строке 4k монитор, нативное разрешение, масштаб 200%

- Между ними 4k монитор, FullHD подключение, масштаб 100%

Впрочем, можно попробовать сравнить и реальные мониторы.

Например, в обзоре Test Monitor LG 43UD79-B приведены макрофото шрифтов на рассматриваемом мониторе при нативном и 1/3 от нативного разрешении (картинки кликабельные):

vs

Farbsäume treten nicht auf (Цветной бахромы нет) — и на том спасибо.

Gif-ка для наглядности:

Несколько пар снимков оттуда: в каждой паре первый — при нативном разрешении, второй — при половинном (картинки кликабельные)

Ну а при желании каждый сможет сам убедиться, сделав подобную проверку на своем имеющемся мониторе.

Монитор необязательно должен быть 4k (хотя и 4k тоже подойдет ;-) ), главное, чтобы на нём была поддержка половинного разрешения.

Сначала включите нативное разрешение, и посмотрите, как выглядят шрифты (при желании сделайте макрофото), а потом включите половинное (540p для FullHD монитора, 720p для QHD, ну и т.д), и посмотрите, что при этом получится.

Эти, а также многие другие вопросы, связанные с целочисленным масштабированием при отображении на 4K-мониторах и 4K-телевизорах, подробно рассматриваются статье Марата Таналина MTonly

Целочисленное масштабирование без размытия (integer scaling)

(статья от 2017-04-17, постоянно обновляется, нынешняя редакция о 2021-12-02)

Картинки оттуда: — vs —

К этой статье мы еще будем возвращаться.

Ну а теперь традиционная рубрика, анонсированная пару веков классиками русской философии "Кто виноват?" и "Что делать?"

Читайте также: