Vmware esxi подключить сетевой диск

Мое знакомство с домашним NAS началось несколько лет назад с Synology 207+. Пока NAS был пустой, он мне очень нравился своими возможностями. Но стоило только перенести на него свою коллекцию фильмов, музыки и фоток, как стало понятно, что пользоваться им невозможно из-за очень низкой производительности. И агрегат превратился в обычную файлопомойку, а в последствии и вовсе был убран в кладовку за ненадобностью. Сама Synology забила на эту линейку и прекратила выпуск новых оболочек на нее. Я периодически следил за новинками у Synology, там как всегда множество хвалебных статей, но доверия они уже не вызывали.

Случайно я наткнулся на проект XPEnology, оказалось, что можно попробовать новую оболочку Synology и на виртуальной машине и на обычном компьютере.

Про установку Synology DSM 4.2 на виртуальную машину в ESXi я и расскажу в этой статье, установка на обычное железо еще проще, но если будет интерес, напишу отдельный топик.

Требуется:

Немного времени, чтобы точно следовать этому руководству, понимание и навыки конфигурации.

Правильно установленный и настроенный на 64-разрядной машине ESXi 5.5 (его можно взять на сайте VMmware).

ESXi Приготовление:

Загрузить имидж диска esxi_synoboot_3202_v2.vmdk на Datastore в ESXi. Поместите его в каталог, то есть, предварительно создать каталог с тем же именем, который вы дадите вашему Synology экземпляру виртуальной машины, и загрузите файл в этот каталог.

Конфигурация ВМ:

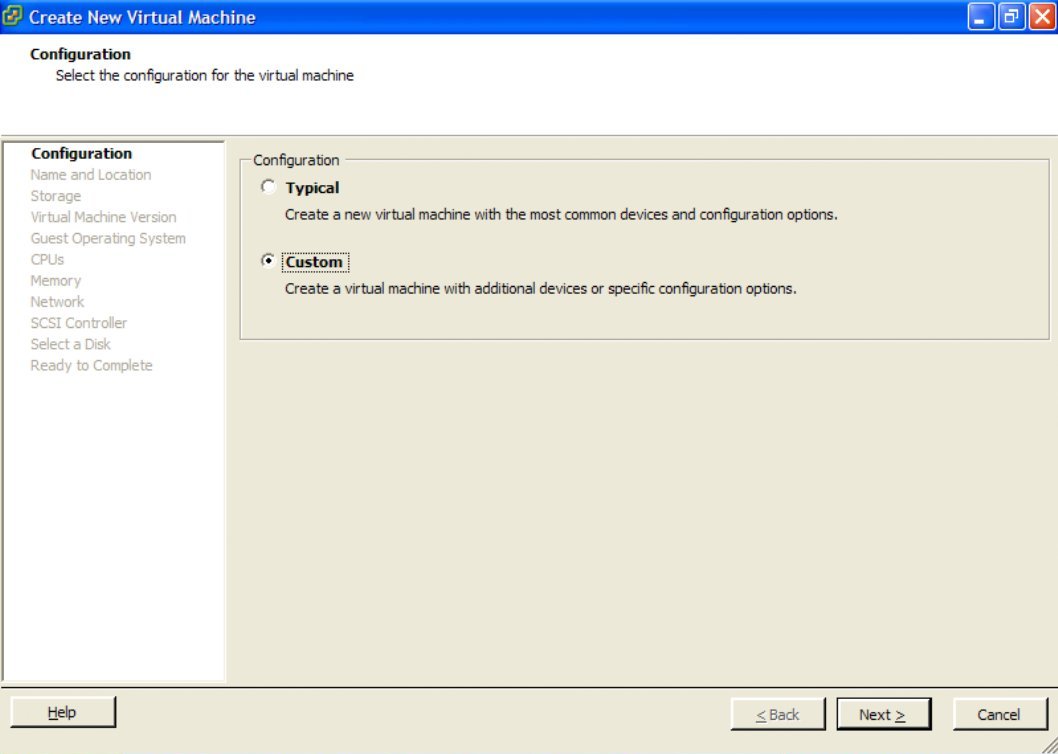

Создать новую пользовательскую виртуальную машину.

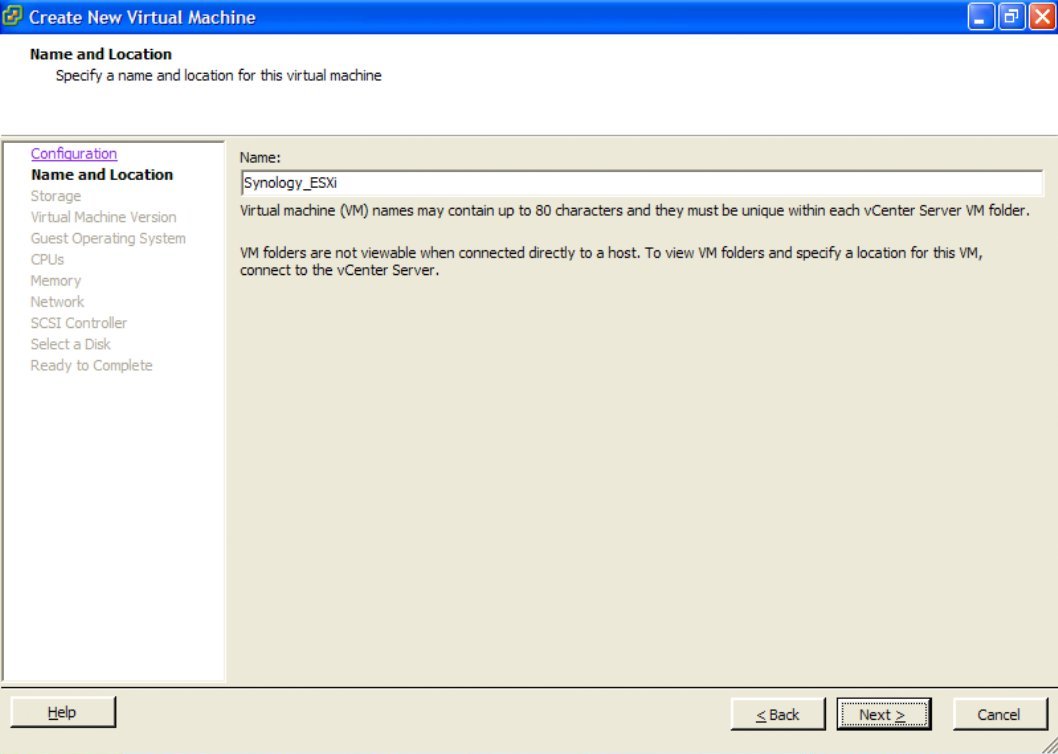

Дайте виртуальной машине удобное имя.

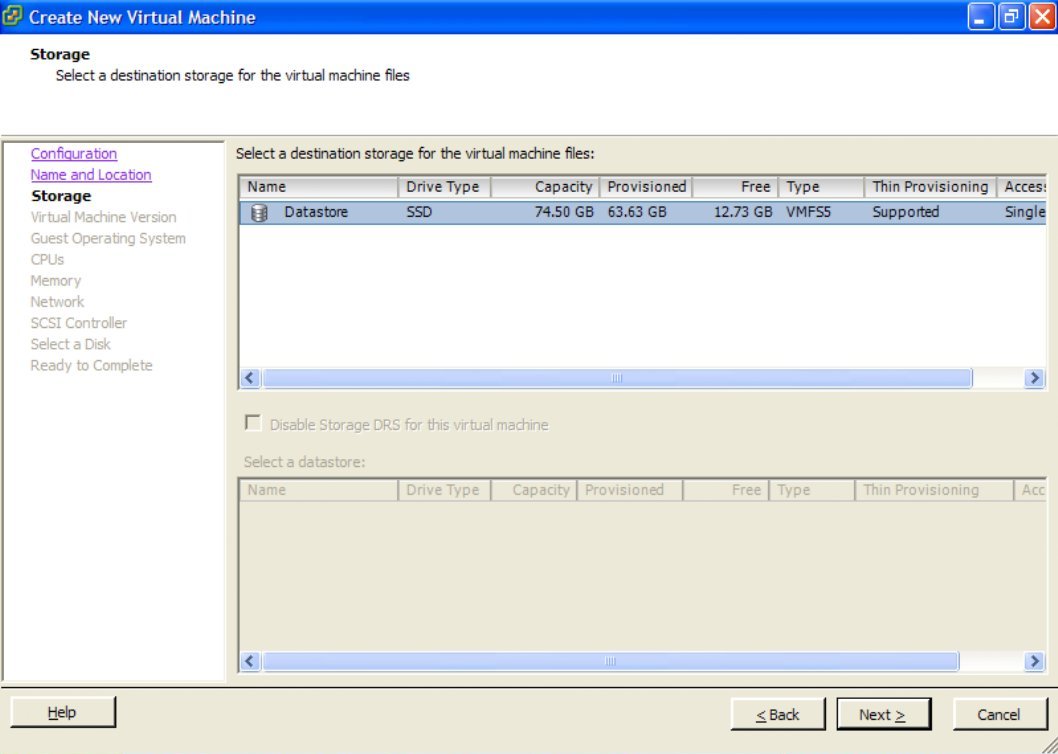

Поместите это на вашем хранилище данных в ESXi, по возможности используйте SSD.

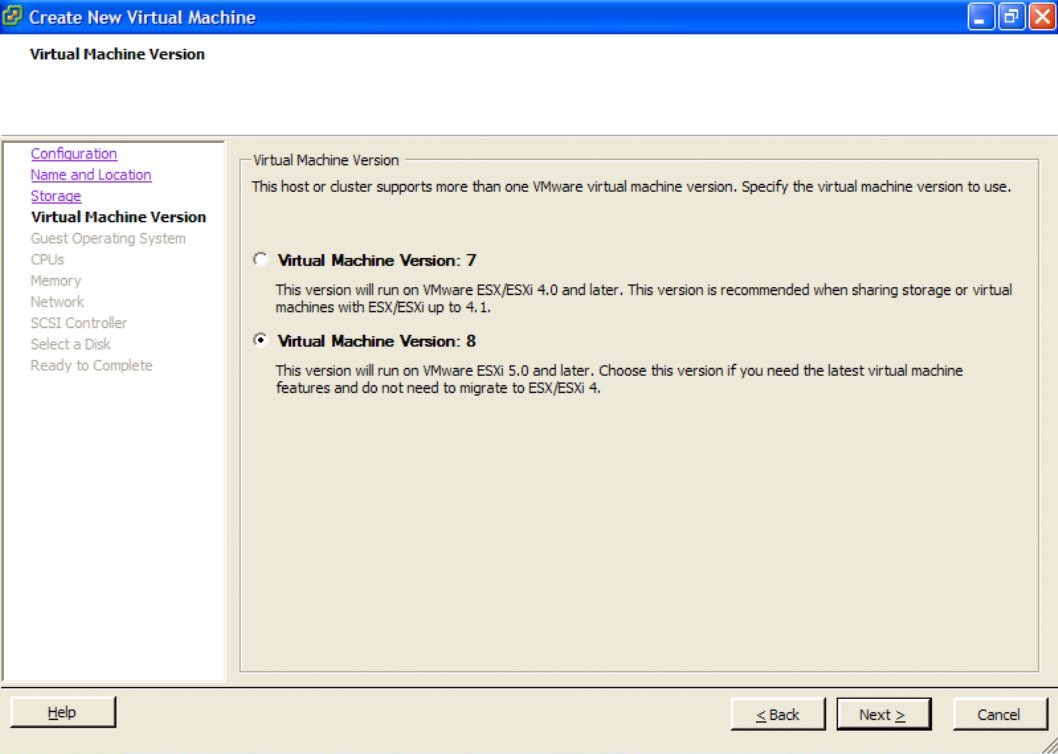

Используйте виртуальную машину версии 8.

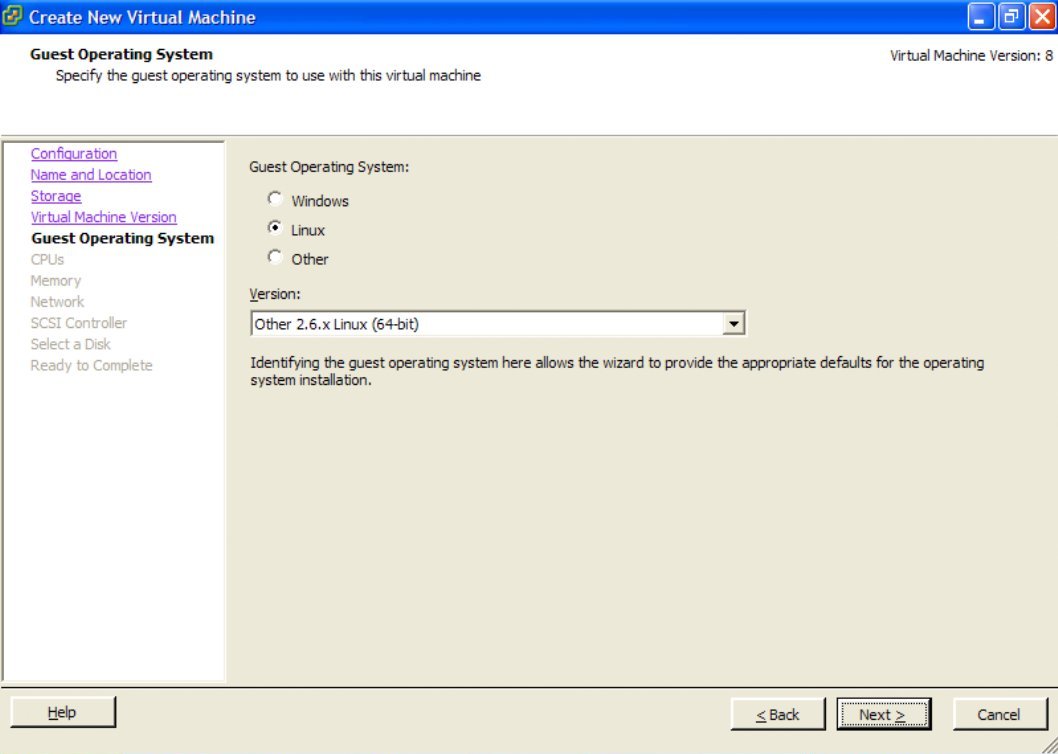

Synology DSM 4.2 основывается на Linux 2.6.x (64-разрядное ядро).

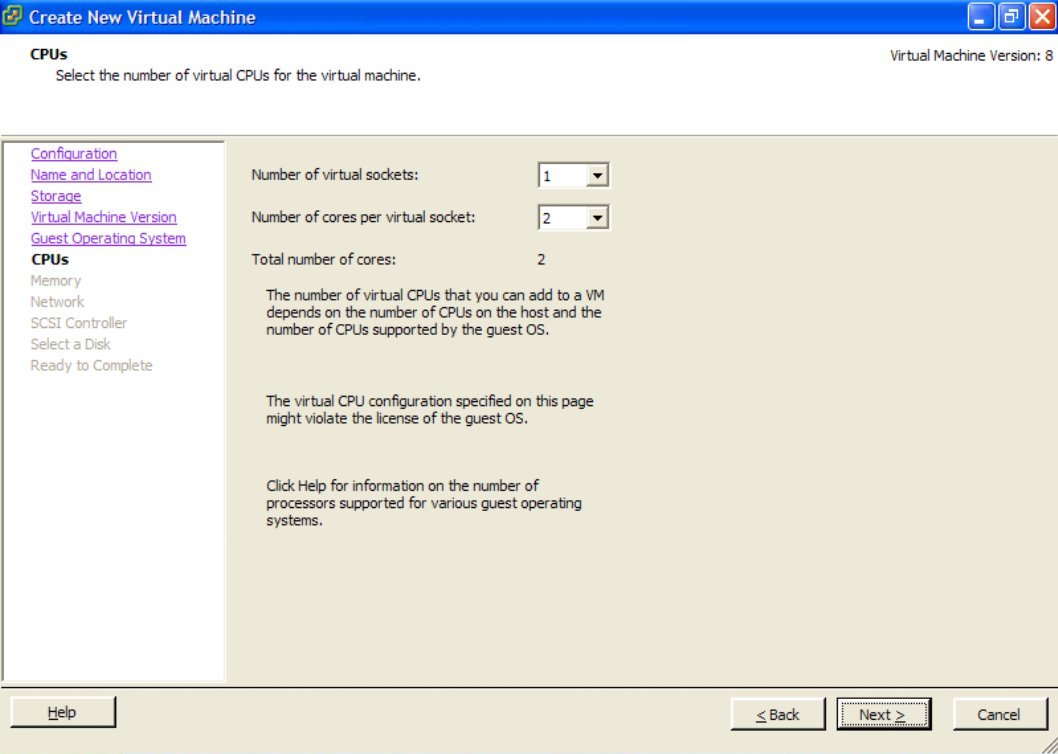

Для соответствующей производительности задействуйте 1 процессор и 2 ядра.

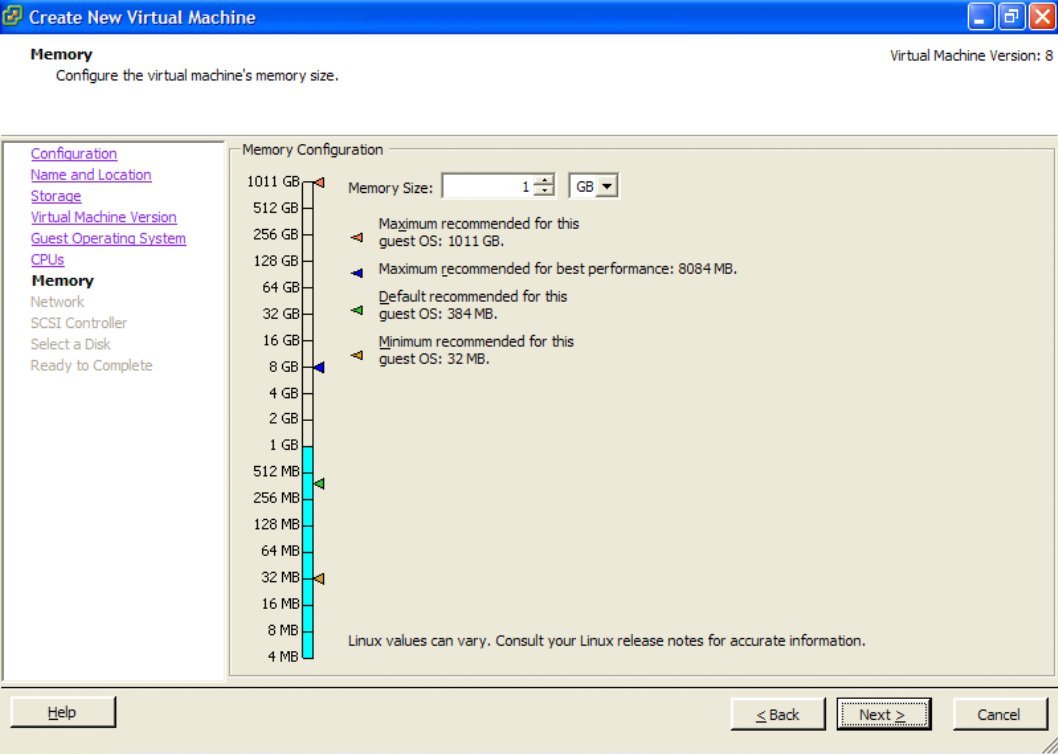

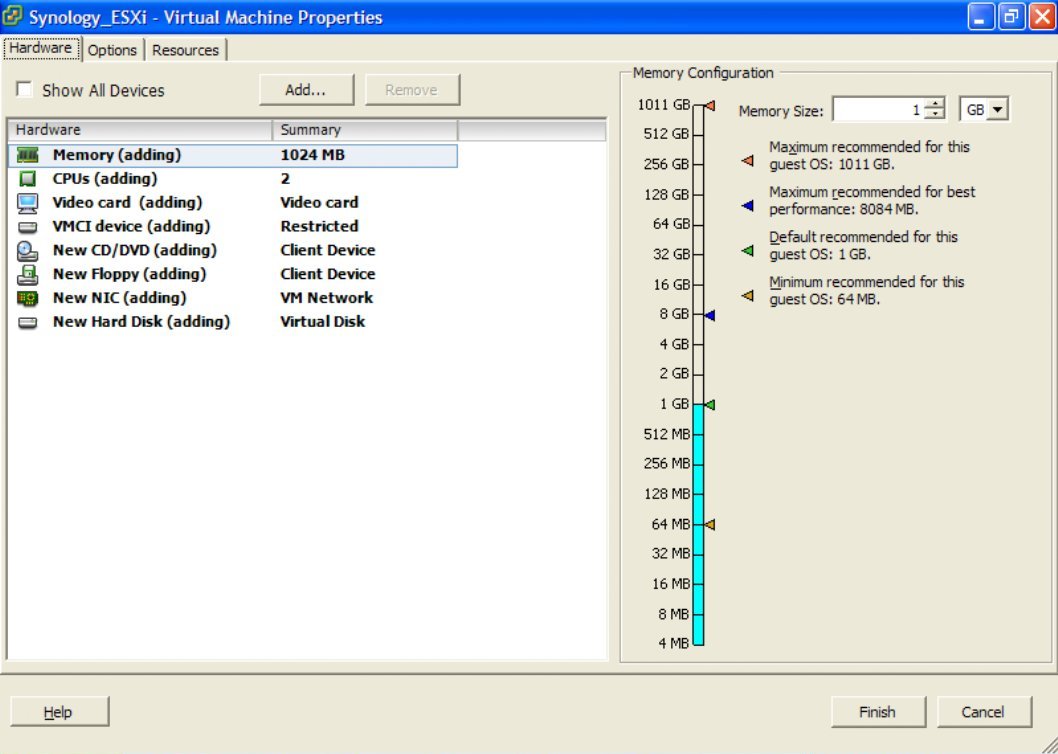

Присвойте 1 ГБ или больше памяти.

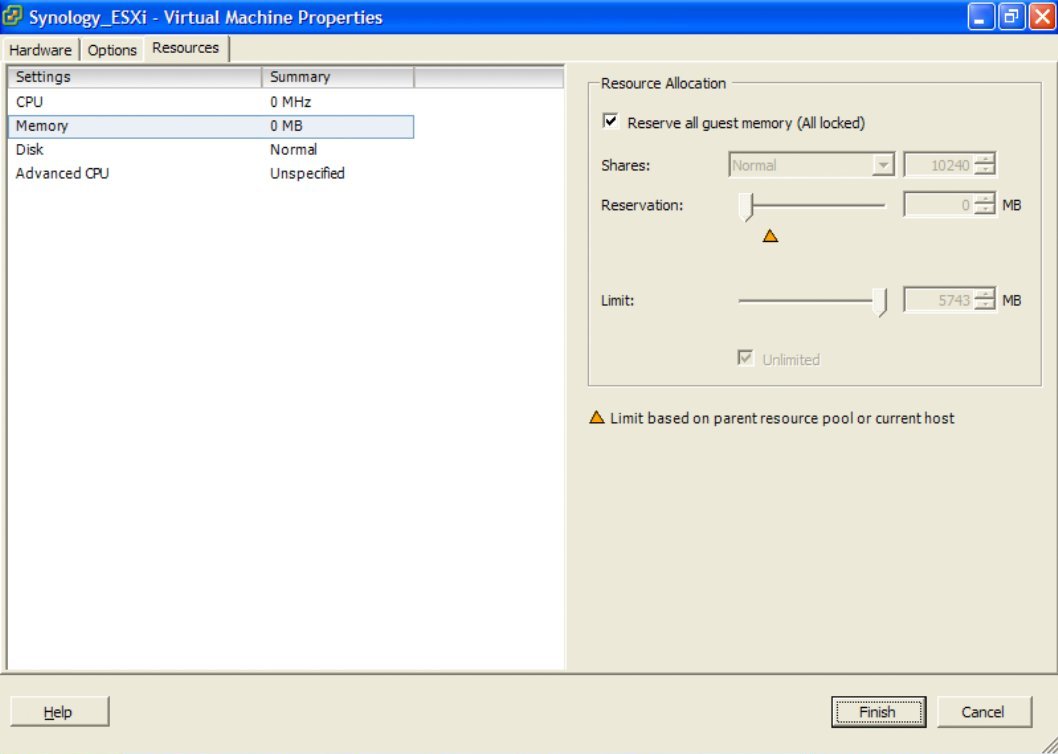

Примечание: по причинам производительности рекомендуется зарезервировать эту память, таким образом, используемая память ДОЛЖНА быть доступной на сервере ESXi.

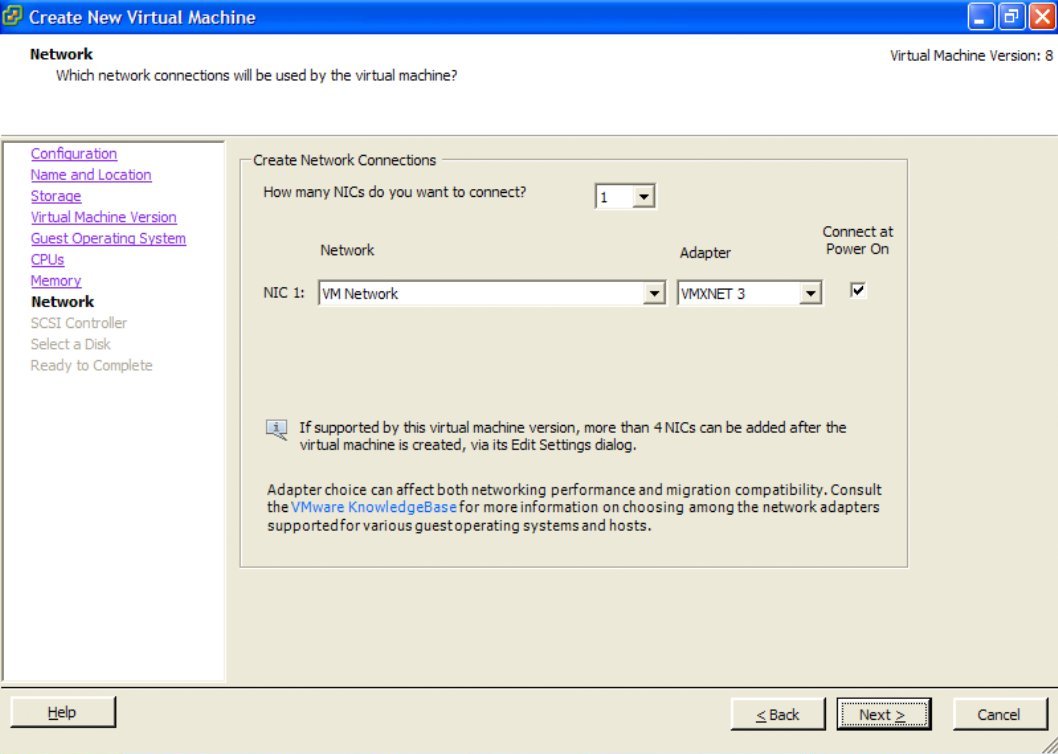

Создайте 1 сетевой адаптер, VM Network, VMXNET 3, Connected at Power On.

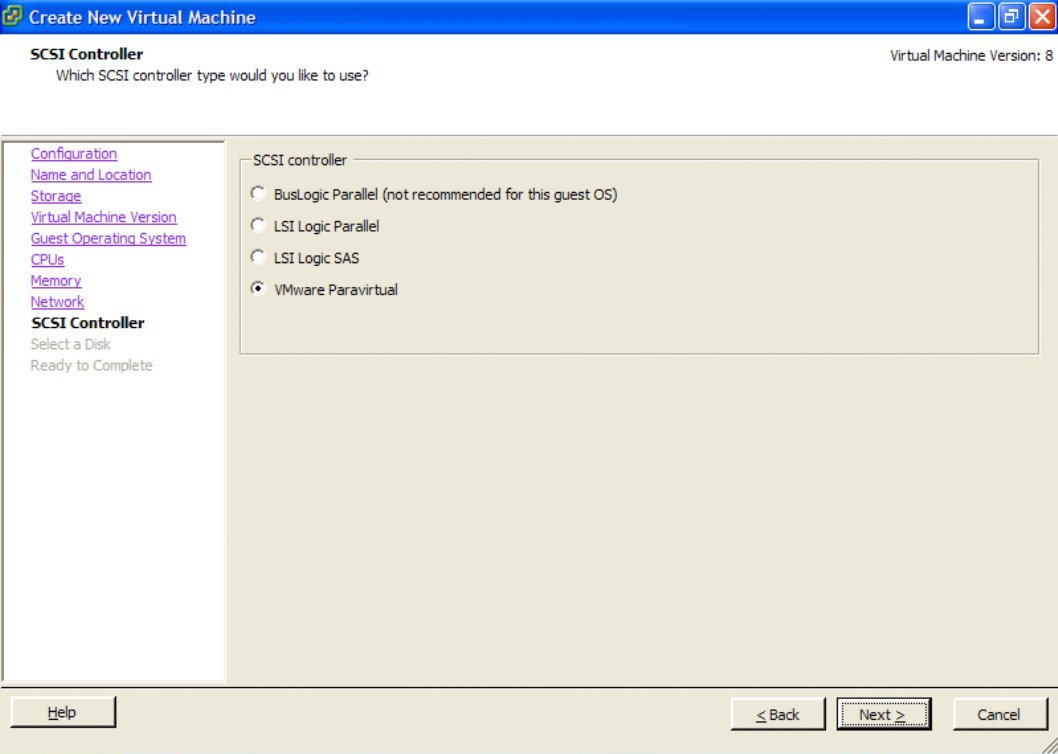

Используйте VMware паравиртуальный SCSI контроллер.

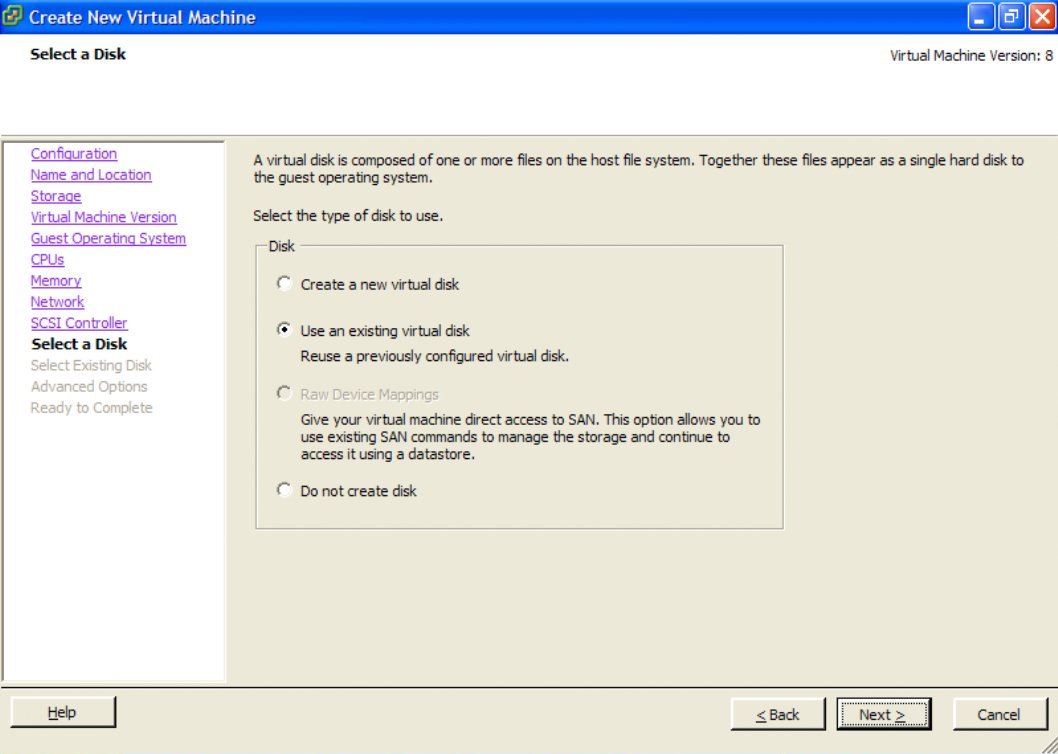

Используйте существующий виртуальный диск.

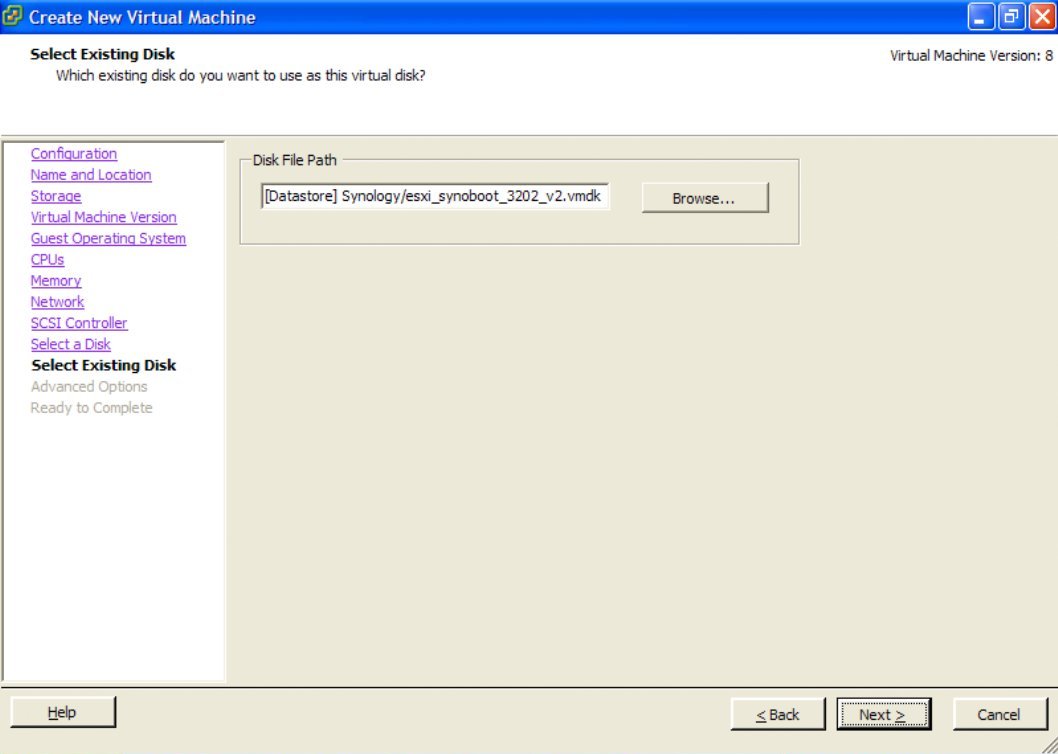

Выберите имидж esxi_synoboot_3202_v2.vmdk, загруженный ранее в Datastore.

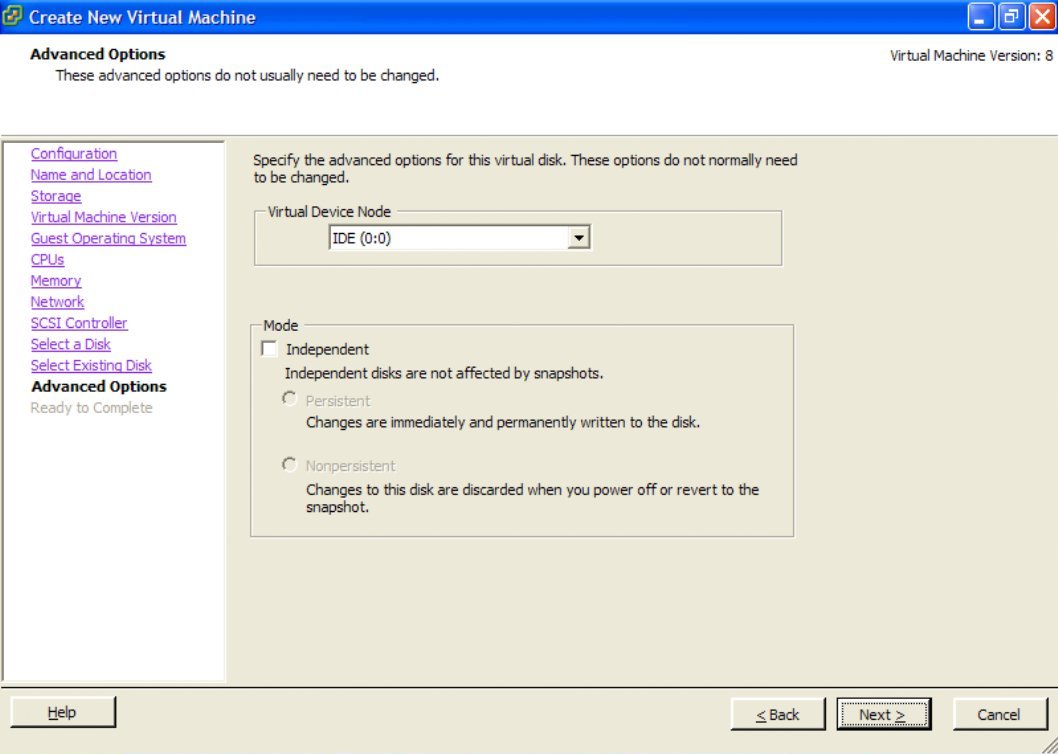

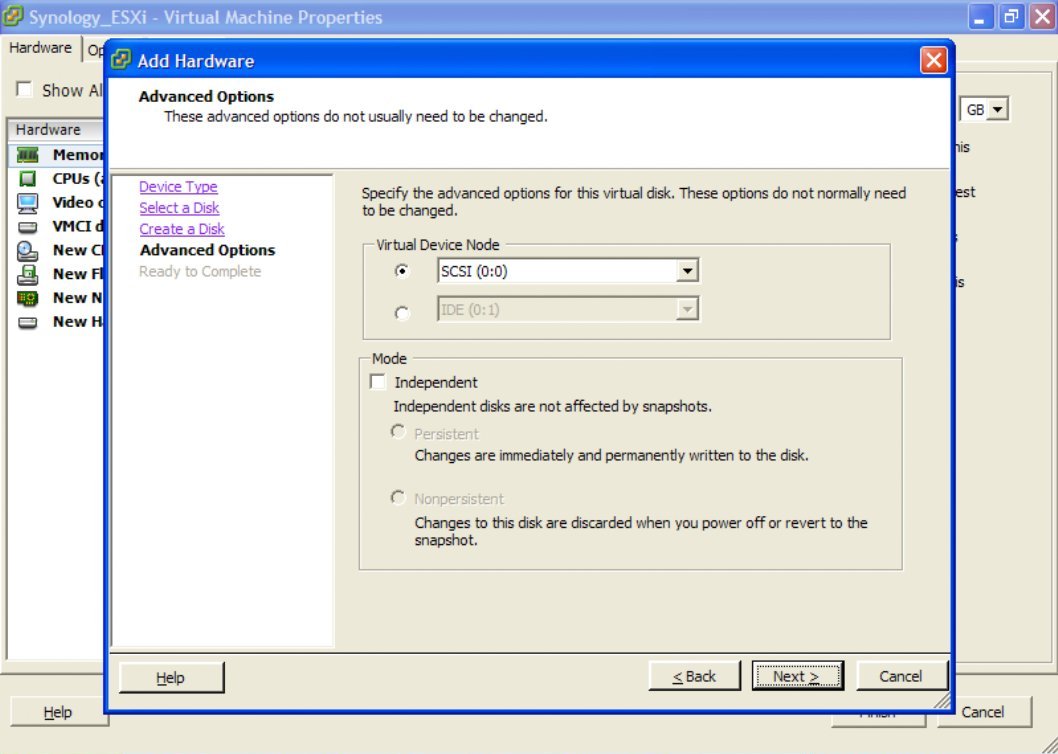

Используйте IDE (0:0) в качестве Virtual Device Node

Выберите «Edit the virtual machine settings before completion» и продолжайте.

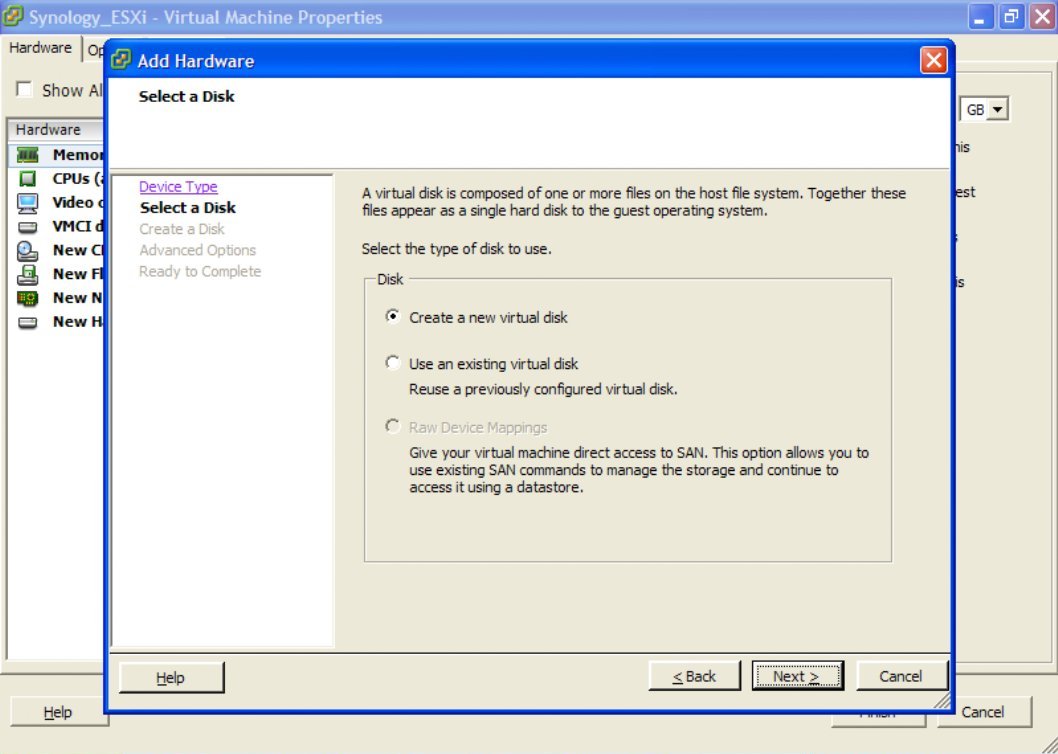

Теперь мы добавим по крайней мере один новый жесткий диск или несколько дисков к виртуальной машине, которые станут вашими новыми дисками данных Synology.

Выберите из устройств Hard Disk и добавьте его.

В этом примере мы создадим новый виртуальный диск VMFS в хранилище данных исключительно для теста. В надлежащей среде используйте RDM PVSCSI или VMDirectPath I/O для подключения диска.

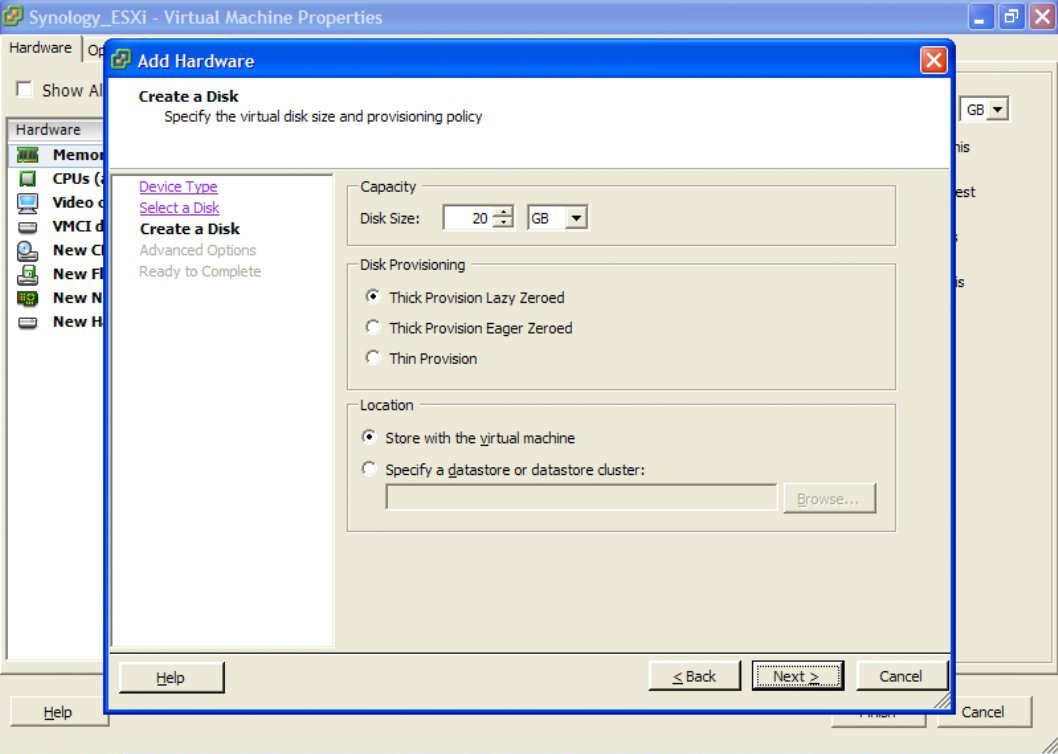

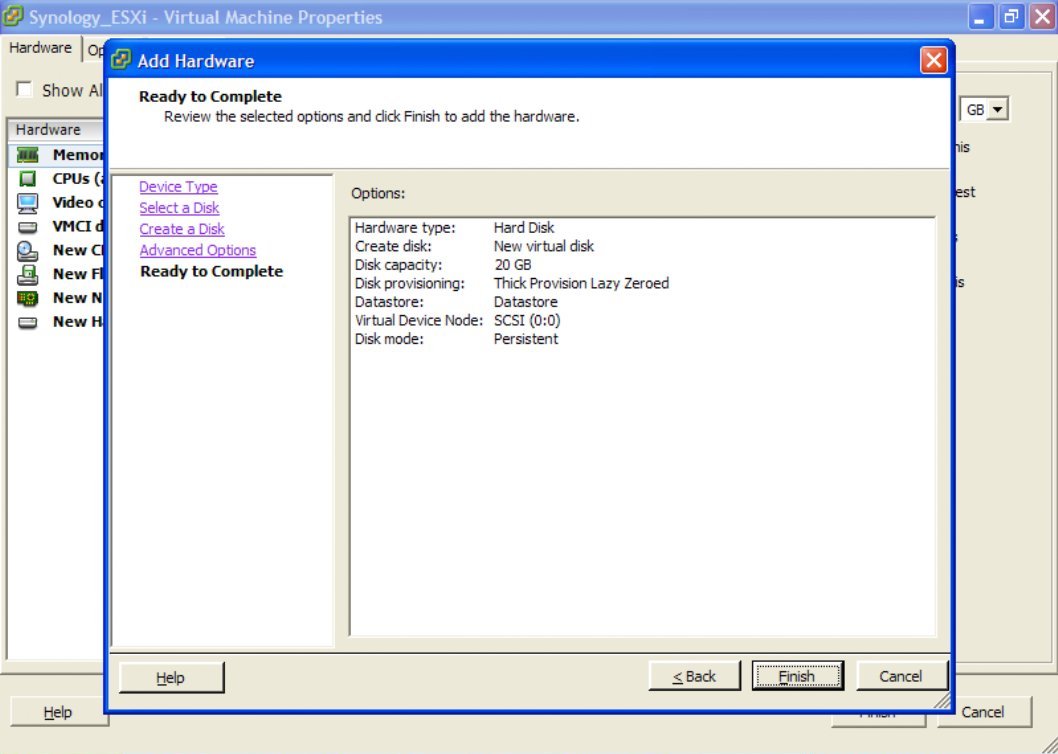

Теперь мы будем, только для примера, создавать 20 ГБ Thick Provisioned Lazy Zeroed диск.

ПРИМЕЧАНИЕ: Тонкий диск будет также работать, однако производительность будет еще хуже.

Присоедините этот новый диск к SCSI (0:0) Virtual Device Node (Диск 1 в Synology)

Дважды убедитесь, что все так, как вы хотите и жмите «Готово» для создания дискового хранилища.

ПРИМЕЧАНИЕ: Повторите добавления дисков, пока не будут добавлены все диски, которые необходимо использовать.

Теперь убедитесь, что виртуальная машина Synology располагает всей памятью, зарезервированной для гостя. В настоящее время VMTools не работает, поэтому управление памятью лучше оставить предварительно выделенным. Кроме того, это позволит использовать ВМ Vt-d подключенных устройств PCI и, следовательно, использовать VMDirectPath I/O и физически подключенные диски.

Установка DSM 4.2 на виртуальную машину Synology

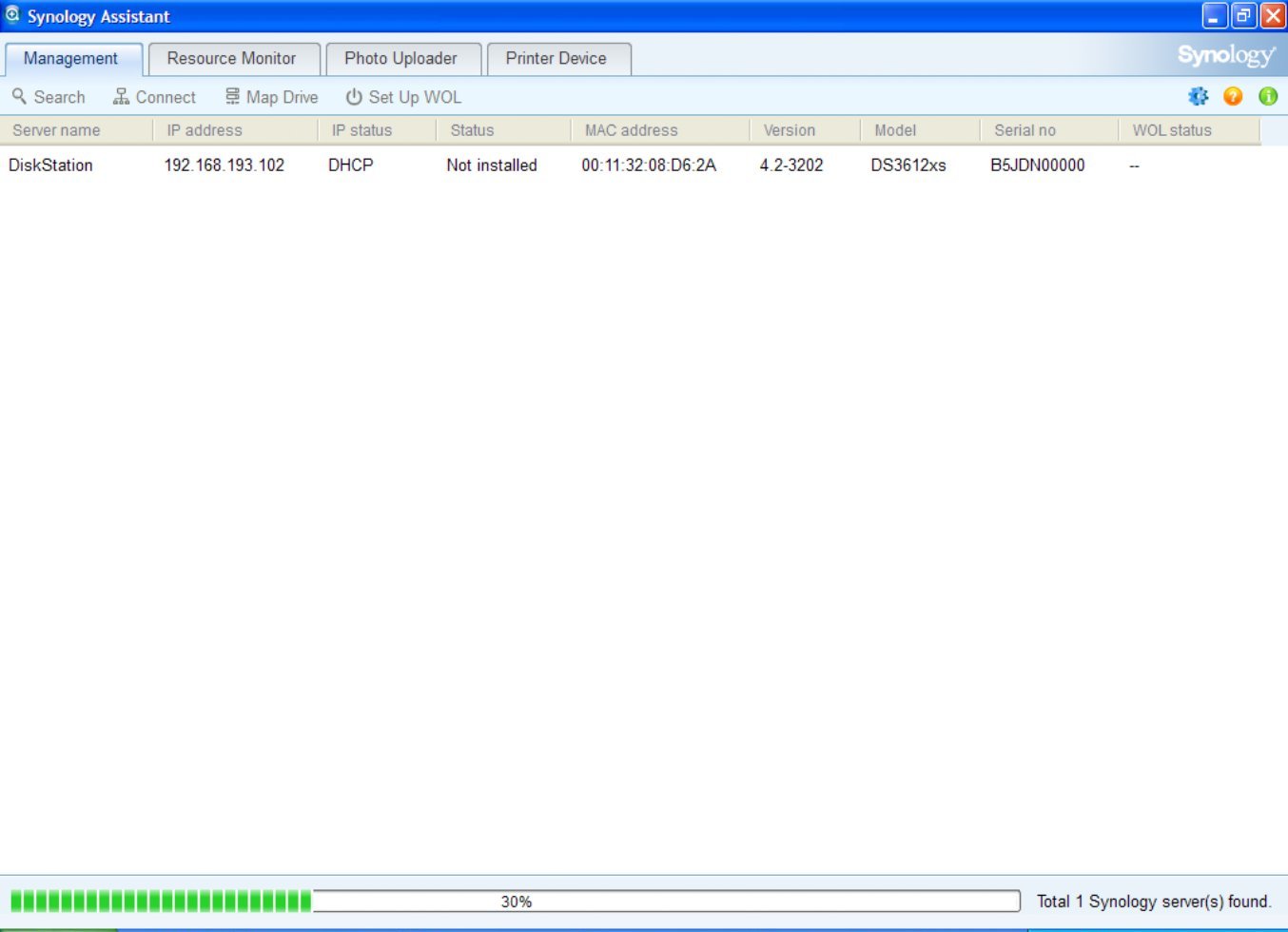

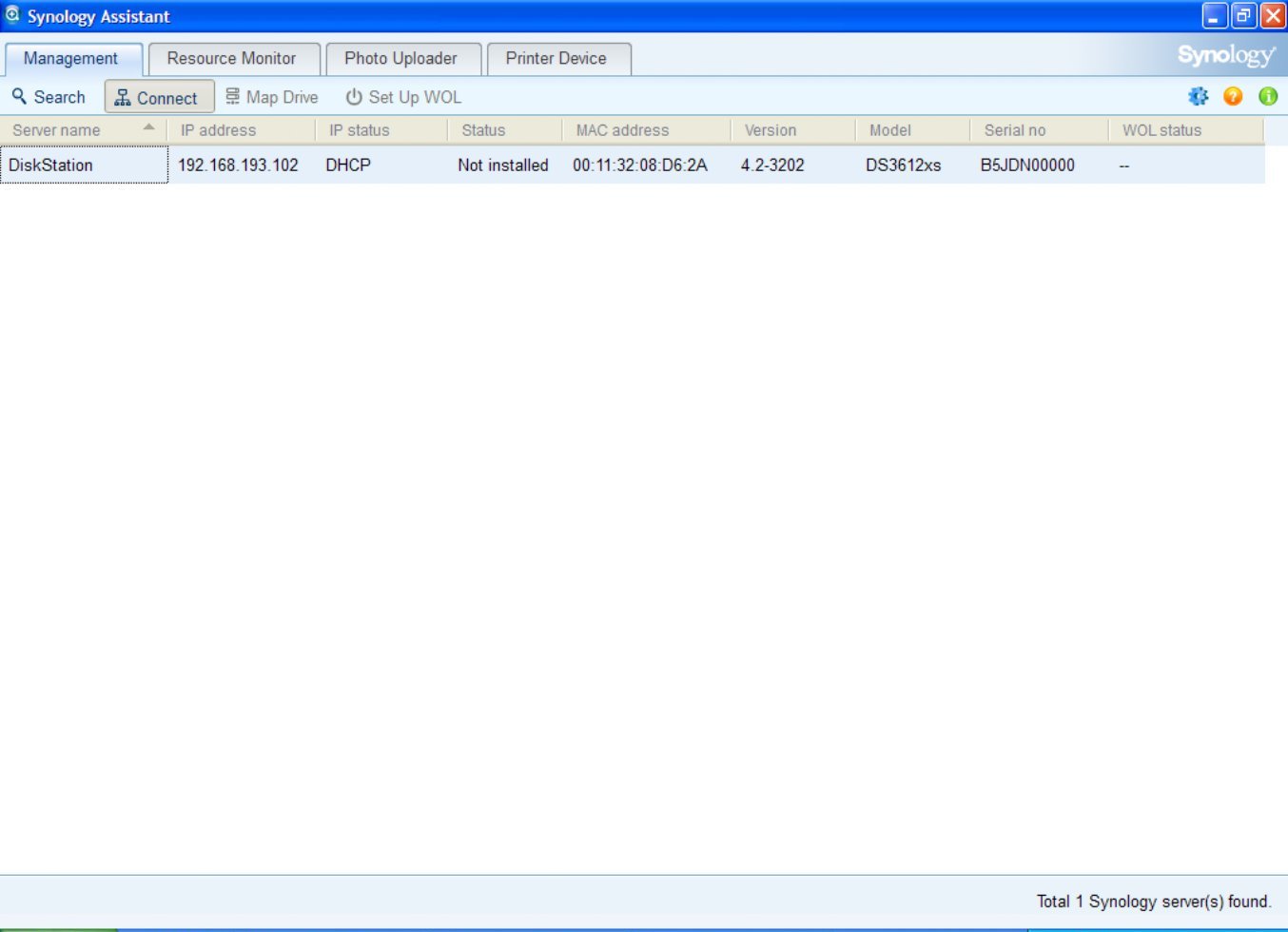

Запустите Synology Assistant и пусть он сканирует сеть на предмет новых NAS Synology.

Когда новый NAS будет найден, выберите и подключите его. Откроется новое окно веб-браузера.

Теперь вы увидите загрузку Synology Web Assistant.

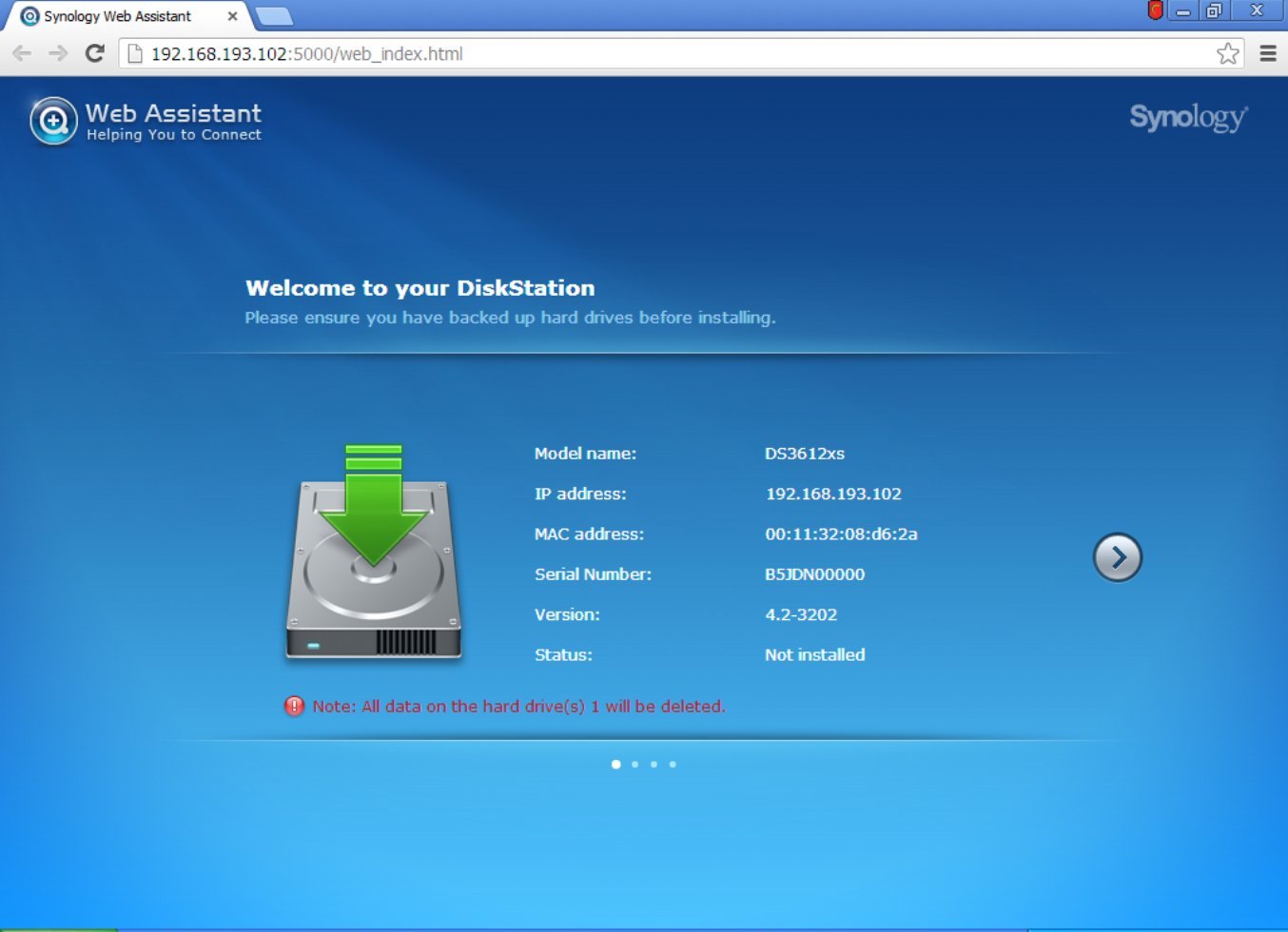

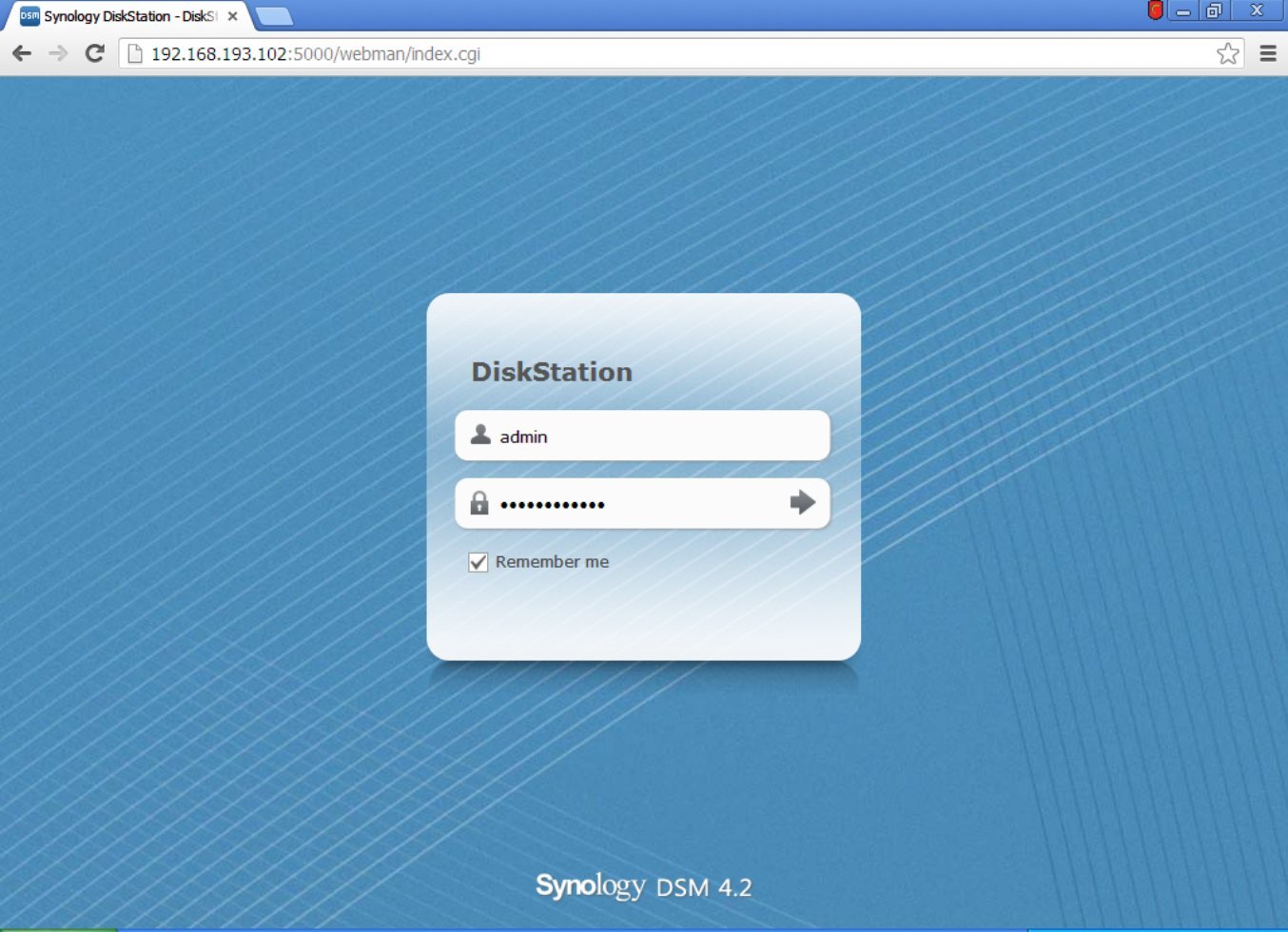

После загрузки, вас встретит новый сервер Synology DiskStation

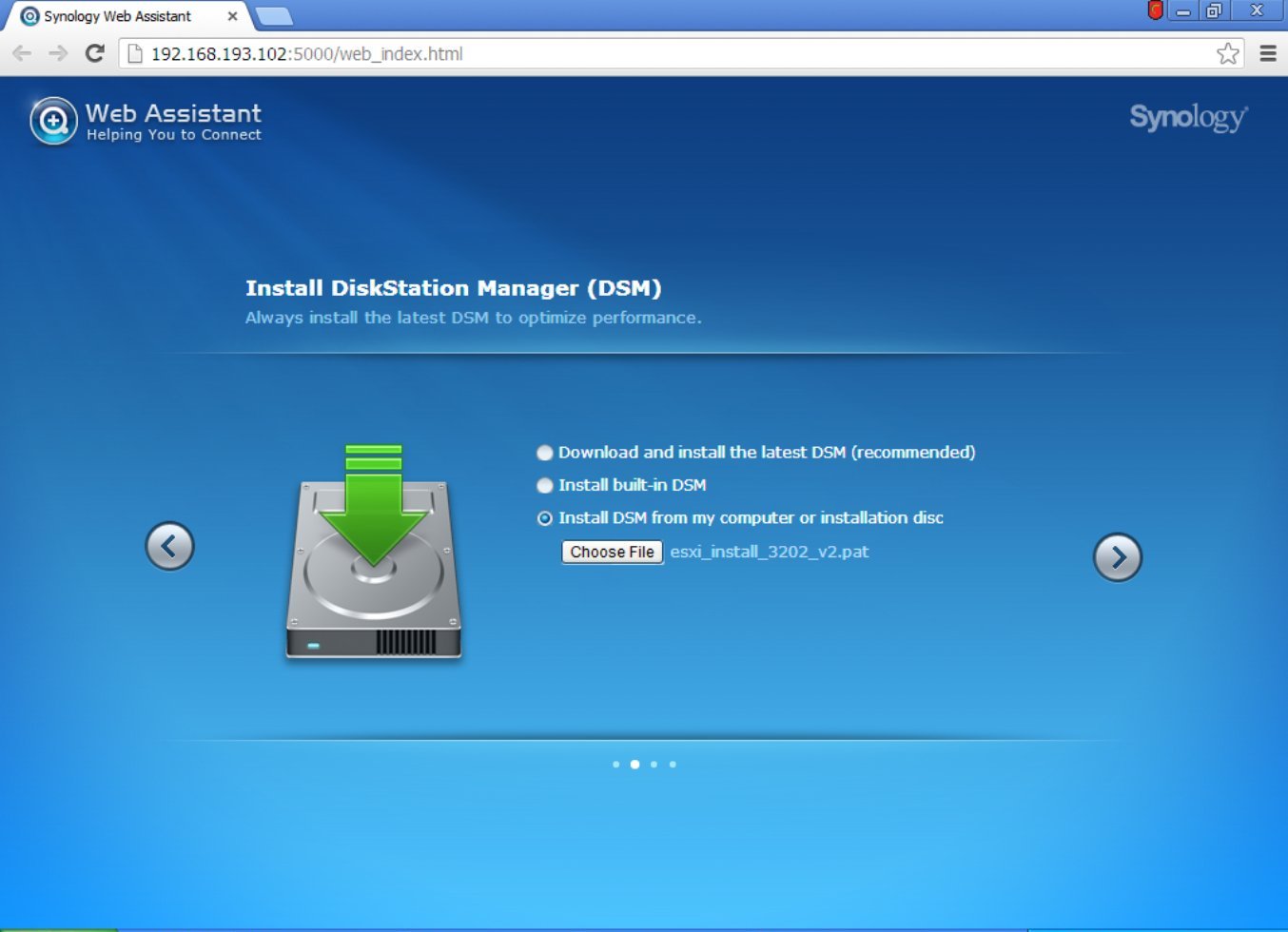

Выбрать — установка DSM с моего компьютера или установочного диска. Выберите esxi_install_3202_v2.pat файл из загруженного ранее архива.

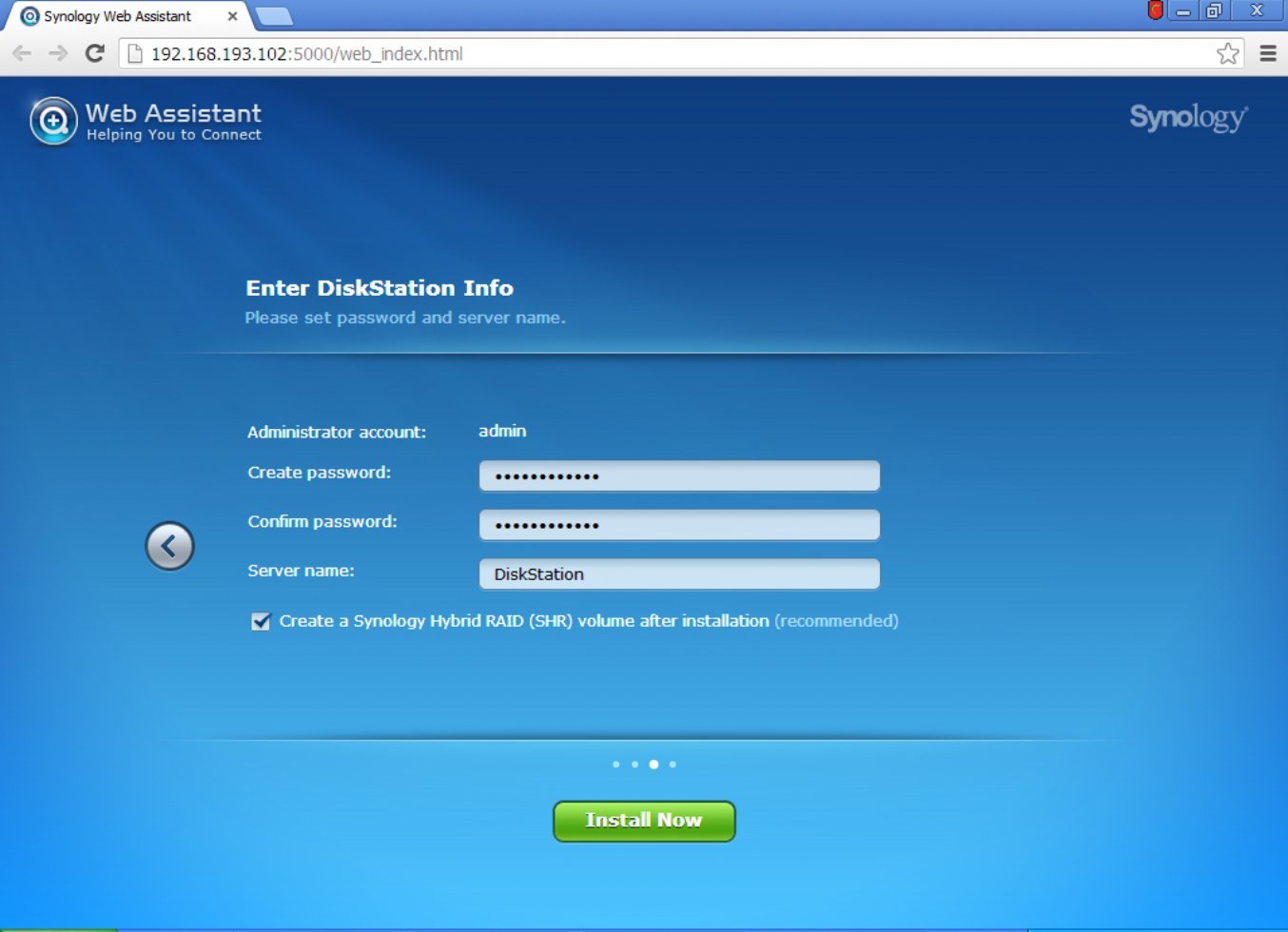

Дайте вашему новому DiskStation подходящее название и безопасный пароль администратора.

Вас предупредят, что установка сотрет все данные на прилагаемых дисках.

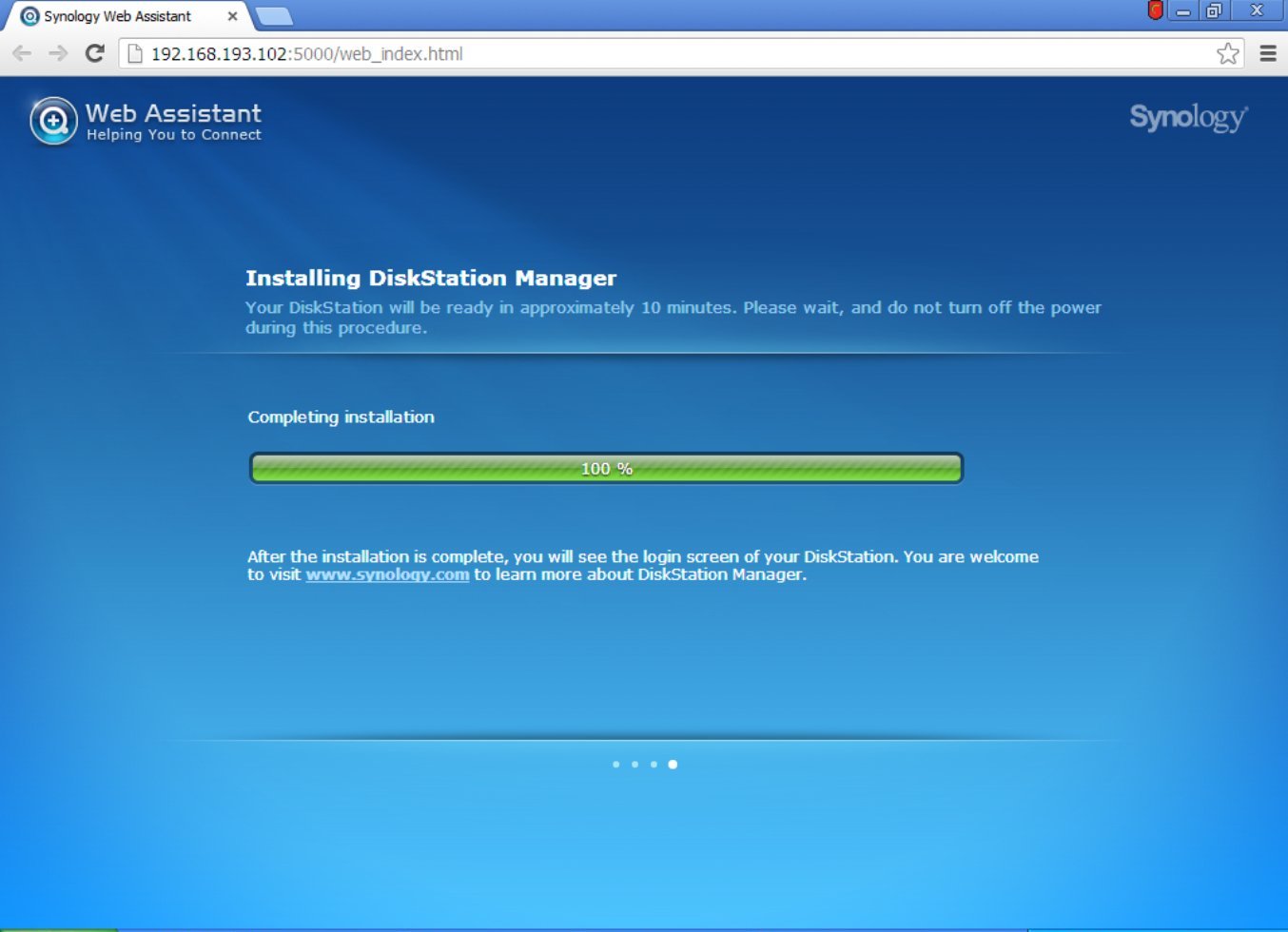

Диск(и) будет отформатирован, пакет DSM будет загружен и установлен.

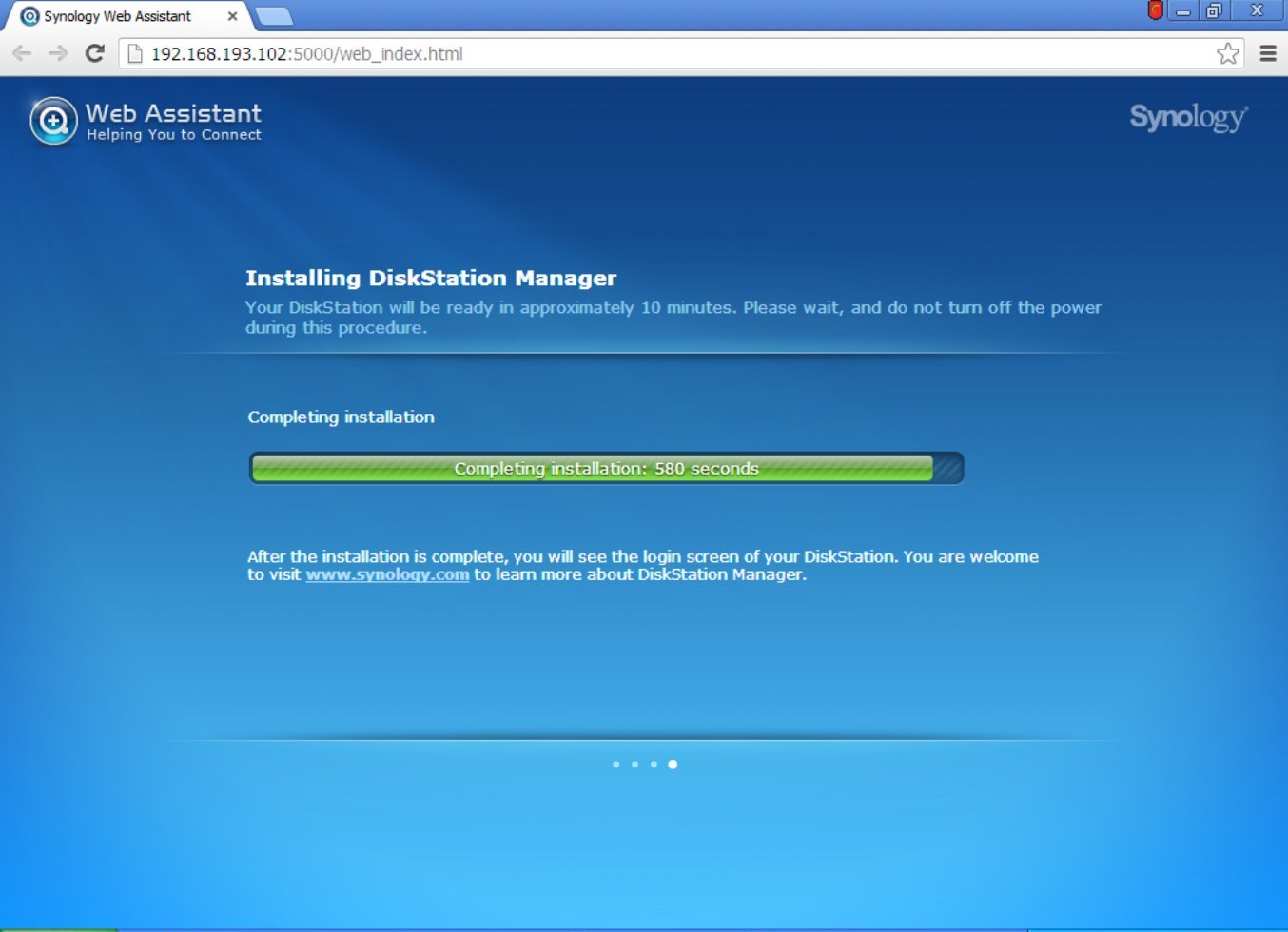

Когда это будет завершено, DiskStation сделает паузу для окончания конфигурации.

Затем он перезагрузится с новой установленной DSM 4.2, будьте терпеливыми (или посмотрите консоль ESXi).

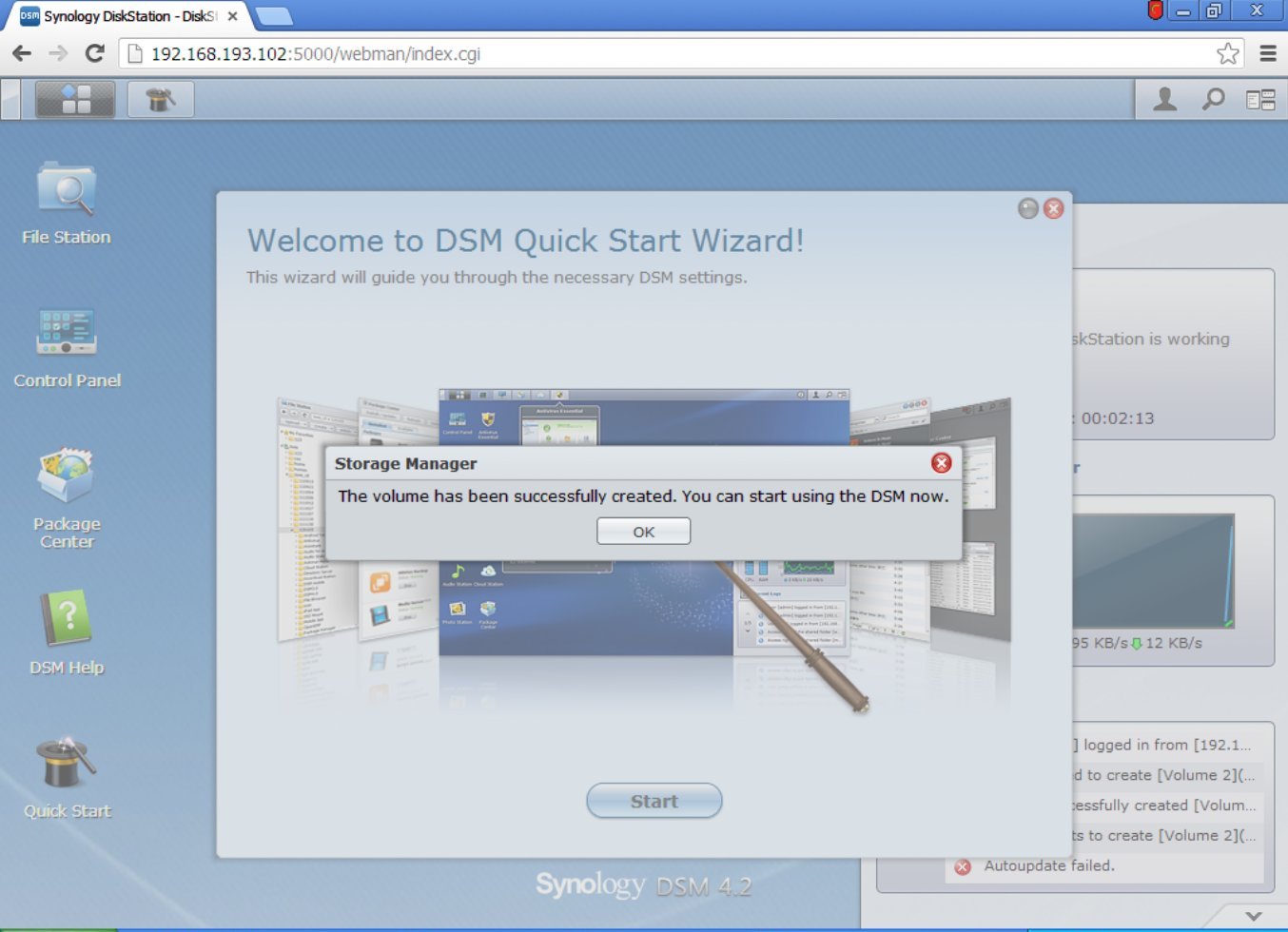

Теперь у вас есть работающий DiskStation!

Как обычно, просто завершите Мастер

И добро пожаловать на ESXi в новую виртуальную машину на основе Synology DiskStation!

21.11.2016

itpro

VMWare, Windows Server 2012 R2

комментария 2

В этой статье мы покажем, как подключить сетевой каталог, расположенный на Windows Server 2012 R2 как отдельное хранилище (datastore) на хосте VMware ESXi и использовать его для хранения файлов виртуальных машин и ISO образов. VMWare ESXi не умеет напрямую работать с общими папками Windows (по протоколу SMB), поэтому нам придется воспользоваться другим способом.

ESXi позволяет использовать в качестве датастора следующие типы хранилищ:

- Локальный диск или LUN на внешнем устройстве хранения, подключенном по Fibre Channel или iSCSI

- Network File System (NFS) –этот сетевой протокол преимущественно используется для удаленного доступа к файловой системе в среде Unix/Linux

Функционал NFS сервера в серверной платформе Microsoft появился еще в Windows Server 2003 R2, и до сих пор поддерживается и в Windows Server 2012 R2.

Совет. Использование каталога NFS в качестве хранилища файлов виртуальных машин VMWare рекомендуется только в тестовых, лабораторных и не критичных продуктивных средах.

Итак, нам в первую очередь нужно настроить NFS каталог на Windows 2012 R2 и подключить его в качестве хранилища на хосте ESXi. Предположим, у нас уже имеется сервер Windows с установленной ролью файловых служб (File and Storage Services). Чтобы установит функционал NFS сервера:

Совет. Установить фичу Server for NFS можно всего одной командой Powershell:

Далее нужно создать каталог Windows, который будет использоваться как точка монтирования NFS. В качестве примера, мы создали каталог c:\nfs (на самом деле это не лучшее место для создания общей папки, предпочтительнее отдельный диск, или папка с назначением жесткой квоты).

В консоли Server Manager перейдите в раздел File and Storage Services-> Shares. Запустите мастер создания нового ресурса (Tasks -> New Share) и выберите NFS Share-Quick. Укажите путь к каталогу и его имя. В нашем примере он называется nfs. В данном случае, полный NSF путь (путь к удаленной шаре), который будет использоваться в среде Unix для доступа к этому каталогу будет таким: msk-fs01:/nfs

На вкладке с типами аутентификации, отключите Kerberos аутентификацию, и выберите “No Server authentication” и “Enable unmapped user access”.

Ограничим доступ к каталогу по IP адресу хоста ESXi. Для этого укажем IP адрес сервера и предоставим ему права Read/Write и Allow root access.

Совет. Также доступ к NFS сервису можно ограничить с помощью Windows Firewall, ограничив доступ отовсюду, кроме определённых IP адресов или подсетей.

Создать общий каталог NFS и ограничить доступ к нему можно также с помощью PowerShell:

New-NfsShare -Name "NFS " -Path "c:\nfs" -AllowRootAccess $true -Permission Readwrite -Authentication sys

Grant-NfsSharePermission -Name “NFS” -ClientName 192.168.1.11 -ClientType host -LanguageEncoding ANSI

Итак, мы создали новый общий сетевой каталог NFS на Windows Server 2012 R2. Осталось подключить его в качестве хранилища на хосте VMWare ESXi.

Совет. Прежде, чем перейти к следующим шагам, убедитесь, что порт vmkernel настроен на вашем сервере ESXi.

После успешного добавления NFS хранилища, оно появится в списке доступных хранилищ хоста. Вы можете использовать это пустое хранилище для хранения файлов ВМ или ISO образов.

Предыдущая статья Следующая статья

Лицензирование VMware vSphere 6.5

Загрузка виртуальной машины VMware с USB диска или ISO образа

Оптимизация Windows для работы в среде виртуализации

Настройка автозапуска для виртуальных машин на VMware ESXi

Почему NFS только в тестовых средах?

какую файловую систему лучше использовать для архивов?

Рубрики сайта

Последние статьи

13.04.2022

itpro

VMWare, Виртуализация

Комментариев пока нет

В VMware vSphere вы можете использовать iSCSI диски в качестве общего дискового хранилища для ваших ESXi хостов. ESXi хост получает доступ к таким дискам по вашей локальной сети с помощью протокола TCP. В этой статье мы рассмотрим, как подключить iSCSI LUN с вашей СХД (или сервера) к хосту VMWare ESXi и создать на нам общее VMFS хранилище.

Предполагаем, что вы создали, настроили и опубликовали iSCSI таргет (диск) на вашей СХД (в Windows Server вы можете в качестве iSCSI таргет использовать виртуальный vhdx диск).

На СХД убедитесь, что вы разрешили подключение к вашему iSCSI таргету вашим ESXi хостам (iSCSI инициаторы). Доступ можно получить по IQN (как получить IQN iSCSI адаптера в ESXi показано ниже, по DNS имени, IP или MAC адресу.

В данном примере мы используем отдельно стоящий хост с ESXi 6.7 (можно использовать и бесплатный ESXi Hypervisor). Это может быть физический хост или виртуальная машина (например, вот пример использования ESXi с помощью nested virtualization в Hyper-V). На хосте есть два сетевых интерфейса (один будет использоваться для управления, второй для трафика к iSCSI LUN).

Создаем VMFS хранилище на iSCSI LUN в VMWare ESXi

Теперь на доступном iSCSI диске можно создать VMFS (Virtual Machine File System) хранилище для размещения файлов виртуальных машин.

Перейдите в раздел Storage -> Datastores -> New datastore.

Задайте имя VMFS хранилища и выберите iSCSI LUN, на котором его создать.

Выберите тип файловой системы VMFS 6 и укажите, что для хранилища нужно использовать весь объем iSCSI диска. Через несколько секунд новое VMFS хранилище станет доступно из ESXi.

Если на данном LUN уже создано VMFS хранилище, оно сразу появится в списке доступных Storage Devices хоста.

Итак, вы подключили iSCSI диск к вашему ESXi хосту и создали на нем VMFS хранилище. Это хранилище могут одновременно использовать несколько ESXi серверов. Теперь у вас есть общее хранилище, и если вы настроите VMware vCenter server, вы сможете использовать vMotion для перемещения запущенных ВМ между хостами.

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-01

Всем привет сегодня хочу рассказать как подключить NFS диск с Open-e 7 в VMware ESXI 5.5. Напомню NFS(Network File System) –это сетевая файловая система, позволяющая пользователям обращаться к файлам и каталогам, расположенным на удалённых компьютерах, как если бы эти файлы и каталоги были локальными. И если у вас вдруг нет FC или наоборот есть 10G ethernet карточки и свитчи и там и там лучше для ESXI настроить NFS, так как по сути любая виртуальная машина это просто набор файлов.

Для того чтобы подключить NFS диск, его сначала нужно создать. Логинимся на ваш Open-e 7. Переходим в пункт меню Confiruration-Volume manager-Volume groups

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-02

Выбираем new NAS volume, задаем его размера в гигабайтах и жмем apply

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-03

Видим наш диск lv0120 5 гигабайт создан

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-04

Далее идем Confiruration-NAS settings

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-05

Ищем пункт NFS settings и ставим галку Use NFS. Жмем apply.

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-06

Следующим шагом будет Confiruration-NAS resources-Shares

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-07

Зададим название для данной share и нажмем apply

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-08

Далее щелкаем слева по нашей созданной шаре и в пункте SMB settings можно убрать галку Visible, чтобы шара была не видимая и ставим Guest (anyone without password), чтобы при доступе не запрашивался логин и пароль

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-09

после этого идем в пунктNFS share access и ставим галку Use NFS в полях Allow access IP и Allow write IP задаем ip адрес ESXI хоста к которому будет подключаться NFS диск.

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-10

Переходим на ваш хост VMware ESXi 5.5 раздел Configuration-Storage и жмем Add storage

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-11

Выбираем Network File System и жмем next

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-12

Указываем в пункте Server ip адрес или DNS имя сервера NFS. В Folder задаем путь к NFS диску, ну и в Datastore Name, указываем имя нашего datastore.

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-13

Смотрим сводную информацию и жмем next.

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-14

Видим, что все отлично подключилось.

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-15

Как подключить NFS диск с Open-e 7 в VMware ESXI 5.5-16

Вот так вот просто подключить NFS диск с Open-e 7 в VMware ESXI 5.5. так же советую обратить внимание на Как подключить NFS диск с Windows Server 2012 R2 в VMware ESXI 5.5

Эксплуатация технически сложного оборудования, типа систем хранения данных, подразумевает наличие у администратора определенных навыков. Однако высокие технологии шагают в массы. И, соответственно, растет число пользователей, впервые столкнувшиеся с ними. Уверены, что статьи в стиле How To являются отличным способом пополнить багаж знаний как для новичков, так и узнать нюансы и особенности для опытных пользователей.

В данной статье мы рассмотрим порядок подключения СХД Qsan к гипервизору VMware ESXi, а также по возможности дадим практические советы по тюнингу настроек для достижения максимальной эффективности использования оборудования.

В рамках данной статьи мы рассмотрим процессы подключения СХД Qsan с использованием блочных протоколов доступа iSCSI и Fibre Channel. Условно в процессе подключения можно выделить несколько основных этапов:

- Физическая и логическая коммутация

- Действия на стороне СХД

- Действия на стороне хоста(ов)

В статье приведены скриншоты настройки гипервизоров ESXi 6.7 под управлением vSphere. В случае Standalone ESXi пункты меню могут называться чуть иначе и ряд настроек отсутствовать.

Физическая и логическая коммутация

Совокупность оборудования и линий связи между СХД и серверами образуют так называемую SAN сеть. Отказоустойчивое подключение участников SAN сети подразумевает постоянное наличие хотя бы одного пути между инициатором (хост) и таргетом (СХД). Т.к. СХД сейчас практически поголовно имеют минимум два контроллера, каждый сервер должен иметь связь с каждым из них. В простейшем варианте серверы подключаются к СХД напрямую. Такой режим работы называют Direct Attach. СХД Qsan поддерживают такой режим работы. В этом случае каждый сервер должен иметь двухпортовую HBA для соединения с каждым контроллером СХД. Т.е. между сервером и СХД будет 2 пути. При наличии максимального количества опциональных портов в таком режиме к СХД можно подключить до 10 серверов через iSCSI или до 8 серверов через Fibre Channel.

В большинстве случаев серверы соединяются с СХД через коммутаторы. Для большей надежности их должно быть два (в общем случае их, конечно же, может быть больше, но это они все равно делятся на две группы – фабрики). Этим выполняется защита от выхода из строя самого коммутатора, линка и порта контроллера СХД/HBA. В этом случае каждый сервер и каждый контроллер СХД подключается к каждому коммутатору. Т.е. между каждым сервером и СХД будет 4 пути (в случае двух коммутаторов).

Важные замечания по поводу параметров SAN сети:

- Фабрики между собой не соединяются для изоляции в случае возникновения ошибок в сети;

- Если протокол iSCSI делит использование коммутаторов с другими сервисами, то весь трафик iSCSI должен быть помещен в изолированный VLAN;

- Для протокола Fibre Channel необходимо настроить в коммутаторах зонирование по принципу «один инициатор – один или несколько таргетов» для исключения взаимовлияния серверов друг на друга;

- Для iSCSI соединений со скоростью 10G и выше рекомендуется включить поддержку кадров большого размера (MTU=9000) с целью увеличения производительности. Важно помнить, что необходимо изменить MTU у всех участников сети: порты контроллера СХД, физические коммутаторы, виртуальные коммутаторы vSwitch, порты vKernel.

Для Qsan параметр MTU меняется на каждом порту каждого контроллера в меню iSCSI Ports

Для ESXi параметр MTU меняется у vSwitch: хост → Configure → Virtual Switches → Edit для конкретного коммутатора

Для vKernel параметр MTU меняется хост → Configure → Virtual Switches → Edit Settings для конкретного порта

Для получения инструкций по изменению MTU у физических коммутаторов рекомендуем обратиться к документации конкретного производителя.

Настройка программного iSCSI адаптера в VMWare ESXi

По умолчанию в ESXi отключен программный адаптер iSCSI. Чтобы включить его, перейдите в раздел Storage -> Adapters. Нажмите на кнопку Software iSCSi.

Измените iSCSI enable на Enabled.

Обратите внимание, что здесь также указан IQN вашего iSCSI адаптера(инициатора), который можно использовать при настройке доступа к iSCSI LUN на СХД).

Затем в секции Dynamic targets добавьте IP адрес вашего iSCSI хранилища и порт подключения (по-умолчанию для iSCSI трафика используется порт TCP 3260). ESXi просканирует все iSCSI таргеты на этом хосте и выведет их в списке Static Targets.

Сохраните настройки. Обратите внимание, что на вкладке Storage -> Adapters появился новый HBA vmhba65 типа iSCSI Software Adapter.

Если ESXi хост подключен к vCenter, чтобы добавить iSCSI LUN, перейдите в раздел Configure -> Storage –> Storage Adapters. Выберите Software iSCSI adapter и укажите на вкладке Dynamic Discovery имя или IP адрес вашего iSCSI хранилища. Выполните Rescan. Список доступных iSCSI таргет должен появится на вкладке Static Discovery.

Если вы не видите список iSCSI таргетов на СХД, можно продиагностировать доступность iSCSI диска через консоль ESXi.

Включите SSH на VMware ESXi хосте и подключитесь к нему с помощью любого SSH клиента (я использую встроенный SSH клиент Windows 10)

С помощью следующей команды можно выполнить проверку доступности вашего iSCSI хранилища (192.168.13.10) с указанного vmkernel порта (vmk1) :

В этом примере iSCSI хранилище отвечает на ping.

Теперь нужно проверить, что на хранилище доступен iSCSI порт TCP 3260 (в этом примере 192.168.13.60 это IP адреса интерфейса vmk1):

Проверьте, что на хосте включен программный iSCSI:

Если нужно, включите его:

Также можно получить текущие параметры программного HBA адаптера iSCSI:

Действия на стороне СХД

Необходимые настройки на СХД можно разделить на два этапа:

- Настройка интерфейсов

- Настройка пространства хранения

Настраивать интерфейсы требуется в основном в случае использования протокола iSCSI: необходимо задать IP адреса портов на вкладке iSCSI Ports. IP адреса портов должны быть из разных подсетей, чтобы однозначно маршрутизировался трафик на стороне хоста.

В случае использования интерфейса Fibre Channel ничего настраивать, как правило, не нужно.

Далее необходимо создать пространство хранения. Сначала создается пул – группа физических накопителей, работающих совместно. Пулов в пределах СХД может быть несколько. Накопители внутри пула объединяются в соответствии с выбранным при его создании уровнем RAID, обеспечивая заданную надежность. Пулы создаются на вкладке Pools → Create Pool, где запускается пошаговый мастер.

- Необходимо выбрать тип пула: thick (место выделяется сразу) или thin (место выделяется по мере заполнения). Отметим, что thick пулы являются более производительными.

- Выбрать конкретные диски

- Уровень RAID

- Указать параметры физических накопителей, влияющие на их производительность. Рекомендуется использовать установки по умолчанию для максимальной скорости:

- Enable Disk Write Cache

- Enable Disk Read-ahead

- Enable Disk Command Queuing

- Disable Disk Standby

![]()

![]()

![]()

![]()

Помимо обычных пулов Qsan поддерживает создание AutoTiering пулов при условии активации соответствующей лицензии. С принципом работы таких пулов можно ознакомиться в отдельной статье.

После создания пула(ов) необходимо создать тома (volume): Volumes → Create volumes. Также запустится пошаговый мастер создания тома.

![]()

![]()

Необходимо задать требуемый размер тома, тип тома выбирается как RAID volume. На свойствах остановимся подробнее.

- Block Size – размер блока, который будет эмулироваться для хоста. Для ESXi он должен быть 512 байт в силу требований VMware. В противном случае такой диск нельзя будет подключить к ESXi. СХД не сможет установить размер блока меньше, чем у физических накопителей. Поэтому нельзя использовать в СХД диски с разметкой 4Kn (блок 4КБ) совместно с VMware. Требуются накопители 512n или 512e.

- Background I/O Priority – приоритет фоновых задач (расширение, миграция и пр.)

- Erase Volume Data – необходимость зануления создаваемого тома. Значение Fast Erase соответствует записи нулей в первый гигабайт пространства, может быть полезно при повторном использовании дисков с целью удалить остатки предыдущих данных (стереть таблицы размещения). Full Erase – запись нулей по всему объему, полезно для достижения максимальной производительности в случае использования RAID 1/10.

- Enable Cache Mode (Write-back Cache) – включение кэша СХД. Очень сильно влияет на производительность.

- Enable Video Editing Mode – снижение производительности ради более стабильных результатов. Для использования совместно с VMware лучше выключить.

- Enable Read-ahead – включение упреждающего чтения. Положительно влияет на производительность.

- Enable Fast RAID Rebuild – при активации данной настройки система будет вести трекинг всех записываемых блоков, чтобы понимать, сколько реальных данных записано на том. В случае выхода из строя диска в составе RAID группы во время ребилда не будут копироваться пустые блоки, что может ускорить данный процесс. Однако стоит помнить, что использование Fast Rebuild снижает производительность при случайном доступе.

Заключительным этапом в настройке СХД является публикация томов для доступа к ним со стороны хостов через функционал LUN mapping → Map LUN.

![]()

![]()

- Необходимо выбрать протокол доступа: FCP (Fibre Channel) или iSCSI. Доступ к одному и тому же тому может быть только через один протокол.

- Allowed Host – список хостов, которым разрешен доступ к тому. По умолчанию разрешено всем (*). Однако рекомендуется всегда явно указывать разрешения для исключения конфликтов доступа и, соответственно, повреждения файловой системы. Для Fibre Channel указываются WWPN хостов (с возможностью выбора из всех доступных в SAN сети). Для iSCSI указываются IQN хостов. В случае нескольких хостов они добавляются по кнопке Add Host. Со стороны ESXi значения WWPN и IQN можно узнать на вкладке Хост → Configure → Storage adapters

![]()

- LUN – ID с которым том будет виден хостам. Также по этому идентификатору легко опознать том со стороны сервера. Для корректной работы кластера VMware LUN ID должен быть одинаковым для одного и того же тома для всех узлов кластера.

Действия на стороне хоста

При использовании протокола iSCSI необходимо выполнить:

- один раз добавить Software iSCSI адаптер, если этого не было сделано ранее: Хост → Configure → Storage adapters → Add Software Adapter.

- Создать отдельные vKernel для работы с iSCSI (минимум два – для связи с каждым контроллером СХД). Можно подключить их на существующий vSwitch, но желательно подключить на отдельный, не имеющий Port Group с виртуальными машинами с целью упрощения администрирования. У данного vSwitch должно быть минимум 2 физических линка для отказоустойчивости. vKernel следует назначить IP адреса из разных подсетей, чтобы хост мог однозначно маршрутизировать трафик. Также очень важно для каждого vKernel изменить параметр Failover таким образом, чтобы он использовал только один физический линк, т.к. VMware не поддерживает Teaming для iSCSI. В итоге должно получиться следующее:

Установки Failover меняются через изменение настроек Port Group

![]()

![]()

- В свойствах Software iSCSI Initiator необходимо указать адреса таргетов, т.е. СХД на вкладке Dynamic Discovery должны быть введены все используемые IP адреса контроллеров СХД

![]()

- После любого изменения параметров СХД и SAN сети необходимо выполнить Rescan: Хост → Storage Adapter → Rescan Storage. Итогом будет появление (т.к. мы добавляем новый том) нового устройства, доступного по 4 путям (согласно топологии подключения через два коммутатора в Dynamic Discovery указано 4 IP адреса портов СХД) с LUN как мы и задавали при публикации на СХД.

![]()

При использовании протокола Fibre Channel все гораздо проще: достаточно выполнить Rescan для обнаружения нового тома. В нашем примере это том с LUN доступный по 4 путям (по 2 на каждом порту HBA).

Следующим шагом будет создание Datastore на новом томе: Хост → Actions → Storage → New Datastore.

По умолчанию VMware использует политику работы с многопутевыми устройствами как Most Recently User (MRU). Для большей эффективности и повышения производительности необходимо для каждого Datastore изменить политику на Round Robin, при которой все доступные пути до СХД будут использоваться равномерно. Политика меняется в меню Хост → Storage Devices → Наше Устройство → Properties → Edit Multi-Path. После применения политики Round Robin все пути будут использоваться для ввода/вывода (Active I/O).

![]()

![]()

В случае использования кластера из нескольких хостов ESXi действия, описанные выше, необходимо повторить на каждом из хостов кроме создания нового Datastore. Т.к. Datastore уже был создан ранее, он появится у остальных членов кластера после выполнения команды Rescan.

В рамках данной статьи конечно же были рассмотрены далеко не все операции, необходимые для каждодневного взаимодействия серверов ESXi и СХД Qsan. Более полная информация содержится в обязательных для ознакомления руководствах пользователей обоих вендоров.

Настройка сети для iSCSI трафика в VMWare ESXi

Сначала нужно создать отдельный VMkernel сетевой интерфейс, который будет испоьзоваться ESXi хостом для доступа к iSCSI хранилищу. Перейдите в раздел Networking -> VMkernel NICs -> Add VMkernel NIC.

![добавить vmkernel порт в esxi]()

Кроме vmk порта нужно сразу создать новая группа портов (New port group). Укажите имя для этой группы – iSCSI и назначьте статический IP адрес для вашего интерфейса vmkernel.

![vmk порт для iscsi трафика в esxi]()

Теперь перейдите в настройки вашего стандартного коммутатора vSwitch0 (Networking -> Virtual Switches). Проверьте, что второй физический интерфейс сервера vmnic1 добавлен в конфигурацию и активен (если нет, нажмите кнопку Add uplink и добавьте его).

![добавить uplink в vmware esxi]()

Проверьте в секции Nic Teaming что оба физических сетевых интерфейса находятся в статусе Active.

![активные uplink сетевые адаптеры]()

Теперь в настройки группу портов iSCSI вам нужно разрешить использовать для iSCSI трафика только второй интерфейс. Перейдите в Networking -> Port groups -> iSCSI —> Edit settings. Разверните секцию NIC teaming, выберите Override failover order = Yes. Оставьте активной только vmnic1, порт vmnic0 переведите в состояние Unused.

![отключить management аплинк для iscsi port groups]()

В результате ваш ESXi хост будет использовать для доступа к вашему iSCSI LUN только один интерфейс сервера.

Читайте также: