Влияет ли видеокарта на быстродействие компьютера

Поговорим с тобой на важнейшую тему для геймера. Да, именно для геймера. Дело в том, что мы поговорим о игровом компьютере. То есть сборке для игр. Ведь игры уже стали неотъемлемой частью нашей культуры. И графика с каждым годом становится всё круче. Тем более всё чаще в новостях проскакивают игры под VR, хотя до масштабного и бытового VR ещё далеко. Слишком дорого для нормального жителя нашей страны.

А может быть я заблуждаюсь, а? И он не такая уж и редкость? Что скажете? У Вас есть шлем виртуальной реальности? Расскажите в комментариях.

О VR речь, в полной мере, не пойдёт. Поговорим о простом гейминге.

Видеокарта и профессиональные приложения

Обойтись встроенной в процессор графикой можно в офисных редакторах, бухгалтерских программах. Инструменты для работы с графикой (и 2D, и 3D) могут поддерживать ускорение GPGPU (вычисления общего назначения). К примеру, такая функция есть в Adobe Photoshop, Media Encoder и Premiere, AutoCAD, Sony Vegas и других профессиональных приложениях.

Разница в скорости кодирования с использованием GPU и без

Уточните на сайте разработчиков вашего инструмента, используются ли технологии CUDA, GPGPU, OpenCL и других методик аппаратного ускорения с помощью GPU. Если таковые имеются – видеокарта столь же важна, как и процессор, потому что она способствует более скоростной работе софта. Особенно это заметно в тяжелых проектах, которые даже мощным Core i7 или Ryzen 7 даются не без напряга.

Если ваши рабочие инструменты не умеют использовать графику для вычислений – то мощный процессор гораздо важнее. Условный Core i7, со встроенной или самой дешевой графической картой, предпочтительнее связки из i5 и флагманского игрового GPU.

Вывод

Для простых задач мощная графическая карта ни к чему. Профессиональный софт уже требует глубже вникнуть в специфику и определить, насколько важны функции GPGPU и мощность графики в конкретном инструменте. Поэтому тут единого ответа, что важнее, процессор или видеокарта, дать нельзя.

Если говорить о сугубо геймерской машине – FPS гораздо сильнее зависит от мощности графики, чем ядер ЦП. Так что, если необходимо выбирать, на чем экономить – лучше купить более доступный процессор. Это рациональнее с точки зрения бюджета. Но вдаваться в крайности не нужно, так как видеокарта хоть и важнее, но с дешевым двухъядерным ЦП тоже «каши не сваришь».

После центрального процессора (ЦП) графический процессор (ГП) оказывает наибольшее влияние на производительность игрового ПК. Графический процессор состоит из дополнительного процессора, который берет данные от ЦП и преобразует их в изображения, которые можно отображать на вашем дисплее. Другими словами, когда вы играете в игру, GPU выполняет большую часть тяжелой работы.

Чем мощнее графический процессор (иногда называемый видеокартой), тем больше информации может быть рассчитано и отображено за более короткое время и тем лучше будет ваш игровой процесс в целом.

Графические процессоры важны, но как узнать, какой из них выбрать? Существует широкий выбор вариантов графических процессоров от разных производителей, и может быть не сразу ясно, какой из них лучше всего соответствует вашим потребностям. Знание основ их работы и различий между ними может облегчить принятие этого решения.

Когда видеокарта не важна

Начать стоит с перечисления ситуаций, в которых без дискретной графики можно обойтись. Современные интегрированные решения способны полноценно справляться с задачами в веб-браузинге, работе с документами. Встроенный аппаратный декодер позволяет смотреть фильмы в разрешении 4К, не нагружая процессор. Поэтому в недорогом неигровом компьютере присутствие дискретной видеокарты необязательно.

Со старыми играми, выпущенными года так до 2012, встроенные ГП тоже справляются. Если на компьютере не предполагается играть в новые игры, и лишь иногда рубиться в классику – можно не покупать дискретный GPU, положившись на встроенный чип. В случае с ноутбуком такое решение – даже плюс, потому что модели без дискретного ГП дешевле, надежнее, меньше греются и лучше держат заряд.

Насколько процессор важен в играх

В играх важен баланс в сочетании процессора и видеокарты. Ведь если ЦП не успевает подавать информацию для обработки ГП – потенциал карты будет не раскрыт. Если процессор, наоборот, мощный, а видео – посредственное, он не даст ощутимой прибавки в FPS.

Условная связка из Intel Core i9 или AMD Ryzen 7 и Nvidia GTX 1060 в играх окажется всего на чуточку быстрее, чем связка той же видеокарты с Core i5 или Ryzen 3. Эта разница будет столь мизерной, что на глаз вы ее не увидите. А вот тандем из i5 и GTX 1070 выйдет мощнее (и дешевле), чем i9 и GTX 1060. То есть, в играх мощная видеокарта все-таки важнее.

Важность GPU вовсе не значит, что процессором можно пренебречь. С условным Core i3 или Ryzen 3 потенциал RTX 2080 Ti окажется не раскрыт полностью, переплата за флагманский GPU будет бессмысленной.

Опыт тестов и исследований показывает, что оптимальной является связка, в которой GPU по маркетинговому рангу равен или чуть выше процессора. То есть, к бюджетно-средней GTX 1060 подойдет ЦП вроде Ryzen 3 или Core i3 с 4 ядрами, к среднему классу наподобие GTX 1070 – Core i5 или Ryzen 5, а к флагману уровня RTX 2080 Ti – что-то из i7 или Ryzen 7.

Тратиться на Core i9 для игр смысла почти нет. Эти чипы дают мизерный прирост FPS в сравнение с i7, но сильно удорожают сборку ПК. Такие процессоры – решения рабочие, а не геймерские, и топовая видеокарта с предтоповым ЦП – сочетание куда более удачное, чем предтоповый ГП с флагманским процем.

Сборки вида «Core i9 + RTX 2060» являются и вовсе дисбалансными для геймера. ПК с процессором Core i7-8700 или Ryzen 7 2700 и графикой GeForce RTX 2060 в играх окажется всего на какие-то проценты медленнее, чем с i9-9900X, но дешевле на тысячу долларов. Все потому, что играм пока без особой нужды больше 8 ядер, а хорошая видеокарта важнее.

Помимо того, что флагманские чипы гораздо дороже моделей уровнем ниже, с их использованием растут и сопутствующие расходы. К примеру, самая бюджетная плата для Core i7-8700 или Ryzen 7 2700 стоит около $60, для i9-9900X – около $300. То же самое и с кулером, который для чипа числом ядер больше 10 обойдется недешево.

Наконец, при росте энергопотребления понадобится более мощный БП. Ведь связка i7-8700 и RTX 2060 имеет суммарный TDP примерно на треть ниже, чем i9-9900X и та же RTX 2060. Если для первой конфигурации хватит и «бронзового» блока питания ватт на 500-600, то второй необходимо нечто посолиднее.

Видеокарты для игр

Игровая индустрия сыграла важную роль в развитии технологии графических процессоров. Сегодняшние компьютерные игры более реалистичны и сложны, чем когда-либо прежде, и растущая производительность современных графических процессоров является одновременно и одной из причин этого, и ответом геймерам, требующим более привлекательных и сложных игр.

Проще говоря, если вы собираете ПК для игр, то GPU будет вашей самой важной покупкой. Другие компоненты, такие как ЦП, хранилище и ОЗУ, также могут влиять на производительность, но графический процессор имеет самую прямую связь с тем, что вы видите на экране во время игры.

Однако существует множество различных игр, и не все из них требуют самого мощного графического процессора на рынке. Вот почему важно ознакомиться с требуемыми, рекомендуемыми и оптимальными характеристиками игры, чтобы убедиться, что вы приобрели подходящий графический процессор.

Покупка лучшего графического процессора, который вы можете себе позволить, — это хороший способ защитить свою сборку в будущем и подготовить ее для запуска популярных игр, которые еще не выпущены. Тем не менее, если вы точно знаете, в какие игры хотите играть, небольшое исследование идеального графического процессора для запуска этой игры — отличный способ начать процесс покупок.

Видеокарты для работы

Те, кто использует свои ПК для сложных задач, таких как 3D-рендеринг, разработка игр и редактирование видео, также получают выгоду от более быстрых графических процессоров. Высокопроизводительные приложения, такие как AutoCAD и Adobe Premiere Pro, могут использовать графические процессоры для ускорения обработки и ускорения и повышения эффективности рабочих процессов.

Вот почему существует целый сегмент графических процессоров, разработанных специально для профессионалов. Эти графические процессоры для рабочих станций оптимизированы для этих приложений, а их драйверы сертифицированы как стабильные и надежные при выполнении этих операций. Видеокарты профессионального класса могут быть чрезвычайно мощными и часто дороже, чем даже высокопроизводительные игровые графические процессоры, но, поскольку они не были разработаны специально для игровых нагрузок, они, вероятно, не идеальны для игрового ПК. Поэтому самый дорогой графический процессор не всегда лучше, и важно выбирать графический процессор в зависимости от того, как вы планируете его использовать, а не исключительно по цене.

В этом руководстве мы сосредоточимся на более популярных видеокартах, ориентированных на игры. Если вам нужен графический процессор для запуска профессиональных приложений, вы, вероятно, будете искать лучшие варианты за пределами обычного рынка потребительских графических процессоров. Серия Nvidia Quadro или линейка AMD Radeon Pro — отличные стартовые позиции.

Хотя графические процессоры профессионального уровня предназначены для других целей, многие фундаментальные концепции по-прежнему применимы.

Универсальные видеокарты

Если вы не играете в игры или не используете требовательные профессиональные приложения, которые могут использовать графический процессор для ускорения работы, вам может не понадобиться вкладывать столько денег в свою видеокарту. Если вы в основном используете приложения для повышения производительности, просматриваете веб-страницы, управляете электронной почтой и выполняете другие задачи с низким уровнем ресурсов, то выбор правильной оперативной памяти, процессора и хранилища должен быть более приоритетным.

Графических возможностей, встроенных в процессор вашей системы, вероятно, достаточно, и вам, скорее всего, не потребуется отдельный графический процессор.

Крупнейшие производители видеокарт

А теперь давайте поговорим о двух крупнейших игроках в сфере игровых графических процессоров (по крайней мере, на данный момент): Nvidia и AMD.

Когда вы покупаете графический процессор, вы выбираете между видеокартами, которые включают в себя все компоненты, необходимые для рендеринга изображения на ваш дисплей. Эти карты включают в себя решения для охлаждения, необходимые соединения и, самое главное, сам графический процессор. Этот процессор представляет собой невероятно сложный чип, разработанный в результате десятилетий исследований и экспериментов. Поскольку входной барьер для создания этих процессоров очень высок, вполне вероятно, что любой купленный вами графический процессор будет произведен одной из двух компаний: Nvidia или AMD.

Исторически сложилось так, что эти две компании боролись за лидерство на рынке графических процессоров, постоянно заставляя друг друга внедрять инновации на благо потребителей. У обеих есть сильные стороны, и обе предлагают надежные варианты. Что бы вы ни выбрали, вы сможете найти карту, соответствующую вашим игровым потребностям.

При покупке видеокарты вы чаще всего будете выбирать из моделей, произведенных не Nvidia и AMD, а такими компаниями, как ASUS, GIGABYTE и MSI. Эти компании берут чипы, разработанные AMD или Nvidia, и создают свои собственные графические карты с использованием этой технологии.

Думайте об этом как о машине: двигатель создан AMD или Nvidia, но остальная часть автомобиля, включая корпус и охлаждение, разработана компанией, которая производит саму карту. Другими словами, если вы покупаете графический процессор ASUS, это все равно чип Nvidia или AMD в корпусе, разработанном ASUS. Каждый производитель графических процессоров предлагает свои собственные уникальные варианты дизайна и технологии, что приводит к множеству вариантов на выбор.

Модель графического процессора (например, Nvidia RTX 3080) относится к самому фактическому процессору, и это то, что говорит вам о том, какое место занимает графический процессор в общем спектре производительности. Есть и другие соображения, такие как охлаждение, тактовая частота и эстетический дизайн, которые могут повлиять на производительность, но если вы покупаете RTX 3080, то вы знаете основные возможности карты независимо от производителя.

Компьютер - это сложно?

Как Вы знаете или просто догадываетесь, что компьютер состоит из разных комплектующих.

В его состав входят:

- Корпус

- Блок питания

- Жёсткий (HDD) или твердотельный накопитель(SSD)

- Оперативная память

- Материнская плата

- Процессор

- Охлаждение для процессора

- Видеокарта (не всегда, но для игрового пк обязательна)

Возможно что-то ещё, но основное всё перечислено.

12 мифов о видеокартах, про которые пора забыть

В предыдущих статьях мы поговорили про мифы о процессорах, оперативной памяти и материнских платах, теперь же перейдем к видеокартам, которые уже давно стали обязательной частью любого компьютера.

Первый миф. Чем больше видеопамяти — тем быстрее видеокарта

Казалось бы, это логично — в более мощные видеокарты ставится больше памяти: так, GTX 1070 с 8 ГБ памяти быстрее, чем GTX 1060 с 6 ГБ, а GTX 1080 Ti с 11 ГБ быстрее GTX 1080 с 8 ГБ. Однако следует понимать, что видеопамять, конечно, важна, но зачастую различное ПО не использует всю имеющуюся у видеокарты память: так, в большинстве случаев GTX 1060 с 3 ГБ медленнее версии с 6 ГБ всего на 5-10%, и разница в основном идет из-за различного числа CUDA-ядер.

Но есть производители видеокарт, которые решили воспользоваться этим мифом в свою пользу: так, например, на рынке можно найти GT 740 с 4 ГБ GDDR5 памяти. Казалось бы — да у GTX 780 Ti, топовой видеокарты того поколения, всего 3 ГБ памяти — то есть GT 740, получается, лучше? Разумеется нет — на тех настройках графики, где используется столько памяти, эта видеокарта выдает слайд-шоу. Ну а если снизить уровень графики для повышения «играбельности», то окажется, что использовано от силы 1-2 ГБ памяти. Причем такие видеокарты встречаются и в текущих линейках — так, у AMD есть RX 550 с теми же 4 ГБ GDDR5 — с учетом того, что видеокарта выступает приблизительно на уровне GT 1030, очевидно, что использовать столько памяти она сможет в очень немногих задачах:

Так что не стоит судить о производительности видеокарты, опираясь только на объем видеопамяти.

Второй миф. Если видеокарте не хватит видеопамяти в игре, то обязательно будут фризы, вылеты и тому подобное

Опять же, это кажется логичным: если видеокарте памяти не хватило, взять ее больше неоткуда — значит, программы корректно работать не смогут. Однако на деле это, разумеется, не так — любая видеокарта имеет доступ к оперативной памяти, которой обычно куда больше, чем видеопамяти. Конечно, ОЗУ в разы медленнее, а время доступа к ней больше — это может вызвать проблемы с плавностью картинки, но только лишь в том случае, если собственной памяти видеокарте не хватает сильно: например, у нее 2-3 ГБ памяти, а игра требует 4-5 ГБ. Но если не хватает нескольких сотен мегабайт, то обычно это проблем не вызывает: GPU умеют динамически использовать доступные им ресурсы, и в ОЗУ они стараются хранить ту информацию, которая нужна редко или не требует мгновенного отклика.

Третий миф. От разгона видеокарты сгорают

При этом различные производители продают разогнанные с завода версии видеокарт. Разумеется, при разгоне видеокарта может повредиться — но только в том случае, если вы измените «физические» параметры, такие как напряжение. Изменение программных параметров, таких как частоты, никак на «железо» не влияет, так что максимум, что вы получите, это вылет видеодрайвера или BSOD от выставления слишком высокой частоты.

Четвертый миф. SLI/Crossfire увеличивают производительность и объем видеопамяти во столько раз, сколько видеокарт подключено

Насчет производительности это, скорее, не миф, а теоретический результат. Увы — на практике, хотя тому же SLI 20 лет, а Nvidia его использует больше 10 лет, в большинстве игр прирост или околонулевой, или вообще отрицательный. Лишь в единичных проектах можно получить прирост хотя бы 20-30% в сравнении с одной видеокартой, что, конечно, смешно, с учетом двукратного увеличения стоимости и серьезных требований к блоку питания. Что касается вычислительных задач, то тут все сложнее: так, профессиональный софт вполне может использовать несколько GPU эффективно, но это уже не домашнее применение.

Что касается видеопамяти, то тут все просто: при использовании DirectX 11 или ниже в видеопамять каждого используемого GPU записывается одинаковая информация, то есть у связки видеокарт будет по сути тот же объем памяти, что и у одиночной карты. А вот в API DirectX 12 есть возможность более эффективно использовать Split Frame Rendering, когда каждая видеокарта готовит свою часть кадра. В таком случае объемы видеопамяти суммируются — пусть и с оговорками.

Пятый миф. Профессиональные видеокарты лучше игровых

Миф идет от того, что профессиональные видеокарты (такие как Nvidia Quadro или AMD FirePro) стоят обычно сильно дороже пользовательских «игровых» видеокарт — а раз дороже, значит лучше. На практике вопрос только в том — в какой области лучше? С физической точки зрения большая часть профессиональных видеокарт имеют тот же GPU и тот же объем памяти, что и обычные игровые видеокарты, а разница идет только из-за других драйверов, которые больше заточены под профессиональное применение:

С учетом того, что эти драйвера под игры никто специально не адаптирует, то профессиональные видеокарты в играх зачастую будут несколько хуже аналогичных по производительности игровых GPU. С другой стороны, если мы будем сравнивать эти же видеокарты в различных CAD-ах или 3ds Max — перевес будет на стороне профессиональной графики, причем зачастую очень существенный. Так что ответ на миф таков: сравнивать эти видеокарты в лоб не имеет смысла, они «играют» и в разных ценовых сегментах, и в разных сценариях использования.

Шестой миф. Если видеокарта не раскрывается процессором — это плохо

Пожалуй, самый популярный миф, который гласит о том, что если видеокарта не занята на 100% — это плохо. С одной стороны, это кажется логичным: нагрузка ниже 100% означает, что видеокарта частично простаивает и вы недополучаете часть производительности. С другой стороны, многие забывают, что нагрузить GPU на 100% можно практически при любом процессоре. Как так? Очень просто: каждый процессор в каждой игре может подготовить для видеокарты лишь определенное количество кадров в секунду, и чем процессор мощнее — тем больше кадров он может подготовить. Соответственно, чтобы видеокарта была занята на 100%, она должна иметь возможность отрисовать меньше кадров в секунду, чем может дать ей процессор. Как это сделать? Да очень просто: поднять разрешение, поставить более высокие настройки графики, включить тяжелое сглаживание — и вуаля, GTX 1080 Ti в 5К на ультра-настройках графики «пыхтит», выдавая 15-20 кадров в секунду, а поставленный ей в пару двухядерный Intel Pentium едва ли нагружен на половину.

Легко можно получить и обратную ситуацию: взять ту же самую GTX 1080 Ti и запустить на ней игру в HD-разрешении с минимальными настройками графики — и тут даже Core i9-9900K не сможет подготовить для ней столько кадров в секунду, чтобы она была занята на 100%.

Так что тут можно сделать два вывода: во-первых, если видеокарта недогружена несильно, а итоговый fps вас устраивает — всегда можно еще немного увеличить настройки графики, чтобы получить 100% нагрузку на видеокарту с лучшей картинкой и при той же производительности. Во-вторых, собирайте сбалансированные сборки, дабы не было такого, что процессор занят на 100%, а fps в игре 20 кадров.

Восьмой миф. Если видеокарта не перегревается, то она работает на максимально возможной для нее частоте в рамках ее теплопакета

Увы — аналогия с процессорами тут не работает: если те действительно удерживают максимальные частоты в рамках TDP вплоть до температуры, с которой начинается троттлинг из-за перегрева, то видеокарты работают хитрее: так, у Nvidia есть технология GPU Boost, которая, с одной стороны, является аналогом Turbo Boost для процессоров — позволяет поднимать частоту выше базовой — а с другой стороны имеет больше ограничений.

Возьмем, для примера, GTX 1080 Ti. Она имеет родную частоту в 1480 МГц, а Boost — 1580. Но стоит нагрузить видеокарту, как частота может подскочить до 1800-1850 МГц — то есть выше Boost: это и есть работа технологии GPU Boost. Дальше — интереснее: критические температуры у видеокарт поколения Pascal составляют порядка 95 градусов — но уже при 85 можно заметить, что частоты снижаются ближе к уровню Boost. Почему так? Потому что Nvidia ввела еще одну опорную температуру, которую называет целевой: при ее достижении видеокарта старается ее не превышать, а для этого сбрасывает частоты. Так что если у вас мощная видеокарта, да и еще с референсным турбинным охлаждением — внимательно следите за температурами, ибо от них в прямом смысле зависит производительность.

Девятый миф. Видеокарты без дополнительного питания хуже аналогов с ним

В продаже можно встретить видеокарты уровня GTX 1050, 1050 Ti и AMD RX 550 без дополнительного питания — то есть, как в старые добрые времена, достаточно поставить их в слот PCIe и они готовы к работе. При этом также есть версии 1050 и 1050 Ti с дополнительным питанием 6 pin, из-за чего некоторые пользователи делают вывод, что раз дополнительное питание есть — значит с ним видеокарты будут работать лучше.

На деле это не совсем так: слот PCIe способен дать видеокарте до 75 Вт, и этого вполне хватает, чтобы даже 1050 Ti работала на указанных на официальном сайте Nvidia частотах. Но если вы нацелены на разгон — да, тут питания от PCIe видеокарте может уже не хватить, так что дополнительные 6 pin от блока питания позволят достичь больших частот, однако разница в любом случае не превысит 10%.

Десятый миф. Не стоит ставить современные PCIe 3.0 видеокарты на старые платы со слотами PCIe 2.0 или 1.0

Все опять же логично — так, пропускная способность PCIe 2.0 x16 вдвое ниже, чем у 3.0 x16, а, значит, современные видеокарты через более старую шину PCIe будут работать медленнее. На деле это опять же не так — пропускная способность PCI Express 3.0 x16 даже для топовых современных видеокарт оказывается избыточной:

Хорошо видно, что разница между 3.0 x16 и 2.0 x16 составляет всего 1%, то есть погрешность, и даже если спуститься до PCIe 1.1 — то есть к материнским платам почти десятилетней давности — падение производительности оказывается всего лишь 6%. Так что вердикт тут прост — версия PCIe практически не влияет на производительность видеокарты, соответственно можно смело к Xeon с PCI Express 2.0 брать GTX 1080.

Одиннадцатый миф. Разгон видеопамяти не имеет смысла

Конечно, наибольший прирост дает разгон ядра видеокарты — тут прирост производительности близок к линейному (то есть увеличили частоту на 10% — получили прирост производительности на 10%). Однако не стоит сбрасывать со счетов видеопамять, особенно в слабых видеокартах: зачастую в них ставят те же чипы памяти, что и в более мощные решения, но при этом сильно снижают частоту. Это дает возможность ее достаточно сильно разогнать, зачастую на 20-40%, что может прибавить к общей производительности графики еще 10-15% — для слабых видеокарт это лишним, разумеется, не будет:

Двенадцатый миф. С выходом каждой новой линейки видеокарт производители урезают производительность старой

Достаточно популярный миф, основанный обычно на том, что на одних (обычно более старых) версиях драйверов видеокарта работает лучше, чем на других (обычно более новых). Разумеется, никакого реального основания он не имеет: если бы Nvidia и AMD на самом деле хотели заставить пользователей обновить видеокарты, они бы прекращали их поддержку как производители смартфонов на Android, через пару лет после выхода. Однако на деле даже решения 600-ой линейки от Nvidia, вышедшей более 6 лет назад, до сих пор получают новые драйвера наравне с более новыми видеокартами, причем со всеми программными «плюшками» типа DirectX 12.

Но почему тогда есть разница в производительности между драйверами? Потому что ничто в нашем мире не идеально, и какие-то драйвера, улучшая производительность в новых играх, могут испортить производительность в более старых или привести к различным ошибкам. Обычно через некоторые время выходят исправленные драйвера, и все возвращается на круги своя.

Производительность компьютерных систем регулярно измеряют при помощи бенчмарков. Но когда на получившиеся цифры смотрят специалисты, занимающиеся постпродакшном видео, то они не могут точно понять, насколько именно одна система окажется эффективнее другой при решении их задач. Шаблонные тесты не учитывают всего множества нюансов, с которыми профессионалам приходится сталкиваться при обработке видео. Бенчмарк не может смоделировать нужные эффекты, проверить скорость просчета RAW с серьезной видеокамеры и т.п.

Но здраво оценивать возможности своей машину монтажеру или специалисту по эффектам просто необходимо. Есть даже такая особенно актуальная для постпродакшна поговорка: «Работа никогда не заканчивается, а лишь временно приостанавливается с наступлением дедлайна». Все, что помогает улучшить продуктивность труда сидящего за компьютером человека, в видеопроизводстве ценится на вес золота. Ведь чем быстрее система «просчитывает» внесенные изменения, тем меньше времени специалист сидит без дела.

Сегодня мы хотим поделиться интересным кейсом на эту тему. Его подготовил Джефф Гринберг – самый настоящий гуру видеопродакшна с 20-летним опытом за плечами. Он пишет книги, регулярно выступает на семинарах, обучает людей работать в видеоредакторах, помогает советами создателям достаточно серьезных фильмов и передач, а также управляет собственным тематическим консалтинговым агентством. Как и все мы, Джефф прекрасно понимает, что использование нового железа и обновление софта ускоряет работу труженика постпродакшна, но ему очень сильно захотелось понять, насколько именно. Гринберг задался целью получить самые точные и, главное, актуальные для работы с видео измерения.

В качестве испытательных площадок для своего эксперимента Джефф выбрал две рабочие станции Dell. Одна из них была выпущена в продажу в 2012 году, а вторая – в конце 2014 года, т.е. вполне актуальна до сих пор.

Рабочая станция конца 2014 года – Dell Precision Tower 7910 с 14-ядерным (28 виртуальных) процессором Intel Xeon E3-2695v3 2,4 ГГц и видеокартой NVIDIA Quadro K5200 с 8 ГБ GDDR5 и 2304 ядрами CUDA (кстати, они двухпроцессорные и поддерживают до 16 слотов RAM).

Остальные комплектующие автор теста постарался максимально стандартизировать, чтобы свести сравнение к трем основным примерам: влияние на производительность процессора, видеокарты и разных версий софта для видеообработки. Так, на оба компьютера он установил операционную систему Windows 7.1 Pro, в качестве основных дисков использовал SSD на 256 ГБ, количество оперативной памяти тоже сделал одинаковым – 64 ГБ. Правда, на Tower 7910 это были планки DDR4, а на T7600 – DDR3. Кроме того, несколько отличались массивы RAID-0, зарезервированные для импорта медиа и кэша. В машине 2012 года работали два HDD с емкостью 1 ТБ и скоростью вращения шпинделя 7200 об/м, а в машине 2014 года трудились два более шустрых и объемных накопителя – 10 000 об/м и 1,2 ТБ емкости.

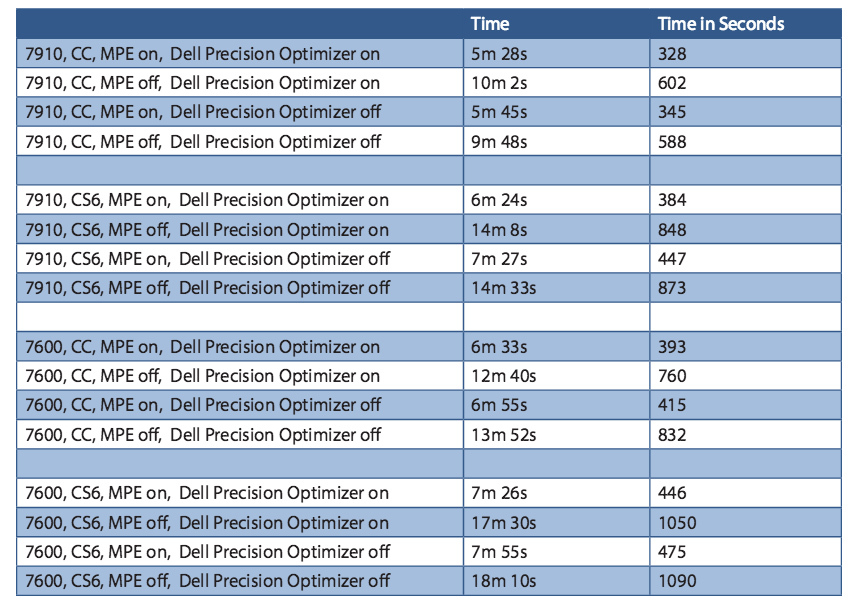

Еще один важный момент, который оказывает серьезное влияние на производительность при обработке видео, – вклад движка Adobe Mercury Playback Engine, фирменного ускорителя GPU от Adobe. Джеффу пришлось взять этот фактор в расчет, включая и отключая ускорение в одинаковых тестах.

Ну а непосредственная обработка видео осуществлялась в программе Premiere Pro. Тестировались версии из разных пакетов: Adobe Creative Suite 6, который был актуален в 2012 году, и Adobe Creative Cloud 2014.

Для решения задачи Джефф сразу поставил перед собой три основных цели:

- Выяснить, как аппаратная составляющая рабочей станции 2014 года улучшает производительность при обработке видео по сравнению с аналогичной машиной, но на два года более старой. Также тестер хотел понять, насколько серьезный вклад в это дело вносит фирменная утилита Dell Precision Optimizer.

- Определить, насколько велика разница при использовании профессиональных видеокарт, между выпуском которых прошло два года. При этом важно было измерить вклад фирменного ускорения NVIDIA.

- И, наконец, Джеффу было крайне интересно, как влияет на производительность актуализация софта.

В качестве основы для изысканий Джефф взял пятиминутный ролик в формате 4K (3840x2160) и провел с ним более сотни различных манипуляций, замеряя временные показатели. А поскольку 4К – это в четыре раза больше, чем Full HD, то результаты можно считать справедливыми и для 20-минутного видео в 1920х1080. Ну и, конечно, 4K сегодня – это самое актуальное разрешение. Его можно без потери качества смело уменьшать до FHD или даже делать кроп до HD, одновременно с этим повышая частоту кадров. Более того, если исходник качественный, то можно даже сделать стоп-кадр и использовать его в дальнейшем как фотографию хоть для печати в крупном размере в глянцевом журнале.

Но это не все. Рабочим станциям Dell предстояло столкнуться и с другими сложностями. В тестовом проекте Джеффа была масса кадров со множеством мелких деталей: пляжи, волны на воде, поля с колышушейся травой. Кроме того, каждый кадр был подвергнут серьезной цветокоррекции. Даже исходники использовались с разных камер: Canon C500 (ProRes 4444), RED EPIC (R3D в RAW) плюс H.264 HD. Поскольку большая часть видео снималась на C500, то именно ProRes 4444 и стал основным кодеком проекта. Не обошлось дело и без эффектов. Их Джефф подбирал очень тщательно, останавливаясь только на тех, которые есть в обеих версиях Premiere Pro – и в CS6, и в CC.

Два главных показателя, по которым работник видеопродакшна оценивает производительность системы, – скорость рендеринга и скорость вывода контента. Рендеринг – это процесс получения серии «просчитанных» изображений, которые затем будут преобразовываться в готовый видеоряд. Под «просчетом» в данном случае можно понимать приведение всех составляющих проекта к единому знаменателю, проработку наложенных эффектов и так далее. Ну а вывод контента – это как раз процесс получения того самого готового видеоряда, пригодного для просмотра в обычных видеоплеерах. С последним во время монтажа приходится сталкиваться регулярно на всех этапах хотя бы просто для того, чтобы показать видео продюсерам, режиссерам и клиентам.

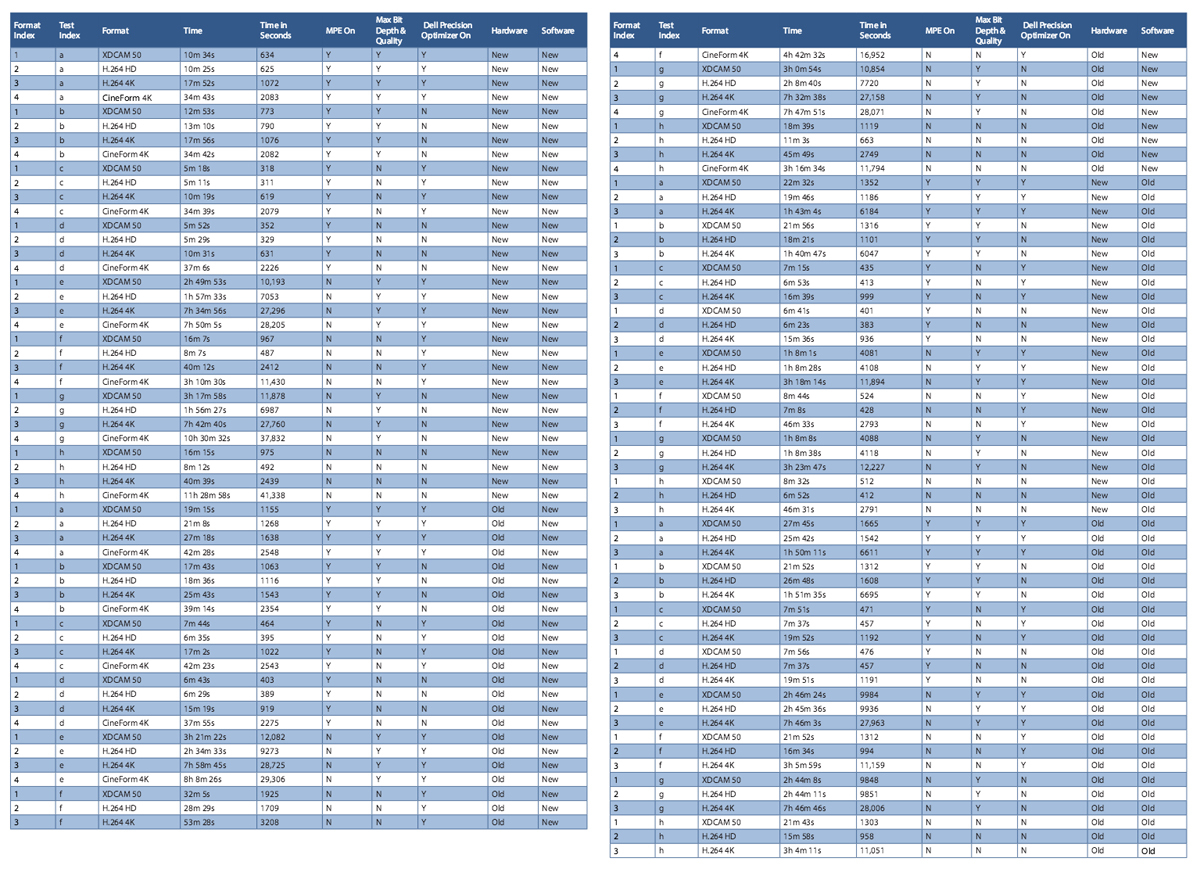

Для вывода контента Джефф выбрал три формата, которые чаще всего применяет в работе. Это XDCAM, который используется для телевещания, H.264 HD, как один из самых популярных на сегодняшний день в целом, и H.264 UHD – для работы с 4K и обеспечения максимальной нагрузки на все компоненты описанных выше рабочих станций.

Результаты тестов скорости рендеринга выглядят следующим образом. Чем быстрее – тем, соответственно, лучше.

В спойлере ниже мы спрятали таблицы, в которых Джефф собрал все замеры скорости рендеринга. Советуем заглянуть туда тем, кто занимается обработкой видео.

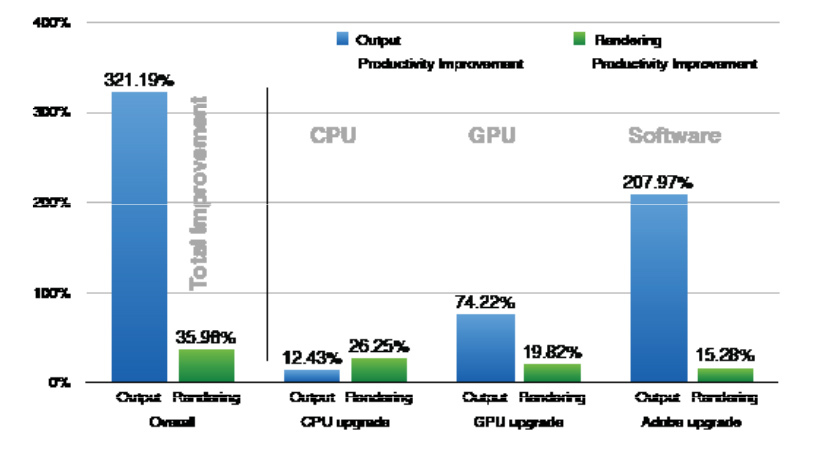

Общие показатели довольно наглядны, но затем Джефф Гринберг стал разбираться, насколько сильно на производительность влияют отдельные компоненты. То есть версии софта, аппаратная часть рабочих станций Dell и мощность видеокарт.

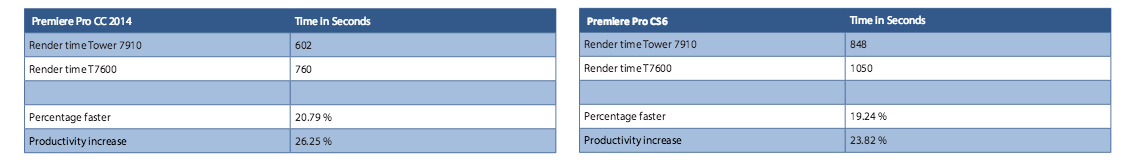

В прямом сравнении аппаратной части двух рабочих станций Dell разных годов выпуска Джефф решил специально отключить ускорение видеокарт, чтобы сделать результат максимально показательным. Ведь если отключить ускорение Adobe MPE, то основная часть вычислительной нагрузки ляжет именно на центральный процессор.

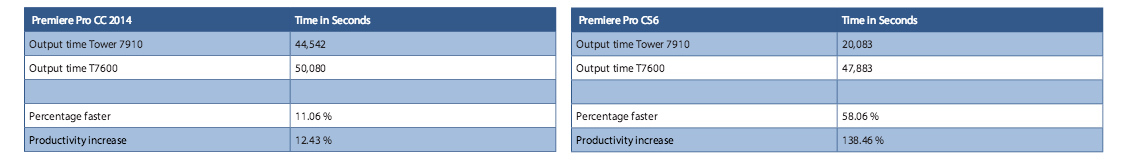

По итогам теста рабочая станция 2014 года (Dell Precision Tower 7910) оказалась примерно на четверть продуктивнее и более чем на 20% быстрее, чем Dell Precision T7600 в Adobe Creative Cloud 2014. Примерно такие же показатели получаются и при выполнении всех тех же манипуляций в более старой версии Premiere Pro в составе пакета CS6.

Дальше – интереснее. В следующей таблице Джеффа собраны совокупные показатели скорости вывода ролика в XDCAM HD, H.264 HD и H.264 UHD. При работе в Premiere Pro CC 2014 вроде бы никаких сюрпризов: видно прирост на 11-12%. А вот в CS6 работа ускорилась на магические 58%, а общая производительность выросла аж на 138%.

Впрочем, Джефф сразу понял, что случился сбой и перепроверил все на другом проекте – там радикальной разницы уже не наблюдалось. Подобный сюрприз он объясняет нюансами проекта и какими-то особенностями софта Adobe, которые так сильно замедлили работу T7600 в одном конкретном случае.

В качестве бонуса Джефф добавляет, что если во время этого испытания включить ускорение GPU, то показатели рабочей станции Dell 2014 года будут на 500% лучше, чем у машины 2012 года.

Отдельными тестами Джефф проверил работу фирменной утилиты Dell, призванной помочь пользователю «выжать» из железа максимум от его возможностей. В Precision Optimizer есть специальные профили для работы в Premiere Pro, Media Encoder и After Effects, создававшиеся в партнерстве с Adobe. Джефф отмечает, что программа очень удобна в использовании и действительно работает: с ее помощью в среднем удается увеличить производительность при рендеринге в Premiere Pro примерно на 5-6%. В масштабах проектов, которые могут прорабатываться по 10-20 часов или даже несколько дней, это ощутимый выигрыш.

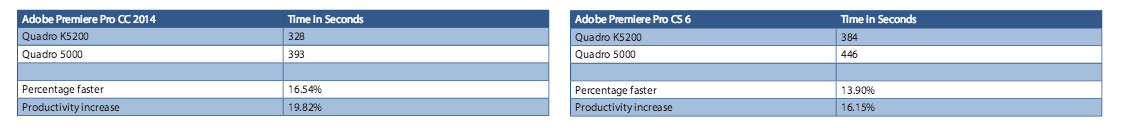

Напрямую сравнивая в своем тесте видеокарты, Джефф, конечно же, активировал фирменное ускорение GPU Adobe Mercury Playback Engine – это все-таки одна из главных «фишек». Процентные показатели для разных версий программ Adobe примерно одинаковые, но видеокарта 2014 года дает выигрыш на 14-16% во времени рендеринга и на 16-20% в производительности.

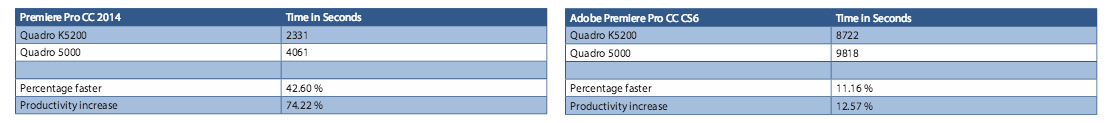

При этом в тесте скорости вывода разница версий Premiere Pro для видеокарт оказалась очень важной. В Creative Cloud 2014 Джефф получил выигрыш по времени почти в 43% и увеличение производительности на 74%! В Adobe CS6 результаты оказались куда скромнее. И здесь уже никаких глюков и сбоев.

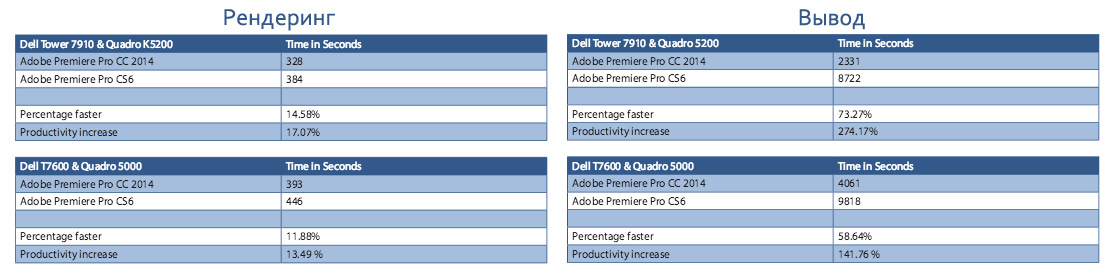

Неугомонному Джеффу также было интересно понять и то, насколько далеко вперед шагнул Adobe Creative Cloud 2014 по сравнению с Creative Suite 6. Результат: на 15% более быстрый рендеринг в CC 2014 и почти на 75% более быстрый вывод при приросте производительности в 274%. Впечатляет!

Главный вывод, который следует из вызывающих уважение изысканий Джеффа Гринберга вы, конечно, знали с самого начала. Очевидно, что апгрейд железа и софта дает существенный прирост производительности, позволяющий ускорить работу. Но насколько он ощутим в случае с нашими двумя машинами?

Полный переход с Dell Precision T7600 на Dell Precision Tower 7910 с одновременной заменой пакета Adobe CS6 на CC 2014 даст прирост производительности в 321% и ускорит рендеринг на 31%. Одним словом, есть за что бороться!

Сводный график показывает, что на ускорение рендеринга в большей степени влияет апгрейд центрального процессора (при отключении GPU), а вот скорость вывода в основном зависит от актуальной версии используемого софта и видеокарты.

Разумеется, Джефф Гринберг отмечает, что если кто-то захочет его тесты повторить, то цифры получатся не точно такие же: будет отклонение в большую или меньшую сторону. Это вызвано особенностями конкретного проекта, который Джефф использовал для проверки скорости компонентов рабочих станций. Впрочем, проект этот явно был достаточно сложным, чтобы считать результат вполне показательным.

Пользуясь случаем, говорим спасибо тем, кто дочитал материал до конца. И приглашаем всех в комментарии для обсуждения. А если у вас есть вопросы по рабочим станциям Dell, то наши специалисты постараются оперативно на них ответить.

Вопрос "что важнее процессор или видеокарта?" по сути своей нелеп. При работе с двухмерной графикой, кодировании видео, аудио, компиляции кода, решает ЦП. В играх и 3D-приложениях (вроде профессиональных инженерных программ) важнее видеокарта, которая занимается обработкой трехмерной картинки. Но попытаться разобраться, насколько эта связь тесна, и на чем можно сэкономить, все же стоит. Чтобы сделать это – нужно проследить зависимость показателей производительности в разных связках ЦП и ГП.

Видеокарты в ноутбуках и настольных компьютерах

Выбор графического процессора важен не только при сборке или покупке нового настольного ПК. Многие портативные компьютеры, ориентированные на игры, также используют дискретные графические процессоры. Если игра на ходу является приоритетной задачей, вы должны убедиться, что ваш ноутбук оснащен графическим процессором, способным играть в нужные вам игры, и что вы не полагаетесь исключительно на встроенную графику с низким энергопотреблением вашего процессора.

Раньше графические процессоры для ноутбуков были значительно менее мощными, чем их полноразмерные собратья для настольных ПК, из-за ограничений по пространству и тепловых соображений. Сейчас они как никогда близки к паритету. Во многих современных игровых ноутбуках используются дискретные графические процессоры, производительность которых очень близка к аналогам для настольных ПК, или они оптимизированы для обеспечения впечатляющей мощности очень тонких и легких ноутбуков.

Вам больше не придется выбирать между портативностью и мощностью.

Компьютер - это сложно?

Как Вы знаете или просто догадываетесь, что компьютер состоит из разных комплектующих.

В его состав входят:

- Корпус

- Блок питания

- Жёсткий (HDD) или твердотельный накопитель(SSD)

- Оперативная память

- Материнская плата

- Процессор

- Охлаждение для процессора

- Видеокарта (не всегда, но для игрового пк обязательна)

Возможно что-то ещё, но основное всё перечислено.

Интегрированные и дискретные графические процессоры

Большинство современных ЦП имеют встроенную графику, которая по сути представляет собой графические процессоры, встроенные в сам ЦП или иным образом тесно связанные с ЦП. Эта встроенная графика, как правило, имеет более низкую производительность, обеспечивая достаточную мощность для управления операционной системой и запуска веб-браузеров, почтовых клиентов, приложений для повышения производительности и другого рутинного программного обеспечения, но этого недостаточно для чего-то большего, чем казуальные (или более старые) игры. Это быстро меняется по мере того, как процессоры становятся более мощными, но на данный момент, если вы хотите играть в игры, лучшим решением, вероятно, будет отдельный (или дискретный) графический процессор.

Автономные графические процессоры варьируются от относительно недорогих вариантов начального уровня до невероятно мощных графических процессоров, которые могут стоить более 1000 долларов США сами по себе. Вы можете купить дискретные графические процессоры в составе готовых систем, для ПК, который вы собираете самостоятельно, или для обновления старого графического процессора.

На что же стоит обратить пристальное внимание? Во что вложиться по-максимом?

Баланс сборки весьма велик. Каждый вложенный рубль, при правильном подходе, может как увеличить производительность системы так и не оказать существенного влияния.

Например оперативная память. Её частота (мощность) практически не важна если сборка происходит на базе процессора от Intel. Но если речь идёт про сборку на новых процессорах от AMD (ryzen), то влияние частоты ОЗУ довольно существенное.

Но ещё важен и сам процессор, точнее его частота, которая напрямую влияет на производительность. Но какой бы крутой процессор или оперативка не стояла в Вашем компьютере, без видеокарты всё бесполезно. Но даже если есть видеокарта, то со слабым процессором она будет простаивать и не работать на полную мощность. А это уже скажется на итоговом восприятием игры (могут быть подтормаживания или даже зависания).

Будь в курсе последних новостей из мира гаджетов и технологий

Почему выбор видеокарты важен?

Для многих людей игры — это самая требовательная к оборудованию задача, которую вы захотите выполнить на своем ПК. Поэтому неудивительно, что серьезные геймеры часами исследуют новейшие технологии графических процессоров и регулярно обновляют свои графические процессоры. По мере того как графические процессоры становятся быстрее, игры разрабатываются, чтобы использовать преимущества дополнительной производительности, и это подталкивает производителей к созданию еще более быстрых графических процессоров, продолжая цикл.

Если вы не уделяете первостепенное внимание играм, возможно, вам не так важны возможности вашего графического процессора. Тем не менее профессиональные приложения часто напрямую используют специализированные вычислительные возможности графического процессора, просто по-разному. Примеры включают редактирование видео, где графический процессор может использоваться для ускорения таких процессов, как кодирование видео, 3D-рендеринг и приложения для автоматизированного проектирования/производства (CAD/CAM), такие как AutoCAD. Все эти программы выигрывают от дополнительной вычислительной мощности графического процессора, хотя больше всего они выигрывают от графических процессоров, разработанных специально для этих приложений.

Таким образом, выбор графического процессора является важной частью сборки, покупки или обновления ПК. Как и в случае с любым компонентом ПК, первый вопрос, который следует задать себе при выборе видеокарты: как вы будете ее использовать?

Читайте также: