Установка видеокарты на сервер супермикро

Note: For consumer-grade GPU card support, please contact Supermicro sales and technical support for details.

✔ a. Add 1x CBL-PWEX-1016-3 per GPU

✔ b. Add 1x CBL-PWEX-1017 per GPU

✔ c. Add 8X FAN-0163L4

✔ d. For 1 or 2 GPU: Add 4x FAN-0166L4, 2x SNK-P0067PS, 1x MCP-310-21903-0B, 1x MCP-310-21905-0B, 1x RSC-R2UW-2E8E16

✔ e. Add 4x FAN-0166L4, 2x SNK-P0067PS, 1x MCP-310-21903-0B, 1x MCP-310-21904-0B

✔ f. Top row of drive bays (2, 5, 8, 11) must be unpopulated

✔ g. Drive bays 0-3 & 20-23 must be unpopulated

✔ h. Can only support CPUs with TDP of 165W and Frequency 3.0 GHz or less; the system must be operated at 30°C or below; HDD performance may be impacted so SSDs are recommended

✔ i. Can only support CPUs with TDP of 165W and Frequency 3.0 GHz or less; the system must be operated at 25°C or below; HDD performance may be impacted so SSDs are recommended

✔ j. Passed internal Supermicro validation - NVQual not performed or not available

✔ k. Supports up to two M10 GPUs

✔ l. Add 4x FAN-0166L4.

✔ m. The system must be operated at 25°C or lower with 3 GPUs.

✔ n. The system must be operated at 25°C or lower with 6 GPUs.

✔ o. MCP-120-21807-0N bracket is required for T4 GPU installation.

✔ p. The system must be operated at 30°C or lower with 4 or more GPUs

✔ q. For 1 or 2 GPU: Add 1x RSC-R2UW-2E8E16.

✔ r. For 3 or 4 GPU: Add 1x RSC-W2-66. For 4 GPU: Also add 1x AOC-2UR66-i4XTF.

✔ s. Add GPU Kit, first GPU need to be installed in Slot 5/6,WIO Left. Second GPU need to be installed in Slot 1,UIO right.

✔ t. Drive bays 9,10,11 must be unpopulated

✔ u. Drive bays 2,5,8,9,10,11 must be unpopulated when installing 2 GPU

✔ v. The system must be operated at 30°C or lower with 1 GPUs, 25°C or lower with 2 GPUs.

✔ w. The system must be operated at 25°C or lower with 1 GPUs, 20°C or lower with 2 GPUs.

✔ x. The system supports 1 double wide GPU (P40) only or 1-2 single wide GPU (T4).

✔ y. 1 GPU supported at 35°C: both fans must be upgraded to FAN-0077L4-1 and Fan speed set to Heavy I/O.

2 GPU supported at 30°C: both fans must be upgraded to FAN-0077L4-1 and Fan speed set to Heavy I/O.

✔ z. 1 GPU supported at 35°C: Left Middle Chassis Fan upgraded to FAN-0074L4, Fan speed set to Heavy I/O.

2 GPU supported at 30°C: Left Middle Chassis Fan upgraded to FAN-0074L4, Fan speed set to Heavy I/O.

✔ a1. Additional hardware required, check product specification details page.

✔ a2. Ambient Temperature @ 30C , the TDP up to 200W + GPU Kit

✔ a3. Ambient Temperature @ 25C , the TDP up to 200W + GPU Kit

✔ a4. Ambient Temperature @ 30C or lower with 2 GPU

✔ a5. Ambient Temperature @ 30C or lower with 2 GPU and removal of top 4 drives on front HDD slots is required if using 3.5” drives; second GPU requires Power Cable, CBL-PWEX-1240.

✔ a6. Ambient Temperature @ 30C or lower with 2 GPU and removal of top 4 drives on front HDD slots is required if using 3.5” drives; first GPU require Power Cable, CBL -PWEX-1040; second GPU requires Power Cable, CBL-PWEX-1240+CBL-PWEX-1040.

✔ a7. Support up to 10x double wide GPU only

✔ a8. Only support up to 4 A16s in one system, in slots 1, 2, 3, 4. No rear fan kit needed.

✔ a9. Ambient Temperature @ 25C or lower with 2 GPU and removal of top 4 drives on front HDD slots is required if using 3.5” drives; first GPU require Power Cable, CBL -PWEX-1040; second GPU requires Power Cable, CBL-PWEX-1240+CBL-PWEX-1040.

✔ c1. Need to add Air Shroud, MCP-310-93806-0N.

✔ c2. Need to add Air Shroud, MCP-310-93807-0B.

✔ c3. Need GPU Power Cable, CBL-PWEX-1017.

✔ c4. Need GPU Power Cable, CBL-PWEX-1028.

✔ c5. when 2 GPU, can pass 35C. When 3 GPU, can pass 30C

✔ c6. when 4 GPU, can pass 35C. When 5 GPU, can pass 35C

✔ c7. when 2 GPU, can pass 35C. When 3 GPU, can pass 35C

✔ n1. The system must be operated at 23°C or lower with 8 GPUs.

✔ n2. conditionally supported at 28C environment temperature, fan mode set to Heavy IO, and other conditions may apply based on complete system configuration, please contact Supermicro Technical Support for additional information.

✔ n3. Needs MCP-120-21807-0N bracket set (a) 4 GPU: supported, (b) 6 GPU: Supported

✔ n4. 4x GPU: Needs to be installed at slot 1, 2, 5, 6 (not supported at slot 3 & 4) and needs rear system fan upgrade, MCP-320-21809-0N, support at 25°C & 30°C. System may throttle at 35°C.

✔ n5. Needs MCP-240-21829-0N bracket set (a) 4x GPU: Needs to be installed to slot at 1, 2, 3, 4. No fan is needed

(b) 6X GPU: Upgrades rear system fan, MCP-320-21809-0N. No fan, system can only support at 25°C, otherwise system may throttle at 30°C & 35°C.

✔ n6. (a) 4x GPU: No fan needed, (b) 6x GPU: No fan needed.

✔ n7. (a) 4x GPU: No fan, system can only support 25°C & 30°C, otherwise system may throttle at 35°C.

(b) 6x GPU: Upgrades rear system fan, MCP-320-21809-0N can support at 25°C, otherwise; system may throttle at 30°C & 35°C.

✔ n8. (a) 40G: (i) 4x GPU: Needs to be Installed at slot 1, 2, 3, 4.

(ii) 6x GPU: Upgrades rear system fan, MCP-320-21809-0N. Without fan, system support at 25°C, otherwise system may throttle at 30°C & 35°C.

(b) 80G: (i) 4x GPU: Needs to be Installed at slot 1, 2, 3, 4.

(ii) 6x GPU: Upgrades rear system fan, MCP-320-21809-0N, system can only support 25°C & 30°C, otherwise; system may throttle at 35°C. Without fan support, system can only support 25°C,

otherwise; system may throttle at 30°C & 35°C.

✔ w1. Operating temperature at 35°C or lower; add 5x FAN-0141L4; set fan to full speed

✔ w2. Operating temperature at 30°C or lower; add 3x FAN-0166L4, 1x RSC-W2-66 and 2x SNK-P0067PSMB; set fan to full speed

✔ w3. For 4 GPUs or 2 A6000, operating temperature at 25°C or lower; add 3x FAN-0222L4; set fan to full speed

✔ x1. Need to add 1x MCP-310-00085-0B (Air block + Air Shroud)

✔ x2. If GPU >2, must add MCP-310-00086-0B (Air dummy). MCP-310-00086-0B Q'ty=10-AOCs. E.g. 4 GPU, 1 raid card and 2 networking installed in the system. It means MCP-310-00086-0B Q'ty =10-7 AOCs, so must add 3x MCP-310-00086-0B.

✔ x3. If GPU installed in share slot, must set BIOS IIO Configuration to "SLOT1 x8 & Slot2 x8", "SLOT5 x8 & SLOT6 x8"

✔ x4. If GPU >=5, BIOS ARI and SR-IOV must set to disable

✔ x5. Only 1 GPU can be supported

✔ x6. System can support up to 2x GPUs

✔ x7. Refer to “Optional Parts List” for required parts. Refer to system manual for GPU installation.

✔ 1UA. CBL-PWEX-1028

✔ 1UF. CBL-PWEX-1017

✔ 2UA. MCP-450-GPUKIT-220U-A

✔ 2UB. MCP-450-GPUKIT-220U-B

✔ 2UC. MCP-450-GPUKIT-220U-C

✔ 2UD. MCP-450-GPUKIT-220U-D

✔ 2UE. MCP-450-GPUKIT-220U-E

✔ 2UF. MCP-450-GPUKIT-220U-F

✔ 2UG. MCP-450-GPUKIT-220U-G

✔ 2UH. MCP-450-GPUKIT-220U-H

✔ 2UI. MCP-450-GPUKIT-220U-I

✔ T1. Up to 250W CPU, Max 32C

✔ T2. Up to 250W CPU, Max 28C

✔ T3. Up to 250W CPU, Max 25C

✔ T4. Up to 205W CPU, Max 35C

✔ T5. Up to 205W CPU, Max 30C

✔ T6. Up to 205W CPU, Max 25C

✔ T7. Up to 165W CPU, Max 35C

✔ T8. Up to 165W CPU, Max 25C

✔ C2U1. Fill empty DIMM slot with MCP-650-00011-0B, Remove dummy drive, Set fan mode to Heavy IO

✔ C2U2. Fill empty DIMM slot with MCP-650-00011-0B, Remove dummy drive

✔ C1U1. Remove DIMM baffles on CPU1 DIMM E~ H, Remove dummy drive, set fan mode to Heavy IO

✔ C1U2. Remove DIMM baffles on CPU1 DIMM E~ H, Remove dummy drive, remove slot 4 mylar

✔ D1. 3.5” drive in bottom trays only

✔ D2. Max 2.5" Drive QTY 4, Max 3.5" Drive QTY 3 (Tray 1-3 only)

✔ D3. Max drive QTY 6 (Tray 6-11)

✔ M1. Max DIMM QTY 16

* Note: System requires BIOS and IPMI update to support NVIDIA GPGPU cards / Xeon Phi / AMD FirePro cards

** Note: All systems can only support up to 2 x K1 or 4 x K2 per Nvidia recommendation

† Note: Intel Xeon Phi 3120P/5110P/7120P can be supported with limited thermal condition, please contact Supermicro sales and technical support for details.

Note: For consumer-grade GPU card support, please contact Supermicro sales and technical support for details.

✔ 1, 2, 3. Note: Additional Supermicro Power cable is required per board for K80/M60 support

✔ 4. Note: 2x Supermicro FAN-015-0L4 are required per node for K80/M60 support

✔ 5. Note: Some configurations require fan upgrade and GPU power cable, please contact Supermicro sales or technical support for details

✔ 6. Note: GPU Kit required and some configurations require riser card upgrades and have drive population limitations, please contact Supermicro sales or technical support for details

✔ 7. Note: Indicated systems can only support up to 2x M10 and 4x M60 GPU.

✔ 8. Note: 1x MCP-120-21807-0N per system

Каждому наверняка когда-то задавали вопрос: "Нам нужен нормальный сервер. Сколько он стоит?". Однако, услышав ответ, обычно забывали об этом вопросе. Действительно, использование в небольшой компании выделенного сервера, несмотря на эффективное решение многих вопросов и задач, сложно обосновать экономически, и дорогая покупка может окупиться не ранее нескольких лет. И поэтому администраторам приходится решать задачи централизованного управления, хранения файлов, печати, резервного копирования и т.п. очень неудобными и сложными путями. Тем не менее, если вдруг требуется именно такое серьезное решение, то можно начать с этой статьи.

Сначала попробуем разобраться, чем должен отличаться сервер от обычного офисного или домашнего ПК.

Начнем собственно с железа. Корпус, он должен вмещать все то дорогое оборудование, которое мы купим и будем пытаться установить в него. Это значит, что по меньшей мере он должен иметь место под установку полноразмерной или даже больше материнской платы, 6–9 плат расширения, иметь 6–12 отсеков для установки жестких дисков, мощный блок питания, продуманную систему охлаждения. Кроме этого, можем добавить отсеки hotswap для жестких дисков, избыточные блоки питания также с горячей заменой и аппаратно-программную поддержку для сетевых ОС по мониторингу и управлению системами вентиляции и питания. Бывают также ситуации, когда нужно много маленьких серверов — например у интернет провайдеров, тогда можно найти монтируемые в 19" стойку корпуса высотой от 1unit. Хотя над охлажденим там нужно подумать.

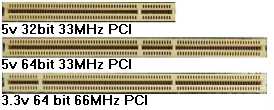

Далее нужно подобрать материнскую плату. Для сервера очень важна производительность системной шины и шины памяти. Выбирать нужно плату на 2–4 процессора с поддержкой шины PCI64/66MHz и FSB 100/133MHz. Лучше использовать Intel 840 или серию ServerWorks Enterprise ServerSet™ III. Для повышения производительности системы памяти в этих чипсетах применяется схема чередования, требующая однако одновременной установки нескольких (2-4) модулей памяти. Еще у Intel есть чипсет с поддержкой четырех процессоров — 450NX, однако завтра он уже устареет — до 9× PCI 32/64bit 33MHz, EDO RAM (хотя и с 2-4 чередованием), 100MHz FSB. Более ранние Intel 450KX/GX и дешевые Intel 440BX/GX можно даже не рассматривать — нет поддержки PCI 64, медленная внутренняя шина, FSB 66MHz/100MHz. Также существуют разработки Compaq, позволяющие использовать до 8 процессоров, но это уже совсем другая история.

Вот краткие характеристики некоторых современных чипсетов:

Intel

| чипсет | 820 | 840 | 450NX |

| FSB | 100MHz/133MHz | 100MHz/133MHz | 66MHz/100MHz |

| количество CPU | 1-2 | 1-2 | 1-4 |

| память | RDRAM / PC100 SDRAM ECC 4Gb 1 канал до 1.6 GBytes/s | RDRAM / PC100 SDRAM ECC 8GB 2 канала до 3.2 GBytes/s | EDO DRAM ECC 8Gb до 1GBytes/s |

| PCI | ICH: 6 × 32bit/33MHz PCI | ICH: 6 × 32bit/33MHz PCI дополнительно с P64H: 4 × 32bit/33MHz PCI или 2 × 64bit/66MHz PCI | 2 шины, до 9x PCI32bit/64bit/33MHz. |

| AGP | 4x | 4x | - |

| IDE/USB | ATA66/2USB | ATA66/2USB | PIIX4 — UDMA/2USB |

ServerWorks

| чипсет | ServerSet III LE | ServerSet III WS | ServerSet III HE |

| FSB | 100MHz/133MHz | 133MHz | 100MHz/133MHz |

| количество CPU | 1-2 | 1-2 | 1-4 |

| память | PC133 SDRAM ECC 4GB | PC133 SDRAM ECC 8GB 2-way interleaved architecture up to 2.1 GBytes/s | PC133 SDRAM ECC 16GB 4-way interleaved architecture up to 4.1 GBytes/s |

| PCI | 2 × 64bit/66MHz PCI 5 × 64bit/33MHz PCI выделенная 32-bit PCI шина для legacy IO и связи с south bridge | 2 × 64bit/66MHz PCI 5 × 64bit/33MHz PCI две независимые 64-bit PCI шины | 2 × 64bit/66MHz PCI 5 × 64bit/33MHz PCI две независимые 64-bit PCI шины выделенная 32-bit PCI шина для legacy IO и связи с south bridge |

| AGP | - | 4x | - |

| IDE/USB | ATA66/4USB | ATA66/4USB | ATA66/4USB |

Процессоры — выбор тут немного легче, поскольку процессоры можно выбрать по текущим требованиям/финансовым возможностям, а далее их менять/добавлять по необходимости. Коротко о современных Intel процессорах можно сказать так:

| частота | частота FSB | L2 кеш | шина | |

| Pentium III | 500-866MHz | 100/133MHz | 256kb/512kb | FCPGA/Slot1 |

| Pentium III Xeon | 500-700MHz | 100MHz | 512kb/1Mb/2Mb | Slot2 |

| Pentium III Xeon | 600-866MHz | 133MHz | 256kb | Slot2 |

Хотя тут Intel странно себя ведет — 4-х процессорные конфигурации поддерживаются только Xeon с FSB 100MHz, и такие процессоры быстрее чем на 550MHz только что появились. Похоже действительно сложно сделать процессор на 133MHz FSB и кешем от 512KB.

При недостатке финансов можно попробовать использовать и старые Intel Pentium II и Pentium II Xeon, однако это FSB 100MHz и частота до 450MHz.

С памятью тоже достаточно просто. Требования к ней постоянно растут и увеличение объема памяти является одним из самых легких способов увеличения производительности и продления срока службы старых серверов и ПК. Поскольку хочется иметь возможность ее простого расширения в ближайшее несколько лет то ориентироваться сегодня на RDRAM можно только в самых требовательных случаях и лучше выбрать PC100/PC133 SDRAM.

В дисковой системе серверов уже давно применяется интерфейс SCSI. Сегодня он уже носит гордое имя SCSI-3 или Ultra160 и нет никаких серьезных причин использовать более медленный вариант поскольку этот интерфейс обратно совместим с Ultra2 и UltraWide. В основном выбор именно SCSI обусловлен необходимостью использования 4-х и более дисков а также высокой производительностью этого интерфейса в условиях мультизадачности. Кроме чистого SCSI часто применяют для повышения скорости и надежности RAID системы. При этом вместо использования одного-двух больших дисков по 36-72Gb чаще используется RAID из дисков по 9–18Gb

Основными параметрами, влияющими на производительность жестких дисков является скорость вращения дисков (RPM) и плотность записи. Сегодня для систем начального уровня применяются диски с RPM 7200, а для самых производительных серверов с RPM 10000. Некоторые современные модели представлены ниже:

- 7200 RPM: Quantum Atlas IV, Atlas V; Seagate Barracuda 18LP, Barracuda 18XL, Barracuda 36, Barracuda 50; Fujitsu MAE30xx; IBM Ultrastar 36LP, Ultrastar 18XP.

- 10000 RPM: Quantum Atlas 10k, Atlas 10k II; Seagate Cheetah 18LP, Cheetah 18XL, Cheetah 36LP, Cheetah 73; Fujitsu MAG30xx; IBM 36LZX, Ultrastar 36ZX, Ultrastar 18LZX

Для будущих систем будут применяться диски с еще более высоким RPM. Например Seagate в начале этого года представила модель Cheetah X15 с RPM 15000 и средним временем поиска менее 4ms.

SCSI контроллеры делаются многими производителями, часто один или два SCSI канала находятся прямо на серверной материнской плате. Для этого используются чипы Adaptec AIC-7892 Single Ultra160 PCI64/33MHz, AIC-7899 Dual Ultra160 PCI64/66MHz, LSI Logic (Symbios) SYM53C1010 Dual Channel Ultra160 PCI64/66MHz, QLogic ISP10160A Single Ultra160 PCI64/66MHz, ISP12160A Dual Ultra160 PCI64/66MHz. Конечно если необходима RAID система, то контроллер устанавливается отдельно. Отметим возможность использовать на некоторых материнских платах специальный слот (расширение PCI 32) — Adaptec RAID Port. В него можно установить карту типа Adaptec ARO-11xx и с использованием установленного на материнской плате SCSI контроллера получить RAID 0/1/5 контроллер.

Поскольку сервера обычно включаются в сети (иначе они бы назывались скорее высокопроизводительоыми рабочими станциями), то для сервера нужен сетевой адаптер или даже несколько. На сегодняшний момент можно использовать технологии 100BaseTX, ATM 155Mb/s, Gigabit Ethernet. Однако два последних варианта все еще относительно дороги. Для повышения скорости на технологии 100BaseTX можно применить особенные, серверные сетевые адаптеры, или коммутаторы с функцией multilink, которые объединяют несколько (до 4-х) физических 100Мбит/сек линий до сервера в одну логическую с увеличенной до 200-400Мбит/сек скоростью.

Что касается остальных компонентов, то они либо не сильно существенны для сервера (CDROM, видеокарта) и необходимо просто их присутстве, либо носят ярко выраженный специфический характер (библиотеки MO, Tape) и тогда можно еще написать несколько статей только про них.

Итак, если посмотреть на наше описание, можно заметить, что наиболее сложен выбор корпуса и материнской платы, поскольку остальные компоненты могуг быть легко заменены. Учитывая эту специфику, многие компании решили выпускать так называемые платформы для построения серверов. Они включают в себя корпус, материнскую плату и набор управляющего ПО. Остальные компоненты могут быть добавлены компанией-продавцом по требованием заказчика.

Конечно если нужен просто файл/принт сервер для совсем небольшой компании до можно собрать на базе недорогих двухпроцессорных плат даже на 440BX, паре Intel Celeron и Promise IDE RAID вполне работоспособную систему. Но если нужно больше, то без специализированных решений не обойтись.

Один из вариантов — купить готовый сервер, например HP или Compaq, или подешевле Acer или даже российской сборки, но для тех кто привык делать все своими руками этот вариант не очень интересен. Поэтому в качестве примера мы представляем платформу компании SuperMicro SuperServer 8050.

Она включает в себя корпус SC-850 и материнскую плату S2QR6.

В корпусе SC-850 есть 10 hotswap отсеков для стандартных 1" жестких дисков SCSI SCA (Ultra160). Для управления дисками применяются две специальные платы со своими контроллерами (фирмы QLogic) и активными терминаторами, с их использованием диски могут быть организованы на 2 канала по 5 дисков или один на 10. При этом все установки SCSI делаются автоматически. Даже при замене дисков не нужно открывать корпус и что-то перенастраивать. Кроме этих отсеков конечно есть и стандартные открытые: два для 3,5 устройств и три для 5,25 устройств.

В системе питания используется 3 hotswap источника по 350 Вт. Нормальный режим работы — 2 одновременно (т.е. 700 Вт) и один в находится в резерве. Конечно если нагрузка небольшая, система может работать и на одном БП.

Для охлаждения используется 10 управляемых вентиляторов. Из них 8 диаметром 90 мм гонят воздух на радиаторы процессоров, материнскую плату и платы расширения, и 2 больших 120 мм на жесткие диски. Первые допускают легкую замену без выключения сервера. Вторые в принципе тоже можно поменять в рабочем состоянии, но это немного сложнее. При отказе одного кроме подачи аварийного сигнала увеличивается скорость вращения других вентиляторов. Этот процесс контролируется специальной платой с микроконтроллером. Кроме того можно подключить еще до 10 вентиляторов с тахометрами к материнской плате (4 CPU, 4 chassis, 2 overheat).

Корпус снабжен множеством индикаторов: на передней панели: питание, активность сети, активность IDE, сбой питания, сбой вентиляторов охлаждения, перегрев в корпусе, перегрев в первом отсеке жестких дисков, перегрев во втором отсеке жестких дисков. Для каждого из 10 жестких дисков: активность, сбой. На блоках питания — нормальная работа/сбой. На материнской плате — питание активно. При возникновении аварийной ситуации подается звуковой сигнал, источник проблемы можно выяснить по индикации.

Материнская плата S2QR6 посторена на чипсете ServerWorks ServerSet III HE. Размеры ее внушительны — 18"×13", не даром для нее требуется такой корпус, как SC850. Эта материнская плата поддерживает до 4-х процессоров Pentium III Xeon (Slot2) 400–700MHz, только 100MHz FSВ (сейчас доступны версии на 500, 550 и 700MHz). Процессоры можно установить в количестве от 1 до 4-х. При этом неиспользуемые Slot2 необходимо закрыть специальными заглушками. Заметим, что несмотря на то, что этот чипсет сделан не Intel, на платформе прекрасно работают ОС Windows 2000 и RedHat Linux, не требуя каких-либо драйверов и обновлений в том числе и для мультипроцессорности. Для надежности на двух главный микросхемах чипсета установлены радиаторы.

Память модулями registered DIMM с ECC устанавливается на специальную плату — MEC (Memory Expansion Card). Поскольку для увеличения производительности применяется схема чередования, то модули устанавливаются группами по 4 в 4 банка (всего 16 слотов). Поддерживаются DIMM размером 128 MB, 256 MB, 512 MB и 1 GB, таким образом максимальный объем памяти может достигать 16 GB (а минимальный — 512 MB).

Для плат расширения предусмотрены слоты PCI: 2×64bit/66MHz, 4×64bit/33MHz, 2×32bit/33MHz. Суммарная пропускная способность всех шин PCI составляет 931 MB/sec. Это обеспечивается использованием чипсетом двух независимых 64bit PCI шин. Отметим, что PCI 64bit/33MHz допускает установку и стандартных 32bit плат, а для 64bit/66MHz требуются специальные, расчитанные на работу с 3,3 Вольт платы (хотя есть и универсальные 3,3/5V платы):

На плате установлено две микросхемы BIOS для защиты от некоторых вирусов и ошибок программирования, переключение между ними делается вручную перемычкой на плате. Плата использует ACPI/APM Plug and Play (PnP) 4 Mb AMI BIOS. Также есть весь стандартный набор портов — 2×IDE/ATA, 1×FDD, 2×COM, 1×LPT, 2×USB, PS/2 mouse & keyboard. Также присутствует PCI сетевой адаптер 10/100BaseTX на микросхеме Intel 82559.

Таким образом даже сегодня конфигурация данной серверной платформы может быть выбрана в широчайших пределах:

- процессор — от одного Pentium III Xeon 500 MHz до четырех на частоте 700 MHz

- память — от 512MB до 16GB

- дисковая система — от одного 9 GB SCSI диска до массива в 360 GB на 10 дисках (SCSI диски на 50 GB и 72 GB пока выше чем 1")

Вот только поиграть толком не получится :) — эта платформа не поддерживает шину AGP, хотя при такой процессорной мощи можно было-бы использовать программный расчет сцены, но к сожалению сегодня игры или согласны на программный OpenGL или умеют работать на нескольких процессорах, но не одновременно. Ну или можно поискать старые PCI видеокарты.

И в заключении традиционно приведем несколько цифр. Конечно сравнивать этот сервер с обычными ПК неправильно, главное в сервере именно его скорость как файлового сервера или сервера приложений, однако для общего представления о скорости его работы, эти цифры вполне подходят. Итак в сервер установлены 4 процессора Intel Pentium III Xeon с частотой 550MHz и L2 кешем 512KB, память объемом 1GB, жесткие диски Quantum Atlas 10k и PCI видеокарта Matrox Millennium. Только не забудьте, что большинство тестов на сервере работает только на одном из четырех процессоров (только L0phtCrack использует на 100% все сразу). Для сравнения используется средний ПК с процессором Intel Celeron 450 на плате SuperMicro 6DBU (440BX) и памятью 64Mb PC100, остальное то-же.

Есть необходимость подобрать вариант железа со следующими требованиями:

- установка в стойку (размер 1u/2u)

- наличие видеоадаптера на чипах ATI/nvidia

- (опционально) наличие звукового адаптера

- наличие удаленного управления (вкл/выкл/редирект монитора. Типа iLO/DRAC)

- 3-летняя гарантия NBD

- остальные ТТХ непринципиальны - 1хCPU типа Xeon-E3, 8Gb памяти и 1 HDD будет вполне достаточно, резервирование БП тоже не обязательно.

Возникают следующие вопросы:

1. Могут ли быть какие-нибудь подводные камни при установке обычной простенькой видеокарты в сервер?

Имеется в виду, что это будет Low-profile, пассивное охлаждение размером в 1 слот, малое энергопотребление.

Например SAPPHIRE Radeon HD 5450 HM

2. Что будет показывать консоль удаленного управления в случае установки доп. видеокарты?

3. Правильно ли я понимаю, что если в модели 2 PCIe, то можно будет и видео и аудио-карты запихнуть внутрь корпуса? На что обратить внимание?

4. Какие конкретные модели посмотреть (желательно с 2PCIe)?

Навскидку нашел следующие:

- Dell R220 (1xPCIe)/R230

- Lenovo RS140 (1xPCIe)/x3250

- HP DL320e Gen8 v2

Из вышеперечисленного больше всего нравится Dell R230 - современное железо, 2xPCIe.

5. Возможно есть какие-нибудь модели, в которых сразу есть интегрированные аудио или Ati/nvidia чипы?

Любые другие комментарии также приветствуются.

Заранее спасибо,

Алексей

На консоли удаленного управления отображается изображение, которое идет через основную встроенную видеокарту (она обычно интегрирована в чип IPMI). Если весь вывод идет через дополнительную карту, то ничего видно не будет.

Если вам нужна гарантия от вендора, то в сервер можете вставлять только валидированные продукты.

Из видеокарт там может быть какая-нибудь Quadro. И то не у всех моделей. Звуковых карт я ни разу не видел в таких списках. Поэтому в качестве звуковой карты возьмите лучше внешний USB девайс, вроде Xonar 3.

На консоли удаленного управления отображается изображение, которое идет через основную встроенную видеокарту (она обычно интегрирована в чип IPMI). Если весь вывод идет через дополнительную карту, то ничего видно не будет.

Tert писал(а): Если вам нужна гарантия от вендора, то в сервер можете вставлять только валидированные продукты.

Из видеокарт там может быть какая-нибудь Quadro. И то не у всех моделей.

Возможно я нахожусь в плену фантазий, но. Я правильно вас понял, что установка внутрь PCIe платы не описанной в compatibility list влечет за собой потерю гарантии?

У Dell видеокарта есть в списке опций только для R720/R730 и это Tesla K40M за $9000

У Супермикро есть материнские платы и корпуса для RM рабочих станций, в том числе под установку до 4х GPU, проприетарного формфактора. Это если пропустить пункт про гарантию.

Функционал KVM через IPMI можно получить с использованием PCoIP хост-карты, или видеокарт из серии FirePro RG****, самая старая RG220 - два монитора, 512М оперативки. Хост карта является высокопроизводительным фреймграббером с DVI или DP входов и компрессором видеоданных с заданным пользователем замылением на динамических сценах и прокидывает AC'97 звук и USB 2.0 устройства (скорость правда так себе, 20МБ/с не выжимает) но на FullHD камеру и микрофон хватает. Есть варианты хост контроллеров и тонких клиентов с SFP модулями, что позволяет сажать их просто на одно физическое волокно, возможно в с WDM c удаленным пользователем где-то в губокой шахте или электродуговой литейке . Для применения совместно с локальной консолью надо иметь HDMI/DVI сплиттер, опционально с S/PDIF выходом или уже со встроенным декодером PCM/DD и усилком для вывода звука с HDMI без звуковых карт на сервере. Полоса пропускания у PCoIP от 7мбит (софтовый сервер->софтовый клиент) до 220мбит/с на устройствах на чипах Tera2

sivanov писал(а): У Супермикро есть материнские платы и корпуса для RM рабочих станций, в том числе под установку до 4х GPU, проприетарного формфактора. Это если пропустить пункт про гарантию.

Я так понимаю, вы имеете в виду что-то типа 7047GR-TRF, верно?

Теоретически вариант, но, во-первых, не хотелось бы отказываться от гарантии, а, во вторых, контора крупная - HP/Dell/Lenovo

для нас это что-то понятное и используемое, а supermicro - совсем нестандарт.

sivanov писал(а): Функционал KVM через IPMI можно получить с использованием PCoIP хост-карты, или видеокарт из серии FirePro RG****, самая старая RG220 - два монитора, 512М оперативки. Хост карта является высокопроизводительным фреймграббером с DVI или DP входов и компрессором видеоданных с заданным пользователем замылением на динамических сценах и прокидывает AC'97 звук и USB 2.0 устройства (скорость правда так себе, 20МБ/с не выжимает) но на FullHD камеру и микрофон хватает. Есть варианты хост контроллеров и тонких клиентов с SFP модулями, что позволяет сажать их просто на одно физическое волокно, возможно в с WDM c удаленным пользователем где-то в губокой шахте или электродуговой литейке . Для применения совместно с локальной консолью надо иметь HDMI/DVI сплиттер, опционально с S/PDIF выходом или уже со встроенным декодером PCM/DD и усилком для вывода звука с HDMI без звуковых карт на сервере. Полоса пропускания у PCoIP от 7мбит (софтовый сервер->софтовый клиент) до 220мбит/с на устройствах на чипах Tera2

Во-первых, спасибо за интересный комментарий! С интересом почитал про PCoIP, Teradici и ATI R/RG карты.

Наш случай гораздо прозаичнее шахты или завода - обычный датацентр, задача - тестировать софт, который в т.ч. умеет задействовать мультимедийные ресурсы (поэтому нужно видео/аудио), постоянно на экран удаленной машины никто не смотрит.

Сейчас тестирование подобных вещей идёт на десктопах, которые неудобны в плане монтажа в стойку и неоптимальны с т.з. занимаемого в ней пространства, потому и задумались о возможности использования rack-mountable оборудования. Была надежда, что в качестве бонуса нахаляву будет функционал IP-KVM, но, похоже, что это было слишком оптимистично.

Относительно PCoIP/ATI RG**** карт мне кажется, что в нашем случае более универсальным решением будет просто IP-KVM (Raritan/Avocent). По цене я так понимаю отличия незначительные в случае расчета на десятки машин.

Сервер Supermicro SYS-2029U-TN24R4T — замена Backplane

Сразу на двух серверах Supermicro SYS-2029U-TN24R4T обнаружилась проблема — не работает 14-й дисковый слот. Докупили диски, вставили, а слот не работает. Непонятно с чем это связано, скорее всего какой-то брак партии.

Zabbix шаблон для мониторинга сервера Supermicro X11DPH-T

Делюсь полезным шаблоном для мониторинга сервера Supermicro X11DPH-T. Если быть более точным, то у сервера нет имени, у него материнка X11DPH-T и корпус 4 юнита. Только что собрал. В шаблоне 5 приложений, 59 элементов данных, 170 триггеров и 5 графиков. Мониторим по IPMI.

Битый слот на сервере Supermicro SYS-2029U-TN24R4T

При добавлении новых дисков на сервера Supermicro SYS-2029U-TN24R4T обнаружилось, что 14-й дисковый слот не работает. На всех серверах. Это печально.

Сервер Supermicro SYS-6019P-MTR

Новая модель сервера Supermicro SYS-6019P-MTR, которая пришла на смену SYS-6018R-MTR. Недорогой одноюнитовый сервер.

RAID1 на материнской плате Supermicro X11DPH-T

Собираем RAID1 из двух SATA3 дисков на материнской плате Supermicro X11DPH-T. Материнская плата оснащена чипом Intel C622, который по спецификации поддерживает массивы RAID 0,1,5,10.

Сервер Supermicro SYS-1029P-WTRT

Есть два подхода к выбору сервера. Можно выбрать сервер с учётом возможной расширяемости или роста определённого показателя: производительности, объёма оперативки или места на дисках. А можно выбрать сервер под определённую задачу. Первый способ более затратный, но с заделом на будущее. Второй — оптимальный по затратам, но почти без возможности роста.

Установка Windows Server 2016 на сервер Supermicro с контроллером MegaRAID 9460-8i

Доброй ночи. На улице стемнело, поэтому мы начинаем установку операционной системы Windows Server 2016 на аппаратный сервер Supermicro SYS-1029P-WTRT. В качестве носителя будет использоваться RAID1 массив из двух NVMe дисков, собранных на аппаратном RAID контроллере Avago MegaRAID 9460-8i.

Замена блока питания на сервере Supermicro SYS-2029U-TN24R4T

На сервере Supermicro SYS-2029U-TN24R4T вышел из строя один из блоков питания. Назначение сервера — сервер баз данных. Забит NVMe дисками.

История о бракованных серверах Supermicro SYS-2029U-TN24R4T

Есть у нас пара серверов Supermicro SYS-2029U-TN24R4T из одной партии. В каждый сервер можно запихнуть 24 NVMe диска.

Supermicro SYS-6018R-MTR — установка адаптера SFP+

Переводим сервер Supermicro SYS-6018R-MTR на десятигигабитную сеть. Будем устанавливать адаптер Mellanox MCX4121A-XCAT ConnextX-4 Lx 10GbE.

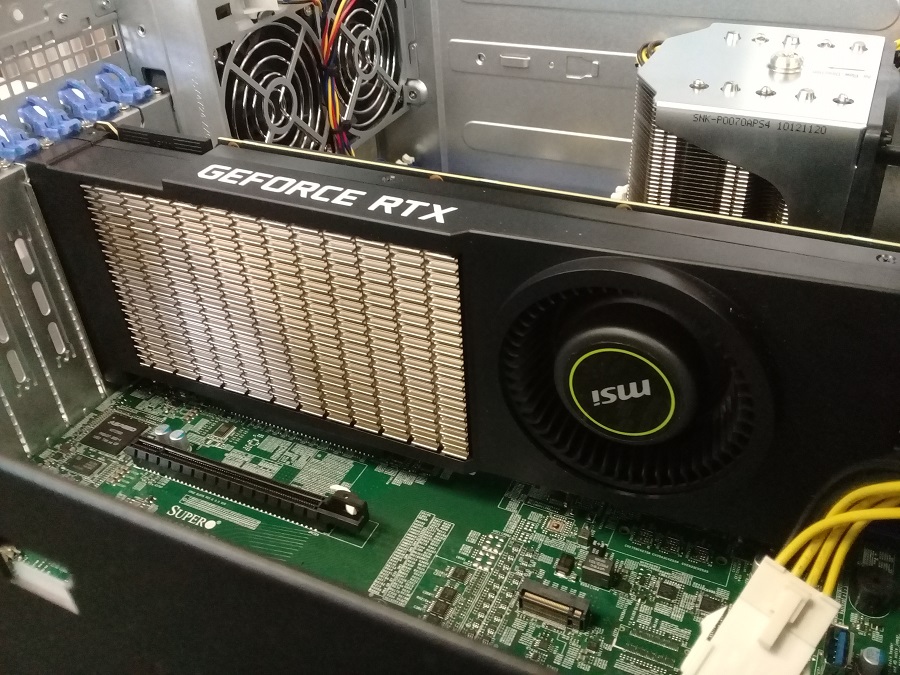

Есть сервер Supermicro GPU SuperWorkstation 7049GP-TRT. В сервер можно установить до 4 больших GPU 10.5' двойной ширины.

В сервере две видеокарты с активным охлаждением MSI Geforce RTX 3090 AERO 24G на базе архитектуры NVIDIA Ampere.

Собираю тестовый стенд:

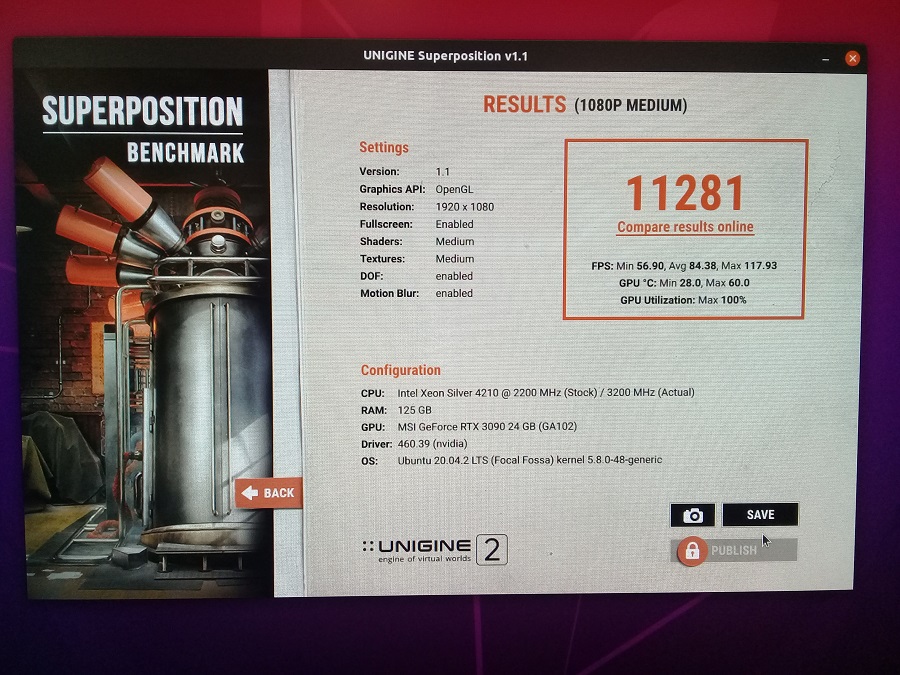

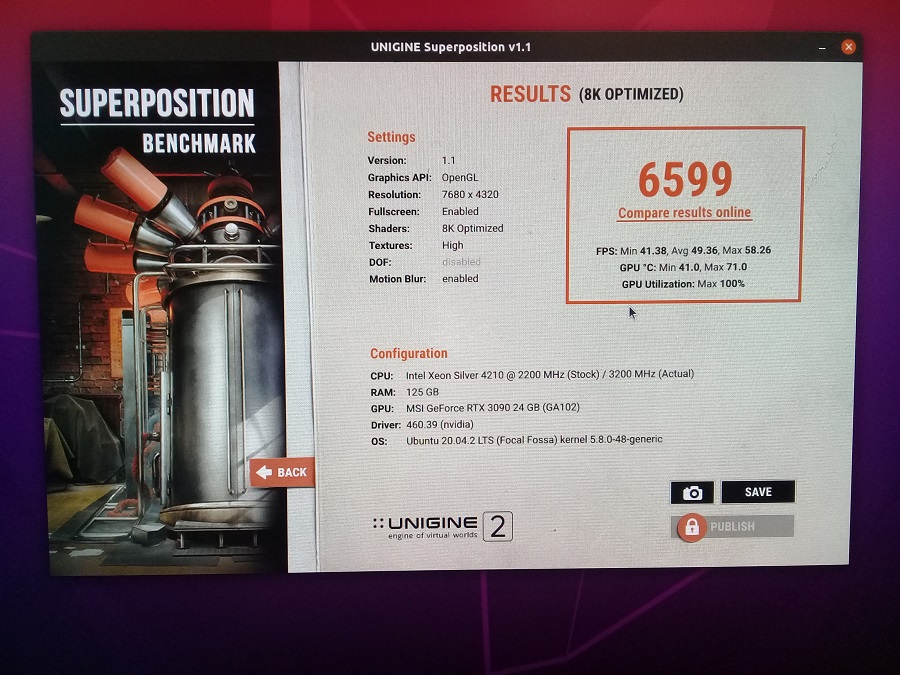

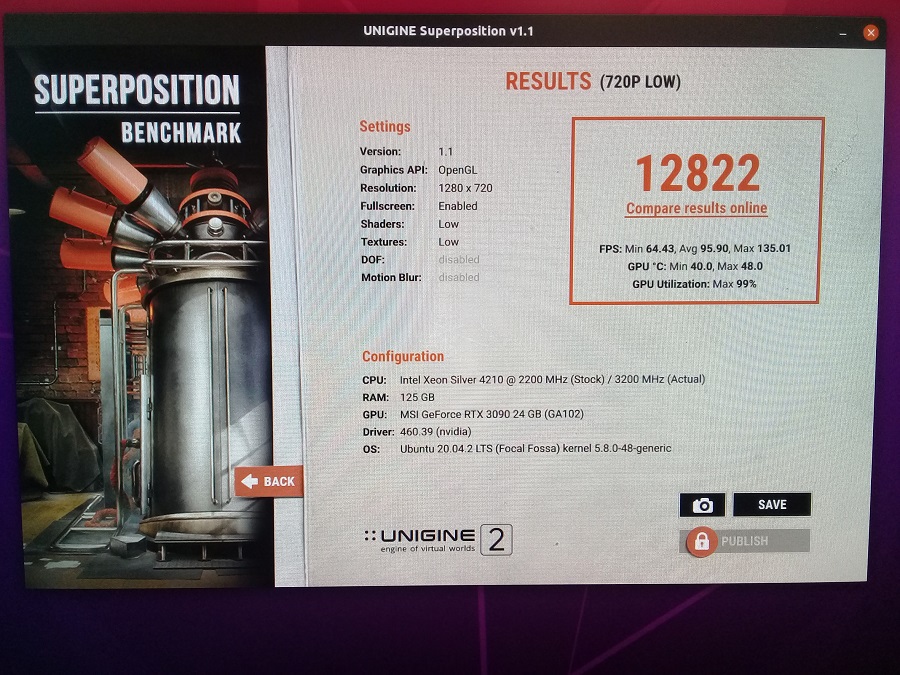

- Сервер: Supermicro GPU SuperWorkstation 7049GP-TRT

- GPU с активным охлаждением: MSI Geforce RTX 3090 AERO 24G

- Процессор: Intel Xeon Silver 4210 CPU @ 2.20GHz

- Память: 128 Гб 2400 МГц

- ОС: Ubuntu Desktop 20.04

- Benchmark: Superposition на движке Unigine.

Тестировать будем только одну видеокарту.

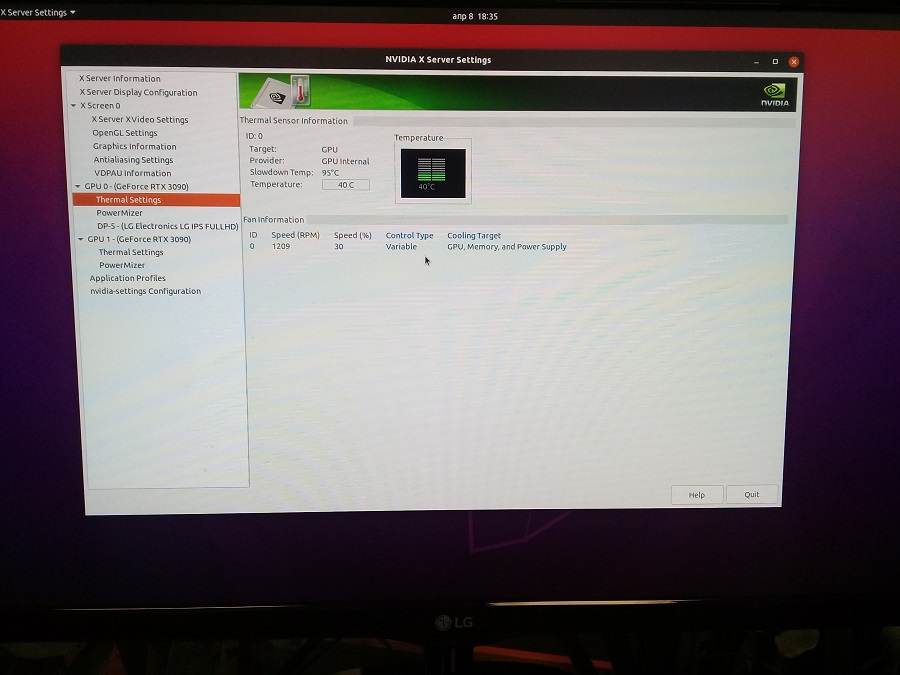

Сервер собран, теперь было бы неплохо проверить, что видеокарты определяются и работают. Benchmark тест нужно какой-нибудь прогнать.

Для начала в BIOS переключаю приоритет вывода изображения с интегрированной видеокарты на установленную. PCIe/PCI/PnP Configuration > VGA Priority, Onboard меняю на Offboard. Подключаю монитор к тестируемой видеокарте.

Собираю из двух дисков RAID 1. Для входа в утилиту управления SATA контроллером нужно нажать Ctrl + i при загрузке.

Временно накатываю Ubuntu.

Проверим, что видеокарты определились:

Теперь установим драйвера NVIDIA. Посмотрим, что предлагает Ubuntu:

Если версия драйверов устраивает, а меня устраивает, то соглашаемся:

Для контроля состояния видеокарт можно использовать утилиту nvidia-smi:

Текущая версия драйверов 455, можно установить драйвера вручную, например, версию 460:

Итак, обе видеокарты обнаружены и нормально работают.

В GUI информацию о видеокартах можно посмотреть с помощью NVIDIA X Server Settings.

Теперь нужно выбрать какой-нибудь тест GPU. Мне не принципиально какой, нашёл Benchmark: Superposition на движке Unigine:

Выполняем скрипт, после в распакованной директории запускаем программу.

На средних настройках получилось 11281 (11313 во второй попытке) очков.

На максимальных — 6599.

На минимальных — 12822.

Тестирование завершено. В BIOS переключаю приоритет вывода изображения обратно на интегрированную видеокарту. PCIe/PCI/PnP Configuration > VGA Priority, Offboard меняю на Onboard.

Читайте также: