Сколько потребляет видеокарта 1070

Сведения о производителе: Компания Gigabyte Technology (торговая марка Gigabyte) основана в 1986 году в Китайской Республике (Тайвань). Штаб-квартира в Тайбэе/Тайвань. Изначально создавалась как группа разработчиков и исследователей. В 2004 году на базе компании был образован холдинг Gigabyte, в который вошли Gigabyte Technology (разработка и производство видеокарт и материнских плат для ПК); Gigabyte Communications (производство коммуникаторов и смартфонов под маркой GSmart (с 2006 г.)); Gigazone International (корпуса, блоки питания и системы охлаждения для ПК, мониторы (торговая марка Envision)); G-Style Co (производство ноутбуков и планшетных ПК). Производство на Тайване и в Китае.

Устройство(а)

Карта имеет 8 ГБ памяти GDDR5 SDRAM, размещенной в 8 микросхемах по 8 Гбит на лицевой стороне PCB.

Микросхемы памяти Samsung (GDDR5). Микросхемы рассчитаны на номинальную частоту работы в 2000 (8000) МГц.

Мы знаем, что практически все ускорители компании Gigabyte полностью спроектированы собственными инженерами (а не являются копиями референс-карт). Это относится и к данному продукту. Сходство с референс-картой есть только в расположении микросхем памяти (это логично) и в наборе видеовыходов.

Блок питания переработан: схема имеет 6 фаз (плюс 2 фазы на питание микросхем памяти) и управляется цифровым контроллером uP9511P производства uPI Semiconductor. Однако это не все. Видеокарта поддерживает большой набор функций мониторинга, за которые отвечает контроллер Holtek HT32F52241 на базе микроконтроллера ARM Cortex -M0+. Он же регулирует мощность системы питания.

Традиционная схема выпуска PCB — Ultra Durable — подразумевает особую печатную плату с двойными медными слоями и набором высококачественных дросселей и твердотельных конденсаторов.

Схема питания обеспечивает очень гибкое регулирование напряжений на ядре и памяти. За это отвечает фирменная утилита Gigabyte Xtreme Engine, которая поставляется с картой на диске, а также ее можно скачать с сайта производителя.

Программа позволяет выбрать один из уже предустановленных режимов работы ускорителя в 3D: OC, Gaming, Eco. Различия лишь в частотах работы. Либо можно создать свой собственный профиль режима работы, установив частоты и вольтажи. Утилита также позволяет выставить режим подсветки кулера, управлять кулером вручную.

Стоит акцентировать внимание на прилично повышенных частотах работы ускорителя относительно стандартных параметров референс-карты (примерно на 13% выше по ядру), что может дать прирост производительности примерно от 10% до 11% в зависимости от разрешения и режима работы.

Перед нами кулер серии WindForce, которая давно уже себя зарекомендовала с самой лучшей стороны, ибо практически все кулеры WindForce очень тихие. Главной его частью являются два массивных пластинчатых никелированных радиатора, соединенных между собой тепловыми трубками, впрессованными в основание, которые обеспечивают равномерное распределение тепла по ребрам радиатора.

Поверх радиатора установлен кожух с тремя вентиляторами, работающими на одинаковой частоте вращения. Лопасти имеют особый профиль (поперечное сечение), и производитель декларирует сильно пониженный уровень шума при аналогичном потоке воздуха в сравнении с обычными лопастями. Следует также напомнить, что кулеры WindForce останавливают вентиляторы в случае простоя или малой нагрузки (если температура GPU не выше 55 градусов). Поэтому не стоит пугаться, если при запуске ПК вентиляторы на ускорителе не вращаются. Кстати, индикатор на торце кулера информирует о том, вращаются ли вентиляторы.

Микросхемы памяти и силовые транзисторы охлаждаются особыми пластинами, прикрученными к основному радиатору. На обороте видеокарты установлена толстая пластина, которая обеспечивает жесткость относительно массивной видеокарты (предотвращая изгиб печатной платы).

СО оснащена особой подсветкой, цветом которой можно управлять с помощью вышеуказанной утилиты.

После 6-часового прогона под нагрузкой максимальная температура ядра не превысила 59 градусов, что является великолепным результатом для видеокарты такого уровня.

Комментарий к Рейтингам полезности

Исходя из цен, которые мы имели на момент написания материала, продукт Gigabyte занял первое место в группе. Да и в целом GTX 1070 лидирует в данной выборке топовых ускорителей в ценовом диапазоне от 500 до 700 долларов.

Gigabyte GeForce GTX 1070 G1 Gaming (8 ГБ) — очень хороший вариант 3D-акселератора, входящего в семейство топовых ускорителей. Этот продукт демонстрирует производительность в среднем на 10% выше, чем референс-карта. Ускоритель обладает очень тихой системой охлаждения, при этом нагрев даже под сильной нагрузкой остается небольшим. Имеются бонусы в виде возможности гибкого регулирования частот и режимов работы, так что карта отлично подойдет «оверклокерам средней руки», довольствующимся повышением частот при штатной СО. По поводу дополнительного ручного разгона: мы полагаем, что такие изыскания интересны лишь очень малому проценту пользователей, так что детального изучения вопроса не проводили. Мы изучим этот вопрос при тестировании Gigabyte GTX 1070 Xtreme Gaming, потому что та видеокарта официально входит в серию для оверклокеров. Стоит заметить, что любителям моддинга данный продукт понравится гибко регулируемой подсветкой на корпусе кулера. Акселератор полностью готов для работы совместно с устройствами VR.

Несмотря на присутствующую критику и немалую стоимость, релиз флагманской видеокарты GeForce GTX 1080 для компании NVIDIA оказался весьма удачным. В производительности новинка обошла не только Radeon R9 Fury X, но и недавнего флагмана-собрата GeForce GTX Titan X. И вот новый приятный сюрприз для геймеров — мощная GeForce GTX 1070 со стоимостью партнерских моделей от 379 долларов.

В основании GeForce GTX 1070 лежит видеочип с маркировкой GP104, такой же, как и у старшей модели 1080, но с меньшим количеством универсальных процессоров (ядер CUDA). Данный графический чип создан на новой микроархитектуре Pascal от NVIDIA. Архитектура Pascal принесла нам долгожданный 16-нанометровый техпроцесс, который позволил существенно повысить рабочие частоты графического ядра. Так в режиме GPU Boost это значение может достигать 1.7-1.8 ГГц. Вместе с новым типом видеопамяти GDDR5X, улучшенным алгоритмом сжатия текстур, всё это позволяет выйти видеокартам GeForce 10-й серии на совершенно новый уровень производительности. Порадует GeForce GTX 1070 и оверклокеров в плане разгона.

Рассмотрим технические характеристики новинки и предшественницы.

| GeForce GTX 1070 | GeForce GTX 970 | |

| Кодовое имя чипа | GP104 | GM204 |

| Архитектура | Pascal | Maxwell |

| Техпроцесс | 16 нм | 28 нм |

| Количество транзисторов | 7,2 млрд. | 5,2 млрд. |

| Тактовая частота, МГц: базовая/ boost | 1506/1683 | 1050/1178 |

| Текстурных блоков | 120 | 104 |

| Универсальных процессоров | 1920 | 1664 |

| Блоков растеризации (ROPs) | 64 | 64 |

| Тип видеопамяти | GDDR5X | GDDR5 |

| Объем видеопамяти, ГБ | 8 | 4 |

| Разрядность шины, бит | 256 | 256 |

| Частота памяти, МГц: | 2000 | 1750 |

| Интерфейс | PCI-Express 3.0 | PCI-Express 3.0 |

| Потребляемая мощность, Вт | 150 | 145 |

| Максимальная температура, °С | 94 | 98 |

Рассматриваемая видеокарта поддерживает технологии Multi-Projection, VR Ready, NVIDIA Ansel, NVIDIA SLI Ready, NVIDIA G-SYNC, NVIDIA GameStream, Microsoft DirectX 12 API, Vulkan API, OpenGL 4.5.

В плане производительности GeForce GTX 1070 и в синтетических и в игровых тестах находится либо на уровне GeForce GTX 980 Ti, либо немного её превосходит.

Тестирование GeForce GTX 1070 в играх* (среднее количество FPS )

| Игры/Настройки | Ультра 1920х1080 px | Ультра 2560х1440 px | Ультра 3840х2160 px |

| Battlefield 4 | 137 fps | 89 fps | 44 fps |

| Fallout 4 | 125 fps | 85 fps | 46 fps |

| Metro: Last Light | 87 fps | 48 fps | 27 fps |

| GTA V | 92 fps | 68 fps | 34 fps |

| The Witcher 3: Wild Hunt | 64 fps | 50 fps | 31 fps |

*Для тестирования использовалась следующая конфигурация стенда: процессор Intel Core i7-6700K, мат. плата ASUS Maximus VIII Extreme, оперативная память G.Skill 16 Гб, SSD Plextor PX-256M6Pro, блок питания Corsair AX1500i, операционная система Windows 10 64 Bit. Версия драйвера NVIDIA GeForce: 375.95.

Таким образом, мы видим, что GeForce GTX 1070 без проблем справляется с самыми требовательными играми при разрешении QHD и максимальной детализации. Тем же, кто ищет комфортной игры в 4К, графические настройки придется понизить, или же присмотреться к старшей GeForce GTX 1080.

Мобильный вариант видеокарты GeForce GTX 1070 был анонсирован компанией NVIDIA 1 сентября 2016 года. У новой модели, как и у других графических адаптеров 10-й серии для ноутбуков, отсутствует привычная буква «М» в названии, сообщая нам о том, что данная мобильная видеокарта является аналогом версии для стационарных компьютеров.

В основании рассматриваемой модели находится видеочип GP104 новой графической архитектуры Pascal. От модели GeForce GTX 1070 для стационарных компьютеров мобильную версию отличает немного сниженная тактовая частота графического процессора, но при этом чуть большее количество шейдеров (ядер CUDA). Так, имея базовую тактовую частоту 1443 МГц, в режиме GPU Boost видеокарта может «разгоняться» до 1645 МГц. Общая же производительность версии для ноутбуков будет близка к десктопному варианту или равна ему. Соответственно, последние требовательные игры 2015-16 годов будут отлично воспроизводиться с пресетом «Ультра» при разрешении FullHD. Также игровые новинки без проблем запустятся и при разрешении 4К, но на средне-высоких настройках. Подробное игровое тестирование смотрите ниже.

Мобильный графический ускоритель GeForce GTX 1070 поддерживает технологии Multi-Projection, VR Ready, NVIDIA Ansel, NVIDIA SLI Ready, NVIDIA G-SYNC, NVIDIA GameStream, Vulkan API, OpenGL 4.5, а также Microsoft DirectX 12 API. Вместе с этим данная видеокарта поддерживает технологию Battery Boost, позволяющую продлить время «жизни» ноутбука в игровом режиме от батареи.

Технические характеристики (могут быть изменены производителем)

Тестирование в играх* (среднее количество FPS )

| Игры/Настройки | Ультра 1920х1080 px | Ультра 3840х2160 px |

Battlefield 1 | 118 fps | 45 fps |

Watch Dogs 2 | 57 fps | 32 fps |

| Call of Duty: Infinite Warfare | 109 fps | 55 fps |

| DOOM 2016 | 108 fps | 46 fps |

| FarCry Primal | 78 fps | 35 fps |

| Mafia III | 47 fps | 20 fps |

| Fallout 4 | 96 fps | 41 fps |

| The Witcher 3: Wild Hunt | 53 fps | 32 fps |

| GTA 5 | 65 fps | 34 fps |

| Battlefield 4 | 132 fps | 43 fps |

| Metro: Last Light | 90 fps | 28 fps |

| Crysis 3 | 69 fps | 29 fps |

*В зависимости от модели и конфигурации ноутбука результаты тестов могут отличаться

В заключение можно отметить, что производительность GeForce GTX 1070 «на голову» выше прошлого мобильного флагмана GeForce GTX 980M. А вот как это отразится на стоимости игровых ноутбуков с новым видеоадаптером — скоро увидим.

Вторая видеокарта на новейшем графическом процессоре NVIDIA архитектуры Pascal обещает быть ещё более интересной, чем GeForce GTX 1080, поскольку она стоит сразу на 35 % дешевле, хотя по производительности готова конкурировать с флагманом предыдущего поколения – GeForce GTX 980 Ti.

Тестирование производительности видеокарт было проведено в закрытом корпусе на системе следующей конфигурации:

- системная плата: ASUS Sabertooth X79 (Intel X79 Express, LGA2011, BIOS 4801 от 28.07.2014);

- центральный процессор: Intel Core i7-3970X Extreme Edition 3,5/4,0 ГГц (Sandy Bridge-E, C2, 1,1 В, 6 × 256 Kбайт L2, 15 Мбайт L3);

- система охлаждения CPU: ARCTIC Liquid Freezer 240 (4 × 1100 об/мин);

- термоинтерфейс: ARCTIC MX-4;

- оперативная память: DDR3 4 × 8 Гбайт G.SKILL TridentX F3-2133C9Q-32GTX (X.M.P. 2133 МГц, 9-11-11-31, 1,6 В);

- видеокарты:

-

8 Гбайт 1607-1734(1898)/10008 МГц; 6 Гбайт 1000-1076(1189)/7012 МГц;

- NVIDIA GeForce GTX 1070 8 Гбайт 1506-1683(1886)/8008 МГц; 4 Гбайт 1050/1000 МГц;

- Inno3D iChill GeForce GTX 980 Ultra HerculeZ X4 Air Boss 4 Гбайт 1126-1227/7000 МГц (снижены до номинальных для GTX 980); 4 Гбайт 1050-1178/7012 МГц (GTX970-DCMOC-4GD5);

В первую очередь, мы сравнили NVIDIA GeForce GTX 1070 с эталонными версиями NVIDIA GeForce GTX 1080 и NVIDIA GeForce GTX 980 Ti.

Кроме того, мы включили в тестирование оригинальную Inno3D iChill GF GTX 980 Ultra HerculeZ X4 Air Boss на приведённых к номинальным для GeForce GTX 980 частотах и компактную ASUS GeForce GTX 970 DC Mini — как модель, которую GeForce GTX 1070 собой заменяет.

Из видеокарт на графических процессорах AMD в тестирование включена SAPPHIRE NITRO Radeon R9 FURY 4 Гбайт.

Ввиду очень серьёзных ограничений по времени тестирования, все участники тестов были проверены только на номинальных частотах. В следующих обзорах оригинальных моделей GeForce GTX 1070 и GTX 1080, коих, мы надеемся, будет очень много, мы обязательно уделим внимание тестированию при разгоне. Добавим, что значение Power Limit на всех видеокартах было выставлено на максимум.

Для снижения зависимости производительности видеокарт от скорости платформы 32-нм шестиядерный процессор при множителе 48, опорной частоте 100 МГц и активированной на уровень Ultra High функции Load-Line Calibration был разогнан до 4,8 ГГц с повышением напряжения в BIOS материнской платы до 1,385 В.

Технология Hyper-Threading активирована. При этом 32 гигабайта оперативной памяти функционировали на частоте 2,133 ГГц с таймингами 9-11-11-20_CR1 при напряжении 1,6125 В.

Тестирование, начатое 28 мая 2016 года, было проведено под управлением операционной системы Microsoft Windows 10 Professional со всеми обновлениями на указанную дату и с установкой следующих драйверов:

- чипсет материнской платы Intel Chipset Drivers – 10.1.1.18 WHQL от 04.04.2016;

- Intel Management Engine Interface (MEI) – 11.0.5.1192 WHQL от 04.05.2016;

- драйверы видеокарт на графических процессорах NVIDIA – GeForce 368.13 beta для GTX 1080, GeForce 368.19 beta для GTX 1070 и GeForce 368.22 WHQL от 23.05.2016 для остальных NVIDIA-карт;

- драйверы видеокарт на графических процессорах AMD – AMD Radeon Software Crimson 16.5.3 WHQL от 24.05.2016.

В силу ограничений монитора производительность видеокарт была проверена в разрешениях 1920 × 1080 и 2560 × 1440 пикселей. Для тестов использовались два режима качества графики: Quality + AF16x – качество текстур в драйверах по умолчанию с включением анизотропной фильтрации уровня 16х и Quality + AF16x + MSAA 4х(8х) с включением анизотропной фильтрации уровня 16х и полноэкранного сглаживания степени 4x или 8x, в случаях, когда среднее число кадров в секунду оставалось достаточно высоким для комфортной игры. В отдельных играх в силу специфики их игровых движков были использованы иные алгоритмы сглаживания, что будет указано далее в методике и на диаграммах. Включение анизотропной фильтрации и полноэкранного сглаживания выполнялось непосредственно в настройках игр. Если же данные настройки в играх отсутствовали, то параметры изменялись в панели управления драйверов Crimson или GeForce. Там же была принудительно отключена вертикальная синхронизация (V-Sync). Кроме указанного, никаких дополнительных изменений в настройки драйверов не вносилось.

Видеокарты были протестированы в двух графических тестах и в пятнадцати играх, обновлённых до последних версий на дату начала подготовки материала. Список тестовых приложений выглядит следующим образом (игры и далее результаты тестирования в них расположены в порядке их официального выхода):

- 3DMark (2013) (DirectX 9/11) – версия 2.0.2067, тестирование в сценах Cloud Gate, Fire Strike, Fire Strike Extreme и Fire Strike Ultra;

- Unigine Valley Bench (DirectX 11) – версия 1.0, максимальные настройки качества, AF16x и (или) MSAA 8x, разрешение 1920 × 1080 и 2560 × 1440 пикселей;

- Crysis 3 (DirectX 11) – версия 1.3.0.0, все настройки качества графики на максимум, степень размытости средняя, блики включены, режимы с FXAA и с MSAA 4x, двойной последовательный проход заскриптованной сцены из начала миссии Swamp продолжительностью 105 секунд;

- Metro: Last Light (DirectX 11) – версия 1.0.0.15, использовался встроенный в игру тест, настройки качества графики и тесселляция на уровне Very High, технология Advanced PhysX в двух режимах тестирования, тесты с SSAA и без сглаживания, двойной последовательный прогон сцены D6;

- Company of Heroes 2 (DirectX 11) – версия 4.0.0.21375, двойной последовательный прогон встроенного в игру теста при максимальных настройках качества графики и физических эффектов;

- Battlefield 4 (DirectX 11) – версия 1.2.0.1, все настройки качества графики на Ultra, двойной последовательный прогон заскриптованной сцены из начала миссии TASHGAR продолжительностью 110 секунд (для видеокарт на GPU AMD использовался API Mantle);

- Thief (DirectX 11) – версия 1.7 build 4158.21, настройки качества графики на максимальный уровень, технологии Paralax Occlusion Mapping и Tessellation активированы, двойной последовательный прогон встроенного в игру бенчмарка (для видеокарт на GPU AMD использовался API Mantle);

- Sniper Elite III (DirectX 11) – версия 1.15a, настройки качества на уровне Ultra, V-Synс отключён, тесселяция и все эффекты активированы, тесты с SSAA 4x и без сглаживания, двойной последовательный прогон встроенного в игру бенчмарка (для видеокарт на GPU AMD использовался API Mantle);

- Middle-earth: Shadow of Mordor (DirectX 11) – build 1951.27, все настройки качества вручную выставлены на максимальный и Ultra-уровень, тесселяция и глубина резкости активированы, не менее двух последовательных прогонов встроенного в игру бенчмарка;

- Grand Theft Auto V (DirectX 11) – build 678, настройки качества на уровне Very High, игнорирование предложенных ограничений включено, V-Synс отключена, FXAA активировано, NVIDIA TXAA выключено, MSAA для отражений выключено, мягкие тени NVIDIA/AMD;

- DiRT Rally (DirectX 11) – версия 1.1, использовался встроенный в игру тест на трассе Okutama, настройки качества графики на максимальный уровень по всем пунктам, Advanced Blending – On; тесты с MSAA 8x и без сглаживания;

- Batman: Arkham Knight (DirectX 11) – версия 1.6.2.0, настройки качества на уровне High, Texture Resolutioin normal, Anti-Аliasing on, V-Synс отключена, тесты в двух режимах – с активацией двух последних опций NVIDIA GameWorks и без них, двойной последовательный прогон встроенного в игру теста;

- Tom Clancy's Rainbow Six: Siege (DirectX 11) – версия 3.1, настройки качества текстур на уровне Very High, Texture Filtering – Anisotropic 16X и прочие максимальные настройки качества, тесты с MSAA 4x и без сглаживания, двойной последовательный прогон встроенного в игру теста;

- Rise of the Tomb Raider (DirectX 12) – версия 1.0 build 647.2_64, все параметры на уровень Very High, Dynamic Foliage – High, Ambient Occlusion – HBAO+, тесселяция и прочие методики улучшения качества активированы, по два цикла теста встроенного бенчмарка (сцена Geothermal Valley) без сглаживания и с активацией SSAA 4.0;

- Far Cry Primal (DirectX 11) – версия 1.3.3, максимальный уровень качества, текстуры высокого разрешения, объёмный туман и тени на максимум, встроенный тест производительности без сглаживания и с активацией SMAA;

- Tom Clancy’s The Division (DirectX 11) – версия 1.2, максимальный уровень качества, все параметры улучшения картинки активированы, Temporal AA – Supersampling, режимы тестирования без сглаживания и с активацией SMAA 1X Ultra, встроенный тест производительности, но фиксация результатов FRAPS;

- Hitman (DirectX 12) – версия 1.1.2, встроенный тест при настройках качества графики на уровне «Ультра», SSAO включено, качество теней «Ультра», защита памяти отключена.

Если в играх реализована возможность фиксации минимального числа кадров в секунду, то оно также отражалось на диаграммах. Каждый тест проводился дважды, за окончательный результат принималось лучшее из двух полученных значений, но только в случае, если разница между ними не превышала 1 %. Если отклонения прогонов тестов превышали 1 %, то тестирование повторялось ещё как минимум один раз, чтобы получить достоверный результат.

Результаты тестов производительности

На диаграммах результаты тестирования видеокарт на графических процессорах NVIDIA выделены зелёной заливкой, а единственная видеокарта на графическом процессоре AMD отражена характерным для данного производителя красным цветом. Для выделения показателей NVIDIA GeForce GTX 1070 мы выбрали тёмно-бирюзовый цвет. Добавим, что на диаграммах в каждом режиме качества результаты тестов отсортированы сверху вниз в порядке убывания стоимости видеокарт.

В данном разделе вашему вниманию будут представлены лишь результаты тестирования видеокарт на диаграммах, а их анализ мы проведем по сводным диаграммам в следующем разделе статьи. Добавим, что для новых игр, недавно включённых в тестирование, дополнительно приведены детальные настройки качества.

При подборе комплектующих для нового компьютера очень важно правильно выбрать блок питания (БП), поскольку недостаточная мощность будет приводить к нестабильной работе ПК. С другой стороны, покупать БП с большим запасом также не лучшая идея, так как это сильно ударит по бюджету и не позволит собрать оптимальную конфигурацию. В данной статье мы расскажем, какой блок питания нужен для видеокарт NVIDIA GEFORCE GTX 1060, 1070, 1070 Ti, 1080 и 1080 Ti.

Установка и драйверы

Блок питания для GEFORCE GTX 1070 и GTX 1070 Ti

Для того чтобы узнать, какой блок питания подойдет для видеокарты NVIDIA GEFORCE GTX 1070 и GTX 1070 Ti нам нужно изучить характеристики на сайте компании NVIDIA. Согласно официальным характеристикам, данная видеокарта потребляет 150-180 Вт мощности. При чем этот показатель одинаковый, как для обычной версии, так и для улучшенной версии с приставкой Ti.

Также в характеристиках видеокарты компания NVIDIA дает рекомендации по мощности блока питания. В этом случае для обоих версий GTX 1070 рекомендуемая мощность БП составляет 500 Вт .

Проверить рекомендуемую мощность блока питания, которую указала NVIDIA, можно при помощи онлайн калькулятора БП. Данные калькуляторы позволяют примерно оценить мощность блока питания на основе используемых комплектующих. В нашем случае мы будем пользоваться калькулятором от MSI. Мы укажем процессор Intel Core i9 9900KF, одну видеокарту GEFORCE GTX 1070 Ti, 2 жестких диска, 4 модуля оперативной памяти, 4 вентилятора, 4 дополнительных карты PCI express и 1 DVD-привод. С такими комплектующими калькулятор от MSI рекомендует чуть больше 450 Вт .

В данном случае калькулятор от MSI выдал результат на 50 Вт меньше, чем рекомендует NVIDIA. Поэтому, для максимальной надежности нужно ориентироваться на большее значение.

Таким образом можно сделать вывод, что для штатной работы видеокарты NVIDIA GEFORCE GTX 1070 или 1070 Ti нужен блок питания мощностью 500 Вт . Если вы хотите оставить место для апгрейда или просто хотите перестраховаться, то вы можете установить БП с некоторым запасом. Например, можно приобрести модель, которая выдаст на 100 Вт больше. Таким образом, для GTX 1070 и GTX 1070 Ti мощность БП с запасом будет составлять 600 Вт .

Конфигурация тестового стенда

- Компьютер на базе процессора Intel Core i7-5960X (Socket 2011):

- процессор Intel Core i7-5960X (o/c 4 ГГц);

- СО Intel Thermal Solution RTS2011LC;

- системная плата ASRock Fatal1ty X99X Killer на чипсете Intel X99;

- оперативная память 16 ГБ DDR4 G.Skill Ripjaws4 F4-2800C16Q-16GRK 2800 МГц;

- жесткий диск Seagate Barracuda 7200.14 3 ТБ SATA2;

- 2 SSD Corsair Neutron SSD CSSD-N120GB3-BK;

- блок питания Thermaltake Toughpower DPS G 1050W (1050 Вт);

- корпус Corsair Obsidian 800D Full Tower.

Результаты тестов: сравнение производительности

- Fallout 4

- Watch Dogs

- Grand Theft Auto V

- The Witcher 3: Wild Hunt

- Middle-earth: Shadow of Mordor

- Batman: Arkham Origins

- Tom Clancy’s Rainbow Six: Siege

- Far Cry Primal

- Hitman (2016)

- Dragon Age: Inquisition

Выводы

Повышенные частоты работы карты (в режиме ОС, разумеется!) дают весьма приличные дивиденды: в среднем прирост относительно референсного GTX 1070 составил около 10%. (Почему не все 13% прироста — в соответствии с повышенной частотой ядра? Тому есть много причин: частота работы памяти практически не повышена, имеются особенности работы драйвера Nvidia, который следит за соблюдением планки энергопотребления, постоянно меняя частоты работы, и иные причины.) Мы видим, что данный ускоритель Gigabyte сильно приблизился по производительности к GTX 1080.Список инструментов тестирования

-

Fallout 4 (Bethesda Games Studios/Bethesda Softworks)

Блок питания для GEFORCE GTX 1080 и GTX 1080 Ti

Для того чтобы решить, какой БП подойдет для видеокарт NVIDIA GEFORCE GTX 1080 и GTX 1080 Ti нам нужно изучить официальные характеристики на сайте NVIDIA. Согласно официальной информации, видеокарта GTX 1080 потребляет 180 Вт , а видеокарта GTX 1080 Ti – 250 Вт .

![потребление энергии GEFORCE GTX 1080 и GTX 1080 Ti]()

Также в официальных характеристиках компания указывает рекомендуемую мощность блока питания. В этом случае для видеокарты GTX 1080 рекомендуемая мощность составила 500 Вт , а для видеокарты GTX 1080 Ti – 600 Вт .

![мощность блока питания GEFORCE GTX 1080 и GTX 1080 Ti]()

Проверить мощность блока питания, которая указана в характеристиках, можно с помощью онлайн калькулятора БП. Подобные калькуляторы позволяют сделать ориентировочную оценку мощности блока питания на основе указанных комплектующих. Для проверки мы будем использовать калькулятор от MSI.

Для начала проверим значения для GEFORCE GTX 1080. Укажем Intel Core i9 9900KF, одну видеокарту GEFORCE GTX 1080, 2 жестких диска, 4 модуля оперативной памяти, 4 вентилятора, 4 дополнительных карты PCI express и 1 DVD-привод. Результат калькулятора с такими комплектующими чуть больше 450 Вт (такой же как и у 1070 и 1070 ti).

![калькулятор для GEFORCE GTX 1080]()

Для проверки значения GEFORCE GTX 1080 Ti будем использовать те же комплектующие. Результат GTX 1080 Ti – 525 Вт .

![калькулятор для GEFORCE GTX 1080 ti]()

В случае видеокарт GTX 1080 и GTX 1080 Ti калькулятор от MSI выдает значения, которые заметно ниже, чем рекомендуемые компанией NVIDIA. Поэтому при выборе БП стоит ориентироваться в первую очередь на официальные значения от NVIDIA.

Из этого можно сделать вывод, что для GTX 1080 нужен блок питания на 500 Вт , а для GTX 1080 Ti на 600 Вт . Если вы желаете перестраховаться или оставить запас для будущего апгрейда, то можно взять модель на 100 Вт больше. Таким образом мощность блока питания с запасом для GTX 1080 составит 600 Вт , а для GTX 1080 Ti – 700 Вт.

Задайте вопрос в комментариях под статьей или на странице «Задать вопрос» и вы обязательно получите ответ.

Мощность блока питания — это та , что заявлена общая или реальное КПД блока? Какой брать?

Заявленная производителем, конечно же.

КПД здесь вообще не причем, это значение влияет только на потребление с розетки и нагрев. Если у БП мощность 500 Вт и КПД 80%, то это не означает, что он выдаст только 80% этой мощности. Он выдаст все заявленные 500 Вт (если он качественный), а с розетки будет потреблять больше 500 Вт (500 / 0,8 = 625 Вт).

Добрый день.

Имею на борту райзен5 2600, 16гб DDR4(2*8), 2 HDD, 3 корпусных крутилки и башня на процессоре (все с подсветкой) и блок питания be quiet System Power 9 500W. Хватит ли мне данного блока питания, если я поставлю gtx1070? Проверял по калькулятору MSI и Be Quit, и там и там выдавало результат не больше 380 вт, при этом разница между данными была около 50/60 вт почему-то….Просто есть возможность прикупить за недорого ASUS ROG Strix GTX 1070 8Гб.

Заранее спасибо за ответ!)))Этот блок по линии 12 вольт выдает 456 Вт. Этого должно хватить, но это очень впритык. Я бы рекомендовал все-таки взять БП чутка помощнее.

Добрый день.У меня проц i7 6 поколения и видеокарта 1060 strix.Хватит ли мне бп на 500w?

Термоснимок

![]()

На тыльной стороне платы — пластина, мешающая локализовать максимально нагретую область.Базовый комплект поставки должен включать в себя руководство пользователя, диск с драйверами и утилитами. Мы видим базовый комплект.

Методика измерения шума

В режиме простоя в 2D температура составляла 37 °C, вентиляторы не работали. Шум был равен фоновому — 20,0 дБА.

При просмотре фильма с аппаратным декодированием температура медленно поднималась до 51 °C, после чего вентиляторы включались и работали на частоте 800 оборотов в минуту. Уровень шума не изменялся (20,0 дБА).

В режиме максимальной нагрузки в 3D температура достигала 59 °C. Вентиляторы при этом раскручивались до 1449 оборотов в минуту, шум вырастал лишь до 23,3 дБА, так что данную СО можно считать практически бесшумной.

Блок питания для GEFORCE GTX 1060

Для того чтобы определить, какой блок питания нужен для видеокарты NVIDIA GEFORCE GTX 1060 в первую очередь обратимся к характеристикам на официальном сайте производителя. Согласно официальным данным эта видеокарта потребляет 120 Вт электроэнергии. При этом данный показатель одинаковый, как для версии с 3 Гб видеопамяти, так и для версии с 6 Гб видеопамяти.

![потребление энергии GEFORCE GTX 1060]()

Также компания NVIDIA сама указывает рекомендованную мощность для блока питания. В данном случае для обоих версий видеокарты GTX 1060 рекомендованная мощность блока питания составляет 400 Вт .

![блок питания для GEFORCE GTX 1060]()

Проверить мощность блока питания, которую рекомендует компания NVIDIA, можно при помощи онлайн калькулятора БП. Такие калькуляторы позволяют выбрать используемые в компьютере комплектующие и примерно оценить, какой БП необходим для работы такого ПК. В данном случае мы будем использовать калькулятор от MSI. Если выбрать процессор Intel Core i9 9900KF, одну видеокарту GEFORCE GTX 1060, 2 жестких диска, 4 модуля оперативной памяти, 4 вентилятора, 4 дополнительных карты PCI express и 1 DVD-привод, то калькулятор от MSI рекомендует 400 Вт .

![калькулятор для GEFORCE GTX 1060]()

Учитывая, указанные выше данные от NVIDIA и MSI можно сделать вывод, что для нормальной работы видеокарты NVIDIA GEFORCE GTX 1060 нужен блок питания мощностью 400 Вт . Если вы хотите перестраховаться или иметь запас на апгрейд комплектующих в будущем, то вы можете приобрести БП с некоторым запасом. Например, можно взять модель, которая обеспечивает на 100 Вт больше. Таким образом, для GTX 1060 мощность блока питания с запасом будет составлять 500 Вт .

Устройство(а)

Карта имеет 8 ГБ памяти GDDR5 SDRAM, размещенной в 8 микросхемах по 8 Гбит на лицевой стороне PCB.

Микросхемы памяти Samsung (GDDR5). Микросхемы рассчитаны на номинальную частоту работы в 2000 (8000) МГц.

Мы знаем, что практически все ускорители компании Gigabyte полностью спроектированы собственными инженерами (а не являются копиями референс-карт). Это относится и к данному продукту. Сходство с референс-картой есть только в расположении микросхем памяти (это логично) и в наборе видеовыходов.

Блок питания переработан: схема имеет 6 фаз (плюс 2 фазы на питание микросхем памяти) и управляется цифровым контроллером uP9511P производства uPI Semiconductor. Однако это не все. Видеокарта поддерживает большой набор функций мониторинга, за которые отвечает контроллер Holtek HT32F52241 на базе микроконтроллера ARM Cortex -M0+. Он же регулирует мощность системы питания.

Традиционная схема выпуска PCB — Ultra Durable — подразумевает особую печатную плату с двойными медными слоями и набором высококачественных дросселей и твердотельных конденсаторов.

Схема питания обеспечивает очень гибкое регулирование напряжений на ядре и памяти. За это отвечает фирменная утилита Gigabyte Xtreme Engine, которая поставляется с картой на диске, а также ее можно скачать с сайта производителя.

Программа позволяет выбрать один из уже предустановленных режимов работы ускорителя в 3D: OC, Gaming, Eco. Различия лишь в частотах работы. Либо можно создать свой собственный профиль режима работы, установив частоты и вольтажи. Утилита также позволяет выставить режим подсветки кулера, управлять кулером вручную.

![]()

![]()

Стоит акцентировать внимание на прилично повышенных частотах работы ускорителя относительно стандартных параметров референс-карты (примерно на 13% выше по ядру), что может дать прирост производительности примерно от 10% до 11% в зависимости от разрешения и режима работы.

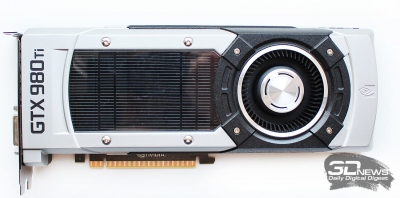

Перед нами кулер серии WindForce, которая давно уже себя зарекомендовала с самой лучшей стороны, ибо практически все кулеры WindForce очень тихие. Главной его частью являются два массивных пластинчатых никелированных радиатора, соединенных между собой тепловыми трубками, впрессованными в основание, которые обеспечивают равномерное распределение тепла по ребрам радиатора.

Поверх радиатора установлен кожух с тремя вентиляторами, работающими на одинаковой частоте вращения. Лопасти имеют особый профиль (поперечное сечение), и производитель декларирует сильно пониженный уровень шума при аналогичном потоке воздуха в сравнении с обычными лопастями. Следует также напомнить, что кулеры WindForce останавливают вентиляторы в случае простоя или малой нагрузки (если температура GPU не выше 55 градусов). Поэтому не стоит пугаться, если при запуске ПК вентиляторы на ускорителе не вращаются. Кстати, индикатор на торце кулера информирует о том, вращаются ли вентиляторы.

Микросхемы памяти и силовые транзисторы охлаждаются особыми пластинами, прикрученными к основному радиатору. На обороте видеокарты установлена толстая пластина, которая обеспечивает жесткость относительно массивной видеокарты (предотвращая изгиб печатной платы).

СО оснащена особой подсветкой, цветом которой можно управлять с помощью вышеуказанной утилиты.

После 6-часового прогона под нагрузкой максимальная температура ядра не превысила 59 градусов, что является великолепным результатом для видеокарты такого уровня.

Читайте также: