Шины видеокарт какие бывают

Руководство покупателя игровой видеокарты

Современные графические процессоры содержат множество функциональных блоков, от количества и характеристик которых зависит и итоговая скорость рендеринга, влияющая на комфортность игры. По сравнительному количеству этих блоков в разных видеочипах можно примерно оценить, насколько быстр тот или иной GPU. Характеристик у видеочипов довольно много, в этом разделе мы рассмотрим лишь самые важные из них.

Тактовая частота видеочипа

Рабочая частота GPU обычно измеряется в мегагерцах, т. е. миллионах тактов в секунду. Эта характеристика прямо влияет на производительность видеочипа — чем она выше, тем больший объем работы GPU может выполнить в единицу времени, обработать большее количество вершин и пикселей. Пример из реальной жизни: частота видеочипа, установленного на плате Radeon HD 6670 равна 840 МГц, а точно такой же чип в модели Radeon HD 6570 работает на частоте в 650 МГц. Соответственно будут отличаться и все основные характеристики производительности. Но далеко не только рабочая частота чипа определяет производительность, на его скорость сильно влияет и сама графическая архитектура: устройство и количество исполнительных блоков, их характеристики и т. п.

В некоторых случаях тактовая частота отдельных блоков GPU отличается от частоты работы остального чипа. То есть, разные части GPU работают на разных частотах, и сделано это для увеличения эффективности, ведь некоторые блоки способны работать на повышенных частотах, а другие — нет. Такими GPU комплектуется большинство видеокарт GeForce от NVIDIA. Из свежих примеров приведём видеочип в модели GTX 580, большая часть которого работает на частоте 772 МГц, а универсальные вычислительные блоки чипа имеют повышенную вдвое частоту — 1544 МГц.

Скорость заполнения (филлрейт)

Скорость заполнения показывает, с какой скоростью видеочип способен отрисовывать пиксели. Различают два типа филлрейта: пиксельный (pixel fill rate) и текстурный (texel rate). Пиксельная скорость заполнения показывает скорость отрисовки пикселей на экране и зависит от рабочей частоты и количества блоков ROP (блоков операций растеризации и блендинга), а текстурная — это скорость выборки текстурных данных, которая зависит от частоты работы и количества текстурных блоков.

Например, пиковый пиксельный филлрейт у GeForce GTX 560 Ti равен 822 (частота чипа) × 32 (количество блоков ROP) = 26304 мегапикселей в секунду, а текстурный — 822 × 64 (кол-во блоков текстурирования) = 52608 мегатекселей/с. Упрощённо дело обстоит так — чем больше первое число — тем быстрее видеокарта может отрисовывать готовые пиксели, а чем больше второе — тем быстрее производится выборка текстурных данных.

Хотя важность "чистого" филлрейта в последнее время заметно снизилась, уступив скорости вычислений, эти параметры всё ещё остаются весьма важными, особенно для игр с несложной геометрией и сравнительно простыми пиксельными и вершинными вычислениями. Так что оба параметра остаются важными и для современных игр, но они должны быть сбалансированы. Поэтому количество блоков ROP в современных видеочипах обычно меньше количества текстурных блоков.

Количество вычислительных (шейдерных) блоков или процессоров

Пожалуй, сейчас эти блоки — главные части видеочипа. Они выполняют специальные программы, известные как шейдеры. Причём, если раньше пиксельные шейдеры выполняли блоки пиксельных шейдеров, а вершинные — вершинные блоки, то с некоторого времени графические архитектуры были унифицированы, и эти универсальные вычислительные блоки стали заниматься различными расчётами: вершинными, пиксельными, геометрическими и даже универсальными вычислениями.

Впервые унифицированная архитектура была применена в видеочипе игровой консоли Microsoft Xbox 360, этот графический процессор был разработан компанией ATI (впоследствии купленной AMD). А в видеочипах для персональных компьютеров унифицированные шейдерные блоки появились ещё в плате NVIDIA GeForce 8800. И с тех пор все новые видеочипы основаны на унифицированной архитектуре, которая имеет универсальный код для разных шейдерных программ (вершинных, пиксельных, геометрических и пр.), и соответствующие унифицированные процессоры могут выполнить любые программы.

По числу вычислительных блоков и их частоте можно сравнивать математическую производительность разных видеокарт. Большая часть игр сейчас ограничена производительностью исполнения пиксельных шейдеров, поэтому количество этих блоков весьма важно. К примеру, если одна модель видеокарты основана на GPU с 384 вычислительными процессорами в его составе, а другая из той же линейки имеет GPU с 192 вычислительными блоками, то при равной частоте вторая будет вдвое медленнее обрабатывать любой тип шейдеров, и в целом будет настолько же производительнее.

Хотя, исключительно на основании одного лишь количества вычислительных блоков делать однозначные выводы о производительности нельзя, обязательно нужно учесть и тактовую частоту и разную архитектуру блоков разных поколений и производителей чипов. Только по этим цифрам можно сравнивать чипы только в пределах одной линейки одного производителя: AMD или NVIDIA. В других же случаях нужно обращать внимание на тесты производительности в интересующих играх или приложениях.

Блоки текстурирования (TMU)

Эти блоки GPU работают совместно с вычислительными процессорами, ими осуществляется выборка и фильтрация текстурных и прочих данных, необходимых для построения сцены и универсальных вычислений. Число текстурных блоков в видеочипе определяет текстурную производительность — то есть скорость выборки текселей из текстур.

Хотя в последнее время больший упор делается на математические расчеты, а часть текстур заменяется процедурными, нагрузка на блоки TMU и сейчас довольно велика, так как кроме основных текстур, выборки необходимо делать и из карт нормалей и смещений, а также внеэкранных буферов рендеринга render target.

С учётом упора многих игр в том числе и в производительность блоков текстурирования, можно сказать, что количество блоков TMU и соответствующая высокая текстурная производительность также являются одними из важнейших параметров для видеочипов. Особенное влияние этот параметр оказывает на скорость рендеринга картинки при использовании анизотропной фильтрации, требующие дополнительных текстурных выборок, а также при сложных алгоритмах мягких теней и новомодных алгоритмах вроде Screen Space Ambient Occlusion.

Блоки операций растеризации (ROP)

Блоки растеризации осуществляют операции записи рассчитанных видеокартой пикселей в буферы и операции их смешивания (блендинга). Как мы уже отмечали выше, производительность блоков ROP влияет на филлрейт и это — одна из основных характеристик видеокарт всех времён. И хотя в последнее время её значение также несколько снизилось, всё ещё попадаются случаи, когда производительность приложений зависит от скорости и количества блоков ROP. Чаще всего это объясняется активным использованием фильтров постобработки и включенным антиалиасингом при высоких игровых настройках.

Ещё раз отметим, что современные видеочипы нельзя оценивать только числом разнообразных блоков и их частотой. Каждая серия GPU использует новую архитектуру, в которой исполнительные блоки сильно отличаются от старых, да и соотношение количества разных блоков может отличаться. Так, блоки ROP компании AMD в некоторых решениях могут выполнять за такт больше работы, чем блоки в решениях NVIDIA, и наоборот. То же самое касается и способностей текстурных блоков TMU — они разные в разных поколениях GPU разных производителей, и это нужно учитывать при сравнении.

Вплоть до последнего времени, количество блоков обработки геометрии было не особенно важным. Одного блока на GPU хватало для большинства задач, так как геометрия в играх была довольно простой и основным упором производительности были математические вычисления. Важность параллельной обработки геометрии и количества соответствующих блоков резко выросли при появлении в DirectX 11 поддержки тесселяции геометрии. Компания NVIDIA первой распараллелила обработку геометрических данных, когда в её чипах семейства GF1xx появилось по несколько соответстующих блоков. Затем, похожее решение выпустила и AMD (только в топовых решениях линейки Radeon HD 6700 на базе чипов Cayman).

В рамках этого материала мы не будем вдаваться в подробности, их можно прочитать в базовых материалах нашего сайта, посвященных DirectX 11-совместимым графическим процессорам. В данном случае для нас важно то, что количество блоков обработки геометрии очень сильно влияет на общую производительность в самых новых играх, использующих тесселяцию, вроде Metro 2033, HAWX 2 и Crysis 2 (с последними патчами). И при выборе современной игровой видеокарты очень важно обращать внимание и на геометрическую производительность.

Собственная память используется видеочипами для хранения необходимых данных: текстур, вершин, данных буферов и т. п. Казалось бы, что чем её больше — тем всегда лучше. Но не всё так просто, оценка мощности видеокарты по объему видеопамяти — это наиболее распространенная ошибка! Значение объёма видеопамяти неопытные пользователи переоценивают чаще всего, до сих пор используя именно его для сравнения разных моделей видеокарт. Оно и понятно — этот параметр указывается в списках характеристик готовых систем одним из первых, да и на коробках видеокарт его пишут крупным шрифтом. Поэтому неискушённому покупателю кажется, что раз памяти в два раза больше, то и скорость у такого решения должна быть в два раза выше. Реальность же от этого мифа отличается тем, что память бывает разных типов и характеристик, а рост производительности растёт лишь до определенного объёма, а после его достижения попросту останавливается.

Так, в каждой игре и при определённых настройках и игровых сценах есть некий объём видеопамяти, которого хватит для всех данных. И хоть ты 4 ГБ видеопамяти туда поставь — у неё не появится причин для ускорения рендеринга, скорость будут ограничивать исполнительные блоки, о которых речь шла выше, а памяти просто будет достаточно. Именно поэтому во многих случаях видеокарта с 1,5 ГБ видеопамяти работает с той же скоростью, что и карта с 3 ГБ (при прочих равных условиях).

Ситуации, когда больший объём памяти приводит к видимому увеличению производительности, существуют — это очень требовательные игры, особенно в сверхвысоких разрешениях и при максимальных настройках качества. Но такие случаи встречаются не всегда и объём памяти учитывать нужно, не забывая о том, что выше определённого объема производительность просто уже не вырастет. Есть у чипов памяти и более важные параметры, такие как ширина шины памяти и её рабочая частота. Эта тема настолько обширна, что подробнее о выборе объёма видеопамяти мы ещё остановимся в шестой части нашего материала.

Ширина шины памяти

Современные игровые видеокарты используют разную ширину шины: от 64 до 384 бит (ранее были чипы и с 512-битной шиной), в зависимости от ценового диапазона и времени выпуска конкретной модели GPU. Для самых дешёвых видеокарт уровня low-end чаще всего используется 64 и реже 128 бит, для среднего уровня от 128 до 256 бит, ну а видеокарты из верхнего ценового диапазона используют шины от 256 до 384 бит шириной. Ширина шины уже не может расти чисто из-за физических ограничений — размер кристалла GPU недостаточен для разводки более чем 512-битной шины, и это обходится слишком дорого. Поэтому наращивание ПСП сейчас осуществляется при помощи использования новых типов памяти (см. далее).

На современные видеокарты устанавливается сразу несколько различных типов памяти. Старую SDR-память с одинарной скоростью передачи уже нигде не встретишь, но и современные типы памяти DDR и GDDR имеют значительно отличающиеся характеристики. Различные типы DDR и GDDR позволяют передавать в два или четыре раза большее количество данных на той же тактовой частоте за единицу времени, и поэтому цифру рабочей частоты зачастую указывают удвоенной или учетверённой, умножая на 2 или 4. Так, если для DDR-памяти указана частота 1400 МГц, то эта память работает на физической частоте в 700 МГц, но указывают так называемую «эффективную» частоту, то есть ту, на которой должна работать SDR-память, чтобы обеспечить такую же пропускную способность. То же самое с GDDR5, но частоту тут даже учетверяют.

Основное преимущество новых типов памяти заключается в возможности работы на больших тактовых частотах, а соответственно — в увеличении пропускной способности по сравнению с предыдущими технологиями. Это достигается за счет увеличенных задержек, которые, впрочем, не так важны для видеокарт. Первой платой, использующей память DDR2, стала NVIDIA GeForce FX 5800 Ultra. С тех пор технологии графической памяти значительно продвинулись, был разработан стандарт GDDR3, который близок к спецификациям DDR2, с некоторыми изменениями специально для видеокарт.

GDDR3 — это специально предназначенная для видеокарт память, с теми же технологиями, что и DDR2, но с улучшенными характеристиками потребления и тепловыделения, что позволило создать микросхемы, работающие на более высоких тактовых частотах. Несмотря на то, что стандарт был разработан в компании ATI, первой видеокартой, её использующей, стала вторая модификация NVIDIA GeForce FX 5700 Ultra, а следующей стала GeForce 6800 Ultra.

GDDR4 — это дальнейшее развитие «графической» памяти, работающее почти в два раза быстрее, чем GDDR3. Основными отличиями GDDR4 от GDDR3, существенными для пользователей, являются в очередной раз повышенные рабочие частоты и сниженное энергопотребление. Технически, память GDDR4 не сильно отличается от GDDR3, это дальнейшее развитие тех же идей. Первыми видеокартами с чипами GDDR4 на борту стали ATI Radeon X1950 XTX, а у компании NVIDIA продукты на базе этого типа памяти не выходили вовсе. Преимущества новых микросхем памяти перед GDDR3 в том, что энергопотребление модулей может быть примерно на треть ниже. Это достигается за счет более низкого номинального напряжения для GDDR4.

Впрочем, GDDR4 не получила широкого распространения даже в решениях AMD. Начиная с GPU семейства RV7x0, контроллерами памяти видеокарт поддерживается новый тип памяти GDDR5, работающий на эффективной учетверённой частоте до 5,5 ГГц и выше (теоретически возможны частоты до 7 ГГц), что даёт пропускную способность до 176 ГБ/с с применением 256-битного интерфейса. Если для повышения ПСП у памяти GDDR3/GDDR4 приходилось использовать 512-битную шину, то переход на использование GDDR5 позволил увеличить производительность вдвое при меньших размерах кристаллов и меньшем потреблении энергии.

Видеопамять самых современных типов — это GDDR3 и GDDR5, она отличается от DDR некоторыми деталями и также работает с удвоенной/учетверённой передачей данных. В этих типах памяти применяются некоторые специальные технологии, позволяющие поднять частоту работы. Так, память GDDR2 обычно работает на более высоких частотах по сравнению с DDR, GDDR3 — на еще более высоких, а GDDR5 обеспечивает максимальную частоту и пропускную способность на данный момент. Но на недорогие модели до сих пор ставят «неграфическую» память DDR3 со значительно меньшей частотой, поэтому нужно выбирать видеокарту внимательнее.

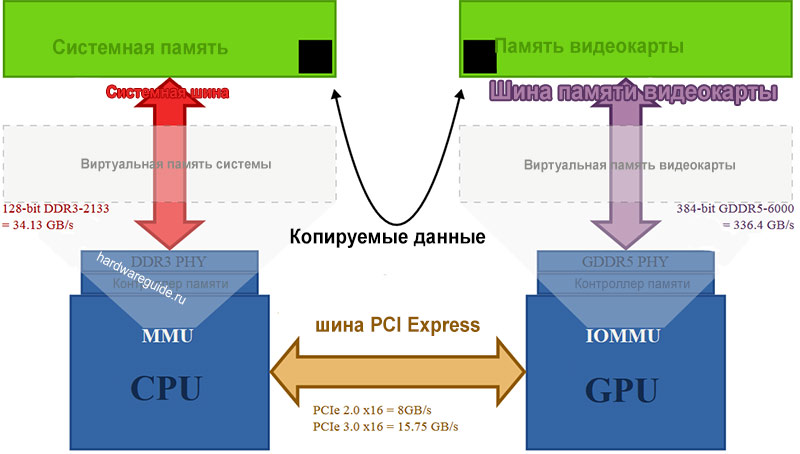

Шина памяти видеокарты – это канал соединяющий память и графический процессор видеокарты. От ширины шины памяти зависит, сколько данных обработает видеокарта за единицу времени. Этот параметр один из главных, который влияет на производительность видеокарты и на ее цену.

Пропускная способность шины памяти высчитывается по формуле:

[ширина шины памяти] * [частота памяти] = [х бит пропуск] / [бит в байте (8бит)]

Если у видеокарты шина 256 бит, частота памяти 2200 Мгц, то пропускная способность равна:

Выводы:

При выборе видеокарты в первую очередь отталкивайтесь от своих потребностей. Иногда бюджетной или даже встроенной видеокарты вполне достаточно для большинства задач. Геймерам и людям, работающим с большими объемами графики следует обратить внимание на последние видеоадаптеры с типами памяти не ниже GDDR 5 и с шириной шины не менее 196 бит. Практически всегда, видеокарты с такими параметрами имеют достаточно мощный видеочип.

И напоследок отметим, что ни одна, даже самая мощная видеокарта не спасет систему со слабым процессором, медленным жестким диском, с устаревшим модулем оперативной памяти или с древней материнской платой. Учтите, что должен быть баланс, так как мощность ПК будет определяться скоростью работы самого слабого звена во всей системе.

Блок питания для видеокарты

Объем памяти

Объем памяти видеокарты - память необходимая для временного хранение информации, подлежащей транспортировке на обработку в графический процессор.

Об объеме памяти, в отличие от ширины шины, следует сказать следующее - больше не значит лучше. Карта с 8 Гб видеопамяти может быть производительнее карты с 12 Гб. И вот почему: если у карты с 8 ГБ более совершенный GPU (графический процессор), шире шина и более быстрый тип памяти, то и ее производительность будет выше. Поэтому объем памяти - немаловажный, но не решающий фактор.

Отметим, что лучшие современные видеокарты имеют типы памяти GDDR6 или HDM2. Сегодня это самый быстрый тип видеопамяти и видеокартам с таким типом памяти предпочтительнее отдать свой выбор очень требовательному геймеру. В крайнем случае, для игр, выбирайте адаптеры GDDR 5. Для домашних и офисных задач, вполне пригодны карты с памятью GDDR 5 или DDR 4.

Подключение SPDIF

Ширина шины памяти. Какую выбрать?

Далее в этой и следующих главах речь будет вестись только о дискретных видеокартах. Сперва рассмотрим ширину шины память, что это и "с чем ее едят". Ширина шины памяти - это то количество данных, которое может быть параллельно передано по линиям передачи информации. По-простому - чем больше ширина шины - тем быстрее передается графическая информация. Поэтому при прочих равных, лучше выбирать видеокарту с большей шиной памяти.

Негласно ширину шины памяти можно разделить:

до 128 бит - бюджетные видеокарты для домашних и офисных систем

160 - 4096 бит - модели с повышенной производительностью

Выводы раздела:

Все просто: если не собираетесь играть или профессионально создавать 3D сцены, то для офисных/домашних задач и немного игр смело можно выбрать видеокарту с шиной в 128 бит. Меньше - мы Вам не рекомендуем - хорошее видео в 4K Вы уже без подвисаний не посмотрите.

Производители графических процесоров. nVidia и ATI

Тестирование AMD Radeon HD 6950 и Radeon HD.

Задел на будущее

Переход на PCI Express вызвал немало вопросов. К моменту появления интерфейса в 2004 году многие лишь недоуменно поднимали бровь — зачем нужна пропускная способность порядка 4 Гб/с, если видеокарты до сих пор не используют всех возможностей AGP 8x? И зачем возвращаться к PCI?

Уже потом люди узнали, что от PCI-архитектуры в PCI Express осталось только название, шина таит в себе много новых возможностей. Так, инновационный интерфейс вернул позабытую технологию 3Dfx SLI в виде подретушированных NVIDIA SLI и ATI CrossFire. Как обычно, при переходе на новую шину широко использовали переходные мосты. История повторяется вот уже который раз, и с каждым новым витком она становится все интереснее!

Настольные ПК с каждым днем все больше и больше уступают позиции ноутбукам. Тем не менее, есть люди, которые по тем или иным соображениям и причинам хотят пользоваться именно настольными системами. Причем речь не только о геймерах, но и о них тоже.

Конечно, можно купить готовый системный блок. Но ведь гораздо интереснее и, при прочих равных, дешевле собрать его самому. Причем так можно не только сэкономить, но и собрать совой ПК именно под свои задачи, что называется "под себя".

При сборке системного блока, помимо выбора процессора, оперативной памяти, материнской платы и прочих комплектующих, неизбежно станет вопрос о выборе видеокарты, одной из важнейших составляющих любого компьютера.

Напомним, что видеокарта - аппаратная составляющая ПК, которая обрабатывает и преобразует данные в видеосигнал, пригодный для вывода на устройства отображения. Как правило, устройством отображения служит монитор. Простыми словами, видеокарта нужна для того, чтобы обработать понятные компьютеру сигналы в понятные нам образы. По тому, как быстро совершается эта обработка, и можно судить о мощности видеокарты. Но, не всегда самая мощная видеокарта - лучший выбор. Все зависит от задач, которые Вы ставите перед своим ПК.

Можно ли менять видеокарту с 64 на 512 бит?

Вопрос из комментариев.

— Да, можно (даже нужно). Единственное с чем у вас могут быть проблемы — это с повышением потребления и увлечения нагрузки на блок питания при установки более мощной видеокарты.

Если посмотрите на графике, то связующим звеном между видеокартой и вашим компьютером является шина PCI Express, то есть битность шины памяти видеокарты никаким образом не влияет на совместимость с той или иной материнской платой.

Еще статьи

Тип памяти видеокарты: GDDR3, GDDR5, GDDR6, HBM2, HBM3

Выводы раздела:

Если Вы не собираетесь играть в современные видеоигры и ПК Вам нужен в основном для офисных задач, серфинга в интернете, просмотра видео на Youtube и, порой, для простых игр, то Вам вполне будет достаточно встроенной графики. Если Вы предъявляете к ПК более высокие требования: любительская обработка видео, не громоздкие 3D-приложения и игра в World of Tanks по вечерам, то можно присмотреться к APU-решениям. Если же Вы - хардкорный ПК-геймер, дизайнер или Ваша работа связаны с 3D-графикой, то Вам однозначно нужна мощная дискретная видеокарта высокого уровня.

Производители видеокарт

Обзор GeForce GTX 580

Видеокарту с какой разрядностью шины памяти выбрать?

Ширина шины памяти напрямую влияет на пропускную способность памяти. Большее значение ширины памяти позволяет передавать большее количество данных из памяти видеокарты для обработки в графический процессор (GPU). Если рассуждать логически, то через шину шириной 128 bit данных можно передать в 2 раза больше, чем через шину в 64 бит. Однако на практике это значение немного ниже, чем в два раза.

Компенсировать потери в пропускной способности памяти можно установкой более быстрых типов памяти. Впервые это доказала компания AMD/ATI представив семейство видеокарт Radeon HD 5xxx. В этой серии некоторые модели видеокарт имели шину всего в 128 бит, но с самым быстрым типом памяти. Производительность таких видеокарт не уступает ускорителям с разрядностью шины памяти в 256 и с памятью GDDR3. За счет высокой скорости памяти GDDR5 компенсируется маленькая ширина шины памяти.

- для бюджетных видеокарт — 64 или 128 бит;

- для карт среднего уровня — 128 или 256 бит;

- для High-End видеокарт — от 256 до 512 бит.

От простого к сложному

В 1981 году компания IBM представила первый в мире персональный компьютер — IBM PC. В нем использовалась допотопная видеокарта с возможностью вывода монохромного изображения, но не это главное. Все наше внимание приковано к шине Industry Standard Architecture (ISA), разработанной в недрах IBM. Основное назначение ISA — соединение периферийных компонентов с системой.

Шина ISA использовалась далеко не только (и даже не столько) для нужд видеокарт. Сторонние производители выпустили массу дополнительных устройств для расширения возможностей компьютера. Оно и понятно, ведь тогда в системную плату не устанавливали звуковой кодек, сетевой контроллер и т.д. Все это можно было реализовать лишь с помощью карт расширения. Сами по себе ISA-порты не сильно отличались от более привычных PCI-разъемов.

Предшественниками полноценных видеокарт были чипы с возможностью вывода спрайтов на экран. Графические возможности компьютеров в те времена не волновали людей: когда IBM представила первый в мире чип с поддержкой вывода нескольких цветов, люди и не поняли, зачем это нужно. Графические карты для интерфейса ISA в середине 1980-х выпускали компании Cirrus Logic, Avance Logic, ATI, S3.

EISA заткнула за пояс шину MCA от IBM и стала стандартом де-факто.

Изначально у шины ISA было много ограничений: недостаточная пропускная способность, малое число прерываний, система распределения питания не ахти. Заменить ISA должна была шина Micro Channel Architecture (MCA), представленная в 1987 году вместе с компьютером IBM PS/2. Новая разработка решила многие проблемы, свойственные ISA: частота шины поднялась до 10 МГц, появился вменяемый Plug-n-Play (до этого прописывать новое устройство в систему приходилось вручную), шина стала 32-битной. Теоретическая пропускная способность MCA достигала 66 Мб/с, на практике — максимум 40 Мб/с. Устройства наконец-то могли общаться друг с другом напрямую, минуя центральный процессор. С такими улучшениями MCA могла бы стать индустриальным стандартом, но IBM сама все испортила. Компания не стала развивать рынок периферии для новой шины, более того, тщательно тормозила этот процесс — сторонние производители должны были получать специализированный ID для каждого устройства, за право выпуска устройств под MCA нужно было платить лицензионные отчисления и роялти. И это при том, что IBM не получила патенты на шину.

История сохранила лишь несколько упоминаний о видеокартах под MCA. Очевидно, что производители испугались всех трудностей, связанных с лицензированием и получением ID. Да и стоило ли мучиться? Компьютеры с шиной MCA оказались значительно дороже аналогов с использованием ISA. Все большей популярностью пользовались системы от Dell, Research Machines и Olivetti. Самые известные дискретные видеокарты для MCA — это монструозные IBM XGA, XGA-2, несколько моделей от Infotronic, Actix и ATI. Кстати, примерно в то же время появился разъем VGA (D-sub) для подключения мониторов.

Видеокарта ATI Mach32 для шины VLB едва помещалась в корпуса того времени. Да-да, и тогда выпускали громадные видеокарты.

Внешне порты EISA были похожи на 16-битные разъемы ISA — они точно так же были разделены на части для сохранения совместимости. С точки зрения производителей, шина EISA не сильно отличалась от оригинальной ISA, так что и видеокарт с ее поддержкой было выпущено предостаточно.

Надстройка продлила жизнь ISA, но в начале 1990-х была представлена шина VESA Local Bus (VL-bus, VLB). За ее разработку ответственна всем известная ассоциация Video Electronics Standards Association (VESA), основанная NEC в середине 1980-х годов. Почему бы не успокоиться на время и не продолжить использование EISA? Все просто — производителям опять не хватало скорости. Решением стала совершенно неудобная по современным меркам «добавка» в виде PCI-образного порта, который располагался в один ряд с 16-битным разъемом ISA, таким образом продлевая его. Устройство с поддержкой VLB устанавливалось сразу в два разъема — порт VLB обслуживал обращения к памяти, а ISA обрабатывал прерывания. Топорное решение, ничего не скажешь.

Несмотря на все недостатки, VLB стала стандартом де-факто в компьютерах с процессорами Intel 80486. Многочисленные производители видеокарт представили длинные модели с двумя разъемами.

В 1991 году ATI выпустила видеокарту Mach 8, которая могла обрабатывать картинку без помощи процессора. Уже в 1992 году последовала Mach 32 с возможностью ускорения обработки графического интерфейса Windows. Начались первые войны за рынок графики. В стычках участвовали S3, Cirrus Logic, ATI, PowerVR, Rendition и более мелкие игроки. На горизонте замаячили трехмерные пространства и аппаратное ускорение графики.

Проследив за компьютерным рынком, Intel решила взять все в свои руки и начала работу над шиной Peripheral Component Interconnect (PCI). Intel подошла к вопросу со всей серьезностью и организовала специальную группу для продвижения стандарта — PCI Special Interest Group (PCI-SIG). В нее вошли представители наиболее крупных IT-компаний.

Карта расширения с четырьмя дополнительными разъемами ISA. Такие устройства использовали, когда доступных портов уже не хватало.

Финальные спецификации PCI 1.0 были готовы к 1993 году. В серверах новый интерфейс заменил и EISA, и MCA. Захват рынка настольных компьютеров произошел не сразу — на тот момент люди были вполне довольны возможностями VLB. С появлением мощных процессоров Pentium недостатки шины стали очевидны — пользователям не давали жить постоянные помехи, наводки от оборудования и испорченные данные на жестких дисках.

В один прекрасный момент Intel представила процессор Pentium Pro в паре с новым чипсетом, в нем место VLB не нашлось. Да, вот так просто компания взяла, да и убрала разъем. Силовые наклонности Intel проявляются и по сей день, ведь именно она форсировала переход на Serial ATA, ратовала за отказ от PS/2 в пользу USB. Что интересно, интерфейс EISA тогда сохранили — соответствующие разъемы оставались на платах еще довольно долго.

К выходу Pentium II в 1995 году PCI-SIG представила спецификации PCI 2.0 (33 МГц). В новой версии была решена проблема прерываний и определения установленных устройств — под эти цели отвели дополнительный канал связи. Периферия могла свободно обращаться к памяти, выделять для себя необходимые участки, а технологию Plug-n-Play довели до ума.

Участники PCI-SIG не почивали на лаврах и продолжали работу над стандартом — в последующие годы появились ревизии 2.1, 2.2 и даже 3.0. Самая ходовая версия PCI обладала пропускной способностью 133 Мб/с. Тем временем на рынке видеокарт только разгоралась борьба за место под солнцем. Производители работали над реализацией аппаратного ускорения 3D-графики. Ярчайшие представители той эпохи — разновидности S3 ViRGE и первый комбинированный 2D/3D графический ускоритель ATI Rage. Не выдержав конкуренции, рынок видеокарт начали покидать различные компании. Многие из них — например, Cirrus Logic — перепрофилировались и успешно существуют до сих пор.

Разъемы PCI Express даже внешне не похожи на PCI, от одноименного предшественника остались лишь воспоминания.

Все описанные тогдашние модели использовали интерфейс PCI — до поры до времени он обеспечивал достаточную пропускную способность. История шины как идеального интерфейса для видеокарт стала подходить к концу с появлением на рынке компаний 3Dfx и NVIDIA. К 1997 году последняя представила сравнительно мощную Riva 128, ATI продолжила развивать Rage, а 3Dfx выпустила легендарные 3D-акселераторы Voodoo и Voodoo 2. Несмотря на то, что шина PCI позволяла вытворять фокусы, вроде установки двух Voodoo 2 и объединения их в режим SLI, пропускной способности стало не хватать. И снова на арену вышла Intel.

Главное уязвимое место шины PCI заключается в том, что 133 Мб/с делятся между всеми установленными устройствами. Стало быть, для требовательной графической карты нужен обособленный разъем. На разработку Accelerated Graphics Port (AGP) ушло немного времени. Первую версию интерфейса представили вместе с процессорами Pentium II для Slot 1. Шина AGP 1x обеспечила пропускную способность до 266 Мб/с. Впервые соединение с процессором было прямым — их «общению» никто больше не мешал. Появилась дополнительная адресация, которая позволила видеокартам посылать новый запрос во время получения уже заказанных данных.

Первая волна видеокарт под AGP не заставила себя долго ждать. В числе пионеров были Rendition Verite V2200, 3dfx Voodoo Banshee, NVIDIA RIVA 128, 3Dlabs PERMEDIA 2, Intel i740, ATI Rage, Matrox Millennium II и S3 ViRGE GX/2. Разумеется, многие из них при работе задействовали переходной мост.

В дальнейшем Intel совершенствовала шину AGP — появились AGP 2x, AGP 4x и AGP 8x. Каждая новая версия отличалась от предыдущей еще большей пропускной способностью и улучшенными электротехническими характеристиками. AGP 8x обладала внушительной пропускной способностью 2133 Мб/с. Достигнуть этого предела производители видеокарт не успели, по команде Intel индустрия двинулась дальше.

| «Дикая утка» IBM | |

| На протяжении всей истории человечества всегда находились провокаторы в хорошем смысле слова, выдумщики и просто светлые головы. Люди, которые никогда не сидели на месте и старались привнести в мир что-то новое. Встречайте одного из таких — Чета Хита (Chet Heath). Этот сотрудник IBM с тридцатилетним стажем отвечал за разработку многих ключевых компонентов, которые в том или ином виде присутствуют в компьютерах и по сей день. В нашей статье мы затронули сразу два из них — шину MCA и технологию Plug-n-Play. Подобных ему в IBM называют «дикими утками» (wild duck), и именно они вращают колесо прогресса. Хит пока является единственным сотрудником IBM, дважды получившим награду компании за технологические достижения! Зная, какое влияние оказал «Голубой гигант» на компьютерную индустрию, можно предположить, что Чету мы обязаны многим. В июне 2000 года Хит покинул родные пенаты. Стало тесно — руководство компании не захотело принимать в оборот предлагаемую им серверную технологию, а раз так, надо двигать дальше. В данный момент наш герой трудится в роли технологического директора на славу компании OmniCluster. Посмотрим, что еще он явит миру. Популярные модели видеокартТактовая частотаПроцессор видеокарты обрабатывает графическую информацию с той или иной скоростью. Именно скорость работы и определяется частотой. При прочих равных условиях, чем выше этот параметр, тем быстрее видеокарта обрабатывает графическую информацию. Но, акцентируем Ваше внимание на том, что это правило актуально только при прочих равных условиях. Сравнивать по частоте видеокарты разных семейств и разных производителей нет смысла.

Тем не менее, отдавая предпочтение последним видеокартам с высокой частотой работы графического ядра и с большим количеством потоковых процессоров (программируемые блоки, параллельно выполняющие вычисления) вы делаете лучший выбор. Видеокарты ATI RadeonОсновные типы видеокартПеред тем как выбрать подходящее решение, следует знать, что на сегодняшний день существует три типа видеокарт:

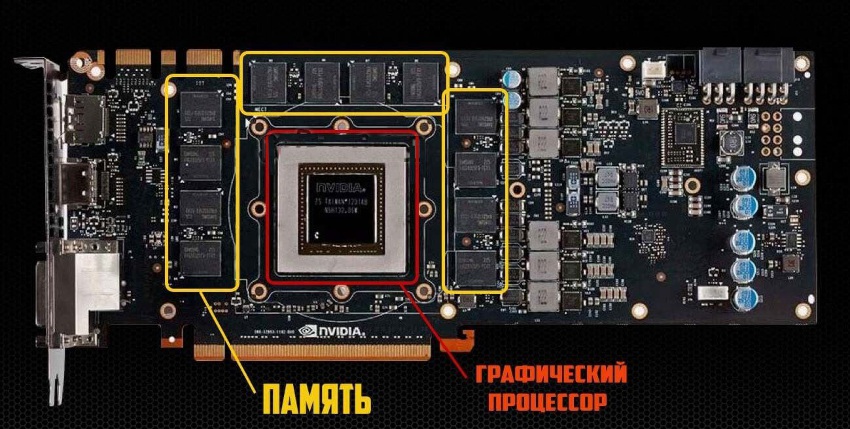

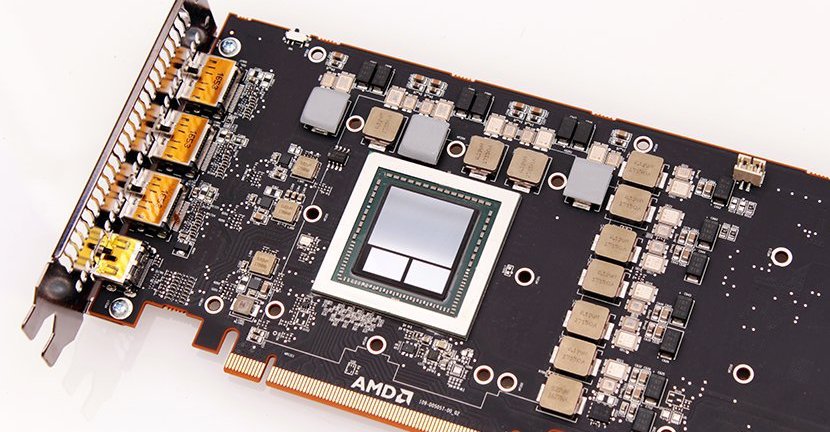

Crossfire Ati Radeon94 комментарияAsus p5k se/epu какую видеокарту подойдёт Видеокарта GIGABYTE GeForce® GT 710 1 Гб GDDR5 Сам ответил на свой вопрос — GDDR3 и GDDR5 есть разница? помогите с выбором ноутбука, нужен такой, чтобы был режим с разверткой 75гц. или подскажите как искать, так как на сайтах не пишут списки поддерживаемых режимов для разных разрешений экрана. Производители лукавят с производительностью консолей. Железо всегда подбирается под разрешению вашего монитора/телевизора. Для комфортного просмотра фильмов выделили по вертикали 25 кадров, но для игр кроме вертикального сканирования необходимо ещё и панорамное сканирование (горизонтальное перемещение). В итоге для максимального перемещения по горизонтали необходимо сканирование с частотой не меньше 60 гц. Делаем расчёт видеокарты и процессора для игр на ПК или для игровой приставки. Подбираем видеокарту. Теперь выбираем процессор для ПК под видеокарту. Итого: Для игр необходима одна видеокарта с частотой 1 ГГц и с разрядностью шины 1024бит.(PSIe 3.0×16) Объём памяти должен быть не меньше пропускного потока монитора. Всё это будет работать при 100% загрузке железа с частотой 60 кадров. Руководство покупателя игровой видеокартыПроизводительность видеокарты определяется не только мощностью самого GPU. Любому чипу нужен большой объём выделенной памяти с высокой пропускной способностью при записи и чтении различных данных: текстур, вершин, содержимого буферов и т. п. Даже самый мощный видеочип можно «придушить» слишком малым объёмом видеопамяти, да ещё с медленным доступом, поэтому характеристики устанавливаемых микросхем памяти также являются одними из важнейших параметров современных видеокарт. Микросхемы памяти, количество которых на некоторых моделях видеокарт достигает 24 штук, обычно располагаются на печатной плате вокруг видеочипа, на одной или обеих сторонах. В некоторых случаях для них не используется даже пассивное охлаждение, но часто применяется общий кулер, охлаждающий и GPU и память, а иногда и отдельные радиаторы. Вот так микросхемы памяти выглядят на GeForce GTX 590 со снятым устройством охлаждения:

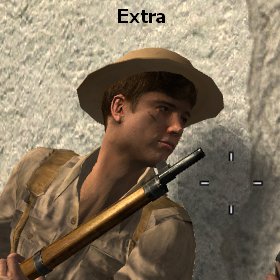

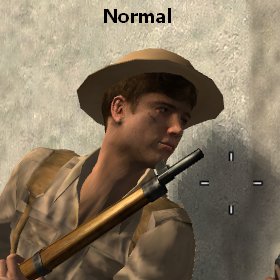

Современные видеокарты оснащаются различным объемом локальной видеопамяти, но обычно он начинается от 512 МБ и может достигать 3 ГБ на один GPU (с удвоением объёма на двухчиповых видеокартах). Чаще всего на видеокарты low-end и mid-end сейчас ставят 1 ГБ памяти, а на high-end — 1,5-3 гигабайта на чип, но есть и исключения. Так, карты самого низкого уровня могут иметь и 512 МБ более быстрой памяти GDDR5, и 1-2 ГБ медленной DDR3. Чем больше выделенной памяти установлено на видеокарте, тем больше данных (тех же текстур, вершин и буферов) можно хранить в ней, не используя медленный доступ к ОЗУ компьютера. Причем, больше всего места занимают текстуры и различные буферы, а вот собственно геометрические данные обычно не слишком объёмны. Рассмотрим скриншоты из довольно старой игры Call of Duty 2 с разными установками качества текстур:

В этой игре, как и во многих других, автоматически настраивается качество текстур под имеющийся объём текстурной памяти. В данном случае режим Extra автоматически выставляется на видеокартах с 320-1024 МБ памяти, High или Normal — на 256 МБ, в зависимости от настроек разрешения и уровня антиалиасинга, а Low — на самых слабых GPU с 128 МБ. И даже если вы выставите максимальные настройки вручную, то на видеокарте с недостаточным объёмом видеопамяти для хранения ресурсов будет использоваться часть системной памяти, что приведет к серьёзным "тормозам" и отсутствию комфорта и плавности в игре. В последнее время рост требований к объёму видеопамяти сильно замедлился, и виновато в этом засилие мультиплатформенных игр. Современные игровые консоли имеют лишь по 512 МБ памяти и поэтому разработчики игр ориентируются именно на этот уровень. Конечно, в ПК-версиях игр зачастую предусмотрены как текстуры большего разрешения, так и высокое разрешение рендеринга, что требует куда большего объёма видеопамяти. Но всё равно, объём памяти в 1 ГБ до сих пор вполне приемлем в подавляющем большинстве случаев. Кроме экстремальных настроек сглаживания и разрешения, вроде MSAA 8x и 2560×1600, соответственно. Но даже уже устаревшим мультиплатформенным играм не хватает 512 МБ, они довольно требовательны к объёму видеопамяти, занимая до 600-700 МБ. И всё же, на данный момент минимальным необходимым объёмом локальной памяти для игровых видеокарт мы считаем 1 ГБ. Он же является и оптимальным для большинства моделей. Кроме видеокарт NVIDIA, имеющих 320- и 384-битную шины памяти — у них объём видеопамяти ещё более подходящий — 1280-1536 МБ. Но для топовых моделей уже востребован и больший объём, порядка 2 ГБ, что предлагают видеокарты серии Radeon HD 6900, и 3 ГБ, ставящиеся на некоторые модификации GeForce GTX 580. Тем более, что видеокарту всегда лучше подбирать с небольшим запасом. К слову, в случае интегрированных видеоядер и устаревших дискретных видеокарт бывает так, что указанное на коробке количество видеопамяти не равно объему установленных на плату микросхем. Такое было ранее в случае видеоплат low-end, работающих с частью системной памяти при помощи технологий TurboCache (NVIDIA) и HyperMemory (ATI): В характеристиках видеокарт с поддержкой этих технологий в маркетинговых целях указывался объём памяти (в т. ч. и часть ОЗУ), который может использоваться видеочипом, равный 128 МБ, в то время как в реальности на них установлен меньший объем — 16-32 МБ. Поэтому всегда нужно внимательно читать материалы нашего сайта, чтобы не попадаться на подобные ухищрения в будущем. Но пока что можно жить спокойно, ведь сейчас в таких видеокартах уже нет никакого смысла, их нишу прочно заняли интегрированные чипсеты. С имеющимися разновидностями видеокарт по объёму локальной памяти мы разобрались, но ведь объём памяти для видеокарт — это еще не всё, и даже зачастую не главное! Очень часто бывает так, что на дешёвые видеокарты ставят очень большое количество памяти, чтобы нарисовать красивые цифры на их коробках и в описаниях готовых систем (поэтому их так любят сборщики — вспомните слоганы вроде «4 ядра, 4 гига»), с расчетом на то, чтобы они лучше продавались. Но для слабых видеокарт в повышенном объёме памяти никакого смысла нет, они ведь всё равно не смогут выдавать приемлемую частоту кадров на высоких настройках, в которых и используется большие объёмы текстур и геометрии. Продавцы часто используют объём видеопамяти в качестве основной характеристики видеокарт, и это вводит в заблуждение простых покупателей, плохо знакомых с реальным положением дел. Сравним производительность решений с разным количеством видеопамяти на примере двух одинаковых видеокарт Radeon HD 6950, имеющих единственное отличие — на первой из них установлено 1 ГБ видеопамяти, а на второй — 2 ГБ. Любой менеджер по продажам скажет вам, что вторая видеокарта значительно лучше первой, кроме случаев, когда в магазине есть модели только с 1 ГБ памяти и редчайших случаев честных и компетентных продавцов. А что получается на самом деле? Есть ли великая разница? Посмотрим на цифры, полученные в игре Metro 2033, являющейся одной из наиболее требовательных: Как видите, в большинстве игровых режимов объём видеопамяти влияет на производительность не слишком значительно — разница не превышает 5-6%. То же самое получается и в других играх, даже современных и ПК-эксклюзивных (что сейчас большая редкость). Лишь в сверхвысоком разрешении и с максимальными настройками качества появляется значимая разница, когда модель с 1 ГБ заметно отстаёт от более дорогой карты с 2 ГБ памяти — на 27%. Казалось бы — вот оно, ради чего нужно платить деньги! Но посмотрите на цифры кадров в секунду при разрешении 2560×1600 — разве 18,9 FPS можно назвать комфортной скоростью? Нет. Что 14,9 FPS, что 18,9 FPS — эти цифры одинаково не имеют практического смысла, никто не будет играть с настолько дёрганой частотой смены кадров. Поэтому, с некоторым допущением, можно считать, что разница в объёме видеопамяти между 1 ГБ и 2 ГБ сейчас незначительно сказывается на скорости рендеринга, и сравнивать даже топовые видеокарты по количеству памяти не нужно. Но речь шла только об объёмах памяти выше 1 ГБ. Да и 512 МБ для плат нижнего ценового диапазона сейчас вполне достаточны. В этих случаях, примеры, когда объём памяти начинает сказываться на производительности, весьма редки. Разработчики игровых приложений рассчитывают используемые в играх ресурсы и графические настройки так, чтобы все данные входили в локальную видеопамять наиболее распространённых на рынке видеокарт. То есть, сейчас это уровни 512 МБ (для low-end) и от 1 ГБ для всех остальных видеокарт, включая и высокие разрешения и максимальные настройки качества. А если видеопамяти меньше, то современные игры или будут тормозить или даже не дадут выставить максимальные настройки. Но этот расчётный объем видеопамяти у игровых разработчиков растет, даже несмотря на засилие консолей и мультиплатформы. Ещё пару лет назад было вполне достаточно 512-640 МБ, а теперь появились проекты, в которых этот объёма недостаточно. Но даже среди самых последних игр таких проектов пока мало, но они уже появляются. Поэтому, в случае не слишком большой разницы в цене между видеокартами с разными объёмами памяти при прочих равных условиях (частота и ширина шины), следует покупать модель с большим объёмом. Но без погони за цифрами — никакой low-end карте не поможет пара гигабайт медленной DDR3-памяти. Такой объём ей на данный момент просто не нужен. Зато важен другой параметр, о котором мы поговорим далее. Подробнее о пропускной способности памяти Ещё одна важная характеристика, о которой мы уже писали — это пропускная способность памяти (ПСП), которая зависит как от частоты работы памяти, так и от ширины шины. Этот параметр определяет количество данных, которые теоретически можно передать в память или из памяти за единицу времени. Другими словами, это скорость, с которой графическое ядро может записывать и считывать различные данные в локальную видеопамять. Соответственно, чем быстрее считываются текстурные, геометрические и прочие данные, и чем быстрее записываются в буфер рассчитанные пиксели, тем выше будет общая производительность. Пиковая пропускная способность памяти рассчитывается довольно просто — это произведение «эффективной» частоты памяти на количество данных, передаваемых за такт (ширина шины памяти). Например, для GeForce GTX 580 с шиной 384 бит и частотой видеопамяти 1002(4008) МГц, ПСП будет равна: 1002 МГц × 4 (передача данных с учетверённым темпом) × 48 (384/8 байт за такт) ≈ 192,4 ГБ/с Естественно, что последнее нигде широко не афишируется. Для производителя узкая шина и дешевле в производстве, и позволяет удобнее масштабировать производительность решений линейки. И две одинаковые видеокарты с одинаковыми частотами, но с разной шириной шины памяти, будут сильно отличаться по производительности. Та, у которой ПСП больше, может обрабатывать большее количество данных, по сравнению с картой с меньшей разрядностью шины, хотя сами GPU у них совершенно одинаковые. Рассмотрим очень жизненный пример — модель GeForce GTS 450 с двумя разными типами памяти, GDDR5 на более дорогой модели и DDR3 на дешёвой. Во время выхода на эту видеокарту ставили исключительно быструю GDDR5-память с приличной пропускной способностью. Но когда её время прошло и она спустилась в нижний ценовой диапазон, производители начали экономить, выпуская варианты с DDR3-памятью, которая гораздо дешевле. Результат подобной экономии можно пронаблюдать на следующей диаграмме: Как видите, всё очень печально для DDR3-варианта — даже в далеко не самой новой игре разница в различных разрешениях экрана составляет от 50 до 70%! То есть, мощность GPU во всех протестированных условиях ограничена медленной видеопамятью. Модель с DDR3 просто не может считывать и записывать данные с теоретически возможной скоростью. Таким образом производители вместе с компанией NVIDIA снизили себестоимость модели, спустив её ещё ниже в бюджетный сегмент. Поэтому при выборе между видеокартой с бо́льшим и меньшим объёмом видеопамяти нужно всегда смотреть на тактовые частоты, ширину шины и цены! Так, при большой разнице в ценах между двумя решениями среднего и низшего уровней с 1 ГБ и 2 ГБ памяти нет смысла гнаться за дорогим вариантом — видеокарта такого уровня просто не получит большой прибавки в производительности от увеличенного объёма. Но если приходится выбирать между видеокартами с разным объёмом памяти и разной ПСП, то тут выбор уже не так однозначен, и нужно его совершать исходя из того, какого уровня видеокарта и насколько разнятся их частоты. Не забывая и про цену, естественно. Например, при выборе между топовой видеокартой с 1,5 ГБ памяти и более высокими тактовыми частотами против такой же карты но с 3 ГБ памяти со стандартными частотами и более высокой ценой на данный момент выгоднее будет первая видеокарта, так как она обеспечит даже бо́льшую производительность почти во всех режимах и условиях, кроме самых высоких разрешений. То же касается, к примеру, GeForce GTS 450 с 1 ГБ GDDR5-памяти против GTS 450 с 2 ГБ DDR3 — первый вариант точно будет быстрее. В большинстве режимов видеокарты бо́льшая частота и ширина шины играет значительно более важную роль, чем бо́льший объём видеопамяти, и только в высоких разрешениях увеличенный объем может серьёзно сказаться на скорости рендеринга. В 1981 году компания IBM представила первый в мире персональный компьютер — IBM PC. В нем использовалась допотопная видеокарта с возможностью вывода монохромного изображения, но не это главное. Все наше внимание приковано к шине Industry Standa

В далеком 1981 году создатели IBM PC и подумать не могли о том, что всего через двадцать пять лет компактные домашние компьютеры смогут выдавать практически фотореалистичную картинку с миллионами полигонов, а игровые миры раскинутся на тысячи виртуальных километров. Интересно, что сказал бы Герман Холлерит (Herman Hollerith), узнав, что основанная им компания по изготовлению перфокарт и счетных машин в очередной раз оказалась у истоков наших ретро-исследований? Частота графического процессора (GPU)Читайте также:

|