Самый слабый процессор в мире

Для настоящего ретроспективного анализа мы решили вернуться к самым худшим процессорам из всех, которые когда-либо предлагались различными поставщиками. Для этого потребовалось фундаментально изучить процессор, а не просто оценить их невысокий рейтинг или слишком низкую скорость. В истории уже полно заурядных продуктов, которые не вполне отвечали ожиданиям, но не были действительно плохими.

Многие люди напомнили бы здесь об ошибке выполнения команды FDIV в Pentium, но причина, по которой мы не включили этот процессор его в наш список, довольно проста: несмотря на то, что для Intel это была огромная маркетинговая неудача, повлекшая чувствительные для компании затраты, в сущности, ошибка была незначительной. Она не повлияла ни на кого, кто уже выполнял научные вычисления, а масштаб и область проблемы в технических терминах никогда не считались крупными. Этот инцидент сегодня вспоминается, скорее, как неудачный способ, при помощи которого Intel справилась с ним, чем как всеобъемлющая проблема самой микро-архитектуры Pentium.

Мы также включили в список несколько плохих чипов. Эти чипы, может быть, и не были худшими из худших процессоров, но они или вызывали серьезные проблемы, или не смогли заинтересовать ключевые сегменты рынка. Ниже приведен наш список худших процессоров.

3. Высокие температуры быстро убивают процессор

Есть мнение, что работая при температурах, близких к максимальным, процессор проживет меньше. С физической точки зрения смысл в этом есть — при высоких температурах деградация кремниевого кристалла идет быстрее. Но тут есть два важных замечания: во-первых, критические температуры, которые указывают производители, берутся с хорошим запасом зачастую в пару десятков градусов. Во-вторых, срок жизни кремниевого кристалла — это многие десятилетия (сейчас хватает самолетов начала 90-ых годов, «мозг» которых — Intel 386 тех же лет, и они отлично работают), поэтому незначительное уменьшение срока жизни при нагреве вы гарантированно не заметите, сменив процессор гораздо раньше.

А вот что действительно может заставить деградировать процессор быстрее, так это повышение напряжения до близких к критическим: в таком случае негативные эффекты можно увидеть уже спустя год — процессор будет не способен нормально работать на той частоте, с которой не было проблем при покупке, и придется ее снижать.

6. Все эти Xeon с AliExpress — головная боль и танцы с бубнами

В последние несколько лет популярность Xeon с китайских торговых площадок выросла в разы (как и цены на них, увы). Причина этому проста: сервера переводят на более новое «железо», а старое, отработавшее 5-7 лет, списывают и продают за копейки, и его с большим удовольствием скупают китайцы. В итоге зачастую за 500-2000 рублей на Ali можно купить топовый процессор для своего сокета, десктопный аналог которого может стоить в разы дороже.

Основная критика идет из-за того, что с сокетом LGA775 и Xeon 5450 (и аналогами), с которых все и начиналось, действительно есть некоторые проблемы — нужно перепрошивать BIOS, не все платы совместимы и так далее. Но если брать более новые процессоры и сокеты — к примеру, Xeon X3440 и LGA1156 — то тут проблем нет вовсе, потому что поддержка серверных CPU уже есть в BIOS материнских плат на LGA1156, и вам просто нужно заменить процессор в сокете, после чего все заработает без всяких танцев с бубном.

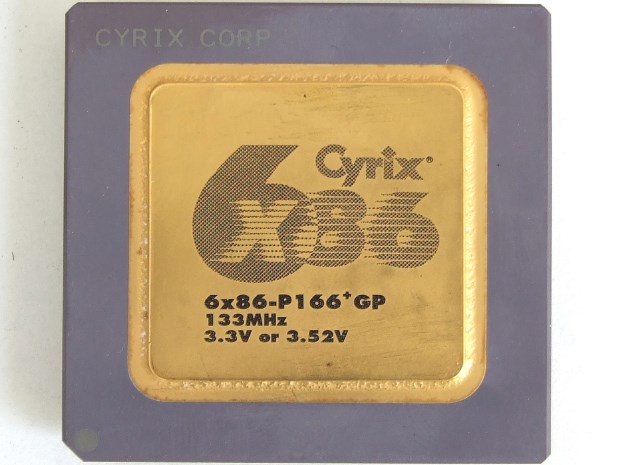

Cyrix 6x86

Cyrix был одним из производителей процессоров на архитектуре x86, который не пережил 90-е годы. Процессоры вроде этого были одной из причин схода компании со сцены. 6x86 заметно опережал Intel Pentium в операциях с целыми числами, но его блок операций с плавающей запятой был ужасен, и стабильность при работе с материнскими платами с Socket 7 оставляла желать много лучшего. Если в конце 1990-х вы играли в компьютерные игры, лучшим выбором были процессоры Intel, можно было довольствоваться AMD, а 6x86 относился к малоприятной категории «Прочее». Он вряд ли кого-то порадовал бы даже в качестве подарка.

4. Архитектура ARM лучше x86

В последнее время ведутся разговоры о том, что ARM лучше x86, и скоро будет массовый переход компьютеров на новую архитектуру. Тут следует понимать, что нет такого понятия, как хорошая или плохая архитектура — есть понятие хороший или плохой процессор. Сравнение ARM и x86 выглядит как сравнение атомного реактора и двигателя внутреннего сгорания: вроде и тот и тот берут на входе топливо и дают на выходе энергию, но делают это абсолютно разными способами, и чтобы сравнить их производительность и эффективность нужно уже брать конкретных представителей и сравнить их между собой. Аналогично и с архитектурами — имеет смысл брать представителей каждой и сравнивать, после чего делать вывод, что какой-то из них быстрее/энергоэффективнее/дешевле, а другой наоборот.

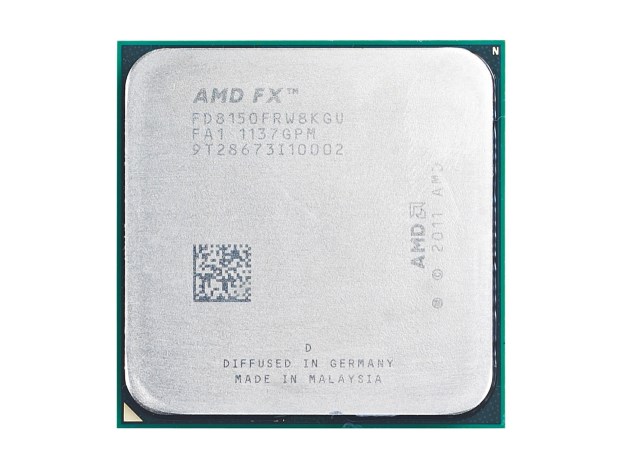

AMD Bulldozer

Этот процессор должен был отнять у Intel долю рынка за счёт повышения эффективности и сокращения площади чипа. AMD хотела предложить более компактное ядро с более высокими частотами, что позволило бы компенсировать недостатки общих ресурсов. В итоге получилась катастрофа. Необходимые тактовые частоты не были достигнуты, расход энергии был слишком большой, а производительность ниже требуемой. В итоге о конкуренции с Intel AMD не могла и мечтать.

1. Intel Itanium

Процессор Intel Itanium был радикальной попыткой перенести сложность аппаратного обеспечения в оптимизацию программного обеспечения. Вся работа по определению того, какие команды должны выполняться одновременно, выполнялась компьютером еще до того, как этот CPU выполнит первый байт кода.

Аналитики предсказывали, что Itanium покорит мир. Но этого не произошло. Компьютеры не смогли достичь необходимой производительности, и этот чип слишком отличался от всего, что было выпущено до него. Хотя ожидалось, что Itanium полностью заменит архитектуру x86 и изменит мир, он с трудом удержался несколько лет в узком сегменте рынке, и не использовался больше почти нигде.

IBM PowerPC G5

Партнёрство IBM и Apple при работе над PowerPC 970, который Apple называла G5, должно было стать судьбоносным. Когда были анонсированы первые устройства на G5, Apple обещала выпустить процессор с частотой 3 ГГц в течение года. IBM не смогла обеспечить нужные компоненты, которые могли бы достичь подобных частот при умеренном энергопотреблении. G5 не смог как следует заменить G4 в ноутбуках из-за высокого расхода энергии. Apple была вынуждена перейти на Intel и архитектуру x86, чтобы продолжать выпускать конкурентоспособные ноутбуки.

8. 100% нагрузка на процессор убивает его быстрее

Не самый частый миф — обычно проводится аналогия с техникой, которая при работе на максимум изнашивается и ломается быстрее. Но вот в процессоре нет механических частей, а деградация при нормальных условиях работы — процесс крайне медленный, и вы гораздо раньше купите себе новый ПК.

Худшие процессоры за всю историю компьютеров — часть №2

Продолжаем подборку не самых лучших процессоров, при выходе которых на рынок возникал лишь один вопрос — а смысл было их выпускать-то?

Intel Core i7-2700K (2011)

Ни для кого не секрет, что второе поколение процессоров Intel Core i было крайне хорошим — тут и припой под крышкой, позволяющий разогнать CPU до 4.5+ ГГц, и поддержка AVX инструкций, что здорово помогает в расчетных задачах — в общем, эти процессоры достаточное количество пользователей эксплуатируют до сих пор, ибо старшие решения в линейке без проблем работают вместе с GTX 1060 и даже 1070.

Однако самый старший представитель второго поколения — i7-2700K — вызывал некоторое удивление. Посудите сами — его от крайне популярного i7-2600K отличает лишь 100 МГц частоты и несколько десятков долларов стоимости, причем они оба разгоняются и имеют полностью идентичные кристаллы, что позволяют достичь одинаковых частот. Поэтому продажи i7-2700K были крайне низкими, и Intel поняли свою ошибку — начиная с третьего поколения в каждой линейке (Core i3, i5 и i7) был только один процессор с возможностью разгона.

Pentium D (2005)

Чтобы поспеть за AMD, которые выпускали первые двухядерные процессоры Athlon 64 X2, Intel в спешке взяла два кристалла от Pentium 4, поместила их на одну подложку и стала продавать как двухядерный процессор. Разумеется, возникло просто море проблем: во-первых, Pentium 4 были сами по себе достаточно горячими, а два их вместе требовали очень хорошего теплоотвода, ибо тепловыделение достигало 130 Вт. Во-вторых, в то время пользовательский софт не умел работать с двумя ядрами, нагружая только одно, а с учетом того, что в Pentium D Intel снизила частоту процессора, чтобы он меньше грелся, то старшие Pentium 4 зачастую оказывались быстрее. В-третьих, для этих процессоров требовалось покупать новую материнскую плату из-за более высоких требований к VRM (питанию процессора), и на старте эти платы имели только поддержку памяти DDR2, которая была тогда достаточно новой, дорогой и зачастую более медленной, чем DDR.

Итог был немного предсказуем — с учетом того, что Athlon 64 X2 этих недостатков был лишен, его продажи были куда выше, даже с учетом более высокой цены. Intel же выпускала свои «топорные» двухядерные Pentium D вплоть до 2008 года, причем с минимальными обновлениями.

AMD FX-9590 (2013)

К концу 2013 года стало понятно, что архитектура Vishera от AMD свое отжила. Однако, как мы помним, Ryzen вышли только в 2017 году, так что компании нужно было как-то продавать свои десктопные решения. И выход был найден — путем «грубой силы» был сделан FX-9590 — первый десктопный процессор, способный «из коробки» работать на частоте в 5 ГГц. Почему путем «грубой силы»? Да потому что AMD банально сильно повысила напряжение, чтобы процессор мог работать на такой частоте. Конечно, тут еще был отбор наиболее удачных для разгона кристаллов, но все еще в основном такие частоты «брались» благодаря повышению напряжения на ~0.1 В в сравнении со «стандартными» FX-8320 и 8350.

В итоге такое повышение напряжения привело к тому, что процессор имел теплопакет в 220 Вт — доселе невиданная цифра даже среди высокопроизводительных решений, где максимум колебался в районе 150 Вт. С учетом того, что максимальная допустимая температура у Vishera всего 75 градусов против 100 у Intel, для охлаждения такого монстра приходилось использовать или систему водяного охлаждения, или большой башенный кулер. К тому же далеко не каждая материнская плата имела цепи питания, способные отдать свыше 200 Вт — AMD даже подготовила список таких плат, которых было всего 8 (и это при том, что всего плат под Vishera было под сотню).

С учетом того, что тот же i7-4770K стоил всего на 10 долларов дороже, но при этом имел теплопакет в 2.5 раза ниже, работал на любой плате под LGA1150 и, что самое главное, зачастую был до полутора-двух раз быстрее — очевидно, что продажи FX-9590 были крайне низкими, а сам этот процессор стал последним гвоздем в крышке гроба с Vishera.

Во времена «войн» между AMD и Intel многие забыли про такого производителя x86 процессоров, как VIA, и это не удивительно: если «красные» и «синие» всегда сначала пытались сделать топовые решения, а потом, путем их урезания, получались более слабые, то вот VIA никогда в топы не лезла, ограничиваясь дешевым низкопроизводительным сегментом, но бросая на него все силы.

И это принесло свои плоды: в 2008 году, когда вышло в продажу первое поколение процессоров Nano, оказалось — сюрприз — что они лучше и Athlon 64 2000+, и первого поколения Atom. И тут ничего удивительного не было — как я говорил выше, та же AMD получала слабые решения путем урезания мощных, и этот Athlon ничем не отличался от более мощных собратьев, кроме как частотой в. 1 ГГц — да, только так можно было уложиться в теплопакет 10 Вт. Что касается Atom, то он вообще по своим возможностям был ближе к Pentium 4, что в 2008 году смотрелось бледно. VIA же разрабатывала свои процессоры с нуля, с прицелом на низкопроизводительный «холодный» сегмент, поэтому в итоге они и выиграли.

Думаю, у вас уже возник вопрос — а что такие процессоры делают в этой статье, если они были даже лучше конкурентов? Ключевой момент — были. К 2012 году, когда вышло последнее поколение Nano, уже двухядерное, оказалось, что конкуренты тоже на месте не сидели: так, у Intel были готовы уже 4-поточные 1.8 ГГц Atom со встроенным видеоядром, поддерживающим DirectX 10 и возможностью проигрывать 1080р видео. А у AMD были процессоры линейки E (E-350), на которых можно было даже поиграть в современные на тот момент игры — пусть и при минимальных настройках графики. И это при том, что все эти процессоры имели теплопакет ниже 20 Вт. Что же предлагали VIA? Два ядра с частотой в 1.2 ГГц, так что в итоге даже Atom был быстрее. Графику Chrome9 HD прямиком из конца нулевых, с поддержой лишь DirectX 9 и HD-видео. И, что самое худшее — ценник, который был выше, чем у Atom (но, правда, несколько ниже, чем у AMD E-350, но последний был куда мощнее).

В итоге у VIA были все шансы занять низкопроизводительный сегмент, и сейчас выпускались бы планшеты на Windows не с Atom, а с Nano. Но, увы, свой шанс они прошляпили, и в итоге практически ушли с рынка x86-процессоров — почти, потому что в сотрудничестве с китайскими властями VIA недавно представили процессоры KX-6000, построенные по 16 нм техпроцессу, имеющие до 8 ядер с частотой до 3 ГГц. По словам компании, эти решения должны конкурировать с Core i5 6-ого поколения (i5-6400), но как будет на деле — узнаем только через год, когда они выйдут в продажу.

Intel Pentium P5 60/66 МГц (1993)

В первой части статьи я писал о ранних Pentium 4, которые выпускались на мертворожденном сокете 423, который уже спустя год был заменен на 478, процессоры для которого были зачастую до двух раз быстрее. И, оказывается, Intel уже не первый раз так «кидала» пользователей.

Итак, 1993 год. Компания анонсирует процессоры Pentium — суперскалярная архитектура (возможность выполнять 2 команды за 1 такт), 64-битная шина данных, улучшенный математический сопроцессор, механизм предсказания ветвлений — в общем, купить новые процессоры захотели многие. То, что они требовали новые платы с Socket 4, никого не удивляло. И — сюрприз — всего через полгода Intel анонсирует более быстрый Pentium на 75 МГц, требующий уже платы с Socket 5. И через год к ним добавляются процессоры уже на 100 МГц, то есть на 50% быстрее. При этом, разумеется, сокеты 4 и 5 были несовместимыми, так что те, кто купил первые Pentium, остались ни с чем, и им для апгрейда приходилось менять и материнскую плату в том числе.

Intel Celeron Covington (1998)

К концу 90-ых в Intel понимают, что не топами едиными нужно жить — компьютеры становятся все популярнее, и далеко не всем нужны высокопроизводительные устройства — большинству требуются дешевые CPU, способные потянуть систему с офисом и Косынкой. И для удовлетворения спроса Intel в 1998 году выпускает первые Celeron с частотами в 266 и 300 МГц, но без кэша второго уровня L2.

Конечно, для офисных задач этого было более чем достаточно, но после тестов вскрывалась правда — без кэша L2 эти процессоры были даже слабее Pentium MMX годовалой давности с более низкой частотой, которые стоили почти столько же. Из-за этого эти Celeron получили у обзорщиков множество не самых лестных прозвищ — Slugeron (от sluggish — медлительный), Celery (сельдерей) и Deceleron.

С другой стороны, это была просто находка для оверклокеров — так как зачастую именно кэш L2 препятствовал сильному разгону Pentium II (ибо тогда все разгонялось вместе), Celeron без него легко брали 400-450 МГц, из-за чего в играх, для которых кэш L2 был не особо нужен, они оказывались почти на уровне «пеньков», но при этом за куда меньшую цену. Но с учетом того, что разгоном мало кто занимался — доверие к новой линейке было подорвано.

Впрочем, Intel смогла достаточно оперативно решить проблему, и уже через год вышло новое поколение Celeron, уже с кэшем L2, но его было вдвое меньше, чем у текущих Pentium: да, это снижало их производительность, но не настолько, чтобы они были хуже предыдущих поколения Pentium, так что линейка Celeron на долгие годы стала популярным решением для сборки не самых дорогих ПК.

На этом на сегодня все, и, если я найду еще материал, выйдет третья и скорее всего заключительная статья по худшим процессорам в истории ПК.

3. AMD Bulldozer

Процессоры на архитектуре Bulldozer от компании AMD должны были перебежать дорогу Intel за счет продуманного совместного использования некоторых возможностей чипа с целью улучшения эффективности и уменьшения размеров кристалла. Компания AMD хотела создать небольшое ядро с более высокой частотой, чтобы избавиться от проблем, связанных с общим дизайном. Но в результате она получила катастрофу. Процессоры Bulldozer не могли достичь целевой тактовой частоты, и расходовали слишком много энергии. Их производительность составляла лишь небольшую долю от того, что требовалась. Довольно редкий случай, когда CPU оказался настолько плохим, что чуть не уничтожил компанию, разработавшую его. Процессорам Bulldozer почти это удалось, поэтому в этом плане это самый худший процессор.

2. От разгона процессоры сгорают

Стоит различать программные и «железячные» параметры процессора. Так, частота — это чисто программный параметр: к примеру, для энергосбережения она может снижаться до сотен мегагерц, а при сильной нагрузке взлетать до нескольких гигагерц. Поэтому банальное увеличение частоты никак навредить не может — максимум вы получите нестабильную работу процессора, но сжечь его таким способом точно не сможете.

Совсем другое дело — напряжение. Это — «железячный» параметр: с одной стороны, чем выше напряжение, тем более высокие частоты становятся доступны процессору. С другой стороны, у каждого процессора есть безопасный диапазон напряжений, и при выходе из него есть ненулевой шанс обеспечить себе поход в магазин за новым CPU.

10. Cell Broadband Engine

Последний пункт в нашем списке худшие процессоры — Cell Broadband Engine. Хотя к этому процессору мы испытываем некоторую теплоту, все равно бросаем его в общую кучу. Этот процессор служит превосходным примером того, как чип может быть феноменально хорош теоретически, но почти невозможным для практического использования.

Его могла бы использовать компания Sony в качестве процессора общего назначения для свой приставки PS3. Но чип Cell был намного лучше для мультимедийной и векторной обработки, чем для решения задач общего назначения (его дизайн датируется тем временем, когда Sony считала, что будет обрабатывать нагрузку на процессор и GPU, используя одну и ту же архитектуру процессора). Многопоточному процессору довольно сложно добиться получения преимуществ от использования блоков SPE (синергические обрабатывающие элементы), и он слишком не похож на другую архитектуру.

Слабый процессор с мощной видеокартой. Имеет ли смысл?

Не плохой обзорщик . Частенько смотрю видосы!

грати можна но не рекомендую

Да, смысл имеет. Но нужен хотя бы слабенький 4-х ядерник, Phenom X4 например. Видеокарта вытягивает практически любую, даже процессорозависимую игру. Но главное! Если видеокарта Nvidia, нужно обработку PhysX поставить на видеокарту, а не на проц., как по умолчанию., незнаю только как у ATI, там как-то Havoc надо перенастроить только на обработку видеокартой. Убелся сам на личном опыте и на вроде как очень процессорозавимой игре GTA5, заменил просто 580 на GTX1080, имея слабый PhenomX4, игра пошла плавно на максе без лагов, вылетов и тормозов со всеми всключенными настройками, тесселяцией, HBAO+, даже с масштабированием текстур. Просадки FPS вообще сразу пропали, а я уже хотел было всю систему менять. В современных играх главную роль играет мощная видеокарта, а не проц. Но если играть в 4K, то там наверно картина будет другая, тут уж в любом случае нужен будет мощный проц.

Сам когда-то страдал той же фигней: была 9800 GT и Celeron 440. Во многих играх был тот самый "эффект медленного процессора" (размытие по краях изображения).

Можем. Практикуем. Не имеем денег.

xAGS37x согласен

блин а когда такая печалька как amd fx6300 разогнанный до 4.3 и gtx560 то что из этого все же слабее и менять надо?((( и какие тогда сейчас процессоры актуальны для современных игр?

все верно! но, есть нюансы. к примеру для Fallout 4 нужна связка мощный проц и карта ибо есть просадки и карта не нагружается на 100% (по крайней мере моя). в то же время в Far Cry 4 плавность картинки просто не реальная - карта нагружена на 90 - 100 % и связка относительно слабый проц + мощная карта работает нормально (опять же сужу по своему конфигу)! в любом случае, если есть запас мощности , его нужно использовать - подбор более мощного проца или разгон слабого, пересадка на PCe 3.0, если карта сидит на 2.0.

Народ подскажите какой прогой он пользуется для отображения загруженности GPU прямо на экран ? У меня 4670k (разогнан до 4.4) и видяха gtx 980, хочу посмотреть загружен ли GPU на 100% в играх.

Обладатели персональных компьютеров со стажем любят вспоминать процессоры, которые внесли значительный вклад в их развитие. Между тем, даже у ведущих производителей не всегда всё происходит гладко, и иногда продукты получаются неудачными. Настолько, что удивляешься, как их вообще решили выпустить.

Мы рассмотрим процессоры, у которых были какие-то фундаментальные изъяны, а не просто производительность ниже ожидаемой. История хранит память о множестве посредственных продуктов, которые не оправдали ожиданий, но мы выберем самые худшие из них.

Многие бы включили сюда ошибку Pentium FDIV, но мы не станем этого делать. Это была крупная маркетинговая ошибка Intel, которая обошлось в копеечку. Сам по себе баг был не настолько значительный. Если вы не занимались какими-либо научными вычислениями, вас он никак не касался. Этот инцидент сейчас можно вспоминать только потому, что Intel неудачно справилась с ним, а не в качестве проблемы процессорной архитектуры.

Intel Pentium 4 Prescott

Prescott удвоил и без того длинный конвейер Pentium 4, расширив его до более чем 30 стадий, с одновременным переходом на техпроцесс 90 нм. Это было ошибкой. Скорость упала настолько, что даже новый блок предсказания ветвлений не помог, а утечки тока привели к повышенному энергопотреблению. Это не позволило добиться тактовой частоты, при которой процессор был бы успешным. Prescott и его 2-ядерный родственник Smithfield оказались наиболее слабыми продуктами для настольных ПК по сравнению с конкурентами того времени.

5. Чем больше ядер у процессора, тем лучше

2. Intel Pentium 4 (Prescott)

Процессор Prescott удвоил ставки и так уже длинного конвейера выполнения команды в P4 , расширив его почти до 40 шагов, и при этом Intel ужала размер кристалла P4 , перейдя к технологии 90 нм. Это оказалось ошибкой. Новый чип столкнулся с остановками конвейера, и даже его принципиально новый механизм прогнозирования не смог предотвратить этого. В результате, паразитные утечки вызывали значительное потребление энергии, не давая процессору достичь тактовой частоты, необходимой для успеха. Сам процессор Prescott, и его двуядерный родственник, Smithfield, оказались, по сравнению с конкурентами, самыми слабыми продуктами для настольных компьютеров, которые Intel когда-либо выпускала.

8. IBM PowerPC G5

Партнерство Apple и IBM по выпуску процессора PowerPC 970 (который Apple продвигала, как G5), предположительно, стало для компании поворотным пунктом. Когда Apple объявила о своих первых продуктах G5, она пообещала выпустить чип с тактовой частотой в 3 ГГц в течение года.

Но IBM не смогла поставить компоненты, которые бы работали с этой частотой при разумном потреблении энергии, и из-за больших расходов энергии процессор G5 не смог заменить использовавшийся в ноутбуках G4. Компания Apple была вынуждена обратиться к Intel и ее архитектуре x86, чтобы выпускать конкурентоспособные ноутбуки и улучшить производительность своих настольных компьютеров.

7. Если процессор не раскрывает видеокарту, то это плохой процессор

«Секта раскрывателей» образовалась всего несколько лет назад, когда с выходом PlayStation 4 и Xbox One создатели игр сильно увеличили требования к CPU. Что «проповедует» эта «секта»? Если процессор не может нагрузить видеокарту на 100%, то значит вы или зря заплатили за такую мощную видеокарту, или зря сэкономили на процессоре.

Почему вообще это происходит? Процессор в игре отвечает за подготовку кадров для видеокарты, физику, искусственный интеллект и т.д., соответственно он может подготовить определенное количество кадров в секунду — к примеру, 50. Видеокарта тоже может обработать и вывести на экран определенное количество кадров, и если их больше 50 в секунду — она некоторое время будет простаивать, а процессор «молотить» на 100%, если меньше 50 — наоборот, видеокарта будет работать на 100%, а процессор будет временами «отдыхать».

Причем следует понимать, что и топовые процессоры тоже могут подготовить не больше определенного количества кадров в секунду, просто в их случае эти цифры могут быть больше 100, а то и 200 — с учетом того, что их зачастую ставят с топовыми видеокартами и ультра-настройками графики, то обычно упор идет именно в GPU. Но если вы искусственно возьмете и снизите разрешение до HD, а настройки до минимальных, то можно будет увидеть, как какой-нибудь i9-9900K будет работать на 100%, а GTX 1060 прохлаждаться.

Отсюда можно сделать легкий вывод — от процессорозависимости можно всегда легко избавиться. Видеокарта прохлаждается? Поднимите настройки графики, увеличьте разрешение — в итоге вы получите более красивую картинку с ровно такой же производительностью. Разумеется, мы не рассматриваем случай, когда процессор тянет игру еле-еле в 15 FPS — даже в таком случае зачастую можно будет полностью нагрузить видеокарту, но вот играть будет все равно не приятно, хотя и, конечно, красиво.

Непочётные упоминания: Qualcomm Snapdragon 810

Snapdragon 810 был первой попыткой Qualcomm построить процессор на архитектуре big.Little на техпроцессе TSMC 20 нм, который просуществовал недолго. За последние годы это был самый непопулярный чип Qualcomm. Samsung полностью пропустила его в своих смартфонах, другие компании столкнулись с серьёзными проблемами при работе с ним. Разработчики процессора заявляли, что виновато плохое управление электропитанием со стороны производителей мобильных устройств. В любом случае, процессор перегревался и расходовал слишком много энергии.

Cell Broadband Engine

Отличный пример того, как процессор может быть феноменальным теоретически, но как его почти невозможно реализовать на практике. Sony использовала его как процессор общего назначения в PlayStation 3, но он был намного лучше при обработке мультимедиа и векторных вычислениях, чем в приложениях общего назначения. Его разработка относится к тем временам, когда Sony собиралась обрабатывать команды центрального и графического процессора единой архитектурой. Было крайне непросто разделить команды на потоки, чтобы воспользоваться его Synergistic Processing Elements, а отличия от других архитектур были слишком большими.

С компьютерным железом всегда было связано много мифов — часть из них действительно в некоторых случаях имеет смысл, но хватает и укоренившихся, типа «чем тяжелее блок питания, тем он лучше», или «чем больше видеопамяти, тем быстрее видеокарта». И в этой статье я разберу основные мифы, связанные с процессорами.

Intel Itanium

Это была радикальная попытка объединить аппаратную сложность и программные оптимизации. Всю работу по определению того, какую команду выполнять параллельно, делал компилятор до того, как процессор выполнял хотя бы байт кода. Аналитики предсказывали, что Itanium завоюет мир. Этого не случилось. Компиляторы не смогли предложить необходимую производительность, и процессор был абсолютно несовместим со всем тем, что было выпущено до него. Казалось, что он полностью заменит собой архитектуру x86, но в итоге процессор несколько лет влачил жалкое существование и был нишевым продуктом.

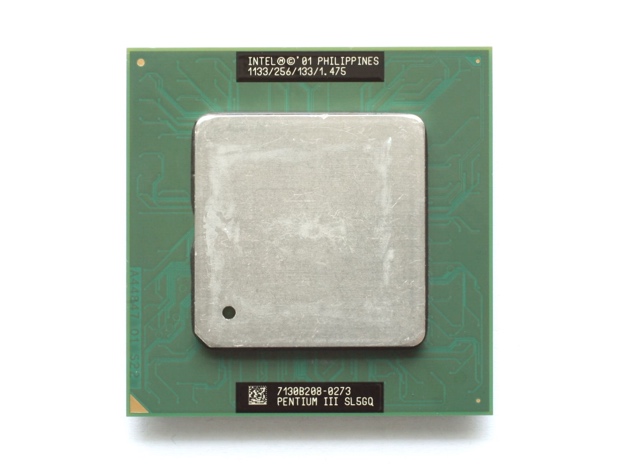

Pentium 3 1,13 ГГц

Сама по себе архитектура Pentium 3 было отличной. Вот только во время гонки тактовых частот против AMD Intel всеми силами старалась сохранить лидерство по производительности, поскольку поставки дорогостоящих систем снижались. В одно время оценки показали, что AMD имеет преимущество 12:1 по продажам процессоров 1 ГГц. Intel предприняла отчаянную попытку повысить частоту Pentium 3 на техпроцессе 180 нм до 1,13 ГГц. Она провалилась. Процессор работал крайне нестабильно, и Intel отозвала всю партию.

7. Qualcomm Snapdragon 810

Процессор Snapdragon 810 был первой попыткой компании Qualcomm построить «большой» маленький CPU с использованием недолго продержавшейся технологии TSMC по созданию 20-нм кристаллов. Система на одном кристалле, несомненно, была последней запомнившейся любовью Qualcomm в области высокотехнологичных чипов – Samsung просто проигнорировала их, а другие компании столкнулись с серьезными проблемами, пытаясь использовать этот процессор.

Сама Qualcomm утверждала, что проблемы с чипом были вызваны некачественным управлением питания у OEM (изготовителей комплексной системы). Но вне зависимости от того, была ли проблема связана с технологическим 20-нм процессом TSMC, или реализацией его в самой Qualcomm, или оптимизацией у OEM – результат оказался тем же самым: сильно греющийся во время работы процессор, использовавший дизайн высшего уровня, и при этом, никем не принятый.

1. Intel Itanium

Процессор Intel Itanium был радикальной попыткой перенести сложность аппаратного обеспечения в оптимизацию программного обеспечения. Вся работа по определению того, какие команды должны выполняться одновременно, выполнялась компьютером еще до того, как этот CPU выполнит первый байт кода.

Аналитики предсказывали, что Itanium покорит мир. Но этого не произошло. Компьютеры не смогли достичь необходимой производительности, и этот чип слишком отличался от всего, что было выпущено до него. Хотя ожидалось, что Itanium полностью заменит архитектуру x86 и изменит мир, он с трудом удержался несколько лет в узком сегменте рынке, и не использовался больше почти нигде.

9. Pentium III 1.13 ГГц

Сам по себе, процессор P3 имел неплохую архитектуру. Но, в соревновании с AMD за достижение частоты в 1 ГГц, Intel слишком стремилась быть лидером производительности. В результате, поставки ее систем высокого класса, постепенно отставали все больше и больше (в какой-то момент, по существующим оценкам, AMD имела преимущество 12:1 над Intel в фактических поставках систем с частотой 1 ГГц). В последней попытке обогнать соперника, Intel попыталась разогнать созданные по 180-нм технологии процессоры P3 до частоты 1.13 ГГц. Эта попытка провалилась. Чипы были фундаментально неустойчивыми, и компании пришлось отозвать всю выпущенную партию.

5. Cyrix MediaGX

Процессор MediaGX был первой попыткой компании построить интегрированный процессор SoC («система на одном кристалле») для настольных компьютеров, когда в одном кристалле объединены графика, CPU, шина PCI и контроллер памяти. К сожалению, эта попытка была сделана в 1998 году, а это означает, что все эти компоненты были реально ужасны.

Совместимость с материнской платы была неправдоподобно ограничена, базовая архитектура, лежащая в основе процессора (Cyrix 5×86) была аналогом Intel 80486, и CPU не мог быть подключен к внешнему кэшу L2 (а в те времена это была единственная разновидность кэша L2) . Такие чипы, как Cyrix 6×86 могли хотя бы называться конкурентами Intel в приложениях, связанных с бизнесом. Но процессор MediaGX не мог бы конкурировать даже с мертвым ламантином.

10. Спецификации процессора на сайте производителя — правда в последней инстанции

Следует понимать, что очень многое на сайте производителя пишется с элементами маркетинга. Откровенной лжи, конечно же, не будет, но вот недоговорок может быть много: так, для нового i9-9900K указан теплопакет в 95 Вт, но вот на практике даже без разгона на максимальной частоте TurboBoost он может потреблять. аж до 200 Вт, то есть вдвое больше. Казалось бы, Intel врет? Ничуть — при родных 3.6 ГГц процессор действительно укладывается в 95 Вт, а TurboBoost — функция необязательная. Поэтому лучше смотреть реальную производительность и тепловыделение в обзорах.

Как видите, мифов о процессорах хватает. Знаете какие-нибудь еще? Пишите об этом в комментариях.

Процессор есть тепло, немудрено почему у меня дома все еще холодно!

Можно подумать "Ксеоны", не жрут в простое больше, обычного i7? Cколько стоит мать на 1156 ? Проще переплатить за гарантию(новенький процессор купить) Чем купить не известно что, у китайцев. P.S Мать на 775 сокет обойдется в 1400р, если что.

WanRoi

WanRoi написал: Cколько стоит мать на 1156 ? Проще переплатить за гарантию(новенький процессор купить) Чем купить не известно что, у китайцев.

если у тебя уже есть система на старом сокете с простеньким процем, можно продлить ей жизнь, купив недорогой xeon. и это действительно может быть отличным вариантом. собирать полностью устаревшую систему из непонятных б/ушных комплектующих - это да, мягко говоря, спорно.

meagarry Так в том и прикол культ какой-то этого старого мусора берут с али б/у матерь и проц и типа дешевле нового Ryzen 1600 ))) Идиотизм там зашкаливает, причем весь youtube таким бредом заполнен !

ARM это "новая архитектура" ))))) Это 80-е годы ппц ! Кто такие тупые блоги делает ?? ARM "новая архитектура" АХАХАХАХ )))

я думаю более тонкий тех процесс куда более склонен к поражению температурами и напряжением поэтом сравнивать кокой то там и9 9909 и 286 несколько некоректо так то например у меня где-то там валяется добрая видеокарта со слоновым тех процессором и гддр2 причем я пускал ее без охлаждения вовсе и мне не удалось ее убить и в свою очередь не факт чо этого не произойдет с новенькой вегой. с другой стороны считается качество современной электроники возросло по сравнию с былинной на чем я на своем примере убедился ибо например моя первая ПеКа была чувствительна к грозе и каждой вспышкой молнии поблизости комп реально давал лаг. касательно архитектуры х86 некоторые поговаривают что это далеко не самая удачная ПеКа архитектура 70х годков и что в общем тоу она достигла своего предела и тормози прогресс накладывая существенные ограничения на процессоры а те в свою очередь могут эволюционировать только в парадигме потребной этих стандартов что делает микросхему большой толстой и неэффективной но имеющие ряд преимуществ перед монолитными эвм былинными основанных на иных наборах логики в свое время. а вот какой нибудь супер пупер мультигиперпоточный профессор с чисослодробилкой мог бы поднять скорость в параллельных вычислениях и как следствие быстродействие компа в целом. например гпу очень так не плохо эволюционируют по сравнению с цпу. но тут надо знать пека матан чтоб этот вопрос со сменой логической парадигмы уразумевать. является ли арм в этом плане лучшей архитектурой совершенно неизвестно. и так же стоит отметить что всякое популярное по создается именно под х86 и в целом под бинарный одномерный принцип с небольшим хаком неопределенности и всякой матрицы. а пункт 7 - значится есть пека тезис что системные требования растут быстрее для гпу нежели для цпу таким образом это некая динамичная во времени система поэзия которой не может означать очевидного вина или слива так еще сильно разнится как в самой игре так и между играми. тема раскрытия более актуальна для старых процессоров которые объективно не способны дать требуемого от пека, когда встает вопрос о замене на некоторою видеокарту которая сама по себе с запредельно мощным процессором способна исполнить свое предназначение. а видеокарта при топовом процессоре чаще всего расходным пека материалом и обычно топовый процессор готов к раскрытию нескольких поколений видеокарт то есть такой ситуации когда новая крутая видеокарта устаревает а более новая и быстрая продолжает добавлять фпс такой системе.

вполне годная и полезная инфа

Такое чувство, что 7 пункт писал школьник. Про пропускную способность и её ограничения, влияние на загрузку видяхи ничего не сказано, как и про потоки.

Будь в курсе последних новостей из мира гаджетов и технологий

1. Чем больше частота, тем быстрее процессор

Миф уходит корнями в 90-ые, когда многие пользователи, дабы не разбираться в непонятных Intel 386, 486 и Pentium просто смотрели на частоту — если у какого-то процессора она была выше, то он действительно оказывался быстрее. Однако сейчас это в общем и целом не верно: процессоры могут иметь различные архитектуры с абсолютно разной производительностью на герц, поэтому какой-нибудь Apple A7 с частотой в 1.3 ГГц оказывается на уровне Snapdragon 800 с частотой в 2.2 ГГц и в этом нет ничего странного. Но если речь идет о процессорах одного поколения и одной линейки, то это в целом работает: так, i5-8400 с частотой в 2.8 ГГц действительно медленнее i5-8500 с частотой в 3 ГГц.

Cyrix MediaGX

MediaGX был первой попыткой создать систему на чипе для персональных компьютеров с графикой, центральным процессором, шиной PCI и контроллером памяти на одном кристалле. К сожалению, 1998 год был неподходящим временем для этого. Все эти компоненты вышли весьма неудачными. Совместимость с материнской платой была ограниченной. Архитектура центрального процессора Cyrix 5x86 была эквивалентна Intel 80486, он не мог подключиться к кэшу второго уровня, который находился за пределами чипа (других тогда не было). Cyrix 6x86 хотя бы мог противостоять процессорам Intel в бизнес приложениях, MediaGX не был способен даже на это.

9. Водяное охлаждение процессора лучше воздушного

С точки зрения физики все верно: вода (или большая часть жидкостей) — куда лучший проводник тепла, чем воздух. Однако следует понимать, что на рынке существует множество так называемых супер-кулеров, способных отвести и 200, и 250 Вт от процессора, чего с головой хватит для 99% пользователей ПК, причем стоят они зачастую дешевле СВО с такими же возможностями.

Так что брать СВО имеет смысл только в двух случаях: или у вас в компактном корпусе стоит мощный процессор, и супер-кулеры в него не помещаются, или же у вас разогнанный под 4.5 ГГц топовый 32-ядерный AMD Threadripper, потребляющий 400+ Вт. Во всех других случаях «водянка» обычно становится пустой тратой денег и возможными проблемами в будущем.

4. Cyrix 6×86

Компания Cyrix была одним из производителей процессоров архитектуры x86, которая не смогла пережить конец 1990-х. (Сегодня ее лицензия на x86 принадлежит компании VIA .) И основной составляющей причины, из-за которой это произошло, стали такие ее чипы, как 6×86. Продукция Cyrix характеризовалась сомнительным отличительным признаком – некоторые игры и приложения снабжались предупреждениями о несовместимости.

Чипы 6×86 были значительно быстрее, чем Intel Pentium, когда выполнялись команды целочисленной арифметики, но ее процессор с плавающей точкой ( FPU ) был очень плохим, и сами чипы не демонстрировали особенной устойчивости при работе на материнских платах с разъемом Socket 7. В конце 1990-х годов геймерам нужен был процессор Intel, хотя они иногда и соглашались на AMD. Но процессор 6×86 был один из ужасных чипов, предназначавшихся «для всех остальных», и любители компьютерных игр вам вряд ли хотели получить его в качестве рождественского подарка.

Texas Instruments TMS9900

Когда IBM искала процессор для оригинального IBM PC, выбор стоял между этим чипом и Intel 8086/8088, в разработке ещё находился Motorola 68K. TMS9900 имел 16 бит адресного пространства, тогда как 8086 предлагал 20 бит. В результате в одном случае объём оперативной памяти мог быть только 64 килобайт, в другом 1 Мб. Отсутствовали регистры общего назначения. 16 16-битных регистров хранились в главной памяти. Естественно, IBM отдала предпочтение Intel.

6. Texas Instruments TMS9900

Процессор TMS9900 — это неудача, которую стоит упомянуть по одной важной причине: Когда компания IBM выбирала процессор для своего первого персонального компьютера IBM PC, у них было лишь два возможных выбора для обеспечения поставки к названной ими дате – TMS9900 и 8086/8088 (процессор Motorola 68K тогда находился в разработке, но еще не был готов к этому времени). Чип TMS9900 был единственным, работающим процессором с адресами памяти длиной в 16 бит, в то время как процессор 8086 имел длину адреса, равную 20 битам. Эта разница позволяла адресовать памяти RAM объемом в 1 Мбайт вместо 64 Кбайт.

Читайте также: