Самая простая видеокарта с hdmi

«Эльдоблог» расскажет, зачем нужна технология HDMI 2.1, в чём её преимущества для игр и разрешения 8К, и как ею воспользоваться.

Сколько стоит платить за видеокарту?

Этот параметр может постоянно меняться, но в целом значение составляет от $100 до $300 за карты для 1080p. Это зависит от того, хотите вы играть на максимальных настройках или ближе к средним. Если вы хотите включить сглаживание, которое выпрямляет изрезанные линии на краях игровых объектов, нужна более мощная карта, особенно если вы хотите поставить остальные настройки максимально возможными.

Если вас удовлетворяет средняя детализация и частота кадров, можно заплатить недорого. Если же вы хотите максимальную детализацию и настройки на разрешении 1080p, карта может стоить $200-$300.

Ценовой диапазон: от 110 до 130 тысяч рублей

Лучшее семейство 3D-ускорителей: GeForce RTX 3070 Ti

Лучшая видеокарта: MSI GeForce RTX 3070 Ti Gaming X Trio 8G

У карты массивная система охлаждения и приятная ARGB-подсветка. Ее производительности достаточно для игры в разрешении 2.5К при максимальных настройках качества графики, а во многих играх она обеспечивает в районе 50 FPS даже в разрешении 4К с трассировкой лучей и DLSS. В этой модели используется графический чип GA104, работающий на тактовой частоте 1575 МГц, а в режиме буст его можно разогнать до 1965 МГц. 8 ГБ памяти GDDR6X работает на частоте 19 ГГц, и вот разве что памяти для каких-то применений уже хотелось бы больше. Для многих это будет грустно услышать, но карточка имеет защиту от майнинга LHR. Стандартный набор видеовыходов: 3 DP 1.4a и 1 HDMI 2.1.

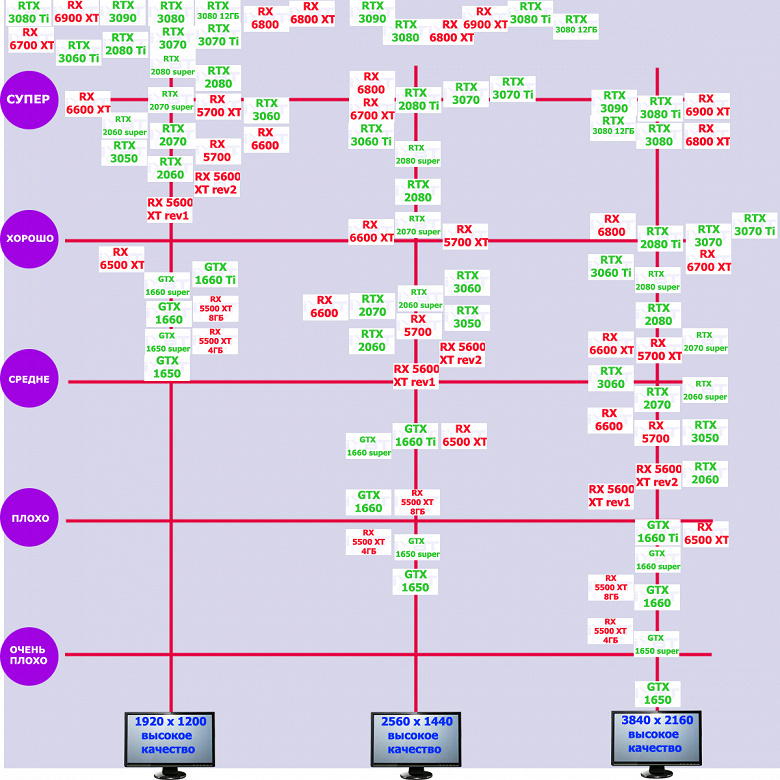

Выбор карты для конкретного разрешения

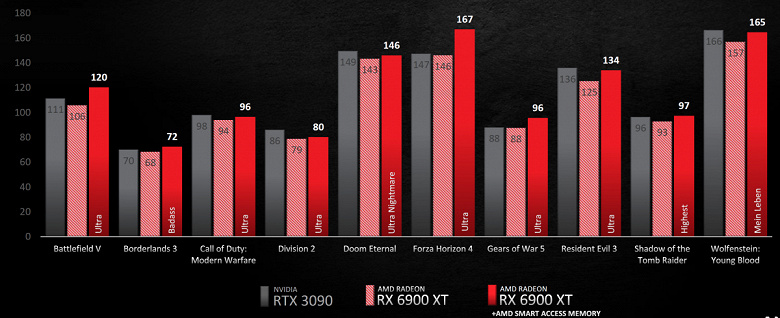

Теперь пройдемся по разрешениям без учета ценового фактора — только чистая производительность. На картинке ниже приведена производительность без RT.

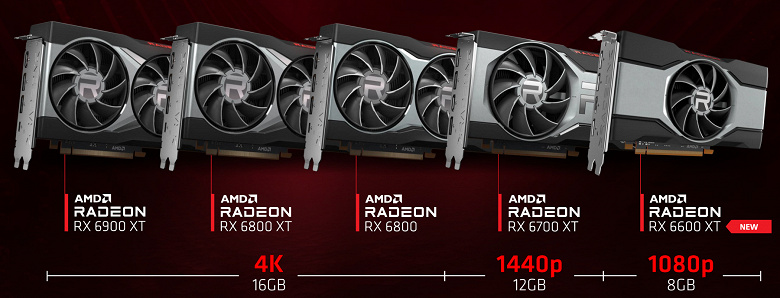

Разрешение 3840×2160 (4К)

Лучшие ускорители для разрешения 4К (при максимальном качестве графики) — GeForce RTX 3090, GeForce RTX 3080 Ti, GeForce RTX 3080, Radeon RX 6900 XT, Radeon RX 6800 XT. Они обеспечивают высокий уровень комфорта во всех играх без использования трассировки лучей. При включении RT ускорители Radeon RX 6000 для 4К смотрятся гораздо бледнее, скорее в их случае можно рассчитывать лишь на 2.5К. В принципе, для 4К еще вполне подойдут GeForce RTX 3070 Ti, GeForce RTX 3070 и Radeon RX 6800, но не во всех играх можно будет получить полный комфорт при максимальных настройках графики даже без RT.

Флагманы предыдущего поколения Nvidia — GeForce RTX 2080 Super и GeForce RTX 2080 Ti — также могут обеспечить приемлемую играбельность в 4К без RT. Все остальные ускорители — уже не для 4К даже для классических игр с растеризацией.

Разрешение 2560×1440/2560×1600 (2.5К)

Кроме всех вышеперечисленных ускорителей для разрешения 2.5К при максимальном качестве картинки в классических играх с растеризацией подойдут прежде всего GeForce RTX 3060 Ti и Radeon RX 6700 XT (в ряде игр они могут замахнуться и на 4К), а если мы говорим об играх с RT, то именно в этом разрешении хорошо проявят себя Radeon RX 6900 XT и Radeon RX 6800 XT. Radeon RX 6600 XT весьма неплох для этого разрешения, но только без RT и не во всех играх (а уж 4К явно не для него). GeForce RTX 3060 и представители предыдущего поколения GeForce RTX 2070 Super/2070/2060 Super и Radeon RX 5700 XT также неплохо справляются с 2560×1440 (правда, уже с оговорками).

Разрешение 1920×1080/1920×1200 (Full HD, 2K)

Все вышеупомянутые видеокарты, разумеется, прекрасно подойдут и для игры на мониторах с базовым на сегодняшний день разрешением. В Full HD обеспечивают полный комфорт не только новинки типа Radeon RX 6500 XT и GeForce RTX 3050 (безо всяких условий и оговорок), но и все семейство предыдущего поколения GeForce RTX 20, а также Radeon RX 5600 XT. Неплохо для такого разрешения смотрятся и Radeon RX 5500 XT и GeForce GTX 1660 Ti, которые потянут некоторые игры в Full HD на максимальных настройках. Менее производительные карты уже не тянут разрешение Full HD при максимальном качестве, а значит, придется снижать качество картинки или разрешение.

Если вы часто посещаете игровые и компьютерные сайты, то много слышите про игры 4K на новых высокопроизводительных мониторах. Также немало говорится о распространении более доступных мониторов 1440p (2560 х 1440). Если читать подобные статьи, может показаться, что высокое разрешение и монструозные дорогостоящие видеокарты правят миром компьютерных игр.

- Игровые видеокарты 1080p: поле для конкуренции

- Основы выбора: на что смотреть в видеокартах 1080p

- Сколько нужно видеопамяти?

- Какие порты нужны видеокарте?

- Сколько стоит платить за видеокарту?

- Покупать видеокарту AMD или Nvidia?

- Брать разогнанную карту или референсную?

- Что такое частота обновления монитора и почему она важна?

- Какую карту брать под разрешение 1080p?

- Лучшая в средней ценовой категории: Nvidia GeForce RTX 3060 Ti Founders Edition

- Лучшая для качества Ультра на разрешении 1080p или высокой частоты обновления на 1440p: Sapphire Pulse Radeon RX 5600 XT

- Лучшая для разрешения 1080p и высокой частоты обновления: Zotac GeForce GTX 1650 Super Twin Fan

- Лучшая для разрешения 1080p с высокой частотой монитора: Zotac GeForce GTX 1660 Super Twin Fan

- Лучшая для игр 1080p: Gigabyte GeForce GTX 1660 OC 6G

- Лучшая для киберспортивных игр на высокой частоте и 1080p: MSI GeForce GTX 1660 Ti Gaming X 6G

- Лучшая для игр 1080p и виртуальной реальности: Nvidia GeForce GTX 1060 Founders Edition

- Лучшая для игр 1080p: PowerColor Red Devil Radeon RX 570

- Лучшая для бюджетных геймеров 1080p: Sapphire Pulse Radeon RX 5500 XT

- Лучшая для игр в 1080p на компактных компьютерах: Zotac GeForce GTX 1650 OC

На самом деле это не так. Да, они важны, за ними будущее, они будут становиться намного дешевле. Однако, в ближайшем будущем игры на разрешении 1920 х 1080 (1080p или Full HD) останутся наиболее распространёнными.

Сейчас мониторы 1080p доступны по цене. Можно найти немало подобных моделей стоимостью около $100 и даже средние видеокарты могут запускать последние игры на таких мониторах с высокой частотой кадров.

Если посмотреть на результаты последнего аппаратного исследования Steam, 1080p остаётся наиболее распространённым разрешением мониторов для компьютерных игр в этом сервисе, опережая все остальные разрешения вместе взятые.

Правда в том, что хотя большинство геймеров не отказались бы играть на максимально возможном разрешении, покупка мониторов 4К или 1440p и видеокарты под них обойдётся очень дорого. Одно зависит от другого. Большинство просто хотят, чтобы игры выглядели хорошо и работали быстро. Этого намного дешевле добиться на разрешении 1920 х 1080.

Это разрешение стало фактическим стандартом для игр вот уже давно и будет оставаться, пока дешёвые мониторы 1440p не станут более распространёнными, а видеокарты под разрешение 4К не станут более дешёвыми. В настоящее время игры на разрешении 4К недоступны на видеокарте дешевле чем $400, если только вы не хотите снизить настройки графики. По этой причине покупка видеокарты с возможностью плавно запускать игры на разрешении 1080p является хорошим вариантом, которого хватит на ближайшие несколько лет, если не дольше.

Игровые видеокарты 1080p: поле для конкуренции

Есть одна проблема: поскольку 1080p является таким популярным разрешением, множество видеокарт конкурируют в этом сегменте. Он стал ещё более насыщенным к началу 2022 года, в нём существует почти десяток разных классов видеокарт на основе разных графических процессоров. В этой статье мы рассмотрим необходимую для выбора идеальной карты 1080p функциональность и расскажем о лучших протестированных картах для разного бюджета.

Nvidia в 2018 и 2019 годах представила видеокарты на архитектуре Turing, также были видеокарты AMD Navi. Они принесли с собой самые мощные видеокарты 1080p не дороже $300. Nvidia во второй половине 2018 года представила первые карты в новой линейке GeForce RTX, включая модели GeForce RTX 2080, GeForce RTX 2070 и дорогостоящую GeForce RTX 2080 Ti элитного класса.

Ценовой диапазон: до 70 тысяч рублей

Лучшее семейство 3D-ускорителей: Radeon RX 6600 XT

Лучшая видеокарта:Gigabyte Radeon RX 6600 XT Eagle PCI-E 8 ГБ GDDR6

Карта без подсветки выглядит скромно, но это добротная «рабочая лошадка». Она прекрасно показывает себя в разрешении Full HD, а в ряде игр способна обеспечить хорошую производительность и в разрешении 2.5К без снижения настроек графики. Модель оснащена тремя вентиляторами, то есть и в данном случае охлаждение даже избыточное. У карты 4 видеовыхода: 2 HDMI 2.1 и 2 DisplayPort 1.4a. Объем видеопамяти — 8 ГБ, для ускорителя такого уровня этого хватает с запасом. В принципе, карта интересна даже для майнинга криптовалют, поскольку используется память GDDR6, достаточно быстрая, но не такой кипятильник, как GDDR6Х. Интерфейс PCIe 4.0, но урезан до х8.

Базовая частота — 1626 МГц, максимальная — 2491 МГц.

Абсолютный лидер по соотношению цены и возможностей

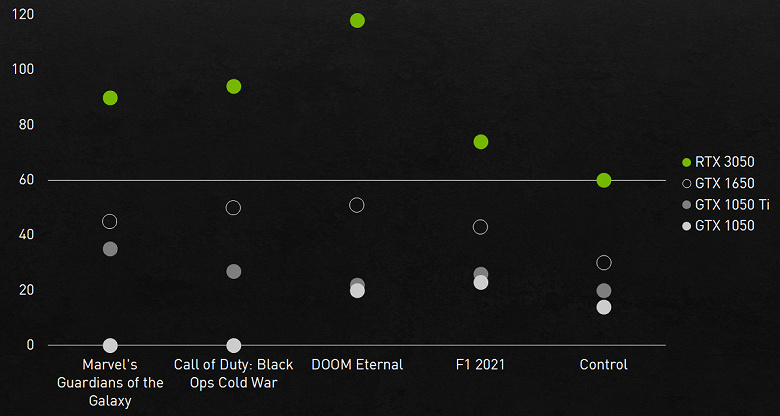

Лучшее семейство 3D-ускорителей: GeForce RTX 3050

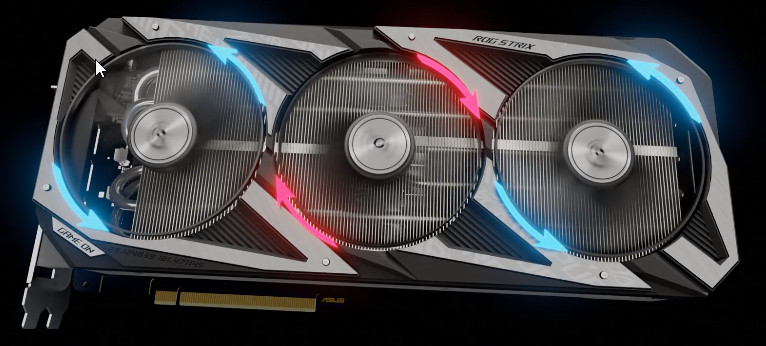

Лучшая видеокарта: Asus ROG Strix GeForce RTX 3050 OC Edition (8 ГБ)

Ускоритель в лучшем случае среднего уровня, но производители конкретных карт всячески стараются разогнать его и усилить охлаждение. Один из примеров такого подхода и взят нами в качестве образца.

По названию Asus ROG Strix GeForce RTX 3050 OC Edition (8 ГБ) понятно, что ускоритель разогнан уже с завода. Большого объема памяти GDDR6 будет хватать еще долго — во всяком случае, для тех режимов, которые этот ускоритель в принципе «вытянет». GeForce RTX 3050 поддерживает технологии DLSS и трассировку лучей, во многих случаях обгоняет конкурирующую модель Radeon RX 6600 и на голову выше ускорителей прошлых поколений GeForce GTX 1650, GeForce GTX 1050 Ti и GeForce GTX 1050. В частности, GeForce RTX 3050 содержит 2560 CUDA-ядер, что более чем вдвое больше, чем у GeForce GTX 1650.

Оснащение защитой от майнинга LHR позволяет ускорителю стоить несколько дешевле, поскольку делает его практически непригодным для майнинга, а значит, такие карты имеют шансы достаться простым пользователям. При скромном хэшрейте (13—15 мегахэшей в секунду) даже нет смысла возиться с оптимизацией GeForce RTX 3050 под майнинг Ethereum.

Карта стабильно работает при разгоне ядра до максимальных 2137 МГц, а памяти — до 16,04 ГГц, что обеспечивает прирост производительности около 8% относительно референса. Мощная система охлаждения, которой не постеснялись бы и иные топовые ускорители, при этом удерживает температуру ядра на несерьезном уровне 54 °C, а шум кулера составляет лишь 20,2 дБА, что едва превышает фоновый уровень шума в специально заглушенном помещении.

В продаже есть много видеокарт других производителей на GeForce RTX 3050, не так уж сильно отличающихся по цене. Однако по совокупности характеристик именно карту Asus ROG Strix GeForce RTX 3050 OC Edition (8 ГБ) мы признаём лидером.

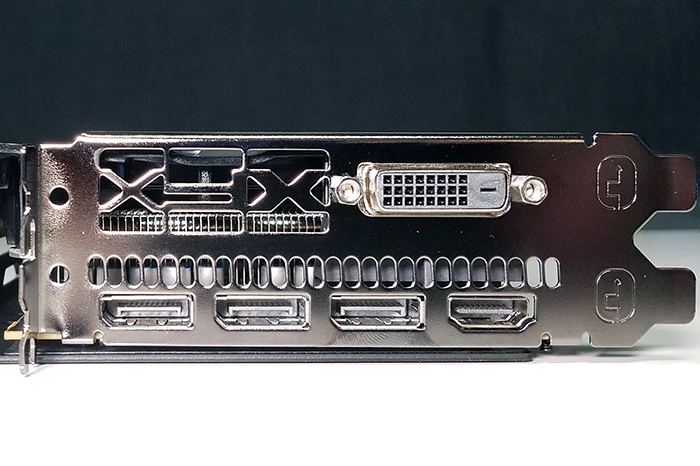

Какие порты нужны видеокарте?

Все стандартные разъёмы на современных видеокартах (VGA, DVI, HDMI, DisplayPort) поддерживают разрешение 1080p. В большинстве случаев нужно выбрать карту, разъёмы которой соответствуют разъёмам на вашем мониторе. Если только вы работаете с разрешением более чем 1080p, тогда может быть превышение возможностей некоторых интерфейсов, таких как VGA или старых версий HDMI.

Если же у вас 1080p, нет причин беспокоиться, все карты и большинство мониторов в наши дни имеют множество разъёмов. Скорее всего вы подключите монитор к видеокарте и проблем не будет. Разве что при обновлении со старого компьютера или карты потребуется новый кабель или переходник. Имейте это в виду при выборе новой видеокарты в магазине.

Стандарты DisplayPort 1.4 и HDMI 2.0 поддерживают разрешение 1080p с частотой обновления экрана до 240 Гц. Если вы хотите играть в игры с высокой частотой кадров, убедитесь в выборе карты и кабеля для этой цели. HDMI 2.0 и HDMI 2.1 не поддерживают частоты 360 Гц, для этого есть DisplayPort 1.4b и более современные стандарты. При покупке монитора вроде Asus ROG Swift 360Hz PG259QN убедитесь в наличии подходящей видеокарты и кабеля.

Если вы впервые прекращаете пользоваться разъёмами DVI или VGA, убедитесь, что интерфейсы HDMI и DisplayPort могут передавать аудиосигнал. Если на мониторе есть встроенные динамики или это HDTV, это может устранить ряд сложностей с кабелями.

Что такое HDMI?

HDMI — это мультимедийный интерфейс высокой чёткости. Если говорить проще, это разъём, позволяющий передавать видео и звук в высоком качестве. К ним добавляются дополнительные потоки информации, необходимые для воспроизведения — интернет-трафик, кодировка объёмного звучания, карты HDR-эффектов и прочие.

Что такое HDMI?

HDMI — это мультимедийный интерфейс высокой чёткости. Если говорить проще, это разъём, позволяющий передавать видео и звук в высоком качестве. К ним добавляются дополнительные потоки информации, необходимые для воспроизведения — интернет-трафик, кодировка объёмного звучания, карты HDR-эффектов и прочие.

Основы выбора: на что смотреть в видеокартах 1080p

Большинство видеокарт с достаточным уровнем качества для игр 1080p стоят между $150 и $300. Более дорогие карты также справятся с этим разрешением, но при цене $300 это перебор и в большинстве игр их возможности не будут раскрываться в полной мере. Давайте рассмотрим ключевые факторы при выборе.

Ценовой диапазон: от 130 до 160 тысяч рублей

Лучшее семейство 3D-ускорителей: Radeon RX 6900 XT

Лучшая видеокарта Gigabyte Radeon RX 6900 XT Gaming OC 16G (16 ГБ)

Карточка разогнана изначально, возможен и дополнительный ручной разгон, что в итоге обеспечивает до 8%-9% прироста производительности. Базовая частота процессора составляет 1815 МГц, повышенная — 2285 МГц. Набор видеовыходов представлен парами DisplayPort 1.4a и HDMI 2.1.

В играх без трассировки лучей (а таких на сегодня явное большинство) Radeon RX 6900 XT примерно соответствует невероятно дорогому (конечно, небезосновательно) флагманскому ускорителю Nvidia GeForce RTX 3090, а ручной разгон может вывести подобную карту в абсолютные лидеры.

Radeon RX 6900 XT легко потянет разрешение 4К при максимальных настройках графики, а в некоторых играх может обеспечить неплохую играбельность даже в 8К. При включении трассировки лучей производительность падает до уровня GeForce RTX 3070, но все же игр без этой технологии очень и очень много, а в некоторых играх трассировка лучей вроде бы есть, но визуально почти ничего не дает (и тогда включать ее нет смысла).

Чем отличается HDMI 2.1 от 2.0 и предыдущих версий?

Технология HDMI была создана в 2002 году, но массовое распространение получила только в 2010-х.

Стандарт HDMI 1.0 позволял показывать на экране картинку с разрешением Full HD (1920×1080) и скоростью до 60 кадров в секунду. Этого по-прежнему хватает для офисной работы, просмотра фильмов за компьютером и веб-сёрфинга.

Первое серьёзное изменение произошло в 2006 году с принятием стандарта HDMI 1.3. Он позволял смотреть видео с разрешением Super HD (2560×1440) при 60 кадрах в секунду или Full HD при 120 кадрах в секунду. Рядовым пользователям был важен последний вариант — он помог сгладить быстрые движения на экране, повысив чёткость изображения в динамичных сценах. Кроме того, в стандарте 1.3 появилась увеличенная глубина цветности, которая сделала оттенки более яркими, насыщенными и естественными.

В 2009 году разработали технологию HDMI 1.4 — она использовалась в первых телевизорах с разрешением 4K (3840×2160). Сегодня этот интерфейс — необходимый минимум для мультимедийной техники. Кабели версии 1.4 также получили поддержку локальной сети и передачи звука в двух направлениях. Стало возможным подключать телевизор к компьютеру, саундбару (звуковой панели) и интернету через один порт.

В 2013 году началось использование HDMI 2.0. Эта версия интерфейса позволяла смотреть 4K-видео со скоростью 60 кадров в секунду, получая высокую детализацию изображения и плавные движения одновременно. В ней появилась поддержка игровых мониторов с нестандартным соотношением сторон экрана — 21:9 и 19:9 против привычных 16:9. Это решение расширило поле зрения в играх — геймеры смогли лучше контролировать трёхмерное пространство вокруг своего персонажа.

В 2015 и 2016 годах были представлены порты HDMI 2.0a и 2.0b. У разъёмов есть поддержка расширенного динамического диапазона — технологий HDR и HLG. Они повышают статическую контрастность, позволяя получить более глубокие детализированные тени и чистые оттенки белого.

В новой версии интерфейса HDMI 2.1 скорость передачи данных повышена с 18 Гбит/с (у 2.0b) до 48 Гбит/с. Сравните это с интернет-подключением — до 1–2 Гбит/с по проводу и по Wi-Fi. Такой прирост позволяет перейти на новые уровни разрешения — 8K (7680×4320) и 10K (10240×5760). И всё это со скоростью до 120 кадров в секунду, повышенной глубиной цветности и поддержкой HDR. В отличие от HDMI 2.0, HDMI 2.1 использует технологию потокового сжатия изображения, которая позволяет уместить больше пикселей в один бит информации, но на пользователя она никак не влияет.

HDMI-кабель Vention High speed v1.4 with Ethernet 19F/19M, 5 м, Black Edition (VAA-B06-B500)

Решили продать видеокарту на пике цен и переждать дефицит на "затычке"? Выберем лучшую - дешевую, с HDMI, не прожорливую, и "тянущую" Скайрим и Сталкер.

Глядя, как цены на массовые GeForce GTX 1060 6 Гб на вторичном рынке переваливают за 15000 рублей, в голову приходит мысль - "пора продавать!". Ведь бум майнинга не вечен, мы проходили это в начале 2010-х, хотя то начало майнинга на видеокартах многие и не заметили, и в 2016-2018 годах, когда о майнинге и возможности стать миллионером вещали из каждого утюга. Дефицит и подорожание видеокарт в то время происходило с мая 2017 года по лето 2018.

реклама

Вот, как пример, динамика цен на популярную видеокарту GeForce GTX 1070, цена которой за год выросла с $500 до $880.

Сейчас ситуация повторяется, популярные видеокарты, пригодные к майнингу, не только резко подскочили в цене, но и вообще исчезли из магазинов. Но периодически можно найти видеокарту по почти приемлемой цене, как например GeForce GTX 1660 Super Palit StormX в Регарде.

реклама

Но разлет цен на GeForce GTX 1660 Super очень большой, и есть модели и дороже, как MSI GTX 1660 SUPER GAMING Z PLUS.

И сегодня у многих геймеров, имеющих в ПК такое сокровище, как Radeon RX 580 или GeForce GTX 1660 Super, не говоря уже о Radeon RX 5700 XT, встает вопрос - что с ним делать? Ведь через несколько месяцев сокровище опять превратится в тыкву, к тому же устаревшего поколения, цена которой на б/у рынке будет в районе 10000 рублей.

реклама

Можно начать майнить на ней, но дело это непростое, и требует время на то, чтобы разобраться с настройками программы-майнера, пула и биржи. А также прочитать кучу информации про вывод средств и обменники. Для школьника или студента с кучей свободного времени - это пара пустяков, но у работающего человека в возрасте 30+, на это часто нет ни сил, ни времени. Несколько моих знакомых с весьма мощными видеокартами даже и не будут пытаться заняться майнингом по этим причинам.

Второй вариант действий - продать видеокарту жадным майнерам на сегодняшнем пике цен. Особенно если играете на ней нечасто. Я, к примеру, иногда месяцами не запускаю никаких игр, и моя GeForce GTX 1060 только ускоряет браузеры и фильмы, с чем легко бы справилась слабенькая встроенная видеокарта Intel HD Graphics. Но встроенная видеокарта становится редким явлением, и на это есть несколько причин.

реклама

Причина первая, внезапно встроенная Intel HD Graphics стала неприлично дорога для своей производительности, о чем я уже писал в блоге "Привыкаем жить без видеокарт: сколько стоит UHD Graphics 630 и в какие игры на ней можно поиграть". Да вы и сами можете легко сравнить цены процессоров с Intel HD Graphics и без, например Core i3-10100F и Core i3-10100. Результат такой ценовой политики привел к тому, что геймеры часто берут процессор без встроенной видеокарты.

Причина вторая - у процессоров AMD Ryzen нет простой, "офисной", встроенной видеокарты. Да, есть прекрасные встроенные Radeon RX Vega, но встроены они в гибридные процессоры, которые обычно не берут в геймерские ПК с дискретной видеокартой.

В результате продав дискретную видеокарту, среднестатистический геймер должен купить какую-либо замену, и вот такую замену в виде недорогой видеокарты мы и будем искать. Просто купить на Авито видеокарту десятилетней давности не самый лучший вариант, ведь разница между такими видеокартами по энергопотреблению, нагреву, шуму и производительности, зачастую, огромная.

Если посмотреть, какие видеокарты предлагают по ценам в 1000-1300 рублей, мы увидим огромное количество вариантов, от GeForce 6600 GT и GeForce 210 и до GeForce GTS 450 и Radeon HD 7570, и для выбора идеальной видеокарты данного ценового диапазона я предлагаю такие критерии:

- Низкое энергопотребление в простое

- Возможность ускорения видео для разгрузки процессора

- Низкий шум

- Производительность хотя бы на уровне UHD Graphics 630

- Низкий риск нарваться на "прожаренную" видеокарту с отвалом

- Наличие HDMI-выхода для удобства использования с новыми мониторами и ТВ

- Поддержка драйверами в Windows 10

Но вначале отталкиваться нам придется от цены и производительности, и скорее всего вы встретите на Авито такие популярные ранее модели как Radeon HD 4850, а также:

Radeon HD 4870

Radeon HD 5770

GeForce 8800 GT

GeForce 9600 GT

GeForce GTS 250

GeForce GTS 450

Попадутся и другие видеокарты, но общий ход мыслей для их выбора будет вам ясен. Теперь давайте разберем критерии выбора по классам видеокарт.

У меня сейчас валяется старенькая Radeon HD 4870, но рекомендовать ее в качестве "затычки" я бы не стал и врагу. Причина в том, что в те годы не особо "заморачивались" энергоэффективностью и Radeon HD 4870 кушает у меня около 100 ватт даже при просмотре Ютуба. При этом шумит и греется до 80 градусов. У Radeon HD 4850 с энергопотреблением дела чуть получше, но главное, что станет проблемой при их использовании - отсутствие драйверов под Windows 10. С сайта AMD для них можно скачать драйвера только под Windows 8 и более ранние ОС.

А вот у Radeon HD 5770 со схожей производительностью и с энергопотреблением все лучше, и драйвера под Windows 10 на сайте AMD есть. Гораздо эффективнее и ускорение видео, а как бонус, на многих моделях есть даже DisplayPort. А поддержка DirectX 11 позволит запустить гораздо больше новых игр.

Что касается старых видеокарт от NVIDIA, то с драйверами под Windows 10 все гораздо лучше. Вот список устройств, которые поддерживает драйвер 341.81 с сайта NVIDIA:

Все лучше и с энергопотреблением - GeForce 9600 GT "кушает" 34,6 Вт в простое, а GeForce GTS 250 - 45 Вт, и, в принципе, это семейство неплохо подходит на роль "затычек", если бы не склонность к отвалам чипа. Купить "прожаренную" видеокарту этого семейства, которая "заартефачит" спустя месяц - вполне частое явление.

А вот у видеокарт GeForce GT 240, GeForce GT 220, GeForce GT 440, GeForce GT 430, GeForce GTS 450 отвалы уже редки, энергопотребление умеренное и все в порядке с ускорением видео. Но по производительности немного превосходит UHD Graphics 630 только GeForce GTS 450.

Теперь о шуме и температурах. Попадаются экземпляры подобных видеокарт с продвинутыми кулерами, например - MSI N450GTS cyclone 1GD5/OC.

Такие кулеры еще и дают большой шанс, что видеокарта работала в комфортном температурном режиме.

Что касается производительности и цены. На GeForce GTS 450 и Radeon HD 5770 можно комфортно поиграть в The Elder Scrolls V: Skyrim, S.T.A.L.K.E.R.: Чистое небо, Метро 2033 и еще множество интересных игр, которые не дадут почувствовать, что ваша видеокарта совсем ущербна. И позволят скрасить вечера в ожидании GeForce RTX 3060 Ti, которые пойдут продавать жадные майнеры в 2022 году по 20000 рублей на Авито после окончания криптовалютной лихорадки.

Что касается цены, этот сегмент видеокарт как "макарошки", уже много лет стоит одинаково, в районе 1000-1300 рублей, а покупать сейчас что-то более производительное рука не поднимается, вспомните, за какие копейки отдавали майнеры Radeon RX 460 совсем недавно.

P.S. Видеокарты в Регарде майнеры расхватывают как горячие пирожки, и за те семь часов, что я писал этот блог 4 февраля, исчезла Radeon RX 580 почти за 40000 рублей и пара моделей GeForce GTX 1660 Super.

Пишите в комментарии, что вы думаете по поводу майнинга, цен на видеокарты, и пригодности видеокарт-"затычек" из блога в 2021 году.

Подпишитесь на наш канал в Яндекс.Дзен или telegram-канал @overclockers_news - это удобные способы следить за новыми материалами на сайте. С картинками, расширенными описаниями и без рекламы.

Руководство покупателя игровой видеокарты

На выбор видеокарты также может повлиять и имеющийся или предполагаемый к приобретению монитор. Или даже мониторы (во множественном числе). Так, для современных LCD-мониторов с цифровыми входами очень желательно, чтобы на видеокарте был разъём DVI, HDMI или DisplayPort. К счастью, на всех современных решениях сейчас есть такие порты, а зачастую и все вместе. Ещё одна тонкость заключается в том, что если требуется разрешение выше 1920×1200 по цифровому выходу DVI, то обязательно нужно подключать видеокарту к монитору при помощи разъёма и кабеля с поддержкой Dual-Link DVI. Впрочем, сейчас с этим проблем уже нет. Рассмотрим основные разъёмы, использующиеся для подключения устройств отображения информации.

Аналоговый D-Sub разъём (также известен как VGA -выход или DB-15F )

Это давно известный всем и привычный 15-контактный разъём для подключения аналоговых мониторов. Сокращение VGA расшифровывается как video graphics array (массив пикселей) или video graphics adapter (видеоадаптер). Разъём предназначен для вывода аналогового сигнала, на качество которого может влиять множество разных факторов, таких, как качество RAMDAC и аналоговых цепей, поэтому качество получаемой картинки может отличаться на разных видеокартах. Кроме того, в современных видеокартах качеству аналогового выхода уделяется меньше внимания, и для получения чёткой картинки на высоких разрешениях лучше использовать цифровое подключение.

Разъёмы D-Sub были фактически единственным стандартом до времени широкого распространения LCD-мониторов. Такие выходы и сейчас часто используются для подключения LCD-мониторов, но лишь бюджетных моделей, которые плохо подходят для игр. Для подключения современных мониторов и проекторов рекомендуется использовать цифровые интерфейсы, одним из наиболее распространенных из которых является DVI.

Разъём DVI (вариации: DVI-I и DVI-D )

DVI — это стандартный интерфейс, чаще всего использующийся для вывода цифрового видеосигнала на ЖК-мониторы, за исключением самых дешевых. На фотографии показана довольно старая видеокарта с тремя разъёмами: D-Sub, S-Video и DVI. Существует три типа DVI-разъёмов: DVI-D (цифровой), DVI-A (аналоговый) и DVI-I (integrated — комбинированный или универсальный):

DVI-D — исключительно цифровое подключение, позволяющее избежать потерь в качестве из-за двойной конвертации цифрового сигнала в аналоговый и из аналогового в цифровой. Этот тип подключения предоставляет максимально качественную картинку, он выводит сигнал только в цифровом виде, к нему могут быть подключены цифровые LCD-мониторы с DVI-входами или профессиональные ЭЛТ-мониторы со встроенным RAMDAC и входом DVI (весьма редкие экземпляры, особенно сейчас). От DVI-I этот разъём отличается физическим отсутствием части контактов, и переходник DVI-to-D-Sub, о котором речь пойдет далее, в него не воткнуть. Чаще всего этот тип DVI применяется в системных платах с интегрированным видеоядром, на видеокартах он встречается реже.

DVI-A — это довольно редкий тип аналогового подключения по DVI, предназначенного для вывода аналогового изображения на ЭЛТ-приемники. В этом случае сигнал ухудшается из-за двойного цифрово-аналогового и аналогово-цифрового преобразования, его качество соответствует качеству стандартного VGA-подключения. В природе почти не встречается.

DVI-I — это комбинация двух вышеописанных вариантов, способная на передачу как аналогового сигнала, так и цифрового. Этот тип применяется в видеоплатах наиболее часто, он универсален и при помощи специальных переходников, идущих в комплекте поставки большинства видеокарт, к нему можно подключить также и обычный аналоговый ЭЛТ-монитор со входом DB-15F. Вот как выглядят эти переходники:

Во всех современных видеокартах есть хотя бы один DVI-выход, а то и два универсальных разъёма DVI-I. D-Sub чаще всего отсутствуют (но их можно подключать при помощи переходников, см. выше), кроме, опять же, бюджетных моделей. Для передачи цифровых данных используется или одноканальное решение DVI Single-Link, или двухканальное — Dual-Link. Формат передачи Single-Link использует один TMDS-передатчик (165 МГц), а Dual-Link — два, он удваивает пропускную способность и позволяет получать разрешения экрана выше, чем 1920×1080 и 1920×1200 на 60 Гц, поддерживая режимы очень высокого разрешения, вроде 2560×1600. Поэтому для самых крупных LCD-мониторов с большим разрешением, таких как 30-дюймовые модели, а также мониторов, предназначенных для вывода стереокартинки, обязательно будет нужна видеокарта с двухканальным выходом DVI Dual-Link или HDMI версии 1.3.

В последнее время широкое распространение получил новый бытовой интерфейс — High Definition Multimedia Interface. Этот стандарт обеспечивает одновременную передачу визуальной и звуковой информации по одному кабелю, он разработан для телевидения и кино, но и пользователи ПК могут использовать его для вывода видеоданных при помощи HDMI-разъёма.

На фото слева — HDMI, справа — DVI-I. HDMI-выходы на видеокартах сейчас встречаются уже довольно часто, и таких моделей всё больше, особенно в случае видеокарт, предназначенных для создания медиацентров. Просмотр видеоданных высокого разрешения на компьютере требует видеокарты и монитора, поддерживающих систему защиты содержимого HDCP, и соединенных кабелем HDMI или DVI. Видеокарты не обязательно должны нести разъём HDMI на борту, в остальных случаях подключение HDMI-кабеля осуществляется и через переходник на DVI:

HDMI — это очередная попытка стандартизации универсального подключения для цифровых аудио- и видеоприложений. Оно сразу же получило мощную поддержку со стороны гигантов электронной индустрии (в группу компаний, занимающихся разработкой стандарта, входят такие компании, как Sony, Toshiba, Hitachi, Panasonic, Thomson, Philips и Silicon Image), и большинство современных устройств вывода высокого разрешения имеет хотя бы один такой разъём. HDMI позволяет передавать защищенные от копирования звук и изображение в цифровом формате по одному кабелю, стандарт первой версии основывается на пропускной способности 5 Гбит/с, а HDMI 1.3 расширил этот предел до 10,2 Гбит/с.

HDMI 1.3 — это обновленная спецификация стандарта с увеличенной пропускной способностью интерфейса, увеличенной частотой синхронизации до 340 МГц, что позволяет подключать дисплеи высокого разрешения, поддерживающие большее количество цветов (форматы с глубиной цвета вплоть до 48 бит). Новой версией спецификации определяется и поддержка новых стандартов Dolby для передачи сжатого звука без потерь в качестве. Кроме этого, появились и другие нововведения, в спецификации 1.3 был описан новый разъём mini-HDMI, меньший по размеру по сравнению с оригинальным. Такие разъёмы также используются на видеокартах.

HDMI 1.4b — это последняя новая версия данного стандарта, вышедшая не так давно. В HDMI 1.4 появились следующие основные нововведения: поддержка формата стереоотображения (также называемого «3D») с поочередной передачей кадров и активными очками для просмотра, поддержка Fast Ethernet-соединения HDMI Ethernet Channel для передачи данных, реверсивный аудиоканал, позволяющий передавать цифровой звук в обратном направлении, поддержка форматов разрешения 3840×2160 до 30 Гц и 4096×2160 до 24 Гц, поддержка новых цветовых пространств и самый маленький разъём micro-HDMI.

В HDMI 1.4a поддержка стереоотображения была значительно улучшена, появились новые режимы Side-by-Side и Top-and-Bottom в дополнение к режимам спецификации 1.4. И наконец, совсем свежее обновление стандарта HDMI 1.4b произошло буквально несколько недель назад, и нововведения этой версии пока неизвестны широкой публике, да и устройств с его поддержкой пока что на рынке нет.

Собственно, наличие именно разъёма HDMI на видеокарте необязательно, во многих случаях его может заменить переходник с DVI на HDMI. Он несложен и поэтому прилагается в комплекте большинства современных видеокарт. Мало того, современные GPU имеют встроенный аудиочип, необходимый для поддержки передачи звука по HDMI. На всех современных видеокартах AMD и NVIDIA нет необходимости во внешнем аудиорешении и соответствующих соединительных кабелях, и передавать аудиосигнал с внешней звуковой карты не нужно.

Передача видео- и аудиосигнала по одному HDMI-разъёму востребована прежде всего на картах среднего и низшего уровней, которые устанавливают в маленькие и тихие баребоны, используемые в качестве медиацентров, хотя и в игровых решениях HDMI применяется часто, во многом из-за распространения бытовой техники с такими разъёмами.

Постепенно, в дополнение к распространенным видеоинтерфейсам DVI и HDMI, на рынке появляются решения с интерфейсом DisplayPort. Single-Link DVI передаёт видеосигнал с разрешением до 1920×1080 пикселей, частотой 60 Гц и 8 бит на компоненту цвета, Dual-Link позволяет передавать 2560×1600 на частоте 60 Гц, но уже 3840×2400 пикселей при тех же условиях для Dual-Link DVI недоступны. У HDMI почти те же ограничения, версия 1.3 поддерживает передачу сигнала с разрешением до 2560×1600 точек с частотой 60 Гц и 8 бит на компоненту цвета (на более низких разрешениях — и 16 бит). Хотя максимальные возможности у DisplayPort немногим выше, чем у Dual-Link DVI, лишь 2560×2048 пикселей при 60 Гц и 8 бит на цветовой канал, но у него есть поддержка 10-битного цвета на канал при разрешении 2560×1600, а также 12 бит для формата 1080p.

Первая версия цифрового видеоинтерфейса DisplayPort была принята VESA (Video Electronics Standards Association) весной 2006 года. Она определяет новый универсальный цифровой интерфейс, не подлежащий лицензированию и не облагаемый выплатами, предназначенный для соединения компьютеров и мониторов, а также другой мультимедийной техники. В группу VESA DisplayPort, продвигающую стандарт, входят крупные производители электроники: AMD, NVIDIA, Dell, HP, Intel, Lenovo, Molex, Philips, Samsung.

Основным соперником DisplayPort является разъём HDMI с поддержкой защиты от записи HDCP, хотя он предназначен скорее для соединения бытовых цифровых устройств, вроде плееров и HDTV-панелей. Ещё одним конкурентом раньше можно было назвать Unified Display Interface — менее дорогую альтернативу разъёмам HDMI и DVI, но основной её разработчик, компания Intel, отказалась от продвижения стандарта в пользу DisplayPort.

Отсутствие лицензионных выплат важно для производителей, ведь за использование в своей продукции интерфейса HDMI они обязаны выплачивать лицензионные сборы организации HDMI Licensing, которая затем делит средства между держателями прав на стандарт: Panasonic, Philips, Hitachi, Silicon Image, Sony, Thomson и Toshiba. Отказ от HDMI в пользу аналогичного «бесплатного» универсального интерфейса сэкономит производителям видеокарт и мониторов приличные средства — понятно, почему им DisplayPort понравился.

Технически, разъём DisplayPort поддерживает до четырёх линий передачи данных, по каждой из которых можно передавать 1,3, 2,2 или 4,3 гигабит/с, всего до 17,28 гигабит/с. Поддерживаются режимы с глубиной цвета от 6 до 16 бит на цветовой канал. Дополнительный двунаправленный канал, предназначенный для передачи команд и управляющей информации, работает на скорости 1 мегабит/с или 720 мегабит/с и используется для обслуживания работы основного канала, а также передачи сигналов VESA EDID и VESA MCCS. Также, в отличие от DVI, тактовый сигнал передаётся по сигнальным линиям, а не отдельно, и декодируется приёмником.

Обновленная версия стандарта — 1.1, появилась через год после 1.0. Её нововведениями стала поддержка защиты от копирования HDCP, важная при просмотре защищенного контента с дисков Blu-ray и HD DVD, и поддержка волоконно-оптических кабелей в дополнение к обычным медным. Последнее позволяет передавать сигнал на ещё бо́льшие расстояния без потерь в качестве.

В DisplayPort 1.2, утверждённом в 2009 году, была вдвое увеличена пропускная способность интерфейса, до 17,28 гигабит/с, что позволило поддержать более высокие разрешения, частоту обновления экрана и глубину цвета. Также именно в 1.2 появилась поддержка передачи нескольких потоков по одному соединению для подключения нескольких мониторов, поддержка форматов стереоотображения и цветовых пространств xvYCC, scRGB и Adobe RGB. Появился и уменьшенный разъём Mini-DisplayPort для портативных устройств.

Полноразмерный внешний разъём DisplayPort имеет 20 контактов, его физический размер можно сравнить со всем известными разъёмами USB. Новый тип разъёма уже можно увидеть на многих современных видеокартах и мониторах, внешне он похож и на HDMI, и на USB, но также может быть оснащён защёлками на разъёмах, аналогичным тем, что предусмотрены в Serial ATA.

Перед тем как AMD купила компанию ATI, последняя сообщила о поставках видеокарт с разъёмами DisplayPort — уже в начале 2007 года, но слияние компаний отодвинуло это появление на какое-то время. В дальнейшем AMD объявила DisplayPort стандартным разъёмом в рамках платформы Fusion, подразумевающей унифицированную архитектуру центрального и графического процессоров в одном чипе, а также будущих мобильных платформ. NVIDIA не отстаёт от соперника, выпуская широкий ассортимент видеокарт с поддержкой DisplayPort.

Из производителей мониторов, объявивших о поддержке и анонсировавших DisplayPort-продукты, первыми стали Samsung и Dell. Естественно, такую поддержку получили сначала новые мониторы с большим размером диагонали экрана и высоким разрешением. Существуют переходники DisplayPort-to-HDMI и DisplayPort-to-DVI, а также DisplayPort-to-VGA, преобразующий цифровой сигнал в аналоговый. То есть даже в случае присутствия на видеокарте исключительно разъёмов DisplayPort, их можно будет подключить к любому типу монитора.

Кроме вышеперечисленных разъёмов, на старых видеокартах также иногда встречаются композитный разъём и S-Video (S-VHS) с четырьмя или семью штырьками. Чаще всего они используются для вывода сигнала на устаревшие аналоговые телевизионные приемники, и даже на S-Video композитный сигнал зачастую получают смешиванием, что негативно влияет на качество картинки. S-Video лучше по качеству, чем композитный «тюльпан», но оба они уступают компонентному выходу YPbPr. Такой разъём есть на некоторых мониторах и телевизорах высокого разрешения, сигнал по нему передается в аналоговой форме и по качеству сравним с интерфейсом D-Sub. Впрочем, в случае современных видеокарт и мониторов обращать внимание на все аналоговые разъёмы просто не имеет никакого смысла.

В этом обзоре представлен общий рейтинг видеокарт по производительности, в том числе с учетом их цен на начало мая 2022 года. Когда-то, более полутора лет назад, в таких наших обзорах было несколько ценовых диапазонов, и в каждом мы выбирали для вас максимально полезную модель по отдаче за свои деньги. Сейчас цены в целом гораздо выше, и нас это совершенно не радует, но время идет, люди собирают новые компьютеры или меняют видеокарты в старых, и невозможно просто навсегда отказаться от такого важного и полезного компонента ПК. Кому-то видеокарта нужна для рабочего применения (многие профессиональные пакеты, например, видеообработки или 3D-рендеринга сильно ускоряются при запуске на GPU), кто-то хочет играть в последние игрушки (их выпуск не прекратился с дефицитом видеокарт и повышением цен), кто-то планирует подмайнивать в свободное от других нагрузок время… Но так или иначе, видеокарты все равно продолжают покупать, пусть и в меньших количествах. И при таких ценах становится очень и очень важно сразу сделать правильный выбор.

Наш подход не меняется, мы помогаем сделать выбор только по одному из критериев — по игровой производительности под Windows (теперь — под Windows 11) в целом и отдельно по ценовым сегментам. Чтобы результаты были прозрачными по всему списку ускорителей, тестирование проводим в одинаковых условиях настроек на максимально возможном качестве 3D-графики в 10 играх (с классической растеризацией) и 3 разрешениях. Учитывая, что находящиеся в нашем списке карты поддерживают трассировку лучей, а также технологии масштабирования изображения Nvidia DLSS и AMD FSR, дополнительно были проведены тесты в соответствующих играх с включением указанных технологий.

Итак, какие же видеокарты стали лучшими на конец апреля 2022 года по результатам последних тестов с учетом розничных цен?

Покупать видеокарту AMD или Nvidia?

AMD и Nvidia обладают отличными вариантами по ценам между $100 и $400. Nvidia может предложить больше видеокарт в разных ценовых категориях. Впрочем, если выбирать модель последнего поколения, сложно найти плохую видеокарту в этой ценовой категории под разрешение 1080p.

Что касается соответствующего программного обеспечения, небольшое преимущество также у Nvidia, но в целом наблюдается равенство. Программа Nvidia GeForce Experience лёгкая и функциональная, позволяет записывать видео игрового процесса при помощи функции Shadowplay, обновляет за вас драйверы. Приложение Nvidia также помогает совместно играть в игры. Программа AMD Radeon Software имеет сходные возможности, драйверы стали заметно лучше по сравнению с прежними Catalyst. В этом плане пропасти между Nvidia и AMD больше нет.

Сколько нужно видеопамяти?

Количество доступной видеопамяти на карте напрямую влияет на разрешение, на которой игра идёт плавно, а также на доступные настройки детализации. Совокупная расчётная мощность графического процессора на карте определяет, насколько хорошо она запускает конкретную игру на разных настройках. О видеопамяти можно думать как о шоссе, которое открывает полосы для работы графического процессора, чтобы не возникало заторов.

Без достаточного объёма видеопамяти графический процессор ограничен, он не способен полностью раскрыть свой потенциал. Причина в том, что видеокарта обрабатывает все показываемые на экране пиксели, когда они находятся в памяти.

Чем больше нужно данных, либо для определённого разрешения, либо для повышения детализации игры, тем больше памяти требуется для эффективной работы карты. Поэтому дорогостоящие видеокарты имеют больше памяти. Её нужно больше, чтобы обрабатывать все пиксели, которые отображаются в игре на высоких разрешениях и при высоких настройках графики.

Для игр на 1080p адекватным минимумом является значение памяти 2 Гб, но 4 Гб намного лучше. Некоторые карты для этого разрешения обладают объёмом памяти 3/6 Гб и 4/8 Гб.

6 и 8 Гб являются отличным значением, но не стоит ждать чудес, поскольку выше объёма 3 или 4 Гб увеличение памяти на этом разрешении мало что меняет. Дополнительный объём памяти может применяться только в некоторых играх и при некоторых обстоятельствах.

Не стоит тратить лишние деньги на память или более мощный графический процессор, возможности которого вы не раскроете целиком. Для 1080p хватит 3 Гб или 4 Гб, если вы в ближайшем будущем собрались поменять монитор на 1440p или 4K. В таком случае нужна карта с более мощным графическим процессором.

Ценовой диапазон: от 70 до 110 тысяч рублей

Лучшее семейство 3D-ускорителей: Radeon RX 6700 XT

Лучшая видеокарта: Sapphire Nitro+ Radeon RX 6700 XT (12 ГБ)

На момент подготовки обзора видеокарта Sapphire Nitro+ Radeon RX 6700 XT (12 ГБ) стоила в районе 100 тысяч. Стильный дизайн, трехслотовое охлаждение и большой объем памяти — основные козыри, выделяющие эту модель среди конкурентов на Radeon RX 6700 XT. Собственно, карточке был посвящен полноценный обзор, так что сейчас мы лишь кратко напомним основное.

Ускоритель позволяет комфортно играть в современные игры в разрешении 2.5К при максимальных настройках графики (но без трассировки лучей!). Карта Sapphire чуть-чуть быстрее референс-аналога, а в играх без трассировки лучей Radeon RX 6700 XT почти догоняет GeForce RTX 3070. При включении RT производительность Radeon RX 6700 XT сильно падает, но если игра поддерживает еще и технологию AMD FSR, ее применение может отчасти компенсировать падение скорости от включения RT.

Видеокарта имеет стандартный набор видеовыходов: 3 DP 1.4a и 1 HDMI 2.1. У нее одна из самых высоких частот в бусте (2622 МГц), если сравнивать с другими моделями на том же GPU. Кулер очень тихий: 23,4/20,7 дБА (в зависимости от выбранного режима). Ручной разгон дает неплохой результат: до 8% прироста производительности.

Читайте также: