Самая дорогая видеокарта titan z

NVIDIA TITAN V is the most powerful Volta-based graphics card ever created for the PC. NVIDIA’s supercomputing GPU architecture is now here for your PC, and fueling breakthroughs in every industry.

GALLERY

GROUNDBREAKING CAPABILITY

NVIDIA TITAN V has the power of 12 GB HBM2 memory and 640 Tensor Cores, delivering 110 teraflops of performance. Plus, it features Volta-optimized NVIDIA CUDA for maximum results.

| NVIDIA TITAN V | |

| Architecture | NVIDIA Volta |

| Frame Buffer | 12 GB HBM2 |

| Boost Clock | 1455 MHz |

| Tensor Cores | 640 |

| CUDA Cores | 5120 |

NVIDIA TITAN users now have free access to GPU-optimized deep learning software on NVIDIA GPU Cloud.

Конструктивные особенности

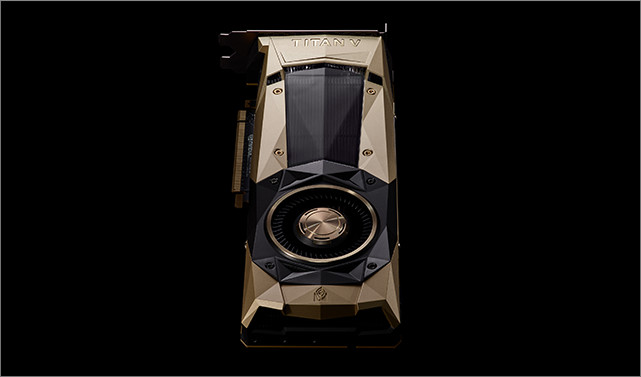

Сама по себе видеокарта Titan Z сконструирована и выглядит просто шикарно — мы уже сталкивались с подобным «индустриальным» дизайном в случае двухчиповой Geforce GTX 690, а также Geforce GTX 780 (Ti) и Titan. Тот же стиль выбрали и для Titan Z, эта плата использует один вентилятор по центру платы и большой радиатор, накрывающий оба видеочипа. Кулер двухчиповой платы весьма мощный и эффективный, и отлично справляется с охлаждением пары GK110. Логотип Geforce на корпусе платы имеет подсветку, да и в остальном она визуально очень похожа на предыдущие решения.

Хотя Titan Z и меньше своего конкурента (R9 295X2 длинная и имеет дополнительный радиатор для работы водяного охлаждения), но плата все равно немаленькая — по толщине она занимает три слота (некоторые считают, что 2.5, но разница невелика, ведь все равно не получится использовать третий слот), так что войдет не во все компактные корпуса. Подобные трехслотовые системы воздушного охлаждения мы видели ранее в партнерских решениях, предназначенных для любителей разгона, но в референсном дизайне такое встречается впервые. Металлическая пластина на задней части платы довольно толстая и служит и как радиатор и защитная деталь для компонентов на плате.

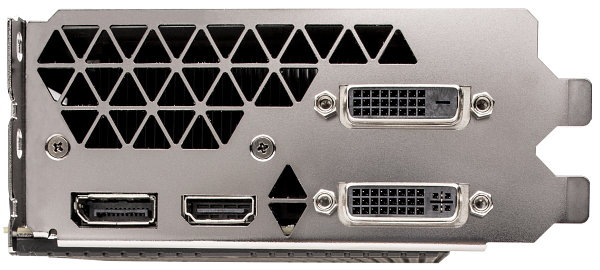

Geforce GTX Titan Z поддерживает вывод изображения на четыре дисплея. По разъемам вывода изображения плата идентична другим референсным платам Nvidia и включает пару разъемов Dual-Link DVI и по одному полноразмерному HDMI и DisplayPort. На планке есть еще и вентиляционные отверстия — для того, чтобы выводить как можно больше горячего воздуха из корпуса. Также на печатной плате Geforce GTX Titan Z есть и единственный разъем SLI — если вдруг кто захочет потратить еще сто тысяч подключить две такие видеокарты для работы в четырехчиповом режиме.

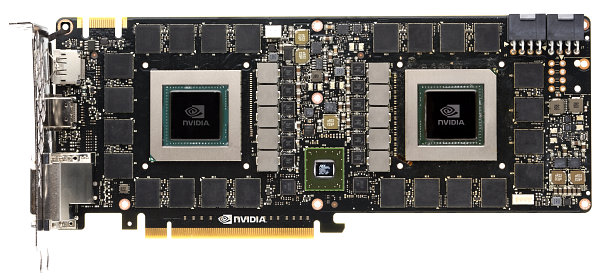

«Раздетая» плата Titan Z показывает всю сложность разводки подобных решений, а также множество элементов на ней: пару крупных чипов GK110, мост PCI-E посередине, микросхемы GDDR5-памяти объемом 12 ГБ и сложнейшую подсистему питания для работы всех этих чипов. Видеокарта Geforce GTX Titan Z использует 12-фазную систему питания (разделенную пополам — по шесть фаз на каждый чип), элементы которой расположены в том числе по центре карты между двумя GPU.

Два в одном.

Идея видеокарты с двумя и более чипами была еще разработана, ныне покойной, компанией 3dfx. Идея заключалась в совместной работе двух графических ускорителей на одной плате, что делало двухчиповую видеокарту "компактнее", чем две видеокарты вместе, а по производительности не уступали.

Хотя главной причиной такой разработки, являлась попытка производителя конкурировать с успешными на то время видеокартами от Nvidia - GeForce 256 и GeForce 2 .

Позже идею подхватили сами Nvidia и ATI в своих будущих разработках.

На пути к "совершенству".

Долгое время Nvidia экспериментировали над разработкой "идеальной" двухчиповой видеокарты. Первая двухчиповая карта от Nvidia ( 7950 GX2 ) имела довольно нестандартную компоновку. Если ATI использовали два чипа на одной плате, то "зеленые" не поскупились и использовали две платы, соединенными SLI-мостиком. В народе такая компоновка получила название "бутерброд" .

Далее производитель пошел еще дальше и разработал следующую модификацию - 9800 GX2 . Охлаждение продумано так, что две платы стоят чипами друг к другу и соприкасаются к единому радиатору.

Подобная компоновка наблюдалась и в следующей серии - GeForce GTX 295. Но тут проблемы с эффективностью охлаждения показали себя во всей красе, а цена за производство "бутерброда" была довольно высокой. Поэтому производитель в итоге от подобной идеи отказался и решил начать работать с одноплатной версией карты. Вскоре была выпущена полностью переработанная модификация - GTX 295 rev. B .

Комментарий к Рейтингам полезности

Вывод о том, что Titan Z трудно рекомендовать к покупке при его чрезвычайно завышенной цене, напрашивался заранее, и тестирование с подведением итогов в виде наших рейтингов это лишь доказало. Уходящий с рынка GTX 690 получил первое место в рейтинге полезности лишь потому, что его остатки распродаются по минимально возможной цене. А вот то, что выгоднее купить два GTX 780 Ti вместо одного Titan Z — очень показательно. И совершенно неважно, что GTX 780 Ti имеет лишь 3 гигабайта памяти: на сегодня такого объема достаточно для всех игр. Кому не хочется загромождать системный блок двумя мощными картами, тот может купить R9 295X2 с его тихой жидкостной системой охлаждения. И опять же, это будет намного более выгодно, чем Titan Z. И даже если найдется фанат, желающий купить и установить у себя в компьютере два Radeon R9 295X2 (там придется серьезно покумекать над размещением внешних радиаторов СВО), то и это будет выгоднее, чем покупать Titan Z.

Кроме того, не стоит забывать про старую «ахиллесову пяту» всех мультипроцессорных ускорителей: крайне высокую зависимость от качества драйверов и поддержки последними всех современных игр. Теоретически вполне возможны не только провалы производительности, но и различные артефакты картинки, и здесь уж остается только надеяться, что программисты AMD/Nvidia вовремя и качественно делают свою работу.

Все вышесказанное относилось к игровому сегменту, где флагман AMD однозначно смотрится лучше. Но не стоит забывать, что GTX Titan Z — это не только игровое решение, но и высокопроизводительный вычислитель для CUDA и прочих GPGPU-задач, и в таком виде новинка может быть очень интересна разработчикам, обеспечивая скорость в 2,7 терафлопс для операций с двойной точностью при всего лишь одной PCB. В этой сфере ценообразование совершенно отдельное от игрового сегмента, поэтому Titan Z может оказаться востребованным.

Oкончательное решение традиционно остается за нашими читателями (смотрите на цены ниже!).

Сведения о разработчике: Компания Nvidia Corporation (торговая марка Nvidia) основана в 1993 году в США. Штаб-квартира в Санта-Кларе (Калифорния). Разрабатывает графические процессоры, технологии. До 1999 года основной маркой была Riva (Riva 128/TNT/TNT2), с 1999 года и по настоящее время — Geforce. В 2000 году были приобретены активы 3dfx Interactive, после чего торговые марки 3dfx/Voodoo перешли к Nvidia. Своего производства нет. Общая численность сотрудников (включая региональные офисы) около 5000 человек.

100% VISIBILITY ACROSS YOUR VIRTUAL WORKSPACE LIFECYCLE

NVIDIA Virtual GPU Solutions IT Management & Monitoring capabilities for every IT user, in all phases of your GPU enabled VDI deployment.

STUNNING DESIGN, UNEQUALLED PERFORMANCE

NVIDIA VOLTA GPU Architecture

21 billion transistors, deep learning Tensor Core architecture, and 110 teraflops of horsepower

POWER SUPPLY

16-phase DrMOS power supply with integrated real time current and thermal monitoring capability

Теоретические выводы

Итак, может ли быть разумной тратой рекомендованная цена в $3000 (более 100 тысяч рублей) за Geforce GTX Titan Z? Ведь на рынке есть не только AMD Radeon R9 295X2 за половину этих денег, но и Geforce GTX Titan Black, пару которых можно купить дешевле (порядка $2000 за две платы), чем один Titan Z. С трехслотовым дизайном корпуса и кулера, у Titan Z остается не так уж много преимущества перед парой Titan Black (или GTX 780 Ti, например) даже по занимаемому в системе месту. Хотя, все же небольшое преимущество есть, а ведь нужно еще учесть и уровень энергопотребления.

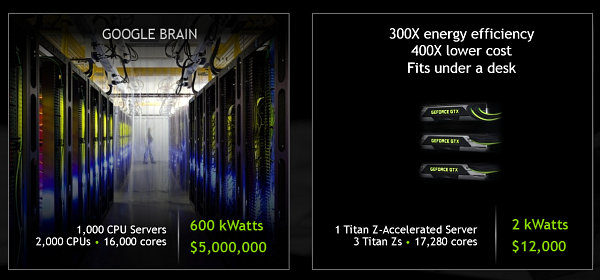

Интересно, что Nvidia усиленно продвигает GTX Titan Z не только как игровое решение для энтузиастов, но и как высокопроизводительный вычислитель для CUDA и прочих GPGPU-задач, и в таком виде от новинки можно вполне ожидать многого, ведь это самая производительная плата компании. Во многих случаях GTX Titan Z будет иметь смысл для занимающихся высокопроизводительными вычислениями на GPU, так как эта модель обеспечивает скорость в 2.7 терафлопс для операций с двойной точностью на всего лишь одной плате расширения, и для тех, кто давно использует CUDA, эта модель имеет хорошее соотношение цены, производительности, потребления энергии и физического размера. Особенно по сравнению с традиционными CPU-системами:

А вот игровое использование GTX Titan Z видится не столь радужным. Конечно, эта модель остается лучшей среди решений Nvidia, но тут и соперничество со стороны AMD Radeon R9 295X2 очень сильное, даже исходя исключительно из вдвое меньшей цены, да и пара GTX Titan Black может быть предпочтительнее. Ведь тут нужно учесть и меньшую тактовую частоты для GPU, по сравнению с одночиповым вариантом, и большую цену двухчиповой Titan Z по сравнению с парой Titan Black. Так что вполне возможно, что лучшим вариантом даже для поклонников Nvidia будет приобретение пары одночиповых решений, а не ультрамощного GTX Titan Z.

На этом краткая теоретическая часть сегодняшнего материала закончена, а в следующей части статьи мы практически исследуем скорость рендеринга новой видеокарты Nvidia Geforce GTX Titan Z в синтетических тестах и сравним ее с производительностью конкурентов, особенно в лице AMD Radeon R9 295X2. Хотя предельные синтетические тесты на многочиповых видеосистемах не имеют особенного смысла, так как ими измеряется скорее эффективность работы технологий многочипового рендеринга CrossFire и SLI, но цифры все же будут любопытны, так как рассматриваемая видеокарта является одной из наиболее производительных решений вообще.

В отличие от номерных карт серии GeForce, к которой тяготеет большинство геймеров, серия Titan нацелена на пользователей, которые нуждаются в вычислениях при помощи ГПУ, то есть использования ГПУ для расчетов, а не игр. Как многие могут знать, графические ускорители отличаются от центральных процессоров на фундаментальном уровне. ГПУ спроектированы для наилучшей работы с параллельными задачами, которые могут быть легко разделены и обработаны разными частями процессора одновременно.

Хорошими примерами таких нагрузок являются машинное обучение, задачи искусственного интеллекта, редактирование видео, профессиональный рендеринг, крупномасштабный анализ данных и научные исследования. На самом деле, если вы взгляните на страницу продукта, новейших Titan RTX, то даже не найдете упоминания о игровой производительности карты.

Вместе с тем, карты Titan по-прежнему являются отличными игровыми решениями, и когда в 2013 году появилась оригинальная Titan GTX, обзорщики на перебой рассуждали о том, что это самое производительное решение, с одним ГП для геймеров. Titan зачастую опережал тогдашнего лидера GTX 680 примерно на 50%, в плане фреймрейта, благодаря наличию большего количества потоковых процессоров, даже несмотря на то, что тактовая частота карты была немного ниже.

В 2014 году мир увидел Titan Black и Titan Z. Хотя обе карты и были основаны на том же самом процессоре GK110, как и оригинальная Titan, у версии Black частоты были немного выше, а модель Z представляла собой невероятно дорогой ГПУ с двумя чипами ( ее цена была в районе 3000 долларов ). Хотя последняя и была чрезвычайно мощной, пара GTX780Ti, с тем же графическим процессором, могла обойтись менее чем в половину стоимости. Стоит также помнить, что тогда, две видеокарты имели гораздо большую привлекательность, чем сегодня. Пользователей вводило в заблуждение еще и то, что Nvidia по-прежнему продвигала эти карты как игровые, даже несмотря на то, что две 780 Ti, с режимом SLI обходились дешевле.

Следующей реализацией карт Titan, стала Titan X 2015 года, которая стала первой картой Titan, не основанной на архитектуре Kepler. В следующем году, за ней последовала карта с точно таким же именем, но уже на архитектуре Pascal, что внесло еще большую путаницу. Более свежую модель Nvidia продвигала в качестве решения для VR, поскольку шлемам виртуальной реальности необходимо высокое разрешение и частота кадров, чтобы избежать проблем с погружением и укачиванием.

В 2017 году на рынок вышли Titan V и Titan Xp, основанные на Volta, которые являлись более производительными версиями Pascal Titan X. Однако, в этот момент времени, Nvidia действительно ушла от своего посыла о том, что Titan представляет собой хороший выбор для богатых ПК игроков. И как мы уже упоминали ранее, RTX Titan 2018 года, практически не рекламировалась для игроков. Это действительно имеет смысл, поскольку геймеры предпочитали избегать Titan из-за ее плохого соотношения цена/качество.

Стоимость карт NVIDIA Titan

Но почему же эти карты так дороги? Одна из причин состоит в том, что карты Titan предлагают больше видеопамяти, чем более простые ГПУ. Иногда намного больше. К примеру, Titan RTXпоставляется с поразительными 24 гигабайтами памяти GDDR6, что более чем в 2 раза превышает объем памяти 1080 Ti. И в отличие от ОЗУ основной системы, вы не можете просто взять и установить дополнительную память в свою видеокарту.

Для тех, кто работает с большими объемами данных, например, в области машинного обучения или исследований, наличие достаточного объема VRAM, для хранения всех данных с которыми работает ГПУ, может иметь большое значение. Вместе с тем, системы с SLI на протяжении многих лет страдают от различных проблем, и пользователи, которые могут себе позволить два высокопроизводительных ГПУ, скорее будут заинтересованы в одном, даже более дорогом ГПУ решении, для того чтобы получить максимальную производительность и избежать проблем с драйверами или поддержкой технологии различными приложениями.

И конечно, из-за того, что карты Titan позиционируются на рынке, как вычислительные карты, многие покупатели Titan - это компании и организации, которые не будут возражать против высокой цены. Например, какой-нибудь исследовательский институт, вероятно не будет задумываться о том, стоит ли потратить дополнительную тысячу долларов на видеокарту, как это бы сделал рядовой, домашний пользователь.

Дисклеймер: данный автор не считает себя убежденным профессионалом и является профаном во многих темах. Не стоит слепо прислушиваться к мнению автора! Все, что будет здесь рассказано, основано на отобранной информации и личном опыте.

Категорически приветствую!

Еще с начала нулевых ATI(потом AMD) и Nvidia частенько мерились размерами своих детищ и не стеснялись этого. Думается, что если бы они могли себе позволить выпускать видеокарты куда большего размера, то сейчас наши компьютеры были бы размером со шкаф. Здравый смысл все-таки оказался сильнее.

Но прошло уже достаточно много времени, и ни Nvidia ни AMD не представили новых двухчиповых модификаций для пользовательского рынка, ограничившись лишь одночиповыми видеокартами. Это и стало предзнаменованием конца эпохи двуглавых чудовищ.

Знакомьтесь, GTX Titan Z.

Часть 1: Теория и архитектура

В самом конце лета, в преддверии выпуска новых GPU, хотя и на основе уже известных архитектур, мы рассматриваем решение компании Nvidia, созданное для узкой прослойки ультра-энтузиастов — двухпроцессорную модель Geforce GTX Titan Z, наиболее производительное графическое решение компании. Эта модель была анонсирована еще в марте, на конференции GPU Technology Conference 2014, посвященной высокопроизводительным вычислениям. Тогда стало известно, что двухчиповая плата на основе пары процессоров GK110 будет иметь 5760 вычислительных ядер производительностью в 8 терафлоп и 12 ГБ памяти, и она должна была начать продаваться в апреле по цене аж 3000 долларов.

Надо сразу отметить, что мощнейшие видеокарты на базе двух графических процессоров — это «вещь в себе» сразу по нескольким причинам. Мы уже неоднократно писали и об их излишней сложности и дороговизне, а также обо всех проблемах рендеринга, использующего возможности двух GPU. Как правило, в последнее время в таких конфигурациях используется исключительно единственный метод — AFR-рендеринг, когда каждый из видеочипов работает над своим кадром. И в таком случае никуда не деться от некоторых сопутствующих сложностей и проблем. Так, для обеспечения совместимости двухчиповых конфигураций необходима дополнительная доработка драйверов, а иногда не обойтись без изменения кода игры. Если же таких оптимизаций нет, то двухчиповая видеокарта зачастую работает как одночиповая, и никаких преимуществ от второго GPU просто нет. Ну или AFR работает, но крайне неэффективно, не обеспечивая значительного роста FPS.

Но даже если все прекрасно оптимизировано со стороны драйвера, AFR-рендеринг не всегда обеспечивает максимальную плавность смены кадров по понятным причинам — двухчиповая конфигурация всегда будет работать менее плавно, чем одночиповая. Ведь драйверу надо обеспечивать совместную работу двух GPU, раздавая им работу над кадрами, в каждом из которых могут требоваться какие-то данные из предыдущего, и тогда возможны дополнительные сложности. Кроме этого, на двухчиповой видеокарте при вдвое выросшей частоте смены кадров, задержка между действием игрока и его отображением на экране не снижается ровно вдвое, как можно было бы подумать.

В общем, сплошные ложки дегтя. А где же бочка меда? Зачем вообще тогда платить бешеные деньги за такое безобразие? Все очень просто — при использовании пары топовых GPU в двухчиповой конфигурации можно получить почти вдвое большую частоту кадров, и это — единственная возможность получения большей производительности, когда более мощных GPU просто не существует. Зачем нужна сверхвысокая частота кадров при не всегда комфортной плавности — вопрос отдельный. Кому-то — для установки рекордов в бенчмарках, кому-то — еще и для экстремального разгона, кто-то просто использует монитор с разрешением 3840×2160, да и не один, а кто-то сочетает вместе все вышеперечисленное.

Главное, что возможность получить экстремально высокую частоту кадров есть, как существуют и желающие заплатить за такую возможность очень много денег. Или, как в случае с Geforce GTX Titan Z — неприлично много. Да, таких желающих чуть ли не по пальцам пересчитать можно, но они есть, и они очень «громкие» — в том смысле, что такие ультра-энтузиасты и в Интернете много пишут о новинках, и своим друзьям рассказывают. То есть, для производителя такие решения нужны скорее не для получения прямой прибыли (на продаже нескольких сотен или тысяч экземпляров много денег не заработать, с точки зрения финансов гораздо важнее массовые продукты), а работа на имидж среди энтузиастов. И вот тут главное сделать все правильно, не допустив ошибок. Получилось ли из Geforce Titan Z ультрапроизводительное решение, стоящее своих денег, и насколько успешно новинка конкурирует с AMD Radeon R9 295X2 — мы и попытаемся разобраться в нашем материале.

Хотя на момент анонса Nvidia указала время выхода Geforce GTX Titan Z как апрель, эта видеокарта задержалась с выходом на рынок до конца мая. Причиной этой задержки был явно неожиданный выпуск конкурентом двухчиповой видеокарты AMD Radeon R9 295X2, основанной на базе пары топовых графических процессоров Hawaii, но предложенной рынку по цене вдвое меньшей — всего лишь $1499! Причем, так как чипы Hawaii очень горячие и в равной по теплопотреблению борьбе они не смогли бы конкурировать с парой GK110, компания AMD решила сделать хитрый шаг, подняв уровень энергопотребления платой до 500 Вт и обеспечив свое двухчиповое решение водяным охлаждением. Поэтому Radeon R9 295X2 получился очень производительным, но при этом и недорогим, а у Nvidia просто не было шансов на быстрое изменение планов.

Несмотря на вдруг возникшие трудности в конкурентной борьбе, Nvidia все же не стала ничего менять и выпустила Titan Z, и даже по обозначенной ранее цене. Это решение предназначено не только для энтузиастов ПК-игр, но и для CUDA-разработчиков, и у них есть совершенно четкая необходимость в получении максимальной производительности при минимальном уровне потребления энергии и занимаемом физическом пространстве, и по этим параметрам Titan Z очень хорош. И даже с учетом того, что для игроков соотношение производительности и цены явно будет уступать конкуренту, Titan Z в любом случае можно считать отличным топовым решением, так как в этой нише по цене выбирают далеко не всегда.

С момента формального анонса на GTC 2014 публике оставались неизвестны лишь цифры рабочей тактовой частоты GPU и памяти, а также уровень потребления энергии новым двухчиповым решением. И в мае Nvidia раскрыла и эти данные: базовая частота GPU равна 705 МГц, а турбо-частота может доходить до 876 МГц. Столь большой разрыв между этими частотами (171 МГц!) говорит о том, что производительность карты ограничена не возможностями чипов по работе на высокой частоте, а насильном ограничении показателя энергопотребления (TDP). Так что скорость GTX Titan Z в реальности будет зависеть от общего потребления энергии видеокартой, и в тяжелых ситуациях частота будет скатываться к базовому значению, хотя во многих играх частота GPU будет близка скорее к турбо-частоте.

- [23.05.13] Nvidia Geforce GTX 780 — урезанная версия GTX Titan, ускоритель премиум-класса

- [18.03.13] Nvidia Geforce Titan — новый однопроцессорный флагман 3D-графики игрового класса

- [22.03.12] Nvidia Geforce GTX 680 — новый однопроцессорный лидер 3D-графики

- [27.03.10] Nvidia Geforce GTX 480: архитектура нового графического процессора изнутри; как реализована поддержка DirectX 11

Далее рассмотрим подробные характеристики анонсированной в мае видеоплаты Geforce GTX Titan Z, основанной на паре графических процессоров GK110.

| Графический ускоритель Geforce GTX Titan Z | |

|---|---|

| Параметр | Значение |

| Кодовое имя чипов | «GK110» |

| Технология производства | 28 нм |

| Количество транзисторов | 2×7,1 млрд. |

| Архитектура | Унифицированная, с массивом общих процессоров для потоковой обработки многочисленных видов данных: вершин, пикселей и др. |

| Аппаратная поддержка DirectX | DirectX 11, в том числе шейдерной модели Shader Model 5.0 |

| Шина памяти | две 384-битные по шесть независимых контроллеров памяти шириной по 64 бита с поддержкой GDDR5-памяти |

| Частота графического процессора | 705(876) МГц |

| Вычислительные блоки | 30 потоковых мультипроцессоров, включающих 5760 скалярных ALU для расчетов с плавающей запятой одинарной точности (FP32) и 1920 скалярных ALU для расчетов двойной точности (FP64) в рамках стандарта IEEE 754-2008; |

| Блоки текстурирования | 480 блоков текстурной адресации и фильтрации с поддержкой FP16- и FP32-компонент в текстурах и поддержкой трилинейной и анизотропной фильтрации для всех текстурных форматов |

| Блоки растеризации (ROP) | 12 широких блоков ROP (96 пикселей) с поддержкой режимов сглаживания до 32 выборок на пиксель, в том числе при FP16- или FP32-формате буфера кадра. Каждый блок состоит из массива конфигурируемых ALU и отвечает за генерацию и сравнение Z, MSAA, блендинг |

| Поддержка мониторов | Интегрированная поддержка четырех мониторов, подключенных по интерфейсам DVI (Dual Link), HDMI 1.4a и DisplayPort 1.2 |

Новая модель Geforce GTX Titan Z получила не совсем привычное имя для двухчиповой карты Nvidia. Впрочем, новинка даже еще более эксклюзивная, по сравнению с GTX Titan (Black), поэтому нет ничего удивительного в том, что она вошла в эту специальную серию, отличающую подобные решения от чисто игровых видеокарт линейки Geforce GTX. Соответственно, в продуктовой линейке компании GTX Titan Z располагается на самом верху, сразу над GTX Titan Black.

Увы, но рекомендованная цена на Titan Z не изменилась с момента анонса, и за нее просят аж $2999 на североамериканском рынке и более 110 тысяч рублей на российском! Это — самая дорогая видеокарта Nvidia из линейки Geforce (естественно, Tesla мы не рассматриваем), которую выпустили на рынок под своей маркой такие избранные партнеры Nvidia, как Asus, Gigabyte, MSI, Zotac, Palit и EVGA (к слову, все Titan Z идентичны и кулером и прочими характеристиками, поскольку партнеры продают референсные карты Nvidia).

Поэтому, что касается решений конкурента — компании AMD — то новая Geforce GTX Titan Z по рекомендованной цене не имеет прямых соперников из линейки Radeon, так как стоит вдвое больше самой дорогой Radeon R9 295X2. Впрочем, с некоторым допущением можно принять за ценового конкурента для новинки Nvidia сразу две видеокарты AMD, но в таком случае шансов на победу у GTX Titan Z вовсе не останется.

Как и быстрейшая видеокарта на базе одного GPU у Nvidia, Titan Z сделана на базе пары чипов GK110 и имеет сдвоенную 384-битную шину памяти. Да и объем установленной на нее видеопамяти оставили тем же (удвоенный), хотя теоретически он мог быть равным 3 или 6 ГБ на чип. Но в случае столь дорогой модели установка 6 ГБ памяти на каждый GPU абсолютно оправдана, особенно с учетом ее суперкомпьютерных претензий, ведь для сложных вычислений объем в 12 ГБ вполне может быть актуальным. Да и в условиях требовательных 3D-приложений, максимальных настроек качества и сверхвысоких разрешений, видеопамяти у GTX Titan Z точно хватит.

POWERED BY NVIDIA VOLTA

Volta GPU architecture pairs NVIDIA ® CUDA ® and Tensor Cores to deliver new levels of performance in a desktop PC GPU.

Архитектура

Так как рассматриваемая сегодня видеокарта Geforce GTX Titan Z основана на двух GPU архитектуры Nvidia Kepler, давно известных нам под кодовым именем GK110, то расписывать в этом разделе особо нечего — все уже было подробно рассказано нами ранее, а в этом материале мы лишь повторим базовую информацию и расскажем об отличительных особенностях двухчипового решения.

Основы архитектуры Kepler были заложены в вышедших уже несколько лет назад чипах семейства Fermi (Geforce GTX 480 и GTX 580), а затем и GK104 (Geforce GTX 680). Текущий топовый чип GK110 поддерживает все возможности, появившиеся в них, и все особенности архитектуры Kepler относятся к нему в полной мере, включая организацию мультипроцессоров SMX, хотя есть там и некоторые отличия.

Графический процессор GK110 имеет в своем составе пять кластеров графической обработки Graphics Processing Cluster (GPC), состоящих из трех мультипроцессоров SMX каждый (схема 5×3, в отличие от 4×2 у GK104). Применяющиеся в Geforce GTX Titan Z графические процессоры GK110 используют одинаковую конфигурацию мультипроцессоров, и эти чипы архитектурно не отличаются от того варианта GK110, который мы рассматривали в обзоре одночипового аналога:

На диаграмме мы видим типичные для чипов архитектуры Kepler мультипроцессоры SMX, все как и в GK104, каждый SMX имеет по движку PolyMorph Engine, 64 КБ общей памяти, 48 КБ текстурной кэш-памяти и по 16 блоков текстурной фильтрации (всего 240 TMU в каждом чипе). Подсистема памяти пары GK110, лежащих в основе Geforce GTX Titan Z, содержит по шесть 64-битных каналов памяти, что в сумме дает дважды по 384-бит доступа к ней. Так как блоки растровых операций ROP «привязаны» к контроллерам памяти, то их количество равно 96 блокам, а объем кэш-памяти второго уровня на каждый чип составляет по 1.5 МБ.

Как и многие предыдущие модели, Geforce GTX Titan Z поддерживает фирменную технологию GPU Boost второй версии. Мы уже неоднократно писали о ней, это комбинация программно-аппаратных решений, позволяющая автоматически увеличивать рабочие частоты GPU в зависимости от его энергопотребления для достижения максимальной производительности. Базовая тактовая частота графического процессоров GK110 в Geforce GTX Titan Z равна всего лишь 705 МГц, а средняя турбо-частота (Boost Clock) равна 876 МГц, что значительно больше. Это средняя частота для набора игр, а реальные частоты в отдельных приложениях могут быть и выше. Частота GDDR5-памяти в Geforce GTX Titan составляет 7000 МГц, а результирующая пропускная способность с учетом двух GPU равна аж 672 ГБ/с, чего должно быть более чем достаточно даже для такого мощного двухчипового решения.

Естественно, что Geforce GTX Titan Z поддерживает все известные технологии компании Nvidia, о которых мы писали много раз, в том числе DirectX 11, PhysX, TXAA, адаптивный VSync и другие. Обо всех них можно прочитать в наших предыдущих материалах, ссылки на которые даны в начале статьи.

Выводы

Radeon R9 295X2 оказался немного быстрее, чем GTX Titan Z, при этом флагман AMD почти в 2 раза дешевле. Тандем из двух R9 295X2 (суммарно 4 GPU в режиме CrossFire X) обладает ценой, схожей с Titan Z, однако здесь производительность намного выше (особенно в высоких разрешениях и при максимальной нагрузке — в режимах, для которых, собственно, такие дорогие ускорители и нужны). Остается лишь вопрос, как уместить в корпусе два R9 295X2, каждый из которых имеет СВО, так что требуется разместить еще и два внешних радиатора с вентиляторами. Ну и блок питания для двух 295X2 потребуется о-о-очень приличный.

Последняя битва двухчиповых гигантов.

GTX Titan Z является последней двухчиповой модификацией Nvidia, выпущенная весной 2014 года, которая должна была тягаться с конкурентом в лице Radeon R9 295X2 .

Сама карта была сильно переработана по отношению к своему предшественнику GTX 690 . Можно сказать, площадь всей платы была полностью покрыта схемотехникой, также она намного сложнее. Немного переработана работа фаз питания, теперь каждый чип может выбирать количество фаз, в зависимости от условий энергопотребления (у предшественника было все фиксированно).

Силы двух конкурентов были равны. По производительности в играх и приложениях, оба графических ускорителя шли нос в нос. И у каждого были как свои преимущества, так и недостатки. "Красные" предлагали гибридное охлаждение и вдвое низкую ($1500 против $3000) стоимость, а "зеленые" предлагали солидное число вычислительных CUDA ядер (2x2880).

Тем не менее обе карты имели серьезные недостатки, которые сильно оттолкнули потенциальных покупателей:

Цена на Titan Z была неоправданно высокой и заинтересовала лишь энтузиастов. Ведь можно было купить два GTX Titan Black и получить даже большую производительность за меньшие деньги.

Radeon R9 295X2 имел серьезные проблемы с обслуживанием. И даже несмотря на более приятную цену, температурный режим и приличную производительность, можно было испытать проблемы с обслуживанием СЖО.

Увы, в этой битве оба производителя проиграли. Их судьбу сыграл сам потребитель, отдав предпочтение одночиповым решениям. Оно и логично. Стоимость стандартных графических ускорителей была намного ниже. Как и условия эксплуатации и температурный режим, они были более щадящими.

Модификации не оправдали ожиданий потребителей, а интерес к двухчиповым картам и связкам SLI/CrossFire неуклонно угасает с каждым днем. В этом виноват как и производитель, так и разработчики софта и игр, которые пренебрегают попытками наладить свои программы на работу с двумя и более графическими ускорителями.

Большое спасибо за прочтение данного материала и всегда буду рад увидеть Вас снова на моем канале!

SHOP NOW

Результаты тестов: сравнение производительности

NVIDIA TITAN V

Windows 10 64-bit, Windows 7 64-bit, Linux, FreeBSDx86, Solaris OS Certification

Все настройки в нижеперечисленном ПО выставлены на максимальное качество графики.

-

BioShock Infinite (Irrational Games/2K Games) — DirectX 11.0

Читайте также: