Переделка видеокарты pci e x16 в x1

Немного погуглив и полазив по форумам, узнал довольно интересную штуку - оказывается никто нам не мешает установить карту с интерфейсом подключения PCI x16 в разъем PCI x1 (естественно, предварительно спилив перегородку в самом слоте, чтобы видеокарта в него стала).

Собственно, у меня как раз возникла необходимость установки второй видеокарты, (модель - ASUS EAX1650PRO 256 MB) в вышеупомянутый слот (будет использоваться для подключения компьютера к телевизору через S-Video). В слоте PCI-Express уже установлена NVidia GeForce 9400 GT.

Хотелось бы спросить:

1) Хватит ли питания указанной карте со слота PCI x1?

2) Смогут-ли эти 2 видеокарты работать одновременно?

3) Чем я вообще рискую, если риск вообще есть? (пилить слот мне не жалко - материнка всё равно уже стара как мир)

Перестала работать видеокарта через riser в слоте pci 3.0 x16

Здравствуйте, и так столкнулся с такой проблемой. Купил я значит корпус thermaltake core p3, под.

Видеокарта с интерфейсом PCI-E 2.0 а материнка со слотом PCI-E x16. Видеокарта будет в нем работать?

Драсти! Не могу разобраться видеокарта с интерфейсом PCI-E 2.0 а материнка со слотом PCI-E x16.

Выбор видеокарты под PCI Express 2.0 2 PCI, 1 PCI-E x1, 1 PCI-E x16

Помогите хочу покупать в Среду Видео ATI Radeon 5850 1GB но там PCI Express 2.1 а у меня на.

Видеокарта PCI-E x16 1.0 и Матплата PCI-E x16 3.0?

Приветствую всех! У друга есть видюха GeForce 8600GT Sonic которую он может мне продать за 10$.

Для любопытных - Переделка pci-e x16 видеокарты в pci-e x1 ну и заодно еще информация по теме.

1. Должно хватить.

2. Нет.

3.

Смогут, но не так, как какой-нибудь sli. По идее можно гонять вычисления на opencl одновременно на обоих, можно прокинуть одну из них в виртуалку(если остальное железо позволяет), а можно считать на нвидии физику, пока ати будет рисовать картинку. Но задействовать их одновременно в отрисовке какой-нибудь игрушки не получится.

жесть, на что способны наши умельцы. а если вторую видеокарту поставить например с s-video out то его реально будет заюзать?

Смогут, но не так, как какой-нибудь sli. По идее можно гонять вычисления на opencl одновременно на обоих, можно прокинуть одну из них в виртуалку(если остальное железо позволяет), а можно считать на нвидии физику, пока ати будет рисовать картинку. Но задействовать их одновременно в отрисовке какой-нибудь игрушки не получится.

Только вот вы не учли, что для одновременной работы ATI и GeForce должны быть установлены и одновременно бесконфликтно функционировать в одной ОС драйвера видеокарт обоих производителей. А это проблема.

а почему это проблема? видеокарта по сути такой же девайс как и все остальные. у меня на компе прекрасно уживаются три звуковых карты. не вижу причин почему бы не работать вместо и двум видеокартам

а почему это проблема? видеокарта по сути такой же девайс как и все остальные. у меня на компе прекрасно уживаются три звуковых карты. не вижу причин почему бы не работать вместо и двум видеокартам

Опять же таки, после прогулки по ссылкам гугла я выяснил, что NVidia затаила обиду на АТI из-за того, что нередко пользователи устанавливали GeForce только ради PhysX, а основной картой выступала ATI. По этому в инсталяторе (или в самом драйвере - я так до конца и не понял) драйвера NVidia зашита проверка на наличие карт сторонних разработчиков (к коим и относится ATI). И если таковые обнаруживаются - драйвер отказывается работать. Правда я не уверен, действительно ли это на сегодняшний день так.

хм, какие они меркантильные

ну а если к примеру два жирафа?

или две ати?

хотя млин толку гадать пока сам не попробуешь.

хм, какие они меркантильные

ну а если к примеру два жирафа?

или две ати?

хотя млин толку гадать пока сам не попробуешь.

что NVidia затаила обиду на АТI из-за того, что нередко пользователи устанавливали GeForce только ради PhysX, а основной картой выступала ATI. По этому в инсталяторе (или в самом драйвере - я так до конца и не понял) драйвера NVidia зашита проверка на наличие карт сторонних разработчиков (к коим и относится ATI).

Добавлено через 3 минуты

Насколько я знаю для решения такой задачи вполне достаточно установить 2 видеокарты в систему:

в обычном режиме (не SLI). В принципе на мамке даже не обязательно должно быть 2 полноценных слота PCI-E х16, достаточно если будет 1 слот PCI-E х16 и 1 слот PCI-E х4 с открытым пазом. Т.е. для 4-х мониторной конфигурации можно использовать 2 любых видеокарты (Желательно 1-го производителя Нвидиа или АТИ). Теоретически можно использовать в качестве второй видяхи и обычную двухголовую PCI карту.

надо пробовать а меня просто 4 мониторов нет

Всем добрый день.

Немного погуглив и полазив по форумам, узнал довольно интересную штуку - оказывается никто нам не мешает установить карту с интерфейсом подключения PCI x16 в разъем PCI x1 (естественно, предварительно спилив перегородку в самом слоте, чтобы видеокарта в него стала).

Собственно, у меня как раз возникла необходимость установки второй видеокарты, (модель - ASUS EAX1650PRO 256 MB) в вышеупомянутый слот (будет использоваться для подключения компьютера к телевизору через S-Video). В слоте PCI-Express уже установлена NVidia GeForce 9400 GT.

Хотелось бы спросить:

1) Хватит ли питания указанной карте со слота PCI x1?

2) Смогут-ли эти 2 видеокарты работать одновременно?

3) Чем я вообще рискую, если риск вообще есть? (пилить слот мне не жалко - материнка всё равно уже стара как мир)

для размещения обычной видиокарты в мини PCI-e , т.е. на 4 пиновый слот

PCI-E x16 2.x видеокарта и PCI-E x16 разъем

Добрый день, давно уже хочу купить видеокарту новую, нашел подходящую, но не уверен что она.

Сгорела видеокарта в слоте PCI

Ситуация и смешная и печальная, малой когда "чинил" ПК, как то умудрился вставить карточку 1060.

Подключение видеокарты через переходник PCI-E x1 to PCI-E x16

В Мат.плате установлен PCI-E x1. Если использовать переходник с PCI-E x1 на PCI-E x16 , по типу.

Все мы слышали анектоты про мужиков, которые напильниками допиливали память чтобы в материнку влезла, не раз радовала нас эта шутка в разных вариациях… Однако, понадобилось мне тут на досуге кое-что посчитать (жесткачь полный, но об этом отдельная история) — в материнке у меня 3 штуки PCI-E x16 (и 2 x1), но нижние 2 стоят так, что туда только одну карту поставить можно (двухслотовую), как ни крути. А нужно 3 — на двух считать, а на третьей чтобы десктоп не тормозил.

Тут мой взор и упал на старичка, не раз меня выручавшего — nVidia 8400GS (как сейчас помню, хотели мне продать 8500GT, т.к. быстрее, но я был стоек :-) ), остается взять напильник, и попробовать запихнуть в x1 слот…

На хабре уже была статья (про то, как в слоте прорезается щель, и карта влазит) — но у меня чипсет с радиатором не дал бы так просто отделаться (также там не было про проблемы с определением карты биосом)… Потому я решил пойти единственно правильным путем — не курочить материнку, а срезать с карты разъем :-) Поехали!

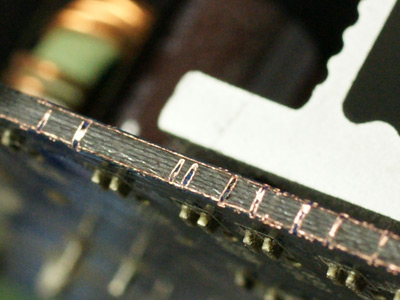

На помощь приходят алмазные диски из известного магазина — текстолит режет как масло и достаточно чисто. Не рекомендую резать «против шерсти» — лохмотья медных слоев будут висеть и могут закоротить. (Не забываем очки — если диск разорвет и в глаз — мало не покажется).

Когда резал — было такое чувство сюрреализма — все-таки оставался какой-то трепет перед сложной электроникой даже после всего того что я с ней уже делал, и тут сижу, нарезаю видеокарту кусочками, все в пыли…

На срезе видны переходные отверстия. Далее необходимо снять фаску с ребер в 45', чтобы внутренние слои не закоротить — тут удобнее будет напильничком (или соответствующей насадкой дремеля, понятия не имею как она называется), строго «по шерсти», (плата-то минимум 4 слоя). Внимательно смотрим, не висят ли где лохмотья меди…

Проверили, включаем… Биос карту не видит. Тут я было начал расстраиваться — впрочем это было бы не удивительно — это ж как лоботомия — рубанули ледорубом, и смотрим заработало или нет :-)

Оказалось, карта сообщает чипсету какая у неё шина PCI-E замыканием соответствующего проводочка — для x16, x8, x4 и x1 он свой. Карта само собой пыталась закоротить проводочек для x16, который мы срезали под корень. Ну ничего, смотрим по справочнику где там для x1, и проволочкой аккуратненько припаиваем. Провод сразу фиксируем каплей клея — чтобы случайно не отодрать вместе с дорожкой.

Соответственно, другой конец проводочка (пометил синим вывод к которому припаивать — я припаивался чуть выше от разъема по дорожке).

Готово, все работает — снижения скорости не заметно, видео, рабочий стол, даже Team Fortress работает :-) Вот кстати редкий пример единения Gigabyte и ASUS (карта изначально пассивная и постоянно угрожающе перегревалась, вентилятор из первой фотки не заработал, т.к. на разъем не было заведено питание как оказалось) :-)

Комментарии / вопросы / мнения — в студию

PS. На правах рекламы — у кого остались лишние/наигрались с Playboy/Vogue? Пишите :-)

Если в компьютере имеются 2 видеовыхода и захотелось подключить 3 монитора, то с некоторой вероятностью сделать это просто добавлением второй видеокарты не удастся — не все материнские платы имеют 2 разъёма PCI Express X16, а в многочисленные разъёмы PCI Express X1 видеокарты обычного размера не встанут из-за несовместимости по разъёму. Не все знают, что на самом деле установка длинного разъёма X16 в короткий слот возможна, поэтому не обязательно для 3-го монитора покупать другую и более дорогую материнскую плату. Способам расширения потенциальных возможностей компьютера посвящена эта статья, а также она развеивает сомнения и опасения о том, что что-то при доработке платы напильником не получится. Час работы — и 3-й монитор к Вашей системе будет подключен.

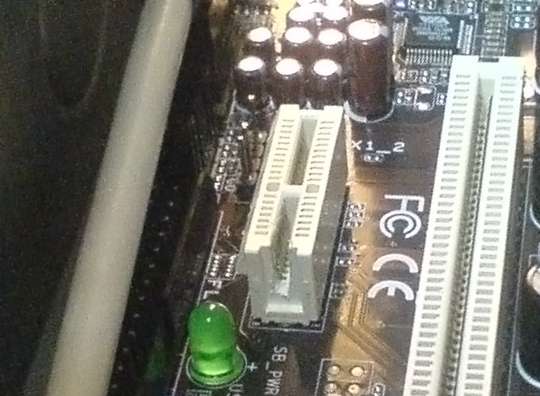

Проблема установки 2 видеокарт существует из-за того, что большинство слотов PCI-Express x1 имеют пластмассовый бортик на конце, дальнем от стенки корпуса компьютера, а видеокарты не имеют прорези для совместимости с бортиком. Как показывается ниже, проблема решается простым прорезанием этого бортика.

Для чего это может понадобиться?

1) Для установки 3-го монитора в систему.

Все способы предполагают материальные затраты и более ограниченный выбор вариантов конфигурации. Если уже имеется плата со свободным слотом PCI-Express x1 и видеокарта с разъёмом PCI-Express x16, проще поступить так, как описано ниже.

Способ 1.6) Сделать прорезь на любом разъёме PCIe X1, удобном для установки видеокарты.

(рис. 6)

2) Для подключения видеокарт в режиме Crossfire.

Строго говоря, для этого режима предусмотрены специальные материнские платы. Но, возможно, решение будет работать и с любой парой разъёмов PCIe (не проверялось).

Процесс доработки разъёма.

Перед работой убедитесь, что на материнской плате действительно будет свободное место для установки свободно висящего «хвоста» разъёма PCI-Express x16. Могут быть детали (конденсаторы, другие разъёмы), которые, в лучшем случае, удастся перепаять, разместив в другом положении.

Прорезание стенки достаточно просто, но требует соблюдения нескольких технических моментов в плане аккуратности операции.

1) материнскую плату лучше вынуть из корпуса, так как неосторожным движением можно повредить целостность разъёма или окружающих деталей;

2) прорезание выполнять так, чтобы не треснула пластмасса разъёма в основании. Поэтому, не использовать кусачки, резать острым скальпелем или лезвием для строительного ножа, соскабливая мелкими кусками или дремелем (машинкой для боров с установленной циркулярной пилой или наждачным диском), но осторожно, чтобы не повредить контакты. Нарушение целостности пластмассы тоже может привести к раздвиганию контактов, ненадёжному соединению.

3) срезая кусочки пластмассы острым ножом, следует быть очень осторожным, чтобы не срезать пружинящие контакты, которые находятся буквально в миллиметре от места операции. Если резать неострым ножом, на процедуру уходит времени 25-30 минут, а контакты, вероятнее, оказываются более защищены тем, что неострое лезвие их не перережет. На практике, у меня один контакт отогнулся вовнутрь, в пространство для текстолита карты, но затем его удалось подогнуть обратно.

4) пластмассу срезать до уровня дна разъёма; на фото показан процесс последовательного выскабливания стенки разъёма до нужной глубины:

(рис. 7)

5) перед установкой видеокарты внимательно проверить, что контакты не загнуты вовнутрь и видеокарта их не повредит.

6) при установке видеокарты — проверить, не прикоснётся ли оголённый разъём видеокарты проводящих поверхностей (радиаторы, детали). Если есть такая опасность, изолировать разъём или поверхности хотя бы скотчем или толстой бумагой, прикреплённой к карте.

(рис. 8)

7) После установки 2-й видеокарты — закрепить её за корпус, так как точка крепления за один маленький разъём PCIe довольно опасна для целостности самого разъёма.

На практике, я игнорировал рекомендацию (1), потому что места для работ внутри корпуса хватало и пользовался неострым б/у-лезвием. Стружки изнутри разъёма выдувал через трубку от шариковой ручки (использование офисных инструментов).

(рис. 9)

Столь незначительный набор инструментов (лезвие, трубка, возможно — скотч) и около часа времени на установку — небольшая плата за возможность подключения 3-го монитора. Может быть, он окажется лишним, но проверить удобство работы с ним и без него лишним не будет.

(рис. 10)

Установка 3-го монитора в системе (Windows XP)

При включении компьютера на вторую карту видеосигнал сначала не подаётся, дисплей сообщает о неподключённом кабеле. Операционная система без проблем обнаруживает видеокарту и подключает драйвер, если это карта того же производителя, что и первая, ранее установленная. WinXP просит перезапустить себя после автоустановки драйвера без каких-либо специальных действий для этого. После перезапуска система стала видеть монитор на второй видеокарте, а монитор обнаружил подключение кабеля.

(рис. 12)

(Интересно, что 2-й монитор на 1-й видеокарте пронумеровался в системе третьим.)

После активации монитора в свойствах дисплея (возможно, потребуется запуск мастера подключения мониторов, зависит от драйвера) на нём появляется фон рабочего стола.

(рис. 13)

Остаётся настроить разрешение и частоту подключения. При установке монитора ЭЛТ не забываем установить частоту развёртки не менее 70 Гц, чтобы не пользоваться 60 Гц по умолчанию. Для LCD-мониторов такое действие не нужно.

(рис. 14)

Если производители чипов (NVidia, ATI, Matrox) разные, нужно установить второй драйвер — обычно, по отзывам из других статей, они уживаются вместе (UPD: по подсказке Jeditobe и подтверждению guessss_who, Windows Vista не поддерживает одновременно драйверы разных производителей видеокарт. XP и Win7 этим не страдают.). В настройках дисплея из системы подключается нужное количество дополнительных мониторов. Результат:

(рис. 15)

В других статьях были неоднократные измерения производительности видеокарт на разъёме PCI-Express x1, в которых показано, что все видеокарты уровня ниже ATI 3850 / GF 9800 в любых режимах и играх ведут себя практически одинаково по сравнению с разъёмом PCI-Express x16 — им хватает предельного потока данных через 1 канал PCI-Express, равного 250 Мбайт/с в одну сторону (500 Мбайт/с в обе).

Если для видеокарты не стоят игровые задачи или она маломощная, то решение на PCIе x1 почти не будет уступать другим решениям с более дорогой материнской платой (кроме некоторых очень требовательных приложений наподобие Microsoft Flight Simulator, Crysis, Call Of Duty 4).

Давным-давно собирал я себе мини-компьютер. Но вот незадача – 3D моделирование и чего уж греха таить – банальные игрушки заставляли данную коробочку сильно призадуматься, а меня — понервничать. Но просто взять и подключить видеокарту к ней нельзя — слот PCI-E X4 есть, но нет места в корпусе. Да и по питанию не сможет обеспечить (если не говорить о совсем уж бюджетных затычках). Какие варианты решения данной проблемы есть на рынке, чем они меня не устроили и что в итоге получилось, я постараюсь описать в данной статье. Прошу под кат, кто не боится большого количества картинок!

Пролог

Для подключения видеокарты требовался PCI-E райзер на 4 линии с дополнительным питанием с возможностью управлять им, если блок питания отдельный. Так что сразу отпадают обычные шлейфовые и многим до боли знакомые благодаря майнингу райзера с USB кабелем в качестве интерфейсного.

Массовые продукты с массовым качеством

А вот что из более-менее удовлетворяющего мои запросы можно найти на просторах сети:

-

PE4C V4.1 — прежде всего плата, устанавливаемая в слот явно не влезала в мой ПК по габаритам. Да и сами кабели HDMI довольно жёсткие, да их тут ещё и 2! Да и цена в ~ 140$ мне показалась не совсем гуманной.

Проектирование

Пообщавшись в различных сообществах, посвященных данной теме, было решено делать райзер универсальным, а не только под себя — чтобы и к ноутбуку (через Mini Pci-E, M2 или даже MXM) и к компьютеру в слот x16 без ограничения только 4 линиями обмена данных!

Вот перечень требований, который я перед собой ставил:

- Подача питания только 12v. 3.3v получать на самом райзере с помощью dc-dc преобразователя.

- Управление питанием не зависимо от типа используемого БП (управляемый АТХ или обычный БП на 12v)

- Подключение различных переходников через отсоединяемые однотипные кабели (без пайки).

- Разбить интерфейс x16 на 4 группы. Таким образом для интерфейса x1-x4 – 1 кабель, x8 – 2 кабеля и 4 кабеля для x16.

- Наблюдаемая мной иногда ситуация, когда подключаемую к ноутбуку видеокарту через EXP GDC питали ноутбучным БП на 19v (разъём то имеется – надо воткнуть) подвигла добавить индикацию входного напряжения в допустимых пределах: 12v ±5%.

Реализация

Хотелки описаны, храбрости накопилось достаточно — пора воплощать! Райзер по своей сути – удлинитель. И кабель – это основная его часть. В качестве таковых были применены разновидности LVDS кабелей — так называемые микро коаксиальные кабельные сборки (micro coaxial cable assembly). Их нередко применяют для подключения матриц дисплеев различных устройств.

Голый кабель 18+

30 жил и всего 2мм в диаметре

Хотя в открытой продаже их найти крайне сложно, мне удалось найти производителя в Китае, готового изготовить такие кабели в любом количестве (даже и 1шт) любой длины и с подходящим разъёмом.

Когда с выбором интерфейсного кабеля было покончено, я смог наконец заняться разработкой схемы платы райзера и подбором компонентов. В конечном итоге разработанные платы были заказаны, компоненты куплены и всё собрано воедино:

Верх платы

Низ платы

- Разъём питания 8pin (15А максимальный ток), совмещенный с сигналом включения (для ATX блоков питания)

- Схема индикации питающего напряжения в допустимых пределах (+12v ±5%) на оконном компараторе. Зеленый светодиод – напряжение в норме, красный – выход за допустимые пределы

- Управление питанием – мосфет на случай применения источника питания без управления и подача сигнал PS ON. Управляющим сигналом служит подача питания 3.3v на хосте

- Понижающий DC\DC для получения 3.3v

- Разъем подключения кулера

- LVDS разъёмы для подключения интерфейсных кабелей

- Слот PCI-E x16

- Защита от КЗ и превышения напряжения – предохранитель и TVS диод.

- Подключение дополнительного питания видеокарты

Весомым минусом такого решения (как впрочем и у аналогов) — нельзя оперативно подключить/отключить райзер без необходимости разбирать ноутбук/компьютер. А сами разъёмы не предназначены для внешнего использования и имеют низкую механическую прочность и низкий ресурс. Поэтому дополнительно сделал вот такой переходник с более надёжными разъёмами (сам кабель с такими разъёмами сразу изготовить нельзя… за приемлемые деньги):

Подобные разъёмы применялись в док-станциях для смартфонов, планшетов и прочих устройств

Подключение с помощью 2х кабелей, а данные переходники их соединяют

Тестирование

Все компоненты на платы напаяны, кабеля подсоединены — самое время скрестить пальцы и протестировать!

На фото прототип и имеет отличия от конечного варианта.

Так как соединили 2мя интерфейсными кабелями — получили PCI-E x8.

При прохождении различных тестов проблем не возникло и видеокарта стабильно работала под нагрузкой, а частота шины повысилась (gen3)

Для тестирования удалось раздобыть ноутбук со слотом M2 Key M с поддержкой NVME — MSI GE62 6QD. Но для прототипа был изготовлен переходник с ключами M+B для большей универсальности, поэтому возможно задействовать только 2 линии из 4х имеющихся:

Так как это был прототип, применение изоленты и вынос dc/dc на отдельную плату вполне уместны

Запуск ноутбука с EGPU. БП запускается автоматически при включении ноутбука

Из-за наличия в ноутбуке интегрированной и дискретной видеокарты пришлось повозиться с установкой драйверов

Работа под нагрузкой

К сожалению, данные железки были в моём распоряжении крайне недолгое время и провести более подробное тестирование у меня не было возможности уже после получения финальной версии райзера. Так что довольствоваться пришлось лишь таким железом:

- МП Asus Q87T

- ЦП Core I3 4150T

- ОЗУ 2*4ГБ Crucial DDR3L SO-DIMM PC-12800

- Wi-Fi / BT модуль Intel Dual Band Wireless-AC 7260

- SSD mSATA 120Гб Crucial M500

- HDD 2.5` Seagate Momentus 500GB

- MSI RX 560 4Gb

Конечно, конфигурация далеко не производительная и получить существенное преимущество от подключения по шине x4 вместо x1 не получилось в различных тестах. Зачастую всё упиралось в слабое железо.

Разница в пределах погрешности

Игры по типу MOBA (WOT, например) показали равнодушие к шине на этой конфигурации — при наличии достаточного объёма видеопамяти нет необходимости подгружать данные в закрытых небольших локациях.

Зато в онлайн играх с открытым миром, особенно в местах массового скопления игроков разница вполне ощутима. Вот 3 замера FPS в игре Black Desert:

| Замер | min | avg | max |

| pci-e x4 gen1 ≈ pci-e x1 gen3 | |||

| 1 | 5 | 28 | 51 |

| 2 | 5 | 29 | 49 |

| 3 | 5 | 29 | 51 |

| pci-e x4 gen3 | |||

| 1 | 7 | 31 | 56 |

| 2 | 6 | 30 | 51 |

| 3 | 7 | 31 | 53 |

Планы и итоги

Проект хоть и затевался как универсальный и не только под себя, но особой популярности не сыскал. Совсем не сыскал. Тем не менее, я получил то, что хотел и бесценный опыт и знания. Как говорится отрицательный результат — тоже результат!

Так же меня часто спрашивают, почему я не пробовал реализовать поддержку модного сейчас интерфейса Thunderbolt3. Проблема в том, что данный интерфейс потребует лицензирования у Intel. И никакой документации на контроллеры просто так не дадут. Есть даже узкий круг разработчиков решений на Thunderbolt3 под патронажем той же Intel. Меня естественно туда не приняли.

Хотя и ходили слухи, что этот интерфейс будет открытым и доступным всем, но на текущий момент это всего лишь слухи и стандарт так и остался закрытым. Но я бы с удовольствием попробовал развить проект в этом направлении.

Не мало вопросов было и о варианте подключения вместо MXM видеокарт. Планы на такой вариант были, но пришлось от него отказаться по двум причинам — подошли к концу средства на R&D и мне не на чем было бы его протестировать.

Вообщем буду очень рад услышать замечания и предложения от хабаржителей. Спасибо за внимание!

Так как это вообще мой первый опыт в разработке электронного устройства, за помощью пришлось обратиться к более опытным в этом плане людям, так что хочу сказать большое спасибо NordicEnergy и Paging за советы и ответы на мои (иногда глупые) вопросы!

P.S. если оффтопик - перенесите, пожалуйста в "технологии".

Отвечу - реально. PCI-E поддерживает, нужно только убрать ограничитель справа в разъёме. Лично ставил два Radeon 1950XT (PCI-E x16) в сервер HP ML-150 в слоты PCI-E x4. PCI-E по стандарту первые 11 контактов разъёма нужны всегда (PCI-E x1), а остальные нужны для увеличения пропускной способности шины.

Помню, тоже эксперементировал, но с 4х с разъемом на ASUS A8N-E. Но ничего путного не вышло. Возможно, проблема была в биосе материнки - не рассчитан он был на видеокарту "в не том" разъеме. А может с видяхами не повезло (обе ATI, причем одна с фирменным аналогом турбо-кэша).

А у АСУСа вообще с этим проблемы - на хоботе народ жаловался, что на их платах в слотах PCIe x16 не работает вообще ничего , кроме видеокарт.

Настоящий джентльмен назовет кошку кошкой, даже наступив на нее в темноте.

Что-то ищем? Google в помощь

Помню, тоже эксперементировал, но с 4х с разъемом на ASUS A8N-E. Но ничего путного не вышло. Возможно, проблема была в биосе материнки - не рассчитан он был на видеокарту "в не том" разъеме. А может с видяхами не повезло (обе ATI, причем одна с фирменным аналогом турбо-кэша).

Хм. странно, АСУС вроде сам говорил что это типа расширеный PCI-E 4x в который можно видео вставить. Естественно слай режима не будет, но 2 видухи должны пахать.

В инете куча статей по поводу включения слай режима с разьемом PCI-E 4x (часто безрезультантые но гдето видел и удачный). На местной барахолке видел както обьяву типа A8N-E переделанная в слай.

Возможно, вина асуса не так велика как обычно. У меня в A8R-MVP (ati X1600) _все_ видюшки нормально запахали в пропиленном PCI-Ex1, в любых комбинациях - то есть возможно чипсет слегка виновен.

P.S. А вообще даже на той материнке есть глюки биоса, обусловленные Asus'ом

Читайте также: