Может ли монитор не поддерживать видеокарту

Засматриваетесь на 4K UHD-мониторы, но ваш лаптоп не поддерживает высокие разрешения? Купили монитор и миритесь с частотой обновления в 30Гц? Повремените с апгрейдом.

TL;DR: 3840×2160@43 Гц, 3200×1800@60 Гц, 2560×1440@86 Гц на Intel HD 3000 Sandy Bridge; 3840×2160@52 Гц на Intel Iris 5100 Haswell.

Разбираемся

- В большинстве случаев, если монитор не старше пяти лет или немного больше, и видеокарта такого же возраста, то они в 99% случаев будут совместимы и поддерживать друг друга.

- Видеокарта например может содержать только VGA (обычно это старые видеокарты). А монитор — только DVI. Поэтому их нельзя подключить один к другому, но можно использовать всякие кабели-переходники (лично я не особо советую, возможны глюки). Вообще существует VGA порт, это устаревший, был актуален в эпоху ЭЛТ-мониторов. DVI и HDMI — это уже современные видеоразьемы. DVI можно подключить HDMI. У меня была материнка, там был только HDMI-выход, а монитор был DVI, купил кабель нонейм, при помощи которого можно подключить с HDMI к DVI, все работало нормально.

- Редко — монитор может иметь один тип DVI, а видеокарта другой, и между этими разными типами не предусмотрена передача видеосигнала. Но это редко.

- Иногда может быть такое, что видеокарта выдает большое разрешение, которое не поддерживается монитором. Решение — уменьшить разрешение в безопасном режиме, где оно по умолчанию будет более низким.

Если вы подключили монитор к видеокарте, а картинки нет, то это может быть что угодно. Может у вас есть встроенное видеоядро в процессоре и в биосе выставлено, чтобы это видеоядро было главным. Попробуйте подключить к видеовыходам материнской платы, если они конечно есть. Еще бывает что нет изображения из-за глюка оперативки — ее нужно извлечь из разьемов и потом поставить обратно. Тоже самое можно сделать и с видеокартой.

Но первым делом — проверьте параметры биоса, чтобы там не было указано, что главным адаптером выступает встроенное видеоядро процессора (обозначаться как iGPU, а дискретная видеокарта просто GPU).

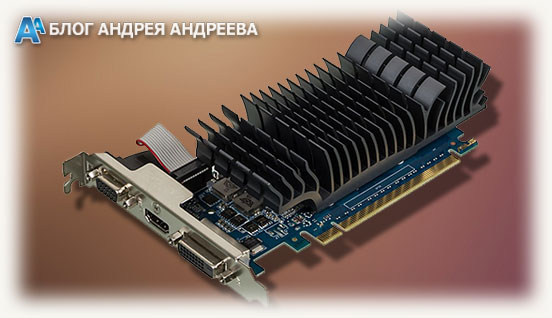

Если на мониторе сзади вы видите такие порты:

А на видеокарте тоже такие:

Значит монитор и видеокарта на 99.99% совместимы. Подключить можно как по синему разьему VGA, так и по белому DVI, то есть даже не один, а два способа. Если нет картинки — нужно искать причину в другом.

Предыстория

Давным-давно, когда все мониторы были большими и кинескопными, компьютеры использовали фиксированные разрешения и тайминги для вывода изображения на экран. Тайминги были описаны в стандарте Display Monitor Timings (DMT), и не существовало универсального метода расчета таймингов для использования нестандартного разрешения. Мониторы отправляли компьютеру информацию о себе через специальный протокол Extended display identification data (EDID), который содержал DMT-таблицу с поддерживаемыми режимами. Шло время, мониторам стало не хватать разрешений из DMT. В 1999 году VESA представляет Generalized Timing Formula (GTF) — универсальный способ расчета таймингов для любого разрешения (с определенной точностью). Всего через 3 года, в 2002 году, его заменил стандарт Coordinated Video Timings (CVT), в котором описывается способ чуть более точного рассчитывания таймингов.

Оба стандарта были созданы с учетом особенностей хода луча в электро-лучевой трубке, вводились специальные задержки для того, чтобы магнитное поле успело измениться. Жидкокристаллические мониторы, напротив, таких задержек не требуют, поэтому для них был разработан стандарт CVT Reduced Blanking (CVT-R или CVT-RB), который является копией CVT без задержек для CRT, что позволило значительно снизить требуемую пропускную способность интерфейса. В 2013 году вышло обновление CVT-R c индексом v2, но, к сожалению, открытого описания стандарта в интернете нет, а сама VESA продает его за $350.

Заключение

Не стоит слепо верить технической документации на монитор. В ходе исследований оказалось, что ограничение по вертикальной частоте аж 86 Гц, вместо 76 Гц по заявлению производителя. Таким образом, я могу наслаждаться плавной картинкой, хоть и в не в самом высоком разрешении

Привет, друзья! Все больше процессоров, представленных на рынке, имеют интегрированный графический ускоритель. Для того, чтобы воспользоваться этими функциями, и материнская плата нужна соответствующая – оборудованная портом для подключения монитора.

Несмотря на то, что прогресс не стоит на месте, это чаще всего не HDMI или DVI-D, а старый добрый VGA.

Сегодня мы с вами разберем, к чему подключать монитор – к материнке или видеокарте и в каких случаях один способ предпочтительнее другого. Советы из этого поста пригодятся всем, кто занимается самостоятельной сборкой компьютера.

Стандартные и нестандартные стандарты

Современным мониторам и видеокартам нет никакого дела до фиксированных разрешений и таймингов времен DMT, они могут работать в широком диапазоне разрешений и частот обновления. Давайте посмотрим в техпаспорт моего монитора:

| Поддерживаемая горизонтальная частота развертки | 31-140 кГц |

| Поддерживаемая вертикальная частота развертки | 29-76 Гц |

| Режим | Частота горизонтальной развертки | Частота вертикальной развертки | Частота пикселизации | Полярность синхронизации |

|---|---|---|---|---|

| VESA, 3840×2160 | 133.3 кГц | 60.0 Гц | 533.25 МГц | H+/V- |

Дело в частоте пикселизации. Многие видеокарты, а тем более интегрированное в процессор видео, имеют железные ограничения частоты пикселизации, а из-за того, что в EDID монитора нет максимального разрешения с меньшей частотой вертикальной развертки вследствие ограниченности его размера, компьютер не может использовать максимальное разрешение.

К сожалению, производители редко публикуют максимальную частоту пикселизации видеочипов, ограничиваясь максимальным поддерживаемым разрешением, но для интересующих меня карт я нашел необходимую информацию:

Intel HD 3000 (Sandy Bridge): 389 кГц

Haswell ULT (-U): 450 кГц

Haswell ULX (-Y): 337 кГц

Совместимость старых мониторов с новыми видеокартами и наоборот

Оргтехника — такая сфера, где без строгой стандартизации и унификации далеко не уедешь. Брендов, выпускающих различные комплектующие и периферические устройства, как и самих таких девайсов, огромное количество.

Если не внедрить единые протоколы обмена данными между ними, крупные компании потеряют часть клиентов и начнут терпеть убытки, а этого никто не допустит.

Исключением является, пожалуй, только компания Apple с собственной экосистемой, но и там все девайсы можно связать по «родным» протоколам.

В итоге мы имеем следующее: независимо от характеристик монитора — будь то навороченный ЖК экран, работающий на частоте 144 Гц и выдающий изображение разрешением 4К, и не самая новая видеоплата, или, наоборот, высокопроизводительный современный видеоадаптер и древний пузатый монитор. Они должны корректно коннектиться и выдавать изображение.

Конечно, не факт, что при такой конфигурации будут запускаться видеоигры, но уж просмотр фильмов вам гарантирован.

Проблема, с которой может столкнуться пользователь — несовместимость портов. К примеру, старые мониторы были оборудованы гнездом VGA — трапециевидным штекером, маркированным синим цветом. На современных видеоадаптерах, даже в бюджетном сегменте, такой слот сегодня большая редкость.

Но и эта проблема имеет решение. Существуют переходники и конверторы сигнала, чтобы связать любые порты разного вида, в том числе аналоговые с цифровыми. При удачном подборе адаптера все будет корректно работать, даже если порты разные.

История

Дискретный графический ускоритель

Такое устройство выполнено в виде отдельного модуля, который монтируется в специальный слот. Оно оборудовано собственными видеопамятью, процессором и системой охлаждения.

Мощная видеокарта сильно греется во время работы, поэтому требует и хорошего охлаждения. Как правило, оборудованы они двумя или тремя большими кулерами, которые могут создавать во время пиковых нагрузок солидный шум.

В зависимости от технических характеристик, такая видеокарта позволяет запускать любые игры. При этом геймер не будет страдать от просадки ФПС, лагов, фризов и вылетов на рабочий стол, если мощность устройства соответствует минимальным системным требованиям игры.И даже если немного не дотягивает, графический ускоритель можно разогнать с помощью специальных утилит. Кроме того, современные видеокарты для передачи видеосигнала часто используют слоты DVI и HDMI (читайте детальнее про разъемы или видео выходы у видеокарт).

Почему нет изображения, если все совместимо

Но не исключено, что при попытке «подружить», казалось бы, вполне совместимые девайсы, может отсутствовать картинка на экране. Из-за чего такое происходит?

Одна из возможных причин — неподходящий переходник. В некоторых случаях требуется не просто переходник, то есть вилка, связывающая разные штекеры в единую электрическую цепь, а именно адаптер, который получает дополнительное питание на преобразующую плату.

Второе, что может вызывать неполадки — разные типы портов DVI. В этом формате есть несколько видов слотов — аналоговый, цифровой и аналогово-цифровой.

Они почти совместимы, но аналоговый порт не будет подавать сигнал на цифровой, и соответственно, наоборот. И даже если в аналогово-цифровой связке все нормально работало, а потом вдруг перестало, не исключено, что на штекере перегорела одна из цепей.

Прочие неполадки в этой области мне не известны. Если вам встречались еще какие-то не стыковки и несоответствия, давайте обсудим в комментариях. О том, что такое разрешение экрана монитора, можно почитать тут. До скорой встречи!

Монитор ЭЛТ LG Flatron f700b - VGA (D-Sub)

Материнка - tl 810i-xl2 (socket 370)

Древняя вещь. На мониторе вообще ничего не отображается, когда он подключён к этому ПК. Сам монитор работает на другом компе.

Исследуемый ПК горит всеми индикаторами, крутит всем, чем должен крутить, но картинки не выдает вообще никакой. При подключении к нему пропадет надпись "нет сигнала".

Идентичная ситуация на обоих имеющихся видео картах (встроенная и S3 Trio64V+).

Т.к. Монитор разработан позже материнки лет так на 9, мне кажется, что проблема именно в этом.

Отсюда 2 вопроса:

1) Какие мониторы мне тогда подойдут (типы разъёмов)?

2) Может, проблема всё-таки не в этом? Тогда в чём? Как диагностировать и устранять?

Как я уменьшу разрешение, если вообще не уверен в запуске системы (НА ЭКРАНЕ НИЧЕГО НЕ ОТОБРАЖАЕТСЯ) .

Так в чём же тогда дело, 1ламер?

Спикер скорее всего давно сдох, т. к. не подаёт признаков жизни.

Если бы отошла оператива, на монтиоре было бы написано что-нибудь.

Спикер компа переживёт всех нас и комплектующие тоже. Несколько раз в день выдать частотный сигнал в 800 гц его совсем не напряжёт (это тот-же наушник почти-что. ) . Если он молчит - или видеокарта глючит, или память.

Если же при включении компа на экране появляется служебная информация (о, Боги, спикер действительно умер!) , а монитор потом выключается, то есть следующие варианты:

1. Загрузиться в безопасном режиме (клавиша F8 перед загрузкой системы) и убедиться в работоспособности системы.

2. Так-же нажать F8 и выбрать режим VGA, после чего выставить правильный режим (хотя я очень сомневаюсь, что эта доисторическая карточка может поддерживать разрешения, несовместимые с разрешением данного монитора) .

3. Загрузиться с live cd и проверить работоспособность системы.

P.S. Если отошла оператива - будут длинные, повторяющиеся сигналы спикера. Или ничего не будет. На мониторе - тем более.

если видяхи менел значит мать выкинь! и это, он хоть пищит когда запускается? если не пищит, то мать догони и еще раз ногой пни. Это 99проц мать!

было тоже самое- оказалось-отошла оперативка. легко проверить-при включении сразу был короткий писк- оперативка в порядке, не было-вытащи оперативку, зачисть контакты ластиком и надежно встать-чтобы сработали защелки

Приветствую друзья

Сразу коротко ответ:

Может ли монитор не поддерживать видеокарту — редкое явление, касается старых мониторов ЭЛТ или специфических, обычно при наличии VGA и/или DVI на мониторе и видеокарте — они друг с другом будут работать корректно.

Что делать и что сделать?

Ответ очевиден — нужно уменьшить частоту пикселизации! Ее уменьшение приведет и к уменьшению частоты обновления монитора. Как нам это сделать? Нам нужно сгенерировать так называемый modeline — информацию о таймингах для видеокарты и монитора. В сети можно найти множество генераторов modeline, но большинство из них безнадежно устарели и ничего не знают о стандарте CVT-R, который мы и будем использовать. Я рекомендую вам воспользоваться umc под Linux, PowerStrip под Windows и SwitchResX под Mac OS. К слову, SwitchResX — единственная программа, которая может рассчитывать modeline по стандарту CVT-R2, но мой монитор его не поддерживает.

Modeline содержит следующую структуру:

Посмотрите на таблицу выше: минимальная вертикальная частота обновления моего монитора может равняться 29 Гц.

Давайте сгенерируем modeline для разрешения 3840×2160 с частотой обновления в 30 Гц:

Как видим, частота пикселизации с данным режимом будет установлена в 262.75 МГц, что далеко от ограничений моего видеоадаптера.

Давайте попробуем установить и активировать наш режим:

Если все прошло удачно, вы увидите картинку в «неподдерживаемом» вашей картой разрешении на мониторе. Ура!

У нас все еще есть большой запас по частоте пикселизации, да и вряд ли кому-то будет комфортно использовать монитор с частотой обновления в 30 Гц, поэтому мы будем увеличивать ее до тех пор, пока частота пикселизации не приблизится к значению в 389 МГц — пределу моего видеоадаптера. Путем нехитрых манипуляций удалось установить, что при такой частоте мы получаем вертикальную развертку в 44.1 Гц.

Не блеск, но жить можно!

Как можно заметить, частота горизонтальной развертки — 97.25 кГц — вполне в диапазоне поддерживаемых монитором. Как в случае с вертикальной разверткой, так и в случае с разрешением, монитору нет дела до конкретных режимов, поэтому мы можем использовать 3200×1800 при 60 Гц — еще не такое низкое разрешение, как 2560×1440, и с привычной частотой обновления.

- Отредактировать EDID монитора и указывать его драйверу

- Добавить modeline в настройки Xorg

Для второго способа достаточно создать файл с Xorg-секцией «Monitor» и поместить его в /etc/X11/xorg.conf.d/ :

Где Identifier — название вашего видеовыхода согласно xrandr. Опцией «PreferredMode» можно задать режим, который будет выбран по умолчанию.

Интегрированная видеокарта

Для начала разберем особенности каждого из типов устройств. Интегрированная видеокарта – виртуальное устройство, созданное как дополнительный логический блок в процессоре. Она не имеет собственной видеопамяти и использует оперативную память компьютера.

Технологии развиваются, и сегодня интегрированные видеокарты – довольно мощные устройства, которые способны решить множество поставленных пользователем задач: воспроизведения мультимедийных файлов, работа с графикой, в том числе 3Д, рендеринг видео и даже запуск не слишком требовательных к мощности современных игр (или теплых ламповых шедевров ушедших лет).Одним из преимуществ такой видеокарты можно считать и то, что шума при работе она вообще не издает. Шуметь будет только кулер процессора, но он работает независимо от подаваемой нагрузки.

Недостаток встроенной видеокарты в том, что она по мощности проигрывает даже дискретным устройствам, средней ценовой категории. Если вы заядлый геймер, такой вариант вам однозначно не подходит.

Небольшой совет

Однако при самостоятельной сборке компьютера, рекомендую все-таки, кроме хорошей дискретной видяхи, приобрести также процессор с интегрированной. Почему так?

Во-первых, любое устройство, каким бы совершенным оно не было, может сломаться в самый неподходящий момент. И пока графический ускоритель находится на гарантийном обслуживании, или вы собираете деньги на новый, чтобы вообще не остаться без компьютера, можно воспользоваться встроенной видяхой.

Во-вторых, в жизни, кроме поломки электроники, периодически происходят всякие неприятные казусы, и часто срочно требуется определенная сумма денежек.

В таком случае мощная видеокарта – своеобразная страховка. Удачно продав ее, можно даже за б/у устройство выручить до 80% стоимости. Это не так накладно, чем продавать золото, особенно фамильное, да и временно расстаться с хорошей видеокартой менее болезненно для геймера, чем сразу полностью с компом.

Не дай Бог, конечно, чтобы вам когда-нибудь пригодился в жизни этот совет.

И напоследок советую ознакомиться с публикациями про все разъемы и выходы, которые есть на материнской плате, и какой лучше выбирать кабель для подключения: DVI или HDMI. Буду чертовски признателен каждому персонально, кто сделает репост на эту статью в социальных сетях. Увидимся завтра! Пока!

Здравствуйте! Сегодня разберемся — может ли монитор не поддерживать видеокарту, по каким причинам такое происходит, как узнать и что делать, если подобное наблюдается.

Для понимания темы также советую ознакомиться: «Все виды разъемов у компьютерных мониторов».

Предыстория

Давным-давно, когда все мониторы были большими и кинескопными, компьютеры использовали фиксированные разрешения и тайминги для вывода изображения на экран. Тайминги были описаны в стандарте Display Monitor Timings (DMT), и не существовало универсального метода расчета таймингов для использования нестандартного разрешения. Мониторы отправляли компьютеру информацию о себе через специальный протокол Extended display identification data (EDID), который содержал DMT-таблицу с поддерживаемыми режимами. Шло время, мониторам стало не хватать разрешений из DMT. В 1999 году VESA представляет Generalized Timing Formula (GTF) — универсальный способ расчета таймингов для любого разрешения (с определенной точностью). Всего через 3 года, в 2002 году, его заменил стандарт Coordinated Video Timings (CVT), в котором описывается способ чуть более точного рассчитывания таймингов.

Оба стандарта были созданы с учетом особенностей хода луча в электро-лучевой трубке, вводились специальные задержки для того, чтобы магнитное поле успело измениться. Жидкокристаллические мониторы, напротив, таких задержек не требуют, поэтому для них был разработан стандарт CVT Reduced Blanking (CVT-R или CVT-RB), который является копией CVT без задержек для CRT, что позволило значительно снизить требуемую пропускную способность интерфейса. В 2013 году вышло обновление CVT-R c индексом v2, но, к сожалению, открытого описания стандарта в интернете нет, а сама VESA продает его за $350.

Так куда подключать провод?

К той видеокарте, которая мощнее. Если вы купили готовый комп, скорее всего, мощнее будет дискретная видеокарта (однако не помешает уточнить спецификацию). Если дискретной видяхи нет, подключать монитор придется к материнской плате.

Обнаружить необходимый разъем несложно: слот на материнской плате расположен выше и почти всегда вертикально. Порты на дискретном графическом ускорителе, как правило, расположены ниже всего и горизонтально.

К сожалению, если у вас оба типа видеокарт и оба разъема, подключить к системнику два монитора не получится. Вернее, получится, конечно, но работать будет только один. Такое ограничение устанавливается в БИОСе, когда основным назначается один из явных графических ускорителей.

Кстати, если вы решили поэкспериментировать и поменять используемый порт, настройки БИОСа также следует поменять, иначе изображения на мониторе не будет. Следует отметить, что это справедливо только к операционным системам семейства Windows.

В Unix такие ограничения можно обойти, однако необходим очень высокий уровень «красноглазия».

Может возникнуть закономерный вопрос: можно ли выводить изображение с дискретной видеокарты через интерфейс на материнской плате, если один из портов сломался? Увы, тоже нет. Архитектура компьютера такого решения не предусматривает.

В случае, если вы переключили в БИОС необходимые настройки и используете интегрированный графический ускоритель, дискретный продолжает работать в «полусонном» режиме: потребляет энергию и даже шевелит кулером.

Но так как нагрузка не подается, то и потребляемая мощность небольшая.

Поэтому, если есть видеокарта, используйте потенциал компьютера на полную мощность.

У меня не получается!

Убедитесь, что вы подключаете монитор через DisplayPort 1.2. HDMI 1.4 не позволяет использовать частоту пикселизации выше 340 МГц, в то время как для DisplayPort (HBR2) верхнее ограничение равно 540 МГц. Также удостоверьтесь, что ваш монитор поддерживает частоту обновления выше 30 Гц на максимальном разрешении, т.к. ранние модели этим грешили.

Читайте также: