Какие видеокарты поддерживают g sync

Nvidia G-Sync – это разновидность технологии адаптивной синхронизации для мониторов и экранов игровых ноутбуков. Она предназначена для устранения разрывов кадров, подергиваний и задержек на экране во время игры, в частности при высокой частоте кадров. G-Sync работает только с совместимыми мониторами и видеокартами Nvidia.

Как это работает

Самой первой технологий по борьбе с рассинхронизацией, была V-Sync (вертикальная синхронизация). Я думаю многие из вас замечали, что параметр с таким названием есть во многих играх и в настройках видеокарт.

Работает V-Sync очень грубо. Она просто уравнивает частоту кадров вашего монитора и видеокарты. Например, ваш ЖК работает на 75 Гц, а ваша видеокарта в игре World of Tanks может на максимальных настройках выдавать 100 FPS. При включении V-Sync 100 FPS будут обрезаны до 75. Естественно это скажется на комфорте игры.

Это еще полбеды. Если видяха не может выдать 60 FPS, то при включенной вертикальной синхронизации происходит сброс до 30. Что уже неприемлемо. На игровых мониторах, поддерживающих 144 Гц и более при включенном V-Sync проблемы создает так называемый Input Lag. Это когда мышь начинает плохо откликаться на ваши действия.

Для устранения всех этих недостатков и пришли нам на помощь G-Sync и FreeSync.

Эти обе технологии работаю прямо противоположным способом. Они заставляют монитор подстраиваться под видеокарту. И тут все зависит от возможностей самого монитора, видеокарты и версии используемой технологии.

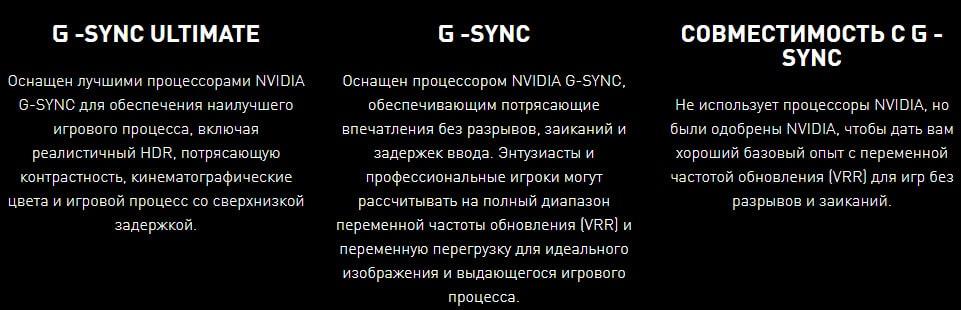

Nvidia G-Sync и HDR

Для просмотра HDR контента вам необходим монитор с маркировкой «G-Sync Ultimate». В отличие от обычных G-Sync мониторов, экраны G-Sync Ultimate отличаются крайне низкой задержкой, несколькими зонами подсветки, покрытием цветового диапазона DCI-P3, максимальной яркостью 1000 нит и поддерживают HDR в играх и видео при максимальной частоте обновления и при максимальном разрешении. Если вы рассчитываете на максимальное качество и HDR контент, то вам необходимо выбирать среди мониторов G-Sync Ultimate.

Технологии AMD FreeSync и G-Sync от Nvidia это так называемая адаптивная синхронизация изображения между видеокартой и монитором. Они направлены на устранение разрывов и других визуально видимых пользователем искажений на мониторе или телевизоре. Технически они реализованы по разному, но пытаются выполнять одну и туже функцию. Ниже мы рассмотрим их более подробно и сравним между собой.

FreeSync

Суть данной технологии, это обеспечить динамическую частоту обновления экрана для комфортного вывода изображения. С ее помощью частота обновления экрана синхронизируется с частотой кадров видеокарты. Это позволяет снизить или вовсе устранить визуальные недостатки, которые очень критичны в высоко динамичных играх.

Например, задержка ввода, это когда кажется, как будто курсор мыши плавает и нет четкого и резкого позиционирования, разрывы изображения и прерывания во время игры.

Выпущена в 2015 году для конкуренции с G-SYNC от NVIDIA. В отличии от конкурента, она не требует установки дополнительного чипа, является надстройкой в драйверах видеокарт. Поддерживает интерфейсы DisplayPort и HDMI.

Существует три модификации технологии:

- FreeSync.

- FreeSync Premium.

- FreeSync Premium Pro.

Каждая последующая, расширяет возможности предыдущей. Более подробно об их отличии, смотрите на изображении ниже (картинка кликабельна).

FreeSync Premium и Premium Pro имеют низкую компенсацию частоты кадров (LFC). Эта технология существует на ПК и игровых приставках. Встроенная аппаратная поддержка HDR является эксклюзивной для FreeSync Premium Pro.

До конца 2019 года существовало два названия FreeSync и FreeSync 2. Сейчас первая, это базовая версия, вторая версия разделилась на Premium и Premium Pro.

Наличие FreeSync в мониторах означает, монитор поддерживает динамическую частоту обновления изображения, и способен синхронизировать частоту вывода кадров GPU и монитора на аппаратном уровне без какого-либо снижения производительности на стороне видеокарты.

G-Sync против FreeSync

FreeSync – это ответ компании AMD технологии G-Sync, поэтому для ее использования вам понадобиться видеокарта Radeon, хотя на данный момент некоторые мониторы с FreeSync совместимы с решениями от Nvidia.

Вместе с тем существуют и другие отличия между двумя технологиями. При разрешении 4K, мониторы с FreeSync поддерживают максимальную частоту обновления 120 Гц, в то время как G-Sync экраны способны достичь 144 Гц. С другой стороны, на текущий момент в продаже есть несколько моделей телевизоров с поддержкой FreeSync, а вот с G-Sync нет.

В дополнение к этому, в отличие от FreeSync, производители, выпускающие G-Sync или G-Sync Ultimate мониторы обязаны платить за фирменный чип Nvidia, который заменяет привычный контроллер дисплея. AMD FreeSync основан на открытых стандартах, поэтому производители не платят никаких отчислений и такие дисплеи, как правило стоят дешевле. Вероятно, в будущем ситуация может изменится из-за появления большего количества G-Sync совместимых мониторов.

Артефакты изображения в играх

Разрывы экрана – это нежелательный эффект изображения, который мешает при игре. Он возникает из-за того, что скорость появления кадров в играх не соответствует частоте обновления монитора. G-Sync призван устранить эту проблему и способен работать с мониторами с частотой обновления экрана вплоть до 240 Гц. Однако, для дисплеев с 4K разрешением этот показатель снижается до 144 Гц. Разрывы появляются в результате того, что видеоадаптер может рендерить кадры быстрее, чем их способен отобразить монитор.

G-Sync синхронизирует частоту обновления экрана с частотой рендеринга кадров видеокарты Nvidia – как только ГПУ заканчивает просчет кадра, он тут же, без всяких задержек отображается на мониторе. Таким образом частота обновления монитора становится не фиксированной, а динамической, как и частота кадров видеокарты.

Мониторы G-Sync делятся на 3 категории: G-Sync Ultimate, G-Sync и G-Sync совместимые. Первые два типа оснащены проприетарным процессором Nvidia и также могут похвастаться поддержкой технологии Variable Overdrive, которая предсказывает появление следующего кадра и подстраивает параметры скорости отклика монитора для устранения артефактов движения.

Для большей наглядности посмотрите видео:

Существующие технологии для борьбы с рассинхронизацией изображений

Всего на данный момент их четыре:

- V-Sync.

- G-Sync.

- FreeSync.

- Adaptive Sync c Variety Refresh Rate (VRR).

G-Sync

Эту технологию адаптивной синхронизации разработала корпорация NVIDIA. На рынке она появилась в 2013 году. Так же, как и FreeSync от AMD, служит для синхронизации выводимой картинки между видеокартой и монитором, но у нее есть множество ограничений.

Для ее реализации в мониторы надо устанавливать чип, который делает конечное устройство дороже. Так же G-Sync работает только с видеокартами семейства GeForce и мониторами, подключаемыми через DisplayPort 1.2a.

На сайте NVIDIA есть список сертифицированных мониторов. Вам только надо выбрать любой партнерский магазин и просмотреть список доступных на данный момент моделей. Например, на сайте newegg данная технология помечена как G-Sync (NVIDIA Adaptive Sync). Подобрать интересный монитор и поискать его уже у нас.

Из-за дороговизны мониторов с G-Sync и других ограничений, технология заняла узкий сегмент рынка, по сравнению с бесплатной FreeSync. Для решения этой проблемы, в 2019 году NVIDIA включила поддержку VESA Adaptive-Sync, что позволило использовать мониторы с AMD FreeSync для видеокарт GeForce начиная с 1000-й серии и Radeon 200х серий. Такие сертифицированные мониторы должны быть помечены, как G-Sync Compatible.

Чуть позже NVIDIA расширила VESA Adaptive-Sync, добавив в него VRR – Variable Refresh Rate. Она была больше заточена на работу с телевизорами и стала поддерживать подключение по стандарту HDMI 2.1, в который была добавлена технология переменной частоты обновления.

Существует два типа сертификатов G-Sync:

Первый подтверждает, что данный монитор имеет микросхему NVIDIA G-Sync и поддерживает адаптивную синхронизацию для всех режимов работы.

В продвинутой версии, в дополнение к базовым нормам, дисплей должен иметь:

- максимальную частоту обновления не ниже 144 Гц, а минимальную — не выше 1 Гц;

- поддержку вывода изображения в расширенном динамическом диапазоне HDR и заводскую калибровку матрицы монитора для соответствия цветовому пространству DCI-P3.

Это естественно сказывается на цене устройства, но и потребитель получает более качественное и хорошо настроенное изделие.

Что лучше выбрать — G-Sync или FreeSync и можно ли обойтись без них.

Если вы поклонник зеленых, то для вас лучшим выбором будет монитор с технологией G-Sync, G-Sync Compatible или G-Sync Ultimate. Обычный G-Sync работает только на видеокартах NVIDIA и требует дорогостоящего монитора с встроенной микросхемой.

Для сторонников красных подойдут мониторы с AMD FreeSync, FreeSync Premium, FreeSync Premium Pro или G-Sync Compatible. FreeSync работает на всех видеокартах и по DisplayPort, и по HDMI. Для видях нвидиа желательно наличие сертификата G-SYNC Compatible, иначе работа не гарантируется.

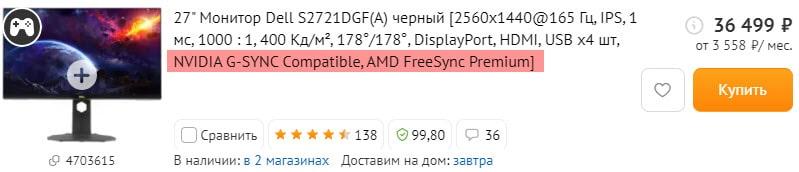

Универсальным решением для тех и других можно считать наличие одновременно и FreeSync Premium и G-Sync Compatible. Ниже на скриншоте можете увидеть модель такого монитора.

На данный момент в обоих технологиях присутствует Adaptive Sync, которую в 2014 году представила Ассоциация стандартизации Video Electronics Standards Association (VESA), которая умеет всё то же самое, что и G-Sync, но без чипов. А FreeSync, это измененный и расширенный Adaptive Sync.

Ниже я привел список мониторов, с поддержкой различных технологий динамического обновления экрана. По количеству предложений можно понять, что популярно на данный момент. Скрин с магазина DNS.

А теперь поговорим, можно ли заменить эти технологии.

Полностью их заменить не получиться, но можно в ручном режиме добиться приемлемого качества игры без рассинхронизации. Здесь основную роль играет мощность видеокарты. Чем она круче — тем проще получить устраивающий вас результат.

Так же чем у монитора больше Гц, тем он более зависим от FreeSync и G-Sync, так как из-за высокой частоты смены кадров и фпс на видеокарте чаще проявляются артефакты.

Всем владельцам не игровых мониторов, с частотой обновления 60-75 Гц я могу посоветовать следующее.

Первое, что необходимо сделать, это в проблемной игре вычислить минимальное значение FPS. Устанавливаете любую утилиту измеряющую FPS и играете. Полученное минимальное значение кадров в секунду записываем.

Теперь, в панелях управления драйверами как у NVIDIA, так и AMD есть вкладка с тонкой настройкой установленных игр. У NVIDIA она находиться в Управление параметрами 3D.

- В управлении выбираем “Программные настройки”.

- Далее выбираем игру, для которой это будем делать. Если ее нет в списке, значит она установлена на другом диск. Надо указать путь к ее запускному файлу.

- Находим в списке настраиваемых параметров пункт Макс. частота кадров.

- В нем устанавливаем ползунок на минимальное число кадров в секунду, которое получили в игре и нажимаем ОК.

Теперь при запуске этой игры частота кадров не будет подниматься выше установленного вами значения и игра будет стабильно работать, без рывков и сбоев. Этот способ не стоит применять, если у вас игра выдает менее 60 FPS.

Это лучший способ побороть разрывы кадров на обычных мониторах без специальных технологий. Я такой способ применил у себя в игре WOT. Моя видяха на макс настройках выдает 110 FPS. В особо нагруженных моментах были проседания до 92-95. Я решил остановиться на 90, так как на комфорте игры это никак не сказалось. зато улучшилась стабильность.

P.S. Изменить максимальную частоту кадров так же можно в файлах самой игры, но это не удобно, так как при обновлениях все надо делать заново.

Похоже, видеокарты AMD в скором времени смогут работать с технологией синхронизации кадров NVIDIA G-Sync. Во всяком случае, ресурс TFT Central сообщает, что компания NVIDIA планирует обеспечить возможность использования технологии G-Sync системам не только со своими собственными видеокартами, но и с ускорителями конкурента.

Ранее выбор между игровыми мониторами с G-Sync и FreeSync был довольно простым. Если ваша система использует видеокарту NVIDIA — вы выбираете монитор с G-Sync, а если видеокарту AMD — то с FreeSync. Но всё изменилось в январе, когда NVIDIA добавила своим видеокартам поддержку технологии Adaptive-Sync, тем самым дав им возможность использовать синхронизацию кадров при подключении к мониторам с FreeSync. Правда, NVIDIA сама отбирает совместимые мониторы, сертифицируя их как «G-Sync Compatible», хотя иногда можно обойтись и без этого сертификата.

Но если владельцы видеокарт NVIDIA получили больше свободы при выборе монитора с синхронизацией кадров, то пользователи AMD Radeon до сих пор не могут использовать функцию G-Sync. Однако теперь сообщается, что будущие мониторы с технологией G-Sync будут поддерживать технологии HDMI-VRR и Adaptive Sync при подключении через HDMI и DisplayPort. Это означает, что будущие владельцы мониторов с G-Sync смогут использовать технологию синхронизации кадров даже при подключении ПК с AMD Radeon и игровых консолей на чипах AMD.

Конечно, поддержка новых технологий будет реализована на уровне прошивки. Сообщается, что соответствующие прошивки уже разрабатываются для аппаратных модулей G-Sync первой и второй версий. И тут важно отметить, что новые прошивки получат лишь будущие мониторы с G-Sync. То есть уже присутствующие на рынке мониторы по-прежнему не смогут использовать G-Sync при подключении к чему-либо, кроме видеокарты NVIDIA.

Приятным сюрпризом от NVIDIA на CES 2019, конечно, стало заявление о поддержке технологии VESA Adaptive Sync в продуктах GeForce — проще говоря, видеокарты NVIDIA теперь поддерживают AMD FreeSync. На данный момент только ускорители серий Pascal и Turing получили такую совместимость, но это очень важное событие: в настоящее время более 550 мониторов совместимы с открытым стандартом переменной частоты кадров, и с появлением нового драйвера на прошлой неделе видеокарту GeForce можно протестировать на любом из них.

NVIDIA добавила поддержку FreeSync в свою марку G-Sync — как бы отлично это ни звучало, следует подчеркнуть, что не всё так просто. Из 400 протестированных мониторов NVIDIA сертифицировала только 12, которые обеспечивают адаптивную синхронизацию без артефактов. Компания предупреждает о возможной несовместимости других дисплеев и артефактах, включая пульсирование и двоения, в то время как на других иногда выводятся чёрные кадры и так далее. Специальная ветка Reddit и связанная с нею огромная таблица постепенно создают картину того, как на деле карты GeForce работают с дисплеями FreeSync.

Eurogamer решил протестировать ASUS VP28U — дисплей 4K начального уровня с поддержкой FreeSync, который не входит в дюжину избранных самой NVIDIA. Этот дисплей ориентирован на бюджетных пользователей и хотя бы поэтому NVIDIA вряд ли бы дала ему сертификат G-Sync. По той же причине любопытно, на что можно рассчитывать?

Сначала к монитору ASUS через DisplayPort (пока нет поддержки HDMI VRR) была подключена видеокарта GeFore RTX 2080 Ti, но затем журналист быстро переключился на менее мощную GTX 1080 Ti, потому что новый флагман семейства Turing порой оказывался слишком быстр, чтобы на нём проверять преимущества VRR. Привязка к 4K/60p в современных играх даже для GTX 1080 Ti — порой нетривиальная задача. Как и многие другие мониторы начального уровня FreeSync, ASUS VP28U может поддерживать VRR только в диапазоне между 40 Гц и 60 Гц — то есть выдавать кадры через 16,7–25 мс. Если производительность игры выпадает из этого окна, теряются все преимущества VRR. Одним из многих достоинств «чистого» G-Sync является компенсация низкой частоты кадров, которая сглаживает ощущение при выпадении из диапазона VRR. Это очень полезная функция, которая доступна только на некоторых экранах FreeSync.

NVIDIA рекомендует лишь дюжину мониторов FreeSync. Что если протестировать GTX 1080 Ti на базовой модели вроде ASUS VP28U? Результат не идеален, но он вовсе не плох

Какими оказались первые впечатления? Технология работает, и до тех пор, пока игра остаётся в заявленном диапазоне VRR, игровое окружение преображается. Теперь GPU напрямую отвечает за вывод нового кадра на экране. Обусловленные вертикальной синхронизацией (V-Sync) дрожания при частоте кадров ниже 60 в секунду исчезают. Ужасные разрывы экрана, связанные с отключением V-Sync, пропадают тоже — до тех пор, пока частота кадров не упадёт ниже 40 кадров/с (ограничения монитора). В результате плавность и положительные впечатления от игры существенно возрастают даже на таком недорогом дисплее, как VP28U.

Чтобы добиться идеального окружения и оставаться в заявленном диапазоне VRR конкретного дисплея, необходимо регулировать настройки игры. Стоит сказать, что диапазон FreeSync может значительно варьироваться от экрана к экрану. Так что при покупке монитора без поддержки G-Sync для сопряжения с видеокартой NVIDIA нужно внимательно ознакомиться с характеристиками и, возможно, присмотреться к огромной составляемой сообществом таблице — судя по ней, многие дисплеи имеют стробирующий эффект в режиме VRR, который сильно отвлекает. Это время от времени появлялось и на ASUS VP28U, в зависимости от выводимого контента и, как правило, в нижней части диапазона VRR. Монитор с полноценной сертификацией G-Sync может обойтись дороже, но зато игрокам не придётся беспокоиться об этих проблемах.

Тестирование ASUS VP28U с консолью Xbox One X, которая тоже поддерживает FreeSync

Адаптивная синхронизация используется в дисплеях с высокой частотой кадров, но в диапазоне до 60 Гц эффект от неё наиболее сильный. Считается, что идеальная плавность достигается на частоте 60 кадров/с, но при работе синхронизации наблюдатель, как правило, не увидит разницы с частотой 50 кадров/с. И в этом оптимальном диапазоне нет разницы между G-Sync и FreeSync.

Технология адаптивной синхронизации великолепна — особенно в разрешениях вроде 4K, где требования новейших игр делают вывод с твёрдой частотой 60 кадров/с чрезвычайно сложной задачей (особенно в случае трассировки лучей и других тяжёлых режимов). Battlefield V большую часть времени выдаёт 60 кадров/с на GTX 1080 Ti при 4K и настройках Ultra. Тем не менее, как только возрастает количество эффектов пост-обработки во время интенсивного боя, частота чаще всего находится в диапазоне 55–60 кадров/с, а может упасть и до 50 кадров/с. На обычном экране это бы бросалось в глаза, но с VRR впечатление достаточно плавное, да и некоторый запас диапазона частот позволяет не тратить много времени, подстраивая графику игры под наихудший сценарий.

Кроме того, поддержка ведущим производителем видеокарт открытого стандарта адаптивной синхронизации сделает мониторы с поддержкой FreeSync более распространённым явлением, если не нормой. И хотя такие артефакты, как стробирование, в настоящее время широко распространены на многих экранах, тот факт, что на них обращено внимание, может привести к общему повышению качества поддержки VRR. Вдобавок ко всему, это даёт возможность NVIDIA обеспечить совместимость для грядущей волны телевизоров HDMI 2.1, где VRR является частью спецификации. Отдельные 4K-экраны от Samsung уже поддерживают FreeSync, но пока NVIDIA работает с VRR только через DisplayPort — будем надеяться, в будущем подоспеет и поддержка HDMI.

Для владельцев видеокарт NVIDIA теперь гораздо проще и дешевле использовать технологию, которая является одним из самых сильных улучшений в игровом окружении на ПК. Однако при выборе более дешёвого варианта стоит помнить, что качество реализации будет зависеть от конкретного дисплея и функциональность может оказаться не такой надёжной, как у существующих экранов G-Sync. Но благодаря поддержке NVIDIA открытый стандарт VRR, наконец, получил огромный импульс, и это можно только приветствовать.

Всех ПК-геймеров планеты Земля, да и консольных игроков тоже, объединяет одна проблема — вертикальные разрывы изображения. И вроде бы есть куча технологий которые решают эту проблему:

- V-Sync,

- G-Sync,

- FreeSync

- А ведь еще есть Adaptive Sync

- А в HDMI 2.1 недавно добавили VRR.

Давайте сегодня раз и навсегда разберемся в технологиях адаптивной синхронизации изображения.

Для тех кто не в курсе. А в чём собственно проблема?

Чтобы изображение появилось на экране, должно произойти, как минимум, две вещи:

- графический процессор должен подготовить кадр и передать его на монитор,

- ваш монитор должен показать этот кадр.

Обычные мониторы работают на частоте 60 Гц, то есть способны выводить 60 кадров в секунду, а игровые на 144 Гц и выше.

А вот графический процессор живет в совершенно ином мире. В играх постоянно всё меняется: колышется листва, журчит ручеёк, враги выпрыгивают из-за угла. Каждый кадр отличается по своей сложности, поэтому на их просчет уходит разное количество времени.

Иными словами, у монитора частота кадров постоянная, а у видеокарты переменная.

Вот и выходит, что за один цикл обновления монитора видеокарта может подготовить больше одного кадра или меньше.

Из-за этого мало того что страдает плавность картинки, так еще и появляются артефакты в виде вертикальных разрывов изображения. Кстати, при просмотре фильмов тоже могут появляться такие артефакты, потому что кино снимают в 24 к/с.

V-Sync

Очевидно проблема требовала решения, и еще на заре компьютерных игр оно появилось! Название у этого решения — вертикальная синхронизация или V-Sync. Наверняка вы встречали такую опцию как в настройках видеокарты, так и в играх.

Работает эта штука достаточно топорно. Фактически она просто принуждает видеокарту выводить кадры с частотой кратной частоте обновления экрана. Например, если у вас монитор 60 Гц, то максимальное количество кадров в секунду тоже будет 60, даже если ваша видеокарта способна на большее. И в общем-то часто такое ограничение вполне уместно, если у видеокарты хватает мощи и нет просадок ниже 60 к/с, но если они есть — начинаются проблемы.

При включенной вертикальной синхронизации, следующее кратное значение — это 30 к/с. Поэтому даже если ваш фреймрейт просел фактически всего на пару кадров, вы всё равно увидите падение до 30 к/с. Такой перепад мало того, что большой и очень визуально ощутимый, так ещё и будет происходить с небольшим лагом. Поэтому если стабильного FPS в 60 к/с или 30 не достичь, то включать V-Sync вообще нет никакого смысла.

Справедливости ради, чем выше герцовка монитора, тем больше мы имеем кратных значений, на которых может работать синхронизация. Поэтому на игровых мониторах V-Sync работает куда лучше.

Но история с кратными значениями — не самая главная проблема технологии. Есть другой неочевидный недостаток: вертикальная синхронизация — увеличивает задержку ввода, то есть создаёт Input Lag.

Игра медленнее реагирует на ваши действия, всё происходит с задержками и как-то плывёт в молоке, поэтому прицелиться становится гораздо сложнее. Почему так происходит?

Это интересно, смотрите! Каждый кадр рассчитывается и выводится на экран через один и тот же конвейер. Упростим его до трёх этапов.

- Каждое ваше действие, например щелчок мышки надо как-то интерпретировать и обновить состояние игры. За это отвечает центральный процессор (синяя полоса на картинке ниже). Центральный процессор подготавливает кадры для графического процессора и помещает их в очередь рендеринга графического процессора.

- Затем графический процессор (зелёная полоса) берет эти подготовленные кадры из очереди и рендерит их.

- Только потом эти кадры выводятся на дисплей (серая полосочка на картинке).

Ну и в чём проблема, спросите вы? Дело в том, что ЦП не берется за подготовку следующего кадра, пока предыдущий не будет выведен на экран. Поэтому ограничивая количество выводимых кадров в угоду синхронизации с дисплеем, мы фактически увеличиваем задержки с которыми обновляется состояние игры! И если в каких-то простеньких играх типа пасьянса такие вещи допустимы, то в соревновательных играх вертикальная синхронизация может стать серьёзной помехой.

G-Sync

Но переживать не стоит, так как решение появилось еще в 2013 году. Именно тогда компания NVIDIA представила свою технологию адаптивной синхронизации — G-Sync. В отличие от старой технологии, G-Sync позволяет подстраивать не видеокарту под частоту обновления монитора, а наоборот заставляет монитор менять свою частоту под видеокарту!

Представляете? Так тоже можно было!

В результате мы получаем потрясающе плавную картинку без вертикальных разрывов и задержки ввода! Просто сказка! G-Sync также работает в огромном диапазоне частот. Изначально это было от 30 до 144 Гц, а сейчас уже есть поддержка до 360 Гц и может даже выше, тут скорее всё зависит от монитора.

А если фреймрейт падает ниже 60 Гц G-Sync умеет дублировать пропущенные кадры.

Получаются сплошные плюсы и проблема решена еще в 2013 году? Так почему же мы до сих пор об этом говорим?

Ну как сказать. Во-первых, эта технология закрытая, соответственно, G-Sync работает только с карточками NVIDIA, но это пол беды.

Все волшебные функции G-Sync стали возможны благодаря специальному чипу, который необходимо встроить в монитор. Естественно, эти чипы производит тоже NVIDIA и стоят они недешево. Поэтому мониторы с поддержкой G-sync в среднем стоят на 250-300$ дороже и таких моделей очень мало. То есть получилась классная, и для 2013 года революционная технология, но не универсальная и дорогая.

VESA Adaptive Sync

Поэтому уже спустя год, в 2014, Ассоциация стандартизации Video Electronics Standards Association или VESA представила открытую технологию Adaptive Sync, которая умеет, в принципе, всё то же самое, что и G-Sync, но без дорогостоящих чипов и работает на частотах от 9 до 240 Гц! Неплохо да?

Но для внедрения технологии нужно, чтобы её поддержку внедрили в прошивку и драйвер монитора, драйвер видеокарты, операционной системы и в игры!

А также необходимо наличие DisplayPort версии не ниже 1.2a, так как технология стала частью именно Display Port. Как видите, чтобы технология взлетела, нужно было проделать много работы. И этой работой занималась компания AMD.

AMD FreeSync

В 2015 году AMD внедрили Adaptive Sync в драйвера своих видеокарт и назвали технологию FreeSync. Реализация от AMD быстро получила очень широкое распространение. Добавить поддержку FreeSync в монитор оказалось настолько дешево, что сейчас сложнее найти игровой монитор без этой фичи, чем с ней.

Но AMD не остановились на просто внедрении стандарта от VESA. Также они добавили поддержку HDMI, начиная с версии 1.4. А в 2017 выпустили FreeSync 2, в который добавилась поддержка HDR и компенсацию низкой частоты кадров, как в G-SYNC.

Кстати, чуть позже, FreeSync 2 переименовали в более элитное FreeSync Premium Pro, а обычный FreeSync для мониторов с частотой 120 Гц и выше стали называть FreeSync Premium. Хотя такие маркетинговые финты я не одобряю, но в остальном сплошной респект AMD за популяризацию стандарта.

Кстати, NVIDIA также в 2017 году добавила поддержку HDR и назвала это всё G-Sync Ultimate.

И вроде бы всё классно, в команде у красных и у зеленых есть по своей шикарной технологии. Но что делать, если у тебя видеокарта от NVIDIA, ты хочешь нормальную поддержку G-Sync, но покупать дорогущий монитор с этой технологией совсем не хочется? Или наоборот — не покупать же Radeon только потому что у тебя монитор с FreeSync?

До недавнего времени выбора не было никакого. Хочешь подешевле и побольше выбор мониторов - покупай Radeon. В другом случае, придется раскошелиться.

G-Sync Compatible

Но в 2019 году NVIDIA пошли навстречу покупателям и добавили поддержку стандарта VESA Adaptive Sync в драйвера для своих видеокарт серии RTX, а также для карточки GTX 1080. А значит теперь можно легко насладиться лучшим из двух миров: взять себе карточку от NVIDIA и монитор с FreeSync по вкусу. Вот только есть проблема. Если на FreeSync мониторе не написано G-Sync Compatible — значит он не был протестирован NVIDIA на совместимость и никаких гарантий, что всё будет работать нормально, вам никто не даёт. А NVIDIA тестирует далеко не все, и далеко не самые доступные модели.

Поэтому инициативу по тестированию в свои руки взяло интернет-сообщество. Они составили табличку с огромным списком протестированных пользователями мониторов.

С мониторами, кажется, разобрались. Но как быть, если хочется поиграть на большом экране телевизора через консоль или ПК. Будет ли работать адаптивная синхронизация? Спешу вас порадовать — будет! При условии что ваш ТВ оснащен портом HDMI версии 2.1, в который добавили технологию переменной частоты обновления VRR - Variable Refresh Rate.

Причём всё будет работать и с видеокартами от NVIDIA и с Radeon. Всё потому, что VRR — это та же самая технология VESA Adaptive Sync, но теперь она стала ещё и частью стандарта HDMI 2.1. Именно таким образом адаптивная синхронизация реализована в консолях нового поколения. А также, вы удивитесь, в Xbox One S и One X. Да, в коробки текущего поколения от Microsoft VRR завезли даже раньше, чем HDMI 2.1.

Итоги

Что, в итоге спустя 6 лет после своего появления, технология Adaptive Sync стала фактически отраслевым стандартом. Захватив видеокарты от AMD и NVIDIA, телевизоры и даже интегрированная графика от Intel в 11-м поколении процессоров теперь поддерживает эту технологию. А это значит, что в светлом будущем мы будем жить без единого разрыва, по крайней мере, вертикального!

Читайте также: