Как в vmware увеличить оперативную память

В третьей части мы посмотрим на то, как работает с оперативной памятью гипервизор, а также на техники, которые применяются для высвобождения памяти, когда её становится крайне мало.

Memory Sizing

Стоит внимательно подходить к вопросу выделения оперативной памяти виртуальной машине.

Рекомендуется выделять виртуальной машине достаточное количество оперативной памяти для работы системы и приложений и, одновременно, не стоит выделять значительно больше, чем требуется.

Нужно понимать, что чем больше памяти выделено машине – тем больше накладные расходы гипервиозра на обслуживание данной памяти (overhead). Даже если гипервизор сможет высвободить часть ресурсов из виртуальной машины, уменьшить оверхед уже не получится.

Memory Overcommit Techniques

ESXi использует 5 техник для оптимизации количества потребляемой ОЗУ, в случаях, если ее становится крайне мало.

Чем меньше свободной остается доступной памяти – тем более жесткие техники он начинает применять. Естественно, ни о какой высокой производительности тут не может идти и речи.

Page Sharing – в случае, если участки памяти двух виртуальных машин одинаковы, нет смысла держать два одинаковых участка и занимать двойное пространство ОЗУ, когда можно просто сослать обе машины на один участок памяти, а второй высвободить. До версии 6.0 Page Sharing работал между виртуальными машинами в рамках одного хоста, однако, с 6-й версии, по умолчанию данный метод применяется только внутри виртуальных машин в целях безопасности.

Ballooning – Модуль, который устанавливается в гостевую операционную систему вместе с пакетом VMware Tools, который может «подтолкнуть» гостевую ОС к высвобождению наименее важных страниц памяти.

Memory Compression – Тут все понятно из описания. Сжатие страниц памяти на хосте. Это, конечно, снижает скорость доступа к памяти, но все еще быстрее, чем использование swap файлов.

Swap to Host Cache – Включается своппинг на уровне хоста. Но в данном случае в кэш, если он, конечно, сконфигурирован. Swap to Host Cache позволяет выделить пространство на SSD, доступ к которому будет все еще быстрее, чем доступ к swap на обычном жестком диске.

Regular Host–Level Swapping – Когда нет свободной озу и заканчивается кэш, страницы памяти виртуальных машин начинают попадать в swap файл на хосте. Несложно догадаться, что это самая крайняя мера и до нее лучше не доводить. Доступ виртуальных машин к страницам памяти, располагаемым в swap файлах хоста будет очень медленным, по сравнению с доступом к страницам в оперативной памяти.

Несмотря на все вышеуказанные техники, которые позволяют выделить виртуальным машинам значительно большее количество ресурсов, чем есть на хосте, на котором они располагаются, до этого лучше не доводить.

Если имеется подозрение, что вышеуказанные техники начинают применяться к VM и это сказывается на ее производительности, следует проверить следующее:

- Проверить значения параметра Ballooning у виртуальной машины в меню Monitor – Performance – Advanced в разделе Memory. Нулевое значение данного параметра обычно говорит о том, что у хоста не наблюдается проблем с переподпиской (overcommitment) и ресурсов достаточно для облуживания виртуальной машины. Стоит помнить, что данный параметр имеется только у виртуальных машин с установленным Balloon Driver, который входит в пакет VMware Tools. Небольшое количество balloon memory не всегда говорит о наличии каких-либо проблем;

- Проверить раздел Utilization виртуальной машины. Отличные от нуля значения Swapped и Compressed могут говорить о нехватке памяти гипервизора. Обращение к данным участкам памяти будет замедленно, что скажется на производительности виртуальной машины;

- Стоит проверить активность использования файла подкачки в виртуальной машине. Это может говорить либо об активной процедуре балунинга, либо о недостаточном количестве памяти, выделенной виртуальной машине.

Memory Page Sharing

Как уже было сказано ранее, начиная с версии 6.0, Page sharing работает по умолчанию только в рамках виртуальной машины (intra-VM sharing). При необходимости, его можно включить между виртуальными машинами (inter-VM sharing), если у них выставлено одинаковое значение «salt».

В связи с большой распространенностью страниц памяти размером 2MB (large memory pages), которые не «шарятся», даже если параметр Page Sharing включен, использование дедупликации страниц будет иметь в большинстве случаев незначительный эффект.

В инсталляциях, где используется большое количество мелких страниц памяти (например, VDI, где используется больное количество однотипных машин), Page Sharing может оказаться полезным.

По умолчанию значение «salt» для виртуальной машины это ее uuid, который всегда уникален, что ограничивает Page Sharing рамками данной VM.

Для того, чтобы включить Page Sharing на всех виртуальных машинах хоста, необходимо выставить параметр Mem.ShareForceSalting в значение 0.

Либо, для включения Page Sharing между определенной группой виртуальных машин, можно использовать параметр sched.mem.pshare.salt в конфигурационном параметре VM.

Следует ознакомиться со статьями в базе знаний VMware (1 , 2 )

Memory Swapping Optimizations

Когда ESXi больше не может высвобождать память и оптимизировать ее использование в связи с высокой переподпиской, последней возможностью остается использование файлов подкачки на уровне хоста, что может сильно сказаться на производительности виртуальных машин.

Далее следуют рекомендации, как этого избежать, либо минимизировать негативный эффект:

- Не отключать Ballooning (не забывать устанавливать VMware Tools и следить за их работой в гостевой ОС), Page Sharing и Memory Compression;

- При включении виртуальной машины ESXi создает swap файл для данной VM, который равен размеру памяти машины за вычетом зарезервированной для нее ОЗУ. Следовательно, дисковых ресурсов на хранилище должно быть достаточно для размещения swap файлов машин;

- Если на хосте имеется SSD диск, не будет лишним задействовать его под кэш (Swatp to the Host Cache). Этот кэш доступен всем виртуальным машинам, располагаемым на хосте. Хороший вариант для SSD небольших размеров;

- Хорошим выбором будет размещение swap файлов виртуальных машин на самых скоростных доступных дисках. Лучший выбор – локальный для хоста SSD. Если объема SSD недостаточно для хранения swap файлов машин, лучше его задействовать под Host Cache;

- Если локальных SSD нет, следует размещать файлы на наиболее быстром доступном хранилище, подключенном, например, по Fibre Channel. К примеру, All-Flash массив;

- Независимо от типа используемого хранилища для лучшей производительности и избегания потенциальной ситуации, связанной с нехваткой доступного дискового пространства, не следует размещать файлы подкачки на thin-provisioned хранилище.

По умолчанию swap файл создается там же, где хранится vmx файл виртуальной машины, изменить данный параметр можно в Advanced секции настроек VM.

Уменьшить объем памяти, которая может оказаться в файле подкачки, либо вообще от него избавиться, можно, зарезервировав объем оперативной памяти для виртуальной машины.

Хорошая идея – зарезервировать для виртуальной машины тот объем памяти, с которым она регулярно работает.

В случае, если резерв выставлен во время работы виртуальной машины, эффект от резервирования появится не сразу и будет появляться постепенно. Для мгновенного эффекта стоит выключить и включить виртуальную машину (не перезагрузить из операционной системы, а именно выключить – включить).

Memory Overhead

Стоит понимать, что при использовании системы виртуализации, будут так же появляться и небольшие накладные расходы. Некоторое количество ОЗУ необходимо гипервизору и его службам, а часть ОЗУ для работы виртуальных машин. В целом дополнительно потребляемую память можно поделить на две категории:

- Как уже было сказано часть памяти используется непосредственно гипервизором и его службами (hostd, vpxa и т.п.). ESXi может использовать системный swap файл и уменьшить потребление ОЗУ до 1GB, в ситуациях когда памяти перестает хватать для работы виртуальных машин. Для использования данной возможности необходимо создать swap файл самостоятельно. esxcli sched swap system set -d true -n . Создается файл объемом 1GB на указанном хранилище;

- Дополнительная память используется для каждой запущенной виртуальной машины. Часть памяти резервируется для VMX процесса, часть для процесса VMM. Память резервируется также для виртуальных устройств (мышь, клавиатура, USB). Объем резервируемой оперативной памяти зависит от многих факторов, например, от количества vCPU, сконфигурированного объема памяти, 32-bit или 64-bit гостевая операционная система и т.п.

2MB Large Memory Pages

В дополнение к стандартным размерам страниц памяти в 4KB, ESXi так же может работать со страницами размером в 2MB (Large Pages).

ESXi назначает 2MB страницы гостевой ОС всегда, когда это возможно, даже если гостевая ОС их не запрашивает. Использование Large Pages снижает значения TLB miss, увеличивает производительность многих приложений, особенно, активно работающих с большими объемами памяти, так же уменьшаются служебные затраты ОЗУ на виртуальную машину.

ESXi не использует Page Sharing с большими страницами (скорее всего потому что найти пару двух одинаковых страниц достаточно тяжело). Однако, в случае нехватки оперативной памяти на хосте, большие страницы начинают дробиться на мелкие (4KB), задействуя при этом механизм Page Sharing.

На этом третья часть осмысления заканчивается. В следующей части рассмотрим советы, касающиеся работы с подсистемой хранения.

Бывают ситуации когда ваша виртуальная машина испытывает сложно в плане нагрузки и ей не хватает ресурсов, в ESXI 5.x.x есть возможность добавления ресурсов на живую. Откройте настройки виртуальной машины через edit settings и перейдите на нужную для вас вкладку того что вы хотите добавить, например это память. Но какого же будет ваше удивление, что на работающей машине увеличение не активно, дело в том что нужная функция просто не активна, давайте это исправим.

Как увеличить размер памяти и количество процессоров (ядер) на работающей виртуальной машине в ESXI 5.x.x-01

Выключаем виртуалку. Идете в свойства виртуалки.

Как увеличить размер памяти и количество процессоров (ядер) на работающей виртуальной машине в ESXI 5.x.x-02

Идем на вкладку options-Memory/CPU hotplug и включаем справа наEnable

Как увеличить размер памяти и количество процессоров (ядер) на работающей виртуальной машине в ESXI 5.x.x-03

Жмем ОК. Включаем виртуалку и заходим сразу в свойства и видим, что для памяти и процессоров все стало активно.

Как увеличить размер памяти и количество процессоров (ядер) на работающей виртуальной машине в ESXI 5.x.x-04

Как увеличить размер памяти и количество процессоров (ядер) на работающей виртуальной машине в ESXI 5.x.x-05

Система VMware позволяет пользователям задавать как объем оперативной памяти, выделяемой каждому виртуальному компьютеру, так и общее количество ОП, зарезервированное для использования виртуальными машинами. Правильная настройка этих параметров очень важна, поскольку может существенно повлиять на производительность как виртуального компьютера, так и системы в целом.

Первый конфигурационный параметр, значение которого может устанавливаться пользователем, - это общее количество памяти, которое резервируется для всех запущенных виртуальных машин. Этот параметр может быть задан перемещением движка в окне, вызываемом через команду Host Reserved Memory в меню Settings.

В общем случае память, используемая каждой виртуальной машиной, берется из того же самого пула памяти, который используется ОС на базовом компьютере и всеми запущенными на нем приложениями. Однако, для повышения общей производительности, система VMware устанавливает задаваемый пользователем лимит памяти для всех виртуальных машин. Когда VMware использует эту память, она недоступна для других приложений, запущенных на базовом компьютере. Но когда VMware не использует эту память, она становится доступной для других приложений. Резервируя память, VMware позволяет виртуальным машинам работать более эффективно.

Память, используемая системой VMware, включает память, отдаваемую операционной системе виртуального компьютера, а также некоторое количество избыточной памяти, необходимой для функционирования самого виртуального компьютера. Объем этой избыточной памяти зависит от нескольких факторов, но обычно не превышает 10 мегабайт. Кроме того, для нормального функционирования ОС виртуальной машины, надо зарезервировать достаточное для этой ОС количество памяти.

Количество реально резервируемой системой VMware оперативной памяти динамически меняется в процессе работы системы. VMware использует зарезервированную память только тогда, когда определяет, что это необходимо для достижения приемлемой производительности виртуального компьютера. Даже если запущены несколько ВМ, реально может использоваться только часть зарезервированной памяти, а неиспользуемая зарезервированная память отдается ОС базового компьютера и запущенным в ней приложениям.

Рекомендуется резервировать для системы VMware 50% физической памяти базового компьютера. Отходить от этого правила могут только опытные пользователи, поскольку изменение этого параметра может существенно повлиять на производительность как базового, так и виртуального компьютера. Если выбрать слишком большое значение этого параметра, это может привести к сильному замедлению работы базового компьютера или даже к его зависанию. Слишком малое значение этого параметра приводит к падению производительности виртуального компьютера и ограничивает число ВМ, которые могут быть одновременно запущены.

Linux плохо ведет себя при нехватке оперативной памяти. По этой причине не стоит запускать одну или несколько виртуальных машин, если им требуется больше ОП, чем остается на базовом компьютере после запуска ОС и других приложений. Точнее, надо придерживаться следующего правила: "Общее количество оперативной памяти, выделяемой для всех одновременно запущенных виртуальных машин, не может превышать количества физической ОП минус объем памяти, которая необходима для работы ОС базового компьютера и запущенных в ней приложений".

Впрочем, система VMware сама ограничивает количество ВМ, которые могут быть одновременно запущены, исходя из количества зарезервированной для нее ОП. Если вы пытаетесь включить питание виртуальной машины, а количества зарезервированной ОП для ее работы недостаточно, включения ВМ не произойдет.

Второй конфигурационный параметр, который могут изменять пользователи системы VMware, - это объем физической оперативной памяти, выделяемый данной виртуальной машине. Значение этого параметра задается в Редакторе конфигурации (Settings › Configuration Editor › Memory). Минимальное значение этого параметра определяется требованиями ОС. Мастер конфигурации вообще не запрашивает у пользователя значение этого параметра, выбирая его исходя из того, какую ОС выбрал пользователь.

Оптимальное значение размера памяти, отводимой виртуальному компьютеру, зависит от нескольких факторов.

• Какие приложения будут запускаться на виртуальной машине.

• Будут ли другие виртуальные машины, запущенные наряду с данной ВМ, конкурировать с ней за разделение оперативной памяти.

• Какие приложения будут запускаться на базовом компьютере одновременно с данной виртуальной машиной.

3.2. Выделение памяти

3.2. Выделение памяти Четыре библиотечные функции образуют основу управления динамической памятью С Мы опишем сначала их, затем последуют описания двух системных вызовов, поверх которых построены эти библиотечные функции. Библиотечные функции С, в свою очередь, обычно

Статическое выделение памяти в стеке

Статическое выделение памяти в стеке В пространстве пользователя многие операции выделения памяти, в частности некоторые рассмотренные ранее примеры, могут быть выполнены с использованием стека, потому что априори известен размер выделяемой области памяти. В

Выделение памяти, связанной с определенным процессором

Выделение памяти, связанной с определенным процессором В современных операционных системах широко используются данные, связанные с определенными процессорами (per-CPU data). Это данные, которые являются уникальными для каждого процессора. Данные, связанные с процессорами,

Выделение дескриптора памяти

Выделение дескриптора памяти Указатель на дескриптор памяти, выделенный для какой-либо задачи, хранится в поле mm дескриптора процесса этой задачи. Следовательно, выражение current->mm позволяет получить дескриптор памяти текущего процесса. Функция copy_mm() используется для

Выделение памяти

Выделение памяти При обсуждении формата исполняемых файлов и образа программы в памяти мы отметили, что сегменты данных и стека могут изменять свои размеры. Если для стека операцию выделения памяти операционная система производит автоматически, то приложение имеет

1.5.10. У меня больше оперативной памяти!

1.5.10. У меня больше оперативной памяти! Иногда Linux не может точно определить объем оперативной памяти. Например, у вас установлено 128 Мбайт, а Linux видит только 64. Для исправления этого в файл /etc/lilo.conf допишите строку:append="mem=128M"Для того, чтобы изменения вступили в силу, введите

Количество оперативной памяти, используемой файловой системой

Количество оперативной памяти, используемой файловой системой При работе компьютера файловая система Windows XP резервирует определенный размер оперативной памяти для операций I/O (операций чтения/записи). Чем больше будет размер резервируемой памяти, тем быстрее будут

Выделение памяти

Выделение памяти Сначала следует определить место для размещения строки при вводе. Как было отмечено раньше, это значит, выделить память, достаточную для размещения любых строк, которые мы предполагаем читать. Не следует надеяться, что компьютер подсчитает длину

5.1.3. Выделение сегментов памяти

5.1.3. Выделение сегментов памяти Процесс выделяет сегмент памяти с помощью функции shmget(). Первым аргументом функции является целочисленный ключ, идентифицирующий создаваемый сегмент. Если несвязанные процессы хотят получить доступ к одному и тому же сегменту, они должны

2.2. Динамическое выделение памяти и указатели

2.2. Динамическое выделение памяти и указатели Прежде чем углубиться в объектно-ориентированную разработку, нам придется сделать небольшое отступление о работе с памятью в программе на С++. Мы не сможем написать сколько-нибудь сложную программу, не умея выделять память

Установка оперативной памяти

Установка оперативной памяти Как мы говорили в главе 4, неправильно вставить модуль оперативной памяти в предназначенный для этого слот, в общем-то, непросто. А не даст вам это сделать система ключей-выемок на модулях и слотах. Так что если модуль памяти не хочет входить в

3.2. Установка процессора и оперативной памяти

3.2. Установка процессора и оперативной памяти Сборка компьютера начинается с установки процессора и оперативной памяти, так как пока материнская плата не присоединена к корпусу, вы имеете свободный доступ к ее

Установка оперативной памяти

Установка оперативной памяти Установить модули оперативной памяти просто.Главное – правильно расположить модуль относительно слота (рис. 3.3). Рис. 3.3. Правильное расположение модуля относительно имеющихся ключейСделать это просто, так как и на планке памяти, и на слоте

Проблемы с оперативной памятью. Тестирование оперативной памяти

Проблемы с оперативной памятью. Тестирование оперативной памяти Наиболее вероятная причина зависания программ (если исключить «глюки» самих программ и Windows) – это оперативная память. Или один из модулей оперативной памяти «битый», или же просто не хватает оперативной

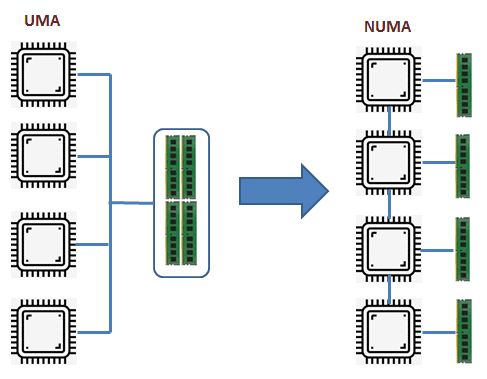

Современные серверные решения на базе архитектуры x86, которые сейчас используются почти во всех программно-аппаратных комплексах, имеют некоторые нюансы. Многопроцессорные сервера, имеющие на материнской плате 2, 4 или даже 8 процессорных сокетов, являются по сути NUMA-архитектурой. NUMA (Non-Uniform Memory Architecture) означает, что каждый процессорный сокет имеет свой пул локальных модулей оперативной памяти и такая связка называется узлом NUMA (рис. 1).

|

| Рис. 1. UMA и NUMA архитектуры. |

Все процессорные ядра и вся оперативная память объединены в одну систему, но обращение процессора к своим (локальным) модулям памяти происходит с большей скоростью (или меньшими задержками), чем к памяти соседнего процессора.

Все современные операционные системы и программные решения более высокого уровня (например, виртуальный гипервизор или СУБД) понимают особенности этой архитектуры. В идеале, это понимание позволяет большинство операций выполнять с памятью локального процессора, не ходя в "дальние края" за памятью соседа.

vSphere от VMware тоже прекрасно разбирается в NUMA. При конфигурировании виртуальной машины (если вы не активируете опцию "Enable CPU Hot Add") и при её работе гипервизор будет размещать виртуальные процессорные ядра (vCPU) и память виртуальной машины в один узел NUMA. Причём, эта функция работает по умолчанию, ничего отдельно настраивать не надо.

Это всё прекрасно работает для небольших виртуальных машин, которые занимают гораздо меньше памяти, чем имеется в одном узле NUMA. Для работы большого количества таких относительно небольших виртуальных машин на одном сервере решения виртуализации и были прежде всего разработаны. Но у нас немного другой профиль - SAP системы, которые обычно требуют много ресурсов процессора и памяти.

Хочу на своём примере показать недостаточно корректную настройку размера виртуальных машин, с учётом NUMA архитектуры. На проекте, про который хочу рассказать, были сервера двух типов:

- 4-х сокетный сервер (8 ядер/16 потоков в каждом процессоре) и 384 Гб оперативной памяти,

- 2-х сокетный сервер (8 ядер/16 потоков в каждом процессоре) и 256 Гб оперативной памяти.

Понимая, всю ситуацию с NUMA архитектурой я разместил на серверах первого типа виртуальные машины с характеристиками:

- 16 vCPU + 192 Гб памяти,

- 8 vCPU + 96 Гб памяти.

При конфигурировании такой системы я был очень доволен - ведь я точно попал в узлы NUMA. Большая машина идеально вписывается в 2 узла NUMA. А те, что поменьше идеально вписаны в один узел NUMA, как на первых серверах, так и на вторых.

Но после прокачки своих знаний по VMware, мне открылось, что я совершил ошибку при конфигурации объёмов памяти.

Для мониторинга работы виртуальных машин на узлах ESXi есть команда esxtop (аналог команды top в Linux) (рис. 2). Так вот, для мониторинга работы с памятью и NUMA диагностики, необходимо запустить команду esxtop , нажать "m", перейдя в мониторинг памяти. После этого нажать "f" и добавить к формату вывод статистику по NUMA (рис. 3).

|

| Рис. 2. Основной экран утилиты esxtop. |

|

| Рис. 3. Активация просмотра статистики по NUMA узлам. |

После этого на экране появится несколько важных полей:

- NHN - текущий домашний узел для виртуальной машины,

- NMIG - количество NUMA миграций с узла на узел,

- NRMEM (MB) - текущее количество "дальней памяти" (из соседней NUMA), используемой виртуальной машиной,

- NLMEM (MB) - текущее количество локальной памяти, используемой виртуальной машиной,

- N%L - текущий процент запрошенной виртуальной машиной памяти, являющейся локальной.

Последний параметр помогает проанализировать итог работы виртуальной машины на NUMA узлах. Если он равен 100%, значит производительность оптимальна. Если же ниже 100%, значит не всегда в процессе работы на реальных процессорных ядрах для текущей виртуальной машины идёт попадание в память локального узла NUMA.

По моей ситуации. Первые две большие виртуальные машины не всегда попадают в память локального NUMA узла (рис. 4 и 5). Напомню, что обе машины работают на серверах с размером узла NUMA = 16 ядер (с учётом HT) + 96 Гб.

|

| Рис. 4. Статистика по NUMA виртуальной машины 8 vCPU + 96 Гб. |

|

| Рис. 5. Статистика по NUMA виртуальной машины 16 vCPU + 192 Гб. |

Процент попадания в локальный NUMA узел 93% и 92% соответственно. Причём, если посмотреть по другим параметрам статистики: виртуальной машине при работе не хватает всего 6-7 Гб памяти на локальном узле.

"Небольшие" виртуальные машины, работающие на серверах второго типа (с размером узла NUMA = 16 ядер (с учётом HT) + 128 Гб памяти), отлично умещаются в локальных NUMA узлах (рис. 6). Забора "чужой" памяти нет, всё работает оптимально.

|

| Рис. 6. Статистика по NUMA виртуальной машины, работающей на сервере второго типа. |

Моя ошибка при конфигурировании размера оперативной памяти больших виртуальных машин в данном случае была в том, что я не учёл накладные расходы гипервизора. Точнее я решил, что накладные расходы общие на весь сервер. А оказалось, что надо учитывать их на каждый узел NUMA. И более оптимально было бы взять не всю память NUMA узла для виртуальной машины, а максимум 90%. Оставив 10% на накладные расходы гипервизора и инфраструктуры VMware.

Максим Мошков рекомендует пользоваться правилом при конфигурировании любых ресурсов в среде VMware - 80% ресурсов можно использовать, а 20% всегда оставлять на запас, накладные расходы и тому подобное.

Если у меня будет возможность, то я переконфигурирую данные виртуальные машины, которые не оптимально попадают в узлы NUMA. И потом поделюсь с вами результатами статистики.

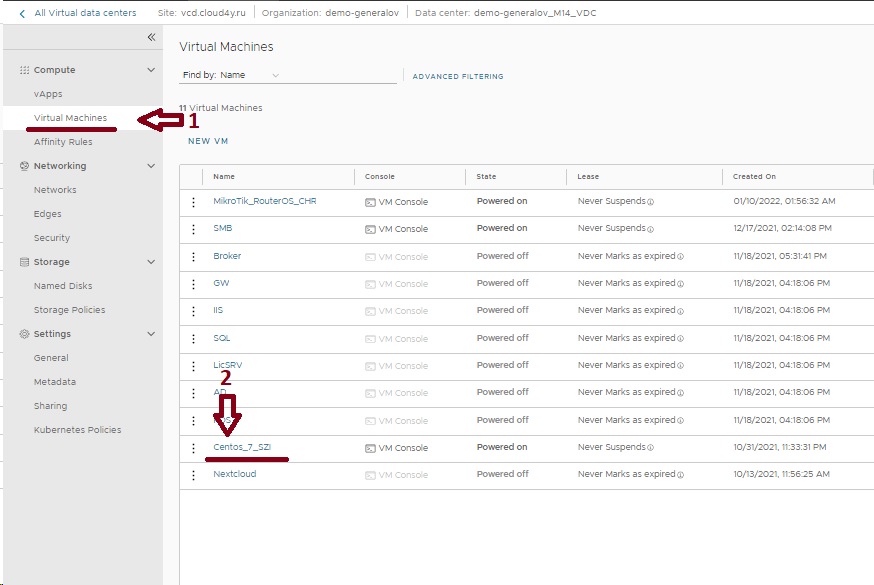

Для того, чтобы увеличить/уменьшить количество ресурсов выделяемых виртуальной машине, ее необходимо выключить.

Для этого перейдите в раздел "Virtual Machines" (1), выберите интересующую вас виртуальную машину и щелкните по ее названию курсором мыши (2).

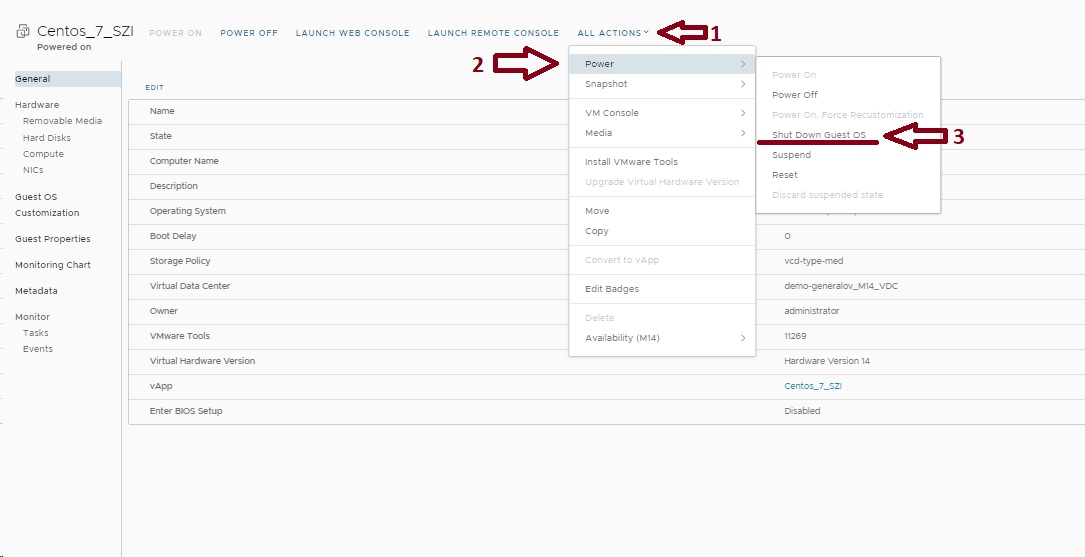

Наведите курсор на гиперссылку "ALL ACTIONS" (1), переместите курсор на раздел "Power" (2), кликните мышью на гиперссылку "Shutdown Guest OS" (3) для корректного завершения работы ос и остановки сервисов внутри вм.

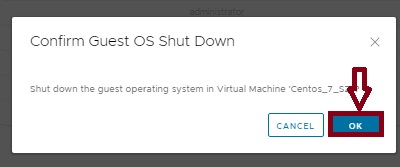

Нажмите "ОК" для подтверждения выключения виртуальной машины.

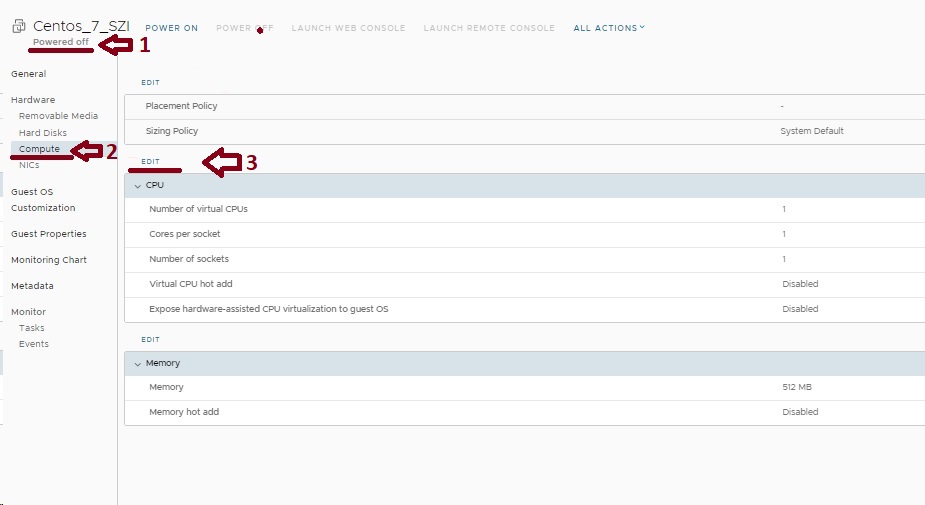

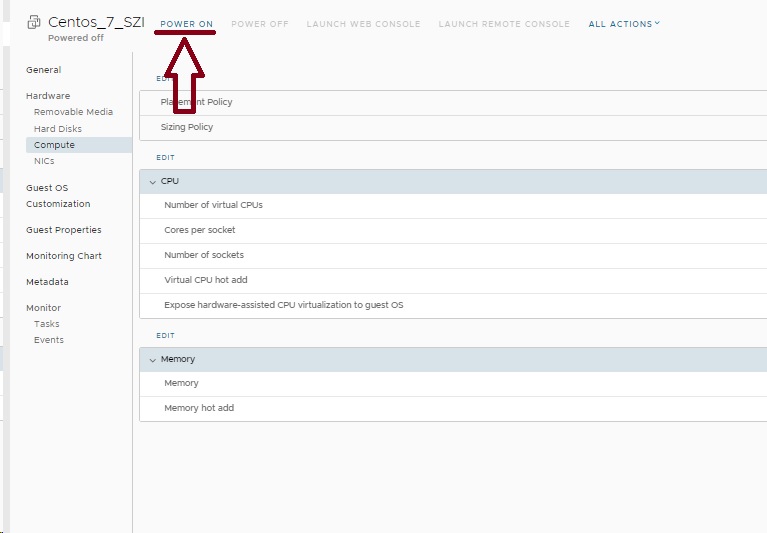

Дождитесь полного выклчения вм (1 - в статусе вм будет написано "Powered off"), щелкните по гиперссылке Compute (2), над разделом CPU выберите "EDIT" (3).

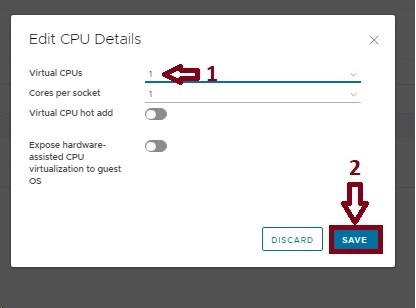

Задайте необходимое количество процессоров (1), для приминения нажмите "SAVE" (2).

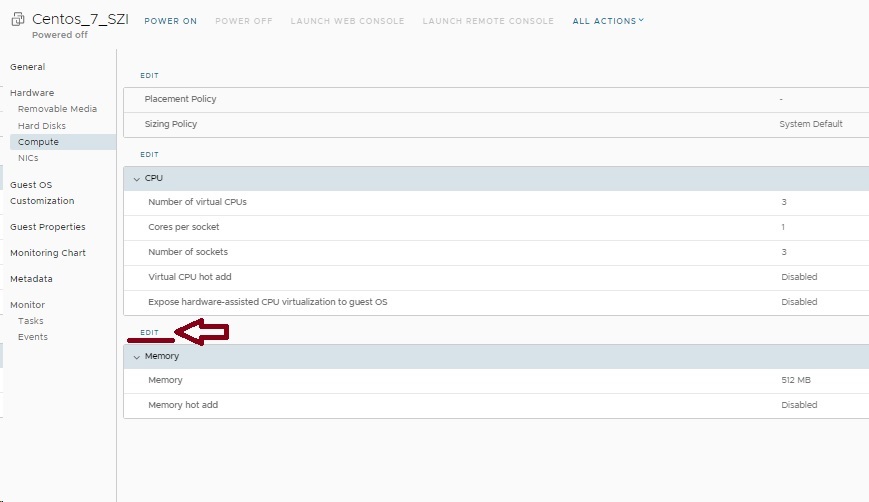

Для увеличения количества RAM, над разделом Memory нажмите "EDIT".

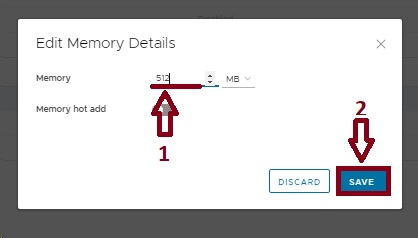

Укажите необходимое количество RAM (1) и нажминте "SAVE" (2) для применения.

После увеличения ресурсов, запустите вм, кликнув курсором мыши по гиперссылке "POWER ON"

- CPU, RAM, ЦПУ, РАМ, Память, ЦП, Добавить

- 43 Пользователи нашли это полезным

Связанные статьи

Для того, чтоб добавить новую существующую сеть в существующий vAPP, необходимо перейти в сам.

Виртуальная машина может быть включена (Powered On), выключена (Powered Off) и приостановлена.

Сетевые адаптеры При создании ВМ у вас есть возможность выбрать разные адаптеры: E1000E.

VMware Tools - это набор утилит, который повышает производительность гостевой операционной.

Периодически мы информируем своих клиентов о созданных у них снапшотах. Чтобы не получать.

Читайте также: