Как разогнать видеокарту gtx 570

Для сравнения уровня производительности были использованы результаты тестов GeForce GTX 580 и Radeon HD 5870, полученные на другом тестовом стенде (далее обозначен как стенд №2) в ходе работы над предыдущим материалом. Настройки CPU (множитель, BCLK) и оперативной памяти (частота, задержки) сохранены. Результаты тестов GeForce GTX 480 были перепроверены и уточнены на основном стенде (стенд №1), так как эта видеокарта была доступна автору на момент написания материала и сравнение с ней представляется особенно важным. Итоговая разница в производительности между двумя вариантами стенда лежит в пределах погрешности измерений (не более 1-2%), что делает сравнение полученных данных правомерным.

Конфигурация тестового стенда №1:

Конфигурация тестового стенда №2:

Программное обеспечение:

- Windows 7 Ultimate x64;

- NVIDIA display driver v. 262.99 для видеокарты GeForce GTX 580;

- NVIDIA display driver v. 263.09 для видеокарты GeForce GTX 570;

- NVIDIA display driver v. 260.99 для видеокарты GeForce GTX 480;

- ATI Catalyst v. 10.10 для видеокарты Radeon HD 5870.

реклама

Для разгона видеокарт, а также мониторинга температур и оборотов вентилятора использовалась утилита MSI Afterburner 2.1.0 Beta 4. На момент написания статьи эта версия была самой последней. Для регулировки напряжения питания GPU применялась утилита NVIDIA Inspector v. 1.9.4.2.

Скриншоты, иллюстрирующие режим работы видеокарт, сняты при помощи утилиты GPU-Z v. 0.4.8.

Для прогрева и проверки стабильности работы видеокарт в процессе разгона использовались утилиты OCCT GPUw (режим Error Check, 1024 x 768) и FurMark (Stability Test, Extreme burning mode, 1920 х 1200, AA0). Полученные частоты дополнительно проверялись прогонами теста Heaven Benchmark v 2.1 c экстремальным уровнем тесселяции и графических тестов из пакетов 3DMark 06 и 3DMark Vantage.

Для проверки температурного режима видеокарт в условиях, приближенных к повседневным, использовался Heaven BenchMark v. 2.1 (shader: high, tessellation: normal, AA4x, 1920 х 1200).

Производительность в игре Crysis Warhead исследовалась с помощью утилиты Framebuffer Benchmarking Tool. В играх Lost Planet 2 и Tom Clancy’s H.A.W.X. II было проведено дополнительное тестирование с помощью утилиты FRAPS v. 3.2.3 для выявления минимального FPS. Остальные игры тестировались с помощью встроенных средств оценки производительности. Во всех случаях была отключена вертикальная синхронизация.

Уровень шума измерялся при помощи цифрового шумомера Becool ВС-8922 с погрешностью измерений не более 0,5 дБ. Измерения проводились с расстояния 1 м. Уровень фонового шума в помещении – не более 27 дБ. Температура воздуха в помещении составляла 22-23 градуса.

Исследование новых образцов «железа» до официального релиза – дело увлекательное. К сожалению, этот процесс очень часто осложняется отсутствием необходимого программного обеспечения. Так вышло и на этот раз.

GPU-z «догадывается» о существовании GeForce GTX 570, но не может корректно отобразить все необходимые данные.

реклама

Используемая для разгона видеокарт утилита MSI Afterburner правильно распознает новую видеокарту и позволяет регулировать частоты, но ничем не может помочь в отслеживании и настройке напряжения питания GPU.

Это странно, если принять во внимание практически идентичную конструкцию исследуемого ускорителя и GeForce GTX 580, с которым Afterburner работает без проблем.

Ограничиваться стандартной отпиской «нормально провести разгон не удалось из-за невозможности управления напряжением» мне не хотелось. Перебрав несколько менее популярных (или устаревших) утилит для разгона видеокарт, автор обнаружил, что самая последняя версия NVIDIA Inspector поддерживает GTX 570. Более того, эта утилита позволяет регулировать «вольтаж», что является необходимым условием для проведения полноценного исследования разгонного потенциала. В дальнейшем оверклокинг проводился именно с использованием этой программы.

Провести подробное исследование работы подсистемы питания (как в обзоре GTX 580) не удалось; NVIDIA Inspector умеет регулировать напряжение, но совершенно не умеет его отслеживать. GPU-z в этом деле тоже не помощник, в строке VDDC всегда отображалось то значение, которое было выставлено вручную. Если учесть, что подсистема питания GeForce GTX 580 постоянно подстраивает «вольтаж», то эта особенность должна наблюдаться и на GTX 570. Было бы интересно выявить различия в алгоритмах работы системы.

По данным NVIDIA Inspector базовое значение напряжения питания GPU составляет 1,013 В (очевидно, это напряжение в 3D-режиме, насколько оно сбрасывается в 2D, отследить не удалось). Разгон видеокарты при использовании автоматической регулировки оборотов турбины дал неплохие результаты.

Штатного «вольтажа» хватило, чтобы поднять частоту ядра до 790 МГц. На отметке 800 МГц графический процессор работает стабильно в большинстве тестов, но длительная проверка в Heaven Benchmark с экстремальным уровнем тесселяции приводит к зависанию системы. Разгон ядра на 8% при таком низком напряжении является хорошим показателем. Если принять во внимание чуть более низкое тепловыделение ядра GTX 570, то можно ожидать, что младшей видеокарте удастся превзойти флагманскую модель, которая в прошлый раз взяла частоту 900 МГц со штатной СО (вот так каламбур).

Дальнейшие эксперименты по разгону показали, что при напряжении питания 1,063 В (+0,05 В к номиналу) ядро может функционировать на частоте 850-855 МГц. Еще один «шажок» - 1,075 В позволил закрепиться на отметке 865 МГц. Хорошее начало, но тут подкачал NVIDIA Inspector. У этой утилиты просто-напросто «закончилась шкала». Максимальное значение напряжения составляет 1,1 В. При таком «вольтаже» была получена частота 880 МГц. При дальнейшей проверке наблюдались незначительные проявления нестабильности, которые исчезли при частоте 875 МГц.

Мне очень хотелось получить 900 МГц, чтобы организовать прямое сравнение производительности GTX 570 и GTX 580, но сделать этого не удалось. Виной тому могла быть нехватка напряжения, неудачность конкретного экземпляра видеокарты или некие изменения в алгоритме работы подсистемы питания, которые пока не получается отследить программно. Также существует вероятность, что для GTX 570 отбираются менее удачные экземпляры процессора GF110 или ухудшение разгонного потенциала вызвано упрощением конструкции преобразователя питания GPU.

Отмечу, что ограничение по напряжению не слишком-то испортило итоговый результат разгона. Запас по температуре оставался совсем небольшой, дальнейший оверклокинг был бы возможен только при значительном повышении уровня шума. Может быть, полученная частота является для GTX 570 абсолютно нормальной. Этот вопрос прояснится, после того, как GTX 570 появится в продаже, и значительное количество этих видеокарт будет исследовано владельцами.

реклама

Можно посмотреть на достигнутый результат и с другой стороны. Догнать GTX 580 по частоте не удалось, но в процентном отношении разгон получился даже более значительным. Результат GeForce GTX 580 (772 -> 900 МГц) - это 16,6%, в то время как младшая модель «разогналась» на 19,5% (732 -> 875 МГц).

Важно и то, что новый ускоритель по частотному потенциалу значительно превосходит GeForce GTX 480. Это здорово повышает шансы GTX 570 обойти предыдущего флагмана по всем статьям. Единственное, что может помешать – нехватка полосы пропускания видеопамяти. Эксперименты по разгону микросхем Samsung показали, что их частотный потенциал на тестируемом ускорителе ограничен отметкой 1115 (4460 МГц). На GeForce GTX 580 был достигнут более солидный результат 1200 (4800) МГц. Видимо, конструкторы опять «поколдовали» с напряжением питания памяти, либо в лабораторию попал совсем уж неудачный экземпляр GTX 570.

Разгон памяти позволил увеличить пропускную способность до 178,4 Гбайт/c. Следовательно, по этому параметру удалось догнать GeForce GTX 480 (177,4 Гбайт/c) на стандартных частотах. После разгона бывший флагман может легко оторваться от GeForce GTX 570 из-за большей разрядности шины; и уж совсем далеко по этому показателю уходит GeForce GTX 580 (192 Гбайт/c на штатной частоте, до 220 Гбайт/c после разгона).

Подведу итог раздела. Разгонный потенциал GeForce GTX 570 оказался лучше, чем у старшей модели GeForce GTX 580 в процентном отношении, но по частотам догнать флагманскую видеокарту так и не удалось. В сравнении с GeForce GTX 480 новинка демонстрирует лучшие способности к оверклокингу без всяких оговорок.

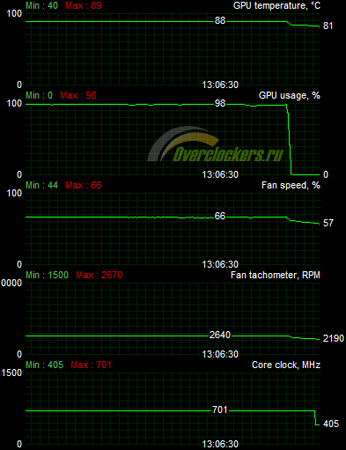

Как всегда открывает тестирование «бублик» - Furmark v. 2.1. Как известно, инженеры NVIDIA посчитали нагрузку, создаваемую этим приложением, чрезмерной, и ввели принудительное ограничение по частоте. Вкупе с работой микросхем подстройки, сбрасывающих напряжение при высокой загрузке GPU, это привело к тому, что старина «бублик» совсем перестал подходить для прогрева видеокарт GTX 580.

Результат GeForce GTX 580 на штатных частотах:

Тот же тест, GeForce GTX 570:

Удивительно, но новая видеокарта прогревается гораздо сильнее даже с учетом возросших оборотов турбины. Возможно, алгоритм сброса частоты был смягчен, либо микросхемы подстройки не так сильно «срезают» напряжение из-за меньшего энергопотребления видеокарты. Это интересное различие, но гораздо важнее сравнить поведение видеокарт в условиях, приближенных к повседневным.

В качестве универсального 3D-теста, не создающего избыточно высокой нагрузки на GPU, применяется Heaven Benchmark. Программисты Unigine реализовали в своем бенчмарке поддержку самых современных технологий компьютерной графики, а значит, он способен загрузить работой максимальное количество блоков ядра.

Результаты теста GeForce GTX 570:

GTX 580 в том же режиме:

Здесь все «как положено», меньшее количество активных блоков GPU и сниженная частота позволяют GeForce GTX 570 продемонстрировать лучшие показатели температуры. Разрыв невелик – всего 3 градуса, но младшая видеокарта вдобавок работает значительно тише: 37,2 дБ против 42 дБ. Эта разница легко различима на слух. Обращаю ваше внимание, что при равном процентном показателе турбина на GTX 570 будет вращаться чуть медленнее, чем на GTX 580. Видимо в BIOS видеокарты «прописан» измененный алгоритм управления.

На фоне старого флагмана компании – GeForce GTX 480, новинка и вовсе выглядит «тихой и холодной».

График GeForce GTX 480 для того же теста:

В этом случае GeForce GTX 570 выигрывает 6 градусов, и это при снижении уровня шума с 44 до 37,2 дБ! Поясню - там, где GeForce GTX 480 начинает надсадно гудеть, GTX 570 только тихо «шипит».

Осталось проверить, будет ли так хороша СО после разгона видеокарты с повышением напряжения.

Частота GPU - 875 МГц, видеопамяти - 1115 (4460) МГц, «игровой» тест:

По сравнению со штатным режимом температура выросла всего на 3 градуса, обороты турбины увеличились на 5%. Уровень шума составил 41,7 дБ. Таким образом, разогнанная GeForce GTX 570 почти точно повторила результат GTX 580 на штатных частотах. Шум при работе ускорителя практически не досаждает, по крайней мере, если речь идет об использовании в составе «игрового ПК». Видеокарту отчетливо слышно на фоне других компонентов стенда, но все равно она работает значительно тише GeForce GTX 480.

В простое температура ядра снижается до 33-34 градусов, но может возрастать до 36-37 при просмотре видеороликов или активном использовании интерфейса Aero.

По итогам раздела можно констатировать, что GeForce GTX 570 демонстрирует превосходство над GTX 580 (и тем более GTX 480) по шумовым и температурным характеристикам. Даже разогнанная видеокарта остается более холодной и тихой, чем любой из флагманов на штатных частотах.

Подпишитесь на наш канал в Яндекс.Дзен или telegram-канал @overclockers_news - это удобные способы следить за новыми материалами на сайте. С картинками, расширенными описаниями и без рекламы.

Привет всем, захотелось разогнать свою Asus GTX 570 Direct Cu II, только вот не определился с частотой ядра, памяти и шейдеров. Кто обладает 570 печью, прошу поделиться своими показателями. И еще, как разблокировать настройку вольтажа на ядро и стоит ли это делать?

P.s.: разгон нужен для повседневной работы и стабильной игры, т.е заоблачные частоты мне не нужны.

eminem23

MSIAfterburber 2.2.0 beta 9 и 10 умеют управлять питанием на Direct CU

На счет разгона,эта лоторея,у меня 850/2100/1.038v или 900/2000/1.062v

На такой карте можно смело поднять питание.

p.s. Разгон памяти,мало что дает.

850-875 МГц по ядру вполне достаточно для повседневного использования, напряжение нужно подбирать, но ориентировочно где-то 1.038в. Вентиляторы СО можно оставить в положении авторегулировки - она работает довольно корректно на данной видеокарте - и тихо, и температуры не самые высокие.

eminem23: Привет всем, захотелось разогнать свою Asus GTX 570 Direct Cu II, только вот не определился с частотой ядра, памяти и шейдеров. Кто обладает 570 печью, прошу поделиться своими показателями. И еще, как разблокировать настройку вольтажа на ядро и стоит ли это делать?

P.s.: разгон нужен для повседневной работы и стабильной игры, т.е заоблачные частоты мне не нужны.

bani

Спасибо, только я не могу понять "850/2100/1.038v"- 2100 это шейдеры?

snegurrrka

А шейдеры и память на сколько посоветуешь выставить?

eminem23: bani

Спасибо, только я не могу понять "850/2100/1.038v"- 2100 это шейдеры?

snegurrrka

А шейдеры и память на сколько посоветуешь выставить?

Добавлено через 30 секунд:

Eurofighter

я думал, что он имеет в виду разъемы питания)

Eurofighter

Всмысле, что тебе не вериться? Я еще не применял настройки, я просто выставил пока. Что именно у тебя вызывает сомнения?

eminem23: Eurofighter

Всмысле, что тебе не вериться? Я еще не применял настройки, я просто выставил пока. Что именно у тебя вызывает сомнения?

Треба дивитися кожен екземпляр окремо, а взагалі середня напруга для такої частоти 1.060-1.075, у мене лише при 1.088 845 по ядру стабільно. 1.100 і вже перегрів врм, тому можеш ставити до 1.088 і не турбуватися.

eminem23: Eurofighter

Если будет маленькое слишком напряжение, видюха не задымиться?)) Просто вырубиться комп?

Лише драйвер(програма/гра закриється) повідомить про помилку. При перегріві врм (1.100) у мене у грі почав блимати екран та страшно шуміти вк.

Поставил вольтаж 1.061, запустил 3дмарк11- ошибка:

Workload Single init returned error message: DXGI call IDXGISwapChain::SetFullscreenState failed:

The requested functionality is not supported by the device or the driver.

не должны глючить, возможно стоит дрова, библиотеки и directx обновить, ладно по теме разгоняй с помощью msi afterburner поднимай понемножку частоты и проверяй комбустером он встроен в msi afterburner, гони до тех пор пока карта стабильно держатся будет в тесте, по желанию можно и с вольтмодом поиграться но при передозе напряжения может и видюха сгореть

Если ты играешь, выкручивая все на максимум, тогда меняй карту на GTX 670.

Это не железки устаревают, а игры плохо адаптируются, а карта у тебя ну чуть ее получше, современная GTX 660. Пробуй разрешение на полную, в играх не ставить.

Да, а процессор все тянет хорошо и памяти хватает?.

Ты умник .От разгона карта не перестанет глючить. и что в твоём понимании глючить. если у тебя на сегодняшний день 570 не справляется выкинь на куй её .А руки кривые не кирила а у тебя .запомни разгон может повысить производительность на цутьцуть но не на много но и срок службы карты сократит. так что пиши подробюнее что за глюки и тогда решим .может у тебя глюк не на апаратном а на совте глюк. у меня радик 6750 и то у меня детишки довольны играют во всё и в кризис 2 на максимуме в разрешении 1920х1080.

Найдите обзор именно своей GTX 570, где ее разгоняют. Я к тому, что системы охлаждения у 570 различны по производительности, а вы не уточнили свою модель. Для сильного разгона придется увеличивать напряжение ядра. Точные значения частот и напряжений, которые нужно выставить, скажем, в MSI AFterburner, никто не даст. GTX 570 прожорливая, а разгон еще больше увеличит ее энергопотребление. Просчитайте, выдержит ли это ваш блок питания. Еще момент. Если Hitman Absolution лагает с настройками 1920*1080 ультра + MSAA 4X, то разгон не спасет положение. Лучше убрать сглаживание, и фпс поднимется до комфортных ~ 40 фпс (на HD 7850 так и сделал, сглажку она тоже не тянет) . Т. е. считаю неразумным мучить карту разгоном, когда она ультра настройки не тянет. Когда есть единственная тормозная опция (тот же MSAA 4X в Hitman Absolution и Far Cry 3, DOF в Metro 2033), режущая фпс почти вдвое, ее лучше отключить.

GeForce GTX 570 в референсном исполнении довольна своеобразная модель: для столь мощного GPU используется откровенно слабое питание – лишь четыре фазы. На просторах интернета массово встречаются отзывы обладателей данного ускорителя, из которых следует, что видеокарта при высоких напряжениях может «уйти на тот свет» – не выдерживает система питания. Поэтому, было принято решение не рисковать и не использовать хардвольтмод для повышения напряжения. Для неэкстремального разгона, без азота, хватит напряжений, которые увеличиваются с помощью программного метода.

Для этих целей использовался следующий набор утилит: MSI Afterburner 2.2.0 beta 8, NiBiTor, Nvflash. Но начнем от простого к сложному, проведя для разминки разгон на номинальном напряжении с референсной системой охлаждения.

Видеокарту удалось разогнать до следующих частот: 850 МГц для GPU и 4500 МГц для микросхем памяти. С учетом того, что ZOTAC GTX 570 AMP! изначально прошита повышенными частотами, разгон получился предсказуемым, честно говоря.

реклама

Следующим по плану был разгон с установленным альтернативным охлаждением. На стандартном напряжении мне удалось покорить частоты 871/1742/4600 МГц.

Для того чтобы раскрыть полностью разгонный потенциал ускорителя ZOTAC GTX 570 AMP я повысил напряжение на графическом процессоре с помощью утилиты MSI Afterburner. Стандартное напряжение на видеокарте 0.98 В, при воздушном охлаждении безопасно его можно повышать лишь до 1.05-1.075 В. Маленькими шагами подбирались стабильные частоты и напряжение. В конечном итоге удалось добиться лишь 915 МГц для GPU при напряжении 1.05 Вольта.

Дальнейшее повышение напряжения на GPU не приносило успеха, во всех игровых тестах появлялись артефакты. Нельзя сказать, что данная видеокарта оказалась неудачной в плане разгона, но если честно, я ожидал больших частот при повышенном напряжении. Напомню, что данный опыт проводился на нестандартном охлаждении.

Первая "игра ползунками" огорчила: всего 830 стабильных мегагерц (хотя тест в FurMark проходила на 855 МГц). Память "прыгнула" немного выше расчетной частоты - 1133 МГц. Этакий никудышный "бумажный" разгон: вроде как и есть, а толку нет.

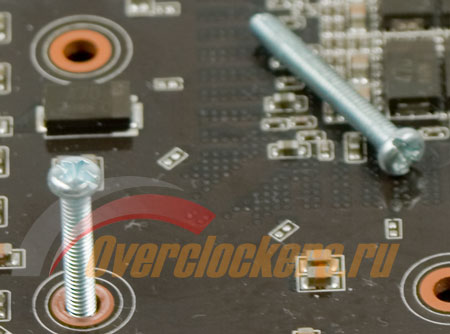

Первой под смену пошла СО. Высокопроизводительного кулера под руками не оказалось, да и установка 90% моделей поверх алюминиевой пластины сопряжена со значительными трудностями: штатный крепеж рассчитан на монтажные отверстия в плате, а не проставки, запрессованные в основание. К счастью, ватерблок Swiftech MCW60 отлично подошел после небольшой доработки основания. Сперва каждая из проставок была подпилена на 1 мм - ровно столько не хватало по высоте, чтобы основание ватера плотно прижалось к ядру (именно в этот момент и была замечена кривизна алюминиевой пластины относительно крышки GPU):

реклама

Второй шаг - замена четырех штатных винтов на 20-мм М2:

Они подошли идеально: под гайку оставалось около 3-4 мм. Установленный ватерблок:

После смены СО температура GPU не поднималась выше 47 градусов по Цельсию.

Конфигурация СВО:

- Помпа - Laing DDC-Pump 12V DDC-1T

- Радиатор - Black Ice GTX360

- Шланги - Tygon 11/15

- Объем резервуара - 2 л

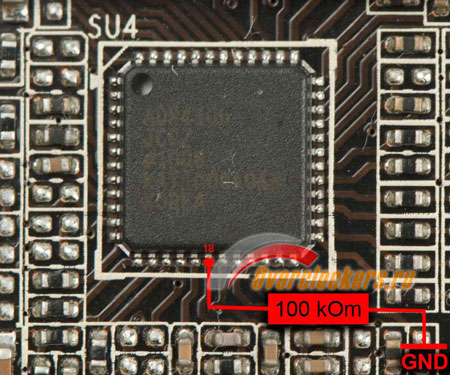

Зависимость частоты видеопроцессора от напряжения питания можно увидеть на графике:

реклама

Особо хочется прокомментировать последний результат. Таким резким скачком частоты без сильного (относительно прочих результатов) повышения напряжения питания GPU обязан снижению температуры воды в контуре до +10 градусов по Цельсию (решил использовать минусовую погоду за окном на благо оверклокинга). Если же не давать такой "форы", то тот же результат можно достигнуть при 1,25 В на ядре. Однако в этом случае силовым элементам VRM становится очень жарко - температура ключей , по данным закрепленного на обратной стороне термодатчика, подбирается к 80 градусам. "Фигня!" - скажет бывалый пользователь. На штатных режимах работы - может быть, а почем известно, какую максимальную мощность могут рассеять через свой корпус распаянные на плате ключи.

Нетрудно догадаться, что моей целью была круглая цифра - 1 ГГц. Скриншоты результата:

В процессе разгона фиксировались напряжения на видеопроцессоре в разных состояниях: простой, загрузка 3D-играми, загрузка утилитой FurMark. Все числа занесены в таблицу:

Предвижу вопрос: почему для FurMark-а указаны две цифры. А потому, что в течение 20 минут напряжение повышалось от левого значения к правому. И чем больше напряжение питания, тем больше разница между двумя числами в одной ячейке. А в случае охлаждения GPU десятиградусной водой Vgpu при запуске FurMark не повышалось. Могу предположить, что это связано с уводом параметров некоторых деталей в зависимости от температуры - при запуске FurMark нагрузка на VRM видеопроцессора самая большая, а все, чем он охлаждался - алюминиевый радиатор, обдуваемый 80-мм вентилятором. Получается, что дельта температур между режимами idle-burn в этой части видеокарты самая большая.

Для измерения производительности использовался тестовый стенд следующей конфигурации:

Используемое программное обеспечение:

- Операционная система: Windows 7 Ultimate x64;

- Драйвера: ForceWare 263.09.

Я отобрал 3 наиболее "тяжелые" игры и один синтетический тест для оценки прироста производительности разогнанной карты относительно стоковой.

Первым идет 3D Mark Vantage.

Extreme mode

Overall

Включите JavaScript, чтобы видеть графики

Гигагерцовая GTX 570 легко обходит GTX 580 - значительная разница в частоте видеопроцессора компенсирует недостаток вычислительной мощности.

Настройки игры:

Preset: Ultra; DirectX 11; MSAA 4x; MSAA for A-tested objects: DX 10.1 style; SSAO mode: HDAO; SSAO quality: Ultra; Tessellation; Contact hardening shadows; Test: Day.

Dx11, Ultra, AA4x, avg fps

1680 x 1050

Включите JavaScript, чтобы видеть графики

1920 x 1200

Включите JavaScript, чтобы видеть графики

реклама

В "Сталкере" разрыв не так велик, но все равно GTX 570 в разгоне обходит GTX 580. В высоком разрешении (1920 х 1200) высокие частоты GTX 570 позволяют лишь чуть-чуть отставать. В этом приложении для выигрыша в 1 fps приходится "отдать" почти 50 МГц.

Настройки игры:

DirectX 11; Quality: Very High; MSAA 4x; Texture Filtering: 16x; DOF: on; Advanced PhysX: off; Scene: Frontline.

Dx11, Very High, AA4x, PhysX off, avg fps

1680 x 1050

Включите JavaScript, чтобы видеть графики

1920 x 1200

Включите JavaScript, чтобы видеть графики

Вот кому будет полезно разгонять 570-е! Минимальный fps я не измерял, но судя по тому, как хорошо игра реагирует на повышение тактовой частоты, разница между 800 МГц и 1 ГГц должна быть заметна на глаз.

Настройки качества:

DirectX 10; Mode: Enthusiast; Anti-aliasing: 4x; Map: ambush

AA4x, avg fps

1680 x 1050

Включите JavaScript, чтобы видеть графики

1920 x 1200

Включите JavaScript, чтобы видеть графики

То же самое можно сказать и про Crysis Warhead - "бонусные" мегагерцы явно пойдут не в бесполезные попугаи да красивые циферки, а на повышение комфорта игрового процесса.

Gainward можно и похвалить, и поругать. Похвалить за саму карту, которая и в самом деле получилась удачной. Уточню - речь идет не о законченном продукте в сборе, а только о PCB с распаянными на ней компонентами, без учета СО. Такой подход к оценке комплектующих может показаться странным и неразумным (пользователь же покупает целиковый продукт, а не конструктор!), но что мешает купить карту с прицелом на разгон? Покупались же в свое время некоторые видеокарты целенаправленно для разблокировки конвейеров. Отчего нельзя купить карту для установки под, например, СЖО?

Поругать за выбор системы охлаждения. Видимо те, кто этот видеокулер проектировал, стремились ужаться "в два слота" по ширине. Как они при этом забыли предусмотреть каналы для выхода отработанного воздуха и не заметить этот момент в тестах, для меня остается загадкой. И напоследок ещё один минус, не упомянутый выше - при использовании в закрытом стенде GTX 570 с такой системой охлаждения проигрывает референсной, так как бОльшая часть нагретого воздуха остается внутри корпуса, а не выводится за его пределы.

Личные рекомендации по применению: скручивать штатную СО и ставить ватерблок. Практика показала, что совершенно не обязательно покупать дорогущий full-cover, вполне сойдет любой универсальный "видеоватер". Кстати, в монтажных стойках для штатного радиатора GPU резьба тоже М2, так что туда можно вставить другие относительно высокие ватерблоки (например, Promodz).

Подпишитесь на наш канал в Яндекс.Дзен или telegram-канал @overclockers_news - это удобные способы следить за новыми материалами на сайте. С картинками, расширенными описаниями и без рекламы.

Читайте также: