Gk106 400 a1 какая видеокарта

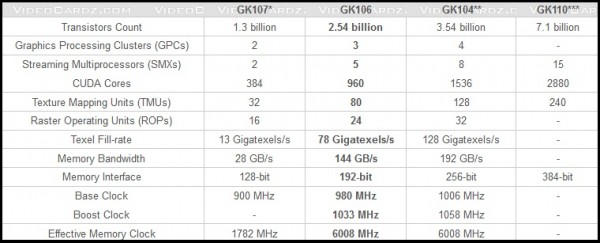

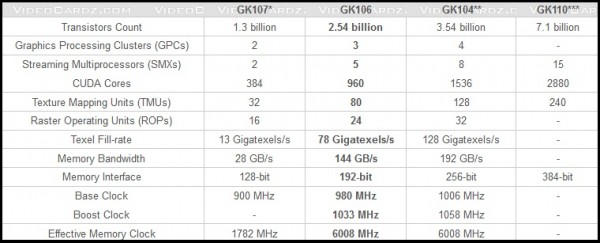

Following the launch of a couple of more GK104-based SKUs, namely GeForce GTX 670 Ti, and GeForce GTX 670, some time in May; NVIDIA will launch its third (after GK104 and GK107) Kepler architecture-based silicon, codenamed GK106. GK106 will make up sub-$200 SKUs, and succeeds the GF116, on which SKUs such as the GeForce GTX 550 Ti, are based. The GK106 will make up at least one known desktop SKU, called GeForce GTX 660.

Its specifications are listed below.

- 28 nm, around 210 mm² die-area, Kepler architecture

- Two Graphics Processing Clusters (GPCs), four Streaming Multiprocessors (SMXs)

- 768 CUDA cores

- 64 TMUs, 24 ROPs

- 192-bit wide GDDR5 memory interface, holding 1.5 GB or 2 GB memory

- PCI-Express 3.0 bus interface

- Around 130W TDP

- Speculated performance comparable to GTX 560 Ti and HD 6950, competitive to Radeon HD 7800 series

Related News

- Mar 1st 2022 NVIDIA DLSS Source Code Leaked (83)

- Jan 21st 2022 Intel Arc Alchemist Xe-HPG Graphics Card with 512 EUs Outperforms NVIDIA GeForce RTX 3070 Ti (95)

- Mar 26th 2022 NVIDIA GeForce RTX 4090/4080 to Feature up to 24 GB of GDDR6X Memory and 600 Watt Board Power (107)

- Aug 22nd 2020 NVIDIA GeForce RTX 3090 Founders Edition Potentially Pictured: 3-slot Behemoth! (183)

- Jan 17th 2022 NVIDIA's Custom RTX 3090 Ti Graphics Cards Reach $4,000 Pricing in Europe (111)

- Apr 27th 2022 NVIDIA Allegedly Testing a 900 Watt TGP Ada Lovelace AD102 GPU (102)

- Jan 29th 2022 NVIDIA "Hopper" Might Have Huge 1000 mm² Die, Monolithic Design (60)

- Dec 2nd 2021 NVIDIA GeForce RTX 2060 12GB Has CUDA Core Count Rivaling RTX 2060 SUPER (99)

- May 6th 2022 NVIDIA GeForce RTX 3090 Ti Gets Custom 890 Watt XOC BIOS (61)

- Mar 1st 2022 Hackers Threaten to Release NVIDIA GPU Drivers Code, Firmware, and Hash Rate Limiter Bypass (51)

Relative Performance

Clock Speeds

Related News

- Mar 1st 2022 NVIDIA DLSS Source Code Leaked (83)

- Jan 21st 2022 Intel Arc Alchemist Xe-HPG Graphics Card with 512 EUs Outperforms NVIDIA GeForce RTX 3070 Ti (95)

- Mar 26th 2022 NVIDIA GeForce RTX 4090/4080 to Feature up to 24 GB of GDDR6X Memory and 600 Watt Board Power (107)

- Aug 22nd 2020 NVIDIA GeForce RTX 3090 Founders Edition Potentially Pictured: 3-slot Behemoth! (183)

- Jan 17th 2022 NVIDIA's Custom RTX 3090 Ti Graphics Cards Reach $4,000 Pricing in Europe (111)

- Apr 27th 2022 NVIDIA Allegedly Testing a 900 Watt TGP Ada Lovelace AD102 GPU (102)

- Jan 29th 2022 NVIDIA "Hopper" Might Have Huge 1000 mm² Die, Monolithic Design (60)

- Dec 2nd 2021 NVIDIA GeForce RTX 2060 12GB Has CUDA Core Count Rivaling RTX 2060 SUPER (99)

- May 6th 2022 NVIDIA GeForce RTX 3090 Ti Gets Custom 890 Watt XOC BIOS (61)

- Mar 1st 2022 Hackers Threaten to Release NVIDIA GPU Drivers Code, Firmware, and Hash Rate Limiter Bypass (51)

Render Config

Graphics Card

Release Date Sep 6th, 2012 Generation GeForce 600 Predecessor GeForce 500 Successor GeForce 700 Production End-of-life Launch Price 229 USD Bus Interface PCIe 3.0 x16 Reviews 77 in our database

Graphics Processor

GPU Name GK106 GPU Variant GK106-400-A1 Architecture Kepler Foundry TSMC Process Size 28 nm Transistors 2,540 million Die Size 221 mm²

Theoretical Performance

Pixel Rate 20.64 GPixel/s Texture Rate 82.56 GTexel/s FP32 (float) performance 1.981 TFLOPS FP64 (double) performance 82.56 GFLOPS (1:24)

26 Comments on NVIDIA GK106 GPU Detailed

I think ill have to get a GTX680 if the prices ever drop or not anything lower than a GTX670, i personally don't like 24ROPs, 192bit. i only want 32ROPs or more a 256bit or higher in a GFX

There was a news post recently stating AMD had no plans of dropping prices on their current offerings, probably hoping to lure people in and make some extra money on people who don't want to wait for GTX680 Availability to improve.

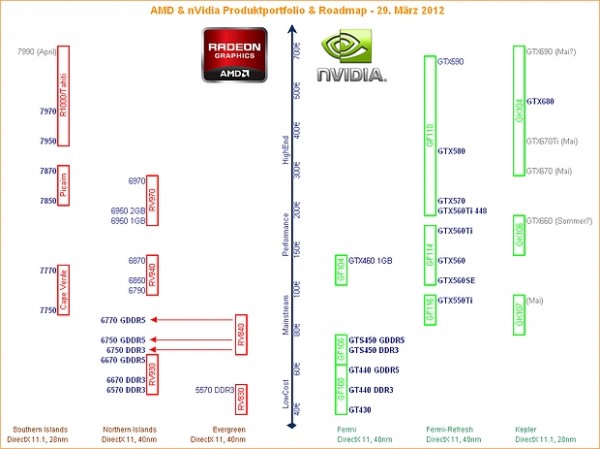

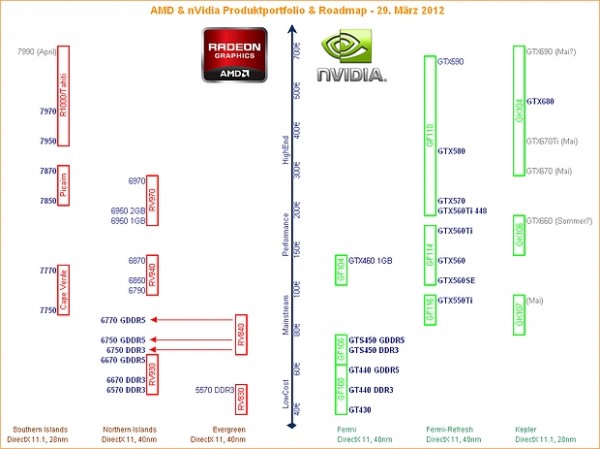

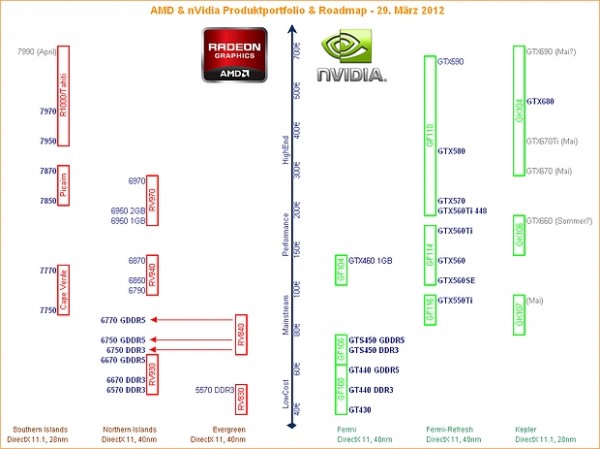

It shows the 7970 as being around 450 with the GTX680 being about 500.

xenocideThere was a news post recently stating AMD had no plans of dropping prices on their current offerings, probably hoping to lure people in and make some extra money on people who don't want to wait for GTX680 Availability to improve.

It shows the 7970 as being around 450 with the GTX680 being about 500.

Right but that's for while the availability isn't there, maybe they think prices will drop by then? Lol.

Wait a min here the projections of the performance being 560ti/6950 makes a hole. A BIG hole that is between the 680 and the "670 ti" were the 7870 and the 7950 hell even the 7970 fill that gap. That's a bit strange, don't ya think?

Isn't the 7970 more expensive because of the extra GB of vRAM? Maybe AMD is planning to release a cheaper than the 680 1.5 GB version of the 7970.

you guys also missed the 7990 out in April,Also the huge ass hole between the 7970-7990?Maybe the price drop is for some refreshed 7970- 7980?Either way we all benefit from it.On both sides.

according to picture 660 is lower than 7800, according to text - they are competing

if 660 is ~130w it means single 6-pin power, which is nice

let's wait and see

looking forward to the 660, mostly since it'll probably lower the prices of GTX560Ti. Though at 130w a 660 would be doable with my current power supply (barely. probably too close to chance it really)

It depends on if you're a geek or someone whom gets their info from stock reviews. nVIDIA is ingeniously counting on the later with kepler.

Like I said in a previous post, I expect this to be paired against the 7850 and beat it at stock. While 7850 may be more architecturally sound with 15-33% more resources on paper, we're again talking a part that will be clocked in the neighborhood of 25% higher on average. When the equivalent of 896 shaders takes on 1024 at 25% higher clock and the limiting factor is most-often shader performance on these configurations, that makes a difference. When 64 texture units take on 80 at 25% higher clock, that's pretty much a tie. When 24 ROPs (with better raster performance) take on 32 ROPs when neither needs that many. it doesnt particularly matter.

Also, according to how I calculate average bandwidth requirements (by bottlenecks on past products) 5ghz on a 192-bit bus fits 680 clocks perfectly. in theory it should be more efficient in that regard than 680 at stock. Memory bandwidth for Pitcairn OTOH is obviously built around the clocks/configuration of 7870 (which is also perfectly matched). It may help 7850 on some occasions, but not to any large degree.

Then you have overclocking. which on 7850 is a complete PITA. The vbios limits it to 1050mhz on pretty much every model (granted ASUS has a work-around), most lack voltage control, and even beyond that there is powertune limiting it to 150w.

I don't think it will be a stretch to say, theoretically, a 1200mhz 660 will compete with a 1050mhz 7850. Sure, 7850 can probably do better if you get the right model and/or want to spend the time figuring it out, but I think nvidia will make the process easier. Given what we've seen on 680 and 28nm as a whole, 1200mhz is also a realistic speed to attain (especially on the fully-working chips). So, more-or-less a wash. but it's important to remember reviews are at stock, and what most people use to compare.

st.boneI think ill have to get a GTX680 if the prices ever drop or not anything lower than a GTX670, i personally don't like 24ROPs, 192bit. i only want 32ROPs or more a 256bit or higher in a GFX

What a load of BS, damn it the GTX660 should be taking on the 7870 ffs.

$350 is too much for a 7870, at $100 less it would be a bit better buy, and now that gtx 660 will compete with 7850, the 7870 won't budge from that price.

Look at the bright side, after there is availability for the gtx 680,670ti, and 670, the 7970,7950, and 7870 should drop in price at least a bit. Lol

Yeah, but it can't. I said it on a GTX680 thread, the GTX660 does not stand a chance to compete directly in that segment. That's what happens when the performance part becomes the high-end card. The one that was going to be the lower mainstream has to take the performance spot and since it is 1/2 of the performance part instead of 3/4 or 2/3 (like Pitcairn), it's going to be nearly imposible, unless the GTX680 is held back by a "bottleneck" somewhere limiting the scaling, similar to HD79xx vs HD78xx, in which case it might land closer to HD7870 (never ever faster in my mind). But chances are slim for GTX660.

Nvidia will probably use some pressure from the top with the GTX670 (i.e loosely beating HD7870 for $300) and hopefully price the GTX660 well below $250 while being cosmetically faster than HD7850. In the end this GTX550 replacement card was probably meant to be sold at $150.

PS: IMO like in the GF106 the 192 bit memory interface is a dumb idea. 128 bit would suffice for what is otherwise half the chip and the extra 64 bit channel will probably do nothing but make it much larger.

N3M3515What a load of BS, damn it the GTX660 should be taking on the 7870 ffs.

$350 is too much for a 7870, at $100 less it would be a bit better buy, and now that gtx 660 will compete with 7850, the 7870 won't budge from that price.

yeah Nvidia is going to force AMD to drop prices on the 7870 if the GTX670ti comes out to be about as fast as the 7950 for the rumored 350-399 price tag.

nvidiaintelftwyeah Nvidia is going to force AMD to drop prices on the 7870 if the GTX670ti comes out to be about as fast as the 7950 for the rumored 350-399 price tag.

The GeForce GTX 660 was a performance-segment graphics card by NVIDIA, launched on September 6th, 2012. Built on the 28 nm process, and based on the GK106 graphics processor, in its GK106-400-A1 variant, the card supports DirectX 12. Even though it supports DirectX 12, the feature level is only 11_0, which can be problematic with newer DirectX 12 titles. The GK106 graphics processor is an average sized chip with a die area of 221 mm² and 2,540 million transistors. It features 960 shading units, 80 texture mapping units, and 24 ROPs. NVIDIA has paired 2,048 MB GDDR5 memory with the GeForce GTX 660, which are connected using a 192-bit memory interface. The GPU is operating at a frequency of 980 MHz, which can be boosted up to 1032 MHz, memory is running at 1502 MHz (6 Gbps effective).

Being a dual-slot card, the NVIDIA GeForce GTX 660 draws power from 1x 6-pin power connector, with power draw rated at 140 W maximum. Display outputs include: 2x DVI, 1x HDMI 1.4a, 1x DisplayPort 1.2. GeForce GTX 660 is connected to the rest of the system using a PCI-Express 3.0 x16 interface. The card measures 241 mm in length, and features a dual-slot cooling solution. Its price at launch was 229 US Dollars.

Memory

Board Design

Slot Width Dual-slot Length 241 mm

9.5 inches TDP 140 W Suggested PSU 300 W Outputs 2x DVI

1x HDMI 1.4a

1x DisplayPort 1.2 Power Connectors 1x 6-pin Board Number P2030

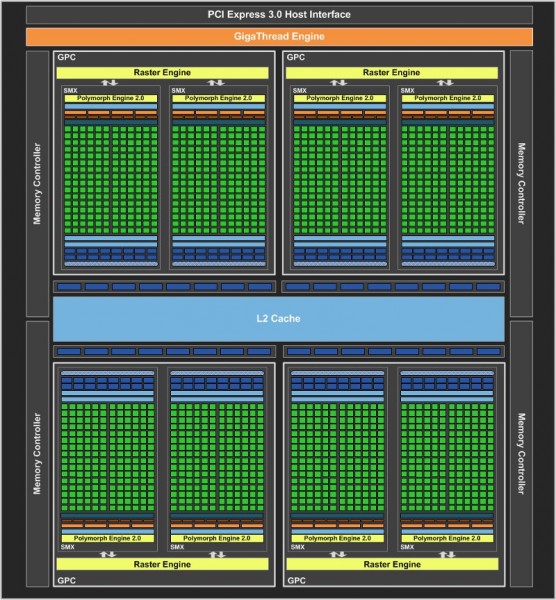

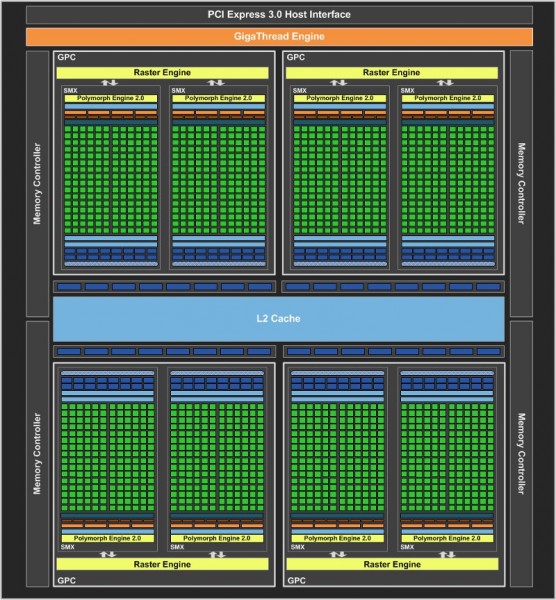

Итак, известно, что в базовой версии кристалл GK106 содержит 960 потоковых CUDA-процессора, которые распределены между пятью мультипроцессорами SMX; в свою очередь мультипроцессоры SMX разделены между тремя вычислительными кластерами Graphics Processing Clusters (GPC), на один из которых приходится лишь один SMX, остальные два получили по паре таких модуля. В состав каждого потокового мультипроцессора вошло 192 CUDA-ядра и 16 текстурных блока TMU (Texture Mapping Unit). Путем несложных вычислительных операций мы в итоге получаем заявленное для GK106 общее число CUDA-ядер, равное 960 единицам, а также 80 TMU.

Также отмечаем, что чип содержит три растровых движка (Raster Engines), 192-битный интерфейс управляется при помощи трех 64-битных контроллеров. На каждый контроллер VRAМ приходится по 128 КБ кэша L2 (общий объем кэша GPU равен 384 КБ) и 8 растровых блока (Raster Operating Unit). Таким образом, суммарное количество ROP составляет 24 штуки. По данным videocardz, всего в составе ядра GK106 будет насчитываться 2,54 миллиарда транзисторов, что ровно на один миллиард меньше чем у GK104.

Довольно интересная новость сегодня просочилась в Сеть относительно будущего графического ускорителя NVIDIA GeForce GTX 660, а точнее ядра, на котором он может базироваться. Напомним, по слухам, основой для данной видеокарты должна была послужить очередная модификация чипа GK104, однако после того как наши зарубежные коллеги опубликовали снимки GPU GK106, можно предположить, что именно ему суждено стать сердцем главной mainstream-модели серии GeForce 600.

Как видно из представленного снимка, GK106 будем немного меньше GK104, при этом он прямоугольной формы, в то время как старшее ядро квадратной формы. Стоит отметить, что масштаб снимков может быть не соблюден и тогда наши предположения окажутся в корне неверными. Чип маркирован как GK106-400-A1, и если то, что он станет основой видеокарты GeForce GTX 660 правда, тогда в его конфигурацию войдет 1152 потоковых CUDA-процессора и 6 мультипроцессоров SMX.

Похоже, с релизом оставшихся представителей серии NVIDIA Kepler калифорнийский разработчик затеял какую-то непонятную игру, результаты которой мы, возможно. увидим уже 6 сентября.

Спецификации будущей новинки следующие:

- 28 нм, площадь кристалла 210 мм², архитектура Kepler

- два графических вычислительных кластера Graphics Processing Clusters (GPC)

- четыре потоковых мультипроцессора Streaming Multiprocessors (SMX)

- 768 потоковых CUDA-ядер

- 64 текстурных блока TMU

- 24 блока растеризации ROP

- 192-битный интерфейс памяти

- 1,5 ГБ или 2 ГБ видеопамяти GDDR5

- шина PCI-Express 3.0

- TDP 130 Вт

- производительность сравнимая с GTX 560 Ti и HD 6950

- конкурент серии Radeon HD 7800

Компания Advanced Micro Devices уже успела познакомить мировую общественность с планируемым графиком выпуска своих новейших графических ускорителей марки Radeon. Адаптер Radeon HD 7970 на базе GPU Tahiti XT был анонсирован еще в прошлом году (22 декабря) и благополучно стартовал в продаже, уже в конце нынешнего месяца ожидается выход еще одного представителя серии Radeon HD 7900 – HD 7950 (Tahiti Pro). Следующие видеокарты нового поколения от AMD появятся на прилавках с февраля по март.

На что сразу же хотелось бы обратить внимание, так это на неимоверное для видеокарт NVIDIA количество потоковых процессоров, что было нехарактерно для моделей предыдущих поколений. Так, чип GK104 содержит 1536 CUDA-ядер, 64 текстурных блока, 32 блока растеризации и будет функционировать на частоте 1050 МГц. Ширина шины памяти должна составить 256 бит, заявленное энергопотребление равно 225 Вт. Еще больше впечатляют характеристики GK100, в составе которого будет доступно 2304 потоковых CUDA-процессора. Топовый чип NVIDIA Kepler наделен 96 текстурными юнитами, а также 64 блоками ROP; номинальная частота GPU составляет 950 МГц, предусмотрена 512-битная шина памяти. TDP GK100 ожидается в районе 300 Вт.

Итак, известно, что в базовой версии кристалл GK106 содержит 960 потоковых CUDA-процессора, которые распределены между пятью мультипроцессорами SMX; в свою очередь мультипроцессоры SMX разделены между тремя вычислительными кластерами Graphics Processing Clusters (GPC), на один из которых приходится лишь один SMX, остальные два получили по паре таких модуля. В состав каждого потокового мультипроцессора вошло 192 CUDA-ядра и 16 текстурных блока TMU (Texture Mapping Unit). Путем несложных вычислительных операций мы в итоге получаем заявленное для GK106 общее число CUDA-ядер, равное 960 единицам, а также 80 TMU.

Также отмечаем, что чип содержит три растровых движка (Raster Engines), 192-битный интерфейс управляется при помощи трех 64-битных контроллеров. На каждый контроллер VRAМ приходится по 128 КБ кэша L2 (общий объем кэша GPU равен 384 КБ) и 8 растровых блока (Raster Operating Unit). Таким образом, суммарное количество ROP составляет 24 штуки. По данным videocardz, всего в составе ядра GK106 будет насчитываться 2,54 миллиарда транзисторов, что ровно на один миллиард меньше чем у GK104.

Спецификации адаптера GeForce GTX 670 Ti:

- 4 графических вычислительных ядра (GPC)

- 7 потоковых мультипроцессоров (SMX)

- 1344 процессора CUDA

- 112 текстурных блока (TMU)

- 32 блока растеризации (ROP)

- 256-битный интерфейс памяти GDDR5

- базовая частота GPU ~ 900 МГц

- VRAM ~ 1000 МГц (5000 МГц GDDR5 эффективная), пропускная способность 160 ГБ/с

- Приблизительная стоимость $349-399

Предстоящая новинка обозначена маркетинговым названием GeForce GTX 690 и, согласно имеющимся данным, должна стартовать в розничной продаже в мае нынешнего года. К сожалению, информация об этом продукте пока что находится на уровне слухом, однако уже сейчас можно сказать, что здесь пользователи обнаружат 3072 потоковых CUDA-процессора, 256 текстурных блока TMU, 64 блока растеризации ROP, а также двойной 256-битный интерфейс. Термопакет данного решения ожидается в районе 330 Вт, для сравнения, данный показатель будущего двухъядерного монстра Radeon HD 7990 также находится на уровне 330 Вт.

На что сразу же хотелось бы обратить внимание, так это на неимоверное для видеокарт NVIDIA количество потоковых процессоров, что было нехарактерно для моделей предыдущих поколений. Так, чип GK104 содержит 1536 CUDA-ядер, 64 текстурных блока, 32 блока растеризации и будет функционировать на частоте 1050 МГц. Ширина шины памяти должна составить 256 бит, заявленное энергопотребление равно 225 Вт. Еще больше впечатляют характеристики GK100, в составе которого будет доступно 2304 потоковых CUDA-процессора. Топовый чип NVIDIA Kepler наделен 96 текстурными юнитами, а также 64 блоками ROP; номинальная частота GPU составляет 950 МГц, предусмотрена 512-битная шина памяти. TDP GK100 ожидается в районе 300 Вт.

Начнем мы с GPU NVIDIA GK104. По утверждению источника в составе данного чипа будет задействовано 640 либо 768 потоковых процессоров CUDA, 80 или 96 текстурных блоков (TMU) и 48 блоков растеризации (ROP); видеопамять распаяна из чипов стандарта GDDR5 и имеет 384-битную шину.

Флагманский GPU GK100 может похвастаться наличием 1024 потоковых CUDA-процессоров, здесь предусмотрено 128 текстурных модулей (TMU), а также 64 блока растеризации (ROP). Ядро и память GDDR5 связаны между собой 512-битным интерфейсом.

В состав каждого SMM входит 128 ядер CUDA, а не 192, как это было в модулях SMX ядер поколения Kepler. Если данное утверждение правдиво, то ядро GM107 должно нести в себе в максимальной конфигурации 640 CUDA, которые все будут активны в графическом ускорителе GeForce GTX 750 Ti. Логично будет предположить, что для адаптера GTX 750 один из потоковых мультипроцессоров будет отключен, что в конечном итоге даст нам число CUDA-ядер, равное 512 единицам.

После того, как в Сети появились первые снимки видеоадаптеров поколения Maxwell (GeForce GTX 750 Ti и GTX 750), мировой общественности стали доступны и фото графического чипа GM107, который и используется в их основе. Согласно предварительным данным, будущий GPU станет неким гибридом между ядрами GK107 и GK106: число CUDA-процессоров здесь соответствует таковому GK106, а вот шина памяти как у GK107. В сравнении с GK106 площадь кристалла была уменьшена на целых 30 процентов.

Для начала NVIDIA предложит две версии GM107. Более медленный вариант с обозначением GM107-300 найдет свое применение в GeForce GTX 750, в то время как модификация GM107-400 будет задействована в GTX 750 Ti. «300-тый» будет обладать 768 потоковыми CUDA-процессорами, в «400-том» таких модулей будет 960.

В технологическом плане новое ядро мало чем отличается от представителей семейства Kepler, разве что прилично улучшился показатель энергоэффективности.

Как сообщают наши зарубежные коллеги, информация о будущих графических ускорителях поколения NVIDIA Maxwell появилась в новых драйверах некоторых моделей ноутбуков. Вполне возможно, что часть производителей уже заполучили в свои руки рабочие образцы будущих чипов для тестирования и интеграции в систему.

Пока что просочившиеся в Сеть данные говорят о двух GPU будущего семейства – GM108 и GM107. Компания NVIDIA вновь применила уже знакомое правило маркировки – GM расшифровывается как «GeForce Maxwell» (ранее GK – «GeForce Kepler» и GF – «GeForce Fermi»).

Характеристики новых графических чипов пока что не озвучиваются, однако судя по названиям, новинки станут основой для ноутбуков начального уровня, а также моделей с малым уровнем энергопотребления. Можно предположить, что GM108 и GM107 придут на смену чипам GK108 и GK107 соответственно, которые задействовались для графики базового уровня.

Помимо вышеуказанных GPU в драйверах можно заметить ранее неизвестный мобильный видеоадаптер GeForce 820M. Примечательно, что по данным источника, карта основывается на ядре GF117, что не удивительно, поскольку NVIDIA уже задействовала данный GPU в моделях GeForce GT 720M и GT 620M. Калифорнийский разработчик вновь применит стратегию, согласно которой новые бюджетные решения будут создаваться путем ребрендинга со старых моделей, а в высокопроизводительном и среднем сегментах найдут применение новые продукты.

Читайте также: