Блок питания crps что это

В отличие от обычного компьютерного блока питания неправильно подобранный серверный блок питания может не просто привести к нестабильной работе одной единицы оборудования, а парализовать деятельность целого департамента или даже компании, так как от него зависит общая функциональность и работоспособность сервера.

Несмотря на то, что конструктивно практически все виды серверных блоков питания идентичны, у них есть свои особенности, которые следует учитывать, подбирая модели, которые будут обеспечивать корректную работу серверного оборудования в безостановочном режиме 24/7.

В первую очередь, следует обратить внимание на следующие важные характеристики: габариты (форм-фактор), мощность и охлаждение. Также немаловажны сертификация по системе 80 Plus и выше, наличие функции «горячей замены» и уровень допустимого напряжение на входе.

Не стоит пытаться сильно сэкономить при выборе серверного блока питания. Однако и переплачивать за качественный и надежный БП тоже не следует. С 2017 года с целью обеспечения рынка России и стран СНГ более широким ассортиментом продуктов, конкурентоспособных по соотношению цена/качество, российское представительство Qdion стало предлагать как полностью готовые блоки питания, так и решения в области SKD- и CKD-локализации производства серверных блоков питания в России. В частности на российском рынке уже доступны серверные OEM-модули Qdion с резервированием, серверные и одинарные промышленные блоки питания производства Aspower, так как Qdion является торговым представительством этой фабрики на территории России, стран СНГ и Германии.

Aspower (бренды Aspower и Honoto) является на сегодняшний день лидером по производству адаптеров и блоков питания в КНР с оборотом более 300 миллионов долларов США в год, выпускающим качественное OEM-оборудование для Lenovo, HP и многих других известных компаний. Топ-3 производителей блоков питания для серверов с оборотом около 60 миллионов долларов США за год, среди которых такие азиатские компании как Foxconn, Inspur (Китай) и Mitac (Тайвань), являются OEM-клиентами Aspower.

OEM-фабрика Aspower (Shenzhen Honor Electronic) была основана в 1996 году. Ее заводы располагаются в Китае в г. Шэньчжэнь и г. Ганьчжоу, а также во Вьетнаме. В департаменте исследований и разработок компании работает 150 инженеров, а большинство ведущих инженеров по разработке серверных блоков питания ранее работали в штате китайской компании Delta. Общее число сотрудников на производстве превышает 2400 человек.

Линейка серверных блоков питания Qdion, которая предлагается для российских системных интеграторов, весьма широка и сбалансирована. В нее входят целый ряд одноюнитовых блоков питания с различной мощностью и эффективностью, в числе которых можно отметить следующие модели: U1A-A10250-S мощностью 250 Вт, U1A-C20500-D мощностью 500 Вт, U1A-C20600-D мощностью 600 Вт, а также компактные отказоустойчивые серверные блоки питания R1A-KH0300 и R1A-KH0400м мощностью 300 Вт и 400 Вт, соответственно.

U1A-C20500-D R1A-KH0300

Большим спросом на российском рынке пользуются модели для двухюнитовых серверов, предназначенных для хранения больших массивов данных, U2A-B20500-S и U2A-B20600-S мощностью 500 и 600 Вт, соответственно, а также ряд серверных блоков питания с резервированием. Qdion предлагает универсальные решения, в частности серверные системы питания с универсальной задней панелью, совместимой с использованием нескольких CRPS-модулей и с универсальными распределителями питания для использования с различными по мощности CRPS-модулями. Например, благодаря двухюнитовому универсальному распределителю питания R2A-DV1200-N PBD могут быть задействованы различные одноюнитовые CRPS-модули мощностью 550 Вт, 800 Вт и 1200 Вт.

В случае, если требуются источники питания компактных размеров для инсталляции в серверных корпусах формата ATX, в линейке Qdion имеются модели R2A-MV0550 и R2A-MV0700 мощностью 550 и 700 Вт, соответственно.

Предлагаемые блоки питания для серверов поддерживают возможность горячей замены, что значительно упрощает их обслуживание и позволяет выполнять замену без остановки серверной системы. Отличительной чертой серверных блоков питания Qdion является отказоустойчивость и поддержка технологий, обеспечивающих оптимальное использование электроэнергии.

Также примечательно, что все устройства сертифицированы согласно американскому стандарту 80 Plus.

О Qdion

Qdion — это дочерняя независимая компания, созданная 1 января 2018 главой исторического представительства FSP в России. Qdion является независимой компанией и специализируется на OEM-поставках и локализации производства в России, представляя 8 ведущих OEM-фабрик в Китае и Тайване, которые не продвигают свою продукцию под собственным брендом, как это делает завод FSP в Шэньчжэне. Эти OEM-фабрики, которые представляет в России Qdion, сосредоточены только на OEM/ODM-бизнесе и готовы помочь российским системным интеграторам в развитии бизнеса по локализации производства.

Линейка БП PNR, производимая заводами FSP в Шэньчжэне, имеет старый дизайн печатных плат, и большинство их них уже подошло к концу срока службы. Серия PNR компании Qdion уже поставляется и успешно заменила серию PNR с логотипом FSP на российском рынке, в частности, для клиентов, являющихся системными интеграторами: с 2019 по 2021 год ее продажи уже превысили продажи серии FSP PNR на российском рынке.

Основным направлением деятельности Qdion является предоставление OEM/ODM-продуктов российским системным интеграторам. Основное внимание уделяется питанию серверов, а серверные БП Qdion (поставляемые крупнейшим в Китае OEM-проиводителем серверных БП Aspower) успешно используются российскими интеграторами первого уровня — рост продаж составил 200-300% с 2019 г. по настоящее время.

О серверном оборудовании Aspower

Для российских системных интеграторов Aspower готов предложить сотрудничество по проектам OEM-, ODM-, SKD- и CKD-локализации производства. OEM-модели Aspower сертифицированы по американскому стандарту 80 Plus, но выпускаются под торговой маркой Qdion для дистрибуции серверных блоков питания производства Aspower через компанию OCS. Продукция также сертифицирована по стандартам CE, UL, EAC и RoHs — глобальным знакам качества и безопасности продукции.

Aspower предлагает универсальные решения, в частности серверные системы питания с универсальной задней панелью, позволяющей использовать несколько CRPS-модулей, и с универсальными распределителями питания для использования с различными по мощности CRPS-модулями.

С полным ассортиментом продукции Aspower можно ознакомиться на сайтах Qdion и FSP.

Видео с производства современного завода Aspower демонстрирует высокий уровень используемых технологий и контроль качества выпускаемой продукции:

Мощные источники питания форм-фактора 19" широко используются для питания дата-центров, серверов, сетевого оборудования, промышленных компьютеров. От таких источников требуется, во-первых, максимально возможная эффективность, поскольку от нее зависят не только прямые расходы на электроэнергию, но и дополнительные затраты на отвод тепла, выделяемого этими источниками. Во-вторых, высокая удельная мощность, необходимая для экономии места.

В-третьих, определенный функционал — параллельная работа, резервирование, дистанционный мониторинг и управление. В-четвертых, как можно большее время наработки на отказ, что напрямую влияет на стоимость обслуживания. Предложить источник, сочетающий все эти качества, способны немногие производители, и Compuware Technology — один из них [1]. В последних моделях источников с цифровым управлением достигнут КПД более 96%, что соответствует высшему уровню 80PLUS TITANIUM в программе добровольной сертификации 80PLUS [2]. Удельная мощность в некоторых моделях доходит до 48 Вт/куб. дюйм, что на сегодня в мире является практическим пределом. Устройства обладают необходимыми функциями и длительным периодом безотказной работы.

Продукция состоит из нескольких серий (рис. 1–8), ниже приведены их краткое описание и характеристики (таблица).

Рис. 1. Одиночные источники питания

Рис. 2. Резервируемые модули

Рис. 3. Узкопрофильные резервируемые модули

Рис. 4. Резервируемые CRPS-модули

Рис. 5. Резервируемые модули для блейд-серверов

Рис. 6. Резервируемые модули с двойным входом

Рис. 7. Резервируемые модули с низковольтным входом

Рис. 8. Модули со встроенной батареей

Параметр

Одиночные источники питания

Резервируемые модули

Узкопрофильные резервируемые модули

Резервируемые CRPS-модули

Резервируемые модули

для блейд-серверов

Резервируемые модули с двойным входом

Резервируемые модули

с низковольтным входом

Модули

со встроенной батареей

основные +3,3, +5, +12, –12; дежурный +5

основной +12; дежурный +5

основной +12;

дежурный +5

основной +12; дежурный +12

основной +12; дежурный +5, +12

основной +12; дежурный +5

основной +12; дежурный +5

основной +12; дежурный +5

Удельная мощность, Вт/куб. дюйм

I 2 C или PMBus

Одиночные источники питания (Single Power Supply). Имеют несколько выходных напряжений, соответствующих стандарту ATX. Используются для питания промышленных компьютеров. Параллельная работа и резервирование не предусмотрены.

Резервируемые модули (AC/DC Redundant Module). Имеют широкую номенклатуру мощностей и опций. Все резервируемые модули этой и других серий предполагают возможность наращивания для увеличения мощности, а также резервирование по принципу N+1. Если для получения необходимой мощности требуется N модулей, то используется N+1, то есть на один больше. Тогда в случае отказа одного из них остальные обеспечивают нормальную работу. Информация о состоянии модулей передается по управляющей шине PMBus, что позволяет оперативно вычислить неисправный источник и сделать горячую замену.

Узкопрофильные резервируемые модули (Slim Line AC/DC Redundant Module). Отличаются уменьшенными габаритами, поэтому могут применяться в случае острой нехватки места. По сравнению с обычными модулями той же мощности в диапазоне 500–980 Вт размеры составляют всего 322×54,5×40 мм против 346×76×40 мм. Остальные характеристики такие же, как у обычных модулей.

Резервируемые CRPS-модули (CRPS Redundant module). Форм-фактор CRPS (Common Redundant Power Supply) был разработан компанией Intel для питания своих серверов. Главная особенность данных устройств — так называемое холодное резервирование. При обычном способе резервирования все модули работают параллельно, и ток нагрузки равномерно распределяется между ними. Недостаток такого способа в том, что при малой нагрузке снижается эффективность использования электрической энергии, поскольку КПД источников резко падает. Технология холодного резервирования предусматривает, что часть модулей может находиться в режиме ожидания с очень низким собственным потреблением. Модули отслеживают состояние нагрузки и в случае необходимости переходят из режима ожидания в рабочий режим или обратно, благодаря чему энергия расходуется наиболее эффективно.

Резервируемые модули для блейд-серверов (Blade Serve Redundant Module). Отличаются, прежде всего, форм-фактором, а также наибольшей из всех серий мощностью. Концепция блейд-сервера предусматривает, что часть компонентов системы, в частности блок питания, вынесена наружу, поэтому модуль устанавливается в специально выделенную корзину.

Резервируемые модули с двойным входом (AC/DC to DC Dual-Input). Модули этой серии имеют два входа, один из которых подключается к сети переменного тока, а другой — к источнику постоянного тока с напряжением 180–300 В. В нормальном режиме модуль работает от сети, в случае перебоя сети он переходит на работу от резервного источника.

Резервируемые модули с низковольтным входом (DC-DC Redundant Module). Модули, работающие от источника постоянного тока с напряжением 36–72 В. Предназначены для питания телекоммуникационного оборудования.

Модули со встроенной батареей (Backup Battery). Реализуют новую концепцию бесперебойного источника питания (UPS). Как правило, UPS является промежуточным звеном между сетью ~220 В и AC/DC-модулями. В случае перебоя сети UPS преобразует энергию встроенных батарей в переменное напряжение, от которого питаются AC/DC-модули. Новый подход состоит в том, чтобы преобразовывать энергию батарей непосредственно в выходные напряжения, исключая промежуточную стадию DC/AC-преобразования. За счет этого экономится до 8% энергии и существенно уменьшаются общие размеры и стоимость системы. Модуль с батареей подключается как обычный резервируемый модуль, он совместим с большинством серий. Время автономной работы составляет 2,5–5 минут, потребление в режиме ожидания менее 2 Вт.

Подробные характеристики модулей можно узнать на сайте производителя или по запросу.

Здравствуйте! Меня зовут Алексей, я руковожу созданием оборудования в компании YADRO – координирую работу всех, кто так или иначе вовлечен в процесс разработки.

В конце прошлой статьи Максим maxf75 немного коснулся особенностей расположения разъёмов памяти. Сегодня я расскажу в целом про то, как мы пришли к тому варианту архитектуры и компоновки, над которыми работаем сейчас.

Вид проектируемого сервера сзади со снятой задней решёткой.

При проектировании мы исходили из ключевого требования: обеспечить максимальный объём памяти. Вообще это тема отдельной статьи, как компания занялась разработками на основе OpenPOWER, определила целевые задачи для сервера и пришла к этому требованию. Между остальными публикациями мы расскажем и эту историю. А пока примем за отправную точку проектирования: сервер на основе OpenPOWER с максимальным объёмом памяти.

Надо отметить, что решения, которые доступны на рынке сейчас и которые позволяют обеспечить действительно большой объём памяти, обладают одним существенным недостатком – стоимость сервера в разы превышает стоимость установленной в нём памяти. Именно поэтому мы приняли решение создать сервер, который сломает эту традицию и позволит предоставить в одной машине до 8 ТБ памяти при сохранении низкой общей (насколько это возможно вообще учитывая стоимость собственно 8 ТБ DDR4) стоимости решения.

Вместе с целью максимизации объёма памяти сразу возникло стремление обеспечить высокую плотность – иногда это оказывается важным фактором, определяющим конкурентное преимущество при сравнении с другими серверами. После пары недель размышлений и прикидок на бумажках у меня возникло ощущение, что мы сможем уложить все это в стандартное 19” шасси высотой 2U.

Учитывая целевой объём памяти и общее количество планок, её размещение — определяющий фактор при построении компоновки сервера. Понятно, что разместить 128 модулей DIMM на системной плате просто невозможно как исходя из банальной геометрии (плата будет гигантских размеров), так и исходя из требований Signal Integrity. Очевидно, что для упихивания нашего количества памяти нужно делать вертикально размещаемые в шасси райзеры, которые подключаются к системной плате. На райзерах необходимо разместить коннекторы под DIMM’ы и буфер памяти Centaur, который содержит кэш и обеспечивает доступ процессора к памяти (один процессор поддерживает до 4-х буферов памяти).

Первая идея компоновки райзера подразумевала размещение модулей с одной стороны, а буфера памяти сбоку рядом с ними, как на картинке. Но, во-первых, мы уперлись в ограничение по длине трасс от буфера к DIMM’ам, а во-вторых поняли, что будут проблемы с их выравниванием.

Первоначальная схема компоновки райзера памяти

Пришлось делать иначе — размещать чип буфера памяти между двумя группами DIMM’ов. Сначала было немножко неочевидно, пройдет ли такое решение по высоте, но аккуратно посчитав высоту райзера, мы поняли, что при размещении компонентов с минимальными допусками получившаяся плата как раз по высоте проходит между дном и крышкой 2U-корпуса. Таким образом, коннектор для подключения к системной плате необходимо было вынести вбок, и райзер получился таким:

Плата сложная, 18 слоев.

Дальше занялись построением общей компоновки сервера. Традиционно в передней части шасси располагаются диски для локального хранилища. Для шасси высотой 2U наиболее стандартными вариантами являются либо 24 × 2.5”, либо 12 × 3.5”. Мы выбрали первый – 3.5” диски нас в данном проекте не сильно интересуют, поскольку мы ориентируемся скорее на SSD.

Позади дисков классически размещаются вентиляторы — тут тоже не было особенных вопросов: поставили 5 вентиляторов распространённого размера 80 × 38 мм – собственно, максимум, который помещался по ширине. Тут тоже были задачи, с которыми пришлось повозиться – при размещении пяти вентиляторов практически не остается места под коннекторы (необходимо же обеспечить возможность их замены на ходу). Выкрутились, найдя очень компактные коннекторы и разместив их фактически в объёме, занимаемом самими вентиляторами.

Подключение вентиляторов. Для удобства отображения скрыт ближний вентилятор и ближняя направляющая рамка.

Вентиляторы подключаются к лежащей под ними плате, которая разводит линии питания и управления оборотами. У каждого вентилятора свой канал управления. На картинке видны шины питания, ведущие к плате — они проходят вдоль левой стороны сервера, если развернуть его блоками питания к себе. По правой стороне проходит шлейф для передачи управляющих сигналов ШИМ от системной платы.

С подключением локальных дисков тоже все не так просто. Нам очень нравится стандарт NVMe, и мы в целом считаем, что за ним будущее. Какие бы новые типы памяти не появились в обозримом периоде (тот же 3D-XPoint от союза Intel и Micron), скорее всего они найдут применение и в варианте NVMe дисков, поскольку PCI Express сегодня является наиболее коротким путем подключить что бы то ни было к процессору (да, мы знаем про NV-DIMM, но это очень дорогой компромисс, который к тому же отъедает ценные для нас слоты под память). С другой стороны, нам бы не хотелось окончательно и бесповоротно отказываться от поддержки SAS/SATA. Эти соображение достаточно логичным образом привели нас к решению о том, что на системной плате мы будем размещать коннекторы, позволяющие нам вывести шину PCI Express кабелем к дисковым контроллерам, будь то коммутатор PCI Express или SAS HBA/RAID контроллер.

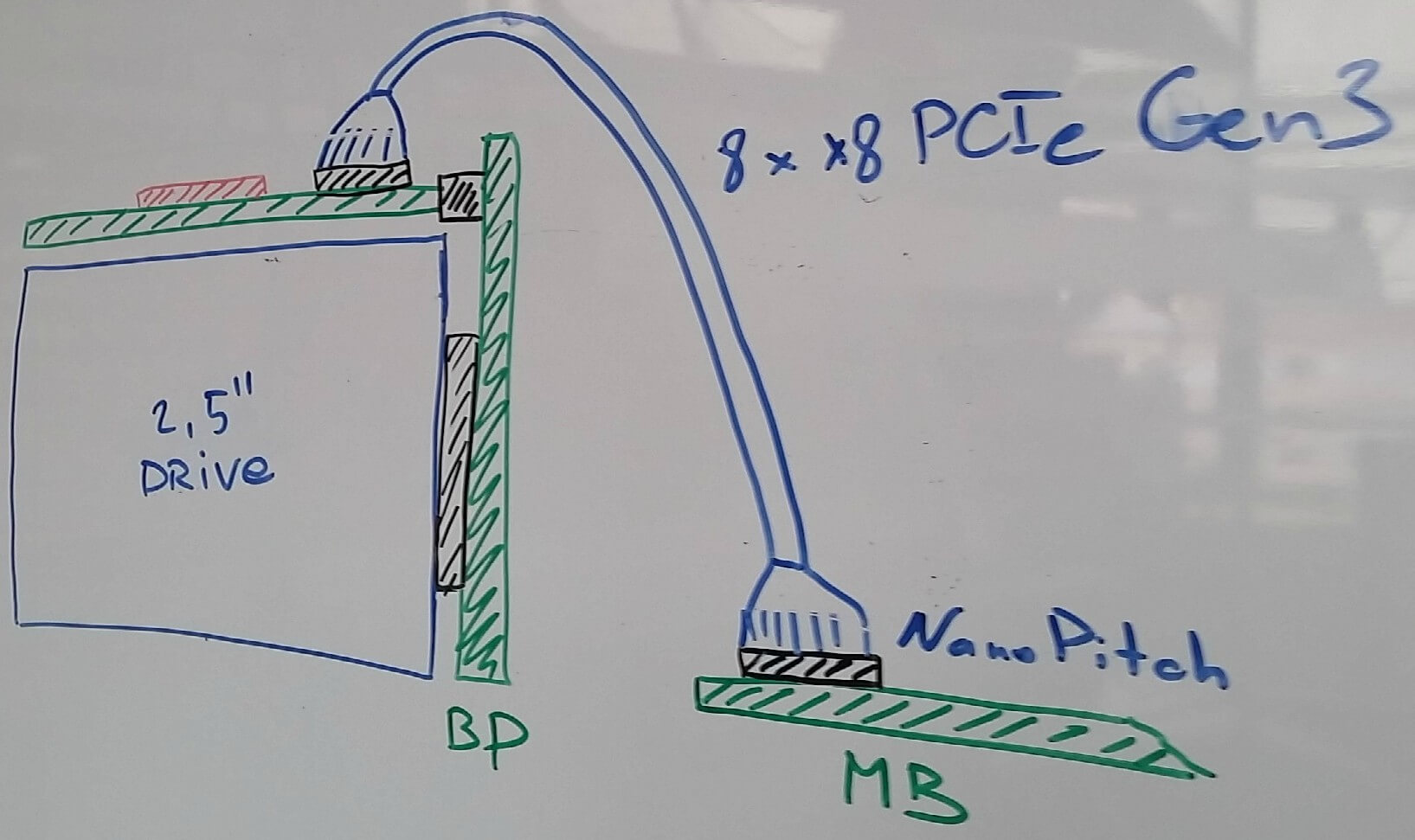

В качестве наиболее подходящей для нас пары разъём-кабель было выбрано решение NanoPitch от Molex (на самом деле это просто реализация активно продвигаемого PCI SIG стандарта OCuLink). Кабели для внутренних подключений достаточно компактны и позволяют по одному кабелю прокидывать до 8 лэйнов PCIe Gen3.

Дальше возник вопрос о том, а где собственно размещать дисковые контроллеры. На бэкплэйне, к которому подключаются диски, сделать это просто невозможно (чипы что SAS-контроллеров, что PCIe коммутаторов слишком большие для этого). После внимательного изучения размеров дисков, максимально допустимой высоты шасси и проработки разных вариантов конструкции дисковых треев стало понятно, что в целом есть возможность разместить плату с контроллерами над дисками. Такое размещение, во-первых, упрощает её подключение к дисковому бэкплейну (можно применить стандартные CardEdge коннекторы), а во-вторых, позволяет снизить высоту дисковых треев за счет отказа от световодов и размещения всей индикации на плате контроллера.

В итоге получилась такая схема подключения:

Для разнообразия — художества от руки. Схема подключения дисков. Магнитная доска, маркеры, 2016 год.

Плата с PCIe-коммутатором или SAS-контроллером располагается над дисками, подключается к системной плате кабелем. Сама плата подключена к дисковому бэкплейну, в который воткнуты диски.

Блоки питания обычно ставят в левом или правом заднем углу корпуса. Нам было удобнее, исходя из дизайна PDB (Power Distribution Board), расположить их в левом (если смотреть сзади). Блоки питания решили использовать стандарта CRPS, основными преимуществами которого являются высокая удельная мощность блоков питания (2 кВт уже сегодня, до 2,4 – почти завтра), высокий КПД, а самое главное — это не какой-то проприетарный стандарт одного вендора, а стандарт, инициатором которого был в свое время Intel и который был поддержан значительным количеством компаний. Два двухкиловаттных блока питания в нашем случае расположены друг над другом.

Поскольку на каждом райзере мы размещаем по одному буферу памяти и по 8 DIMM’ов (максимально поддерживаемое Centaur’ом количество), то получается, что нам требуется четыре райзера на процессор, то есть всего 16 в шасси. Исходя из высоты стандартных модулей DDR4 RDIMM в ширину таких райзеров в шасси можно разместить не более 11 (да и то, приходится использовать Ultra-low seating DIMM-сокеты и ужиматься, считая десятые доли миллиметров). Поэтому ещё 5 райзеров пришлось поставить в другое место, на заднюю часть системной платы. Собственно, это и привело в итоге к разворачиванию одного процессора на 180 градусов (последняя Ктулху-картинка в прошлой статье). Учитывая высоту наших райзеров памяти от дна до крышки сервера, к ограничениям формы системной платы добавился ещё один вырез.

После этого осталось только разместить разъёмы для стандартных карт PCI Express, количество которых однозначно определилось свободным местом. Получилось разместить 5 слотов, плюс отдельный коннектор для платы менеджмента (для разгрузки системной платы мы решили вынести на отдельную карту BMC, USB и Ethernet — всё это поместили на отдельную небольшую плату, которая устанавливается в тот самый шестой разъём).

В итоге получилась такая картина расположения компонентов (вид сверху, плата с контроллерами над дисками не показана, чтобы диски не заслонять):

0. Системная плата.

1. Процессоры IBM POWER8 SCM Turismo.

2. Райзеры памяти с DIMM’ами.

3. 24 × 2.5” диска и дисковый бэкплейн

4. Слоты для карт расширения (поддерживаются только HHHL, то есть низкопрофильные карты).

5. Плата управления.

6. Вентиляторы системы охлаждения.

7. Блоки питания.

Вот эти соображения, которые я описал, и определили облик сервера. Итого: стандартное 19” шасси высотой 2U, 4 сокета для процессоров POWER8, 16 разъёмов для райзеров с планками памяти (всего до 128 модулей DIMM во всём сервере, по 8 на каждом райзере), 5 стандартных PCI Express слотов для карт расширения и одна карта управления.

Когда я впервые увидел такую надпись при опросе версий прошивок HP DL380, то был несколько обескуражен. Эм, ну ладно, если очень нужно – скачай и поставь. Но что за софт может быть в банальном блоке питания? Оказалось, что для диагностики местной системы жизнеобеспечения и обработки отказов по питанию. Там натуральный кластер из блоков питания, со своим арбитром и логикой. Под катом рассказ об устройстве такого "кластера" и о том, почему 2 x 1400 = 2300W.

Два блока питания – в два раза выше надежность? Не всегда, потому что зависит от настроек системы электропитания. Вот о ней подробнее и поговорим. В качестве предметов рассказа я выбрал оборудование среднего серверного класса, вроде такого:

То есть, не блейды и не мейнфреймы – у них все иначе устроено. Обратите внимание, форм-фактор сервера не имеет значения для наличия или отсутствия дополнительных блоков питания.

Начнем с ответа на вопрос "зачем сколько БП, если можно просто хранить небольшой запас запчастей". Системы с резервированием в сервере всегда полезны, даже если не рассматривать отказоустойчивость. Например, они повышают удобство обслуживания и позволяют нам не ночевать в серверной при замене дисков или тех же блоков питания.

Например, второй блок питания поможет, если:

Выйдет из строя ИБП;

Дорожные рабочие найдут месторождение электричества;

Возникнет необходимость переноса сервера в другую стойку;

Два блока питания дают больше гибкости при проектировании серверной комнаты. Например, рабочая схема подключения у одного клиента: в серверной две фазы, подключены к разным блокам питания серверов. Одна фаза подключена к UPS, а вторая работает только через стабилизаторы. Но эта линия идет от генератора с автозапуском. При отключении электричества дизель стартует и серверы продолжают работать, даже если UPS разрядятся. Это всего лишь один из вариантов, подобранный с учетом пожеланий клиента и возможностей бюджета.

Итого, несколько БП нужны для удобства администратора, повышения надежности системы и обеспечения большей мощности.

Простейший вариант систем с двумя блоками питания выглядит как запитывание отдельных комплектующих компьютера от разных блоков, при этом один из них управляющий и питает материнскую плату. Подобные решения практикуют геймеры и майнеры, потому что для установки трех и более видеокарт одного источника питания не хватит. Для подключения используют такие адаптеры:

При нажатии на Power замыкаются зеленый сигнальный провод с "землей", давая команду на запуск обоим блокам питания.

Помню, когда-то давно был у меня компьютер уровня Pentium III с набором SCSI дисков. Штатного блока питания перестало хватать, и я подключил старый АТ-блок отдельно для жестких дисков. Запуск чудо-машины происходил так: нажимаем на кнопку дополнительного питания и ждем жужжания дисков, затем включаем основной БП и начинается загрузка.

Даже в эпоху всепроникающего Китая для "самоделкиных" существует множество схем подключения двух блоков питания своими руками, чтобы получилась похожая конфигурация:

Но вернемся к промышленным серверным решениям.

Устройство питания по своей логике довольно простое. Блоки подключаются к специальной корзине Power Distribution Backplane, где также присутствует микроконтроллер Power Distribution Unit (не путайте с распределителем питания для серверной стойки). Контроллер отвечает за схему использования доступных БП: одновременно или в режиме primary-backup.

Столь продвинутую подсистему питания можно настраивать под конкретные потребности. При использования сервера с двумя блоками питания доступно несколько режимов работы:

Резервирование, при котором один блок питания нагружен постоянно, а второй готов подхватить нагрузку в случае сбоя;

Очень напоминает RAID – его отказоустойчивый уровень 1 и производительный 0.

Большинство производителей позволяют администратору выбрать необходимый режим. Например, в таком сервере HP настройка через BIOS выглядит следующим образом:

Изображение немного устарело, так как в новых системах используется настройка через iLO, но для понимания сути ее достаточно.

Посмотрим на выдаваемую мощность пары блоков питания HP DL360 при разных режимах настройки и небольшой нагрузке. Для этого используем консольную утилиту hpasmcli.

Не обманул производитель, блоки питания выдают примерно одинаковую мощность.

И правда, при использовании режима распределения нагрузки блоки нагружены примерно одинаково. Но при включении отказоустойчивости используется только один блок питания, а второй переводится в Standby и расходует минимум энергии.

Своеобразный "спящий режим" нужен для того, чтобы избежать холодного старта при подключении резервного БП, сэкономить время и минимизировать риски выхода блока питания из строя в процессе его активизации. Как и в случае с бытовыми лампочками, при любом холодном включении образуются пиковые нагрузки на элементную базу электроцепи, что может привести к ее порче.

Настройка режимов работы у каждого производителя выполняется по-своему. Например, у Lenovo (IBM) в системах с двумя блоками питания настройка через GUI выглядит следующим образом:

На выбор предлагаются три режима работы:

Отказоустойчивость без снижения энергопотребления – вернемся к нему позже;

Отказоустойчивость с понижением мощности;

Generic-серверы, вроде Intel и Supermicro, не всегда хорошо документированы и открытой информации о настройках режимов работы БП не оказалось. Пришлось обратиться к нашим инженерам и форумам. Оказалось, что подобные системы обычно работают они в режиме балансировки нагрузки.

Если вы плотно работали с подобными платформами и владеете другой информацией – поделитесь в комментариях, пожалуйста.

Еще интереснее обстоят дела с системами из трех и более БП.

Как и в аналогии с RAID, большее число узлов открывает более изощренные схемы использования. Например, у сервера Supermicro с тремя блоками штатно используется режим работы 2+1, то есть работают одновременно два, а третий в резерве.

В случае с четырьмя БП в Lenovo можно настроить использование блоков питания более гибко. Интерфейс даже считает показатели мощности самостоятельно:

С точки зрения баланса производительности и надежности, подобные конфигурации из 4 БП оправданы только при использовании "прожорливых" комплектующих. В остальных случаях запас по мощности будет избыточным, а удобство и запас надежности обеспечивают 2 блока питания с разными подводами электричества.

На мой взгляд, в таких платформах интереснее вместо третьего и четвертого БП поставить резервные батареи (примеры для Supermicro и HP). Они подстрахуют от проблем с UPS и минут на 5 повысят время работы без электричества в сети. Кроме того, с подобными модулями удобнее заниматься обслуживанием железа: выдернул кабель – и спокойно перенес сервер в другой шкаф. Время работы сервера от встроенной батареи составляет около пяти минут.

Опыт инженеров Сервер Молл показывает, что блоки питания на втором месте по выходу из строя, после жестких дисков. По крайней мере, в ходе восстановления серверов эти компоненты часто меняются из-за применения в их конструкции электролитических конденсаторов.

Если к сбоям дисковой подсистемы мы привыкли и держим запасной диск наготове, то замена для системы питания встречается на полках ЗИП реже. Ситуацию в какой-то степени спасает гарантия и возможность получить замену отказавшего БП через пару дней с курьером, но Закон Мерфи со счетов сбрасывать не стоит. В моей практике был случай, когда во время ожидания замены отказавшего БП вышел из строя оставшийся. Хорошо, что на сервере ничего жизненно-важного не было.

Если оставить в стороне надежность, то остается вопрос с мощностью. Как правило, лучше взять сразу два блока питания, каждый с достаточным запасом выходной мощности. Но если бюджет таких вольностей не позволяет, то придется взвешивать потребности более детально и учитывать проседания мощности источников питания. Обратимся к руководству от HP, в котором представлен график КПД системы питания в разных конфигурациях:

В случае низкой нагрузки машины КПД одного блока питания выше, но картина меняется, если у нас высоконагруженный сервер.

Что же будет, если один из блоков питания выйдет из строя, а мощности оставшегося не хватит?

У многих вендоров предусмотрен механизм снижения энергопотребления на случай сбоя – PowerSafe Guard у Fujitsu, Throttling у Lenovo. Использование подобных механизмов не всегда спасает ситуацию, да и существенное падение производительности порой хуже простоя.

Есть еще один нюанс: возрастает нагрузка на второй блок питания, что повышает вероятность его выхода из строя. Лучше исходить из того, что один блок питания из пары должен обеспечивать сервер целиком, хотя бы при штатных нагрузках. Разница в стоимости блоков питания разной мощности не так уж велика, поэтому стоит выбирать более производительные модели. Например, вот цены на варианты от Supermicro:

Блок питания PWS-406P-1R на 400 Ватт стоит в среднем 12 000 ₽;

Цены взяты с Яндекс маркета, так что в реальности они могут быть даже ниже. Экономия 4 000 ₽ в ущерб отказоустойчивости выглядит так себе даже для небольшого сервера.

Современный блок питания содержит набор диагностических механизмов для контроля внутренней системы охлаждения, напряжения, силы тока и массы внутренних состояний.

Помимо автоматического отключения при перегреве, полезно иметь возможность подключить к централизованному мониторингу показатели работы подсистемы питания. Например, с их помощью можно прогнозировать выход из строя определенного БП или выявить нестабильный подвод электричества. Все это обеспечивают микроконтроллеры, внутреннюю логику которых производитель периодически совершенствует в новых обновлениях.

При всех описанных преимуществах, у решений с несколькими блоками питания есть и отрицательные стороны:

Необходимость покупать более дорогие проприетарные блоки питания. Как правило, они должны быть одинаковыми, что может вызвать проблемы с заменой для очень старых серверов;

Узким местом становится управляющий блоками питания контроллер и плата, к которой они подключаются (Power Distribution Backplane);

При малой нагрузке больший расход электроэнергии, как следствие специфического алгоритма использования;

Если у вас есть собственный негативный опыт работы с конфигурациями из нескольких блоков питания – было бы интересно почитать в комментариях.

В завершение приведу несколько полезных ссылок на калькуляторы мощности популярных вендоров:

Если вам тоже лень оценивать мощность при выборе очередного нового сервера, то эти инструменты помогут при расчете как мощности блоков питания, так и энергопотребления всего ЦОД.

The CSU front end series from Artesyn is designed to provide a flexible power conversion solution for compute, storage, and networking equipment in the common redundant power supply (CRPS) form factor.

This series of AC-DC products is housed in the industry standard 1U x 73.5 mm x 185 mm CRPS form factor. Featuring individual power ratings from 550 W up to 2400 W, the choice for power supplies can cover cost-sensitive entry level systems, or power hungry applications where there are space constraints. Designed to provide the highest power in the smallest form factor, the series offers class-leading power density of 75 W/in3. The common form, fit, and function for all products in the family provides a path for power capacity flexibility, future-proofing your system designs.

Many of the models in this product family are available with various input and airflow direction options, enabling deployment in environments from enterprises to traditional data centers, -48 Vdc data centers, and telecom central offices. The DC input option can be used to power equipment from battery backup as well.

The Artesyn CSU series currently have options for using an IEC C13 or C19 AC power cord in the 2000 W range, with system designers free to choose the appropriate power capacity at 200 Vac. The CSU2400AP operates with an IEC C19 AC power cord to draw the full 2400 W at 200 Vac.

Active current sharing helps maximize cost effectiveness by eliminating the need for additional components when paralleling multiple power supplies for very high current applications. These hot-pluggable power supplies support N+1 or N+N redundant architectures, cold redundancy mode, and system power throttling.

All AC-input models in the family are certified for 80 PLUS ® Platinum level efficiency, peaking at 94%, and offer low total harmonic current distortion (EN61000-3-2).

Digital control using the PMBus ® protocol and a built-in I 2 C serial interface facilitates remote set-up, monitoring and control using Artesyn Embedded Power’ universal PMBus graphical user interface. This programming flexibility enables users to implement sophisticated power management schemes with minimal additional components.

All models offer overcurrent, overvoltage, undervoltage, overtemperature and fan fault protection.

Читайте также: