Загрузка видеопамяти в простое сколько норма

Руководство покупателя игровой видеокарты

Современные графические процессоры содержат множество функциональных блоков, от количества и характеристик которых зависит и итоговая скорость рендеринга, влияющая на комфортность игры. По сравнительному количеству этих блоков в разных видеочипах можно примерно оценить, насколько быстр тот или иной GPU. Характеристик у видеочипов довольно много, в этом разделе мы рассмотрим лишь самые важные из них.

Тактовая частота видеочипа

Рабочая частота GPU обычно измеряется в мегагерцах, т. е. миллионах тактов в секунду. Эта характеристика прямо влияет на производительность видеочипа — чем она выше, тем больший объем работы GPU может выполнить в единицу времени, обработать большее количество вершин и пикселей. Пример из реальной жизни: частота видеочипа, установленного на плате Radeon HD 6670 равна 840 МГц, а точно такой же чип в модели Radeon HD 6570 работает на частоте в 650 МГц. Соответственно будут отличаться и все основные характеристики производительности. Но далеко не только рабочая частота чипа определяет производительность, на его скорость сильно влияет и сама графическая архитектура: устройство и количество исполнительных блоков, их характеристики и т. п.

В некоторых случаях тактовая частота отдельных блоков GPU отличается от частоты работы остального чипа. То есть, разные части GPU работают на разных частотах, и сделано это для увеличения эффективности, ведь некоторые блоки способны работать на повышенных частотах, а другие — нет. Такими GPU комплектуется большинство видеокарт GeForce от NVIDIA. Из свежих примеров приведём видеочип в модели GTX 580, большая часть которого работает на частоте 772 МГц, а универсальные вычислительные блоки чипа имеют повышенную вдвое частоту — 1544 МГц.

Скорость заполнения (филлрейт)

Скорость заполнения показывает, с какой скоростью видеочип способен отрисовывать пиксели. Различают два типа филлрейта: пиксельный (pixel fill rate) и текстурный (texel rate). Пиксельная скорость заполнения показывает скорость отрисовки пикселей на экране и зависит от рабочей частоты и количества блоков ROP (блоков операций растеризации и блендинга), а текстурная — это скорость выборки текстурных данных, которая зависит от частоты работы и количества текстурных блоков.

Например, пиковый пиксельный филлрейт у GeForce GTX 560 Ti равен 822 (частота чипа) × 32 (количество блоков ROP) = 26304 мегапикселей в секунду, а текстурный — 822 × 64 (кол-во блоков текстурирования) = 52608 мегатекселей/с. Упрощённо дело обстоит так — чем больше первое число — тем быстрее видеокарта может отрисовывать готовые пиксели, а чем больше второе — тем быстрее производится выборка текстурных данных.

Хотя важность "чистого" филлрейта в последнее время заметно снизилась, уступив скорости вычислений, эти параметры всё ещё остаются весьма важными, особенно для игр с несложной геометрией и сравнительно простыми пиксельными и вершинными вычислениями. Так что оба параметра остаются важными и для современных игр, но они должны быть сбалансированы. Поэтому количество блоков ROP в современных видеочипах обычно меньше количества текстурных блоков.

Количество вычислительных (шейдерных) блоков или процессоров

Пожалуй, сейчас эти блоки — главные части видеочипа. Они выполняют специальные программы, известные как шейдеры. Причём, если раньше пиксельные шейдеры выполняли блоки пиксельных шейдеров, а вершинные — вершинные блоки, то с некоторого времени графические архитектуры были унифицированы, и эти универсальные вычислительные блоки стали заниматься различными расчётами: вершинными, пиксельными, геометрическими и даже универсальными вычислениями.

Впервые унифицированная архитектура была применена в видеочипе игровой консоли Microsoft Xbox 360, этот графический процессор был разработан компанией ATI (впоследствии купленной AMD). А в видеочипах для персональных компьютеров унифицированные шейдерные блоки появились ещё в плате NVIDIA GeForce 8800. И с тех пор все новые видеочипы основаны на унифицированной архитектуре, которая имеет универсальный код для разных шейдерных программ (вершинных, пиксельных, геометрических и пр.), и соответствующие унифицированные процессоры могут выполнить любые программы.

По числу вычислительных блоков и их частоте можно сравнивать математическую производительность разных видеокарт. Большая часть игр сейчас ограничена производительностью исполнения пиксельных шейдеров, поэтому количество этих блоков весьма важно. К примеру, если одна модель видеокарты основана на GPU с 384 вычислительными процессорами в его составе, а другая из той же линейки имеет GPU с 192 вычислительными блоками, то при равной частоте вторая будет вдвое медленнее обрабатывать любой тип шейдеров, и в целом будет настолько же производительнее.

Хотя, исключительно на основании одного лишь количества вычислительных блоков делать однозначные выводы о производительности нельзя, обязательно нужно учесть и тактовую частоту и разную архитектуру блоков разных поколений и производителей чипов. Только по этим цифрам можно сравнивать чипы только в пределах одной линейки одного производителя: AMD или NVIDIA. В других же случаях нужно обращать внимание на тесты производительности в интересующих играх или приложениях.

Блоки текстурирования (TMU)

Эти блоки GPU работают совместно с вычислительными процессорами, ими осуществляется выборка и фильтрация текстурных и прочих данных, необходимых для построения сцены и универсальных вычислений. Число текстурных блоков в видеочипе определяет текстурную производительность — то есть скорость выборки текселей из текстур.

Хотя в последнее время больший упор делается на математические расчеты, а часть текстур заменяется процедурными, нагрузка на блоки TMU и сейчас довольно велика, так как кроме основных текстур, выборки необходимо делать и из карт нормалей и смещений, а также внеэкранных буферов рендеринга render target.

С учётом упора многих игр в том числе и в производительность блоков текстурирования, можно сказать, что количество блоков TMU и соответствующая высокая текстурная производительность также являются одними из важнейших параметров для видеочипов. Особенное влияние этот параметр оказывает на скорость рендеринга картинки при использовании анизотропной фильтрации, требующие дополнительных текстурных выборок, а также при сложных алгоритмах мягких теней и новомодных алгоритмах вроде Screen Space Ambient Occlusion.

Блоки операций растеризации (ROP)

Блоки растеризации осуществляют операции записи рассчитанных видеокартой пикселей в буферы и операции их смешивания (блендинга). Как мы уже отмечали выше, производительность блоков ROP влияет на филлрейт и это — одна из основных характеристик видеокарт всех времён. И хотя в последнее время её значение также несколько снизилось, всё ещё попадаются случаи, когда производительность приложений зависит от скорости и количества блоков ROP. Чаще всего это объясняется активным использованием фильтров постобработки и включенным антиалиасингом при высоких игровых настройках.

Ещё раз отметим, что современные видеочипы нельзя оценивать только числом разнообразных блоков и их частотой. Каждая серия GPU использует новую архитектуру, в которой исполнительные блоки сильно отличаются от старых, да и соотношение количества разных блоков может отличаться. Так, блоки ROP компании AMD в некоторых решениях могут выполнять за такт больше работы, чем блоки в решениях NVIDIA, и наоборот. То же самое касается и способностей текстурных блоков TMU — они разные в разных поколениях GPU разных производителей, и это нужно учитывать при сравнении.

Вплоть до последнего времени, количество блоков обработки геометрии было не особенно важным. Одного блока на GPU хватало для большинства задач, так как геометрия в играх была довольно простой и основным упором производительности были математические вычисления. Важность параллельной обработки геометрии и количества соответствующих блоков резко выросли при появлении в DirectX 11 поддержки тесселяции геометрии. Компания NVIDIA первой распараллелила обработку геометрических данных, когда в её чипах семейства GF1xx появилось по несколько соответстующих блоков. Затем, похожее решение выпустила и AMD (только в топовых решениях линейки Radeon HD 6700 на базе чипов Cayman).

В рамках этого материала мы не будем вдаваться в подробности, их можно прочитать в базовых материалах нашего сайта, посвященных DirectX 11-совместимым графическим процессорам. В данном случае для нас важно то, что количество блоков обработки геометрии очень сильно влияет на общую производительность в самых новых играх, использующих тесселяцию, вроде Metro 2033, HAWX 2 и Crysis 2 (с последними патчами). И при выборе современной игровой видеокарты очень важно обращать внимание и на геометрическую производительность.

Собственная память используется видеочипами для хранения необходимых данных: текстур, вершин, данных буферов и т. п. Казалось бы, что чем её больше — тем всегда лучше. Но не всё так просто, оценка мощности видеокарты по объему видеопамяти — это наиболее распространенная ошибка! Значение объёма видеопамяти неопытные пользователи переоценивают чаще всего, до сих пор используя именно его для сравнения разных моделей видеокарт. Оно и понятно — этот параметр указывается в списках характеристик готовых систем одним из первых, да и на коробках видеокарт его пишут крупным шрифтом. Поэтому неискушённому покупателю кажется, что раз памяти в два раза больше, то и скорость у такого решения должна быть в два раза выше. Реальность же от этого мифа отличается тем, что память бывает разных типов и характеристик, а рост производительности растёт лишь до определенного объёма, а после его достижения попросту останавливается.

Так, в каждой игре и при определённых настройках и игровых сценах есть некий объём видеопамяти, которого хватит для всех данных. И хоть ты 4 ГБ видеопамяти туда поставь — у неё не появится причин для ускорения рендеринга, скорость будут ограничивать исполнительные блоки, о которых речь шла выше, а памяти просто будет достаточно. Именно поэтому во многих случаях видеокарта с 1,5 ГБ видеопамяти работает с той же скоростью, что и карта с 3 ГБ (при прочих равных условиях).

Ситуации, когда больший объём памяти приводит к видимому увеличению производительности, существуют — это очень требовательные игры, особенно в сверхвысоких разрешениях и при максимальных настройках качества. Но такие случаи встречаются не всегда и объём памяти учитывать нужно, не забывая о том, что выше определённого объема производительность просто уже не вырастет. Есть у чипов памяти и более важные параметры, такие как ширина шины памяти и её рабочая частота. Эта тема настолько обширна, что подробнее о выборе объёма видеопамяти мы ещё остановимся в шестой части нашего материала.

Ширина шины памяти

Современные игровые видеокарты используют разную ширину шины: от 64 до 384 бит (ранее были чипы и с 512-битной шиной), в зависимости от ценового диапазона и времени выпуска конкретной модели GPU. Для самых дешёвых видеокарт уровня low-end чаще всего используется 64 и реже 128 бит, для среднего уровня от 128 до 256 бит, ну а видеокарты из верхнего ценового диапазона используют шины от 256 до 384 бит шириной. Ширина шины уже не может расти чисто из-за физических ограничений — размер кристалла GPU недостаточен для разводки более чем 512-битной шины, и это обходится слишком дорого. Поэтому наращивание ПСП сейчас осуществляется при помощи использования новых типов памяти (см. далее).

На современные видеокарты устанавливается сразу несколько различных типов памяти. Старую SDR-память с одинарной скоростью передачи уже нигде не встретишь, но и современные типы памяти DDR и GDDR имеют значительно отличающиеся характеристики. Различные типы DDR и GDDR позволяют передавать в два или четыре раза большее количество данных на той же тактовой частоте за единицу времени, и поэтому цифру рабочей частоты зачастую указывают удвоенной или учетверённой, умножая на 2 или 4. Так, если для DDR-памяти указана частота 1400 МГц, то эта память работает на физической частоте в 700 МГц, но указывают так называемую «эффективную» частоту, то есть ту, на которой должна работать SDR-память, чтобы обеспечить такую же пропускную способность. То же самое с GDDR5, но частоту тут даже учетверяют.

Основное преимущество новых типов памяти заключается в возможности работы на больших тактовых частотах, а соответственно — в увеличении пропускной способности по сравнению с предыдущими технологиями. Это достигается за счет увеличенных задержек, которые, впрочем, не так важны для видеокарт. Первой платой, использующей память DDR2, стала NVIDIA GeForce FX 5800 Ultra. С тех пор технологии графической памяти значительно продвинулись, был разработан стандарт GDDR3, который близок к спецификациям DDR2, с некоторыми изменениями специально для видеокарт.

GDDR3 — это специально предназначенная для видеокарт память, с теми же технологиями, что и DDR2, но с улучшенными характеристиками потребления и тепловыделения, что позволило создать микросхемы, работающие на более высоких тактовых частотах. Несмотря на то, что стандарт был разработан в компании ATI, первой видеокартой, её использующей, стала вторая модификация NVIDIA GeForce FX 5700 Ultra, а следующей стала GeForce 6800 Ultra.

GDDR4 — это дальнейшее развитие «графической» памяти, работающее почти в два раза быстрее, чем GDDR3. Основными отличиями GDDR4 от GDDR3, существенными для пользователей, являются в очередной раз повышенные рабочие частоты и сниженное энергопотребление. Технически, память GDDR4 не сильно отличается от GDDR3, это дальнейшее развитие тех же идей. Первыми видеокартами с чипами GDDR4 на борту стали ATI Radeon X1950 XTX, а у компании NVIDIA продукты на базе этого типа памяти не выходили вовсе. Преимущества новых микросхем памяти перед GDDR3 в том, что энергопотребление модулей может быть примерно на треть ниже. Это достигается за счет более низкого номинального напряжения для GDDR4.

Впрочем, GDDR4 не получила широкого распространения даже в решениях AMD. Начиная с GPU семейства RV7x0, контроллерами памяти видеокарт поддерживается новый тип памяти GDDR5, работающий на эффективной учетверённой частоте до 5,5 ГГц и выше (теоретически возможны частоты до 7 ГГц), что даёт пропускную способность до 176 ГБ/с с применением 256-битного интерфейса. Если для повышения ПСП у памяти GDDR3/GDDR4 приходилось использовать 512-битную шину, то переход на использование GDDR5 позволил увеличить производительность вдвое при меньших размерах кристаллов и меньшем потреблении энергии.

Видеопамять самых современных типов — это GDDR3 и GDDR5, она отличается от DDR некоторыми деталями и также работает с удвоенной/учетверённой передачей данных. В этих типах памяти применяются некоторые специальные технологии, позволяющие поднять частоту работы. Так, память GDDR2 обычно работает на более высоких частотах по сравнению с DDR, GDDR3 — на еще более высоких, а GDDR5 обеспечивает максимальную частоту и пропускную способность на данный момент. Но на недорогие модели до сих пор ставят «неграфическую» память DDR3 со значительно меньшей частотой, поэтому нужно выбирать видеокарту внимательнее.

Такая проблема: После выхода из любой игры, или просмотра видео, видеокарта остается под нагрузкой и греется(почти всегда). Снять нагрузку с карты в состоянии покоя, помогает только перезагрузка "ПК". Еще я заметил, что если не выходить из игры через меню самой игры, а завершить процесс в диспетчере, то видеокарта не грузиться(но не всегда помогает). Вот я поиграл во что-нибудь, выхожу из игры, а видеокарта остается все дальнейшее время под нагрузкой в 501MHz, и температурой примерно 50 градусов (в состоянии покоя температура 34~36) пока я не перезагружу ПК.

Биткойн майнеры и прочая нечисть исключается - я полностью просканировал "ПК" различными утилитами и не один раз переустанавливал "ОС", с полным форматированием "ЖД" . Так же проверил "ПК" "процесс эксплорером" на процессы нагружающие ГП - таковых не выявил.

Спасибо.

Видеокарта - R9 280x Rev 2.0 "гигабайтовская".

Была таже фигня, на 1070. всегда 1600мгц показывало. и сканировал на вирусы, думал браузер грузит. вылечил так, снёс дрова, клинером почистил пк. винда установила быстро свои дрова (тож нвидии ток старее) в гпу-з сразу 250 мгц. установил новые дрова всё. 250мгц. тишина)

Shinsuke_Michishita написал:

Биткойн майнеры и прочая нечисть исключается - я полностью просканировал "ПК" различными утилитами и не один раз переустанавливал "ОС

Shinsuke_Michishita написал:

После выхода из любой игры, или просмотра видео, видеокарта остается под нагрузкой и греется(почти всегда).

Shinsuke_Michishita

Проблема ещё может быть в драйверах или 3D приложении.

Ищем что запущено, через диспетчер задач гасим процесс, находим нужный.

Проверяем драйвера, провести чистую установку, откатиться. Так же есть рекламные вирусы, их находит adwcleaner.

Всё началось 1,5 месяца назад, комп ушёл в BSOD, код ошибки ссылался на сбой видеодрайверов, но по какой причине доподлинно неизвестно. И так несколько раз. Далее обнаружил что по каким то причинам, частота ГПУ и памяти работает на макс. в простое,при этом видеокарта не была загружена. Подумал словил майнера, просто снёс Windows, зачистил все возможное. После переустановки Windows проблема исчезла. Буквально неделю назад, все началось повторяться, за исключением BSOD(скорее всего проблема была сразу же после установки Windows, но я о ней не подозревал). Я включаю компьютер, при этом не запускаю других приложений и программ, не пользуюсь им примерно 5 минут, запускаю MSI Afterburner, наблюдаю макс частоту ядра и памяти, но загрузка карты остаётся 0 .Диспетчер задач мне ничего не говорит. Через GPU Z удалось узнать что некий параметр Video Engine Load загружен на 100%. По правде говоря что это за параметр , понятия не имею. Общая проблема устраняется перезагрузкой компа, но в определённое время появляется вновь и вновь, и в основном тогда когда я включаю комп. Помимо этого я делал все возможное, начинаю от переключений режимов электропитания, до переустановки драйверов. Ничего не помогает. Довольно даже интересно стало, в чем корень проблемы. Либо это хитрожопый майнер, либо косяк дров.

Есть какие нибудь мысли, у тех то разбирается больше в этом?

Ryazancev

Думаешь любой вирус можно найти и удалить? Писал же что менял Windows, при чем не просто менял, форматнул и SSD и хард.

video engine load – это степень занятости аппаратного ускорения во время воспроизведения видео. параметр указывает на степень загруженности "видеообработчика" процессора твоей видеокарты. если то, что ты пишешь, верно, то видеокарта думает, что на ней крутится обработка текущего декодирования видео.

интересная проблема.

я на windows 10 сталкивался с двумя разными проблемами полной загрузки видеоядра в простое. в первом случае (nvidia, windows 10 1809 LTSC) помогла комбинация "адаптивный" режим управления электропитанием в настройках видеодрайвера плюс стандартная схема электропитания "сбалансированный".

во втором случае (nvidia, windows 10 pro consumer 1909) помогло убийство системы "диспетчер окон рабочего стола (DWM)" и сопутствующее вырезание из системы аппаратной визуализации (требуются минимальные знания в SQL плюс навыки работы с реестром и системными файлами windows), что повлекло за собой отключение всех визуальных эффектов рабочего стола, невозможность вызвать контекстные меню значков программ с панели задач, а также отключение vsync в режиме 2D.

полагаю, что виновником служит какой-то запущенный процесс в системе. советую использовать программу process explorer, в которой можно посмотреть, что и как грузит видеокарту. при открытии программы правой кн. мыши по вкладкам и выбрать "select columns", где во вкладке "process gpu" поставить галку "gpu usage". так ты увидишь все жрущие от видеокарты процессы и степень их загрузки, а оттуда уже легче будет гуглить.

P.S. совет выше про отсутствие энергопотребления при работе железа на максимальной частоте без нагрузки – бред. повышение частот даже в полном простое равно повышению энергопотребления.

legusor

Пишу верно. Process Explorer попробую, как будет время,спасибо.Вот кстати энергопотребление не глянул.

Не исключено что это наглый майнер шалит?

InboxM

если майнер шалит, то сами процессы вируса могут автоматически отключаться, если пользователь пытается открыть диспетчер задач, process explorer, process monitor монитор ресурсов и т.п. есть такие майнеры, которые себя подобным образом маскируют.

тот же монитор ресурсов, который можно вызвать через диспетчер задач, имеет полезную функцию – отслеживание выгруженных из памяти процессов. т.е. если на какое-то время, пусть даже секунду, монитор ресурсов windows успевает заметить процессную активность, но майнер вырубился для маскировки, это получится отследить. аналогично с process explorer.

можно еще самостоятельно посмотреть следующие пути:

c:\program data

c:\program files

c:\program files x86

c:\windows\temp

c:\users\%username%\appdata\local

c:\users\%username%\appdata\local\temp

c:\users\%username%\appdata\localLow

c:\users\%username%\appdata\Roaming

в случае с путями

c:\windows\temp

c:\users\%username%\appdata\local\temp

можно просто удалить все вообще.

еще можно через управление компьютером "просмотр событий", в разделе "журналы windows-приложение" поискать ошибки. возможно, что получится найти какую-то инфу с подозрительным процессом, а далее – в гугл.

так же можешь запуститься в безопасном режиме и посмотреть, есть ли проблема. сделать это можно через msconfig-загрузка, галочка "безопасный режим" (по ненадобности не забыть отключить).

еще посмотри автозапуск через msconfig или диспетчер задач и посмотри оснастку "планировщик заданий" (taskschd.msc). там, возможно, будут подозрительные приложения или задачи на запуск, что часто бывает в случае разных вирусов. в планировщике заданий открывай окно "библиотека планировщика заданий" и там смотри. открывать другие подпапки внутри не надо.

P.S. можешь скачать последнюю версию утилиты dr.web cureit и запустить ее от администратора, загрузившись в безопасном режиме.

Руководство покупателя игровой видеокарты

Производительность видеокарты определяется не только мощностью самого GPU. Любому чипу нужен большой объём выделенной памяти с высокой пропускной способностью при записи и чтении различных данных: текстур, вершин, содержимого буферов и т. п. Даже самый мощный видеочип можно «придушить» слишком малым объёмом видеопамяти, да ещё с медленным доступом, поэтому характеристики устанавливаемых микросхем памяти также являются одними из важнейших параметров современных видеокарт.

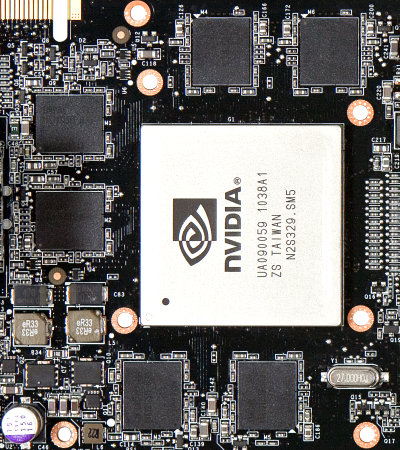

Микросхемы памяти, количество которых на некоторых моделях видеокарт достигает 24 штук, обычно располагаются на печатной плате вокруг видеочипа, на одной или обеих сторонах. В некоторых случаях для них не используется даже пассивное охлаждение, но часто применяется общий кулер, охлаждающий и GPU и память, а иногда и отдельные радиаторы. Вот так микросхемы памяти выглядят на GeForce GTX 590 со снятым устройством охлаждения:

Современные видеокарты оснащаются различным объемом локальной видеопамяти, но обычно он начинается от 512 МБ и может достигать 3 ГБ на один GPU (с удвоением объёма на двухчиповых видеокартах). Чаще всего на видеокарты low-end и mid-end сейчас ставят 1 ГБ памяти, а на high-end — 1,5-3 гигабайта на чип, но есть и исключения. Так, карты самого низкого уровня могут иметь и 512 МБ более быстрой памяти GDDR5, и 1-2 ГБ медленной DDR3.

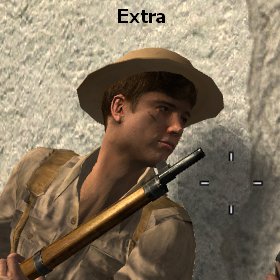

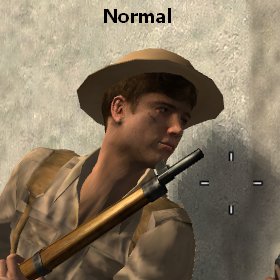

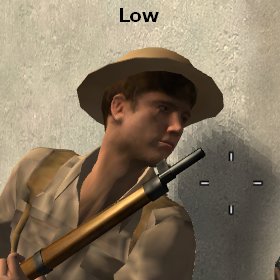

Чем больше выделенной памяти установлено на видеокарте, тем больше данных (тех же текстур, вершин и буферов) можно хранить в ней, не используя медленный доступ к ОЗУ компьютера. Причем, больше всего места занимают текстуры и различные буферы, а вот собственно геометрические данные обычно не слишком объёмны. Рассмотрим скриншоты из довольно старой игры Call of Duty 2 с разными установками качества текстур:

В этой игре, как и во многих других, автоматически настраивается качество текстур под имеющийся объём текстурной памяти. В данном случае режим Extra автоматически выставляется на видеокартах с 320-1024 МБ памяти, High или Normal — на 256 МБ, в зависимости от настроек разрешения и уровня антиалиасинга, а Low — на самых слабых GPU с 128 МБ. И даже если вы выставите максимальные настройки вручную, то на видеокарте с недостаточным объёмом видеопамяти для хранения ресурсов будет использоваться часть системной памяти, что приведет к серьёзным "тормозам" и отсутствию комфорта и плавности в игре.

В последнее время рост требований к объёму видеопамяти сильно замедлился, и виновато в этом засилие мультиплатформенных игр. Современные игровые консоли имеют лишь по 512 МБ памяти и поэтому разработчики игр ориентируются именно на этот уровень. Конечно, в ПК-версиях игр зачастую предусмотрены как текстуры большего разрешения, так и высокое разрешение рендеринга, что требует куда большего объёма видеопамяти. Но всё равно, объём памяти в 1 ГБ до сих пор вполне приемлем в подавляющем большинстве случаев. Кроме экстремальных настроек сглаживания и разрешения, вроде MSAA 8x и 2560×1600, соответственно.

Но даже уже устаревшим мультиплатформенным играм не хватает 512 МБ, они довольно требовательны к объёму видеопамяти, занимая до 600-700 МБ. И всё же, на данный момент минимальным необходимым объёмом локальной памяти для игровых видеокарт мы считаем 1 ГБ. Он же является и оптимальным для большинства моделей. Кроме видеокарт NVIDIA, имеющих 320- и 384-битную шины памяти — у них объём видеопамяти ещё более подходящий — 1280-1536 МБ. Но для топовых моделей уже востребован и больший объём, порядка 2 ГБ, что предлагают видеокарты серии Radeon HD 6900, и 3 ГБ, ставящиеся на некоторые модификации GeForce GTX 580. Тем более, что видеокарту всегда лучше подбирать с небольшим запасом.

К слову, в случае интегрированных видеоядер и устаревших дискретных видеокарт бывает так, что указанное на коробке количество видеопамяти не равно объему установленных на плату микросхем. Такое было ранее в случае видеоплат low-end, работающих с частью системной памяти при помощи технологий TurboCache (NVIDIA) и HyperMemory (ATI):

В характеристиках видеокарт с поддержкой этих технологий в маркетинговых целях указывался объём памяти (в т. ч. и часть ОЗУ), который может использоваться видеочипом, равный 128 МБ, в то время как в реальности на них установлен меньший объем — 16-32 МБ. Поэтому всегда нужно внимательно читать материалы нашего сайта, чтобы не попадаться на подобные ухищрения в будущем. Но пока что можно жить спокойно, ведь сейчас в таких видеокартах уже нет никакого смысла, их нишу прочно заняли интегрированные чипсеты.

С имеющимися разновидностями видеокарт по объёму локальной памяти мы разобрались, но ведь объём памяти для видеокарт — это еще не всё, и даже зачастую не главное! Очень часто бывает так, что на дешёвые видеокарты ставят очень большое количество памяти, чтобы нарисовать красивые цифры на их коробках и в описаниях готовых систем (поэтому их так любят сборщики — вспомните слоганы вроде «4 ядра, 4 гига»), с расчетом на то, чтобы они лучше продавались. Но для слабых видеокарт в повышенном объёме памяти никакого смысла нет, они ведь всё равно не смогут выдавать приемлемую частоту кадров на высоких настройках, в которых и используется большие объёмы текстур и геометрии.

Продавцы часто используют объём видеопамяти в качестве основной характеристики видеокарт, и это вводит в заблуждение простых покупателей, плохо знакомых с реальным положением дел. Сравним производительность решений с разным количеством видеопамяти на примере двух одинаковых видеокарт Radeon HD 6950, имеющих единственное отличие — на первой из них установлено 1 ГБ видеопамяти, а на второй — 2 ГБ. Любой менеджер по продажам скажет вам, что вторая видеокарта значительно лучше первой, кроме случаев, когда в магазине есть модели только с 1 ГБ памяти и редчайших случаев честных и компетентных продавцов. А что получается на самом деле? Есть ли великая разница? Посмотрим на цифры, полученные в игре Metro 2033, являющейся одной из наиболее требовательных:

Как видите, в большинстве игровых режимов объём видеопамяти влияет на производительность не слишком значительно — разница не превышает 5-6%. То же самое получается и в других играх, даже современных и ПК-эксклюзивных (что сейчас большая редкость). Лишь в сверхвысоком разрешении и с максимальными настройками качества появляется значимая разница, когда модель с 1 ГБ заметно отстаёт от более дорогой карты с 2 ГБ памяти — на 27%.

Казалось бы — вот оно, ради чего нужно платить деньги! Но посмотрите на цифры кадров в секунду при разрешении 2560×1600 — разве 18,9 FPS можно назвать комфортной скоростью? Нет. Что 14,9 FPS, что 18,9 FPS — эти цифры одинаково не имеют практического смысла, никто не будет играть с настолько дёрганой частотой смены кадров. Поэтому, с некоторым допущением, можно считать, что разница в объёме видеопамяти между 1 ГБ и 2 ГБ сейчас незначительно сказывается на скорости рендеринга, и сравнивать даже топовые видеокарты по количеству памяти не нужно.

Но речь шла только об объёмах памяти выше 1 ГБ. Да и 512 МБ для плат нижнего ценового диапазона сейчас вполне достаточны. В этих случаях, примеры, когда объём памяти начинает сказываться на производительности, весьма редки. Разработчики игровых приложений рассчитывают используемые в играх ресурсы и графические настройки так, чтобы все данные входили в локальную видеопамять наиболее распространённых на рынке видеокарт. То есть, сейчас это уровни 512 МБ (для low-end) и от 1 ГБ для всех остальных видеокарт, включая и высокие разрешения и максимальные настройки качества. А если видеопамяти меньше, то современные игры или будут тормозить или даже не дадут выставить максимальные настройки.

Но этот расчётный объем видеопамяти у игровых разработчиков растет, даже несмотря на засилие консолей и мультиплатформы. Ещё пару лет назад было вполне достаточно 512-640 МБ, а теперь появились проекты, в которых этот объёма недостаточно. Но даже среди самых последних игр таких проектов пока мало, но они уже появляются. Поэтому, в случае не слишком большой разницы в цене между видеокартами с разными объёмами памяти при прочих равных условиях (частота и ширина шины), следует покупать модель с большим объёмом. Но без погони за цифрами — никакой low-end карте не поможет пара гигабайт медленной DDR3-памяти. Такой объём ей на данный момент просто не нужен. Зато важен другой параметр, о котором мы поговорим далее.

Подробнее о пропускной способности памяти

Ещё одна важная характеристика, о которой мы уже писали — это пропускная способность памяти (ПСП), которая зависит как от частоты работы памяти, так и от ширины шины. Этот параметр определяет количество данных, которые теоретически можно передать в память или из памяти за единицу времени. Другими словами, это скорость, с которой графическое ядро может записывать и считывать различные данные в локальную видеопамять. Соответственно, чем быстрее считываются текстурные, геометрические и прочие данные, и чем быстрее записываются в буфер рассчитанные пиксели, тем выше будет общая производительность.

Пиковая пропускная способность памяти рассчитывается довольно просто — это произведение «эффективной» частоты памяти на количество данных, передаваемых за такт (ширина шины памяти). Например, для GeForce GTX 580 с шиной 384 бит и частотой видеопамяти 1002(4008) МГц, ПСП будет равна:

1002 МГц × 4 (передача данных с учетверённым темпом) × 48 (384/8 байт за такт) ≈ 192,4 ГБ/с

Естественно, что последнее нигде широко не афишируется. Для производителя узкая шина и дешевле в производстве, и позволяет удобнее масштабировать производительность решений линейки. И две одинаковые видеокарты с одинаковыми частотами, но с разной шириной шины памяти, будут сильно отличаться по производительности. Та, у которой ПСП больше, может обрабатывать большее количество данных, по сравнению с картой с меньшей разрядностью шины, хотя сами GPU у них совершенно одинаковые.

Рассмотрим очень жизненный пример — модель GeForce GTS 450 с двумя разными типами памяти, GDDR5 на более дорогой модели и DDR3 на дешёвой. Во время выхода на эту видеокарту ставили исключительно быструю GDDR5-память с приличной пропускной способностью. Но когда её время прошло и она спустилась в нижний ценовой диапазон, производители начали экономить, выпуская варианты с DDR3-памятью, которая гораздо дешевле. Результат подобной экономии можно пронаблюдать на следующей диаграмме:

Как видите, всё очень печально для DDR3-варианта — даже в далеко не самой новой игре разница в различных разрешениях экрана составляет от 50 до 70%! То есть, мощность GPU во всех протестированных условиях ограничена медленной видеопамятью. Модель с DDR3 просто не может считывать и записывать данные с теоретически возможной скоростью. Таким образом производители вместе с компанией NVIDIA снизили себестоимость модели, спустив её ещё ниже в бюджетный сегмент.

Поэтому при выборе между видеокартой с бо́льшим и меньшим объёмом видеопамяти нужно всегда смотреть на тактовые частоты, ширину шины и цены! Так, при большой разнице в ценах между двумя решениями среднего и низшего уровней с 1 ГБ и 2 ГБ памяти нет смысла гнаться за дорогим вариантом — видеокарта такого уровня просто не получит большой прибавки в производительности от увеличенного объёма. Но если приходится выбирать между видеокартами с разным объёмом памяти и разной ПСП, то тут выбор уже не так однозначен, и нужно его совершать исходя из того, какого уровня видеокарта и насколько разнятся их частоты. Не забывая и про цену, естественно.

Например, при выборе между топовой видеокартой с 1,5 ГБ памяти и более высокими тактовыми частотами против такой же карты но с 3 ГБ памяти со стандартными частотами и более высокой ценой на данный момент выгоднее будет первая видеокарта, так как она обеспечит даже бо́льшую производительность почти во всех режимах и условиях, кроме самых высоких разрешений. То же касается, к примеру, GeForce GTS 450 с 1 ГБ GDDR5-памяти против GTS 450 с 2 ГБ DDR3 — первый вариант точно будет быстрее. В большинстве режимов видеокарты бо́льшая частота и ширина шины играет значительно более важную роль, чем бо́льший объём видеопамяти, и только в высоких разрешениях увеличенный объем может серьёзно сказаться на скорости рендеринга.

Вот примерно так часто появляются темы на форумах. Почему это чушь, и почему объём памяти совсем не так уж и важен - я подробнее писал об этом вот здесь. Если коротко –то не в памяти дело, вернее, не только в памяти.

Но объём её всё равно важен. Хотя бы потому, что его указывают в системных требованиях к играм. И пусть эти “системные требования” – часто сильно усреднённая штука, но цифры там вполне конкретные, и они хоть как-то показывают, какими примерно характеристиками должен обладать компьютер для того, чтоб эту игру запускать. Насколько важно количество видеопамяти-можно узнать только в сравнении, по тестам; их много в интернете. Один из примеров- есть здесь, это всего лишь ссылка, найденная за пару секунд в Google. Но даже из неё ясно, что видеокартам среднего уровня (а мобильные в большинстве своём относятся именно к таким, и ниже) практически всё равно, 512мб или 1гб памяти на неё есть- это не даёт сколько-нибудь ощутимых преимуществ, отличающихся от обычной погрешности в таких тестах.

Какие бы не были системные требования игры или программы, может возникнуть необходимость проверить, а сколько же в реальности игра этой самой видеопамяти потребляет. Хотя бы для того, чтоб не ломиться сразу в интернет с вопросом, на что поменять видеокарту в ноутбуке потому,что у неё – “всего” 512мб на борту.

Путаницу вносит и тот факт, что на ноутбках дискретные карты умеют оперировать двумя типами памяти. Первый –это собственная память, собственный чип видеокарты, относительно небольшого (в сравнении с следующим типом) объёма. Второй- это т.н. “разделяемая память” (“shared memory”), память, которая выделяется видеокарте из оперативной по необходимости (повторюсь, я про это писал здесь.) Значит, если у видеокарты 512мб собственной памяти, то при требованиях игры в 1гб она вообще не пойдёт? Или всё-таки будет использована shared memory, а её много, и с запасом больше (пара гигабайт?)

Вот для этого и нужен мониторинг и средство, которое позволило бы определить, сколько ресурсов ваша любимая игра “съедает”.

Стандартные тестовые пакеты вроде Aida и подобных такой возможности не дают- ну или вернее, дают её очень ненаглядным и неудобным способом. Вот так это выглядит в Aida:

Отображение загрузки в процентах тут позволяет увидеть только то, что творится в данную секунду, не давая возможности мониторинга. Т.е. запустив игру и свернув её, вы увидите тут не реальные текущие данные, а результат сворачивания, когда большая часть ресурсов не используется.

Чтоб было хорошо- используем одну из лучших утилит всех времён и народов – Process Explorer (а здесь - страница на русском, но утилита всё равно на английском).

Описывать все её возможности смысла нет, это сделано многократно в интернете. Сейчас нас интересует возможность проверки нагрузки на видео.

После запуска программы в верхней части окна будут видны графики, показывающие различную текущую информацию о процессах в системе, 6-ой слева (или 2-ой справа) нас и интересует. Двойной щелчёк по нему открывает окно, относящееся к видеоподсистеме. Туда же можно попасть, выбрав пункт “System Information” из меню “View”.

Здесь GPU Usage- это загрузка видеочипа, GPU Dedicated memory –использование собственной памяти видеокарты, и GPU System Memory- количество используемой оперативной. На скриншоте выше- ситуация, когда запущено несколько программ и включен Aero, на скриншоте ниже- тот же набор программ, но Aero выключен.

Происходит такое потому, что при включении Aero прорисовку интерфейса Windows берёт на себя видеокарта, а при отключении –как и в ХР, процессор. Соответственно изменяется и нагрузка на процессор. Кстати, с оперативной памятью системы – такая же ситуация, со включенным Aero система использует примерно на 50мб больше оперативки, чем без него.

Как посмотреть, насколько были задействованы ресурсы видеокарты во время игры? Запускаем Process Explorer, сворачиваем, запускаем игру. На графике отображается ~5 минут событий, обновление графика –каждую секунду.

Можно изменить время обновления графика, от полусекунды до 10-и секунд (меню “View”-“Update interval”, относится к данным во всей программе). Есть смысл ставить 10 секунд, получив усреднённые данные за больший период времени.

Для примера – в Fallout3 на максимальных настройках качества ресурсы видеочипа у меня (это видеокарта geforce 9600m gt ddr3 512mb в ноутбуке с 4gb опертивки и процессором core3duo P8600) использовались примерно наполовину, а загрузка видеопамяти составляла не более 400 мегабайт.

Читайте также: