Влияет ли разрешение экрана на fps

Вопрос многим должен показаться очень глупым, да и мне самому стыдно это не понимать, учитывая то, на кого я учусь, но все же.

Из-за слабенькой видеокарты в некоторых играх разрешение меньше ставлю, чтобы повысить фпс. Например, в последнюю часть местро приходилось маленький экранчик делать, чтобы поиграть в шедевр. Но почему же? Я могу понять, когда влияет на фпс сглаживание, тени, текстуры, но разрешение. Ведь просто размер экрана меняется.

Как ты думаешь,почему Full HD видео весят так много , те же картинки с разрешением 4-5к. Объясню проще,чем выше разрешение,тем больше количество точек на дюйм приходится,представь разницу теперь в 1024х768 и 1920х1080,какой из них обработать труднее ? И вся эта нагрузка идет на твою видеокарту.Отсюда и влияние на фпс,поскольку разрешение экрана напрямую влияет на производительность,ровно так же,как и уровень детализации в игре или любые другие настройки.

От разрешения зависит количество пикселей. Естественно, если выставляешь значение разрешения выше, то и увеличивается количество пикселей, которые, в свою очередь, нагружают твою видеокарту и наоборот.

От выбранного разрешения экрана зависит, сколько пикселей прийдется обрабатывать видеокарте. Меньше разрешение -меньше пикселей - выше производительность - хуже качество.

Как ты думаешь,почему Full HD видео весят так много , те же картинки с разрешением 4-5к. Объясню проще,чем выше разрешение,тем больше количество точек на дюйм приходится,представь разницу теперь в 1024х768 и 1920х1080,какой из них обработать труднее ? И вся эта нагрузка идет на твою видеокарту.Отсюда и влияние на фпс,поскольку разрешение экрана напрямую влияет на производительность,ровно так же,как и уровень детализации в игре или любые другие настройки.

О, спасибо. Я как-то предполагал, что картинка по кадрам обрабатывается, а не по каждому пикселю. Это же какая видеокарта должна быть у людей, которые телевизоры размером с окно вместо мониторов используют?

Вопрос многим должен показаться очень глупым, да и мне самому стыдно это не понимать, учитывая то, на кого я учусь, но все же.

Из-за слабенькой видеокарты в некоторых играх разрешение меньше ставлю, чтобы повысить фпс. Например, в последнюю часть местро приходилось маленький экранчик делать, чтобы поиграть в шедевр. Но почему же? Я могу понять, когда влияет на фпс сглаживание, тени, текстуры, но разрешение. Ведь просто размер экрана меняется.

Чем больше разрешение(PPI) экрана, тем больше разрешение(PPI) текстур, а соответственно они весят больше, их надо где то хранить, они помещаются в видео память, то-есть если мало видеопамяти могут быть просадки фпс в некоторых играх при большем разрешении.

Около 2% всех геймеров в Steam имеют монитор с разрешением дисплея 4К. Ещё 6% владеют мониторами с разрешением 2К. Это очень мало, но количество пользователей с подобными мониторами растёт. Предположим, вы купили монитор, принесли домой, запустили игру в разрешении 4К и увидели слайд-шоу в 5 fps. В таком случае у вас есть несколько простых вариантов: купить новый компьютер за несколько тысяч долларов, или понизить разрешение экрана.

реклама

Странно, но ведь именно для игр в разрешении 4К и 2К вы покупали дорогой монитор. Предположим, вы ещё не определились с тем, какой из двух способов решения проблемы выбрать. Что же, давайте послушаем ребят с сайта Gecid, которые провели большое тестирование и могут нам рассказать, насколько увеличивается количество кадров в секунду после снижения разрешения, а так же, как замена видеокарты влияет на этот показатель.

Первым делом будут тесты с самыми низкими настройками графики с видеокартой GeForce RTX 2080 Ti. Ясно, что у вас не такая видеокарта, но ничего не поделать, в лаборатории Gecid на этом этапе только флагманские модели.

Как видите, практически во всех играх при смене разрешения fps меняется незначительно и только при переходе к 4К резко проседает на 26-30%. Очень показательно, но кто, купив GeForce RTX 2080 Ti, играет на низких настройках? Ниже тесты на максималках.

Падение fps оказалось нелинейным и проседает медленно до разрешения 2К, после чего резко падает на 4К. В оригинальном материале есть ещё тесты с видеокартой Radeon RX 5600 XT, но там примерно такая же тенденция, а значит нет смысла повторяться. Суть проблемы в том, что падение производительности при переходе от меньшего разрешения к более высокому разнится от игры к игре. Всё дело в оптимизации. Где-то fps превращается в слад-шоу ещё на 2К, а где-то бодро идёт и на 4К. Ясно, что зависимость есть, но эксперты рекомендуют подбирать разрешение отдельно к каждой игре, а иначе в некоторых проектах на 2К ваша система будет тормозить, а в других – вы с лёгкостью можете переключиться на 4К.

реклама

В качестве тестового стенда выступил компьютер на базе процессора AMD Ryzen 7 3700X, материнской платы MSI MEG X570 GODLIKE и 16 Gb оперативной памяти CORSAIR VENGEANCE RGB PRO на частоте в 3600 MHz.

Начнём с 2080 Ti. Её тестировали на минимальных и максимальных настройках графики в разрешениях 720р, 900р, 1080р, 1440р и 4K в 7 различных играх. На минималках в Assassin`s Creed: Odyssey почти не было разницы между тремя начальными разрешениями и реальное снижение производительности можно наблюдать лишь в 1440р и 4К. Похожий результат наблюдается и в Borderlands 3. А в Gears 5 и Metro: Exodus схожую производительность показали уже 4 разрешения из 5.

|  |

|  |

|  |

|  |

По результатам тестов в 7 играх реальное снижение производительности можно обнаружить лишь в самом высоком разрешении. Хотя от себя я пожалуй добавлю, что Ryzen 3700X далеко не самый подходящий процессор для подобного теста, а данные результаты могли быть вызваны банальным ботлнеком с его стороны. В максимальных настройках разница уже более различима и судя по результатам 7 игр снижение разрешения с 1080p до 720p может дать 17% прибавку к производительности. Повышение же с 1080р до 4k понижает FPS на 48%.

|  |

|  |

|  |

|  |

Ну а напоследок были протестированы более слабые карты RX 5600XT и RX 5500XT. Они продемонстрировали наиболее чётко выраженную зависимость FPS от разрешения экрана

|  |  |

|  |  |

Из всего этого теста можно сделать лишь один вывод: далеко не на каждой системе снижение разрешения экрана обязательно приведёт к росту производительности. Перформанс будет зависить от множества факторов и будет разниться от системы к системе, да и особенности оптимизации самих игр сбрасывать со счетов тоже не стоит.

Всем привет! С вами Zero, и сегодня я расскажу, почему я предпочитаю 24-дюймовый FullHD монитор с частотой обновления 144 Гц более крупным моделям с более высокими разрешениями, а в дальнейшем, вероятно, снова куплю 24-дюймовую FullHD модель, но уже на 240+, а скорее всего, на 360+ Гц с поддержкой технологий адаптивной синхронизации.

Предисловие

реклама

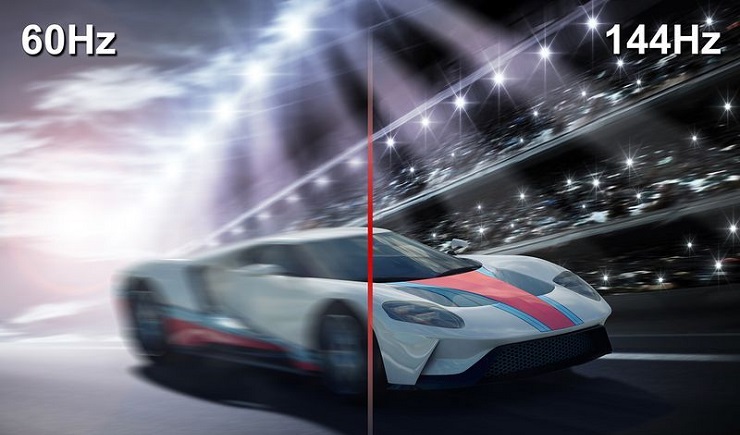

Кто бы что ни говорил, разница между 30 и 60 FPS хорошо заметна. Включите какой-нибудь фильм с 24-30 кадрами в секунду и остановите кадр на динамичной сцене, например, демонстрирующей быстрое движение автомобиля или бег человека. Вместо четкого объекта вы увидите его размытый силуэт. Некоторые кинолюбители считают motion blur художественным приемом, который якобы только улучшает восприятие фильма – по их словам, с большим количеством кадров кино выглядит «как новостной сюжет или любительская съемка», но это все чушь.

На самом деле, 24-30 кадров в фильмах – отвратительное, анахроничное наследие эпохи кинопленки. Сейчас при помощи специальных цифровых камер можно снимать хоть 240, хоть 360, хоть 960 кадров в секунду – существуют и устройства с гораздо более высокими значениями, но они уже нужны только для отдельных задач вроде замедленной съемки лопастей вентилятора, крыльев насекомого, а то и вовсе лучей света. Лично я хочу иметь возможность в любой момент остановить фильм и рассмотреть детали сцены в кристальной четкости, а для этого нужно много кадров в секунду, а не нынешние 24-30 или даже 48. Надеюсь, со временем киноиндустрия уйдет от устаревших стандартов – это все равно что, если бы сейчас мы смотрели не цветное кино, а черно-белое. Может, в отдельных картинах, где это подчеркивает идею режиссера, это и уместно, но в целом – нет.

Что не так с вертикальной синхронизацией

![]()

реклама

Упомяну в статье и про вертикальную синхронизацию (программную, в настройках игры или драйвера видеокарты). Задача этой технологии – предотвращать разрывы кадра вроде того, что на картинке выше, и она успешно это делает…но ценой увеличения фреймтайма и инпут-лага (задержки управления). Для большинства одиночных игр это не критично, если же вы предпочитаете сетевые проекты, и при этом играете на 60 Гц мониторе с высоким FPS, например, 150+, лучше не включайте V-Sync. Включение этой технологии нивелирует ваше преимущество над игроками с менее мощным железом. Если у вас обоих пинг 50 мс, и вы одновременно выбегаете из-за разных углов на открытое пространство, то, при прочих равных, у кого больше FPS, тот находится в более выгодном положении, а включая V-Sync, вы отказываетесь от этого бонуса.

Следующий логичный вопрос – а когда же вертикальную синхронизацию включать стоит? Если ваш монитор не поддерживает технологии адаптивной синхронизации, включать V-Sync стоит в одиночных играх, в которых сильно бросаются в глаза разрывы изображения. Чаще всего они заметны в катсценах, но иногда и непосредственно в процессе игры. Если ваш монитор поддерживает G-Sync, AMD FreeSync или Adaptive-Sync – лучше попробуйте их.

Есть ли смысл от частоты кадров выше 60 на 60 Гц мониторе и что такое фреймтайм

![]()

Теперь кратко расскажу о том, есть ли смысл от, условно говоря, 200+ FPS на 60 Гц мониторе или от 300+ на 144 Гц мониторе. Да, есть! Во-первых, всегда стоит иметь запас как минимум в несколько десятков кадров в секунду превышения над комфортным FPS, чтобы в особо нагруженных сценах не ощутить неприятную просадку, которая будет выглядеть как микрофриз. Во-вторых, если ПК способен выдать в секунду больше кадров, то и на мониторе может быть показан более актуальный и свежий кадр, хотя, конечно, если ваше железо выдает много FPS – лучше купите и подходящий монитор на 240-360+ Гц. К счастью, сейчас уже хватает приличных моделей на IPS и VA матрицах, и мириться с недостатками TN нет необходимости. Но, повторюсь, больше FPS – всегда хорошо, даже если у вас монитор на 60 Гц, поскольку он будет отображать максимально актуальную картинку. Есть ли какой-то предел, свыше которого FPS наращивать нерационально? Не знаю, тут нужны двойные слепые плацебо-контролируемые исследования, как при проверке медицинских препаратов – надеюсь, компании, выпускающие оборудование для геймеров, игровые СМИ или блогеры со временем их проведут, причем с соблюдением научных стандартов для таких исследований, чтобы их можно было потом воспроизвести. Предположу, что фреймтайма в 1-2 мс будет хватать с лихвой.

Фреймтайм (время отрисовки кадра) – это время, которое кадр находится на экране, пока готовится следующий кадр. Например, при 60 постоянных FPS и 60 Гц кадр будет меняться примерно каждые 16.7 мс, а при 150 постоянных FPS и Гц — примерно каждые 6.7 мс. Адаптивные возможности человеческого организма, включая зрительный аппарат и мелкую моторику, велики, и со временем вы научитесь извлекать выгоду от меньшего фреймтайма, особенно в шутерах. Так, NVIDIA сообщает, что при 180 FPS результаты игроков в CS: GO и PUBG значительно лучше, чем при 60 FPS.

Не стоит забывать и о том, что из-за разной нагруженности сцен, например, при 30 средних FPS фреймтайм каждого кадра может быть 33.3 мс, но если одни сцены очень «легкие» а другие, напротив, «тяжелые» (взрывы, дым и другие эффекты), то одни кадры могут отрисовываться за 15 мс, а другие – за 80 мс, что будет восприниматься как неприятные тормоза и микрофризы. Запомните: «больше FPS – всегда хорошо»! Разница между 15 мс и 80 мс колоссальна и легко ощущается людьми на глаз, а вот увидит ли среднестатистический homo sapiens разницу между 1 и 4 или 3 и 6 мс – вопрос, на который могут ответить только исследования. В идеале, ваше железо должно выдавать столько кадров в секунду, чтобы даже очень редкие 0.1% low FPS события оставались в рамках комфортного фреймтайма. Для тех, кто не понимает, о чем речь – на оверах есть хорошая, хотя и слишком математическая для большинства читателей статья, «Показатели игровой производительности».

Почему показатели FPS и Гц для меня важнее, чем разрешение

![]()

Думаю, из моего предисловия вы поняли, почему низкая частота кадров – это плохо. Если не поняли – попробуйте в какой-нибудь игре искусственно ограничить FPS – поставьте сначала 8, потом 16, потом 24, 30, 48, 60, а дальше – 120 или 144 и без ограничений. При низком FPS вместо приятной плавности в динамичных сценах мы видим размытые силуэты и рывки или микрофризы. На мой взгляд, играть с разрешением FullHD (1920 на 1080 пикселей) и частотой кадров 144+ НАМНОГО приятнее, чем с разрешением 4K (3840 × 2160 пикселей) и частотой кадров 30+ или даже 60. «А почему бы не совместить?» – спросите вы. Потому что видеокарты не тянут в требовательных современных играх разрешение 4K, максимальные настройки графики, а также хотя бы 120+ кадров в секунду. В Cyberpunk 2077, если поставить 4K и выкрутить все ползунки на максимум, не выдаст нужной частоты кадров даже RTX 3090.

реклама

У меня сейчас RTX 3060 Ti, и играть с ней в уже не новые тайтлы вроде The Witcher 3 очень комфортно и приятно – в «Ведьмаке» частота кадров не опускается ниже 144. Как консольщики играют в режиме 30 FPS – не понимаю, я пробовал искусственно поставить такой лимит. Рывки, размытость при резком повороте камеры…еще и настройка часто в консольных играх для размытия специальная есть – якобы это не стремное железо и плохая оптимизация, а «кинематографичная» фишка такая. Ага, фишка…

Заключение

Полагаю, в рамках этой статьи я достаточно подробно изложил, почему считаю, что FPS, фреймтайм и частота обновления экрана гораздо важнее для комфортной игры, чем разрешение, хотя среди геймеров на эту тему бытуют разные мнения. А что по этому поводу думаете вы? Пишите в комментариях. Если нашли какие-то технические ошибки – тоже пишите, я открыт к критике.

Подпишитесь на наш канал в Яндекс.Дзен или telegram-канал @overclockers_news - это удобные способы следить за новыми материалами на сайте. С картинками, расширенными описаниями и без рекламы.

Судя по статистике нашего региона, у большинства пользователей дисплеи с разрешением 1920 x 1080. Поэтому львиную долю тестов видеокарт мы делаем именно в FHD. Реже в QHD и 4K UHD. Последнее больше касается топовых акселераторов.

Но под нашими видео вы часто просите протестировать тот или иной видеоускоритель в 900p или даже 720p. Мы очень любим нашу аудиторию и прислушиваемся к ней. Но, к сожалению, при всем желании на это попросту не хватает ни времени, ни свободных рук. И этим материалом мы попробуем пролить свет на данную тему.

Напомним, что разрешение монитора – это количество пикселей по ширине и высоте экрана. И чем это значение выше, тем больше объем данных обрабатывается вашей видеокартой. Теоретически, зная площадь отрисовки, можем прикинуть итоговую производительность при смене разрешения. Например, для FHD умножаем 1920 х 1080, а для HD – 1280 х 720. Делим результаты и получаем коэффициенты роста и уменьшения производительности. В данном случае это 2,25 и 0,44 соответственно.

Но это только в теории. Ведь видеокарта не только раскрашивает точки, но и налаживает текстуры, просчитывает тени, различные фильтры и эффекты, а также делает реалистичное освещение, отражения и многое другое. В таком случае ей нужно оперировать большими массивами данных. И тут важную роль играет не только центральный процессор, но и пропускная способность внешних и внутренних шин, объем и скорость видеопамяти, оперативки и даже накопителей. Поэтому мы решили все проверить на практике.

За его охлаждение отвечает 2-секционная СЖО NZXT Kraken X53. Она получила алюминиевый 240-мм радиатор, который увеличен в толщине до 30 мм против привычных 27. Длина соединительных шлангов составляет 400 мм. Они достаточно гибкие и облачены в тканевую оплетку, а на противоположном конце находятся поворотные фитинги.

Видеокарта у нас одна из самых быстрых игровых решений – ASUS ROG STRIX GeForce RTX 2080 Ti.

Материнская плата – мегафункциональная и надежная – MSI MEG X570 GODLIKE формата EАТХ.

Для чипов Matisse компания AMD рекомендует использовать оперативную память с частотой 3600 МГц. В нашем случае это набор CORSAIR VENGEANCE RGB PRO 16GB DDR4-3600. 16 гигабайт должно хватить для любых игр и настроек.

Дисковая подсистема представлена парой быстрейших NVMe-накопителей. Операционка и часть игр установлены на терабайтный ADATA XPG SX8200 Pro. Он построен на чипах Micron TLC 3D NAND второго поколения, имеет тонкий черный радиатор и интерфейс PCI Express 3.0 х4.

Все остальное поместилось на двухтерабайтный Seagate FireCuda 520 с интерфейсом PCI Express 4.0 х4.

За качественное и бесперебойное питание отвечал SeaSonic PRIME TX-750 TITANIUM на 750 Вт. Он имеет сертификацию 80PLUS Titanium и перечень всевозможных защит, не говоря уже о всех необходимых коннекторах.

Упомянутые «железки» без проблем разместились в корпусе-трансформере RIOTORO GPX100 MORPHEUS. Он имеет полностью модульную конструкцию: все панели и лоток материнской платы могут менять высоту. В зависимости от сценария можно получить Midi Tower с восемью слотами расширения или Mini Tower с пятью.

Качественную картинку обеспечил «безрамочный» 27-дюймовый Ultra HD-монитор AOC U2790PQU. Захват видео происходил с помощью внешний системы с AVerMedia Live Gamer Portable 2 Plus.

Перед самим тестом хочется напомнить несколько важных моментов! Во-первых, использовались проекты со встроенными бенчмарками производительности, что дает хорошую повторяемость результатов. Во-вторых, все игры запускались на минимальных и максимальных настройках графики в пяти разрешениях: 1280 × 720, 1600 × 900, 1920 × 1080, 2560 × 1440 и 3840 × 2160. И в-третьих, все прогонялось по три раза и бралось среднее значение, дабы уменьшить погрешность измерения.

Переходим к тестам. Начнем с минималок. В Assassin’s Creed Odyssey переход с 1080p к 900p и 720p лишь немногим увеличивает среднюю скорость. Но в последнем случае ощутимо улучшается статистика редких событий. В 1440p и 2160p производительность падает на 20% и 30% соответственно.

В Borderlands 3 похожая картина: уменьшение разрешения добавляет лишь несколько кадров к итоговым результатам. Любопытно, что в QHD FPS снижается незначительно. А вот в 4K UHD средняя скорость упала больше чем на 40%.

В Gears 5 переезд с FHD в более низкие разрешения дает плюс 3-6 FPS. В QHD количество кадров слегка уменьшается, причем 1% Low больше. Забегая вперед: в этой игре мы получили наименьшее падение показателей для 4K UHD среди всех протестированных проектов.

В Metro Exodus понижение разрешения добавляет 1-2 кадра/с к средней скорости. Переход в 1440p отнимает каких-то 3 FPS. Во всех случаях статистика редких событий без изменений. А вот в 2160p падение производительности составляет уже внушительные 30%.

В Red Dead Redemption 2 уменьшение разрешения поднимает показатель 1% Low на 3-6 кадров/с. По средней скорости разница еще менее заметна. В QHD показатели уменьшаются на 14%. Переход в 4K UHD снижает производительность более чем на 45%.

В The Division переход с 1080p к 900p и 720p добавляет максимум 7-8 FPS. Разница с 1440p практически незаметна. А вот в 2160p показатели падают на 16-25%.

В World War Z уменьшение разрешения дает буст в 2-13 FPS. В QHD получаем минус 11 кадров/с. В 4K UHD статистика падет более чем на 25%.

В среднем на минималках по 7 играм переход с FHD к HD+ улучшает статистику на 1-2%. Используя HD-разрешение, можно рассчитывать на дополнительные 3-5% FPS. Переход в QHD снижает производительность на 7%, как по средней скорости, так и по редким событиям. А вот в 4K UHD показатели падают на 26-30%.

В теории мы должны были получить линейное изменение производительности. Но на деле все не так красиво. Хотя по мониторингу ресурсов хватает, но мы не исключаем, что уперлись в какой-то из компонентов системы. А может где-то и в ограничение игровых движков или API.

Да, в реальности никто из обладателей мощной видеокарты не будет играть с минимальными настройками графики. Поэтому переходим к максималкам.

В Assassin’s Creed Odyssey переход в 900p не приносит никаких дивидендов. 720p добавляет сверху 7 FPS. Повышение разрешения более ощутимо бьет по производительности. И если в 1440p скоростные показатели падают на 2-9 кадров/с, то в 2160p разница доходит до 35%.

В Borderlands 3 уже веселее: снижаем разрешение и получаем дополнительные 7-30 кадров за секунду. В QHD скорость падает на 21-28 FPS. Переход в 4K UHD отнимает до 60% FPS.

В Gears 5 низкие разрешения приносят бонус до 8 кадров/с, а сверхвысокие – «кушают» от 14 до 48 FPS.

В Metro Exodus понижение разрешения добавляет к средней скорости 6-11 FPS. Очень редкие события остаются без изменений. В 1440p статистика падет на 2-11 кадров/с. В 2160p скоростные показатели снижаются максимум на 42%.

В Red Dead Redemption 2 при HD+ и HD-разрешении получаем сверху до 6-13 FPS. Переход в 2K и 4K снижает производительность на 11-46%. Причем больше просаживается показатель 1% Low.

В The Division 2 снижение разрешения благоприятно сказывается на скоростных показателях. В 900p получаем дополнительные 24 FPS, а в 720p – более 30. Переход в 1440p чреват потерей до 37 кадров/с. В 2160p показатели падают максимум на 60%.

В World War Z переход в HD+ улучшает среднюю скорость лишь на пару кадров, зато к статистике редких событий прирастает 9 FPS. В HD получаем плюс 16-23 кадра/с. Использование QHD «съедает» 19-39 FPS. В 4K UHD разрыв доходит до 56%.

Суммарно на максималках по 7 играм: переход с 1080p до 900p обеспечивает бонус 5-10%, а в 720p средний рост производительности составил 9-17%. При использовании 1440p скоростные показатели падают на 13-19%. С 2160p статистика уменьшается на 41-48%. Как видите, разрыв увеличился, но все так же нелинейно.

Почему я не хочу брать для игр монитор больше 24-27 дюймов, и что такое ppi

Расскажу и о том, почему мне максимально комфортно c 24-дюймовым FullHD монитором. Если монитор слишком крупный, с большой диагональю, в процессе гейминга придется слишком много «бегать» глазами – дальнее периферическое зрение улавливает изображение гораздо хуже, чем центральное, хорошо улавливает оно в основном только движение. Мои глаза находятся примерно на расстоянии 80-100 см от экрана монитора (я специально взял рулетку и измерил), и при зрении, близком к «единице», я не вижу на нем отдельных пикселей, но охватываю центральным и центрально-периферическим зрением значительную его часть.

реклама

Если бы я купил, например, 34-дюймовый монитор, то в играх не смог бы следить за всем сразу с таким же комфортом, как сейчас – пришлось бы постоянно переводить взгляд с одной зоны дисплея на другую. Вот телевизор можно брать гораздо более крупный, потому что зритель сидит от него на расстоянии нескольких метров. Но у меня телевизора вообще нет, потому что, если долго его смотреть, можно начать считать, что Путин – великий президент, в России все хорошо, нет ни падения реальных доходов, ни цензуры, и на внешнеполитической арене страна тоже действует правильно, только вот злой Запад строит козни, иначе бы уже всех догнали и перегнали.

Теперь о показателе ppi. Ppi – это сокращение от «pixels per inch», «пиксели на дюйм». Это единица измерения разрешающей способности монитора. Вычислить ppi можно по формуле:

Если показатель ppi слишком низкий, изображение выглядит «зернистым», что особенно хорошо заметно при увеличении. Это наглядно демонстрирует картинка ниже:

Какой показатель ppi считать комфортным? Это зависит от вашего зрения, личных предпочтений и того, как далеко ваши глаза находятся от экрана. Лично мне при использовании 24-дюймового FullHD монитора хватает и ppi чуть выше 90, кому-то же такая картинка может показаться недостаточно четкой. Но, на мой взгляд, для большинства игр важнее непосредственно игровые настройки графики и FPS/фреймтайм/герцы, а не разрешение.

Читайте также: