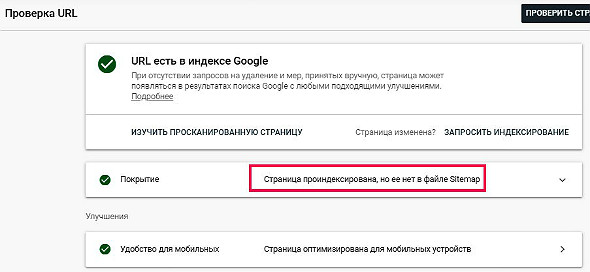

Страница проиндексирована но ее нет в файле sitemap что это значит

У Вас же идёт 301-й редирект на динамический сайтмап, генерируемый плагином.

Да - и где вы там видите старье?

Насколько я себе представляю, плагин писали не дураки, и поисковики успешно читают динамический сайтмап. Но ссылку на него, на мой взгляд, лучше дать прямую, без редиректа. А то, что чего-то нет в сайтмапе - это скорее всего имеется в виду старый архив.

У динамического сайтмапа преимущество - он вроде как сам обновляется. А статичный Вам самому придётся обновлять, вручную или по крону.

В том-то и беда, что в Sitemap регулярно не попадают свежие записи, я выше приводил пример.

Причем у этой записи SEO: Хорошее.

Да хоть выше, хоть ниже. В таких случаях обычно советуют купить на базаре курицу. 😂

В когорте Хадов пополнение? Найс…

Тигранчик, вместо того, чтобы плодить тонны бессмысленного флуда здесь, хотя бы раз пробежался по настройкам Yoast, почитал доки и написал нормальный robots.txt (то, что я вижу сейчас - донное дно). После этого остался бы один более менее законный вопрос для тут "как без аддурилки скормить robots.txt Гуглю?"

PS - на вопрос "почему донное дно" я отвечу только "патамушта", такшо не утруждайтесь

Я вам не Тигранчик, и на брудершафт вроде тоже не пили. Тролльте в другой теме - здесь я рассчитываю на помощь, без пустопорожних нотаций и общих фраз ни о чем.

Текущая статистика такая:

- записей в блоге ~3200

- страница отправлена и проиндексирована ~2800

- страница проиндексирована, но ее нет в файле Sitemap ~500

При этом эти 500 проиндексированных, но отсутствующих в Sitemap ссылок - какой-то мусор (ссылки на реальные страницы сайта, но через ссылки давно удаленного форума), я сделал по ним запрос Удалить URL-адреса. И одновременно существует ~400 нормальных записей, которых нет ни в отправлена и проиндексирована, ни в проиндексирована, но ее нет в файле Sitemap.

Я слышал, что недавно в Google были крупные изменение, но чтобы до такой степени. Раньше любая запись буквально через минуты попадала в выдачу.

Бороться с Google Search Console, индесациями и пр залипухами ПС нужно в СЕОшных разделах.

Заголовок публикации отображает ответ системы в панели управления нового вебмастера Гугл.

Если ваш взгляд «спотыкался» на этом месте, то, скорее всего, вы начинали проверять свои:

- плагин Google XML Sitemaps;

- саму карту sitemap.xml по адресу сайта

После всех проверок получалось, что все вроде бы работает, а вебмастер, после добавления

новых страниц, упорно пишет:

У меня так и было.

Впервые обратил внимание на это предупреждение при отправке в индекс новых публикаций сайта на Битрикс.

Там плагина нет, но в модулях проверил, перепроверил, запустил создание нового файла карты, подождал некоторое время – в Google вебмастере по-прежнему: «…но ее нет в файле Sitemap».

Еще думал – возможно, только Битрикс не «отсвечивает» свои страницы в Sitemap, но оказалось и карты сайтов на WordPress не видит вебмастер.

Решил, что это сбой у Гугла (и там сбои бывают), не буду обращать внимания. Тем более что в поиске Google все эти страницы присутствуют.

Решил – забыл. Но ненадолго…

Практически каждый день приходится что-то добавлять в вебмастера, и это предупреждение постоянно смущает!

Нужно поинтересоваться у всезнающего Интернета – зашел, спросил.

А там уже давно это обсуждают и очень многие не могут понять «…а в чем же дело?». Все так же перепроверяют, поломок не находят, спрашивают на форумах, строят догадки.

Из ответа следует, что все страницы в Sitemap на самом деле есть.

Но Гугл и Яндекс, не гарантируют индексацию их всех (страниц) именно с карты xml сайта.

То есть – страница и без карты проиндексируется и попадет (если она качественная) в поиск, а вот индексировать ее в файле Sitemap совсем и не обязательно. В первую очередь это касается страниц с малозначительным контентом. Я так понимаю – это не плохие страницы, а просто не несущие новой полезной информации.

У вас есть свое мнение, информация? – пишите в комментариях

А вы вообще пользуетесь вебмастером Google и новой версией Яндекс вебмастера?

Знаю, что некоторые владельцы сайтов только слышали о них…

Кстати, давно обещал, пора бы уж и написать:

о новой версии Search Console (панель управления Google Webmaster Tools), а то старую скоро совсем отключат.

Открываю файл sitemap.xml и нахожу там все страницы, которые указаны как отсутствующие в сайтмапе.

Более того, открываю подробности о сайтмапе в ПУ, и вижу, что "Файл Sitemap успешно обработан" и отсутствие каких-либо ошибок. Число записей в sitemap.xml точно соответствует числу статей на сайте. Причем дата последней обработки файла всегда свежая:

Так что это за ерунда такая? Почему в подробностях всех страниц указано, что в файле sitemap.xml они отсутствуют, хотя они там есть и сам файл успешно гуглом обрабатывается?

потому что консоль всю жизнь глючит и все уже привыкли , ждите

Так спрашивается нафига такая консоль, если в ней не отражается реально положение вещей?

Brat_Sergij:

Так спрашивается нафига такая консоль, если в ней не отражается реально положение вещей?

Да тоже заметил, что консоль глючит. Гугл что то чудит вообще.

Brat_Sergij:

Так спрашивается нафига такая консоль, если в ней не отражается реально положение вещей?

Надеюсь это риторический вопрос

Открываю файл sitemap.xml и нахожу там все страницы, которые указаны как отсутствующие в сайтмапе.

Более того, открываю подробности о сайтмапе в ПУ, и вижу, что "Файл Sitemap успешно обработан" и отсутствие каких-либо ошибок. Число записей в sitemap.xml точно соответствует числу статей на сайте. Причем дата последней обработки файла всегда свежая:

Так что это за ерунда такая? Почему в подробностях всех страниц указано, что в файле sitemap.xml они отсутствуют, хотя они там есть и сам файл успешно гуглом обрабатывается?

У меня так и не прошла эта болячка. На одном сайте - ок отображает, на другом - вот такая лабуда уже с полгода точно.

- Время ответа для некоторых URL в файле Sitemap слишком велико. Это может свидетельствовать о проблеме с сервером или с содержанием страницы (14)

- Файл Sitemap содержит URL, доступ к которым заблокирован в файле robots.txt (110)

В последнем случае в качестве примеров приведены ссылки на картинки в wp-content/themes/, как я понимаю так и должно быть. Тогда что не так?

Что надо-то? Если Вас интересует, должны ли быть ошибки, - то можно ответить, что ошибки надо по возможности исправлять.

время ответа исправляется, сюрпрайз, уменьшением времени ответа страницы. Смотреть в нормальном браузере, где есть что-то типа "Webmaster tools" - "Network": какие элементы страницы тормозят, искать - почему

Со вторым путктом все еще проще - "или крестик снимите, или трусы наденьте": в Sitemap должны быть только открытые публично ресурсы. Ссылки в карте сайта должны вести только на страницы, которые доступны к индексации. И никаких "картинок", закрытых в robots

При чем здесь картинки? Вынужден повторить, что упомянул эти два предупреждения на всякий случай - а здесь и сейчас меня интересует почему НЕ ВСЕ записи (не картинки, а записи. т.е. публикации!) попадают в Sitemap (в результате чего их нет в выдаче поисковика). В настройках Yoast SEO по записям такие настройки:

- Показать Записи в результатах поиска? - ДА

- Дата в предпросмотре фрагмента - СКРЫТЬ

- Блок Yoast SEO - ПОКАЗАТЬ

Те. все записи для индексации доступны - но почему-то не все они попадают в Sitemap.

Кстати у меня этот Sitemap в архиве (sitemap.xml.gz) и последний раз редактировался в 2014 году. Может его у меня попросту нет?

В Search Console вижу /page-sitemap.xml, /post-sitemap1.xml . /post-sitemap4.xml, но большая часть элементов из них проиндексирована - похоже дата архива от редактирования его содержимого не меняется. Нельзя ли как-нибудь в Search Console отфильтровать те элементы, которые не были проиндексированы? И потом проиндексировать их вручную?

Так как точно известно какие URL-ы поисковики увидеть не смогут, то генератор sitemap.xml написан (будет) только для «невидимых» URL-ов. Писать же генератор вообще для всех URL-ов — лениво. Но есть опасения, что тогда странички отсутствующие в sitemap.xml будут проигнорированы поисковиками (или проиндексированы с другим весом). Известно ли как относятся поисковики к страничкам отсутствующим в sitemap.xml? Они вообще индексируются?

Известно ли как относятся поисковики к страничкам отсутствующим в sitemap.xml? Они вообще индексируются?

Если поисковик найдет страницу, то да, может проиндексировать. Но и наличие ссылки в карте сайта еще не является гарантией обязательной индексации страницы.

Сергей Еремин если есть возможность где-то в футере добавить небольшой линк, то сделайте html карту сайта, в деле перелинковки и улучшения индексации она будет хорошим дополнением к sitemap.xml

Тут бы еще breadcrumbs добавить и сделать грамотную перелинковку текстов, но Вам будет явно лень. :)

Так как точно известно какие URL-ы поисковики увидеть не смогут, то генератор sitemap.xml написан (будет) только для «невидимых» URL-ов. Писать же генератор вообще для всех URL-ов — лениво. Но есть опасения, что тогда странички отсутствующие в sitemap.xml будут проигнорированы поисковиками (или проиндексированы с другим весом).

Боритесь с ленью! Хорошая карта сайта очень важна для любого сайта, ссылки на страницы с важным для индексации контентом там должны присутствовать обязательно.

Спасибо за ответ.

Лень -- это проявление рациональности. :)

Хлебные крошки тоже ничего не решат, т.к. это это скорее сервис а не сайт. помесь гео-поисковика и я.маркета с прайс.ру. т.е. нет жесткой структуры.

Есть страницы которых мало (блог, коммерческие условия, договора, список компаний участников). Таких страниц относительно мало. Скажем 2-5 тысяч всего (в пределе 20 тыс). И на них можно попасть через обычную навигацию, т.к. они не имеют гео-привязку.И городить огород sitemap.xml для не кажется рациональным (сейчас). Возможно после. Но уже сейчас хочется понять будет ли поисковик их индексировать.

Сергей Еремин: поисковик может проиндексировать все страницы, которые найдет. Независимо от того есть они в карте сайта или нет. С учетом габаритов Вашего сервиса Вам бы позадуматься о генераторе карты сайта. Вы явно о этом думали, но наверно тоже лень пока с этим разбираться. :)

Можете попробовать посмотреть всякие готовые генераторы карты сайта, но скорей всего Вам придется писать свой велосипед или переделывать один из существующих.

Natan: Т.к. ссылки появляются только после того как пользователь что-то там введет в интерфейс, а сервис ему построит ответ (а ответ надо проиндексировать, ведь то что один построил теперь и другим пригодится). В принципе я могу вычислить все возможные ответы, и построить карту в много миллионов страниц. Но только это же какая-то опупительная страница получится! Если предположить, что длинна URL 20 символов (что скромно) то общий размер HTML-файла карты сайта будет минимум 524Mb! Какой поисковик такое осилит?

Сергей Еремин: о добавлении динамически генерируемых миллионов страниц речи нет, но карту на пару тысяч линков, на наиболее важные страницы со статичными адресами, сгенерить можно. Не руками же собирать. ;)

Natan: Смо-собой буду делать Sitemap Sitemap-ов. и 10Пи ссылок мне по любому хватит. Кроме того я хочу строить Sitemap по мере запросов пользователей. Пользователь что-то спросил. Я ему построил PIL-ом картинки, построил таблицы, закешировал и добавил в Sitemap. АИ все это на не сильно шустром сервере. А если сразу Sitemap всего-всего-всего сделать -- то поисковик заддосит сервис.

Сергей Еремин: в принципе на Ваш вопрос про индексацию страниц не указанных в sitemap я давно ответил. Если мой ответ был Вам полезен, можете отметить его как решение. :)

Читайте также: