Ssd накопитель это схд

В принципе технология твердотельных накопителей не так уж нова. Она была разработана еще в конце 70‑х гг. прошлого века. Массовое применение таких накопителей началось больше двух десятков лет назад. Те же флеш-накопители или карты памяти тоже стали привычными продуктами уже лет десять назад. SSD-диски, которые используются в современных системах хранения, конечно, отличаются от своих «родственников», в том числе применяемых в настольных и портативных персональных системах, но у них есть целый ряд общих особенностей. Так что достоинства и недостатки данной технологии следует обозначить подробнее, чтобы более четко определить те ниши, где применение данных накопителей будет оправданным.

Достоинства и недостатки SSD

- очень малое время задержки при записи и чтении;

- высокая производительность, фактически ограниченная только пропускной способностью самого интерфейса;

- устойчивое время считывания файлов вне зависимости от их расположения или фрагментации;

- низкая потребляемая мощность;

- полное отсутствие вибрации и шума;

- высокая механическая стойкость;

- широкий диапазон рабочих температур.

В итоге, как показывают тесты, проведенные в условиях, близких к имеющим место на практике, SSD-диски на реальных задачах опережают RAID-массивы из самых быстродействующих SAS жестких дисков со скоростью вращения шпинделя 15 KRPM как минимум вдвое, а на некоторых операциях даже практически на порядок. Если же диски не объединять в RAID, то разница в быстродействии между SSD и SAS жестким диском составит порядка 15—20 раз, и до 50 раз, если речь идет о массовых SATA-накопителях. При этом SSD-диски не имеют движущихся частей, а значит, не боятся вибраций, механических перегрузок, пыли и агрессивных сред. При этом они не потребляют энергию при отсутствии обращения к ним, что еще более снижает их энергопотребление.

Существенных недостатков у SSD-накопителей всего два, но они довольно существенны. Это, в частности, ограниченное количество циклов перезаписи. У лучших (но и дорогих) образцов он составляет порядка 100 тыс. циклов, однако у некоторых систем на базе технологии MLC этот показатель существенно меньше (5—10 тыс. циклов, по разным данным). Если брать минимальный показатель в 5 тыс. циклов, то при типичном использовании в ЦОД такого диска хватит меньше чем на год. При этом скорость записи у SSD-дисков еще и не слишком велика, что может стать узким местом на ряде задач. В любом случае требуется доработка ПО, иногда серьезная. Это также стоит считать если не недостатком, то определенной особенностью, о которой надо знать и которую необходимо иметь в виду.

Не менее серьезным недостатком является также высокая цена. При этом стоимость SSD прямо пропорциональна емкости, в то время как цена жестких дисков по мере увеличения емкости растет довольно медленно. В итоге средняя стоимость хранения на SSD-диске будет в пять раз выше, чем на SAS-диске, и как минимум на порядок больше, чем на SATA. Были надежды, что по мере перехода к массовому производству цена будет снижаться, но они не оправдались. И это при том, что рынок SSD существенно более конкурентный, чем жестких дисков, где сложилась олигополия небольшого числа крупных игроков.

Таким образом, SSD-диски имеет смысл использовать для следующих задач:

создание подсистем хранения для оборудования, рассчитанного на использование в жестких условиях эксплуатации;

хранение данных, где критична скорость чтения;

в качестве буферной памяти для ускорения доступа к данным.

Как они используются, или как их можно применить на практике? Попробуем рассмотреть некоторые сценарии.

SSD как основа систем хранения, работающих в жестких условиях

Серверные системы приходится использовать не только в практически стерильных условиях центров обработки данных, но и в цехах, на судах и в разных летательных и космических аппаратах, в железнодорожных вагонах и локомотивах. Здесь играют роль такие факторы, как электромагнитные излучения, повышенные или пониженные температуры и влажность, загазованность, запыленность, вибрации, перегрузки. Причем полностью устранить все эти факторы, а они часто представлены в сочетании, не представляется возможным.

Естественно, об использовании жестких дисков для таких систем не может быть и речи, что, к слову, долго было одним из сдерживающих соображений для развития средств промышленной автоматизации и всевозможных бортовых систем. А емкость и быстродействие твердотельных дисков росли не так быстро, как того хотелось бы. Кроме того, существенно упрощается решение многих задач в области внутрицеховой автоматизации, в то время как в прежние времена приходилось идти на всевозможные ухищрения, чтобы избежать размещения тех или иных систем на определенных участках.

То же самое относится и к целому ряду специализированных систем для хранения больших массивов данных, полученных в ходе всяческого рода научных исследований и экспериментов. Впрочем, только этой сферой область применения таких накопителей не ограничивается. Схожие требования возникают и при решении целого ряда инженерных задач, и при геологоразведке, особенно нефтегазовых месторождений, при составлении прогнозов погоды, аэрофотосъемке и еще в множестве других областей.

Когда важна высокая скорость чтения

Ситуация, когда том работает в основном на чтение, в то время как запись происходит существенно реже, не так уж и необычна. Именно так обстоит дело с очень многими задачами, которые решают вычислительные комплексы для высокопроизводительных научных и инженерных расчетов, где необходимо обрабатывать относительно небольшие объемы данных по сложным алгоритмам. В итоге уже есть суперкомпьютеры, где вся подсистема хранения построена на базе SSD-дисков. Например, как раз такая система «СКИФ-Аврора» действует в Южно-Уральском государственном университете.

Использование SSD дает значительный выигрыш и там, где критична скорость ввода-вывода. Везде, где необходимо добиться реальных десятков тысяч операций в секунду (а это, например, все, что связано с биллингом или кеширующими прокси‑серверами), пришлось бы использовать десятки, а то и сотни довольно дорогих SAS-дисков. SSD-накопителей понадобится в десятки раз меньше, что позволит снизить затраты. А новейшие накопители позволяют добиться уже сотен тысяч операций ввода/вывода в секунду. Такой производительности удалось достичь в ходе проекта Quicksilver, который был успешно завершен еще в 2008 г. в одном из исследовательских центров IBM. И это без учета того, что уменьшается пространство, занимаемое дисковыми массивами (в среднем в пять раз), а также энергопотребление и затраты на охлаждение (немногим меньше, чем вдвое). Так что многие аналитики полагают: именно данный сегмент рынка СХД станет прорывным для SSD-дисков, которые будут все более активно вытеснять из него жесткие диски SAS.

Одним из первых успешных применений SSD‑дисков в подсистемах хранения данных началось в качестве системного накопителя в блейд‑серверах. Причем это было сделано практически одновременно и независимо друг от друга обоими ведущими поставщиками таких систем: HP и IBM. В этом случае лучше всего раскрываются достоинства SSD, ведь запись на системный том происходит довольно редко, только при обновлении системы, и в основном такой том работает как раз на чтение. При этом данные размещались на другом устройстве, так же как файл (или раздел) подкачки и всяческие логи, временные файлы и тому подобное. К тому же использование SSD, по данным IBM, позволило снизить энергопотребление на 18 Вт в расчете на сервер, на 252 Вт на шасси и на 1512 Вт на всю стойку.

Схожий эффект достигается и тогда, когда SSD используют для хранения системных образов виртуальных машин. В этом случае количество циклов записи будет еще меньше, в то время как скорость чтения будет оставаться критичным параметром. Это в равной степени относится как к виртуализации серверов, так и к использованию данной технологии для организации рабочих мест.

SSD как буферная память

Использование более быстрых устройств для буферизации чтения с более медленных имеет весьма длительную историю. Вспомним хотя бы программу smartdrv из времен ДОС, которая применялась для ускорения работы жестких дисков еще в конце 1980‑х гг. Аналогичные средства были и для более серьезных систем, в том числе и серверных. И идея использовать в качестве буфера более быстродействующие SSD-накопители тоже не заставила себя ждать. Так называемые гибридные винчестеры для настольных систем и серверов существуют уже несколько лет. В первое время эффективность такого решения вызывала, скажем так, сомнение, но современные устройства действительно заметно быстрее, чем традиционные. При этом эффективность данной технологии для серверов оказалась существенно выше, чем для рабочих станций, где выигрыш составляет, по разным данным, 10—30%. Прежде всего за счет того, что значительную часть ПО удалось адаптировать, с тем чтобы использовать сильные стороны SSD. Кроме того, в гибридных дисках для настольных систем и ноутбуков применяются компоненты с более скромными параметрами.

Хороший пример использования такого подхода — решение Oracle Exadata. «Exadata Version 1 была самой быстродействующей в мире машиной для реализации хранилищ данных. Exadata Version 2 вдвое превосходит Exadata V1 по быстродействию для приложений хранилищ данных и является единственной машиной баз данных, способной исполнять OLTP-приложения. Exadata V2 исполняет практически любые приложения для баз данных значительно быстрее и с меньшими затратами, чем любой другой существующий в мире компьютер», — подчеркнул глава компании Oracle Ларри Эллисон. Как показывают тесты на реальных задачах, никакого преувеличения тут нет. Во многом этого удалось добиться благодаря применению решения Exadata Smart Flash Cache, позволяющего хранить часто запрашиваемые «горячие» данные, чтобы обеспечить высокую пропускную способность и сверхмалое время отклика при обработке транзакций. Емкость буфера составляет 5 Тбайт из общего объема 336 Тбайт неформатированной емкости, которым комплектуется Oracle Exadata 2. Стоит также отметить, что немалую роль в столь значительном ускорении сыграли и доработки, внесенные в код СУБД Oracle 11g и отличающие его от более ранних версий. В противном случае выигрыш все равно был бы, но куда скромнее.

SSD: развеиваем мифы

Мне хотелось бы развеять ряд мифов, которые заставляют корпоративных заказчиков воздерживаться от использования SSD при хранении и обработке своих критически важных данных. Данные мифы были «чистой правдой» еще три-пять лет назад, но технологии развиваются, и в настоящее время SSD уже совсем не те, что были раньше.

Миф 1. SSD-накопители — недостаточно зрелая технология для хранения бизнес-критичных данных за счет ограниченного количества циклов перезаписи. Современный SSD-накопитель — сам по себе уже система хранения со своим контроллером, кеш‑памятью, микрокодом и внутренней «файловой системой». Количество перезаписей каждого блока учитывается и выравнивается в масштабах всего накопителя. Заложена дополнительная емкость, и потенциально проблемные блоки заранее выводятся из эксплуатации. В целом, современный SSD-накопитель корпоративного класса — более надежное устройство, нежели жесткий диск, о чем свидетельствует обширная статистика.

Миф 2. SSD-накопители эффективны при чтении. При записи преимущество над жесткими дисками минимально. Да, преимущества в 30—50 раз при записи не будет. Но на 7—10 раз рассчитывать можно. Именно такие результаты мы получаем на наших системах хранения при случайной записи на SSD. При типичной смешанной нагрузке SSD превосходит жесткий диск примерно в 20 раз.

Миф 3. SSD-накопители — непозволительно дорогая роскошь для большинства коммерческих организаций. Цена за единицу объема SSD по‑прежнему превосходит HDD в 5—10 раз, и это не изменится кардинально в ближайшее время. Добиться экономической эффективности от применения SSD позволяет программное обеспечение систем хранения IBM Easy Tier для автоматического переноса «горячих» данных на SSD. По сути, SSD — это дополнительный слой кеширования. Добавление четырех SSD-накопителей к 100 жестким дискам позволит удвоить производительность СХД при увеличении цены на 30—40%. Возможен и другой вариант — добавить четыре SSD, а 100 жестких дисков заменить на 50 более емких. В этом случае при сохранении исходной производительности стоимость, энергопотребление и габариты СХД кардинально сократятся.

В статьях про СХД из "конспекта админа" практически не рассматривались технологии софтовой организации дискового массива. Кроме того, за кадром остался целый пласт относительно дешевых сценариев ускорения хранилищ с помощью твердотельных дисков.

Поэтому в этой статье рассмотрю три неплохих варианта использования SSD-дисков для ускорения подсистемы хранения.

Чаще всего твердотельные накопители рассматривают просто как альтернативу HDD, с большей пропускной способностью и IOPS. Однако, такая замена "в лоб" часто стоит слишком дорого (брендовые диски HP, например, стоят от $2 000), и в проект возвращаются привычные накопители SAS. Как вариант, быстрые диски просто используются точечно.

В частности, удобным выглядит использование SSD для системного раздела или для раздела с базами данных – с конкретным выигрышем в производительности можно ознакомится в соответствующих материалах. Из этих же сравнений видно, что при использовании обычных HDD узким местом является производительность диска, а в случае SSD сдерживать будет уже интерфейс. Поэтому замена одного лишь диска не всегда даст такую же отдачу, как комплексный апгрейд.

В серверах используют SSD с интерфейсом SATA, либо более производительные SAS и PCI-E. Большинство представленных на рынке серверных SSD с интерфейсом SAS продаются под брендами HP, Dell и IBM. К слову, даже в брендовых серверах можно использовать диски OEM-производителей Toshiba, HGST (Hitachi) и других, которые позволяют сделать апгрейд максимально дешевым при схожих характеристиках.

С широким распространением SSD был разработан отдельный протокол доступа к дискам, подключенным к шине PCI-E – NVM Express (NVMe). Протокол разработан с нуля и значительно превосходит своими возможностями привычные SCSI и AHCI. С NVMe обычно работают твердотельные диски с интерфейсами PCI-E, U.2 (SFF-8639) и некоторые M.2, которые быстрее обычных SSD более чем вдвое. Технология относительно новая, но со временем она обязательно займет свое место в самых быстрых дисковых системах.

При выборе твердотельных дисков с интерфейсом SATA следует обращать внимание на параметр DWPD, который определяет долговечность диска. DWPD (Drive Writes Per Day) – это допустимое количество циклов перезаписи всего диска в сутки на протяжении гарантийного периода. Иногда встречается альтернативная характеристика TBW/PBW (TeraBytes Written, PetaBytes Written) – это заявленный объем записи на диск на протяжении гарантийного периода. В SSD для домашнего использования показатель DWPD может быть меньше единицы, в так называемых "серверных" SSD — 10 и более.

Такая разница возникает из-за разных типов памяти:

SLC NAND. Самый простой тип – в каждой ячейке памяти хранится один бит информации. Поэтому такие диски надежны и обладают хорошей производительностью. Но приходится использовать больше ячеек памяти, что негативно влияет на стоимость;

MLC NAND. В каждой ячейке хранится уже два бита информации – самый популярный тип памяти.

eMLC NAND. То же самое что и MLC, но повышена устойчивость к перезаписи благодаря более дорогим и качественным чипам.

Таким образом, при точечной замене обычных дисков твердотельными логично использовать MLC-модели в RAID 1, что даст отличную скорость при том же уровне надежности.

Считается, что использование RAID совместно с SSD – не лучшая идея. Теория основывается на том, что SSD в RAID изнашиваются синхронно и в определенный момент могут выйти из строя все диски разом, особенно при ребилде массива. Однако, с HDD ситуация точно такая же. Разве что, испорченные блоки магнитной поверхности не дадут даже прочитать информацию, в отличие от SSD.

По-прежнему высокая стоимость твердотельных накопителей заставляет задуматься об альтернативном их использовании, помимо точечной замены или использования СХД на базе одних лишь SSD.

От размера и скорости кэша RAID-контроллера зависит скорость работы массива в целом. Расширить этот кэш можно с помощью SSD. Технология напоминает решение Smart Response от Intel.

При использовании подобного кэша данные, которые используются чаще, хранятся на кэширующих SSD, с которых производится чтение или дальнейшая запись на обычный HDD. Режимов работы обычно два, аналогично привычному RAID: write-back и write-through.

В случае write-through ускоряется только чтение, а при write-back – чтение и запись.

При настройке кэша write-through запись проводится как в кэш, так и на основной массив. Это не влияет на операции записи, но ускоряет чтение. К тому же, перебои питания или всей системы для целостности данных уже не так страшны;

Для работы обычно требуется специальная лицензия или аппаратный ключ. Вот конкретные названия технологии у популярных на рынке производителей:

LSI (Broadcom) MegaRAID CacheCade. Позволяет использовать до 32 SSD под кэш, суммарным размером не более 512 ГБ, поддерживается RAID из кэширующих дисков. Есть несколько видов аппаратных и программных ключей, стоимость составляет около 20 000 р;

Microsemi Adaptec MaxCache. Позволяет использовать до 8 SSD в кэше в любой конфигурации RAID. Отдельно лицензию покупать не нужно, кэш поддерживается в адаптерах серии Q;

Схема работы SSD-кэша предельно проста – часто используемые данные перемещаются или копируются на SSD для оперативного доступа, а менее популярная информация остается на HDD. Как итог, скорость работы с повторяющимися данными значительно возрастает.

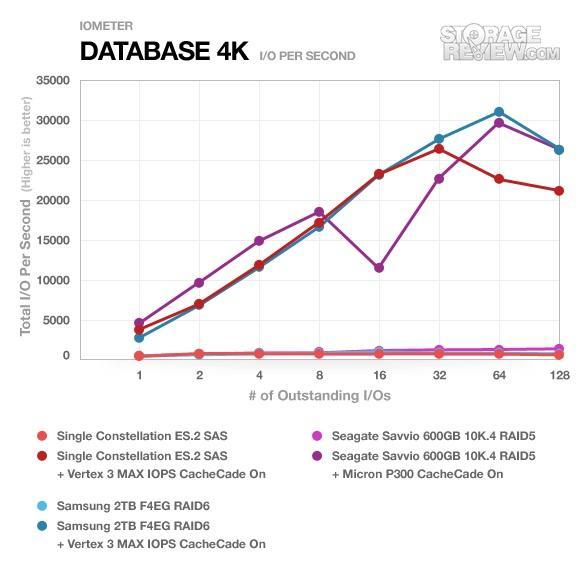

В качестве иллюстрации работы RAID-кэша на базе SSD можно привести следующие графики:

StorageReview – сравнение производительности разных массивов при работе с базой данных: использованы обычные диски и их альтернатива на базе LSI CacheCade.

Но если есть аппаратная реализация, то наверняка существует и программный аналог за меньшие деньги.

Помимо программного RAID существует и программный SSD-кэш. В Windows Server 2012 появилась интересная технология Storage Spaces, которая позволяет собирать RAID-массивы из любых доступных дисков. Накопители объединяются в пулы, на которых уже размещаются тома данных – схема напоминает большинство аппаратных систем хранения. Из полезных возможностей Storage Spaces можно выделить многоярусное хранение (Storage Tiers) и кэш записи (write-back cache).

Storage Tiers позволяет создавать один пул из HDD и SSD, где более востребованные данные хранятся на SSD. Рекомендованное соотношение количества SSD к HDD 1:4-1:6. При проектировании стоит учитывать и возможность зеркалирования или четности (аналоги RAID-1 и RAID-5), так как в каждой части зеркала должно быть одинаковое количество обычных дисков и SSD.

Кэш записи в Storage Spaces ничем не отличается от обычного write-back в RAID-массивах. Только здесь необходимый объем "откусывается" от SSD и по умолчанию составляет один гигабайт.

Общая схема работы выглядит так:

При записи на чистый диск данные сохраняются на SSD;

Когда SSD заполнены, данные пишутся в write-back кэш, который записывается на HDD;

Если кэш переполнен, запись ведется напрямую на HDD;

Если рассматривать другие операционные системы, то технологий доступно еще больше. Например, в GNU\Linux есть bcache, EnhanceIO, dm-cache и lvmcache, L2ARC в ZFS, Cache Tiering и Cache Pool в Cephs.

Если говорить о программном ускорении дисковой системы, то интересным вариантом выглядит использование для этих целей оперативной памяти. Существует ряд приложений, позволяющих "откусить" часть RAM под кэш – например PrimoCache. Подобные решения, помимо ускорения работы, помогут и продлить жизнь SSD. Главное предусмотреть защиту от проблем с питанием и не размещать в таких разделах слишком важные данные.

Файловые и веб-серверы хорошо работают с кэшем на SSD, а для размещения производственной базы данных приоритетнее RAID-массив из обычных дисков под данные и отдельное SSD-зеркало под журналы транзакций. Остальные сценарии работы с данными требуют более творческого подхода и знания специфики использования.

Если у вас есть собственные приемы правильного использования твердотельных накопителей – поделитесь в комментариях, чтобы дополнить примеры из статьи.

Заодно расскажите, что думаете о RAM-дисках – только ли это just for fun технология, на ваш взгляд?

В настоящее время flash накопители все прочнее занимают нишу носителей информации в Enterprise сегменте. Этому способствует как значительное снижение их стоимости, так и увеличение емкости отдельных накопителей. Там, где еще недавно использовались только механические жесткие диски, сейчас активно эксплуатируют SSD. Причем речь идет не только о внутренних накопителях в клиентских системах, но и о дисковой подсистеме серверов и систем хранения данных. И в этом сегменте отдельное место занимают конфигурации систем хранения, где в качестве носителей используется только SSD. Это — так называемые All Flash системы.

Прежде всего, необходимо понять для себя, что же такое All Flash система хранения. Понятно, что из названия вытекает использование в ней только Flash накопителей. Однако, не все All Flash системы одинаковы. Условно их можно разделить на три подвида.

Вердикт

Выбирая All Flash массив, большинство пользователей по умолчанию предпочитают рассматривать в качестве кандидатов традиционные СХД, укомплектованные SSD. И если производительность ~280K IOPS (4K, random write) вас устроит, то вы мыслите в правильном направлении. Вот только задачи бизнеса все чаще требуют, чтобы оборудование работало на все 146%. И с обычной СХД выше головы, увы, не прыгнут, а какой-нибудь IBM Flash System стоит заоблачных денег. И вот здесь All Flash массивы AccelStor будут как нельзя кстати. Достойная производительность, высокая надежность, гибкий выбор конфигурации и адекватная техподдержка – это далеко не полный перечень достоинств данных массивов. Добавьте к этому полное отсутствие скрытых платежей за лицензии и более длительный срок использования SSD — и вы получите не просто интересный продукт, а достойный инструмент в работе вашего бизнеса.

Так что уже занятое AccelStor место «под солнцем» на рынке сверхбыстрых массивов будет неминуемо расширяться. И, как знать, каких вершин они смогут достичь.

Не секрет, что дни накопителей на жестких магнитных дисках (HDD) сочтены, хотя нельзя сказать, что переход на твердотельные накопители SSD произойдет очень быстро. Здесь ситуация примерно такая же, как с электромобилями – всем они нравятся, у них много преимуществ, но всем также известны и их недостатки и ограничения. Поэтому переход на электромобиль – процесс длительный, как и переход с HDD на SSD.

Сравнение SSD и HDD имеет много общих черт со сравнением электромобиля и автомобиля на топливе. Как и автомобиль на топливе, так и HDD, — это вершина инженерного искусства по части точной механики. Напротив, как электромобили, так и SSD, довольно просты по внутреннему устройству, если говорить о механике.

Выгоды от использования накопителей SSD в серверах общеизвестны, однако напомним их еще раз.

AccelStor – собственный взгляд на работу All Flash

Компания AccelStor была образована как startup в 2014 году. Ключевым инвестором (по сути – владельцем этого проекта) является широко известный IT гигант Toshiba. Еще до коммерческого запуска компания обращала на себя внимание, получая высшие награды на различных мероприятиях, посвященных Flash технологиям. Одна из топ-наград в их списке получена на весьма известном и престижном мероприятии Flash Memory Summit (2016).

Награды AccelStor

Все эти награды были получены за инновационный подход по работе с flash памятью, реализованного в фирменной технологии FlexiRemap, которой обладают все массивы AccelStor NeoSapphire.

Технология FlexiRemap представляет собой специальный алгоритм для работы с SSD так, чтобы избавиться от узких мест в плане производительности, а также максимально увеличить срок службы накопителей. Основной идеей является преобразование случайных запросов на запись в последовательные цепочки. Т.е. поступившие блоки данных объединяются в цепочки, кратные «страницам», и только потом записываются на SSD. В результате такой подход к записи новых данных является с точки зрения накопителей последовательным, что в итоге позволяет добиться высоких показателей производительности.

В процессе работы алгоритм FlexiRemap ведет учет востребованности всех блоков данных. В соответствии с частотой использования данные автоматически ранжируются при перезаписи так, чтобы все «горячие» данные располагались максимально близко друг к другу. Тогда в процессе изменения блоков эти данные будут также перемещаться в новые «страницы» совместно, что опять же позволит пользоваться более производительным последовательным режимом записи на SSD по сравнению с традиционным подходом. Этот механизм похож на этакий виртуальный тиринг, который помимо прочего также ускоряет работу Garbage Collection, т.к. «сборщик мусора» также будет выполнять свою работу в последовательном режиме.

Несмотря на то, что RAID здесь не применяется, данные все равно находятся под защитой. Для этого все SSD делятся на две симметричные группы. Весь ввод/вывод равномерно распределяется по обоим группам (stripe). В каждой группе помимо данных хранятся контрольные суммы так, чтобы была возможность продолжать работу в случае отказа одного накопителя. Суммарно массив может выдержать отказ двух SSD, что в сравнении с RAID эквивалентно уровню RAID 50 из двух групп.

Организация массива данных

При записи применяется механизм round robin, благодаря которому данные максимально равномерно распределяются по всем дискам. Помимо этого, у каждого SSD есть собственный коэффициент веса, который зависит от его текущего ресурса записи. Поэтому если какой-либо диск изношен сильнее остальных, он будет реже получать новые данные до тех пор, пока показатели ресурса не сравняются. По сравнению с традиционным методом в RAID, технология FlexiRemap позволяет значительно увеличить срок службы накопителей за счет их равномерного использования.

FlexiRemap против RAID

Особо стоит отметить механизм сохранности данных в случае отказа какого-либо диска. В этом случае та группа, в которой отказал SSD автоматически переводится в режим «только для чтения». Делается это для максимально быстрого выполнения процесса ребилда на диск hot spare. Как только группа восстановится, она может снова участвовать во всех типах операций. Причем автоматически сработает описанный ранее механизм выравнивания ресурса записи.

Говоря о SDS appliance, нужно понимать, что это по сути сервер с предустановленным ПО. Поэтому он априори одноконтроллерный, выражаясь в терминологиях СХД. И хотя ряд задач позволяет не прибегать к резервированию контроллеров системы хранения, все вендоры СХД уже давно приучили нас, что «правильная» СХД – это СХД с двумя (или даже более) контроллерами. У AccelStor на это также есть свой ответ – технология Shared Nothing для работы двух нод в кластере.

Модели AccelStor NeoSapphire с двумя нодами могут быть как в едином корпусе (на базе twin серверов), так и в виде двух отдельных серверов. Последние можно разнести на расстояние до 100м друг от друга для создания disaster recovery. В любом случае для синхронизации данных между нодами используется внешнее соединение через InfiniBand 56G с дополнительной проверкой «пульса» через Ethernet.

Организация синхронизации между нодами

В отличие от привычной двухконтроллерной СХД здесь дублируются не только сами контроллеры (ноды) с обязательной обвязкой в виде модулей охлаждения и блоков питания, но и сами данные. Каждая нода в AccelStor NeoSapphire абсолютно независима и содержит полную копию данных благодаря непрерывной синхронной репликации. Обе ноды работают в режиме Symmetric Active-Active без применения передачи запросов друг другу (ALUA), как в классических СХД. Поэтому время переключения в случае сбоя со стороны AccelStor реально стремится к нулю. А наличие двух копий данных позволяет значительно повысить надежность системы по сравнению с традиционной архитектурой.

Продолжая тему надежности, стоит отметить, что массивы Accelstor не кэшируют данные при операциях записи, т.к. работают в синхронном режиме. Все промежуточные действия над данными алгоритмом FlexiRemap выполняются в оперативной памяти контроллера. Но массив выдаст подтверждение хосту об успешном завершении операции только после физической записи на SSD. Поэтому в All Flash массивах Accelstor нет батарей/конденсаторов из-за отсутствия необходимости в них.

Помимо уникальных технологий All Flash массивы AccelStor NeoSapphire обладают и стандартным для рынка Enterprise функционалом: Thin Provisioning, снапшоты по технологии Redirect-on-Write с возможностью их бэкапа и восстановления через внешние CIFS/NFS папки, асинхронная репликация, компрессия и дедупликация. Отдельно стоит отметить функцию Free Clone по созданию копий томов, которые физически не занимают места, т.к. являются по сути ссылками на исходный том. Данная функция может быть очень полезна, например, в VDI.

Разумеется, присутствует поддержка всех современных операционных систем и платформ виртуализации. Имеется plug-in для VMware vSphere Web Client с возможностью управления томами и в полной мере реализующий функционал Free Clone.

Важным преимуществом Accelstor NeoSapphire как Software Defined Storage является возможность работы на обычном «железе» x86 с совершенно стандартными SSD. Да, производитель не предоставляет вольностей по выбору аппаратной платформы: это он выполняет за вас. Делается это прежде всего для гарантированно предсказуемой производительности решения, а также с целью исключить проблемы совместимости. Все All Flash массивы Accelstor собираются под конкретного заказчика в нужной ему конфигурации и проходят тщательное тестирование перед отправкой. Стандартная гарантия на все массивы 3 года NBD с опережающей заменой запчастей. Т.к. вендор присутствует на территории России, техподдержка имеется в том числе и на русском языке.

При заказе All Flash массива Accelstor NeoSapphire можно гибко выбирать необходимый объем. Причем этот объем – то, что реально доступно хостам для работы независимо от физической организации дискового пространства. Необходимо учитывать, что все модели поставляются полностью заполненные дисками. Свободных слотов нет – добавить диски не получится. Это делается все из-за тех же упомянутых ранее требований по производительности и надежности. Если в будущем понадобится увеличить объем, это можно сделать при помощи полок расширения (доступно для старших моделей). Также заранее необходимо определиться, сколько нод (контроллеров) будет в массиве, т.к. апгрейд на текущий момент до двухнодового режима не предусмотрен.

В качестве интерфейсов для всех моделей доступен выбор 10G iSCSI или 16G Fibre Channel. Опционально может быть также 56G InfiniBand. Для iSCSI моделей помимо блочного доступа бонусом идет поддержка файловых протоколов CIFS и NFS. Количество портов определяется заданной производительностью системы так, чтобы они не были узким местом (обычно 2-6 портов на ноду).

В качестве накопителей используются стандартные SSD Enterprise класса. Чаще всего с интерфейсом SATA, т.к. работы с двумя контроллерами не требуется. Имеются также модели All Flash массивов на базе NVMe дисков.

Использование стандартных серверных платформ и SSD позволяет заметно оптимизировать стоимость решения в целом. При этом AccelStor обеспечивает сервис от своего имени на все решение целиком независимо от того, комплектующие какого производителя входят в состав массива.

И, да, крайне важный момент: никаких платных лицензий! Весь функционал доступен сразу «из коробки». Более того, в случае расширения функционала новые возможности будут доступны при обновлении прошивки.

Преимущества SSD

- Высокая скорость записи-чтения, которая у SSD в несколько раз быстрее, чем у HDD, даже самых быстрых, со скоростью вращения 20 тыс. оборотов в минуту. Это очень полезно при записи и чтении больших массивов данных.

- Число одиночных операций записи-чтения в секунду у SSD гораздо больше за счет возможности выполнения нескольких операций одновременно. В HDD такое невозможно, поскольку для каждой операции нужно перемещать головку записи-считывания.

- Полное отсутствие шума от накопителя SSD за счет отсутствия движущихся частей. Поэтому сервер с SSD шумит меньше и единственным источником шума в нем остается вентилятор процессора.

- Стойкость к механическим воздействиям. Например, диск SSD не боится падений на жесткий пол, что для HDD является фатальным событием.

- Низкое энергопотребление, поскольку в SSD не тратится энергия на вращение шпинделя HDD.

- Независимость скорости чтения от фрагментации файла. Если файл на HDD сильно дефрагментирован, это заметно влияет на скорость считывания. В SSD такое не наблюдается.

- Меньшие габариты и вес. Часто можно увидеть, что установочные размеры дисков, как SSD, так и HDD, — одинаковы, однако это объясняется исключительно стандартизацией размеров слотов в серверах. SSD могут быть конструктивно выполнены в корпусах гораздо меньших размеров, чем HDD.

Сравнение размеров HDD и SSD

Несмотря на такие заметные преимущества, у SSD есть и недостатки.

Клиентские и серверные SSD

При использовании в серверах, различают клиентские (потребительские) и серверные SSD. Грубо говоря, клиентский SSD – это обычная флешка, установленная в компьютер. Сложно найти пользователя, который был бы озабочен числом циклов перезаписи, который выдерживает его SSD-диск в компьютере. Никакой пользователь не израсходует допустимое число циклов перезаписи обычного потребительского SSD, не только за все время работы на данном компьютере, но и за всю свою оставшуюся жизнь.

Напротив, в серверных SSD в дата-центрах, в особенности, для использования SSD в физическом сервере, на котором работают виртуальные серверы, количество циклов полной перезаписи диска SSD может приближаться к показателю DWPD. А это уже чревато ранним выходом накопителя SSD из строя.

Поэтому клиентские SSD не рекомендуется использовать в серверах (в особенности в дата-центрах). Серверные SSD, предназначенные для дата-центров, можно использовать и в качестве клиентских, но это нецелесообразно экономически.

Есть желающие использовать клиентские (потребительские) SSD в серверах, поскольку, как они считают, что если производительность SSD высокая, то и в сервере они будут работать так же хорошо, как и в обычном клиентском компьютере. Поначалу будут, но долго не проработают.

Клиентский компьютер и сервер – вещи разные.

Клиентский SSD предполагает обслуживание одного пользователя, даже если одновременно запущены несколько приложений. Нагрузка на SSD в клиентском компьютере – периодическая и большую часть времени диск будет простаивать. Если на запрос пользователя ответ от SDD придет с небольшой задержкой, то это либо просто незаметно, либо не критично.

Серверы и СХД предназначены для одновременного обслуживания множества пользователей, поэтому даже небольшая задержка ответа на запрос от серверного SSD сделает работу с сервером затрудненной, а если пользователей – сотни, то даже неприемлемой. Поэтому для серверных SSD задаются параметры, рассчитанные на одновременное обслуживание большого количества пользователей.

Не вдаваясь в технические подробности, скажем, что в серверных SSD доступ к ячейкам памяти может производиться через 8–16 каналов, каждый из которых может иметь от 16 до 64 подканалов. В клиентских SSD имеются лишь 2–4 канала с 4–8 подканалами.

Малое количество каналов и подканалов у клиентских SSD до некоторой степени компенсируется кэшированием. Однако после наполнения небольшого по объему кэша происходит деградация производительности клиентского SSD, после чего она определяется количеством каналов, которое у клиентских дисков небольшое.

Именно поэтому производительность клиентских SSD в многопользовательской среде сильно падает. А цены серверных SSD гораздо выше, чем клиентских.

Например, потребительский накопитель Micron M500DC емкостью 800 ГБ имеет показатель TBW 2500 ТБ. Это означает, что такой накопитель позволяет перезаписать свой полный объем в 800 ГБ примерно три тысячи раз. Для накопителей потребительского класса это вполне нормально. Редко какой пользователь выберет этот объем перезаписи за весь срок службы компьютера. А вот в корпоративном сервере CRM, к которому обращается множество пользователей, объем перезаписи в 2500 ТБ будет выбран за несколько дней, а возможно и часов.

Что произойдет дальше? Дальше потребительский SSD, на который взвалили такую огромную нагрузку, перейдет в режим чтения Read Only. То есть записать в него информацию станет невозможно.

SLC, MLC, TLC, QLC

Первые SSD создавались на основе транзисторных накопителей, в которых одна ячейка хранит один бит, закодированный при помощи двух уровней заряда – заряжено или разряжено. Такая технология была названа SLC (Single level cell) — одноуровневая ячейка.

Такая технология предполагала, что чип памяти SSD – планарный, одноуровневый, как и большинство чипов для других микросхем. SLC позволяет производить на каждой ячейке до 100 тысяч операций записи-стирания.

Технологии SSD (изображение: Micron)

Затем, по мере уплотнения емкости в чипах SSD, появилась технология с многоуровневыми ячейками MLC (Multi Level Cell). Хотя уровней в ней было всего два, а не «много». Соответственно, в такой ячейке можно разместить два бита. Распознаваемых уровней заряда в MLC – четыре (00, 01, 10, 11). То есть MLC дала возможность вдвое повысить емкость. Однако число циклов перезаписи в такой структуре сократилось на порядок – со 100 до 10 тыс. циклов. Но и удельная стоимость на гигабайт в MLC также значительно уменьшилась.

Следующим шагом была технология TLC (Triple Level Cell), где в ячейке можно различать 8 уровней заряда или 3 бита (тремя битами можно закодировать цифры от 0 до 7, т. е. восемь цифр). Это дало возможность увеличить рост емкости чипа на 50 %. Однако и допустимое число циклов перезаписи сократилось до трех тысяч.

Затем была изобретена технология 3D NAND, т. е. планарную, двумерную структуру 2D NAND SSD решили сделать трехмерной.

Это позволило перейти к следующему этапу – технологии QLC, которая позволяет размещать в ячейке до 4 битов, то есть распознавать 16 уровней заряда. Это дало возможность повысить емкость чипа еще на 33 %, однако число циклов перезаписи сократилось до одной тысячи, что для серверных SSD корпоративного класса совершенно неприемлемо. Средний сервер организации съест ресурс циклов перезаписи ячеек очень быстро, после этого память нужно будет менять.

Причем по технологии 3D NAND можно изготавливать как чипы TLC, так и QLC.

1. Традиционные СХД с использованием SSD

На самом деле, это – самый многочисленный вид All Flash систем хранения. Потому что для производителя нет ничего проще, чем укомплектовать свою уже существующую СХД SSD накопителями. Конечно же ведущие вендоры помимо переклеивания шильдиков (СХД All Flash) занимаются еще и дополнительной оптимизацией прошивки для удобства работы именно с SSD, а также повышения скорости работы системы в целом. Но есть и те, которые особо не заморачиваются и просто предлагают бандлы, состоящие из обычной СХД и набора SSD. В результате на рынке можно встретить предложения, начиная от All Flash NAS Qnap (оставим за рамками обсуждение целесообразности данного решения, но, ведь, действительно All Flash – не придерешься!) до монструозных многоловых Netapp FAS.

Главным достоинством такого решения является прежде всего умеренная стоимость. Конечно, у каждого вендора есть своя доплата за бренд, но в целом цена All Flash системы (речь про «голову» с контроллерами) по сравнению с классической СХД отличается не сильно (на фоне стоимости SSD так вообще «копейки»).

Минусом же является невысокая итоговая производительность решения. Все подобные All Flash системы, имеющие внутри современное «железо», выдают на запись порядка 300K IOPS (4K, 100% random, рассматриваем режим записи по той причине, что он гораздо тяжелее для СХД, нежели чтение. Показатели чтения, разумеется, значительно выше). Сильное отрицательное отклонение от этой величины скорее является серьезной недоработкой прошивки, а более высокие показатели производительности говорят о лучших алгоритмах кэширования и/или оптимизации прошивки под конкретные модели SSD. В любом случае «насыщение» происходит уже при количестве дисков ~10-20. Поэтому дальнейшее добавление дисков позволит лишь увеличить доступный объем хранения, но не скорость работы.

Основной причиной такого ограничения в производительности является использование классических алгоритмов RAID. Данные алгоритмы были разработаны достаточно давно для работы с механическими жесткими дисками и абсолютно не учитывают особенности работы твердотельных накопителей. Ведь SSD в отличие от HDD не может просто так перезаписать блок данных. Ему требуется перезаписать всю страницу, содержащую изменяемый блок, в новое место, а старое место освободить для последующей новой записи. Эти обстоятельства в дополнение к стандартным RAID penalty дают огромный overhead для операций перезаписи.

1. Традиционные СХД с использованием SSD

На самом деле, это – самый многочисленный вид All Flash систем хранения. Потому что для производителя нет ничего проще, чем укомплектовать свою уже существующую СХД SSD накопителями. Конечно же ведущие вендоры помимо переклеивания шильдиков (СХД All Flash) занимаются еще и дополнительной оптимизацией прошивки для удобства работы именно с SSD, а также повышения скорости работы системы в целом. Но есть и те, которые особо не заморачиваются и просто предлагают бандлы, состоящие из обычной СХД и набора SSD. В результате на рынке можно встретить предложения, начиная от All Flash NAS Qnap (оставим за рамками обсуждение целесообразности данного решения, но, ведь, действительно All Flash – не придерешься!) до монструозных многоловых Netapp FAS.

Главным достоинством такого решения является прежде всего умеренная стоимость. Конечно, у каждого вендора есть своя доплата за бренд, но в целом цена All Flash системы (речь про «голову» с контроллерами) по сравнению с классической СХД отличается не сильно (на фоне стоимости SSD так вообще «копейки»).

Минусом же является невысокая итоговая производительность решения. Все подобные All Flash системы, имеющие внутри современное «железо», выдают на запись порядка 300K IOPS (4K, 100% random, рассматриваем режим записи по той причине, что он гораздо тяжелее для СХД, нежели чтение. Показатели чтения, разумеется, значительно выше). Сильное отрицательное отклонение от этой величины скорее является серьезной недоработкой прошивки, а более высокие показатели производительности говорят о лучших алгоритмах кэширования и/или оптимизации прошивки под конкретные модели SSD. В любом случае «насыщение» происходит уже при количестве дисков ~10-20. Поэтому дальнейшее добавление дисков позволит лишь увеличить доступный объем хранения, но не скорость работы.

Основной причиной такого ограничения в производительности является использование классических алгоритмов RAID. Данные алгоритмы были разработаны достаточно давно для работы с механическими жесткими дисками и абсолютно не учитывают особенности работы твердотельных накопителей. Ведь SSD в отличие от HDD не может просто так перезаписать блок данных. Ему требуется перезаписать всю страницу, содержащую изменяемый блок, в новое место, а старое место освободить для последующей новой записи. Эти обстоятельства в дополнение к стандартным RAID penalty дают огромный overhead для операций перезаписи.

Проверка в деле

У AccelStor имеется широкая номенклатура моделей с различной заявленной производительностью. Минимальная модель NeoSapphire 3401 с 8 SSD способна обеспечить 300K IOPS@4K. А топовая P710 с 24 SSD выдает уже 700K IOPS@4K. Что же касается NVMe моделей, то тот же показатель в 700K IOPS@4K достигается в NeoSapphire P310 всего при 8 SSD! И заметьте, что указанные значения производительности – это запись в устоявшемся режиме (чтение и всякие пиковые значения выше), т.е. в самом тяжелом для массива режиме работы.

Мы провели тестирование двухнодовой системы NeoSapphire H710 с 48 SSD (по 24 SSD в каждой ноде) с доступной емкостью 27ТБ. Accelstor декларирует производительность для этой модели не ниже 600K IOPS 4K, random write. Тестирование производилось в IOmeter с трех серверов, подключенных через Fibre Channel.

В синтетических тестах All Flash массив оказался даже лучше, чем обещано в спецификации, что, по нашему мнению, является только плюсом в сегменте рынка, где любые показатели подвергаются сомнению (спасибо оторванным от реальности маркетологам за это!).

Важно отметить, что одним из основных преимуществ алгоритма FlexiRemap является высокая производительность в режиме записи без деградации с течением времени. Т.е. достигнутый показатель в устоявшемся режиме будет таким же и через 10мин/час/… непрерывной работы. Для подтверждения этого факта мы запустили тест IOmeter (4K, 100% random write) на несколько часов (использовался один хост). Да, это действительно так: производительность практически не меняется с течением времени.

2. All Flash массивы с проприетарным «железом»

Для преодоления узких мест традиционных СХД необходимо использовать абсолютно другую архитектуру аппаратного и программного обеспечения. Примером таких решений являются продукты Pure storage или IBM Flash System. В них нет ни RAID в привычном понимании (parity конечно же есть и отказоустойчивость имеется), ни как таковых SSD (вместо них – свои «накопители»). Результатом является просто сумасшедшая производительность и особенно низкие показатели latency. Но стоимость… Действительно, как крыло от самолета.

Память класса хранения SCM (Storage Class Memory)

В компьютерной терминологии понятие «память» (memory) относится к оперативной памяти, с быстрым обменом данными с процессором компьютера, данные в которой сохраняются только при наличии электропитания. При выключении компьютера данные в оперативной памяти стираются.

Напротив, понятие «хранение», т. е. система хранения данных, СХД (storage), означает устройство для долговременного хранения данных, где информация сохраняется при выключенном питании. Именно к этому классу устройств относятся как HDD, так и SSD.

SCM (Storage Class Memory) – это нечто среднее между памятью и СХД. Это разновидность SSD, выполненная по технологии NVMe (Non-Volatile Memory express). Сервер может рассматривать эту память как оперативную динамическую память (DRAM). Доступ к данным в памяти SCM происходит гораздо быстрее, чем даже к обычному накопителю SSD, не говоря уже об HDD.

Обычная архитектура процессора, памяти и СХД и архитектура с памятью класса хранения SCM (Storage Class Memory)

Существует несколько технологий SCM, как с требованием наличия постоянного питания, так и без него. Скорость доступа к данным в некоторых типах SCM приближается к оперативной памяти DRAM.

Сравнение задержки считывания в разных типах памяти и СХД, цены на единицу емкости

В чем различия M.2 SATA и M.2 NVMe

M.2 — это форм-фактор. Накопители M.2 могут быть в версиях SATA и NVMe. Энергонезависимая память (Non-Volatile Memory) NVMe (NVM Express) — это открытый стандарт, который позволяет модулям SSD работать с максимальной скоростью чтения-записи, на которую способен их чип NAND.

Это дает SSD работать непосредственно через интерфейс PCIe, а не через SATA, который начинает устаревать. То есть NVMe — это описание шины подключения, а не новый тип флэш-памяти. Он также не связан с форм-фактором, поэтому накопители NVMe могут иметь форм-факторы M.2 или PCIe.

Жесткий диск HDD с интерфейсом SATA и скоростью 7200 об/мин обеспечивает скорость около 100 МБ/с в зависимости от возраста, состояния и степени фрагментации. SSD с интерфейсом SATA III обеспечивает максимальную пропускную способностью 600 МБ/с, SATA II — 300 МБ/с.

SSD NVMe обеспечивает скорость записи до 3500 МБ/с, то есть почти в 6 раз больше, чем у SATA III.

Форм-факторы SSD: SATA, M.2, NVMe и PCI-E

Практически у всех материнских плат компьютеров есть физический интерфейс для накопителя SATA. (см. рисунок ниже). Но не на всех имеется разъем под компактный SSD-накопитель M.2, который сейчас стал появляться даже у ноутбуков.

Форм-факторы SATA, mSATA и M.2

Заключение

Выбор подходящего SSD для определенного сервера в определенном развертывании может быть сложной задачей, поскольку существует множество моделей SSD корпоративного класса, с разными показателями производительности, форм-факторами, ресурсами и емкостью. С другой стороны, есть много разных серверов для разных приложений. Поэтому задача выбора серверного SSD является очень многофакторной.

При оценке пригодности серверных SSD для конкретного использования сервера не следует ограничиваться только значениями IOPS или пропускной способности. Необходимо учесть также показатель качества обслуживания конечных пользователей, чтобы гарантировать выполнение соглашений SLA для приложений, производительность для реальных рабочих нагрузок, а также вид форм-фактора, обеспечивающего «горячую» замену в отказоустойчивых архитектурах.

Поэтому при выборе SSD для сервера желательно воспользоваться консультациями предметных специалистов, хорошо разбирающихся в технологиях памяти и СХД, а также в приложениях серверов.

3. Software defined storage

Особняком от всего этого «зоопарка» All Flash массивов стоят программно-определяемые хранилища (Software Defined Storage, SDS). SDS – это программное обеспечение, работающее на обычном x86 «железе» и выполняющее «эмуляцию» СХД. Мы не зря употребили этот термин в кавычках, т.к. в настоящее время граница между аппаратными и программными контроллерами весьма условна, в отличие от былых времен. Современные СХД чаще всего используют стандартную x86 архитектуру под управлением Linux подобных операционных систем. Да, могут использоваться дополнительные контроллеры с поддержкой offload для некоторых операций. Но основное отличие от SDS – это закрытость как «железа», так и ПО для пользователя. SDS же, напротив, позволяет использовать практически любое рекомендуемое аппаратное обеспечение и производить умеренные модификации в программных компонентах.

Однако, если использовать SDS не просто в качестве СХД, а как All Flash массив, то давать возможность пользователю свободно выбирать серверную платформу и производить самостоятельную установку ПО неверно. Основная причина – невозможность гарантировать заданные показатели производительности (собственно, основную причину выбора All Flash), а также сложность поддержки широкого списка оборудования. Поэтому на рынке присутствуют так называемые appliance – законченные решения, состоящие из серверной платформы с предустановленным и настроенным ПО и укомплектованные необходимым количеством SSD, что в целом обеспечивает заданную производительность.

Представителями именно такого типа решения (SDS appliance) и являются герои нашего обзора – All Flash массивы компании AccelStor.

Использование SSD в серверах

Наиболее предпочтительные области для SSD в серверах следующие:

- Базы данных, с которыми работает большое количество пользователей, например сервер 1C, сервер SQL, CRM, ERP.

- Хранение и работа с наиболее востребованными данными.

- Приложения, где требуется высокое быстродействие, низкая задержка передачи данных, например приложения AR/VR, промышленные системы автоматизации и роботизации и т.п.

- Приложения, работающие на границе сети (Edge Computing), например виртуальные BBU для базовых станций мобильной сети (vRAN).

- Вычисления в памяти (In-memory Computing).

- Обработка очень больших объемов потоковых данных в режиме реального времени.

- Приложения онлайн-трейдинга, где очень важно время реакции на изменения в биржевой ситуации.

Можно назвать и другие области, где применение SSD в серверах гораздо предпочтительное, нежели HDD.

Параметры TBW и DWPD

Это важные параметры, характеризующие надежность и долговечность диска SSD:

- TBW (Total Bytes Written): допустимое количество терабайт, которое можно записать на накопитель, стирая и записывая информацию заново. Чем TBW выше, тем более живуч накопитель SSD и тем дольше он сможет проработать без сбоев.

- DWPD (Drive Writes Per Day): допустимое количество перезаписей полного объема SSD в сутки. Чем выше этот показатель, тем лучше отказоустойчивость твердотельного накопителя. Чем выше требования к интенсивности обмена данными с накопителем при работе сервера, тем выше должен быть данный показатель. DWPD можно вычислить так:

DWPD = TBW / СTB * 365 * 5, где:

- СTB – объем накопителя в терабайтах;

- 365 – количество дней в году;

- 5 – количество лет гарантии.

Показатель DWPD более объективен, потому что при расчете учитывается время гарантии. Для памяти SCM (NVMe SSD) число циклов перезаписи много выше, чем для обычного SSD SATA.

3D XPoint

Отдельного рассказа заслуживают накопители Intel Optane. Технология SSD 3D XPoint была анонсирована корпорациями Intel и Micron в июле 2015 года. Устройства компании Intel, использующие данную технологию, выпускаются под торговой маркой Optane, а устройства Micron будут использовать марку QuantX.

Накопитель Intel Optane с технологией 3D XPoint

Технология 3D XPoint может обеспечить практически неограниченный ресурс циклов перезаписи, по крайней мере, очень высокое значение этого показателя. Это достигается за счет особой технологии: изменения фазового состояния вещества, когда материал ячейки памяти при нагреве током меняет свое состояние из аморфного (высокое сопротивление) в кристаллическое (низкое сопротивление) и обратно. Это совершенно новый принцип, не связанный с хранением заряда в ячейке, как у предыдущих поколений SSD NAND.

Чипы 3D XPoint емкостью 16 Гбайт обеспечивают плотность памяти в 0,62 Гбит/мм 2 . Для сравнения, плотность памяти в микросхемах 3D NAND TLC достигает 2,5 Гбит/мм 2 . По емкости эта память проигрывает 3D NAND для SSD.

Очевидно, что использование 3D XPoint в виде модулей памяти SCM весьма перспективно для подсистем памяти серверов.

Преимущества 3D XPoint можно увидеть в такой инфографике:

Технологии SSD для серверов

Если кому-то интересно разобраться в технологиях SSD (а их есть много разных), применяемых в серверах, можно прочитать этот раздел. Если неинтересно, можно пропустить.

Недостатки SSD

Основных недостатков SSD всего два, но они часто являются аргументами в пользу выбора HDD.

- Низкое число циклов перезаписи по сравнению с HDD.

- Высокая стоимость.

Хотя эти недостатки довольно существенны, очевидно, что решение этих проблем – лишь вопрос времени.

Читайте также: