Сколько памяти занимает википедия

Вы замечали, что мы постоянно скачиваем всё больше и больше информации, при этом она сама становится больше. Что я имею в виду - фильм, который раньше каждый из нас с удовольствием смотрел весил 400-600Мб, сейчас же - качество в 2-4Гб считается не очень, а уж если полноценно смотреть в высококачественном разрешении 4К - то конечно же надо скачивать фильм 20-30Гб по размеру и более. А уже не за горами и разрешение 8К и далее. И так со всеми остальными видами - тексты больше, картинки больше - всё больше.

И всё это радостно накапливается в Интернете … Сколько же сейчас там хранится данных, вот конкретно в нашем 2020м году. Оказывается, существует не только множество исследований, но и множество методик, которые пытаются оценить размер Интернета. Но прежде всего, нам придётся разобраться в единицах измерения - ибо конечно же Гигабайты и Терабайты в этом нам не помогут :)

Йоттабайт это очень много

Итак, как всем прекрасно известно, минимальный размер информации это 1 бит - то есть 0 или 1, 8 бит нам дают 1 байт и вот после этого и начинается прирост размера измерений почти на 1000, точнее на 1024 - связано это с тем, что 1024 это 2 в 10 степени. Отсюда и появляются некруглые итоговые значения. Кстати математики придумали гораздо большее количество названий большим и ОЧЕНЬ большим числам .

В Интернете нас более 4.5 миллиардов

Итак, прежде всего немного статистики - общее количество пользователей Интернета - более 4.5 миллиардов, более 1.5 миллиардов сайтов. Ежедневно мы шлём более 237 миллиардов электронных писем, более 705 миллионов постов в Твиттере, более 6 миллиардов видео просмотрено на YouTube. Живую статистику можно посмотреть прям здесь . А вот сколько именно данных создаёт каждый из нас - можно почитать здесь .

Каков же размер Интернета?

Итак, сколько же действительно данных в Интернете. На текущий размер ежегодный прирост данных в Интернете оценивается примерно в 1,1 Зеттабайт, что как мы помним из таблицы равно около 1,2 миллиарда терабайт данных. В целом же общий размер Интернета можно выразить в диапазоне от 2 до 4 Зеттабайт данных. И в целом если вдруг захочется скачать весь Интернет - то сегодня на хорошей скорости это потребует около 11 миллиардов лет.

А сколько же весит Интернет?

И вот это самый интересный вопрос - оказывается это можно посчитать :) Как мы помним, вся информация состоит из бит - то есть нулей и единиц и если 0 это просто отсутствие чего-то, то единица это фактически заряженный конденсатор - микроскопический и при этом содержит около 40.000 электронов - это очень мало, но они уже что-то весят! Масса электрона составляет 9,11 * 10⁻³¹ кг. Принимая, что примерно 0 и 1 одинаковое количество умножим на общий размер Интернета получаем, что он весит сейчас от 0,0000005 грамм до 0,0000015 грамм - немного не правда ли :)

Как известно мы живем в мире информации. Как бы это банально не звучало, но каждый день в мире что то происходит. Благодаря появлению компьютеров информация обрела единицу измерения, а благодаря интернету появилась возможность распространять ее огромное количество по всему миру со скоростью света.

И так, сегодня хотелось бы вам рассказать сколько доступной и не очень доступной информации имеется в свободном и не совсем свободном доступе, или же иными слова сколько "весит" интернет!

Начну пожалуй с небольшой справки. Вы скорее всего знаете что раньше информация измерялась в байтах (в самом начале вообще в битах. 1 байт=8 бит). Поскольку количество информации постоянно растет, а измерять что либо большими числами не совсем удобно, используются специальные приставки которые обозначают количество нулей после единицы т. е. 1 Килобайт=1 000 байт, 1 Мегабайт=1 000 000 байт и т. д. Вы наверняка слышали про Гигабайты, Терабайты, возможно даже про Петабайты. Кроме вышеперечисленных существуют еще Эксабайты, Зеттабайты и Йоттабайты. Для простоты восприятия переведем все выше перечисленные обозначения в Гигабайты. И так

1 Терабайт= 1000 Гигабайт

1 Петабайт=1 000 000 Гб

1 Эксабайт= 1 000 000 000 (Миллиард) Гб

1 Зеттабайт = 1 000 000 000 000 (Триллион) Гб

1 Йоттабайд = 1 000 000 000 000 000 (Квадриллион) Гб

В общем вы оценили масштаб. А теперь вернемся непосредственно к теме поста. Объем данных, хранящихся в Интернете на момент 2009 года, вплотную приблизился к отметке в 500 эксабайтов (500 млрд Гб). Такие данные приводит аналитическая компания IDC, проводившая исследование по заказу EMC Corporation. По прогнозам аналитиков, через полтора года количество данных вырастет еще в 2 раза. Аналитики подчеркивают, что объем хранящейся в Интернете информации удваивается приблизительно каждые полтора года.

И так если предположить что такая тенденция сохранялась на протяжении всего это времени(2009-2015) т. е. объем информации в интернете удваивался в 2 раза каждые 1,5 года то на данный момент общий объем всего контента в интернете составляет 8 Зеттабайт (хотя с учетом развития интернета и увеличения скорости передачи данных это число скорее всего в несколько раз больше). Или 8 000 000 000 000 (Триллионов) Гигабайт!! Согласитесь внушительное число! (а если вспомнить старую легенду что 80 % интернета это порнография и прочий не потребный контент, то можно понять чем занималось человечество все это время, и почему мы до сих пор не освоили космос:)) В общем что бы вы сильнее ощутили всю мощь такого количества информации переведу все эти Гигабайты в часы, а именно в видео самого большого разрешение которое имеется на сегодняшний день.

На данный момент самое высокое разрешение видео имеет размеры 4096х3112 пикселей называется 4К или UltraHD, и 1 час такого видео в среднем займет примерно 30 Гигабайт пространства на вашем жестком диске! И так путем не хитрых подсчетов можно узнать что, чтобы посмотреть видео данного формата с размером 8 зеттабайт вам потребуется не много ни мало а. 30 441 400 лет! Не х*евое такое кино! Если учитывать что первый хомо сапиенс появился примерно 200 000 лет назад. мы так не плохо накопили информации за эти 200 000 лет! Но к сожалению из 8 зеттабайт информации полезной можно назвать лишь не большую часть. И это. это печально.

P. S. Данный пост не претендует на звание научного доклада, оперировал лишь поверхностной информацией, не углубляясь в мат часть)))

Мы уже привыкли к постоянному и безудержному росту объёма информации в сети. Остановить или замедлить этот процесс никому не под силу, да и смысла в этом нет. Все знают, что интернет огромен, как по количеству данных, так и по поголовью сайтов. Но насколько он велик? Можно ли как-то оценить, хотя бы приблизительно, сколько петабайт бегает по кабелям, опутывающим планету? Сколько сайтов ждут посетителей на сотнях тысяч серверов? Этим вопросом задаются многие, в том числе и учёные, которые пытаются разработать подходы к оценке безбрежного моря информации, называемого интернетом.

Всемирная сеть — очень оживлённое место. Согласно сервису Internet Live Stats, каждую секунду в Google делается более 50 000 поисковых запросов, просматривается 120 000 видео на Youtube, отправляется почти 2,5 млн электронных писем. Да, весьма впечатляет, но всё же эти данные не позволяют в полной мере представить себе размеры интернета. В сентябре 2014 года общее количество сайтов перевалило за миллиард, и сегодня их примерно 1,018 млрд. А ведь здесь ещё не подсчитана так называемая «глубокая паутина» (Deep Web), то есть совокупность сайтов, не индексируемых поисковиками. Как указывается на Википедии, это не синоним «тёмной паутины», к которой в первую очередь относятся ресурсы, на которых ведётся всевозможная противоправная деятельность. Тем не менее, контент в «глубокой паутине» может быть как совершенно безобидным (например, онлайновые базы данных), так и совершенно непригодным для глаз законопослушной публики (к примеру, торговые площадки чёрного рынка с доступом только через Tor). Хотя Tor’ом пользуются далеко не только нечистые на руку люди, но и вполне чистые перед законом пользователи, алчущие сетевой анонимности.

Конечно, вышеприведённая оценка численности веб-сайтов является приблизительной. Сайты возникают и исчезают, к тому же размеры глубокой и тёмной паутин определить практически невозможно. Поэтому даже приблизительно оценивать размеры сети по этому критерию весьма непросто. Но одно несомненно — сеть постоянно растёт.

Давайте посчитаем массу ВСЕГО ИНТЕРНЕТА?

Может тогда величина получится ощутимой?

По самым последним данным объём информации в интернете равняется 10 Зеттабайтам , т.е. 10 миллионов миллионов Гигабайт - 10 000 000 000 000 Гигабайт.

Если всю эту информацию записать на DVD-диски, то получится стопка высотой до Луны (около 703 000 км).

Если подставим новое количество байт в наши расчёты, то получится, что все в мире сайты, картинки, письма, фотографии, видео и тексты весят около 1 грамма!

Но наши расчёты справедливы, если бы мы всю имеющуюся в мире электронную информацию записали на огромную флешку.

Но информация в интернете хранится не на флешках, а на магнитных жестких дисках. Принцип там в том, что при намагничивании ячеек памяти, как и любого другого предмета, не меняется его масса (электронов не добавляется), а меняется структура предмета. Т.е. масса пустого и заполненного жесткого диска почти равны . Но почему почти? Потому что здесь в дело вступает теория относительности.

Ведь для того, чтобы сообщить ячейке некоторую информацию , т.е. изменить её структуру, потребуется некоторое количество энергии, которую она запасает в виде магнитного поля. А энергия имеет эквивалент массы. Помните знаменитую формулу E=mc^2?

Итак, энергия магнитного поля одной ячейки равна 1,5х10^-21 Дж.

Таким образом весь интернет, записанный на жестких дисках весит 8.35х10^-23 грамм!

0,0000000000000000000000835 грамм - весь интерет!

Чтобы понять насколько это мало, сравним это с массой атома водорода.

0,000000000000000000000000167 грамм - атом водорода!

И получаем следующее: весь интернет весит в 500 раз больше атома водорода.

Т.е. вся информация, созданная и выложенная человечеством, все ваши переписки, знания, видео, фотографии, всё это всех людей на земле может быть записано с помощью энергии, выделенной 500 атомами водорода во время ядерного синтеза! Это меньше самой крошечной пылинки у вас дома.

Интернет настолько огромен, кажется, что в нём можно найти почти всё, но с другой стороны он является очень крошечным.

Спасибо за просмотр!

Друзья, ставьте лайки, подписывайтесь на канал, если вам было интересно. Наберём 100 лайков и 100 подписчиков и посчитаем, сколько весит вся Москва!

Всё дело в данных

Если одних только веб-сайтов более миллиарда, то отдельных страницы гораздо больше. Например, на ресурсе WorldWideWebSize представлена оценка размера интернета именно по количеству страниц. Методика подсчёта разработана Морисом де Кундером (Maurice de Kunder), опубликовавшим её в феврале этого года. Вкратце: сначала система осуществляет поиск в Google и Bing по списку из 50 распространённых английских слов. На основании оценки частоты этих слов в печатных источниках полученные результаты экстраполируются, корректируются, вводится поправка на совпадения результатов по разным поисковикам, и в результате получается некая оценка. На сегодняшний день размер интернета оценивается в 4,58 млрд отдельных веб-страниц. Правда, речь идёт об англоязычном сегменте сети. Для сравнения, там же указан размер голландского сегмента — 225 млн страниц.

Но веб-страница в качестве единицы измерения — вещь слишком абстрактная. Куда интереснее оценить размер интернета с точки зрения объёма информации. Но и здесь есть нюансы. Какую именно информацию считать? Передаваемую или обрабатываемую? Если, к примеру, нас интересует информация передаваемая, то и здесь можно считать по-разному: сколько данных может быть передано за единицу времени, или сколько передано фактически.

Одним из способов оценки циркулирующей в интернете информации является измерение трафика. Согласно данным Cisco, к концу 2016 года по всему миру будет передано 1,1 зеттабайта данных. А в 2019 году объём трафика удвоится, достигнув 2 зеттабайт в год. Да, это ОЧЕНЬ много, но как можно попытаться представить себе 10 21 байт? Как услужливо подсказывается в инфографике от той же Cisco, 1 зеттабайт эквивалентен 36 000 лет HDTV-видео. И понадобится 5 лет для просмотра видео, передаваемого по миру каждую секунду. Правда, там было предсказано, что этот порог трафика мы перейдём в конце 2015, ну ничего, немного не угадали.

В 2011 году было опубликовано исследование, согласно которому, в 2007 году человечество хранило на всех своих цифровых устройствах и носителях примерно 2,4 х 10 21 бит информации, то есть 0,3 зеттабайта. Суммарная вычислительная мощность мирового парка вычислительных устройств «общего назначения» достигала 6,4 х 10 12 MIPS. Любопытно, что 25% от этой величины приходилось на игровые приставки, 6% — на мобильные телефоны, 0,5% — на суперкомпьютеры. При этом суммарная мощность специализированных вычислительных устройств оценивалась в 1,9 х 10 14 MIPS (на два порядка больше), причём 97% приходилось на… видеокарты. Конечно, с тех пор прошло целых 9 лет. Но очень примерно оценить текущее положение дел можно исходя из того, что за период 2000-2007 среднегодовой рост объёмов хранимой информации составил 26%, а вычислительной мощности — 64%. Учитывая развитие и удешевление носителей, а также замедление прироста вычислительной мощности процессоров, предположим, что количество информации на носителях растёт на 30% в год, а вычислительная мощность — на 60%. Тогда объём хранимых данных в 2016 году можно оценить на уровне 1,96 х 10 22 бит = 2,45 зеттабайта, а вычислительную мощность персональных компьютеров, смартфонов, планшетов и приставок на уровне 2,75 х 10 14 MIPS.

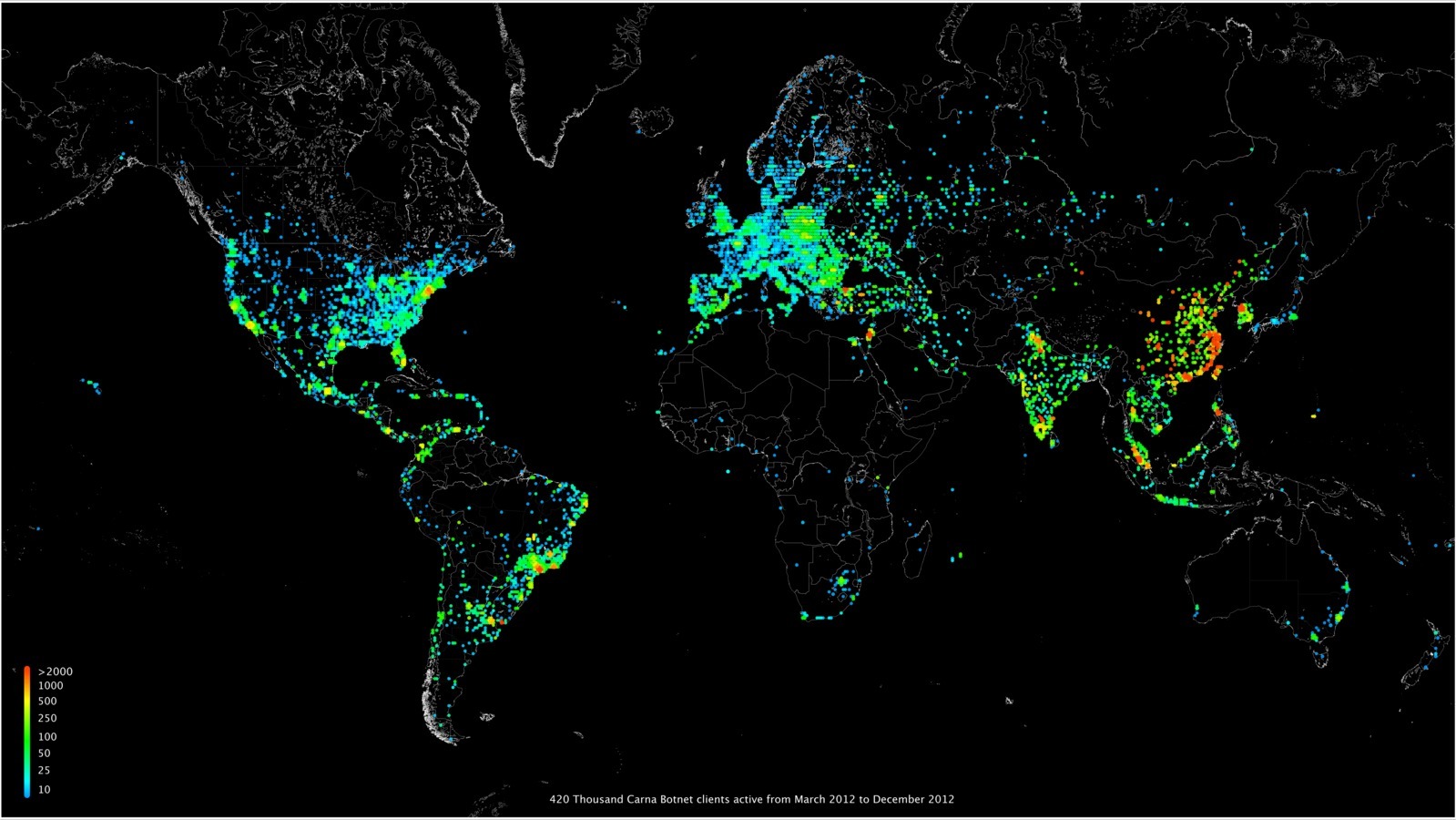

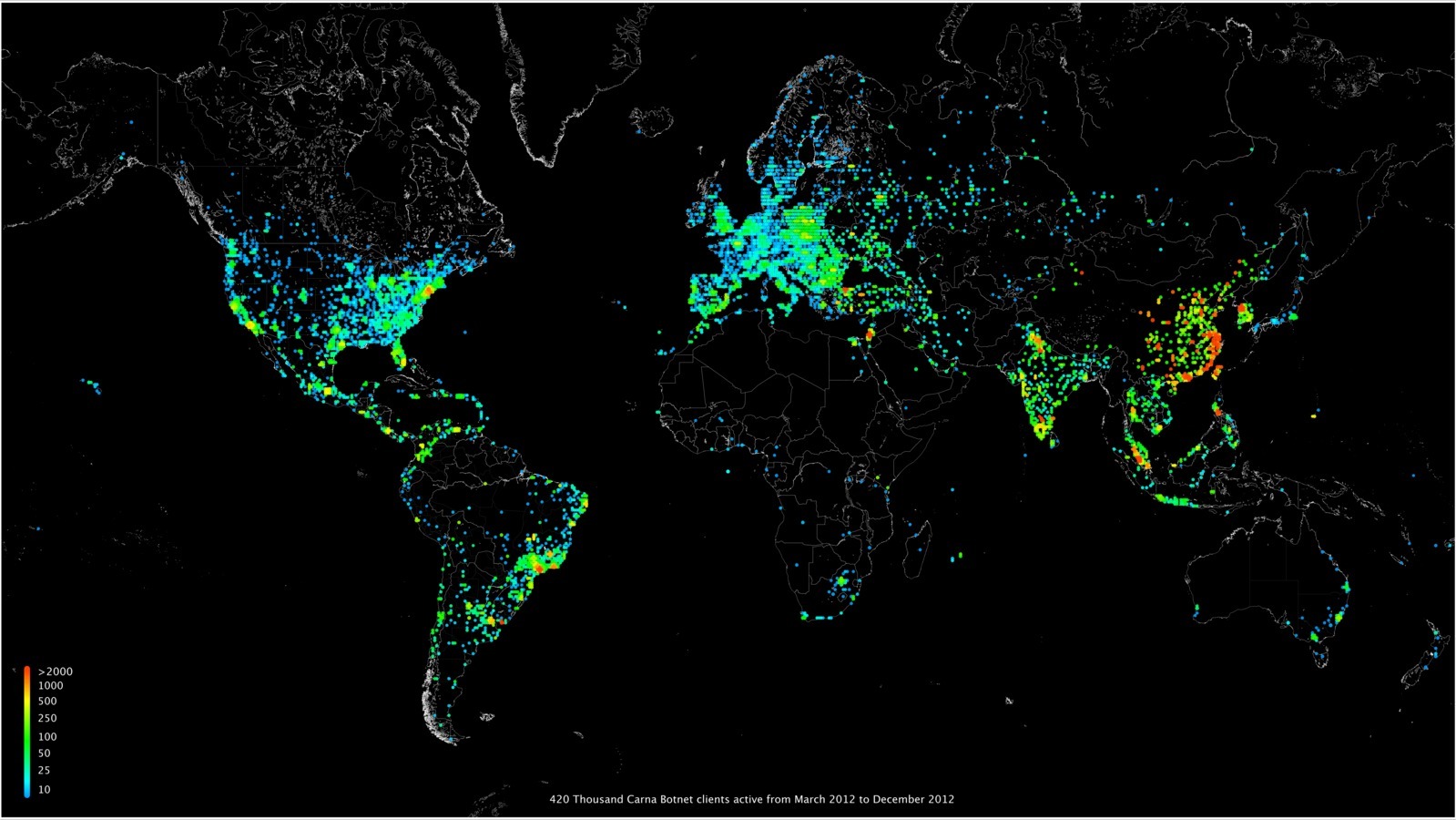

В 2012 году появилось любопытное исследование количества используемых на тот момент IPv4-адресов. Изюминка в том, что информация была получена с помощью глобального сканирования интернета силами огромной хакерской ботнет-сети из 420 тыс. узлов.

После сбора информации и алгоритмической обработки выяснилось, что одновременно активными были около 1,3 млрд IP-адресов. Ещё 2,3 млрд бездействовали.

Всё дело в данных

Если одних только веб-сайтов более миллиарда, то отдельных страницы гораздо больше. Например, на ресурсе WorldWideWebSize представлена оценка размера интернета именно по количеству страниц. Методика подсчёта разработана Морисом де Кундером (Maurice de Kunder), опубликовавшим её в феврале этого года. Вкратце: сначала система осуществляет поиск в Google и Bing по списку из 50 распространённых английских слов. На основании оценки частоты этих слов в печатных источниках полученные результаты экстраполируются, корректируются, вводится поправка на совпадения результатов по разным поисковикам, и в результате получается некая оценка. На сегодняшний день размер интернета оценивается в 4,58 млрд отдельных веб-страниц. Правда, речь идёт об англоязычном сегменте сети. Для сравнения, там же указан размер голландского сегмента — 225 млн страниц.

Но веб-страница в качестве единицы измерения — вещь слишком абстрактная. Куда интереснее оценить размер интернета с точки зрения объёма информации. Но и здесь есть нюансы. Какую именно информацию считать? Передаваемую или обрабатываемую? Если, к примеру, нас интересует информация передаваемая, то и здесь можно считать по-разному: сколько данных может быть передано за единицу времени, или сколько передано фактически.

Одним из способов оценки циркулирующей в интернете информации является измерение трафика. Согласно данным Cisco, к концу 2016 года по всему миру будет передано 1,1 зеттабайта данных. А в 2019 году объём трафика удвоится, достигнув 2 зеттабайт в год. Да, это ОЧЕНЬ много, но как можно попытаться представить себе 10 21 байт? Как услужливо подсказывается в инфографике от той же Cisco, 1 зеттабайт эквивалентен 36 000 лет HDTV-видео. И понадобится 5 лет для просмотра видео, передаваемого по миру каждую секунду. Правда, там было предсказано, что этот порог трафика мы перейдём в конце 2015, ну ничего, немного не угадали.

В 2011 году было опубликовано исследование, согласно которому, в 2007 году человечество хранило на всех своих цифровых устройствах и носителях примерно 2,4 х 10 21 бит информации, то есть 0,3 зеттабайта. Суммарная вычислительная мощность мирового парка вычислительных устройств «общего назначения» достигала 6,4 х 10 12 MIPS. Любопытно, что 25% от этой величины приходилось на игровые приставки, 6% — на мобильные телефоны, 0,5% — на суперкомпьютеры. При этом суммарная мощность специализированных вычислительных устройств оценивалась в 1,9 х 10 14 MIPS (на два порядка больше), причём 97% приходилось на… видеокарты. Конечно, с тех пор прошло целых 9 лет. Но очень примерно оценить текущее положение дел можно исходя из того, что за период 2000-2007 среднегодовой рост объёмов хранимой информации составил 26%, а вычислительной мощности — 64%. Учитывая развитие и удешевление носителей, а также замедление прироста вычислительной мощности процессоров, предположим, что количество информации на носителях растёт на 30% в год, а вычислительная мощность — на 60%. Тогда объём хранимых данных в 2016 году можно оценить на уровне 1,96 х 10 22 бит = 2,45 зеттабайта, а вычислительную мощность персональных компьютеров, смартфонов, планшетов и приставок на уровне 2,75 х 10 14 MIPS.

В 2012 году появилось любопытное исследование количества используемых на тот момент IPv4-адресов. Изюминка в том, что информация была получена с помощью глобального сканирования интернета силами огромной хакерской ботнет-сети из 420 тыс. узлов.

После сбора информации и алгоритмической обработки выяснилось, что одновременно активными были около 1,3 млрд IP-адресов. Ещё 2,3 млрд бездействовали.

Физическое воплощение

Несмотря на восход цифрового века, для многих из нас биты и байты остаются понятиями несколько абстрактными. Ну, раньше память измеряли мегабайтами, теперь гигабайтами. А что если попробовать представить размер интернета в каком-то вещественном воплощении? В 2015 году двое учёных предложили использовать для оценки настоящие бумажные страницы А4. Взяв за основу данные с вышеупомянутого сервиса WorldWideWebSize, они решили считать каждую веб-страницу эквивалентной 30 страницам бумажным. Получили 4,54 х 10 9 х 30 = 1,36 х 10 11 страниц А4. Но с точки зрения человеческого восприятия это ничем не лучше тех же байтов. Поэтому бумагу привязали к… амазонским джунглям. Согласно расчёту авторов, для изготовления вышеуказанного количества бумаги нужно 8 011 765 деревьев, что эквивалентно 113 км 2 джунглей, то есть 0,002% от общей площади амазонских зарослей. Хотя позднее в газете Washington Post предположили, что 30 страниц — слишком много, и одну веб-страницу правильнее приравнять к 6,5 страницам А4. Тогда весь интернет можно распечатать на 305,5 млрд бумажных листов.

Но всё это справедливо лишь для текстовой информации, которая занимает далеко не самую большую долю от общего объёма данных. Согласно Cisco, в 2015 году на одно только видео приходилось 27 500 петабайт в месяц, а совокупный трафик веб-сайтов, электронной почты и «данных» — 7 700 петабайт. Немногим меньше пришлось на передачу файлов — 6 100 петабайт. Если кто забыл, петабайт равен миллиону гигабайт. Так что амазонские джунгли никак не позволят представить объёмы данных в интернете.

В упомянутом выше исследовании от 2011 года предлагалось визуализировать с помощью компакт-дисков. Как утверждают авторы, в 2007 году 94% все информации было представлено в цифровом виде — 277,3 оптимально сжатых эксабайта (термин, обозначающий сжатие данных с помощью наиболее эффективных алгоритмов, доступных в 2007 году). Если записать всё это богатство на DVD (по 4,7 Гб), то получим 59 000 000 000 болванок. Если считать толщину одного диска равной 1,2 мм, то эта стопка будет высотой 70 800 км. Для сравнения, длина экватора равна 40 000 км, а общая протяжённость государственной границы России — 61 000 км. Причём это объём данных по состоянию на 2007 год! Теперь попробуем таким же образом оценить общий объём трафика, который прогнозируется на этот год — 1,1 зеттабайта. Получим стопку DVD-дисков высотой 280 850 км. Тут уже впору переходить на космические сравнения: среднее расстояние до Луны составляет 385 000 км.

Другая аналогия: общая производительность всех вычислительных устройств в 2007 году достигала 6,4 х 10 18 инструкций/сек. Если принять, что в человеческом мозге 100 млрд нейронов, каждый из которых имеет 1000 связей с соседними нейронами и посылает до 1000 импульсов в секунду, то максимальное количество нейронных импульсов в мозге равно 10 17 .

Добрый день, какие сервера должны быть у Google чтобы он хранил столько информации?

Есть YouTube, вообще практически весь интернет у них на серверах.

Боюсь представить какие цифры там.

Интересно просто какие виды памяти бывают)

Вкратце - построили. У них с сотню датацентров по всему миру, включая кэширующие прокси ютуб-роликов. Внутри почти обычные железки с тоннами жестких дисков и SSD. Их просто много.

Johnny Gat, крупные IT компании редко используют такие железки, чаще это самые обычные сервера или блейды, с подключенными полками, если это нужно для конкретной машинки.

Владимир Олохтонов, крупные IT компании как раз такие "железки" и используют. А вот гигантские (амазон, фейсбук, гугл) - обычно используют что-то "свое".

самое интересно, что автор вопроса даже в тот же гугл поленился залезть)))) испугался прослыть каламбуром?)))

Интересно, что у них на готове, на случай если вдруг самолет в один из датацентров влетит? Второй такой же, с теми же данными?

Волшебные сервера, ясен пень.

А вот какие виды памяти бывают:

Где-то в гугле)) встречал статейку, как ихние инженера ездят на заводы, скидки выбивают))) Ну и нельзя исключать полезность исключения дублирования, если процессору для этого надо будет 0, 0001% процессорного времени, почему же не хранить фотки одной и той же пьянки, который один юзер пересохранил себе, в одном варианте?))) А какой просто отрывается при умном анализе картинок? Дублей наверняка процентов 10% точно есть.

индекс всего интернета и "весь интернет" это не одно и тоже. объем хранилища у них несомненно большой, но значительно меньше чем "весь интернет"

размер индекса гугла примерно 100 Петабайт на 2016 год. сейчас наверно подрос где нибудь процентов на 10.

прибавим сюда кучу личной инфы с их сервисов, ну скажем еще процентов 20 от этого объема.

Объем всего интернета по примерным оценкам исследователей из Cisco (самая большая контора по производству сетевого оборудования) - где то в районе 1.2 Зетабайта на текущий момент, что примерно в 10 000 раз больше чем размер индекса Google.

При желании можно разместить 200 Петабайт данных даже в одном ДЦ.

Более интересный вопрос - как они обеспечивают оперативность доступа к такому объему данных (я могу представить только в общих чертах)

Это понятно что не весь интернет у них. Поисковой индекс это лишь часть. У них есть ещё и Google Drive, YouTube. много чего есть что много место занимает

Я вот думаю, Гуглу много денег Я не дал но место на дисках моя информация занимает, откуда столько дисков? ))

И правда ли, что заполненная флешка, тяжелее пустой? И если да, то насколько?

Начнём с элементарного сравнения. Например, полное собрание сочинений Льва Толстого в 5 томах весит около 12 кг , а компьютерный эквивалент соответствует примерно 25 Мегабайтам текста. В обычную электронную читалку объёмом 4 ГБ поместится 160 полных собраний сочинений различных авторов. И что же, после этого читалка потяжелеет на 12х160=1920 килограмм? Столько весит Ниссан X-Trail. Конечно, масса гаджета останется практически неизменной.

С другой стороны, если полностью исписать блокнот, то его вес увеличивается на массу исписанных чернил. И лист бумаги с картинкой очевидно тяжелее белого.

На сколько тяжелеет флешка, когда на неё записывают информацию?

Давайте по порядку. Цифровая информация представляет из себя последовательность бит, каждый из которых может принимать одно из двух значений - 0 или 1. Вот оцифрованное изображение Моны Лизы.

В общем даже кажется, что эту последовательность можно запомнить, но масса мозга при этом никак не изменится.

Дело в том, как организовано хранение этой информации. Ячейки памяти в флешке представляют собой транзисторы с плавающим затвором. Транзисторов могут быть миллиарды. На этих затворах могут накапливаться электронные заряды, что соответствует значению 1 (единица) информации, а пустые затворы соответствуют 0.

Теперь самое интересное. Электроны имеют массу, а значит, флешка потяжелеет. Давайте посчитаем на сколько.

Для примера возьмём флешку в 32 ГБ. В ней 2,75х10^11 (10 в 11 степени) ячеек памяти. Масса электрона 9,1х10^-31 кг (10 в -31 степени). Электронов в каждой ячейки памяти помещается примерно 25 000 штук.

В результате перемножения получаем, что полностью заполненная единицами флешка весит на 0,00000000000618 грамма больше пустой! При этом изменение массы флешки настолько маленькое, что нет весов, которые могут измерить эту разницу.

Читайте также: