Scsi bus sharing vmware что это

In some cases, it may be necessary to share the same virtual disk (vmdk or RMD) between 2 (or more) virtual machines (VMs) running on VMWare ESXi hosts. This configuration is most commonly used in clustering scenarios. You can share the vmdk file located on the shared storage, or on a local datastore on the ESXi host. If you want to use the shared disk on different ESXi hosts, you can use only the shared VMFS (datastore), or SAN/iSCSI/vSAN storage. A shared virtual disk is a VMDK file that two or more virtual machines can read and write at the same time.

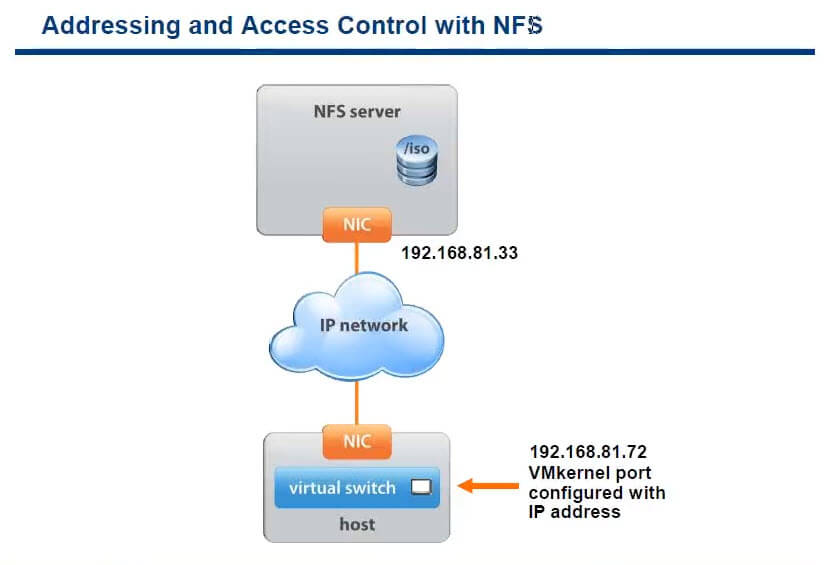

NFS компоненты

Довольно старый протокол, как его настраивать nfs в esxi я уже рассказывал, можете ознакомиться.

- Довольно легко внедряется

- не требует дополнительных вложений

- Используется для общего доступа для хостов, например датастор с дистрибутивами

- Из минусов, зависим по скорости, если скорость передачи стала слишком маленькой, встает напрочь

- Накладные расходы на передачу данных, на инкапсуляцию пакетов

Ниже представлен пример адресации NFS, схема очень простая.

Выводы

вообще не важно каким методом вы организуете дисковое пространство вашего ESXI хоста, все зависит от бюджета конечно, но помните, что в идеале все виды трафика должны быть изолированны, а в идеале находиться на разных сетевых картах, для максимальной производительности

Преимущества и недостатки ISCSI

- Легкость внедрения, данная технология уже легко идет в коробке с Windows Server 2008 R2 и выше, просто компонент, настроил и забыл

- Очень дешево, не нужно ничего кроме сетевой карты

- Не нужно ничего докупать

- Расстояние подключения, довольно высокое, хоть в соседний город, но будет скорость зависимая от интернета конечно, оптике проигрывает на порядок.

- Из недостатков, скорость, ограниченная сетевой картой и скоростью коммутатора, хотя есть возможность на нем настроить LACP да и на самом target, тоже можно сделать nic teeaming, за счет чего увеличить пропускную способность

- соединение не совсем надежное, если нет дублирования конечно

- нагрузка на вычислительные мощности процессора

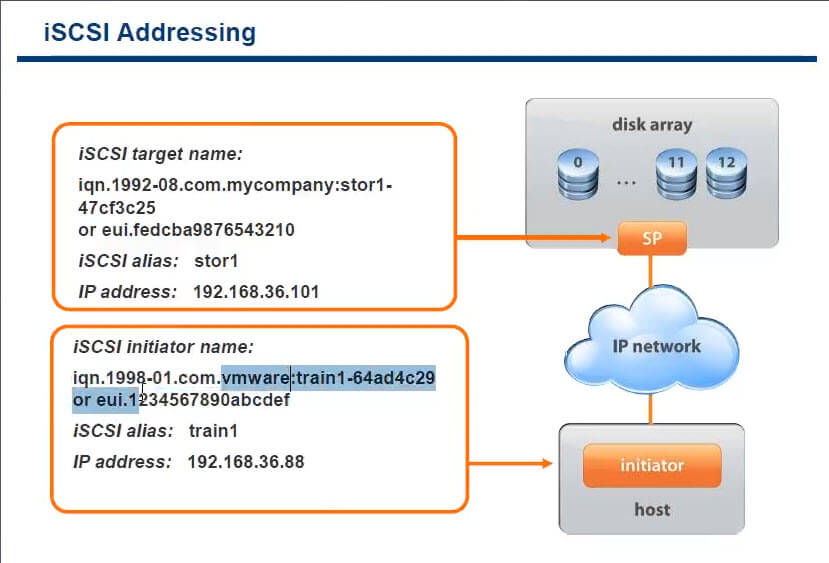

В качестве адресации в ISCSI taget или ISCSI initiator, используются аля wwn, под названием IQN. IQN это уникальный идентификатор устройства в рамках ISCSI сети.

Для чего применяют Multi-Writer диск

- Во первых, как я и писал выше для отказоустойчивости различных сервисов, сервера которых могут быть в разных ЦОДах.

- Во вторых для возможности обслуживания важных серверов, без их простаивания. Например, чтобы была возможность своевременно производить обновление Windows пакетов, другого программного обеспечения, иметь возможность перезагружать сервер

- В целях тестирования кластерных технологий, когда у вас нет СХД и нет возможности реализовать общий диск, по FC или ISCSI протоколу

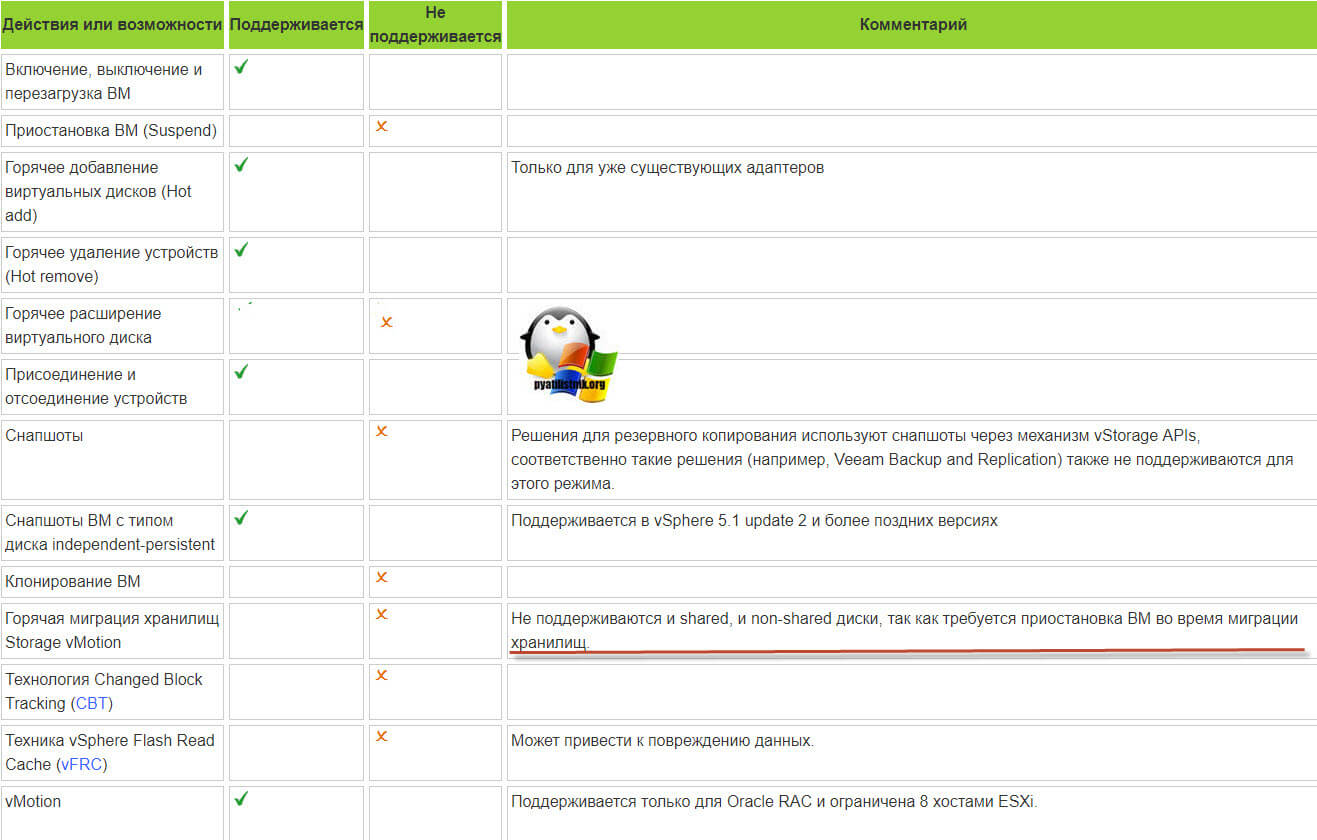

Ограничения подключений

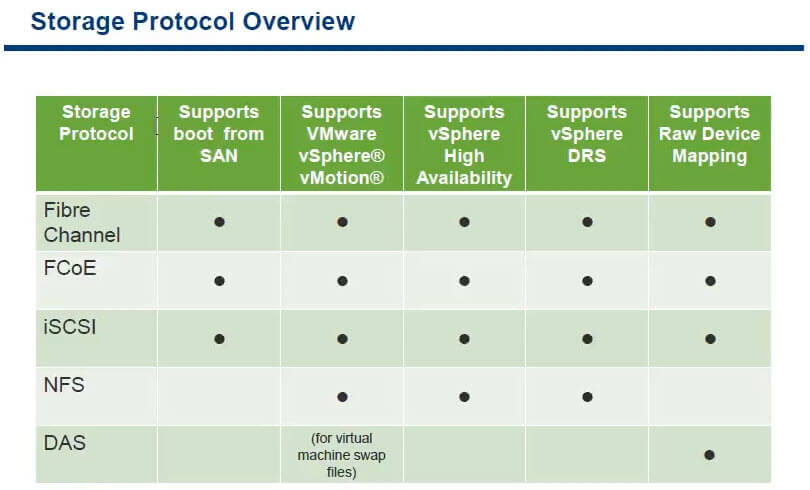

Как известно каждый метод подключения несет в себе как плюсы так и минусы, один что то умеет, а второй нет. Ниже мы рассмотрим сводную таблицу, в которой отражены виды подключений и какие функции vCenter в них работают.

Как можно заметить что загружаться с СХД (SAN) могут только FC, ISCSI и FCoE, NFS это не умеет так как работает не на блочном уровне, а на файловом. Ниже я расскажу, в чем разница. Первая тройка поддерживает все фишки vCenter

В чем разница, блочный в большинстве случаев быстрее, простой пример вам нужно прочитать 1 блок файла в 100 мб, при блочном доступе вы получите нужный блок сразу, при файловом доступе вы должны считать файл полностью и только потом получить нужную часть файла.

NFS по некоторым пунктам отстает, DAS как вы сами понимаете, логично что их не использует, так как по сути это собственные диски вставленные в сервер с гипервизором.

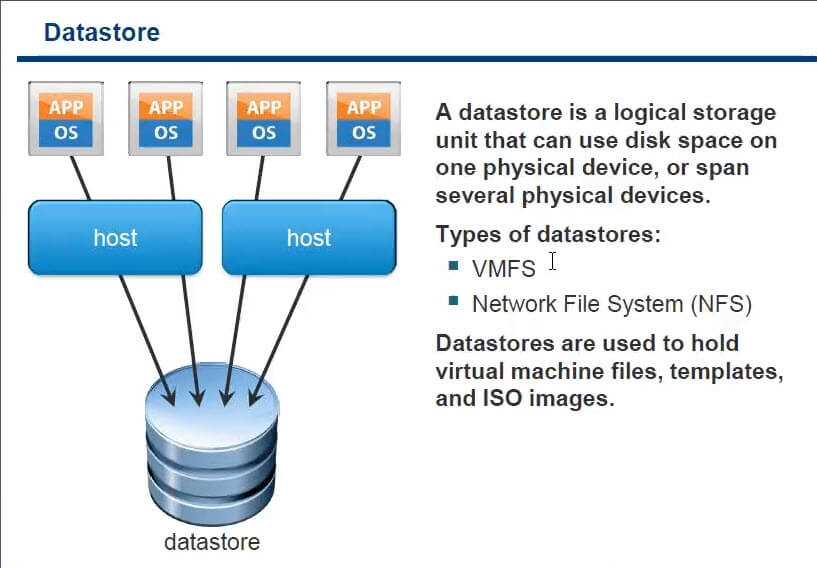

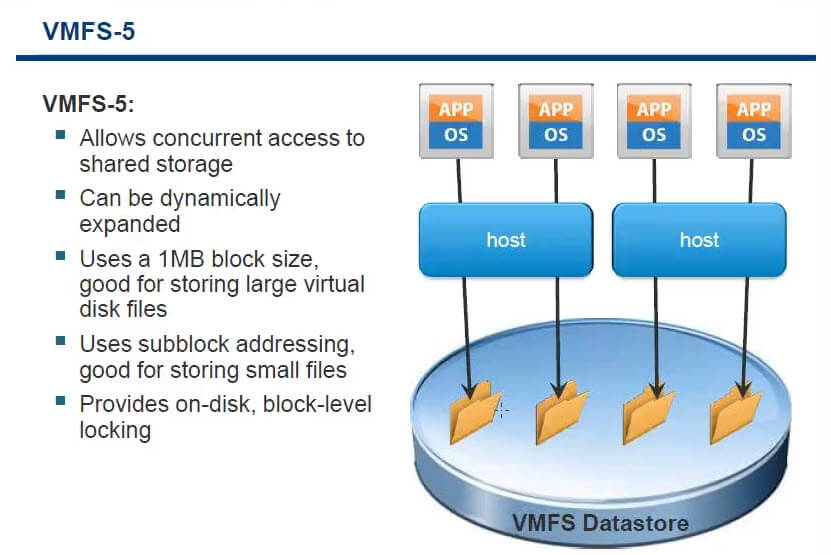

После того как вы разметили lun у вас он будет либо формата vmfs либо nfs. Если вы подключили NFS шару, она не отформатируется в VMFS а будет именно NFS. Ниже представлен скрин, как работаю виртуальные машины на datastore. Есть приложение в ОС, которое крутится в виртуалке, та в свою очередь работает на определенном хосте и хранит свои файлы виртуальной машины на определенном datastore.

Ограничения общих дисков VMware ESXI

Без некоторых нюансов все же не обошлось, хочу выделить некоторые ограничения при использовании общих дисков:

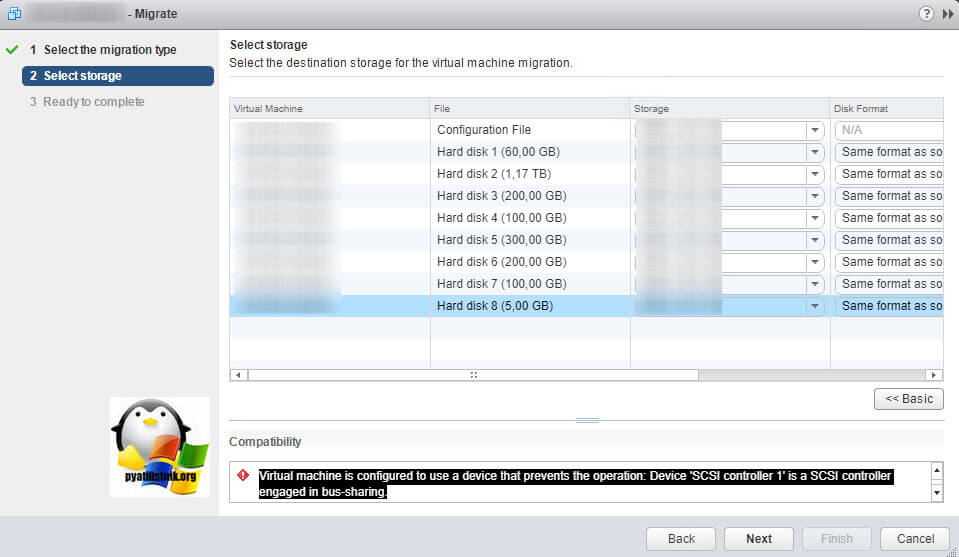

Например, при попытке сделать Storage vMotion вы получите ошибку:

Virtual machine is configured to use a device that prevents the operation: Device 'SCSI controller 1' is a SCSI controller engaged in bus-sharing

Если нужно будет мигрировать, то придется выключать виртуалку.

- Вы не сможете на живую произвести расширение дисков, при попытке вы получите вот такую ошибку:

The disk extend operation failed: The virtual disk requires a feature not supported by this program. Hot-extend is currently supported only for VMFS flat virtual disks without snapshots opened in persistent mode.

- Если вы вдруг разметите оба диска в NTFS на двух хостах и попытаетесь на них писать, создав на одном одну папку, а на втором вторую, то хосты эти папки не увидят, каждый свою, учтите, это вам не общий диск с синхронизацией файлов, Multi-Writer VMDK именно нужен для кластеризации.

VMFS 5

И так файловая система VMFS5 самая новая на текущий момент у VMware. Основные достоинства

- Общий доступ

- Можно динамически расширять

- Размер блока 1 мб, больше нет необходимости париться про, то какой размер блока выбрать

- Блочный доступ

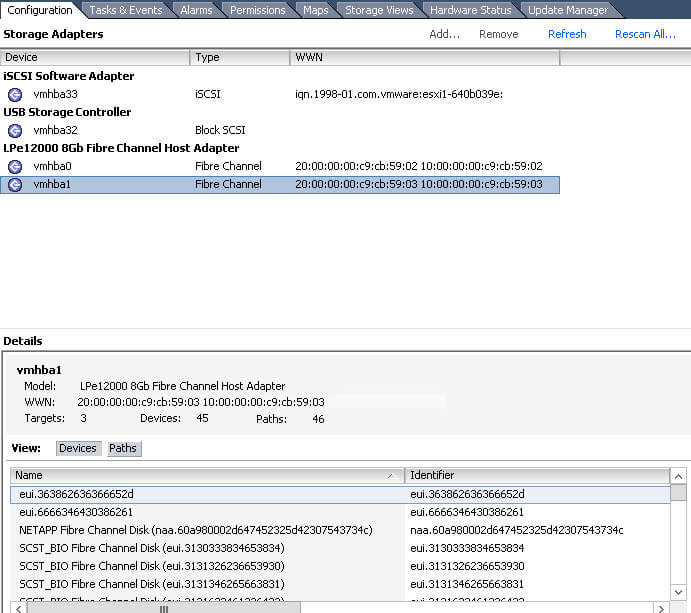

Устройства подключения к дисковым ресурсам в esxi называются как vmhba (виртуальный host bus adapter), есть ISCSI программный, есть fc как в моем случае. Посмотреть их можно в Storage Adapter. Заметьте у каждого представлен тут сразу WWN.

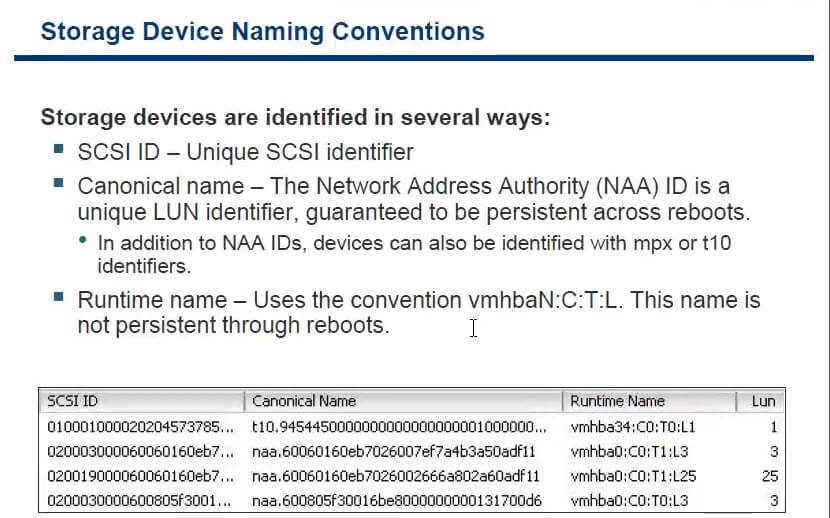

Каждый SCSI ID уникальный и имеет некое каноническое имя. Runtime name можно сравнить с WWN или mac адресом, по сути это уникальный идентификатор устройства в esxi.

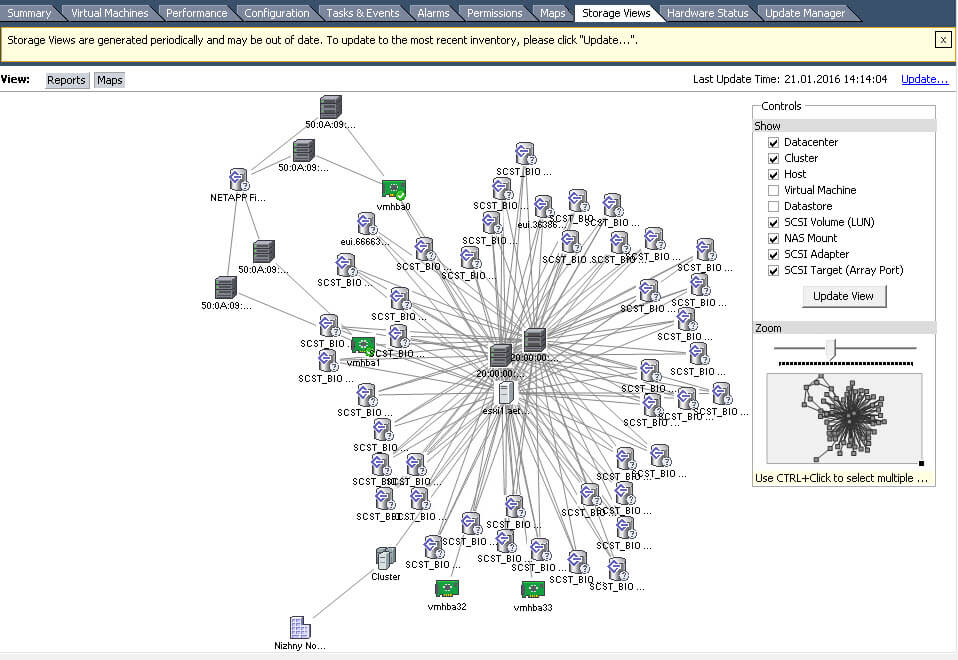

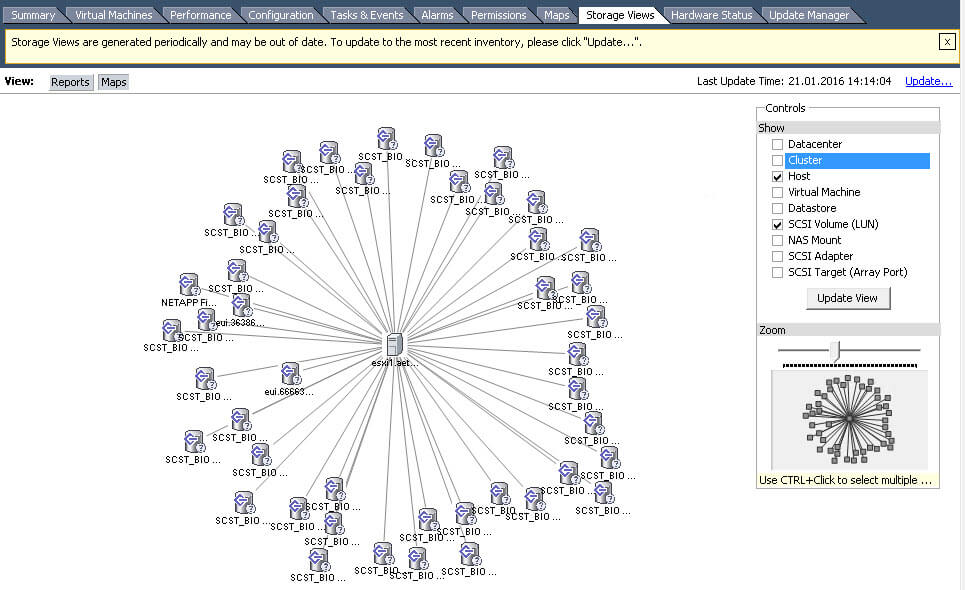

В VMware ESXi 5.5 есть очень удобная карта датасторов и устройств через, которые они подключены. Посмотреть данную карту можно в Storage Views

Удобно можно по фильтровать, убрав соответствующие галки с правой стороны.

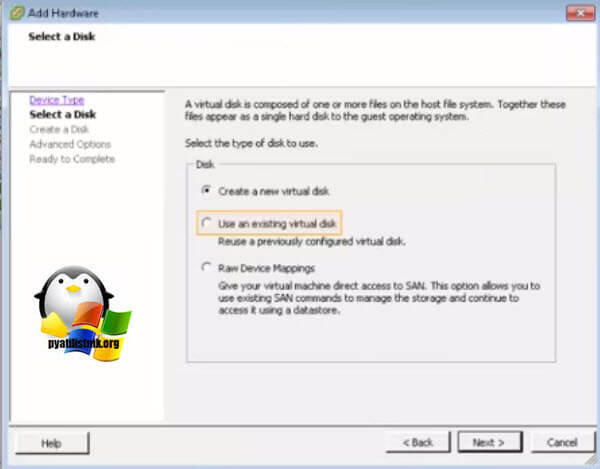

Включение общего диска для ESXI 5.5 и ниже

В более ранних версиях гипервизора Vmware ESXI 5.5 и ниже, общий кластерный диск выключается таким образом. Вы заходите так же в свойства виртуальной машины и добавляете там новый SCSI Controller с типом работы "Virtual".

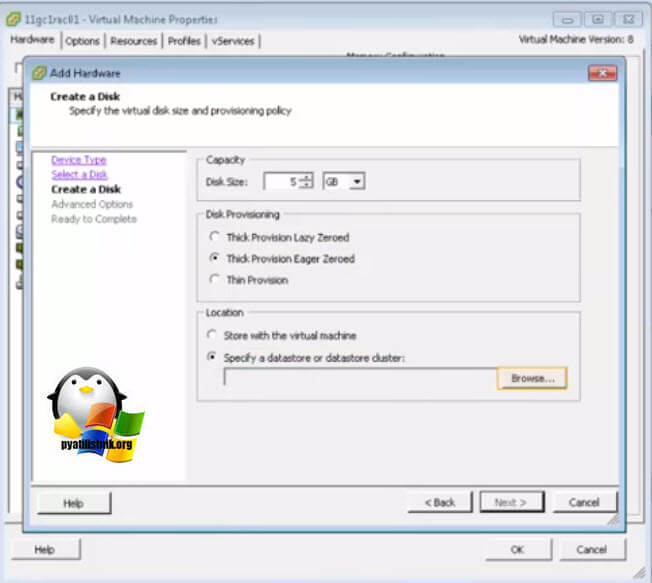

Затем вы создаете новый диск, указываете его размер и тип Thick Provision Eager Zeroed.

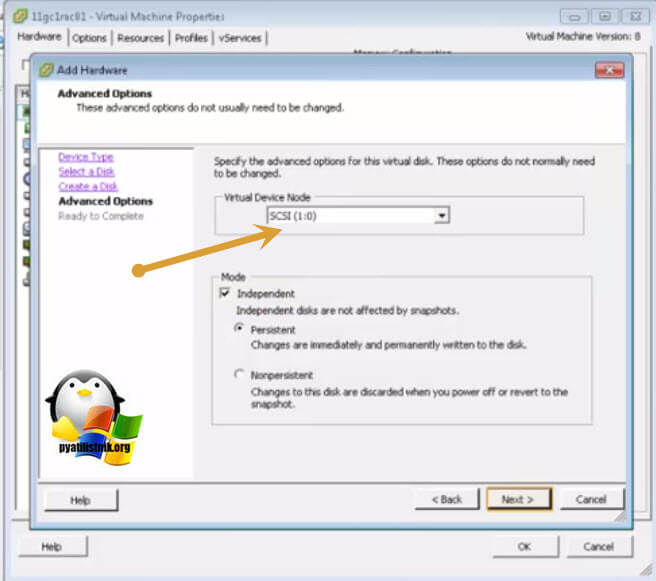

Далее Vmware ESXI 5.5 попросит вас выбрать Выбор LSI Logic SAS контроллер, обязательно укажите тот, что мы создали заранее и запомните порт SCSI к которому вы его подключаете в моем примере, это SCSI (1:0).

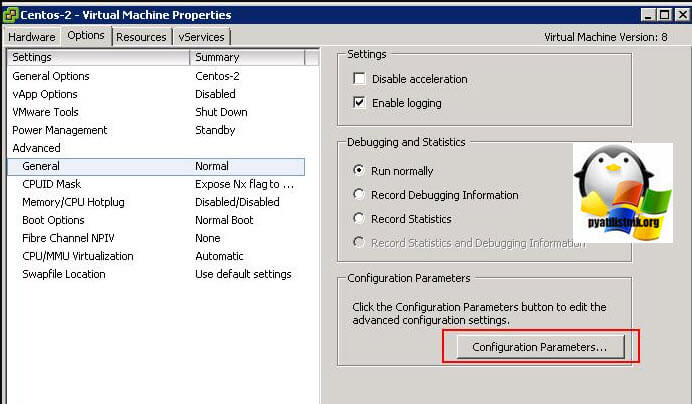

Далее в настройках виртуальной машины вам необходимо перейти на вкладку "Option - General" и нажать кнопку "Configuration Parameters".

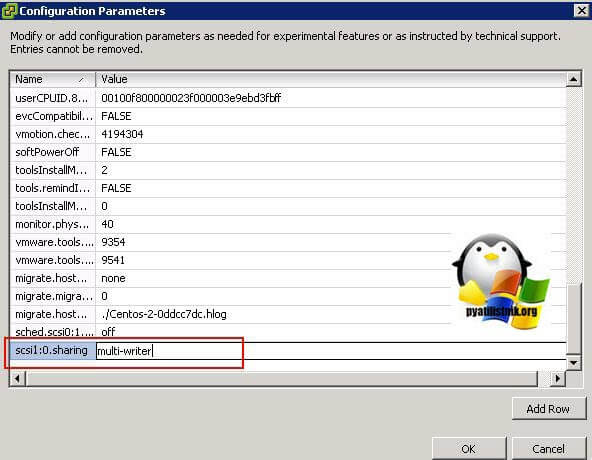

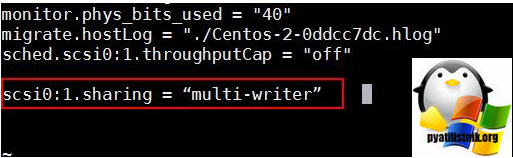

В самом конце для каждого общего диска пишем в имени номер SCSI порта SCSI1: 0.sharing в поле "Value" пишем multi-writer.

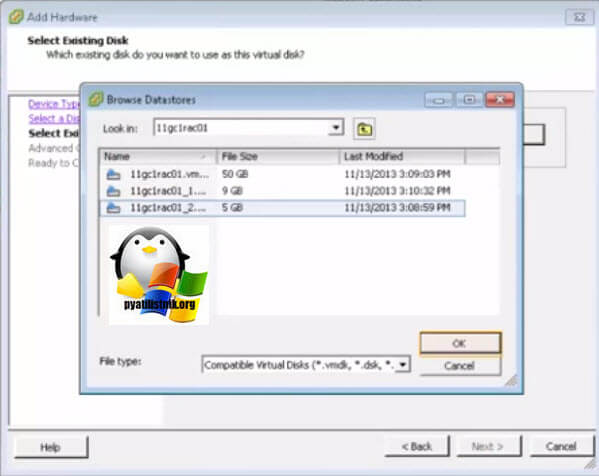

Для второй виртуальной машины делаем те же действия, единственное на этапе создания диска, выбираем пункт существующего "Use an existing virtual disk"

Через кнопку "Browse" указываем путь до него.

Выбираем сам VMDK диск. После чего не забываем так же прописать на вкладке "Option - General" и нажать кнопку "Configuration Parameters", для каждого общего диска пишем в имени номер SCSI порта SCSI1: 0.sharing в поле "Value" пишем multi-writer.

Configuring Shared Disk in VMware Workstation

You can also create a vmdk disk and share it between two running virtual machines on VMware Workstation. You can use a shared vmdk disk in two or more VMs to test cluster scenarios. This mode only works in the Pro version and is available starting with VMware Workstation 12.

You can create a shared disk in VMware Workstation from the command prompt using the vmware-vdiskmanager.exe utility. Open cmd.exe as an administrator and run the commands:

Create a new 5 GB VMDK disk:

Creating disk ‘shareddisk01.vmdk’

Create: 100% done.

Virtual disk creation successful.

Now you need to add the vmdk file (disk) you created to the first virtual machine. Open the settings of the virtual machine to which you want to add the shared disk: Add > Hard Disk > SCSI disk type > Use an existing virtual disk > select file shareddisk01.vmdk.

In the Converting existing virtual disk to new format window, select Keep Existing Format.

Save your VM settings.

Now select the Hard Disk you added and click the Advanced button. Select the mode Independent > Persistent for the SCSI controller.

Save the VM settings disk. Do not turn on the virtual machine immediately. You need to manually edit the virtual machine configuration file (vmx). Run the command:

Add the following lines to the VMX configuration file:

Now add the shared VMDK file to the second virtual machine in the same way. Edit the VMX file of the second VM and add the same lines.

Start both VMs. When they run, a warning message will appear:

Clustering is not supported for VMware Workstation. This setting will be ignored.

Ignore this message. Now you can set up Windows Server Failover Cluster (WSFC) or Oracle RAC in your virtual machines running on VMware Workstation. The shared VMDK disk will be available in both VMs.

I enjoy technology and developing websites. Since 2012 I'm running a few of my own websites, and share useful content on gadgets, PC administration and website promotion.

Всем привет сегодня мне хочется рассказать, как работает Vmware ESXI на уровне дисковой подсистемы, с какими протоколами дружит. Рассмотрим архитектуру дисковой подсистемы, будет интересно. Хочу отметить, что производительность всей инфраструктуры, будет на 90 процентов зависеть именно от этого фактора, и правильное его понимание, будет служить залогом лучшего планирования и функционирования, советую выделить для своего обучения минут 15-20 и вы сможете потом избежать, большого количества всевозможных проблем.

Не так давно я писал статью о том что такое виртуализация и ее принцип работы VMware ESXI, советую ознакомится, там я в общих чертах рассказал как работает сам ESXi и посмотрели сравнения с физической инфраструктурой. Далее я хотел бы рассказать о каждой из его составляющих более подробно.

Что такое общий диск Multi-writer в VMware ESXI

Сейчас уже очень сложно себе представить серьезный сервис без отказоустойчивости, которая может быть реализована на разных уровнях работы инфраструктуры. Очень частым решением выступает отказоустойчивый кластер, который подразумевает использование разных серверов для одного сервиса. Выход из строя одного из серверов не влияет на работоспособность предоставляемых услуг клиентам. Очень часто в кластерах используются общие диски, для хранения баз данных (Microsoft SQL или Oracle), файловые ресурсов. Общие диски могут презентованы, как отдельные LUN с СХД, через ISCSI протокол, через общий диск или RDM в случае с виртуальными машинами.

В данной заметке я опишу реализацию с помощью общего диска для виртуальных машин VMware ESXI 6.5. В некоторых случаях (как правило, в сценариях кластеризации) может потребоваться совместное использование одного и того же диска между двумя (или более) виртуальными машинами. Наиболее оптимальным способом является использование диска vmdk, физически расположенного на общем хранилище или локально на хосте ESXi. Если вы хотите использовать общие диски на разных хостах ESXi, то вы можете использовать только разделяемое хранилище

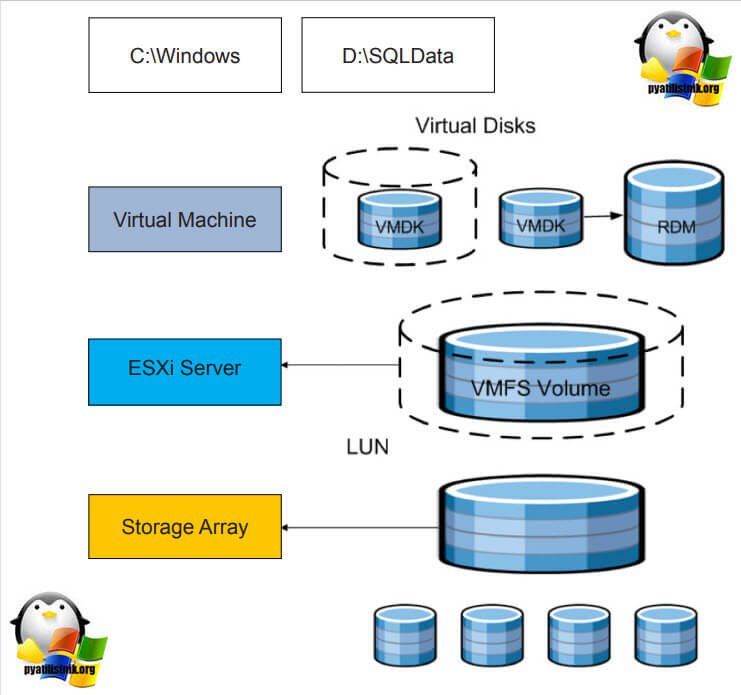

.На представленной ниже схеме вы видите:

- Storage Array, по сути это ваша система хранения данных, на которой реализован RAID массив, по рекомендации производителя.

- RAID массив порезан на LUN, это логически порезанное место на вашей системе хранения данных

- Далее LUN презентуется хостам VMware ESXI 6.5 и размечается файловой системой VMFS 6. Где из LUN получаются разделы (Datastore-Volume) для гипервизора.

- Далее на на Datastore уже разворачиваются виртуальные машины

Вот на таком общем VMFS Volume диске вы создаете общий VMDK диск, который будет доступен двум и более виртуальным машинам под чтение и запись. Сами виртуальные машины могут находится на разных физических хостах и разных географических локациях.Такой режим называется Multi-Writer VMDK, его часто применяют в построении кластеров MS SQL, Oracle RAC, такой режим работы диска применяется в технологии VMware Fault Tolerance.

Включение Multi-Writer VMDK через SSH

- Выключите виртуальную машину. , на котором расположена виртуальная машина.

- Перейдите к конфигурационному файлу виртуальной машины ( VM_name.vmx) (расположенному в /vmfs/volume/datastore_name/vm_name).

- Всегда рекомендуется создать резервный файл .VMX перед внесением изменений в файл конфигурации виртуальной машины. Вы можете создать резервную копию с помощью команды ( CP VM_name.vmx VM_name.VMX.bak )

- Откройте и отредактируйте исходный .vmx-файл с помощью текстового редактора, такого как редактор VI. Введите «i», чтобы начать вносить изменения.

- Добавьте эту запись в конец .vmx-файла: SCSI0: 1.sharing = "multi-writer", для каждого диска отдельная запись

- Закройте и сохраните файл .vmx, используя (: wq)

В некоторых случаях (как правило, в кластерных сценариях) может возникнуть необходимость совместного использования одного и того же диска двумя (и более) виртуальными машинами. Самый оптимальный способ — использовать диск vmdk, физически расположенный на общем хранилище или локальном диске хоста ESXi (если хост один). Если вы хотите презентовать общий диск виртуальным машинам, запущенным на разных хостах ESXi, вы можете использовать только общее хранилище (VMFS datastore).

Предположим, у нас уже имеется некоторое общее внешнее хранилище (подключенное к каждому узлу ESXi с использованием iSCSI или Fibre Channel SAN), доступное всем хостам VMWare ESXi, с виртуальными машинами, которым нужно предоставить доступ к общему диску. Допустим, у нас всего 2 таких ВМ.

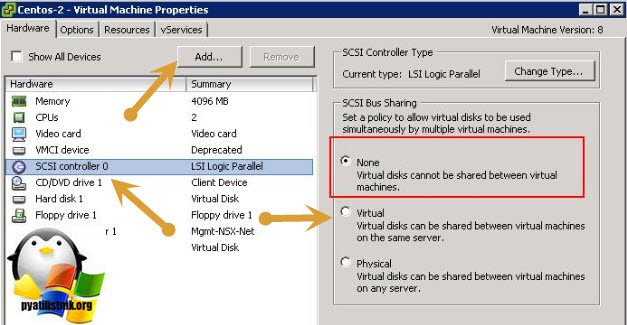

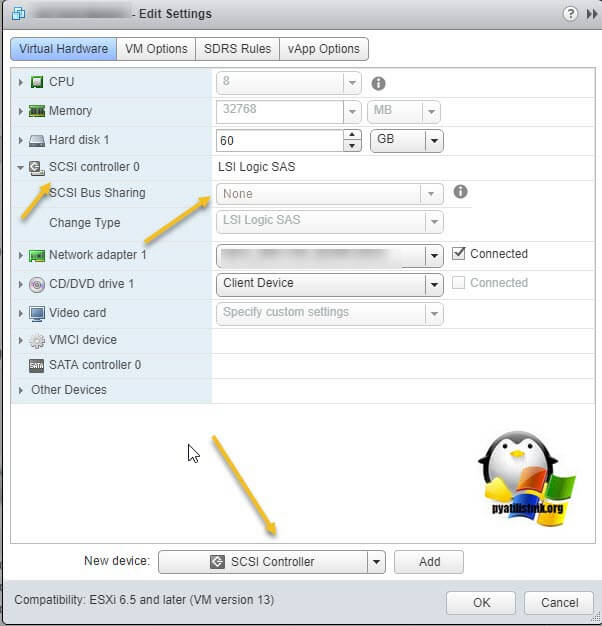

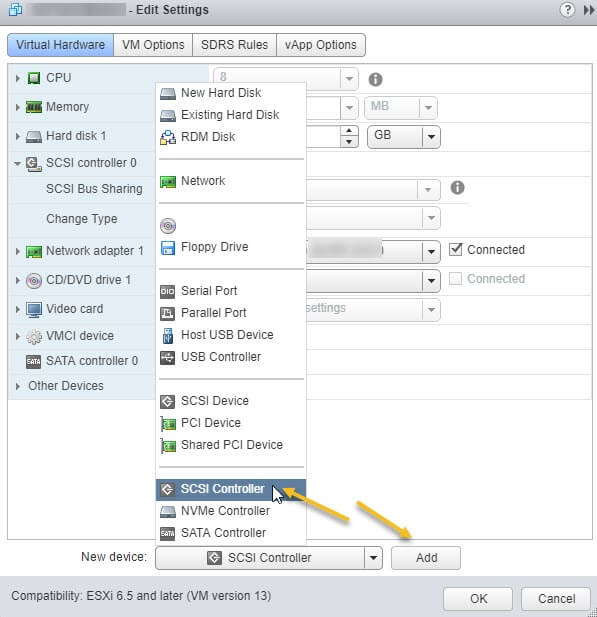

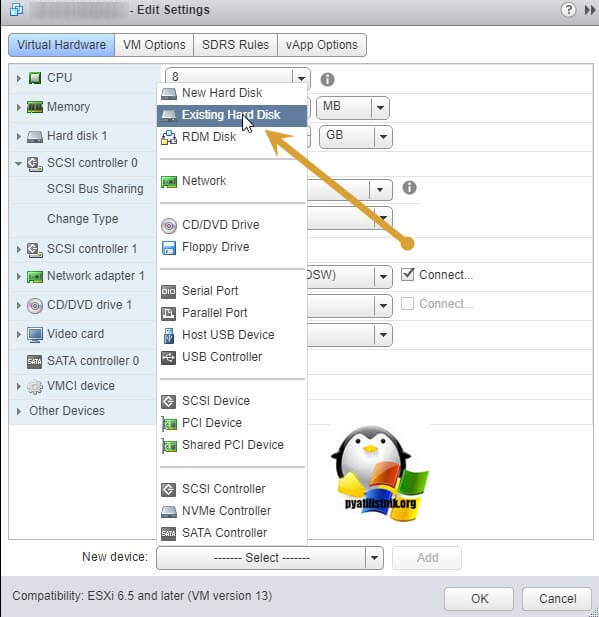

На обеих ВМ нужно добавить новый SCSI контроллер. Для этого, откройте клиент vSphere, выберите первую ВМ machine (Node 1) и откройте ее настройки (Edit Settings).

Чтобы добавить новое устройств, в выпадающем списке внизу окна выберите SCSI controller и нажмите кнопку Add.

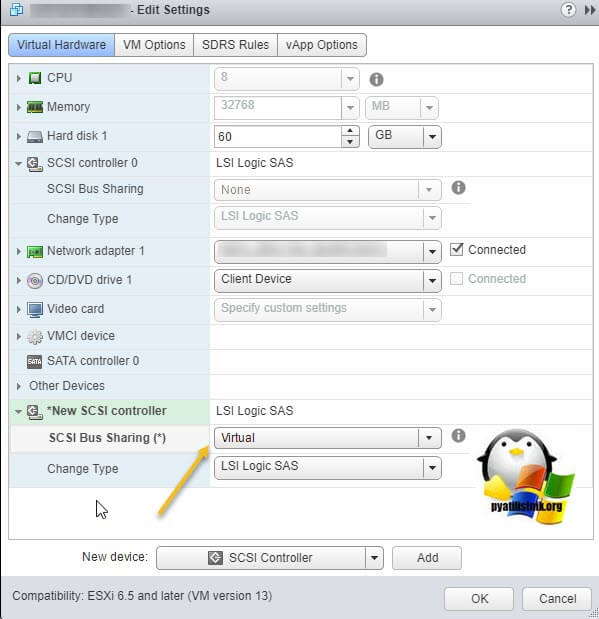

В качестве типа контролера SCSI выберите LSI Logic SAS.

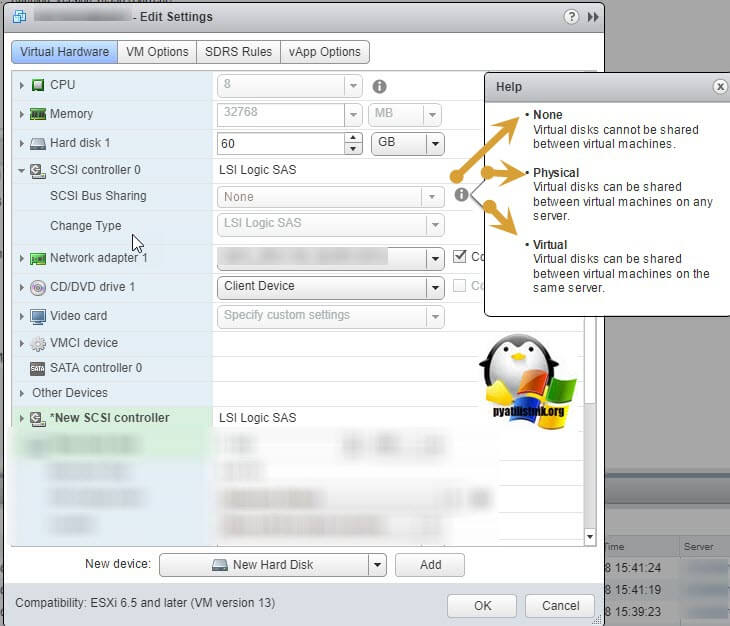

Выберите нужный режим общего доступа к шине SCSI (SCSI Bus sharing mode):

- Virtual — виртуальный диск предоставляется нескольким ВМ на одном хосте ESXi

- Physical – общий доступ к vmdk файлу с нескольких ВМ на разных хостах ESXi

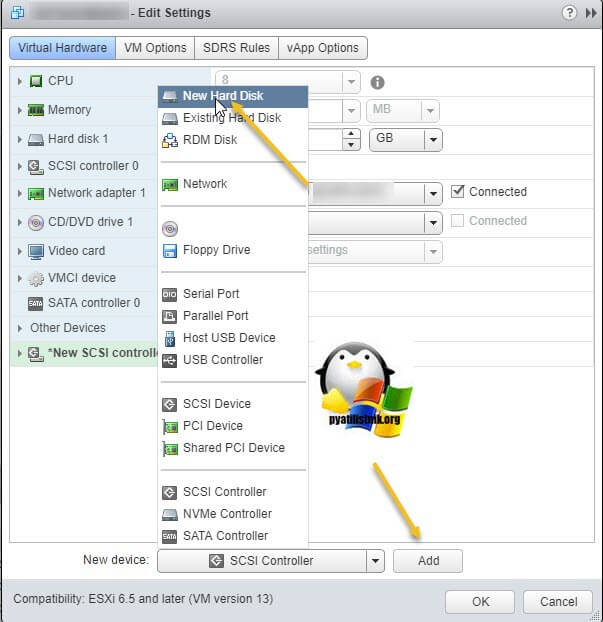

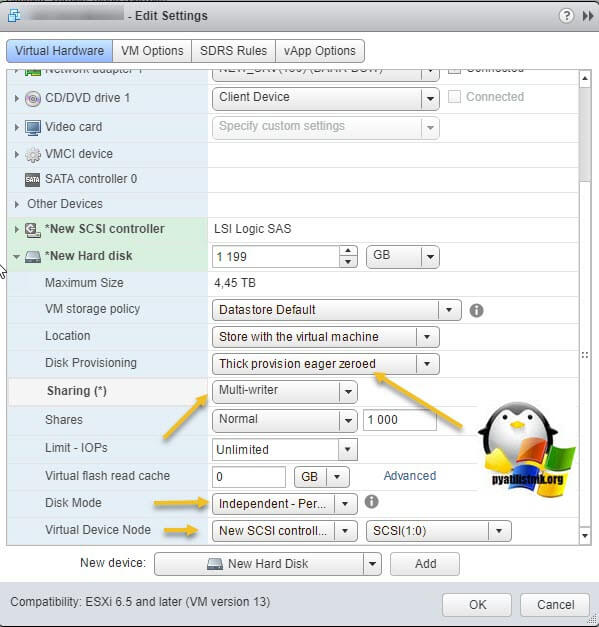

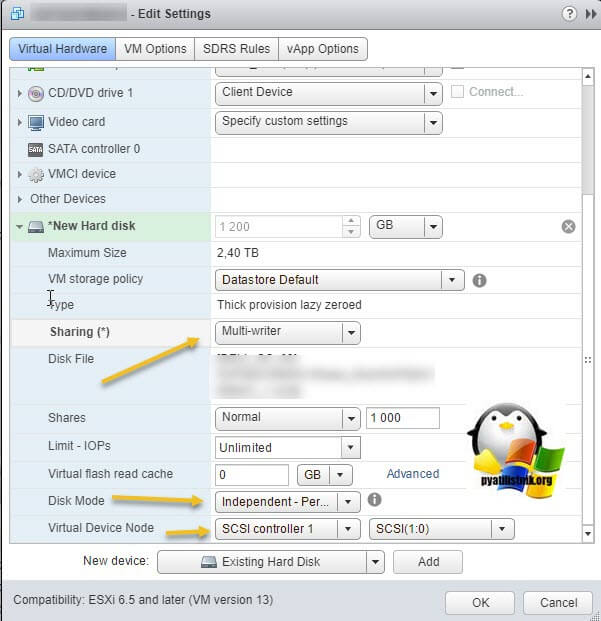

Нажмите OK. Затем на первой ВМ нужно добавить новый виртуальный диск (New Device -> New Hard Disk -> Add) со следующими настройками:

- VM Storage Policy: по желанию

- Location: укажите имя общего хранилища, на котором будет находится общий виртуальный диск

- Disk Provisioning: выберите Thick provision eager zeroed (другие типы дисков использовать не получится)

- Sharing: Multi-writer

- Virtual Device Node: выберите созданный ранее виртуальный SCSI контроллер

- Disk mode: выберите режим Independant – Persistdent. В этом режиме нельзя создать снапшот общего виртуального диска

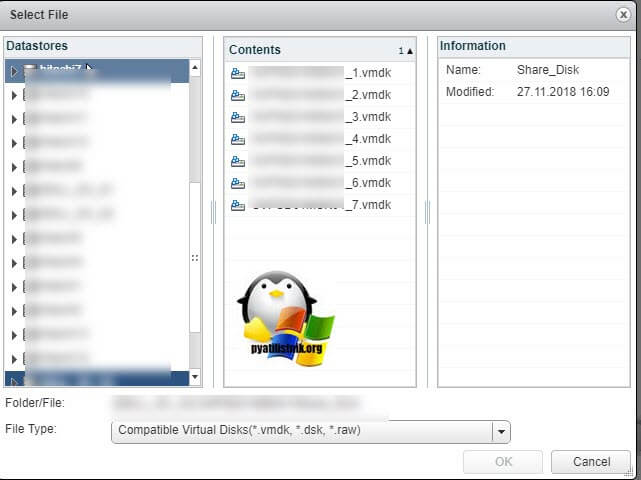

Аналогичным образом нужно добавить новый SCSI контроллер и на второй виртуальной машине (Node 2). После это в настройках второй ВМ нужно добавить существующий виртуальный диск (Existing Hard Disk).

В появившемся окне выберите хранилище, на котором ранее вы разместили общий диск. Выберите каталог с именем первой ВМ, а затем – нужный vmdk файл.

В том случае, если вам потребуется использовать несколько общих дисков, имейте в виду, что один SCSI контроллер поддерживает до 16 дисков. Если дисков больше (что вряд ли), нужно будет создать дополнительный SCSI контроллер.

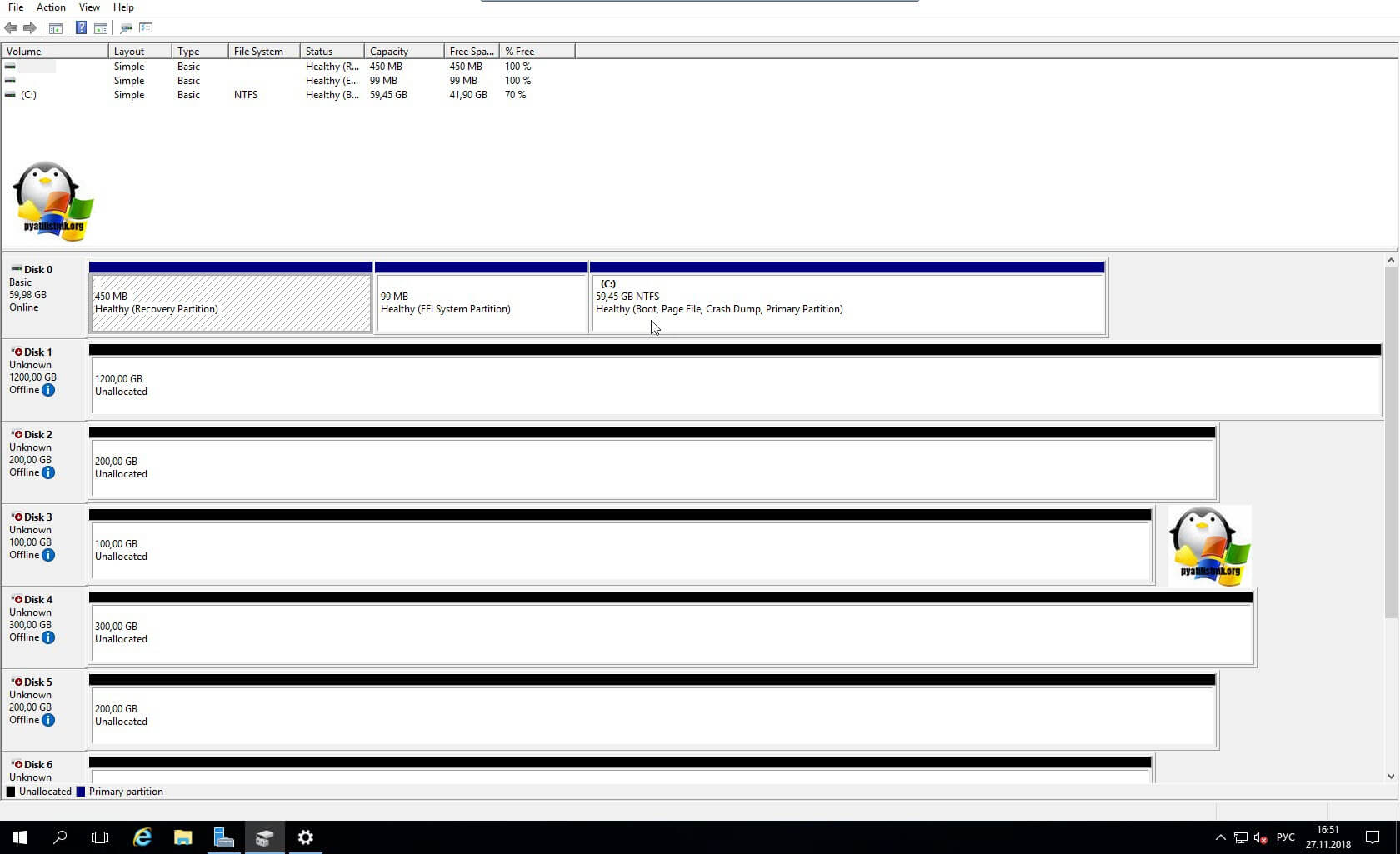

После того, как вы настроили виртуальные машины, подключитесь к гостевой ОС. В нашем случае это Windows. Откройте оснастку управления компьютером (Computer Management) и перейдите в раздел Storage -> Disk Management . Щелкните ПКМ по нему и выберите Rescan Disk.

Система определит новый диск и предложит инициализировать его. Выберите нужный стиль таблицы разделов (MBR или GPT), создайте на новом диске раздел и отформатируйте его. Аналогичные операции выполните на второй ВМ. После этого, обе ВМ смогут совместно использовать один общий виртуальный vmdk диск.

Delphi site: daily Delphi-news, documentation, articles, review, interview, computer humor.

Виртуальный контроллер SCSI тоже бывает разных типов, и для него доступны кое-какие настройки. Сначала про типы. Если вы зайдете в свойства ВМ и на закладке Hardware выделите SCSI-контроллер, в верхней правой части окна будет кнопка Change Type (рис. 5.12).

Рис. 5.12. Смена типа виртуального SCSI-контроллера Типов всего четыре:

- BusLogic Parallel - этот виртуальный дисковый контроллер работает наименее эффективным способом, с большими, чем другие, накладными расходами. Однако для него есть драйверы для большого количества операционных систем;

- LSI Logic Parallel - работает с меньшими накладными расходами, чем Bus-Logic;

- LSI Logic SAS - новая версия LSI Logic. Отличается тем, что поддерживает стандарт SCSI 3. Используется для ВМ, которым необходима поддержка этого стандарта. Главным образом для виртуальных машин - узлов кластера Microsoft Failover Cluster;

- VMware Paravirtual SCSI (PVSCSI) - самая современная версия виртуального дискового контроллера. Обеспечивает наибольшую производительность и наименьшие накладные расходы. Однако не работает VMware Fault Tolerance для ВМ с этим контроллером, и список ОС, для которых есть драйверы, невелик:

• Windows Server 2008 (включая R2);

• Windows Server 2003;

• Red Hat Enterprise Linux (RHEL) 5.

Напомню, что «паравиртуализованный» виртуальный контроллер означает, что при его работе задействуются мощности контроллера физического напрямую, без какой-то эмуляции или перехвата со стороны гипервизора. Именно в этом кроется повышение эффективности паравиртуализованных дисковых и сетевых контроллеров.

Резюме. Если позволяют условия, используйте контроллер типа VMware Paravirtual. Если он не поддерживается гостевой ОС, используйте LSI Logic Parallel. Если и он не поддерживается, используйте BusLogic. Для ВМ-узлов MFC используйте LSI Logic SAS.

Пример - установка в ВМ Windows 2008. У этой ОС нет стандартных драйверов для PVSCSI, однако есть для контроллера LSI. Но на ESX(i) (начиная с Update 1) есть образ FDD с драйверами для PVSCSI. И теперь у вас есть несколько вариантов того, как поступить с типом контроллера:

- вариант 1. Тип контроллера поставить PVSCSI, подключить к ВМ образ flp с драйвером для него и в начале установки подложить эти драйверы. После окончания установки оставить этот тип контроллера.

Вариант хорош простотой. В данном случае его можно назвать оптимальным;

- вариант 2. Тип контроллера поставить LSI Logic. После установки ОС добавить в систему второй контроллер, типа PVSCSI, включить ВМ. Windows активирует драйверы для PVSCSI. Выключить ВМ, удалить второй контроллер (PVSCSI), тип первого поменять с LSI Logic на PVSCSI. Вариант не очень удобен большим количеством шагов, зато нет нужды в подкладывании драйверов;

- наконец, драйверы можно интегрировать в дистрибутив - но их необходимо где-то взять. Например, из упомянутого образа FDD. Как вариант - из iso с VMware tools.

Образы дискет с драйверами для PVSCSI (Windows 2003/2008) и Bus Logic (Windows XP) доступны в каталоге vmimages. Зайдите в свойства ВМ, выделите Floppy Drive ^ Use existing floppy image in datastore ^ каталог vmimages\ floppies.

Еще у виртуального SCSI-контроллера есть настройка «Bus sharing» - совместный доступ к SCSI-шине. Она нужна в ситуациях, когда вы хотите дать одновременный доступ к одним и тем же виртуальным дискам нескольким ВМ. Обычно это необходимо для построения кластеров, таких как MSCS/MFC. Варианты этой настройки:

- None - совместного доступа нет. Значение настройки по умолчанию;

- Virtual - к виртуальным дискам, висящим на этом контроллере, возможен доступ с других ВМ на этом же сервере. Настройка, нужная для организации cluster-in-a-box;

- Physical - к виртуальным дискам, висящим на этом контроллере, возможен доступ с других ВМ, в том числе с других серверов. Настройка, нужная для организации cluster-across-boxes и physical-to-virtual.

Добавление контроллера. Если вы нажмете кнопку Add на закладке Hardware в свойствах ВМ, вы увидите список виртуальных компонентов, которые в ВМ можно добавить. Однако среди них нет SCSI-контроллера. Если вам надо добавить SCSI-контроллер, то делается это так.

Все-таки идем в мастер добавления виртуального оборудования Edit Settings ^ Hardware ^ Add. Но добавляем Hard Drive.

Проходим по мастеру создания жесткого диска. О подробностях - чуть ниже, сейчас нас интересует пункт «SCSI node». У каждого виртуального диска есть адрес вида «SCSI X:Y». Последняя цифра адреса - это номер диска на SCSI-шине, SCSI id. А первая цифра - номер контроллера. Таким образом, первый, дефолтный диск ВМ создается по адресу SCSI 0:0, то есть это первый диск на первом контроллере. Если для второго диска вы выберете адрес SCSI 1:0, то кроме диска у вас добавится и второй контроллер. Если для третьего диска выбрать SCSI 2:0, то добавится третий контроллер. Всего до четырех.

Добавлять несколько контроллеров вам придется преимущественно для ВМ -узлов Microsoft Cluster Services или Microsoft Failover Cluster. Для этих решений требуется, чтобы загрузочный диск и диски с данными висели на разных контроллерах.

VMware Multi-Writer Mode for Shared VMDK

VMware VMFS is a clustered file system shared between multiple ESXi hosts. By default, VMFS, NFS datastores, vSAN are not allowing multiple virtual machines to access the same .vmdk file simultaneously (locks are used). This prevents VMs from accessing other virtual machines’ disks and avoid data corruption or loss. However, there is a VMware technology that allows sharing of VMFS-backed disks between several VMs. This feature is called Multi-writer VMDK. The Multi-Writer option ensures that a guest host clustering application (such as Oracle RAC or Microsoft MSCS) doesn’t cause data loss when accessing from two or more virtual machines (cluster nodes).

Hint. Multi-writer is also used for VMWare Fault Tolerance when primary and standby virtual machines access a shared vmdk file simultaneously.

Virtual disks, which must be available simultaneously in several VMWare virtual machines, use the Multi-writer technology (available starting from VMware ESXI 5.5 and newer). In most cases, this shared disk operation mode is used in cluster solutions for Oracle RAC and Microsoft MSCS (Microsoft Cluster Service) clusters.

The main restrictions of shared VMWare disks in Multi-Writer mode:

-

You won’t be able to perform the online migration of running VMs with shared disk to another host (vMotion), or datastore (Storage vMotion). You can migrate between ESXi hosts only powered off virtual.

Hint. vMotion is only supported for Oracle RAC cluster with up to 8 ESXi hosts;

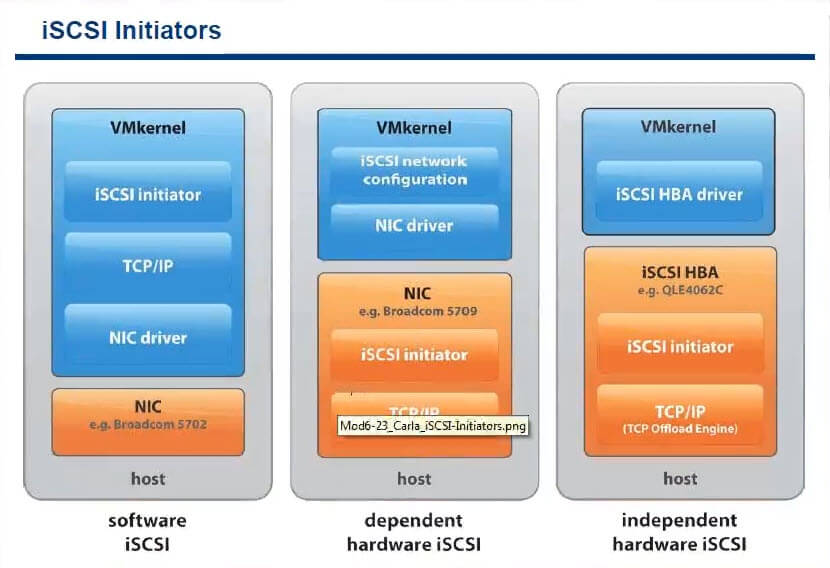

Виды ISCSI initiators

- Софтовые идут в комплекте ESXI или Windows например

- Физические зависимые > тут инкапсуляция и обработка трафика делается карточкой, но все равно используется процессор

- Физические не зависимые > тут весь ISCSI трафик обрабатывается за счет мощностей железки, тем самым снимая нагрузку с CPU.

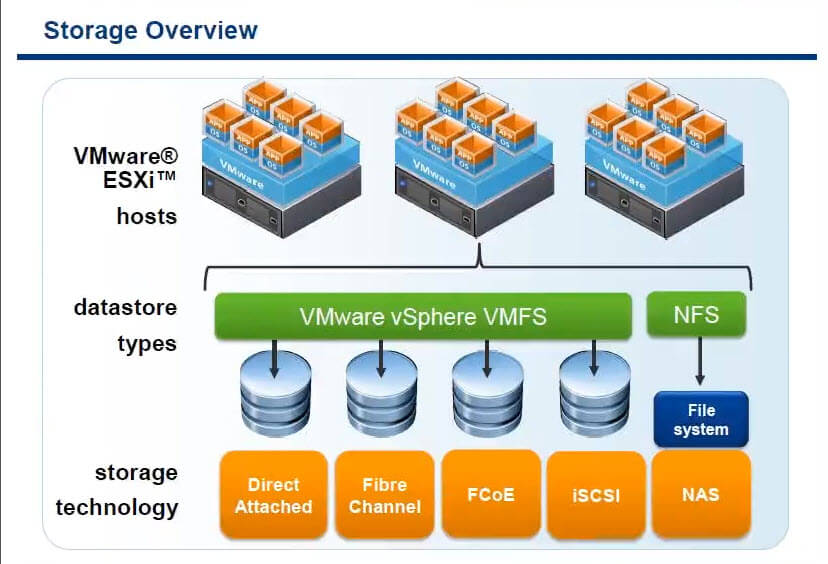

Storage архитектура

На скриншоте снизу представлена схема работы ESXI с дисками. Есть хосты виртуализации, к ним по протоколам

- NAS > подключение NFS по сети

- ISCSI > тоже по ethernet сети

- FCoE

- FC > оптика

- Direct Attached (DAS)

Далее эти дисковые ресурсы, видятся в гипервизоре как LUN разделы, которые подключаются и форматируются в VMFS файловую систему.

Как подключить общий диск в VMware ESXI 6.5 и выше

Поэтому нам первым делом необходимо в свойствах виртуальной машины добавить новый SCSI Controller.

Если посмотреть подсказку у LSI Logic SAS контроллера, то вы увидите три его режима:

- None - для работы с не кластерными Multi-Writer дисками

- Physical - виртуальные диски могут быть общими для виртуальной машины и физическим сервером

- Virtual - для работы с общим диском для нескольких виртуальных машин

Хочу отметить, что к одному LSI Logic SAS контроллеру можно одновременно подключить до 16 виртуальных дисков

Делается это через пункт "New Device" и нажатии кнопки Add, для SCSI Controller.

Далее у нового, добавленного контроллера вы в пункте "SCSI Bus Sharing" выберите тип "Virtual". Можете сохранить конфигурацию виртуальной машины, через нажатие кнопки "Ок"

Далее на первой машине, где мы только что добавили новый контроллер, вам нужно создать новый виртуальный диск, делается это так же, через пункт "New Device"

Откройте параметры нового виртуального диска. Для того, чтобы сделать его общим между виртуальными машинами VMware ESXI, вам необходимо выставить соответствующие настройки:

- Disk Provisioning - Делает толстый диск с занулением "Thick provision Eager zeroed thick disks", нужен для кластеризации, о типах дисков ESXI, читайте по ссылке.

- Sharing - тут вы как раз выбираете режим общего диска "Multi-Writer"

- Disk Mode - режим работы диска выставите "Independent Persistent" (Подробнее про режимы работы ESXI дисков), данный режим работы не позволит использовать vStorage APIs, что не даст создавать на таком диске снапшоты. Данный режим рекомендуется самим вендором VMware и его партнерами, такими как Oracle. Если бы мы разрешили создание снимков на этом диске, то это могло бы привести к потере данных. Так если у вас на этом диске быдет база SQL и вы будите использовать Veeam Backup, то у ваших резервных копий на уровне самого SQL могут быть проблемы при восстановлении из них, так как точка отсчета с которой нужно будет выстраивать цепочку бэкпов будет нарушена Veeam, который сдвинет точку бэкапа на себя. Если выставлен Independent Persistent, то в Veeam при создании бэкапа этой виртуальной машин можно исключить нужные диске, где стоят SQL или Oracle.

- Virtual Device Node - выберите наш новый LSI Logic SAS контроллер, работающий в режиме "SCSI Bus Sharing Virtual"

Данное действие не обязательное, вы его можете пропустить и просто сохранить настройки, после чего переходить к настройке второй виртуалки, об этом чуть ниже

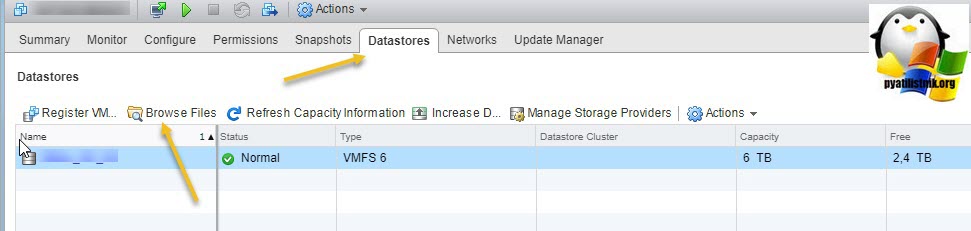

Далее я иду на датастор на котором находится виртуальная машина с общими дисками (Datastore - Browse Files).

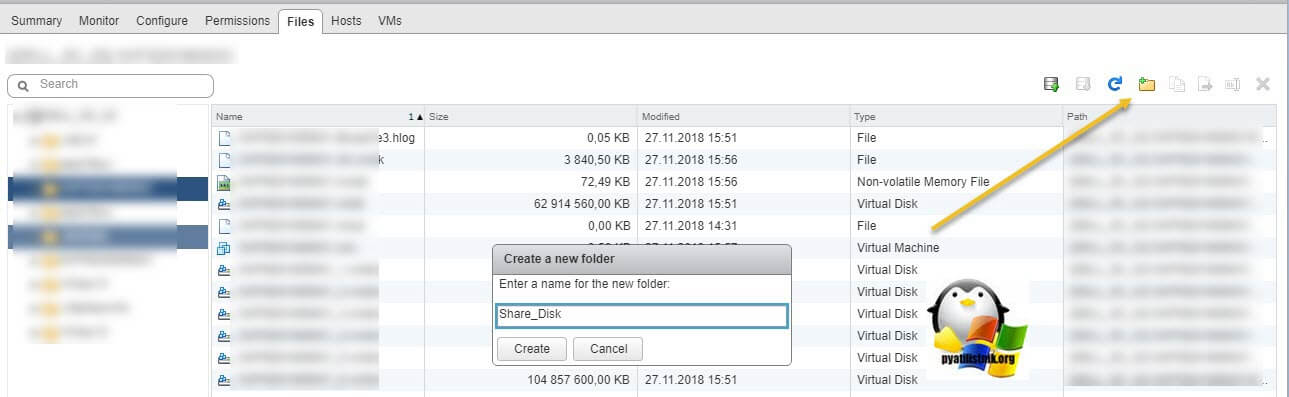

Нахожу нужные мне Multi-Writer диски. Создаю новую папку

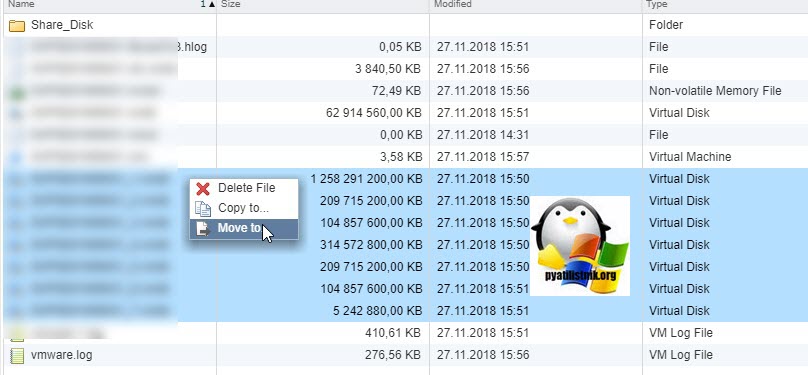

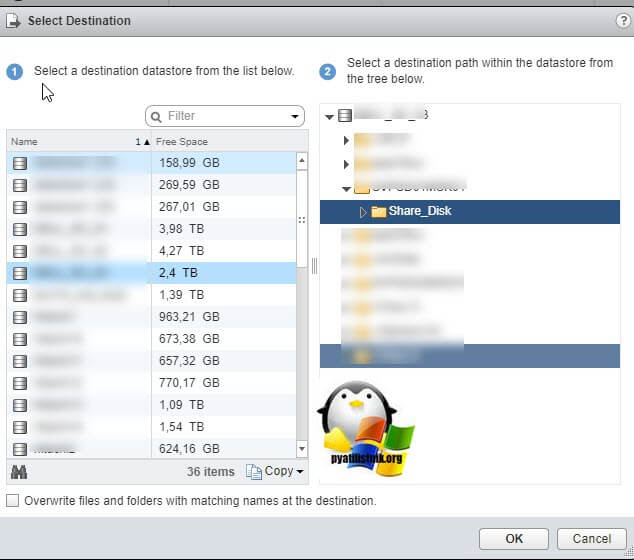

И перемещаю в новую папку общие диски, хочу отметить, что вы их можете переместить на любой общий между хостами ESXI датастор.

Я делаю "Move to" на тот же латасторе, но в новую папку. Этим я добьюсь, что буду видеть явным образом общие кластерные диски.

Так как я диски до этого удалил, для удобства, то мне их нужно заново добавить. Если вы до этого не удаляли, то сделайте эти действия только для второй виртуальной машины. Открываем настройки виртуальной машины и нажимаем добавить новое устройство, выбираем пункт "Existing Hard Disk", это у нас выбор существующего общего кластерного диска.

Указываем на каком датасторе у нас лежит Multi-Writer диск и выбираем нужный VMDK, в моем случае их семь.

Выставляем нужные параметры:

- Disk Provisioning - "Thick provision Eager zeroed thick disks"

- Sharing - "Multi-Writer"

- Disk Mode - "Independent Persistent"

- Virtual Device Node - выберите наш новый LSI Logic SAS контроллер, работающий в режиме "SCSI Bus Sharing Virtual"

Если такой диск не один, то добавляем все за один раз для экономии времени. Проделываем такое добавление общих дисков на всех виртуальных машинах, где планируется использовать Multi-Writer.

Далее уже в операционной системе Windows Server, зайдя в оснастку "Управление дисками" вы обнаружите ваши диски. Остается их только разметить в GPT формат и отдать под кластер.

ISCSI компоненты

И так ранее я рассказывал как подключить iscsi диск к VMware ESXI 5.5, ознакомьтесь кто хочет попрактиковаться, мы же рассмотрим как это работает. И так есть сервер на котором установлена, не важно какая операционная система, она предоставляет нарезанные луны, нарезанные на физических дисках. У данного сервера есть такой параметр (адрес) ISCSI target, цель к которой мы будем подключаться. Далее по обычной ethernet сети, по TCP/IP, хост с гипервизором, подключается к ISCSI targe, за счет ISCSI Initiators (софтового или железного о них ниже). В итоге хост получает нужные ему lun, форматирует их и все.

Sharing a VMDK Disk Between Two Virtual Machines on ESXi Hosts

Suppose the shared external storage (connected to each ESXi host using iSCSI or Fiber Channel SAN) has already been presented to all VMWare ESXi 6.5 hosts. These hosts running the two VMs (node1 and node2) you want to add a shared virtual disk. On both virtual machines, you need to add a new SCSI controller.

In the vSphere Client inventory select the first virtual machine (Node 1), and select Actions > Edit Settings.

To add a new virtual device select Add New Device > SCSI controller in the dropdown list, and press the Add button.

Select LSI Logic SAS as a type of SCSI controller. Be sure to create a new SCSI controller, don’t use a default SCSI 0 controller.

Now you need to choose the SCSI Bus sharing mode:

- Virtual — if you want to share a virtual disk between VMs on the same ESXi host;

- Physical — used when you need to share vmdk file between VMs on different ESXi hosts (if you have multiple ESXi hosts in VMWare vSphere cluster then you must use this bus sharing mode).

Hint. None mode is used only for non-clustering Multi-writer drives.

Press OK. Next, you need to add a new virtual disk on the first VM (Add New Device > Hard Disk > Add) with the following disk settings:

- VM Storage Policy: optional;

- Location: you need to select a shared datastore name that will store the vmdk file;

- Disk Provisioning: select Thick provision eager zeroed (shared virtual disk cannot be zeroed thick or thin provisioned. You can use other disk provisioned types if your shared vmdk file is located on the vSAN 6.7 Patch 01 datastore).

Note. You can convert thick provision lazy zeroed disk to thin; - Sharing: Multi-writer;

- Virtual Device Node: select the SCSI controller created earlier;

- Disk mode: Independent – Persistent – in this mode, you can’t create snapshots for a virtual drive you want to share.

Hint. If you enabled VMWare Fault Tolerance protection for a virtual machine, the multi-write VMDK mode is enabled automatically for virtual disks.

In the same way, you need to add a new SCSI controller to another virtual machine (Node 2). Then you need to add a new disk (Existing Hard Disk) in the settings of the second virtual machine.

Select the VMFS Datastore, which stores the shared vmdk file that you created earlier for the first VM. Select the name of the first virtual machine, and in the middle pane select the desired vmdk file.

Also, you need to select the Sharing mode — Multi-Writer for this disk.

If you want to use more than one shared disk on VMware, keep in mind that each of them doesn’t require the additional SCSI controller. You can connect up to 16 different drives for a single SCSI controller.

Make sure you use the same SCSI device address for a shared vmdk disk on both virtual machines. Therefore, if you added SCSI Controller 1 when creating a SCSI controller, you should select it. For example, if you have a new address SCSI(1:0) on VM (node1) for a new disk (this means the first disk on the second SCSI controller), you should use the same address SCSI(1:0) for the shared disk on the second VM (node2). It is important!

Note. In ESXi versions, before ESXi vSphere 6.0 update 1, the MultiWriter mode for vmdk is also supported, but you cannot enable it from the vSphere Web Client interface. You can add a multi-writer flag by shutting down the VM and manually editing the vmx file of the virtual machine, adding the following line at the end of the file:

You can also add this parameter in the VM properties: Options > General > Configuration Parameters: Scsi1:0:sharing “multi-writer”.

After changing the virtual machine’s settings, connect to the console of the guest OS virtual machine. In this case, the VMs running Windows Server, so you can remotely connect to them using RDP (how to enable RDP remotely). Run the Computer Management console (compmgmt.msc), and expand Storage > Disk Management section. Right-click and select Rescan Disk.

The system detects the new disk and offers to initialize it. Select the desired partition table (MBR or GPT), create a new partition, and format it. Similar operations must be performed on the second VM. After these settings, both VMs are using a shared disk. Now you can proceed to set up a cluster solution based on Oracle RAC and Microsoft Cluster Services (MSCS).

Note. Keep in mind that using multi-writer VMDKs for non-clustered scenarios is not supported. If the shared VMDK disk is online on both ESXi hosts, you won’t see changes made to the disk by one virtual machine in the other virtual machine. This will happen until you bring the disk offline and then bring it online.

When trying to migrate a VM with a connected vmdk disk in MultiWriter mode, an error will appear:

Virtual machine is configured to use a device that prevents the operation: Device ‘SCSI controller X’ is an SCSI controller engaged in bus-sharing.

To resolve this issue turn off the VM, and perform cold vMotion.

In a similar way, you can provide simultaneous access from different VMs to the same raw LUN via Raw Device Mapping (RDM) mode. In this case, the RDM disk is being added to node1 as usual, and when adding a disk to node2 instead of selecting the LUN number, you need to select the mapping VMDK file for the RDM disk on the VMFS Datastore.

Starting from vSphere 6.7 Update 1 you can share a single virtual disk in multi-writer mode on more than 8 hosts simultaneously. This behavior is supported for VMFS5/VMFS6 datastores as well after you enabled the /VMFS3/GBLAllowMW config option.

Читайте также: