Расширение дисплеев с помощью surround что это

Мы уже писали о том, что в сентябре нынешнего года компания AMD объявила о реорганизации и создании выделенного подразделения Radeon Technologies Group (RTG), которое сфокусировано на графических решениях, а также сегментах виртуальной и дополненной реальности. Во главе этой группы стоит Раджа Кодури (Raja Koduri) — вице-президент и главный графический инженер компании.

Идея выделения «графической группы» в отдельное подразделение AMD должна способствовать оптимизации внутренних процессов компании и акценте RTG на графических решениях, дела с которыми у компании в последнее время идут хоть и не идеально, но явно лучше, чем у процессорного подразделения.

Мы ждали какой-то активности и анонсов от нового подразделения компании, занимающегося вопросами разработки графических процессоров, и вот, 8 декабря они анонсировали несколько новых технологий и улучшений, связанных с выводом изображения на экран. Хотя ничего эксклюзивного и уникального пока что не было представлено, но многие дисплейные технологии компании получили важные и полезные улучшения.

К примеру, была объявлена поддержка планируемых к выходу дисплеев, предназначенных для вывода HDR-изображений, анонсированы некоторые нововведения в технологии динамической частоты обновления FreeSync, также было объявлено и о поддержке разъемов HDMI 2.0a и DisplayPort 1.3 следующим поколением графических процессоров компании AMD.

Поддержка HDR-дисплеев с расширенным динамическим диапазоном

Потребители нуждаются во все более качественном выводе изображения, и для его обеспечения уже сейчас используется довольно большое количество пикселей, особенно если речь идет об устройствах виртуальной реальности и 4K-дисплеях. Но для получения по-настоящему качественной картинки нужно не только большое количество пикселей, но и повышение их качества: вывод изображений в широком цветовом охвате с увеличенной контрастностью и максимальной яркостью.

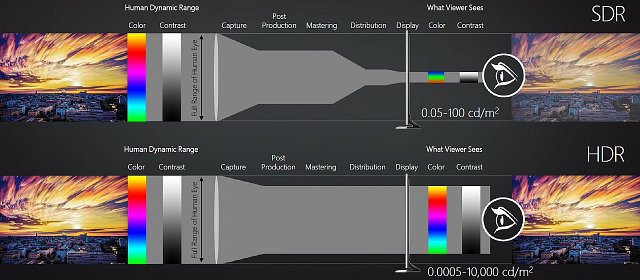

На современных дисплеях человек видит лишь малую часть того, что он может наблюдать своими глазами в окружающем мире. Иначе говоря, диапазон воспринимаемых нашим глазом яркостей и цветов куда больше того, что дают нам нынешние устройства вывода визуальной информации. Возьмем, к примеру, относительную яркость (интенсивность свечения), которая измеряется в канделах на м² (также единица измерения известна как нит, 1 нт = 1 кд/м²).

Для солнечного света этот показатель равен 1 600 000 000 нт, яркие блики на изображениях могут иметь яркость в десятки и сотни тысяч нит, зато детали в тенях — менее 1 нт. Этот диапазон очень широк, хотя относительная яркость для большинства привычных объектов составляет от 1 до 250 нт, и современные мониторы способны как раз отобразить от 0,1 нт до 250 нт максимум, а лучшие из обычных телевизоров — до 400 нт.

Для того чтобы хоть немного приблизиться к возможностям человеческого зрения, был введен новый индустриальный стандарт для телевизоров — HDR UHDTV, обеспечивающий диапазон яркости от 0,005 до 10 000 нт. Внедрение High Dynamic Range во все стадии конвейера обработки изображения — то, чего ждут многие энтузиасты качественного изображения.

Первые HDR-устройства имеют яркость до 600-1200 кд/м², а в будущем ЖК-мониторы с поддержкой High Dynamic Range (HDR) и локальной подсветкой смогут обеспечить до 2000 нт, а OLED-дисплеи — до 1000 нт максимум, но при идеальном черном цвете и большей контрастности, чем ЖК-дисплеи.

Первые подобные HDR-дисплеи ожидаются во второй половине 2016 года, ближе к его концу, а некоторые телевизоры с расширенным диапазоном уже доступны на рынке. Пусть они пока и далеки от идеальных показателей, но OLED обеспечит черный цвет, а LCD с локальной подсветкой способны на огромную яркость, и оба типа экранов подходят в том числе для игр, обеспечивая лучшие показатели по яркости, контрастности и цвету, приближающиеся к возможностям нашего зрения.

К слову о цвете: также пользователям нужен и расширенный цветовой диапазон, ведь наиболее распространенное сейчас цветовое пространство sRGB тоже довольно сильно отстает от возможностей зрения человека. И даже расширенное цветовое пространство AdobeRGB не дает всех возможных цветовых оттенков, как и стандарт, принятый для цифровых кинофильмов — P3.

Нынешний контент почти весь создан в рамках стандартов BT.709, sRGB, SMPTE 1886 (Gamma 2.4), а новый стандарт HDR-10, Rec.2020 (BT.2020), SMPTE 2084 способен обеспечить отображение более миллиарда цветов при 10 битах на компонент цвета, что весьма серьезно приближает качество цветопередачи к возможностям человеческого организма по распознаванию цветовых оттенков.

Для обеспечения высокого качества изображения нужны также и новые методы кодирования цветов, поскольку текущие методы были спроектированы в соответствии с устаревшими рекомендациями прошлого века с учетом исключительно ЭЛТ-устройств: они предполагают максимальную светимость в 100 нт, нерационально расходуют информацию в кодированном сигнале и плохо сохраняют данные в тенях.

Для современного контента разработаны новые стандарты: 10-битный и 12-битный ST 2084. Они учитывают возможности современных ЖК-дисплеев, могут закодировать световую интенсивность от 0 до 10 000 нт, значительно улучшают качество и эффективность кодирования данных в тенях, а 12-битный вариант и вовсе превосходит возможности человеческого зрения.

Но не нужно путать обсуждаемую тему HDR-возможностей устройств отображения с тем, что давно появилось в играх и называется HDR-рендерингом. Действительно, многие современные игровые движки используют рендеринг с расширенным динамическим диапазоном, чтобы сохранить данные в тенях и светах — но делается это исключительно до вывода информации на дисплей. А далее изображение в любом случае будет приводиться обратно к обычному динамическому диапазону, чтобы можно было вывести его на SDR-монитор.

Для того чтобы сохранить максимум цветов и светимости, используются специальные алгоритмы тонального отображения (tone mapping) — преобразования тональных значений из широкого диапазона в узкий. И с учетом новых HDR-устройств нужны как улучшенные алгоритмы tone mapping, так и ориентация их уже на HDR-, а не на SDR-дисплеи. Инженеры AMD как раз и предлагают более эффективный и высокопроизводительный алгоритм tone mapping, предназначенный для видеокарт серии Radeon.

В результате работы нового алгоритма при подключении HDR-дисплея вместо тусклых цветов и малого диапазона яркостей на монитор будет выведено куда более яркое и близкое к реальности изображение. Мы уже видели HDR-рендеринг с выводом на HDR-телевизор в работе, и его результат выглядит весьма впечатляюще, особенно при сравнении с изображением на обычным мониторе, стоящем рядом. Так что стандартизацию и появление HDR-телевизоров и мониторов можно назвать одной из небольших революций, которая должна произойти довольно скоро.

В данный момент компания AMD усиленно работает для того, чтобы обеспечить поддержку HDR-дисплеев в своих видеокартах серий Radeon 300 и будущих продуктах, которые появятся в 2016 году и будут готовы к появлению массовых HDR-телевизоров и мониторов в конце года.

Собственно, в определенной мере даже нынешние видеокарты Radeon уже готовы к работе с такими мониторами. Серия Radeon 300 обеспечивает работу мониторов в разрешении 1920×1080 при 120 Гц и 10 бит на цвет, в разрешении 2560×1440 при 60 Гц и 10 бит, а также в 4K-разрешении, но уже лишь при 30 Гц. Будущие же видеокарты в максимальном разрешении обеспечат частоту обновления в 60 Гц, в чем им поможет поддержка новых портов вывода: HDMI 2.0a и DisplayPort 1.3.

Сейчас AMD старается в будущем году обеспечить поддержку HDR-дисплеев рабочими станциями и игровыми ПК, ведь те же кинофильмы уже могут получить преимущество от такого вывода, так как Голливуд давно использует стандарты, превышающие бытовые. А вот для того, чтобы получить HDR-изображение в тех же игровых приложениях, будет необходимо переделывать не только графическую часть игрового движка, но и часть контента: например, текстуры должны также храниться в форматах, позволяющих использовать широкий цветовой и яркостный охват. Так что компания AMD работает с игровыми разработчиками для того, чтобы лучшие игры 2016 года уже могли полноценно использовать возможности HDR-дисплеев.

И еще один важный момент, на который нужно будет обратить внимание при использовании грядущих HDR-телевизоров в качестве мониторов для ПК: сочетание вывода отрисованного 3D-изображения в широком динамическом диапазоне и его дальнейшей постобработки в телевизоре, которая зачастую просто не отключается полностью в большинстве телевизоров. Было бы неплохо, если производители HDR-телевизоров обратили на это внимание и дали возможность полного отключения всей постобработки, попросту вредной при работе в качестве ПК-монитора.

Улучшения технологии AMD FreeSync

Группа Radeon Technologies Group не могла обойти своим вниманием и технологию динамической частоты обновления AMD FreeSync, имеющей несколько преимуществ перед аналогичной возможностью конкурента — Nvidia G-Sync. Главным плюсом технологии AMD можно считать отсутствие необходимости в установке специальной платы в мониторы и оплаты лицензионных взносов со стороны производителей дисплеев. Соответственно, сравнимые по параметрам устройства с поддержкой FreeSync стоят обычно меньше, чем G-Sync-мониторы.

Неудивительно, что количество производителей дисплеев с поддержкой FreeSync более чем вдвое выше, чем с G-Sync, да и разнообразие моделей мониторов с поддержкой этих технологий примерно аналогичное, и снова в пользу FreeSync. Кроме этого, большая доля FreeSync-мониторов имеет на борту не только разъемы DisplayPort, но и HDMI, а весьма приличная часть таких мониторов основана на качественных IPS- и *VA-матрицах и/или имеет высокое 4K-разрешение.

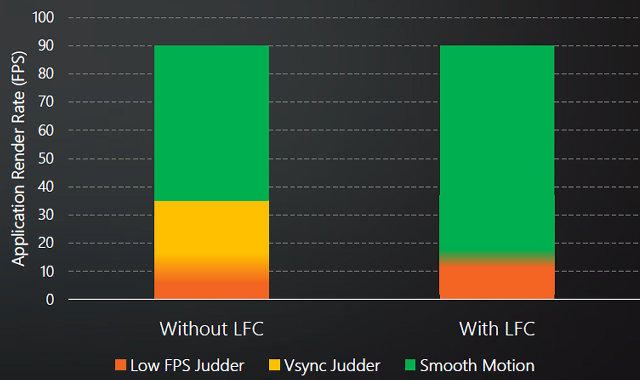

В недавнем обзоре нового видеодрайвера AMD Radeon Software Crimson Edition мы уже писали о технологии компенсации низкой частоты кадров Low Framerate Compensation (LFC), которая появилась в FreeSync начиная с этой версии драйверов. Работа LFC заключается в том, что технология постоянно отслеживает скорость рендеринга и вставляет дополнительные кадры, когда частота кадров падает ниже минимальной поддерживаемой частоты обновления дисплеем с поддержкой FreeSync.

Специальный адаптивный алгоритм автоматически изменяет последовательность выходных кадров и их частоту обновления так, чтобы снизить неприятные рывки из-за падения частоты кадров. При FPS ниже минимальной частоты обновления и включенной вертикальной синхронизации (VSync on) FreeSync ранее вовсе не работал, что вызывало неплавность в смене кадров. Но теперь, с включением LFC, смена кадров в таком случае плавная. При отключенной синхронизации в тех же условиях наблюдаются разрывы кадра (так называемый tearing), но включение LFC снижает и их.

Технология LFC работает исключительно программно и может быть модифицирована для будущих мониторов. В том числе поэтому никакой настройки со стороны пользователя или обновления монитора она не требует, эта возможность автоматически включается на всех мониторах с поддержкой FreeSync, максимальная частота обновления которых в 2,5 раза превосходит минимальную.

На приложенной диаграмме видно, что в конфигурации с монитором Asus MG279Q с его диапазоном частоты обновления 35—90 Гц без включения LFC рывки наблюдаются при частоте кадров менее 35 FPS, а при включении этой технологии FreeSync работает и при меньшей частоте, когда минимальная комфортная граница частоты кадров отодвигается вниз до 15 FPS.

Также компанией AMD был анонсирован ноутбук Lenovo Y700 — первый мобильный компьютер с FreeSync-дисплеем, который уже продается на североамериканском рынке в магазинах Best Buy по цене от $899. Ноутбук Lenovo Y700 основан на гибридном процессоре AMD FX-8800P «Carrizo» и дискретном видеоядре Radeon R9 M380 с подключенной напрямую ЖК-панелью на основе IPS-матрицы размером 15,6 дюйма и с разрешением 1920×1080, имеющей динамическую частоту обновления в пределах от 40 до 60 Гц.

В ноутбуке используется стандарт eDP (embedded DisplayPort) и прямое подключение ЖК-панели к графическому процессору без необходимости установки специальной платы scaler. К сожалению, описанная нами выше технология компенсации низкой частоты кадров LFC в случае ноутбука Lenovo работать не будет, так как разница между 40 и 60 Гц меньше 2,5 раз, что слишком мало для корректной работы этой возможности.

Очередным анонсом, связанным с FreeSync, является объявление о совместной работе компании AMD с производителями мониторов для обеспечения работы технологии FreeSync при HDMI-подключении, что на данный момент невозможно. Эта возможность важна потому, что разъемы HDMI распространены куда шире, чем DisplayPort, что даст пользователям более широкий выбор телевизоров и мониторов с поддержкой технологии динамического изменения частоты обновления.

Кстати, по мнению представителей AMD, сравнительно малое количество мониторов с разъемами DisplayPort объясняется в основном маркетинговыми причинами. Ведь порты HDMI значительно лучше известны по бытовым устройствам вроде телевизоров, плееров и проекторов, хотя за их использование производителям и приходится платить немалые отчисления.

AMD обещает открыть возможность работы FreeSync по HDMI в начале 2016 года, и эта возможность будет доступна для всех APU и GPU компании, которые поддерживают FreeSync по DisplayPort. Вероятно, это приведет к расширению предложения FreeSync-дисплеев на рынке, так как 70% массовых устройств не имеют поддержки разъема DisplayPort. Кроме этого, еще одной из полезных возможностей станет возможность подключения FreeSync-монитора к ноутбуку с видеокартой Radeon и разъемом HDMI на борту.

Компания полностью поддерживает будущую стандартизацию динамически изменяемых частот обновления в будущих версиях HDMI, но в AMD не хотят ждать окончания процесса стандартизации. Так как текущий стандарт HDMI имеет возможность включения специальных vendor-specific расширений, компания AMD воспользовались этим временным решением, чтобы внедрить технологию FreeSync в уже существующую версию этого стандарта. Важно, что их расширение полностью совместимо как с будущими моделями Radeon, так и с уже вышедшими устройствами, соответствующими стандарту HDMI.

На данный момент компания работает со своими партнерами, в числе которых Acer, LG, Mstar, Novatek, Realtek, Samsung, для обеспечения работы обсуждаемой технологии динамического изменения частоты обновления в том числе и при помощи HDMI-портов. Приведем список первых мониторов с поддержкой работы FreeSync при HDMI-подключении — компаний Acer, LG и Samsung:

Как видите, мониторы готовятся разные, с размерами экрана от 20 до 34 дюймов и различным разрешением. Разве что типы устанавливаемых в них матриц пока что неизвестны.

Также поддержка работы технологии FreeSync с подключением по HDMI-разъемам будет обеспечиваться и будущими моделями ноутбуков, основанных на процессорах компании AMD: гибридных APU в сочетании с дискретными GPU, начиная с некоторых моделей, планируемых к выходу в первом квартале наступающего года.

Поддержка стандарта DisplayPort 1.3 в следующем поколении Radeon

Ну и последним, но от этого не менее важным анонсом сегодняшнего дня стало объявление о поддержке будущего стандарта вывода визуальной информации в следующем поколении графических процессоров компании AMD. Ожидаемые в следующем году видеокарты Radeon будут первыми в индустрии решениями с поддержкой DisplayPort 1.3. Новая версия этого стандарта использует существующие кабели и разъемы, разве что могут накладываться дополнительные ограничения на их длину.

Вероятно, одними из первых графических решений Radeon следующего поколения будут мобильные GPU, которые и станут первенцами в поддержке стандарта DisplayPort 1.3 HBR3, окончательно выпущенного в сентябре 2014 года. Главным преимуществом нового стандарта является увеличение пропускной способности до 32,4 Гбит/с, что наконец-то отодвинет предел по пропускной способности, имеющийся в предыдущем поколении DisplayPort 1.2.

Это значение более чем на 80% превышает возможности HDMI 2.0 и позволяет подключить 5K-мониторы в RGB-формате при 60 Гц, используя единственный кабель (сейчас приходится подключать пару разъемов и кабелей, и такие мониторы являются как бы парой дисплеев), а также UHDTV-телевизоры с разрешением 8K (7680×4320), используя цветовую субдискретизацию 4:2:0 при 60 Гц. Также по DisplayPort 1.3 можно будет подключать и стереодисплеи (120 Гц) с 4K-разрешением.

Мониторы со сверхвысоким 5K-разрешением имеют заметно большее количество пикселей по сравнению с 4K-устройствами — их на 78% больше. Это дает плотность точек в 210 пикселей на дюйм для 5K-мониторов по сравнению с 142 ppi для 4K-дисплеев того же размера. Понятно, что в результате будет обеспечена куда большая четкость и большее пространство для приложений на рабочем столе. Появление 5K-дисплеев, рассчитанных на подключение одним кабелем DisplayPort 1.3, ожидается к середине 2016 года, а 4K-дисплеи с поддержкой HDR должны появиться уже в конце следующего года.

Также новый стандарт будет полезен для продвижения технологии FreeSync. Компания AMD ожидает появления первых устройств с 4K-разрешением с поддержкой технологии динамического обновления до 120 Гц в конце 2016 года. Такие мониторы будут способны работать в 4K-разрешении с применением технологий FreeSync и компенсации низкой частоты кадров Low Framerate Compensation в частности.

Вот список характеристик для мониторов нового поколения, которые становятся возможны при использовании новой версии стандарта DisplayPort 1.3 с расширенной пропускной способностью: мониторы с разрешением 1920×1080 пикселей: 240 Гц SDR и 240 Гц HDR; мониторы с разрешением 2560×1440: 240 Гц SDR и 170 Гц HDR; 4K-мониторы: 120 Гц SDR и 60 Гц HDR; 5K-мониторы: 60 Гц SDR. Пользователям остается лишь дождаться середины или конца 2016 года, заработав к тому времени достаточное количество денег для приобретения подобных устройств, которые явно будут стоить недешево.

Eyefinity – технология, разработанная компанией AMD, которая обеспечивает совместное подключение нескольких дисплеев к компьютеру, и реализованная в видеокартах, начиная с графического процессора RV800. Не отстали от соперника и их извечные оппоненты, предложив свой вариант – NVIDIA Surround. Обе компании предлагали две совсем разные технологии построения видеостен.

Вступление, NVIDIA Surround – были первыми, стали последними, AMD Eyefinity – лучше один раз сделать, чем трижды переделывать, построение Eyefinity на базе Gigabyte HD 7770

Оглавление

Вступление

Eyefinity – технология, разработанная американской компанией AMD, которая обеспечивает совместное подключение нескольких дисплеев к компьютеру, и реализованная в видеокартах, начиная с графического процессора RV800.

реклама

Впрочем, на момент анонса в сентябре 2009 года, AMD были уже вторые, их успели обогнать калифорнийцы со своим GeForce GTX 200, производство которого началось с 2008 года. Обе компании предлагали две совсем разные технологии построения видеостен. В этой статье хочется провести сравнение особенностей построения AMD Eyefinity и NVIDIA Surround, выявить плюсы и минусы данных решений.

NVIDIA Surround – были первыми, стали последними

До того, как представить продукт с поддержкой до четырех мониторов одновременно, калифорнийцы прошли долгий путь, занявший целых два года. И это с учетом тенденций развития данного рынка.

Началом, которое, мягко говоря, было неудачным, стало изначальное использование видеокарт с двумя конвейерами дисплеев. Другими словами, в течение трех поколений графических ускорителей для включения Surround требовались две и более карты, объединенные в упряжку SLI. Они в свою очередь накладывали свои ограничения по выбору комплектующих для создания подобной системы.

Ошибка была действительно существенная, но за ней последовали еще три. Одной из них стало обязательное наличие материнской платы с сертификацией SLI. Действительно, подобных решений на базе чипсетов, способных потянуть данную систему в полном объеме, было не так много, предполагалась покупка именно топ-продукта, каким был nForce 680i SLI и старше.

Помимо этого для создания Surround требовались видеокарты NVIDIA с одинаковыми графическими процессорами, хотя извращений хватало и здесь. Так, для моделей семейства GeForce GTX 200 запуск трехмониторной системы гарантировался при объединении карт в 2-Way SLI, а также 3-Way, которая предназначалась больше для любителей выжимать максимум из системы и ставить рекорды в популярных бенчмарках. Представьте себе три таких «бутерброда» в системном блоке, которые благодаря своему аппетиту прогреют комнату сильнее, чем батарея.

Несколько позже данную ситуацию разрядили гибридные решения, представлявшие собой объединение двух видеопроцессоров, размещенных на одной печатной плате. Такими были GeForce GTX 295 и GTX 590. Изображение выводилось на три дисплея с использованием двух DVI и HMDI разъемов.

Так продолжалось вплоть до выхода новой архитектуры Fermi, которую NVIDIA представила общественности в ноябре 2010 года. Попытка была удачной и принесла пользователям возможность подключения до четырех дисплеев одновременно. Для этого кроме привычных выходов DVI и HDMI в топовых версиях GTX 570/ GTX 580 был впервые использован DisplayPort. Хотя на рынок и ранее попадали гибридные решения с возможностью подключения до пяти мониторов к одной видеокарте, к примеру, KFA 2 MTD X5 GTX 560 Ti.

реклама

И все же, чего всегда не хватало NVIDIA, что было у AMD – возможности построения Surround с одной картой среднего ценового диапазона. Ситуация кардинально поменялась с выпуском семейства графических процессоров на основе архитектуры Kepler. Возможностью создания видеостен наконец-то обзавелись середнячки серии GTX 660.

Но самой болезненной проблемой компании по сей день остается выбор дисплеев для вывода изображения. Если отталкиваться от официального сайта NVIDIA, то при создании Surround пользователям придется не только учитывать вышеперечисленные факты, но и подбирать мониторы с одинаковыми разрешением, частотой обновления и полярностью синхронизации.

Вдобавок производитель предлагает поиграть в игры в стереоскопическом 3D, которое накладывает еще больше ограничений на аппаратные связующие, поскольку для него необходимы совместимые с данной технологией дисплеи.

AMD Eyefinity – лучше один раз сделать, чем трижды переделывать

В AMD поступили иначе, пусть и немного задержавшись со своим релизом Eyefinity. Впервые в графических процессорах RV800 блок вывода изображения, в отличие от GTX 200 и старше, был переделан таким образом, что GPU поддерживал вывод картинки на устройства вывода в количестве до шести штук включительно. Для этого был использован цифровой интерфейс DisplayPort, который не требовал сигнала синхронизации, как DVI.

Запуск технологии Eyefinity состоялся с выходом Radeon HD 5870, а ее совершенствование продолжается и по сей день.

Для работы Eyefinity не требовалось специальной материнской платы, рекомендация была только одна – для достижения максимальной производительности желательно использовать интерфейс PCI-E 2.0 и выше. Такую техническую рекламу можно заметить на каждой упаковке видеокарт. Собственно, это свойственно всей линейке ускорителей AMD, в том числе и новым решениям.

Однако существовала одна проблема, заключавшаяся в том, что активация Eyefinity происходила с применением DisplayPort, который являлся ключевым элементом для такой масштабируемости, меняя способ поддержки нескольких мониторов для видеокарты.

Существует два варианта, первый и более дорогостоящий – наличие подходящего монитора, проектора с данным выходом или активным переходником. В данном случае был использован mini Display Port - DVI PowerColor, сертифицированный AMD для подобных систем.

Зато проблем с подборкой мониторов для вывода изображения в Eyefinity нет. Технология не требует наличия одинаковых аппаратных решений. Это действительно очень удобно, вывод изображения доступен практически на все цифровые панели с наличием соответствующих портов. Можно либо объединять их в одну виртуальную стену, либо использовать до трех независимых и более со своим родным разрешением. Стоит учитывать только один нюанс: хотя бы один из дисплеев должен быть подключен к цифровому выходу.

реклама

Безусловно, данная технология подойдет не только геймерам и любителям больших разрешений, но и тем, чей профессиональный род деятельности связан с работой на нескольких мониторах одновременно.

Построение Eyefinity на базе Gigabyte HD 7770

Печатная плата на текстолите синего цвета, размеры и технические характеристики видеокарты более чем стандартны для данной серии.

Графическое ядро выполнено по технологическим нормам 28 нм производства, его частота равна 1050 МГц. Память стандарта DDR5 представлена четырьмя микросхемами по 256 Мбайт с частотой 1125 МГц.

Gigabyte HD 7770 повторяет концепцию предыдущего графического поколения AMD, на ее передней панели размещены следующие выходы:

- Один DVI-I;

- Один HDMI;

- Два Mini DisplayPort.

За вывод изображения отвечают три LCD монитора фирм Samsung, BenQ и Philips диагональю 18.5 дюймов. В остальном их характеристики вполне обычны: формат экрана 16:9, максимальное разрешение 1366 х 768, присутствует цифровой выход DVI.

Подключение дисплеев к видеокарте происходит по приведенной ниже схеме:

- HDMI to DVI-D;

- Mini DP to DVI-D;

- VGA to DVI-I.

Далее в операционной системе в AMD Vision Engine Control Center происходит их распознавание. В случае успешного обнаружения переходим к следующей операции.

Создаем группу дисплеев по предоставленному шаблону горизонтального или вертикального размещения. Последнее возможно в шести различных комбинациях, в зависимости от подключаемых устройств.

Регулируем компенсацию лицевой панели, выбираем предпочитаемый дисплей и расположение панели задач Windows. Практически все готово, на выходе получаем разрешение, которое составляет 4098x768 точек.

Подпишитесь на наш канал в Яндекс.Дзен или telegram-канал @overclockers_news - это удобные способы следить за новыми материалами на сайте. С картинками, расширенными описаниями и без рекламы.

Решил попробовать поиграть на 3-х мониторах. Есть 2 видеокарты Palit GeForce GTX 660 OC и 3 монитора 17" 1280х1024 с VGA входом.

Проблема в том, что к одной видеокарте подключить больше 1 монитора vga не получится, поэтому остается 1 вариант: купить монитор, подключаемый через HDMI или DisplayPort. Покупать новый монитор 1280х1024 с поддержкой DisplayPort как то рука не поднимается да и дорого для такой древности. Лучше чуть дороже, но что-нибудь современное широкоформатное (сопоставимое по высоте с 17-дюймовым узкоформатным, конечно).

Поэтому и вопрос, можно ли сделать 2d surround например так: 1 широкоформатный монитор по середине и 2 старых по бокам, т.е. с разным разрешением.

Буду благодарен и за другие рац. предложения.

Если это будет примерно так выглядеть, как Вы думаете,будет ли это принципиально?

В общем проверил. Не получилось. В качестве третьего монитора использовал телевизор сони 40' разрешением full hd с hdmi входом (сразу про телевизор и не подумал :)). Подключить получилось комп видит всех, но именно surround не воспринимает.

Еще видел существуют активные переходники, т.е. преобразователи сигнала из цифрового в аналоговый. Но они редкие и дорогие слишком.

Да уж, не ожидал, что упрусь в разъем. На моей старенькой 8800GTS было 2 аналоговых выхода, но, правда, цифровых вообще не было.

В общем проверил. Не получилось. В качестве третьего монитора использовал телевизор сони 40' разрешением full hd с hdmi входом (сразу про телевизор и не подумал ). Подключить получилось комп видит всех, но именно surround не воспринимает.

| Требуется три дисплея с поддержкой общего разрешения , частоты обновления и полярности синхроимпульса |

.

Я подключал три разных монитора HDMI + VGA +VGA то есть 1920x1080 + 1920x1200 + 1920x1200 всё работало .

Решил выйти из ситуации таким путем. Нашел старый дисплей 17", но с входом DVI-D подключил к первой видеокарте вместе с VGA (DVI-I через переходник). Результат тот же, что и с телевизором.:dont: Монитор работает, по всем мониторам вожу мышкой. Но в панели управления nvidia, когда выбираю "Расширение дисплеев с помощью Surround" - в настройках пусто. Т.е. не позволяет настроить сурраунд.:(

Добавлено через 7 минут

Может схема подключения неправильная.

Но что интересно, на сайте nvidia отсутствует конфигурация для моих GTX 660 OC:confused:

Подключил таки три монитора в 2d surround. Но только к одной видеокарте. Видимо все же схема подключения неправильная была. Теперь нужно найти точную схему для моих карт.

А вот размер и форма монитора, как оказалось, по барабану. Лишь бы можно было на мониторах выставить одинаковое разрешение. Я подключил телевизор 40" к HDMI, один монитор 17" к VGA, второй монитор 17" к DVI-D.

Добавлено через 1 час 2 минуты

Нашел схему здесь, вроде бы соответствует моей (зеленым цветом). А у меня не работала.

В итоге решил обновить драйвер видеокарты. Все заработало. :hi:

Powered by vBulletin® Version 3.8.4

Copyright ©2000 - 2022, Jelsoft Enterprises Ltd. Перевод: zCarot

NVIDIA расширяет экспансию в так полюбившейся компании и недавно еще бывшей ее монополией нише 3D. То, что дало толчок всему направлению, систему NVIDIA 3D Vision, мы тестировали уже довольно давно. Регулярно делаем отчеты о поступающих на рынок системах, поддерживающих 3D Vision, коих сегодня становится все больше и больше. Не говоря уж о полностью самостоятельных, автономных 3D-решениях, которые, правда, редко относятся именно к геймерскому сегменту. А именно на него и делает в первую очередь акцент NVIDIA. Сегодня мы поговорим об экстремальном геймерском решении на основе NVIDIA 3D Vision — системе панорамного 3D, NVIDIA 3D Vision Surround. Первый обзор на территории Рунета.

Система эта не является неким готовым для магазина продуктом «из одной коробки». Это составная вещь: 3 монитора с поддержкой 3D Vision (развертка 120 Гц), мощная система с видеоподсистемой на базе минимум двух карт уровнем начиная с GeForce GTX 260 (лучше — GTX 400), ОС Windows 7 и очки NVIDIA 3D Vision. Разберемся с тем, из чего собрана наша NVIDIA 3D Vision Surround.

Детали

3 монитора LG W2363D. Первые 3D-мониторы LG. TN-матрица, 23 дюйма диагонали, FullHD-разрешение, частота 120 Гц, уменьшение времени отклика при включении функции Thru Mode, стильный дизайн (глянцевая рамка, матовый экран, оригинальное колесико изменения яркости). Цена — 16 тысяч рублей. Отличные современные мониторы, снабженные двумя HDMI-разъемами каждый. Но они в нашем случае не понадобятся, подключение надо осуществлять по DVI.

Хорошие мониторы, с оптимальными для настоящего момента набором характеристик (яркость — 400 кд/м2, контрастность — 70000:1, 16,7 млн. цветов), адекватно отображающие стерео картинку, оптимизированные для игр. Едва ли могут восприниматься как инструменты работы дизайнера, художника или фотографа, но для этого и не предназначены.

Компьютер Meijin в максимальной для этой компании комплектации:

- Процессор Intel Core i7 Extreme частотой 3,3 ГГц, с увеличенным до 12Мбайт кэшем третьего уровня, поддерживающий 64-разрядные приложения

- Материнская плата с набором микросхем Intel X58

- Оперативная память — 24 Гбайт DDR3

- 3 x NVIDIA GeForce GTX 480 (шина памяти 384 bit, 480 потоковых процессоров, частота ядра 700 МГц, памяти – 3696 МГц), включенных в режиме SLI

- Дисковый массив RAID1 на 2 Тбайт

- BD-RW привод

- Звуковая плата Creative X-Fi

- 64-разрядная операционная система Windows 7 Ultimate, установленная на отдельный SSD-накопитель

Цена такой системы — 390 тысяч рублей.

Неплохо, не правда ли? Добавляем водяную систему охлаждения с 10 вентиляторами, красиво подсвеченными трубками (визуально всю красоту можно увидеть через прозрачное окно на боковой стенке корпуса) и информационным экранчиком на лицевой панели. Вес нетто в районе 30 килограмм, огромный черный корпус без особых изысков, практически предельная на сегодняшний день комплектация компьютера — Meijin изрядно поднаторела в выпуске экстремальных ПК.

Третья деталь — это, собственно, система NVIDIA 3D Vision. О ней мы уже подробно писали, не будем повторяться.

Сборка и настройка

Собрать систему несложно — единственное, с чем может возникнуть сложность, так это с попаданием именно в поддерживающий Surround DVI-порт на видеокарте, но это можно отследить по NVIDIA Control Panel, если что-то пошло не так, и один из мониторов отказывается работать. Да и старый-добрый метод научного тыка тоже никто не отменял. Также следует расставить мониторы максимально плотно по отношению друг к другу, чтобы панорамной картинке не мешали обширные зазоры.

Но вот все мониторы подключены, подходящая для системы конфигурация соблюдена (видеокарты только от NVIDIA, в частности), время ставить драйверы. Ничего сложного, нужные файлы легко находятся на сайте NVIDIA.

Далее — процесс настройки. Надо лезть в NVIDIA Control Panel, где последовательно нужно включить систему, проверить ее на работоспособность, расставить виртуально мониторы в правильной последовательности, настроить картинку по высоте для плавного, без «лесенки», отображения на всех мониторах, и настроить горизонтально.

Рабочее разрешение на трех FullHD-мониторах — 5760х1080. На этапе бета-тестирования драйверов в каждой игре необходимо выставлять свое разрешение, а также задавать специфические графические настройки. Почему и насколько это мешает процессу — читайте ниже.

Немного о вариациях. Мы тестировали систему в самом простом режиме — три установленных рядом в пейзажной ориентации монитора. Но также возможна их установка в портретной ориентации для получения разрешения 3240x1920, допускается и размещение их на единой подставке, с максимально малым друг от друга расстоянием. Только FullHD-мониторами с поддержкой 3D возможности применения NVIDIA Surround не ограничиваются. Вполне можно играть в игры и поставив в ряд мониторы разрешением 1680x1050. Для этого требуются и меньшие вычислительные ресурсы, не обязательно собирать систему-монстра. Но и впечатления будут значительно менее острыми.

Впечатления

В настоящий момент NVIDIA 3D Vision Surround применима исключительно в игровом контексте. Есть, конечно, деморолики и фотографии в формате 48:9 (естественном для разрешения 5760х1080), но этого пока очень мало, чтобы заявлять о применимости 3D Surround в иных, кроме игровой, сферах — хотя NVIDIA утверждает, что работа ведется и в этом направлении. По игровой же опишу свои впечатления.

Безусловно, самыми востребованными жанрами для подобной панорамной системы, должной обеспечивать максимальный эффект присутствия, являются авиасимуляторы и экшн от первого лица. К сожалению, на первом я проверить возможности системы не успел, зато вдоволь побегал с оружием наперевес.

Играл в «Метро 2033», Battlefield Bad Company 2, Just Cause 2, Left4Dead 2.

Особенно 3D Vision Surround впечатляет в «Метро 2033» и Just Cause 2, в них подобная система показалась чрезвычайно обоснованной. «Вылетающие из экрана» эффекты, бросающиеся из темных углов периферического зрения монстры и солдаты, очень широкий угол обзор в довольно эпичной JC2 — играть в подобные игры в режиме 3DВ Vision Surround, — это действительно особые ощущения. При этом отмечаю и сложность той же «Метро 2033» для настройки — для приемлемого FPS необходимо копаться в специфических настройках DirectX, а также отключать антиальясинг. Оптимальное разрешение —4800х900 (равно как и в JC2).

Удивила Battlefield Bad Company 2. Для оптимального FPS тоже были рекомендованы NVIDIA разрешение 4800х900 и отсутствие антиальясинга, но и в таком режиме игра умудрилась терять кадры то и дело и заметно тормозить. И это — на компьютере ценой в 12 тысяч долларов! Да, 3D Vision Surround пока что скорее вещь для недалекого будущего.

Left 4 Dead 2 же по причине своей сетевой направленности как-то не выглядит оптимальным решением для игры в столь энергоемком режиме. Хотя лезущие из темноты боковых экранов объемные зомби, конечно, действуют на психику угрожающе.

Need for Speed Shift. В гонках 3D-эффект ощущается не слишком, зато по полной работает Surround, давая полное осознавание себя в кабине гоночного болида. Для фанатов виртуальных гонок такая система вкупе с рулем и педалями может оказаться крайне привлекательной.

Warhammer 40K Dawn of War II Chaos Rising. Да, 3D Vision Surround работает и в RTS. Причем в данном случае — с максимальным разрешением в 5760х1080 и антиальясингом. Но тут вылезли проблемы с интерфейсом, который оказался мало приспособлен для Surround— менюшки разъехались по экрану, и пока доедешь до них мышкой, вражеские орки уже успеют разгромить ваш отряд. NVIDIA знает о таких проблемах с подобными проектами и работает над их устранением. Но пока только работает.

Как должен выглядеть интерфейс на хорошо приспособленной для 3D Vision Surround игре, хорошо можно отследить по фирменной демо-игре Supersonic Sled. Все по центру, все аккуратно.

Проехались по частностям — скажем о целостном впечатлении. Как бы ни хотелось говорить о непередаваемых ощущениях и поднимать над головой революционный стяг, можно утверждать только лишь о приятных, но не сносящих голову ощущениях, привносимых за счет активированного периферического зрения и недоступной ранее широте угла обзора. 3D-эффект не приобретает новых красок, эта система будет немногим менее эффективной и в режиме 2D Surround. Что сказать о щелях между мониторами и рамках, которые должны мешать восприятию? Вот этого как раз и нет — мозг достраивает панораму в целостную картинку.

На сегодняшний момент самая совершенная игровая 3D-система, доступная в домашних условиях. Да что 3D — это просто мечта любого экстремального геймера. Панорамный обзор с рекордным углом обзора, эффектно выскакивающие из зоны периферийного внимания монстры, запредельное разрешение и крайне высокий уровень погружения в игровую реальность. Но эта система не лишена довольно существенных недостатков.

Для тестирования NVIDIA 3D Vision Surround у нас применялся, напомню, топовый десктоп от Meijin ценой 390 тысяч рублей, вобравший в себя все лучшее, что есть сейчас на пользовательском рынке высоких технологий. Но даже из небольшого числа запускавшихся нами игр далеко не все работают на максимальных или близких к максимальным настройках. И не каждая игра вообще заработает на этом сетапе. NVIDIA 3D Vision Surround — система, безусловно, крайне интересная. Достаточно простая (никаких проблем с драйверами, настройками и сборкой). Эффектная. Не имеющая на рынке аналогов. Но требующая неуемных денежных затрат. Даже если не покупать компьютер Meijin по цене нового автомобиля, а собрать самостоятельно приличную систему, то вместе с тремя мониторами это потянет минимум тысяч на 150. Что автоматически позиционирует 3D Surround как элитарное решение.

А ведь скоро на рынок будет выпущена поддерживающая 3D Sony Playstation 3. Более бюджетное и массовое решение, которое можно подключить к плазме диагональю 60 дюймов и получить похожие впечатления. Но хардкорному игроку, конечно, не стоит отвлекаться на такие вещи — NVIDIA 3D Vision Surround в настоящий момент самое совершенное игровое решение на рынке, аналогов ему нет. Стоит отметить, что для 3D-системы Playstation будет выпущено к концу года около десятка игр, а 3D Vision уже сейчас поддерживается более 450.

Surround View — активирует одновременную работу встроенного графического адаптера и внешней видеокарты, например для подключения нескольких мониторов.

Значение опции может быть Enable, Disable и Auto.

Также нашел информацию, что если у вас например установлена видеокарта в разьем PCI-E и вы включите данную опцию, то у вас появится возможность использовать встроенную графику процессора как дополнительную видеокарту, например для вывода изображения на другой монитор. Это имеется ввиду конечно если у вас присутствует встроенное графическое ядро, но оно есть почти в каждом процессоре Intel или AMD.

Нужно ли включать опцию? Если у вас несколько мониторов — да. Если у вас один монитор — думаю нет, однако может быть такое, что ваш софт NVIDIA или Radeon позволяет использовать две видеокарты сразу. Например для игр — внешняя видеокарта, а для Windows, браузера и подобного не особо требовательного ПО в плане видеоресурсов — встроенное графическое ядро. Такая схема применяется в ноутбука, а вот в настольных компьютерах — точно не знаю.

Вот собственно сама функция:

PS: хотя если честно, первое что пришло на ум, когда увидел название опции — что это связано с звуком))

Это вам просто на заметку:

- Обведено зеленым — это разьем встроенной видеокарты, их может быть два, но если расположены в той области — значит это точно встроенная видеокарта. Кстати она обозначается как iGPU.

- Обведено красным — это отдельная внешняя видеокарта, которую можно использовать например для игр или для тяжелого графического софта, например Фотошоп. Такая видеокарта обозначается просто GPU, редко — dGPU.

И вот если активировать опцию — то можно использовать два монитора, для каждого из которых будет работать отдельная видеокарта.

Надеюсь данная информация оказалась полезной. Удачи и добра, до новых встреч друзья!

Читайте также: