Какая файловая система esxi

This article details frequently asked questions and answers about vSphere ESXi core storage, including Auto Deploy and vLCM.

Auto Deploy

Storage архитектура

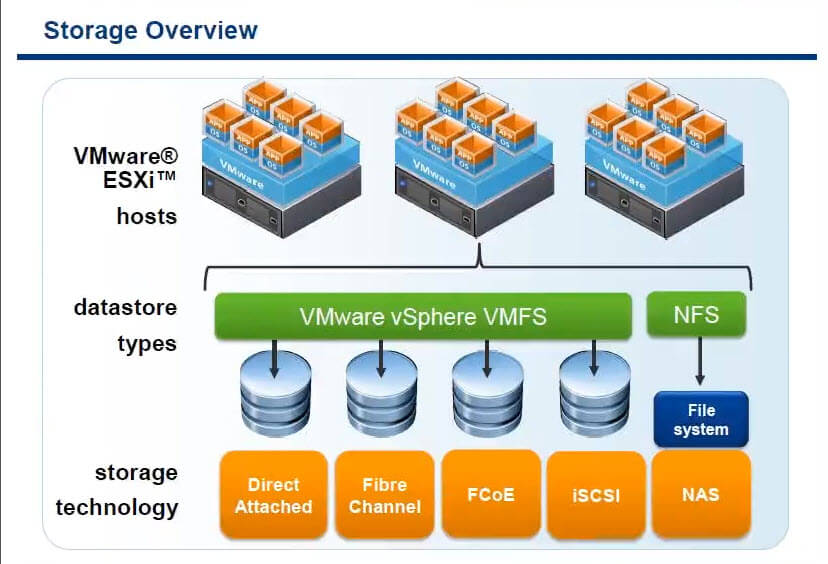

На скриншоте снизу представлена схема работы ESXI с дисками. Есть хосты виртуализации, к ним по протоколам

- NAS > подключение NFS по сети

- ISCSI > тоже по ethernet сети

- FCoE

- FC > оптика

- Direct Attached (DAS)

Далее эти дисковые ресурсы, видятся в гипервизоре как LUN разделы, которые подключаются и форматируются в VMFS файловую систему.

I’m using Auto Deploy, what do I do?

vSphere Autodeploy is fully supported. However, with the recommendation to use ESXi host local storage for new features and capabilities, it is recommended to (re)configure the Host Profiles with Auto Deploy to use Stateful Installs. Doing so does require local storage for the ESXi hosts.

vSphere Lifecycle Manager (vLCM) is a new feature that relies on local storage. When vLCM is used in an environment with Auto Deploy, customers should change to statefull installations, see this article for more details.

Filter Tags

Lifecycle Management Storage ESXi 7 vSphere vSphere 7 vSphere Lifecycle Manager (vLCM) Document Intermediate Design Deploy

Понимать то, как устроена Файловая Система гипервизора " VMware ESXi 5.0 ", безусловно, очень важно. Тем более, что по сравнению с VMware vSphere 4.1, произошли некоторые значительные изменения. В частности, произошел переход от MBR в пользу GPT. И теперь утилита fdisk вам уже ничем не поможет. На замену ей пришла новая утилита - " partedUtil ", умеющая работать с GPT. Ну, а теперь давайте перейдем к рассмотрению структуры файловой системы ESXi 5.0:

Первый раздел - это небольшой раздел, служащий только для загрузки системы и поиска образа ( image ) гипервизора, который может располагаться на одном из следующих двух разделов.

Второй раздел - это 250-мегабайтный FAT раздел, на котором располагается актуальный образ системы. Сам образ " s.v00 " представляет собой сжатый файл размером в 124MB, который содержит в себе операционную систему ( ОС ) гипервизора ( англ.: hypervisor operating system ) и который распаковывается каждый раз при загрузке системы.

Третий раздел - данный раздел необходим для применения обновлений ( т.е. патчей ). Если ESXi только что установлен, то раздел будет пуст.

Четвертый раздел ( core dump partition ) - раздел служит для размещения crash-информации в случае, когда гипервизор выходит из строя ( PSOD - purple screen of death ).

Пятый раздел - в данном разделе, в основном, располагаются ISO файлы с "VMware Tools" для различных поддерживаемых ОС. Также здесь находятся образы дискет с драйверами для PVSCSI контроллера.

Шестой раздел - если ESXi установлен на локальный жесткий диск, размер которого больше 5GB, то именно здесь будет создан "scratch"-раздел. Этот раздел содержит, в основном, различные лог-файлы системы. При установке VMware ESXi 5.0 на очень маленький диск, размер которого не больше 1GB, или на USB, то "scratch"-раздела не будет, а все лог-файлы будут находиться в оперативной памяти ( а вот в случае отключения электричества, все лог-файлы будут потеряны ).

Седьмой раздел - на оставшейся части свободного дискового пространства будет автоматически создан VMFS том ( раздел ). Обычно это самый большой раздел, на котором, возможно, и будут располагаться ваши виртуальные машины.

На хосте "VMware ESXi 5.0" вы можете получить доступ к этим разделам, перейдя в определенные каталоги, которые располагаются в корне "/":

Отфильтрованный вывод команды "ls -l /", выполненной на хосте ESXi 5.0:

А вот вам вывод команды "df -h", выполненной на том же хосте ESXi 5.0:

Как видите, нам не показаны 1-ый и 4-ый разделы. Но это, в принципе, и понятно. Ведь это сугубо служебные разделы, в которые не стоит лезть. Но все же, если мы все-таки хотим их увидеть, то в этом нам поможет упомянутая чуть выше утилита " partedUtil ":

Возвращаясь к обсуждению очень важных для нас 2-ого и 3-его разделов, хочу отметить, что при обновлении актуального образа системы, который располагается во втором разделе , он сначала будет скопирован в 3-ий раздел . Это делается для того, чтобы если обновление прошло, скажем так, не совсем удачно, можно было бы откатиться до последней рабочей конфигурации.

А сделать это можно путем нажатия "SHIFT + R" во время загрузки, после чего будет предложено выбрать альтернативный раздел ( с рабочим образом ) для загрузки системы.

Всем привет сегодня мне хочется рассказать, как работает Vmware ESXI на уровне дисковой подсистемы, с какими протоколами дружит. Рассмотрим архитектуру дисковой подсистемы, будет интересно. Хочу отметить, что производительность всей инфраструктуры, будет на 90 процентов зависеть именно от этого фактора, и правильное его понимание, будет служить залогом лучшего планирования и функционирования, советую выделить для своего обучения минут 15-20 и вы сможете потом избежать, большого количества всевозможных проблем.

Не так давно я писал статью о том что такое виртуализация и ее принцип работы VMware ESXI, советую ознакомится, там я в общих чертах рассказал как работает сам ESXi и посмотрели сравнения с физической инфраструктурой. Далее я хотел бы рассказать о каждой из его составляющих более подробно.

Переход с VMFS-3 на VMFS-5

Операция перехода с VMFS-3 на VMFS-5 бесшовна: производится вживую, без останова, во время операции ВМ продолжают работать.

Хранилища, обновленные до VMFS-5, могут использовать: функцию поддержки 1-килобайтных файлов, тома до 60ТБ, все улучшения в функционале VAAI ATS.

Пример вывода vmkfstools на обновленном томе:

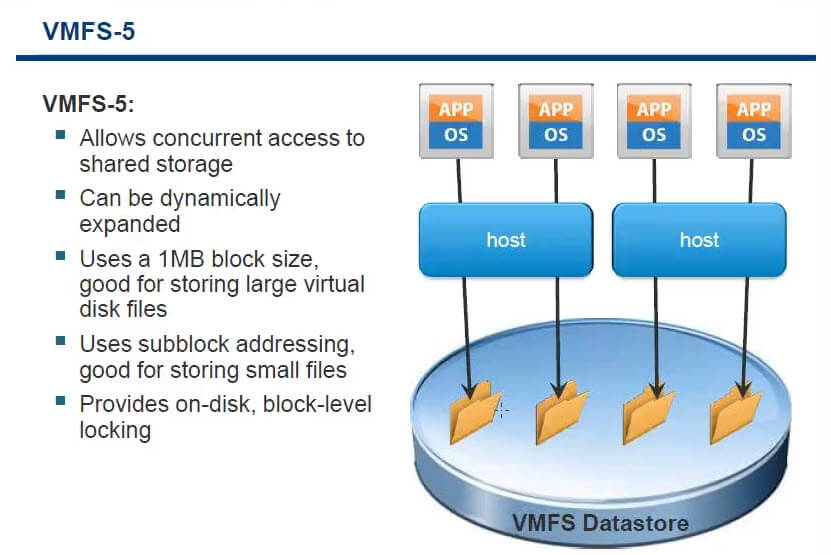

VMFS 5

И так файловая система VMFS5 самая новая на текущий момент у VMware. Основные достоинства

- Общий доступ

- Можно динамически расширять

- Размер блока 1 мб, больше нет необходимости париться про, то какой размер блока выбрать

- Блочный доступ

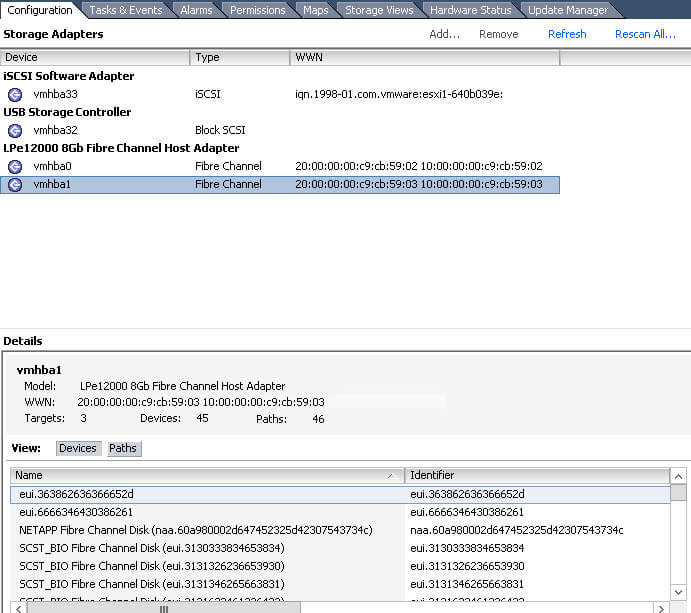

Устройства подключения к дисковым ресурсам в esxi называются как vmhba (виртуальный host bus adapter), есть ISCSI программный, есть fc как в моем случае. Посмотреть их можно в Storage Adapter. Заметьте у каждого представлен тут сразу WWN.

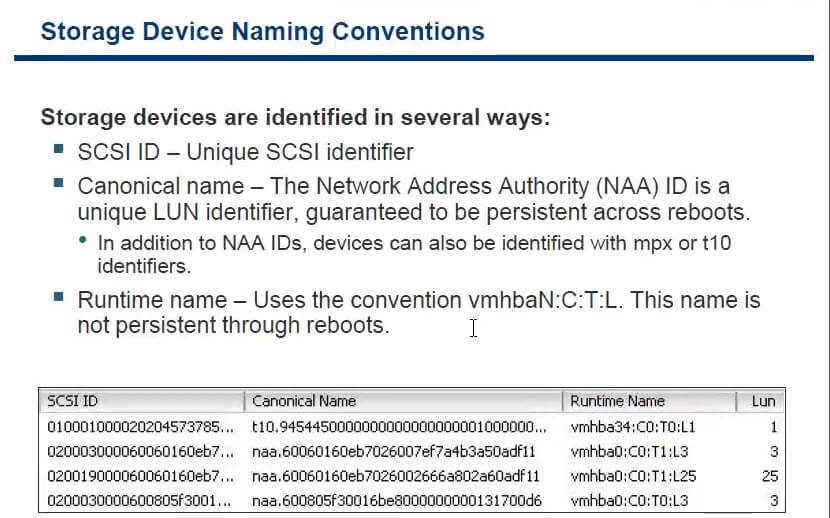

Каждый SCSI ID уникальный и имеет некое каноническое имя. Runtime name можно сравнить с WWN или mac адресом, по сути это уникальный идентификатор устройства в esxi.

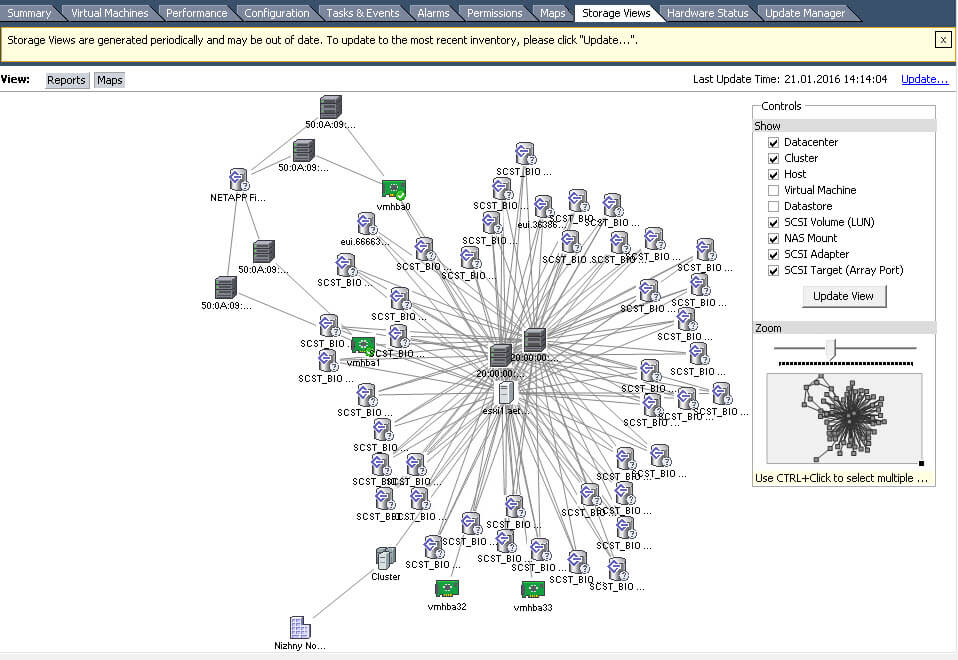

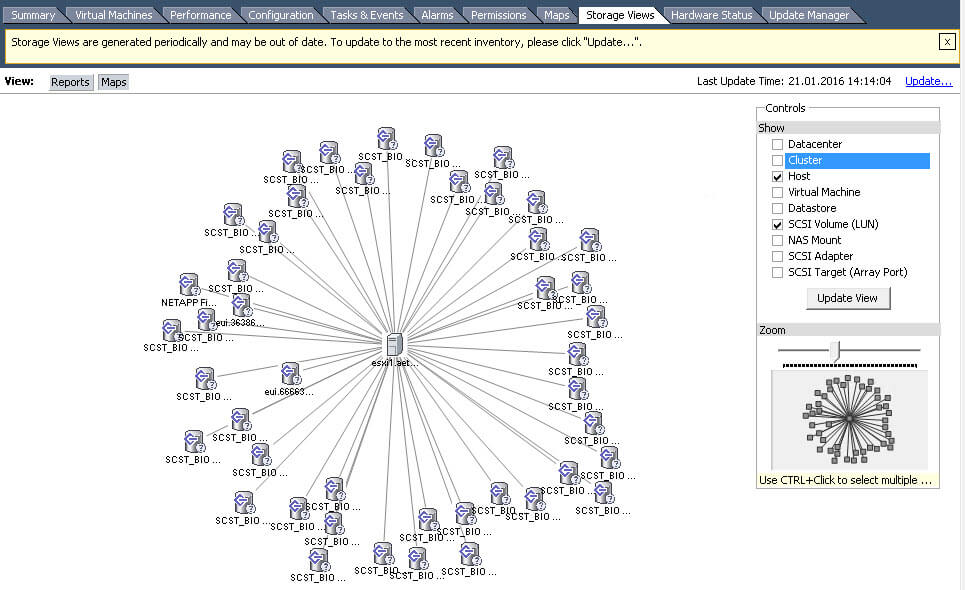

В VMware ESXi 5.5 есть очень удобная карта датасторов и устройств через, которые они подключены. Посмотреть данную карту можно в Storage Views

Удобно можно по фильтровать, убрав соответствующие галки с правой стороны.

Independent, Persistent, Non-Persistent диски

И так теперь у вас есть виртуальная машина, если вы зайдете в ее свойства то сможете обнаружить, что для каждого виртуального диска есть еще дополнительные опции

- Independent

- Persistent

- Non-Persistent

давайте смотреть, что каждый из них означает. Вот такая картинка идет по умолчанию для виртуального диска. Что это подразумевает, а то, что у вас в конфигурации стандартный виртуальный диск, на нем можно делать снапшоты ESXI, это дает возможность делаться дельте диска и данные уже писать в него. Если откатывать снапшот, то вы получите диск на момент снятия.

Independent, Persistent, Non-Persistent диски-01

Если у нас стоит Independent и Persistent. В такой конфигурации это означает, что вы не сможете создать снапшот, так как все изменения сразу пишутся на диск. При попытке его создать вас пошлют с ошибкой Cannot take a memory snapshot, since the virtual machine is configured with independent disks. Некий такой механизм защиты от снапшота,

Independent, Persistent, Non-Persistent диски-02

И последний вариант это Independent > Non-Persistent. Тут тоже не работают снапшоты. Диск необходим вот для чего. Предположим у вас есть какой, то публичный или тестовый стенд, где все что то могут поставить, до этого вы его подготовили в эталонный вид и поставили тип диска Non-Persistent, далее все начинаю херачить и ломать эту машинку, ставить там свой софт и тестить его, в итоге, у вас же нет снапшота, а откатиться хочется, этот тип диска и позволяет это сделать путем обычной перезагрузки. Хороших примеров его использования полно, главный принцип один раз настроили, что то пошло не так ребутнули и все счастливы.

Особенности VMFS-5

Улучшения VMFS-5:

Улучшена утилита vmkfstools детально покажет существующие блоки

Теперь несколько примеров по выбору размера тома VMFS:

Пример 1. Минималистичный и экономичный.

Сайзим виртуальные машины по тому VMFS по номинальному размеру дисков vmdk. Оставляем 30% тома свободным на случай снапшотов и Suspend’ов виртуальных машин.

Пример 2. Сбалансированный.

Суммируем все виртуальные машины, учитывая диски таким образом: (disk +RAM)*1.1. Считаем, что 10% от номинального размера vmdk будут исполь зоваться снапшотами, за ростом которых будет следить системный администратор. Прибавляем еще 30-35% к получившемуся размеру, которые всегда остаются свободными на случай отпуска системного администратора или создания внеплановых ВМ. Этот вариант учитывает, что файл *.vmss, содержащий RAM виртуальной машины, которая поставлена «на паузу» (suspend), не удаляется при ее старте (удаляется только после полной остановки). Поэтому, возможно, у каждой машине в папке будет лежать файл *.vmss, равный размеру номинальной RAM виртуальной машины.

Пример 3. Максимальный запас.

Сайзим виртуальные машины по формуле disk*2+RAM. Этот вариант учитывает, что для всех машин будет по одному снапшоту, эти снапшоты разрастутся до размера базового диска, и все машины когда-либо будут приостановлены. Самым волнующимся можно добавить сюда еще 30%.

так что советую в ESXI 5.5 оставлять размер блока 1 мб, и размер страйпа на RAID лучше оставлять тот что по умолчанию, так как работа контроллера заточена под него. Надеюсь вы немного разобрались с VMFS-5.

Всем привет сегодня рассмотрим, в чем разница виртуальных дисков у Vmware ESXi 5.5, разберем каждый тип диска и где его лучше применять. Виртуальные машины на платформе VMware vSphere размещаются на хранилищах Fibre Channel, iSCSI, NAS/NFS или локальных дисках серверов ESX. Диски виртуальных машин могут располагаться на томах в файловой системе VMFS (Virtual Machine File System), NFS (Network File System) или на томах RDM (Raw Device Mapping). При этом на томах VMFS и NFS виртуальные диски машин хранятся в формате vmdk, а на томах RDM виртуальная машина хранит свои данные напрямую на LUN. Сегодня мы поговорим о том, в каких форматах могут быть виртуальные диски машин в VMware vSphere, к которым обращаются серверы VMware ESXI 5.x.x

Преимущества и недостатки ISCSI

- Легкость внедрения, данная технология уже легко идет в коробке с Windows Server 2008 R2 и выше, просто компонент, настроил и забыл

- Очень дешево, не нужно ничего кроме сетевой карты

- Не нужно ничего докупать

- Расстояние подключения, довольно высокое, хоть в соседний город, но будет скорость зависимая от интернета конечно, оптике проигрывает на порядок.

- Из недостатков, скорость, ограниченная сетевой картой и скоростью коммутатора, хотя есть возможность на нем настроить LACP да и на самом target, тоже можно сделать nic teeaming, за счет чего увеличить пропускную способность

- соединение не совсем надежное, если нет дублирования конечно

- нагрузка на вычислительные мощности процессора

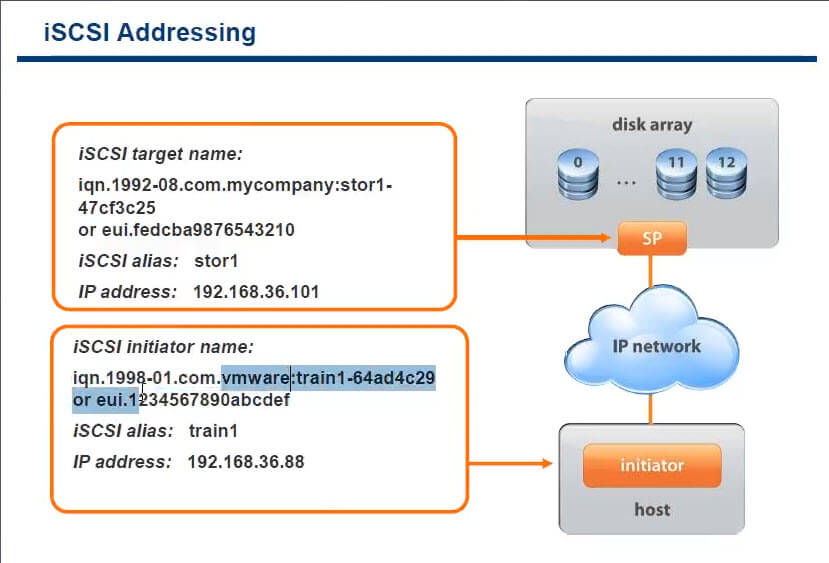

В качестве адресации в ISCSI taget или ISCSI initiator, используются аля wwn, под названием IQN. IQN это уникальный идентификатор устройства в рамках ISCSI сети.

I see bootbank cannot be found at path '/bootbank' errors being seen after upgrading to ESXi 7.0 Update 2. What's happening?

This is often because low-endurance SD or USB boot media is used. SD or USB devices have a small queue depth and due to a race condition in the ESXi storage stack, some I/O operations might not get to the device. Such I/Os queue in the ESXi storage stack and ultimately time out. For more information, see Knowledge Base article 83963.

- Upgrade to vSphere 7 Update 2c. Check out the release notes for more details.

What is supported for ESXi system storage?

ESXi 7.0 recommends a boot disk of at least 32 GB of persistent storage such as HDD, SSD, or NVMe. Use USB, SD, and non-USB flash media devices only for ESXi boot bank partitions. A boot device must not be shared between ESXi hosts.

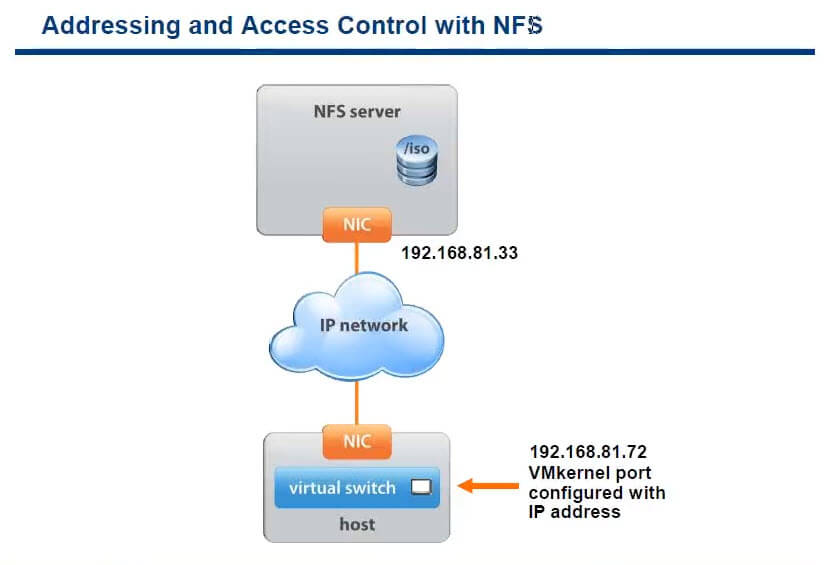

NFS компоненты

Довольно старый протокол, как его настраивать nfs в esxi я уже рассказывал, можете ознакомиться.

- Довольно легко внедряется

- не требует дополнительных вложений

- Используется для общего доступа для хостов, например датастор с дистрибутивами

- Из минусов, зависим по скорости, если скорость передачи стала слишком маленькой, встает напрочь

- Накладные расходы на передачу данных, на инкапсуляцию пакетов

Ниже представлен пример адресации NFS, схема очень простая.

Выводы

вообще не важно каким методом вы организуете дисковое пространство вашего ESXI хоста, все зависит от бюджета конечно, но помните, что в идеале все виды трафика должны быть изолированны, а в идеале находиться на разных сетевых картах, для максимальной производительности

Оптимальный размер блока esxi 5.5-01

Всем привет сегодня хочу затронуть тему как выбрать размер блока esxi 5.5. Выбор размера тома VMFS-5 для размещения виртуальных машин VMware ESXi стал уже не таким сложным с выходом ESXI 5.5.

При развертывании виртуальной инфраструктуры серверов VMware Virtual Infrastructure, один из основных вопросов, который встает перед администраторами и CIO – это выбор правильной системы хранения и необходимого дискового пространства. От правильного сайзинга виртуальных машин по томам VMFS зависит в будущем то, насколько производительной и гибкой будет виртуальная инфраструктура.

Ниже приведем основные рекомендации по созданию хранилищ VMFS для виртуальных машин в части выбора их размера и правильной конфигурации.

Итак, для начала несколько рекомендаций:

- Помните, что лучшей практикой является создание одного тома VMFS для одного LUN. Добавление дополнительных LUN в качестве экстентов (extents) не рекомендуется.

- Для уменьшения риска необходимости расширения тома VMFS при создании снапшотов и прочих непредвиденных обстоятельств виртуальные машины размещаются таким образом, что 30% тома VMFS должны оставаться свободными.

- Да улучшения производительности на одном VMFS-томе размещаются от 5 до 15 виртуальных машин на LUN. Не рекомендуется размещать более 30 виртуальных машин.

- Создавайте все LUN унифицированного размера, например, по 1024 ГБ или 2048 ГБ. Не храните ISO-образы на дорогих FC LUN – используйте для этого NFS-шары.

- Уделите особое внимание выбору размера блока при создании тома VMFS.

- Для маленьких LUN необходимо учитывать, что метаданные тома VMFS также занимают некоторое дисковое пространство. Объем метаданных, расположенных на томе VMFS вычисляется по следующей формуле:500Мб + (x – 1)*(0.016Кб), где x-объем, выделенный тому VMFS в гигабайтах.Например, для тома емкостью в 200 Гб объем метаданных будет равен:500Mб + (200 - 1) (0.016Кб) = 503.184 Мб

Оптимальный размер блока esxi 5.5

- Для доступа к одному тому VMFS используйте не более 10-15 хостов. При большем количестве хостов ESXi в вашей инфраструктуре – лучше создать два кластера DRS / HA во избежание проблем с производительностью. Если у вас виртуальные машины с большими требованиями к I/O (серверы БД), не используйте более 8 хостов ESXi на том VMFS.

- Одним из важных параметров является размер очереди к диску (Disk Queue). Если вы мигрируете существующие ВМ в виртуальную среду – необходимо сначала изучить размеры средней очереди к диску систем и распределить их потом по LUN так, чтобы средние значения дисковой очереди на LUN были приблизительно одинаковы. Провести такое обследование (Virtualization Assessment) может авторизованный консультант (VMware Authorized Consultant, VAC), который использует ПО VMware Capacity Planner для централизованного сбора информации об Inventory и загрузках физических серверов.

- Занимаемое пространство виртуальной машиной на томе VMFS может рассчитываться исходя из формулы disk*2+RAM. RAM понятно для чего – на случай приостановки (suspend) виртуальной машины. Дисковое пространство умножается в два раза исходя из учета возможного создания «снэпшота» виртуальной машины, файл отличий которого может увеличиться до размера базового диска. Почему так? Да потому, что NTFS работает таким образом: при записи файлов на диск сначала используются полностью свободные блоки, а только после того, как они закончились – блоки, которые помечены как свободные. То есть при записи файлов – vmdk разрастается, а при удалении – размер не уменьшается.Таким образом, файл отличий vmdk, который из гостевой ОС видится как диск размером с базовый, быстро вырастет до его размера, и у нас получится два диска исходного размера. Это происходит еще и потому, что Windows постоянно производит запись и удаление чего-то на диск – например, работает с файлом подкачки.Кроме того, очень важный момент – резервное копирование виртуальных машин средствами VMware Consolidated Backup (VCB), который пользуется технологией снапшотов. Иногда VCB забывает удалить снапшот виртуальной машины после того, как отработает, и этот снапшот продолжит расти.

- Отдельная история, если вы планируете внедрить Virtual Desktop Infrastructure (VDI) на базе, например, продукта VMware View. При использовании технологии Linked Clones, которая предоставляется средствами VMware View Composer и позволяет создавать несколько ВМ с файлами отличий от базового образа виртуального диска, отдельное внимание нужно уделить быстродействию системы хранения. Поскольку пространство под виртуальные диски связанных клонов выделяется динамически (блоками по 16 МБ) – это вызывает дополнительные операции по резервированию LUN хостом ESXi. Таким образом, если таких клонов много – система хранения начнет испытывать проблемы с производительностью.

Why do I see persistent storage warnings on my ESXi hosts?

Starting in vSphere 7 Update 3, when ESXi hosts are booted from a USB or SD device, and are not equipped with an additional local HDD or Flash media (NVMe or SSD) to store the OSData partition, ESXi displays displays one of the following warnings:

"Secondary persistent device not found. Please move installation to persistent storage as support for SD-Card/USB only configuration is being deprecated."

"Please add a secondary persistent device. Support for SD-Card/USB only configuration is being deprecated."

"Scratch is configured to SD-Card/USB device. This may result in system failure. Please add a secondary persistent device."

See KB article 85615 for more details.

I can't retrofit local storage media, how do I mitigate?

If local storage is not present there are still ways to make sure logs are stored, by using external Syslog solutions, NetDump Collector or Core Dump Partition. See this article how to enable Syslog on ESXi hosts.

Диски типа Thin (тонкие диски)

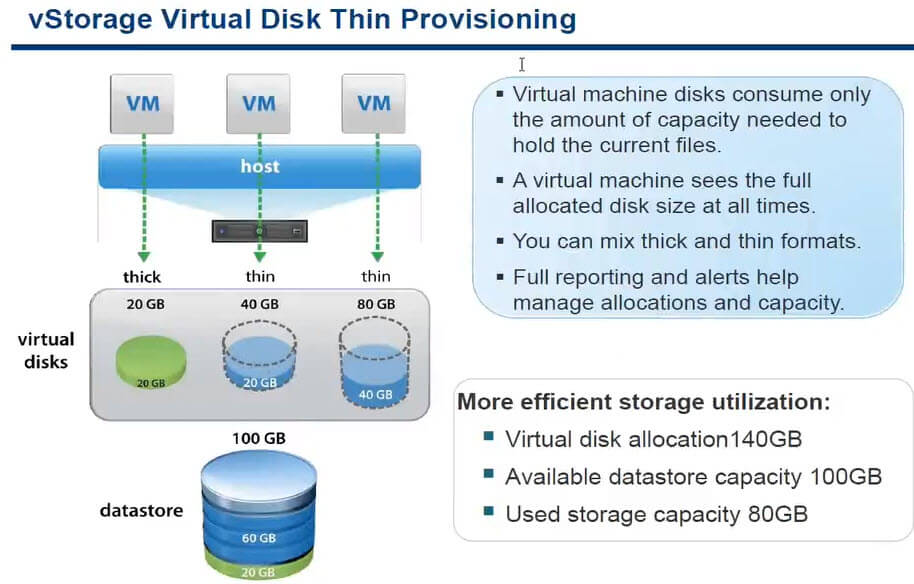

Эти диски создаются минимального размера и растут по мере их наполнения данными до выделенного объема. При выделении нового блока - он предварительно очищается. Эти диски наименее производительны (выделение нового блока и его очистка), однако наиболее оптимальны для экономии дискового пространства на системе хранения данных. Чаще всего их используют в тестовых средах и стендах, где нужно по экономить дисковое пространство или же для разработки.

На слайде пример виртуальной машины с тремя дисками общего объема 140 ГБ, а по фату на датасторе используется 80 гб.

Хочу заметить, что не важно какой у вас диск Thick disks, Zeroed thick disks, Eager zeroed thick disks, thin, рано или поздно они при заполнении до одинакового размера будут по скорости идентичны

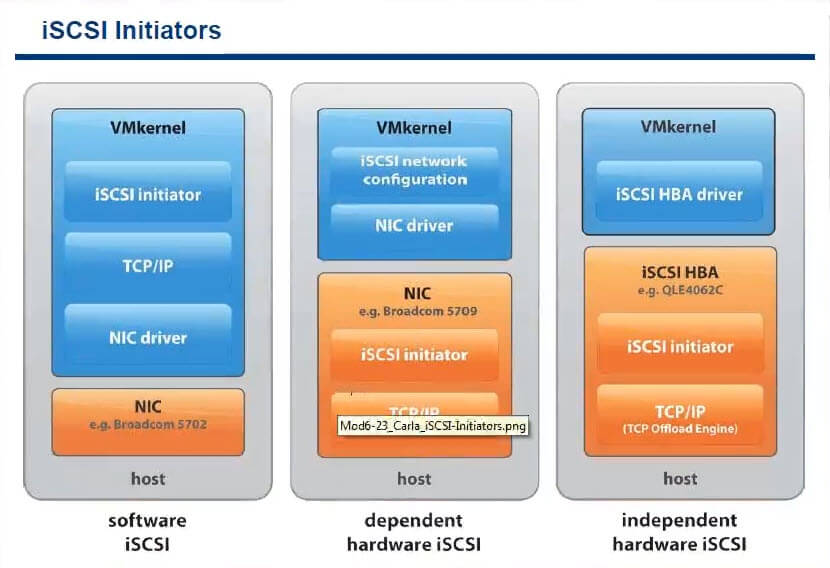

Виды ISCSI initiators

- Софтовые идут в комплекте ESXI или Windows например

- Физические зависимые > тут инкапсуляция и обработка трафика делается карточкой, но все равно используется процессор

- Физические не зависимые > тут весь ISCSI трафик обрабатывается за счет мощностей железки, тем самым снимая нагрузку с CPU.

Can I add local storage after I upgrade to ESXi 7?

Yes. It is good practice to equip ESXi hosts with recommended local storage media. When adding local storage after upgrading to ESXi 7, enable the advanced setting autoPartition=TRUE and reboot the ESXi hosts as described in KB article 77009 to mitigate the persistent storage warnings.

Persistent Storage Warnings

Ограничения подключений

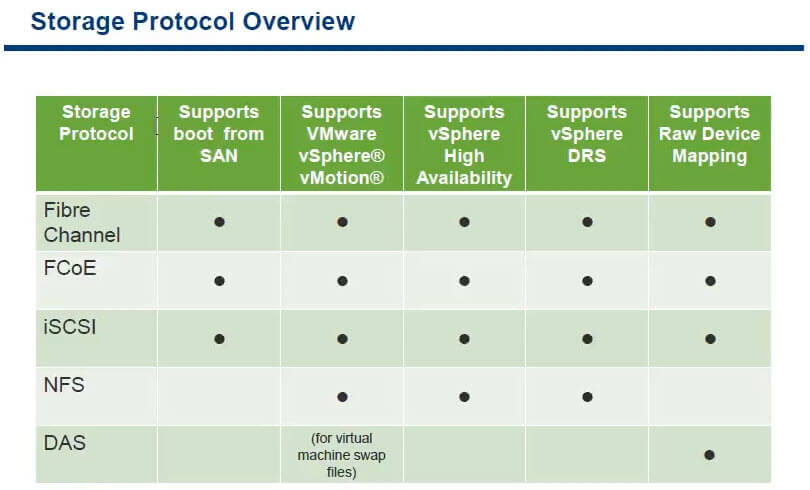

Как известно каждый метод подключения несет в себе как плюсы так и минусы, один что то умеет, а второй нет. Ниже мы рассмотрим сводную таблицу, в которой отражены виды подключений и какие функции vCenter в них работают.

Как можно заметить что загружаться с СХД (SAN) могут только FC, ISCSI и FCoE, NFS это не умеет так как работает не на блочном уровне, а на файловом. Ниже я расскажу, в чем разница. Первая тройка поддерживает все фишки vCenter

В чем разница, блочный в большинстве случаев быстрее, простой пример вам нужно прочитать 1 блок файла в 100 мб, при блочном доступе вы получите нужный блок сразу, при файловом доступе вы должны считать файл полностью и только потом получить нужную часть файла.

NFS по некоторым пунктам отстает, DAS как вы сами понимаете, логично что их не использует, так как по сути это собственные диски вставленные в сервер с гипервизором.

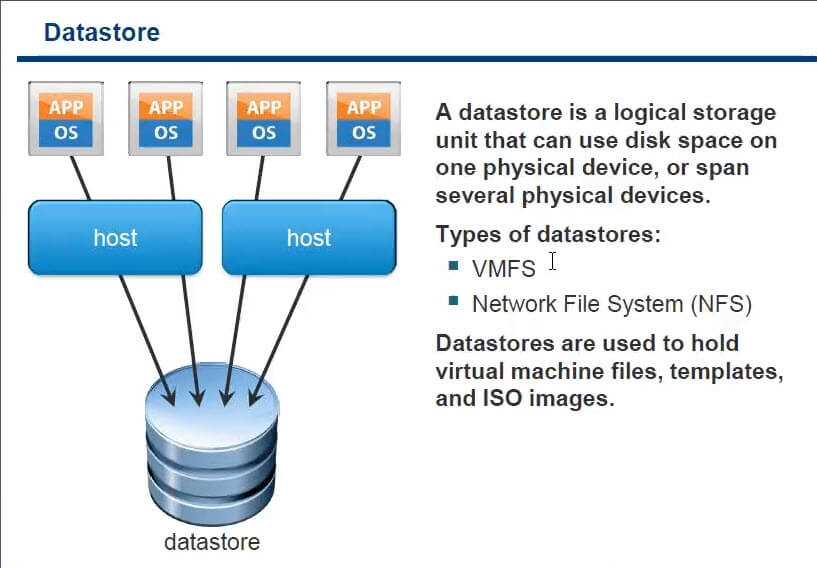

После того как вы разметили lun у вас он будет либо формата vmfs либо nfs. Если вы подключили NFS шару, она не отформатируется в VMFS а будет именно NFS. Ниже представлен скрин, как работаю виртуальные машины на datastore. Есть приложение в ОС, которое крутится в виртуалке, та в свою очередь работает на определенном хосте и хранит свои файлы виртуальной машины на определенном datastore.

I'm using SD or USB boot media to boot my ESXi hosts, what are immediate actions that I can take to prevent such issues?

- SD cards or USB drives should only be considered to store the system boot and boot bank partitions. The ESX-OSData partition must be created on persistent storage.

- In any case, if a SD or USB device is used for boot media (only SD/USB or SD/USB + local hdd/ssd disk), follow the below instructions to reduce the amount of IO sent to the SD or USB boot media:

- Ensure the /scratch partition is configured on persistent storage like a local hdd/ssd or boot from SAN device. The ESXi 7.0 installer will not create the /scratch partition on a SD card or USB drive. It tries to find persistent storage and attempts to create /scratch on that.

- If there is no supported persistent storage available, a 250 MB /tmp partition is created on a ramDisk. This may limit the performance of ESXi hosts if this partition runs out of space.

- Do not create the /scratch partition on the SD or USB boot media in any case. Running the /scratch partition on the SD or USB boot media is not supported by VMware. Always configure /scratch on locally attached disk (HDD or SSD). If the local disk is not available, then configure it on a SAN.

- It is good practice to connfigure ESXi Dump Collegator to offload core dumps. .

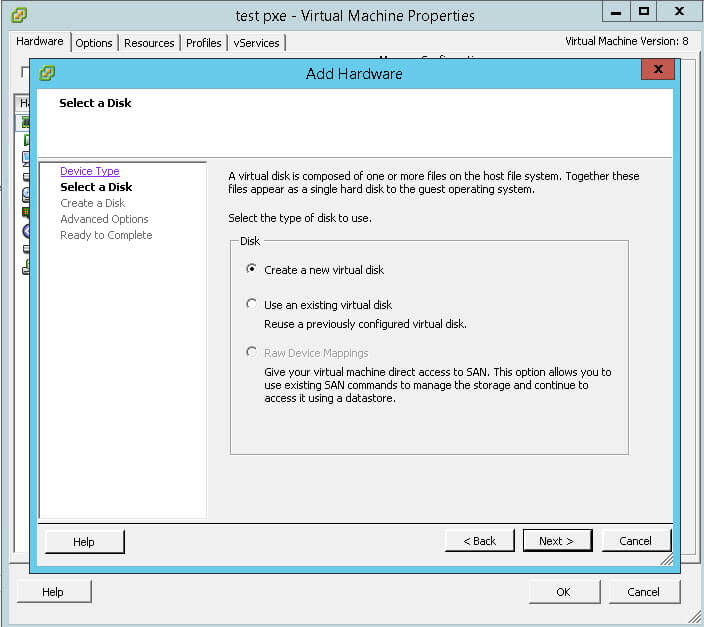

Диски типа Thick (толстые диски)

Это тип дисков vmdk на томах VMFS или NFS, размер которых предопределяется заранее (при создании) и не изменяется в процессе наполнения его данными. Давайте добавим для примера новый виртуальный диск.

Никогда без веской необходимости не создавайте IDE диски, так как они не расширяются на лету и без геморроя и медленнее SCSI

![Thick disks]()

Существует три типа дисков thick:

![Thick disks-2]()

Thick disks

Все пространство диска выделяется в момент создания, при этом блоки не очищаются от данных, которые находились там ранее. Это может создавать потенциальные угрозы безопасности, поскольку виртуальная машина может получить доступ к данным на хранилище VMFS, которые ей не принадлежат. При обращении к блокам такого диска их содержимое предварительно не очищается со стороны ESX. Преимущество дисков типа thick - производительность и быстрота создания, недостаток - безопасность

Zeroed thick disks (lazy zeroed thick disks)

Все пространство такого диска выделяется в момент создания, при этом блоки не очищаются от данных, которые находились там ранее. При первом обращении виртуальной машины к новому блоку происходит его очистка. Таким образом, эти диски более безопасны, однако при первом обращении к блоку - теряется производительность системы ввода-вывода на операцию очистки. При последующих обращениях - производительность идентична дискам типаEager zeroed thick. Этот тип диска создается по умолчанию через VMware vSphere Client для виртуальных машин. Преимущество дисков Zeroed thick disks - безопасность и быстрота создания, недостаток - производительность при первом обращении к блоку.

Eager zeroed thick disks

Все пространство такого диска выделяется в момент создания, при этом блоки очищаются от данных, которые находились там ранее. Далее происходит обычная работа с блоками без очистки. Преимущество такого диска - производительность и безопасность, недостаток - долгое время создания.

I'm experiencing VMFS-L Locker partition corruption on ESXi hosts. What's happening?

This is likely be the result of using low-endurance SD or USB boot media for ESXi hosts. Files, for example vmtools, which are read from time to time by virtual machines could cause corruption of the SD or USB boot media due to things like read-disturb symptoms where neighbouring flash cells get affected from the read activity. This means that even though you might be reading from one sector, it could affect other sectors that have not been accessed in the flash device - hence we see filesystem metadata sectors getting corrupted.

We can reduce heavy access to SD or USB boot media by the steps explained in Knowledge Base article 83376. This article details how the ToolsRamdisk advanced options is used to copy vmtools, which exists on the SD or USB boot media, to a RAMdisk. This behaviour is of mainly seen on vSAN or VDI environments.

Различия между созданным с нуля и обновленным хранилищем на VMFS-5

Хранилища, обновленные до VMFS-5:

RDM — Raw Device Mappings

- Максимальный размер для passthru RDM 60ТБ.

- Максимальный размер для non-passthru(virtual) RDM 2ТБ — 512 байт.

- Обновленный до VMFS-5 хранилища также поддеживают большие passthru RDM.

Хочется напомнить об оставших ограничениях:

Максимальный размер VMDK-файла равен 2ТБ — 512 байт.

Максимальное количество LUN равно 256.

Рекомендация

Рекомендуется создавать VMFS-5 тома с нуля для получения максимального эффекта, миграцию с VMFS-3 оcуществлять посредством Storage vMotion.

What do these warnings mean?

In summary, the warnings mean the ESXi host is in a state where logs and state might not be persistent (get lost when the host is rebooted), with a side effect that it can cause boot up to be slower.

With new features and capabilities like vSphere Lifecycle Manager, vSAN, and NSX-T, the way VMware approaches ESXi host installations have changed. More and more features and capabilities will rely on host local storage for additional kernel modules, but also for state information like PCIe mappings and SSL certificates.

ESXi System Storage

What is recommended for ESXi system storage?

Looking ahead, there will be new features that require ESXi hosts with high-quality persistent storage (local hdd/ssd or boot from SAN). The recommended ESXi 7.0 install options are the following:

- A disk with a minimum of 32 GB. The disk contains the boot partitions and ESX-OSData volume.

- A disk of 138 GB or larger. The disk contains the boot partitions and ESX-OSData volume.

- A disk of 142 GB or larger. The disk contains the boot partitions, ESX-OSData volume, and VMFS datastore.

ISCSI компоненты

И так ранее я рассказывал как подключить iscsi диск к VMware ESXI 5.5, ознакомьтесь кто хочет попрактиковаться, мы же рассмотрим как это работает. И так есть сервер на котором установлена, не важно какая операционная система, она предоставляет нарезанные луны, нарезанные на физических дисках. У данного сервера есть такой параметр (адрес) ISCSI target, цель к которой мы будем подключаться. Далее по обычной ethernet сети, по TCP/IP, хост с гипервизором, подключается к ISCSI targe, за счет ISCSI Initiators (софтового или железного о них ниже). В итоге хост получает нужные ему lun, форматирует их и все.

Are USB/SD boot devices recommended?

Legacy SD and USB devices are not recommended. Legacy SD and USB devices are supported with some limitations listed below. To chose a proper SD or USB boot device, see Knowledge Base article 82515.

What happens to the system storage layout when I upgrade my ESXi hosts to vSphere 7?

The ESXi system storage requirements are also applicable for ESXi upgrades (6.x > 7). However, the boot media requirements differ between a new vSphere 7 install, and an upgrade to vSphere 7. There’s a requirement for boot media to run a 4 GB storage device at minimum, when upgrading to vSphere 7. Even though 4 GB boot media devices are supported, it is strongly recommended to adhere to the boot media requirements for a fresh vSphere 7 installation. Check out this article for detailed information.

What has changed for ESXi system storage?

We have increased the boot bank sizes, and consolidated the system partitions and made them expandable. This article details these changes introduced with vSphere 7 and how that reflects on the boot media requirements to run vSphere 7.

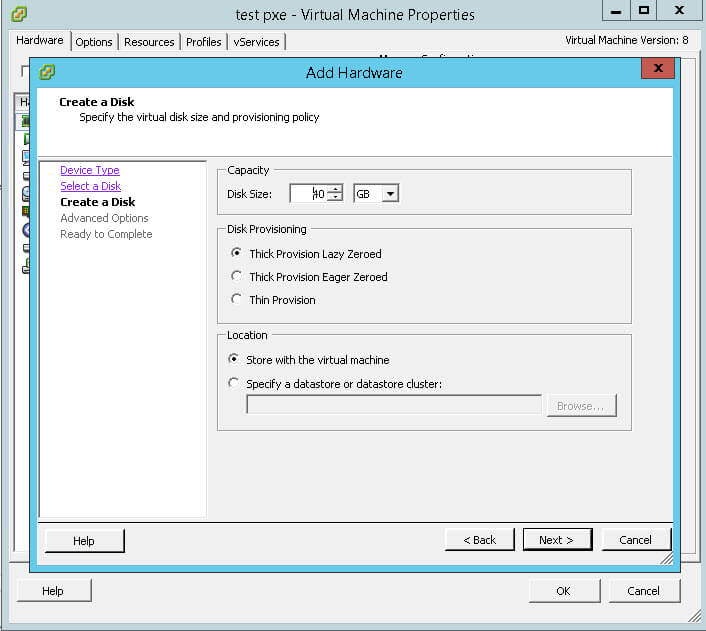

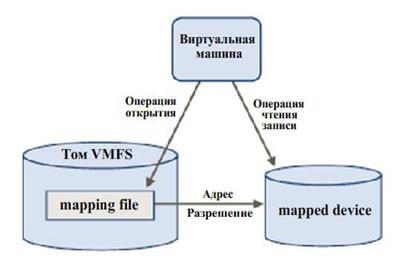

Диски типа Raw

Файловая система VMFS поддерживает схему Raw Device Mapping (RDM), которая представляет собой механизм для прямого доступа виртуальной машины к дисковой подсистеме (конкретному LUN) устройств хранения Fibre Channel или iSCSI. Этот тип виртуального диска доступен для создания из vSphere Client.

Если в сети хранения данных используется ПО для создания мгновенных снимков системами резервного копирования, которые запущены в виртуальных машинах, требуется прямой доступ к дисковой подсистеме устройств хранения. Кроме того Raw-диски используются для кластеров Microsoft Clustering Services (MSCS), включая кластеры типа «виртуальный-виртуальный» и «виртуальный-физический».

Но RDM не используется для повышения производительности - его производительность аналогична дискам vmdk в файловой системе VMFS.

RDM может обеспечиваться путем предоставления символьной ссылки в томе VMFS к разделу Raw (режим виртуальной совместимости). В этом случае файлы маппирования, относящиеся к конфигурации виртуальных машин, отображаются как файлы в томе VMFS в рабочей директории виртуальной машины. Когда том Raw открывается для записи, файловая система VMFS предоставляет доступ к файлу RDM на физическом устройстве и реализует через него механизм блокирования и контроля доступа. После этого операции чтения и записи идут напрямую к тому Raw, минуя файл маппирования.

Файлы RDM содержат метаданные, используемые для управления и перенаправления доступа к физическому устройству. RDM предоставляет возможности прямого доступа к дискам, при этом сохраняются некоторые возможности, присущие файловой системе VMFS. Схема взаимодействия виртуальной машины с устройством хранения посредством механизма RDM изображена на рисунке:

![Описание типов виртуальных дисков vmdk виртуальных машин на VMware vSphere ESXI 5.x.x-01]()

Описание типов виртуальных дисков vmdk виртуальных машин на VMware vSphere ESXI 5.x.x-01

Перед началом операций ввода-вывода виртуальная машина vmware посредством файла маппирования инициирует открытие тома Raw. Далее файловая система VMFS осуществляет разрешение адресов секторов физического устройства, а виртуальная машина начинает производить операции чтения-записи на физическое устройство.

Используя RDM возможно производить следующие операции:

- «горячая» миграция виртуальных машин посредством VMotion на томах Raw;

- добавлять новые тома Raw с помощью VI Client;

- использовать возможности файловых систем, такие как распределенное блокирование файлов, установка разрешений и именование;

Для RDM используются два режима совместимости:

- Режим виртуальной совместимости, который позволяет производить маппирование файлов виртуальных дисков, включая возможности создания мгновенных снимков системы хранения. При таком режиме выбирается том VMFS, на котором будет храниться файл маппирования и том, где находится файл конфигурации виртуальной машины.

- Режим физической совместимости, позволяющий приложениям получать низкоуровневый доступ к SCSI-устройствам, при этом наличие файла маппирования не требуется.

Использование функций VMotion, DRS и HA поддерживаются в обоих режимах совместимости.

Читайте также: