Hdd fc что это

"Имья, сестра, имья!"© Три мушкетера.

Без конкретной марки и производителя сказань нельзя.

сетевая карточка по оптике или хаб -- диск будет виден в сети как компутер с расшареным винтом =в мануале описан ip адрес обратясь из броузера получишь веб страничку для настройки = не выгодно тк на твоей машине процессор будет разбирать собирать ip-пакеты.

или наоброт выгодно. если это просто мусорник без головной боли.

Специализированая карточка -- изнутри компьютера видна как дисковый скази интерфейс и имеет оптческий шнурок к диску.

Винт с FiberChannel будет виден как сетевое устройство при подключении к сетевой карте по оптике. Это откуда такая информация?

Кстати, бывает и не оптический FiberChannel

штатный злобный буратино форума

Это изза КРАЙНЕ НЕПОЛНОГО ВОПРОСА.

Я его дешифровал как HDD МАССИВ (коробочка такая не маленькая набиваемая винчестерами).

Одиночный винт с оптикой интерфейсом. "Месье знает толк в извращения"©Анекдот.

для подключения FC массива нужна соответственно FC карточка (copper или optical). а отдельные HDD с FC интерфейсом надо втыкать в массив FC, который собственно к компу и цепляетсяю.

А интерфейс FC намного ближе к SCSI нежели к IP и не знаю где это Gradov_Georg вычитал про веб странички и IP пакеты. У FC массивов такие же LUNы и ID как у SCSI.

штатный злобный буратино форума

Вай вай вай. Напали. Обругали.

во первых я написал ДВА РАЗНЫХ ВАРИАНТА. Один через ip второй через то карточку которая видна как SCSI изнутри машины.

Во вторых не вычитал, а выслушал недалее как прошлый четверг на семинаре SuperMicro от ихнего китайца. и вообще у меня уже два дня бегает 1,2Террабайта ихних. Не могу нарадоваться.

А марку отдельного винчестера с FC мне никто так и не назвал?

Сенсей для друзей по NLE

А марку отдельного винчестера с FC мне никто так и не назвал?

штатный злобный буратино форума

интересно было починать об этом семействе. возраст у него приличный 1998 год.

ST-39102FC Fibre Channel FC-AL, Dual Port (Cheetah 9LP)

Выделеное это его интерфейс -- соответвенно надо искать что-то вроде "PCI to FC-AL hard drive"

===========

FC and NT

Several vendors support FC in the NT market. Adaptec and Emulex have FC cards with drivers for NT, and Raidtec has a complete FC hard drive setup: Raidtec hard drive enclosure, an Emulex LightPulse PCI FC Host Adapter card, and Seagate FC-AL hard drives. Some manufacturers are producing hard drives for use in FC arrays. Unfortunately, no hardware-based FC RAID solutions are currently available. If you want RAID, you must use the slower, software-based RAID that is included with NT Server.

============

это для настройки. почти у любого массива внешнего с поддержкой RAID есть COM port или ethernet для настройки, но к производительности никакого отношения он не имеет. по нему данные с винта не качаются и при чем тут сбор пакетов и замедление работы?

диски FC есть и новые. например ST3146707FC

они такие же как SCSI по механике, только контроллер другой

а насчет NT - ты бы еще старее документацию взял - про NT 3. может чего еще интересного вычитаешь. современные массивы поддерживают RAID, например adaptec SANbloc 2Gb RAID

штатный злобный буратино форума

Внешние рейд массивы бывают РАЗНЫЕ -- индивидуального грубо говоря "внутрикопьютерного" и СЕТЕВОГО использования.

СуперМикро представила уже и универсальные на оптике -- один чемодан с 4 портами которые могут работать одновременно 2 меди+две оптики =

= ОПТИКА работает И как независимый сервер -- включай в хаб и используй "коллективно" или прямо в сетевую на "персональном" компьютере ИЛИ ЖЕ ПОСТАВЬ SCSI-to-FC-AL карточку в персональный компьютер.

В персональном включении и РЕКОМЕНДУЕТСЯ дабы твоя машина не гробила время IP ставить не сетевую, а SCSI-to-FC-AL карточку -- хотя никто не запрещает использовать сетевую.

А для "чиста служебки" у них и телефонный модем встречается.

Доку какую уж нашел в 3 часа ночи нашел по исходным данным ту и показал. я подобные вещи предпочитаю покупать целиком с гарантией -- отсутвие документов на отдельные платы тоже об этом говорят.

"Fibre Channel, HDD с интерфейсом Fibre Channel -- Как можно подключить к компу это устройство ?"

После бурных обсуждений автор уточнил только марку винта Seagate ST39102FC.

из чего я и искал только ПЛАТУ -- что нашел с доступной докой то и выложил.

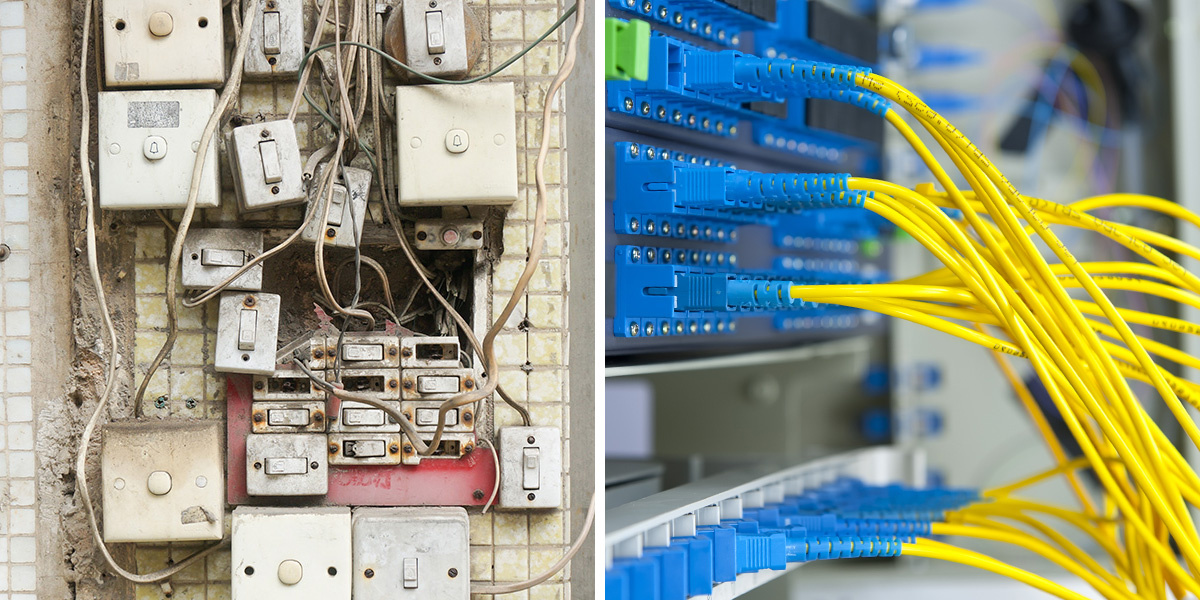

Сначала был компьютер. Первый, он же и единственный. Боже, как это было просто. Все данные хранились где-то глубоко в его недрах, и если их там не было,

то их не было вообще. Потом появились сети, призванные объединить такие компьютеры для совместной работы. На этом эпоха централизованного хранения завершилась, потому что для повышения производительности гораздо удобнее оказалось приблизить ресурсы поближе к рабочим группам. Таким образом, в попытке минимизировать сетевую нагрузку накопители информации были были равномерно разделены между множеством серверов и настольных компьютеров.

В итоге, сейчас мы имеем то, что имеем, и какой бы простой не являлась сеть, в ней одновременно существуют два канала передачи данных. На виду всегда сетевой канал, т. е. собственно сеть, по которой идет обмен между клиентами и серверами. Вместе с тем существует и второй канал, по которому происходит обмен данными между системной шиной компьютера и собственно устройством хранения. Это может быть канал между контроллером и жестким диском, если говорить в терминах ПК, или между RAID-контроллером и внешним дисковым массивом, как в случае сколь-нибудь серьезного сервера.

Такое разделение каналов во многом объясняется различными требованиями к пересылке данных. В сети на первое место встает доставка нужной информации одному клиенту из множества возможных, для чего необходимо создать определенные и весьма сложные механизмы адресации и некий «сетевой этикет» при одновременной работе всех клиентов. В итоге, перед каждой пересылкой по сети приходится выполнять ряд неизбежных процедур в соответствии с объявленными правилами и сознательно мириться с возникающими при этом задержками и снижением пропускной способности сетевого канала. Кроме того, сетевой канал предполагает значительные расстояния, поэтому здесь предпочтительна передача данных по последовательному соединению.

А вот канал хранения выполняет крайне простую задачу, предоставляя возможность обмена с заранее известным накопителем данных. Единственное, что от него требуется — делать это максимально быстро. Расстояния здесь, как правило, небольшие, поэтому производители могут использовать более дорогой кабель для параллельной передачи данных.

Если звезды зажигаются…

В последнее время в воздухе снова витает идея централизации. Или же, если угодно, то ее можно назвать концепцией истинно разделяемых ресурсов, где накопители не принадлежат никому конкретно, а могут напрямую использоваться любым другим ресурсом сети. Актуальность централизации во многом определяется осознанием все увеличивающейся роли хранения данных в современной вычислительной среде. Разве не заманчиво иметь возможность двигать устройства хранения в сети, как шахматные фигуры, и не привязывать их жестко к шинам ввода-вывода отдельных компьютеров?

Предполагается, что такая схема улучшит производительность и масштабируемость вычислительной среды вместе с более легким администрированием, а также повысит доступность данных. В итоге, мы вправе ожидать существенного снижения стоимости владения данным ресурсом, что справедливо ставится во главу угла финансовыми службами.

Очевидно, что всего этого можно добиться, если интегрировать накопители в сеть наряду с серверами, клиентскими машинами и прочими принтерами, т. е. использовать для этого существующий сетевой канал. К сожалению, после такого шага сеть просто впадет в кому, подавая лишь слабые признаки жизни. Конечно, если бы мы до сих пор использовали MS-DOS или все разом перешли на Linux, то с ними сетевой канал еще бы справлялся, но ведь по совершенно необъяснимым причинам пользователи предпочитают монстров типа Windows NT, да еще и пытаются передавать по этому же каналу потоковое видео.

В то же время существующему каналу хранения такие нагрузки по зубам, но вряд-ли в нынешнем виде он подходит для реализации истинно разделяемых ресурсов. Если обратиться к физической реализации такого канала, то самым сильным игроком здесь был и остается старый добрый параллельный SCSI, но при всей нашей любви к нему необходимо признать существенные ограничения на допустимую длину физической линии. Дело в том, что волновые характеристики отдельных проводников слегка отличаются, поэтому при передаче на большие расстояния возникает дифференциальная задержка в виде неодновременного прихода импульсов по разным сигнальным парам. В итоге получаем не более 25 метров даже при использовании дифференциального интерфейса HVD. Кроме того, передача по параллельному кабелю влечет за собой дополнительные расходы вследствие большей сложности монтажных работ, а также высокой стоимости используемых кабелей и коннекторов.

Fibre channel — хорошо забытое старое

Исходя из присущих параллельному соединению ограничений, сама идея использовать последовательную линию для канала хранения выглядит не такой уж и безумной, как это могло показаться с первого раза. Совершенно не зря говорят, что технический прогресс развивается по спирали. Если заглянуть в мир mainframe, то там практически с самого начала живет разработанный IBM стандарт последовательной передачи под названием ESCON (Enterprise Systems Connection) с использованием запатентованной IBM кодировки 8b/10b.

Когда в 1988 году ANSI (Американский Национальный Институт по Стандартизации) зарегистрировал рабочую группу по разработке «практичного, недорогого и вместе с тем расширяемого метода для высокоскоростного обмена данными между ЭВМ, суперкомпьютерами, рабочими станциями, персональными компьютерами, накопителями и устройствами отображения», мало кто из сторонних наблюдателей верил в успех, слишком уж глобальна и вызывающе звучала постановка задачи. Возможно, именно из-за такой недооценки потенциального соперника IBM с легкостью выдала лицензию на кодировку 8b/10b без отчислений владельцу (royalty-free license).

К тому времени парадигма Network (сетевое соединение) — Channel (шина ввода/вывода) была уже столь очевидна, что новый метод было решено назвать Fiber Channel. Через некоторое время разработчики спохватились, что английское слово Fiber слишком уж сильно ассоциируется с оптоволоконными линиями, поэтому оно было заменено на французскую (или британскую) транскрипцию Fibre. Учитывая, что основной топологией этого метода была избрана петля с арбитражным доступом (Arbitrated Loop), то его полное название составило Fibre Channel Arbitrated Loop или FC-AL.

Самое смешное, что после некоторых раздумий корпорация IBM тоже бросилась вдогонку, разработав свой собственный метод последовательной передачи под названием SSA (Serial Storage Architecture). Видимо, хотели сделать собственный закрытый стандарт, но получилось, как с микроканальной шиной MCA — основная масса разработчиков и производителей предпочла открытую архитектуру.

При всем богатстве выбора…

Таким образом, в настоящее время канал хранения может быть построен на основе нескольких интерфейсов передачи данных, три из которых описаны в стандарте на архитектуру SCSI-3. На верхнем (программном) уровне они используют один и тот же метод общего доступа (Common Access Method — CAM) и отличаются лишь на уровне реализации архитектурной модели (SCSI Architecture Model - SAM). То, что мы до сих пор столь привычно называем SCSI, по-прежнему использует параллельную архитектуру передачи SPI (SCSI Parallel Interface) и имеет коммерческое название UltraSCSI или Ultra2 при использовании архитектурной модели SPI-2. Кроме параллельного SPI, в стандарте SCSI-3 описаны еще и два последовательных интерфейса — Fibre Channel и SSA, отличающиеся лишь реализациями архитектурных моделей. Не стоит также забывать про старые добрые ESCON для мэйнфреймов и HIPPI (High Performance Parallel Interface), первоначально разработанный для суперкомпьютеров Cray.

| Ultra2 | FC-AL | SSA | HiPPI-Pp2 | ESCON |

|---|---|---|---|---|

| полудуплекс | полный дуплекс | полный дуплекс | полудуплекс | полудуплекс |

| параллельный (34 пары) | последовательный | последовательный | параллельный (100 пар) | последовательный |

| 80 MBytes/s | 200 MBytes/s | 80 MBytes/s | 80 MBytes/s | 17 Mbytes/s |

| SCSI CAM | SCSI CAM, IP, VI, HiPPI-FP, ESCON, IPI, ATM, Ethernet, FDDI, Token Ring | SCSI CAM | HiPPI-FP, IPI | ESCON |

| 25 метров | 10 километров | 20 метров | 25 метров | 400 метров |

Как видно из приведенной таблицы, по сумме вышеперечисленных характеристик FC-AL выглядит явным фаворитом. Правда, справедливости ради стоит отметить новый HiPPI-800, который, несмотря на свое название High Performance Parallel Interface, также использует последовательную передачу данных и имеет во многом сходные характеристики канала (до 10 км, полудуплекс при эффективной полосе пропускания 80 Mbytes/s).

Мы совершенно сознательно не считаем разработанную IBM технологию SSA сколь-нибудь серьезным соперником технологии FC-AL. Не станем пока вдаваться в технические детали, о которых вдоволь поговорим позже, а сфокусируемся лишь на маркетинговых вопросах. В свое время инициатива IBM была поддержана очень небольшим количеством независимых производителей, и только несколько из них сумели продвинуться дальше стадии разработки. А потом начались потери. Компания Conner, выпустившая на рынок жесткие диски SSA, была приобретена компанией Seagate, являвшейся уже к тому времени членом FCLC (Fiber Channel Loop Community). В итоге — ни Коннера, ни дисков.

На данный момент жесткие диски SSA можно приобрести только у IBM и Xyratex, которая сама базируется на бывшем заводе IBM. Долгое время из IBM исходили слухи о скором выпуске RAID-контроллера SSA, макет которого возили по компьютерным выставкам и демонстрировали всем желающим. А потом возить перестали, объявив о продаже прав на продукт компании Adaptec. Через некоторое время Adaptec перешел под знамена FCLC и блистательно похоронил наши надежды. Поэтому сейчас нам в очередной раз искренне жаль всех пользователей SSA, которые остались сиротами после объявления IBM о начале разработки нового стандарта FC-EL (Fiber Channel Enhanced Loop). Интересно, а сколько раз нужно наступить на грабли, чтобы выработать устойчивый рефлекс, как у собаки Павлова?

Первое знакомство

На момент выхода данной статьи Fibre Channel может быть описан как технология интерфейса передачи данных с гарантированной скоростью 1.0625 Gbit/s, поддерживающая такие распространенные способы обмена, как SCSI или IP. Благодаря такой универсальности, FC-AL может использоваться как в высокоскоростных шинах ввода/вывода (канал хранения), так и в LAN (сетевой канал) с максимальной длиной физической линии до 10 километров при использовании оптоволокна. К другим очевидным достоинствам Fibre Channel можно отнести поддержку различных топологий (точка-точка, петля с арбитражным доступом и коммутируемая звезда).

В основу технологии положена методика простого перемещения данных из буфера передатчика в буфер приемника с полным контролем этой и только этой операции. Благодаря такому «разграничению прав и обязанностей» для FC-AL совершенно неважно, как обрабатываются данные индивидуальными протоколами до и после помещения в буфер, вследствие чего тип передаваемых данных (команды, пакеты или кадры) не играет никакой роли.

Таким образом, технология Fibre Channel может смело претендовать на роль универсальной Магистрали, пропускающей потоки данных как существующих шин ввода/вывода, так и LAN соединений.

Во избежание возможных недоразумений сразу оговоримся, что мы не предлагаем всем дружно отказаться от IDE, SCSI, Ethernet или FDDI. Совсем нет, это было бы так же глупо, как и призывы некоторых производителей тянуть ATM к каждому рабочему месту.

Совершенно очевидно, что технологическое превосходство того или иного стандарта само по себе не может служить достаточным основанием для отказа от уже используемых решений. Иначе кто бы сейчас в здравом уме покупал IDE диски, когда есть существенно более продвинутые SCSI? Но зачем платить лишние деньги за конвейерную обработку, если на компьютере не установлена многозадачная и многопотоковая ОС? И даже если установлена, то так ли часто большинству из нас приходится пользоваться этими возможностями? С другой стороны, нам неизвестны примеры успешного использования IDE дисков для аппаратного обеспечения посещаемых Интернет-ресурсов.

Примерно то же самое можно сказать и применительно к технологии Fibre Channel. Вряд ли на сегодняшний день есть большой смысл в ее применении на домашнем ПК или даже на рабочем месте в офисе. А вот объединить ресурсы серверов и накопителей в единый пул для центра обработки информации с помощью Fibre Channel можно гораздо эффективнее, чем при использовании стандартного набора Gigabit Ethernet + Ultra2 SCSI.

И при этом даже останется немного денег, чтобы после праведных трудов отдохнуть, ни в чем себе не отказывая :-)

Почему стоит рассмотреть использование Fibre Channel? Fibre Channel по-прежнему является наиболее безопасным, надежным, экономически эффективным и масштабируемым протоколом для соединения серверов и хранилищ, а также единственным протоколом, специально предназначенным для передачи трафика хранилища.

Все мы знаем, что объем данных продолжает расти в геометрической прогрессии, и что сами данные являются той новой валютой, на которую рассчитывают предприятия. Способность своевременно реагировать на эти данные может повлиять на конкурентоспособность бизнеса на рынке. Поэтому быстрый и надежный доступ к данным имеет первостепенное значение, а базовая инфраструктура, которая связывает пользователя с системами хранения данных, является более важной, чем когда-либо прежде.

В современном центре обработки данных архитекторы могут выбирать из множества различных вариантов подключения, но Fibre Channel был и останется источником жизненной силы для подключения к общим хранилищам. Это связано с тем, что Fibre Channel является наиболее безопасным, надежным, экономически эффективным и масштабируемым протоколом для соединения серверов и хранилищ, а также единственным протоколом, специально предназначенным для передачи трафика хранилища.

Fibre Channel существует уже несколько десятилетий и по-прежнему является основным выбором для подключения к общему хранилищу в центре обработки данных. С помощью Fibre Channel создается выделенная сеть хранения, а команды хранения SCSI направляются между сервером и устройствами хранения с пропускной способностью до 28,05 Гбит / с (32GFC) и с IOPS, превышающим один миллион. Поскольку Fibre Channel изначально был разработан для трафика хранилищ, он работает очень надежно и обеспечивает высокопроизводительную связь. Адаптеры HPE StoreFabric 16GFC и 32GFC и инфраструктура коммутации обеспечивают пропускную способность, количество операций ввода-вывода в секунду и низкую задержку, необходимые в центрах обработки данных сегодня и на годы вперед.

Достижения в технологии Fibre Channel держат его на опережение, когда дело доходит до подключения.

Например, инфраструктура HPE StoreFabric 16GFC и 32GFC уже способна поддерживать трафик хранения NVMe, даже до того, как собственные массивы хранения NVMe станут массовыми. Другие расширенные возможности включают расширенную диагностику, упрощенное развертывание и оркестровку и повышенную надежность, такую как T-10 PI, двухпортовая изоляция и многое другое.

Другой популярный вариант подключения к хранилищу – iSCSI. С iSCSI, команды хранения в стандартной сети TCP / IP, и это отлично подходит для систем низкого и среднего уровня, где производительность и безопасность не являются основными требованиями. Распространенное заблуждение о Fibre Channel заключается в том, что, поскольку он использует выделенную сеть хранения данных, он дороже, чем iSCSI. Хотя iSCSI может работать в той же сети Ethernet, что и весь обычный сетевой трафик, для обеспечения производительности, необходимой большинству клиентов от своих систем хранения, iSCSI должен работать в сегментированной или выделенной сети Ethernet, изолированной от обычного сетевого трафика. Это означает сложные конфигурации VLAN и политики безопасности или полностью выделенную сеть Ethernet. Так же, как Fibre Channel.

Единственная реальная разница в стоимости между FC и iSCSI – это когда DAC — кабели используются в реализациях iSCSI. Но с ограничением расстояния 5 метров, используя DAC — кабели.

Это может нормально работать для клиентов малого и среднего бизнеса, имеющих только один массив хранения, но DAC — кабели плохо работают в крупномасштабном центре обработки данных.

Когда вы смотрите на топологию сети хранения данных, лучшие практики идентичны для iSCSI и Fibre Channel. Для обеспечения отказоустойчивости и устранения простоев в проекте сети хранения данных (SAN) предусмотрено два идентичных сетевых пути между серверами и хранилищем.

Однако одно существенное отличие заключается в том, что сети Fibre Channel не так подвержены нарушениям безопасности, как Ethernet. Когда вы в последний раз слышали о взломе сети Fibre Channel? Никогда? Как насчет сети Ethernet?

Безопасность является одной из главных причин того, что Fibre Channel будет оставаться опорой в центре обработки данных в течение многих лет.

Как мы ожидаем, набор команд SCSI будет заменен командами Non-Volitile Memory Express или NVMe. NVMe – это оптимизированный набор команд, разработанный для SSD и памяти классов хранения, который намного эффективнее, чем SCSI. Кроме того, NVMe представляет собой многорядную архитектуру с очередями ввода-вывода до 64 КБ, причем каждая очередь ввода-вывода поддерживает до 64 КБ команд. По сравнению со SCSI с одной очередью и 64 командами, NVMe может обеспечить значительно более высокую производительность.

Современная инфраструктура HPE StoreFabric 16GFC и 32GFC, которая поддерживает команды SCSI, также может запускать команды NVMe в сети SAN или в структуре, как она называется. При использовании Ethernet клиентам потребуется внедрить RDMA с низкой задержкой по сравнению с конвергентным Ethernet или RoCE, чтобы в полной мере использовать преимущества NVMe. Однако этот подход требует сложной реализации Ethernet без потерь с использованием мостов центров обработки данных (DCB) и управления приоритетными потоками (PFC). Сложность сети для NVMe через Ethernet будет огромным барьером для большинства клиентов, особенно когда развернутая сегодня FC SAN прекрасно работает с хранилищем NVMe завтрашнего дня.

Данный раздел поможет вам выбрать дисковый массив, который наиболее полно отвечает вашим потребностям.

Производительность дисковых массивов должна, прежде всего, удовлетворять потребностям ваших приложений.

Основными элементами массива являются:

1) Внешний интерфейс (обычно это интерфейс RAID контроллера массива): NAS, SCSI, Fibre Channel, iSCSI

2) Кэш контроллера

3) Интерфейс жестких дисков массива: sATA, SCSI, Fibre Channel

Каждый из выше перечисленных элементов должен быть подобран для гармоничной работы с вашим приложением, ибо оно является главенствующим.

Производительность дисковых массивов

Производительность можно рассматривать как показатель объема работы, выполненной за определенный промежуток времени. Производительность хранилищ данных часто выражается в числе операций ввода/вывода за секунду (IOPS) и/или мегабайт в секунду (MB/s). Число операций ввода/вывода за секунду (IOPS) и/или количество переданных мегабайт информации в секунду (MB/s) являются показателями производительности, но не ее синонимами, более того, они имеют обратную зависимость - большое значение показателя IOPS означает низкое MB/s, как показано на диаграмме:

Например, приложение требует 1 000 IOPS при размере блока в 8k, что равнозначно пропускной способности в 8 Мб/с (1 000 IOPS x блок 8k = 8 Мб/с). При использовании 200 Мб/с соединения Fibre Channel, 8 Мб/с уже не представляется слишком хорошей производительностью (8 Мб/с подразумевает использование только 4% пропускной способности шины Fibre Channel) если говорить о производительности в показателях Мб/с. Однако если приложение запрашивает 1 000 IOPS и устройство хранения данных предоставляет 1 000 IOPS без организации очереди (глубина очереди команд , чтобы собрать разрозненные крошечные . С другой стороны, доступ в кэш, который является оперативной памятью, гораздо быстрее, чем к диску. Алгоритмы кэширования работают одинаково (с некоторой разницей в эффективности, в зависимости от производителя): наиболее часто запрашиваемые данные хранятся в кэш.

Поэтому мы можем предположить, что размер кэш памяти контроллера, прежде всего, критичен для приложений со случайным доступом, которые характеризуются высокой плотностью транзакций в единицу времени. Увеличение кэш памяти контроллера в двое может повысить производительность системы в целом на 35% (!). Если для потокового видео вполне будет достаточно 128 МВ, то для системы потребуется не менее 1GB

3. Интерфейс жестких дисков

-

FC HDD:

- Надежность высокая. Каждый диск снабжен двумя каналами FC. В случае выхода из строя одного, работа продолжается по второму. 1 500 000 часов наработки на отказ.

- Производительность отличная. Наивысшая производительность для приложений со случайным методом доступа.

- Масштабируемость отличная. Емкость массива наращивается до 60 терабайт.

-

SCSI HDD:

- Надежность средняя. Каждый диск имеет один канал. В случае выхода из строя подлежит замене. 1 000 000 часов наработки на отказ.

- Производительность хорошая. Для приложений со случайным методом доступа.

- Масштабируемость плохая. Емкость массива наращивается до 4 терабайт.

-

SATA HDD:

- Надежность ниже средней. Не для массивов с интенсивным циклом. Наработка на отказ 500 000 часов.

- Производительность средняя. Хорошая для приложений с последовательным методом доступа.

- Масштабируемость отличная. До 120 терабайт в одном массиве.

Полезные ссылки:

1) В обзоре рассматриваются достоинства и недостатки нтерфейсов систем хранения данных таких как: SCSI, Fibre Channel, IEEE 1394 (FireWire), Serial ATA и iSCSI.

storage_interfaces.pdf

2) Исследование, проведенное аналитической компанией Taneja Group, предсказывает перспективы использования в ярусном хранении (tiered storage) дисков ATA и Serial ATA. В статье также дано описание ярусов хранения (storage tiers), представлены 4 ключевых фактора, влияющих на развитие данной технологии и мнения Taneja Group по поводу будущего технологии.

Storage-Tiers-ATA-Tech-Brief-01-2004.pdf

3) В этой статье рассматриваются различные методы подключения хранилищ к хост системам, такие как SAS (DAS), NAS и SAN, а также варианты организации резервного копирования, используемые в каждом случае.

host_connection_1.htm

4) Производители дисковых систем часто обращают внимание на "внутреннюю пропускную способность" дисковых систем. Является ли она полезным показателем производительности для приложений? Можно ли использовать это показатель для сравнения производительности двух различных дисковых систем? Ответы на эти вопросы обсуждаются в настоящей статье

DiskSystemInternalBandwidthWars.pdf

В этой статье мы проведем небольшой обзор наиболее популярных протоколов, которые используются для построения сетей хранения данных (SAN). Также рассмотрим перспективы развития и использования отдельных протоколов, опираясь на общедоступные роудмапы производителей.

Не секрет, что на сегодняшний день проблемы производительности перемещаются из сферы СХД в область SAN сетей, так как СХД уже достигли огромных показателей производительности в ГБ/с и миллионах IOps, а текущие SAN сети не позволяют прокачивать через себя такие объёмы данных.

Общие тенденции

Существующие сети FC 8Гб/с и Ethernet 10Гб/с уже не справляются c современными СХД, даже Ethernet 25/50 Гб/с не может обеспечить приемлемые задержки при работе с последними моделями СХД, использующими NVMe диски.

Многие ИТ-специалисты, занимающимся настройкой и администрированием инфраструктуры хранения, задаются вопросом о модернизации SAN-сетей. Почему же это так важно и необходимо на сегодняшний день? Сформулируем несколько основных причин:

- Во-первых, плотность хранения данных постоянно растёт, увеличиваются объёмы как HDD дисков, так и флэш-накопителей. Уже сейчас на рынке доступны HDD объёмом 10ТБ и SSD до 3.2ТБ.

- Во-вторых, скорость флэша и гибридных СХД растёт в двух аспектах: увеличивается пропускная способность и уменьшаются задержки. Например, последние модели NVMe-накопителей имеют производительность порядка 3ГБ/с и задержки в 20 мкс.

- В-третьих, потребность в обработке миллионов IOps. Уже сейчас один NVMe-диск способен выдавать до 700+ тысч IOps.

- В-четвёртых, потребность увеличивать производительность на один порт подключения. Если раньше с одного порта QSFP+ на протоколе InfiniBand получали максимум 56Гб/с, то уже в этом году есть решения с производительностью 200Гб/с на порт.

По существующим прогнозам, в перспективе двух лет (по данным Gartner, в течение 18 месяцев) all-flash массивы будут комплектоваться более производительными SSD-дисками, а в сочетании с быстрым интерконнектом (например, NVMe) и новыми протоколами (например, iWARP) производительность all-flash массивов повысится ещё на два порядка, что приведёт к необходимости модернизировать SAN.

Сравнение протоколов

Все SAN сети, будь то Ethernet, PCI Express, SAS, NVMeoF, FC, FCoE или InfiniBand, должны поддерживать одинаковый функционал, а именно:

- идентифицировать хост и СХД;

- иметь возможность маршрутизировать траффик;

- разделять сеть на подсети и изолировать в них траффик;

- обеспечивать возможность использования нескольких путей к СХД;

- управлять подключением устройств к сети;

- приоритизировать траффик.

На сегодняшний день протоколы хранения данных можно разделить на две условные группы:

- используемые для подключения серверов приложений (FC, FCoE, iSCSI, NFS, SMB);

- используемые для подключения в рамках кластера или в качестве интерконнекта внутри СХД (InfiniBand, NVMe, PCIe).

Fibre Channel (FC)

Fibre Channel — популярный протокол хранения, обеспечивающий низкие задержки и высокую пропускную способность за счёт своих архитектурных особенностей. Fibre Channel не требователен к ресурсам и отлично подходит для передачи большого объёма данных, так как все операции FC выполняются на стороне HBA, разгружая центральный процессор.

Новые версии протокола Fibre Channel обратно совместимы с прошлыми редакциями, что открывает хорошие перспективы для модернизации и масштабирования. Например, если внедрять FC 32Гб/с, то всё ещё можно будет использовать FC 8Гб/с и 16Гб/с, т.е. можно поэтапно менять FC-коммутаторы и FC адаптеры.

В ближайшее время FC будет обновлён до 64Гб/с и 128Гб/с (уже сейчас есть коммутаторы, поддерживающие агрегацию 4-х портов 32Гб/с в один канал 128Гб/с для соединения коммутаторов).

Простота настройки и удобство в администрировании позволили FC стать одним из наиболее распространенных протоколов хранения. Большинство администраторов SAN-сетей во всем мире знает, как он устроен и какие преимущества обеспечивает при решении различных задач. При этом FC всё ещё сложнее, чем Ethernet, хотя и обладает большим количеством средств управления и мониторинга.

FCoE (Fibre Channel over Ethernet)

Идея создания FCoE заключалась том, чтоб консолидировать операции ввода-вывода и, как следствие, обеспечить безопасное размещение в одном «проводе» различных типов траффика. Такая задумка подразумевала снижение совокупной стоимости владения системой (TCO) за счет уменьшения числа кабелей и адаптеров, а также снижения показателей по энергопотреблению. При этом показатели доступности и производительности FCoE не сопоставимы с показателями FC, так как передача данных требует дополнительных накладных расходов на инкапсуляцию в Ethernet.

К тому же, FCoE добавляет сложность в развёртывании и администрировании всей системы, повышая уровень требований к обслуживающему персоналу и поддержке решения. Несмотря на надежды производителей FCoE на повсеместное внедрение, до сих пор данный протокол не смог вытеснить FC и развивается очень медленными темпами. Распространение FCoE на рынке SAN в настоящий момент минимально.

По данным Fibre Channel Industry Association (FCIA) в прогнозных показателях FCoE скорость протокола зависит от реализаций Ethernet.

iSCSI (Internet Small Computer System Interface)

iSCSI строится на двух наиболее часто используемых протоколах:

- SCSI — протоколе обмена блоками данных между компьютером и хранилищем

- IP — сетевом транспортном протоколе, широко применяемом в корпоративных сетях Ethernet.

Считается, что iSCSI 10Гбит обеспечивает такое же количество IOps и пропускную способность, как и сопоставимый ему FC 8Гбит, но это не совсем так. Хотя пропускная способность iSCSI и выше, но его эффективность ниже, чем у FC за счёт дополнительных накладных расходов.

Производительность iSCSI зависит от существующий инфраструктуры Ethernet (на сегодняшний день минимально рекомендованная сеть для iSCSI – 10Гбит). В ближайшем будущем (по данным Gartner, 10–12 месяцев) стоит планировать переход на 25/40/50GbE, если будет необходимость использовать высокопроизводительные all-flash СХД.

SAN-сети на основе сетей Ethernet

Протоколы iSCSI, NFS, SMB, FCoE используют Ethernet-сети для передачи данных, поэтому использовать данные протоколы в общих сетях не целесообразно. Это приводит нас к необходимости развёртывания выделенных сетей для использования их в качестве SAN.

Такие сети должны работать параллельно с другими основными сетями и отделять пользовательский траффик от траффика данных серверов. Однако из-за разделения сетей увеличивается сложность администрирования и общая стоимость владения.

Единственное исключение — это использование общих сетей для объектного хранения, т.к. в данном случае обеспечение минимальных задержек и максимальной производительности не так критично.

NFS (Network File System)

Network File System (NFS) — протокол сетевого доступа к файловым системам, первоначально разработанный Sun Microsystems в 1984 году. NFS предоставляет клиентам прозрачный доступ к файлам и файловой системе сервера.

NFS просто конфигурируется и администрируется, т.к. используется поверх сетей Ethernet. Как и в других протоколах, использующих Ethernet, скорость и задержки целиком зависят от реализации сети на нижнем уровне и чаще всего «упираются» в ограничения стандарта 10GbE.

NFS часто используется как протокол начального уровня для построения SAN-сети для виртуализации. По прогнозам Gartner, такой тренд сохранится в течение последующих 10 лет.

SMB (Server Message Block)

SMB — это сетевой протокол для общего доступа к файлам, который позволяет приложениям компьютера читать и записывать файлы, а также запрашивать службы серверных программ в компьютерной сети. Разработан компанией Microsoft для реализации «Сети Microsoft Windows» и «Совместного использования файлов и принтеров». С увеличением пропускной способности сетей передачи данных SMB стал одним основных протоколов файлового доступа, применяемых в СХД. В системах хранения SMB чаще всего используется в сетях 10GbE, из-за этого его производительность сильно зависит от реализации, настроек и используемых компонентов сети.

До версии SMB 3.0 протокол в основном использовался для передачи файлов в локальных сетях. С новой версией, поддерживающей технологию SMB-Direct (использование RDMA), стал активно применяться в кластерах виртуализации на базе MS Hyper-V как протокол доступа к общему пулу хранения.

Как и NFS, SMB часто используется в качестве протокола начального уровня при построении SAN-сети для виртуализации. Эта тенденция также должна сохраниться в ближайшее десятилетие.

InfiniBand (IB)

InfinBand — высокоскоростной протокол, обеспечивающий очень большую пропускную способность и низкие задержки. Используется, преимущественно, в отрасли высокопроизводительных вычислений (HPC) и в качестве интерконнекта при создании высокопроизводительных СХД.

Наиболее явным недостатком этой технологии является сложность в настройке и администрировании. Как следствие, работа с IB требует квалифицированного персонала.

Среди трудностей повсеместного распространения InfinBand можно отметить ограниченные средства для мониторинга производительности и диагностики проблем, а также не самую лучшую совместимость с разными операционными системами.

В сравнении с FC и Ethernet протокол InfiniBand более «дорог» для внедрения и обслуживания. К тому же, существует лишь несколько считанных компаний, которые производят оборудование и программное обеспечение для работы с IB.

NVMe (NVM Express)

NVMe — это достаточно новый высокопроизводительный протокол доступа к твердотельным накопителям, подключенным по шине PCI Express. Аббревиатура «NVM» в названии обозначает энергонезависимую память (Non-Volatile Memory), в качестве которой в SSD повсеместно используется флеш-память типа NAND.

Протокол был разработан с нуля. Основные цели его разработки – низкие задержки и эффективное использование высокого параллелизма твердотельных накопителей. Последняя задача решается за счёт применения нового набора команд и механизма обработки очередей ввода-вывода, оптимизированного для работы с современными процессорами.

На данный момент технология NVMe еще не получила широкого распространения. В основном протокол используется для внутреннего соединения в серверах и СХД. Спецификация NVMe также позволяет инкапсулировать его в другие протоколы, такие как Ethernet, FC и InfiniBand, и масштабировать протокол в более крупных сетях. Впрочем, поскольку NVMe использует прямой доступ к памяти (RDMA), латентность протокола несущей должна быть очень низкой для нормальной работы протокола.

В 2017 году ожидается активное внедрение NVMe, так как многие производители серверных платформ представляют новые модели с поддержкой двухпортовых NVMe-устройств, что позволит проектировать отказоустойчивые решения для хранения.

Ожидается, что в ближайшие несколько лет NVMe будет использоваться в качестве внешнего межсетевого интерфейса, аналогичного PCIe и InfiniBand. Например, он может использоваться в небольших специализированных сетях хранения из десятков узлов или устройств в однородной среде хранения. Гораздо шире NVMe будет использоваться в качестве внутреннего интерконнекта.

PCIe имеет очень низкие задержки и используется преимущественно в серверах для подключения плат расширения, в том числе и высокопроизводительных NVMe дисков. Некоторые новые продукты от известных производителей используют PCIe в качестве протокола подключения серверов через небольшие PCIe коммутаторы, т.е. PCIe получается использовать только в небольших SAN-сетях.

Только несколько производителей СХД в мире используют PCIe для внешних подключений, что и определяет узкоспециализированное применение данного протокола.

Так как PCIe не использует SCSI и требует собственного протокола для передачи данных, он может увеличить пропускную способность за счёт уменьшения задержек, по сути, работая на скорости чистой PCIe-линии. Такие решения требуют применения проприетарных драйверов, что делает их сложно администрируемыми и приводит к невозможности создавать гетерогенные инфраструктуры, а также встраивать такие решения в существующие SAN сети.

На сегодняшний день основная используемая реализация технологии — это PCIe 3.x, в которой производительность увеличена на 40% по сравнению PCIe 2.x.

По количеству линий PCIe масштабируется от 1ГБ/с до 16ГБ/с. В 2017 году выходит новый стандарт PCIe 4.x, который увеличит производительность в 2 раза, т.е. максимальная производительность достигнет 32ГБ/с.

Протоколы объектного хранения

Производительность этих протоколов сильно зависит от нижнего уровня, чаще всего это Ethernet. Основное функциональное применение протоколов объектного хранения — работа с неструктурированными данными. Ввиду этого они используются в рамках ЦОДов, а также широко применяются для доступа к данным и записи в облачные пулы хранения.

Протоколы объектного доступа требуют передачи и хранения большого объёма метаданных, что всегда добавляет накладные расходы, особенно в сравнении протоколами блочного доступа.

За последние несколько лет было разработано множество протоколов объектного доступа. Наиболее популярные из них – SOAP, S3, OpenStack Swift. В ближайшем будущем (по данным Gartner, в течение 5 лет) данные технологии будут вызывать особый интерес.

Вывод

Развитие SAN-протоколов напрямую зависит от развития приложений и профилей нагрузки.

Такие приложения и типы нагрузок, как в HPC, аналитике Big Data и активных архивах, будут двигать SAN в сторону создания СХД c очень низкими задержками и высочайшей пропускной способностью, а также с поддержкой разделяемого доступа с использованием NVMe.

Протоколы, которые будут внедряться в ближайшем будущем (такие как 40/100GbE ), файловые протоколы (такие как NFS over RDMA и SMB-Direct) и текущие блочные протоколы (такие как FC 16Gb/s), уже сейчас слишком медленные для следующего поколения Flash и гибридных СХД.

Основным протоколом на ближайшее десятилетие останется FC, так как под него создана вся необходимая инфраструктура. Многие будут переходить на FC 16Гб/c, затем на FC 32Гб/с и более новые версии.

InfiniBand, PCIe и NVMe останутся протоколами для подключения конечных устройств, межузловых подключений в кластерах или интерконнекта с малыми задержками. При этом будут и небольшие узкоспециализированные решения для SAN-сетей, в которых необходимы минимальные задержки и максимальная пропускная способность. FCoE, iSCSI, NFS, SMB или объектные протоколы будут использоваться преимущественно в качестве внешних протоколов.

C каждым годом растёт интерес к объектным системам хранения. Это происходит за счёт увеличения количества неструктурируемых данных, появления новых задач по их обработке и новых требований к хранению информации.

Использованные источники:

• The Fibre Channel Roadmap, FCIA 2016.

• Dennis Martin. Demartek Storage Networking Interface Comparison, Demartek 2016.

• Valdis Filks, Stanley Zaffos. The Future of Storage Protocols, Gartner 2017.

Читайте также: