Enclosure raid что это

Появился у нас новый сервер Supermicro. На сервере установлен RAID контроллер AVAGO MegaRAID SAS 9460-8i, в котором два NVMe диска собраны в RAID 1. В качестве операционной системы у нас выступает Windows Server 2016.

Естественно, Supermicro и Windows не видят диски, а следить за железом как-то нужно. Windows видит только массив.

Для управления контроллером и дисками воспользуемся утилитой StorCLI.

Заключение

Использование аппаратных решений для создания дисковых массивов из двух дисков выглядит нерационально. Тем не менее, существуют задачи, где использование RAID-контроллеров оправдано. С появлением контроллеров с поддержкой интерфейса NVMe у пользователей появляется возможность использовать более быстрые SSD в своих проектах.

RAID (Redundant Array of Independent Disks), или, по-русски, избыточный массив независимых дисков — это способ хранения одних и тех же данных в разных местах на нескольких установленных жестких или твердотельных накопителях. Используется данная технология преимущественно для защиты данных в случае отказа одного из дисков и расширения общего пространства памяти. Однако, примите во внимание, существует ряд уровней на которые подразделены RAID массивы. И в зависимости от уровня сфера применения дисков может разниться.

Intel® Virtual RAID On CPU

Intel® VROC Standard Hardware Key

Intel® Virtual RAID On CPU (VROC) — это программно-аппаратная технология для создания RAID-массивов на базе чипсетов Intel®. Данная технология доступна в основном для материнских плат с поддержкой процессоров Intel® Xeon® Scalable. По умолчанию VROC недоступен. Для его активации необходимо установить аппаратный лицензионный ключ VROC.

Стандартная лицензия VROC позволяет создавать дисковые массивы с 0, 1 и 10 уровнями RAID. Премиальная версия расширяет этот список поддержкой RAID5.

Технология Intel® VROC в современных материнских платах работает совместно с Intel® Volume Management Device (VMD), которая обеспечивает возможность горячей замены для накопителей с интерфейсом NVMe.

Intel® VROC со стандартной лицензией Настройка массивов производится через Setup Utility при загрузке сервера. На вкладке Advanced появляется пункт Intel® Virtual RAID on CPU, в котором можно настроить дисковые массивы.

Создание массива RAID1 на двух накопителях

Технология Intel® VROC имеет свои «козыри в рукаве». Дисковые массивы, собранные с помощью VROC, совместимы с Linux Software RAID. Это означает, что состояние массивов можно отслеживать в /proc/mdstat, а администрировать — через mdadm. Эта «особенность» официально поддерживается Intel. После сборки RAID1 в Setup Utility можно наблюдать синхронизацию накопителей в ОС:

Отметим, что через mdadm нельзя собирать массивы на VROC (собранные массивы будут Linux SW RAID), но можно менять в них диски и разбирать массивы.

Linux Software RAID

Программные RAID-массивы в семействе ОС Linux — достаточно распространенное решение как в клиентском сегменте, так и в серверном. Все, что нужно для создания массива, — утилита mdadm и несколько блочных устройств. Единственное требование, которое предъявляет Linux Software RAID к используемым накопителям, — быть блочным устройством, доступным системе.

Отсутствие затрат на оборудование и программное обеспечение — очевидное преимущество данного способа. Linux Software RAID организует дисковые массивы ценой процессорного времени. Список поддерживаемых уровней RAID и состояние текущих дисковых массивов можно посмотреть в файле mdstat, который находится в корне procfs:

Поддержка уровней RAID добавляется подключением соответствующего модуля ядра, например:

Все операции с дисковыми массивами производятся через утилиту командной строки mdadm. Сборка дискового массива производится в одну команду:

После выполнения этой команды в системе появится блочное устройство /dev/md0, которое представляет из тебя виртуальный диск.

Тестирование

В первую очередь проверим задержки при работе с диском. Тест выполняется в один поток, размер блока 4 КБ. Каждый тест длится 5 минут. Перед началом для соответствующего блочного устройства выставляется none в качестве планировщика I/O. Команда fio выглядит следующим образом:

Из результатов fio мы берем clat 99.00%. Результаты приведены в таблице ниже.

| Случайное чтение, мкс | Случайная запись, мкс | |

|---|---|---|

| Диск | 112 | 78 |

| Linux SW RAID, RAID0 | 113 | 45 |

| VROC, RAID0 | 112 | 46 |

| LSI, RAID0 | 122 | 63 |

| Linux SW RAID, RAID1 | 113 | 48 |

| VROC, RAID1 | 113 | 45 |

| LSI, RAID1 | 128 | 89 |

Помимо задержек при обращении к данным, хочется увидеть производительность виртуальных накопителей и сравнить с производительностью физического диска. Команда для запуска fio:

Производительность измеряется в количестве операций ввода-вывода. Результаты представлены в таблице ниже.

| Случайное чтение 1 поток, IOPS | Случайная запись 1 поток, IOPS | Случайное чтение 128 потоков, IOPS | Случайная запись 128 потоков, IOPS | |

|---|---|---|---|---|

| Диск | 11300 | 40700 | 453000 | 105000 |

| Linux SW RAID, RAID0 | 11200 | 52000 | 429000 | 232000 |

| VROC, RAID0 | 11200 | 52300 | 441000 | 162000 |

| LSI, RAID0 | 10900 | 44200 | 311000 | 160000 |

| Linux SW RAID, RAID1 | 10000 | 48600 | 395000 | 147000 |

| VROC, RAID1 | 10000 | 54400 | 378000 | 244000 |

| LSI, RAID1 | 11000 | 34300 | 229000 | 248000 |

Легко заметить, что использование аппаратного контроллера дает увеличение задержек и просадку по производительности в сравнении с программными решениями.

Ссылки

Если вам понравилась статья, то ставьте 👍🏻 каналу.

Пишите комментарии, задавайте вопросы, подписывайтесь.

Последовательный интерфейс Serial ATA — это не только удобная замена прижившегося в настольных системах старого доброго параллельного UltraATA (IDE). Определенная и достаточно ощутимая доля устройств с интерфейсом Serial ATA предназначена для профессионального применения и даже вытеснения некоторых других более «дорогих» интерфейсов с рынка профессиональных устройств хранения данных начального уровня. Этому способствует как более высокая скорость SATA по сравнению с PATA, так и расширенная функциональность, в определенной мере приближающаяся к возможностям интерфейса SCSI. Среди прочего, очень полезной возможностью является изначально встроенная в интерфейс SATA функция горячей замены (подключения и отключения) накопителей. И в этом отношении, вполне закономерным выглядит шаг компании Adaptec, Inc, именитого производителя контроллеров и систем хранения данных, которая в конце 2004 года выпустила «набор», состоящий из появившегося на рынке ранее четырехпортового SATA RAID контроллера среднего ранга AAR-2410SA и корзины для четырех SATA-дисков. Данная система (замечу — с поддержкой RAID уровня 5 и функцией горячей замены накопителей) получила название Adaptec Serial ATA RAID 2410SA Enclosure Kit, и мы в этой статье постараемся познакомиться с ее основными особенностями.

Комплектация набора незамысловата: помимо собственно корзины для 4 SATA-дисков и слегка модернизированного контроллера AAR-2410SA

имеется 4 метровых SATA-кабеля, low-profile-планка для контроллера (он допускает установку в низкопрофильные корпуса с подсоединенными SATA-кабелями), две толстеньких книжечки-мануала на разных языках (на один контроллер и на набор целиком) и CD с драйверами и утилитами. В комплекте есть и специальный четырехпроводной кабель для подключения корзины к контроллеру (управление светодиодами исправности дисков, расположенных на передней панели корзины):

Корзина бывает двух расцветок — бежевой (как на фото) и черной. Производитель дает трехлетнюю гарантию на этот набор.

С программным RAID

Несомненное преимущество программного RAID — простота использования. Массив в ОС Linux создается с помощью штатной утилиты mdadm. При установке операционной системы чаще всего создание массива предусмотрено непосредственно из установщика. В случае, когда такой возможности установщик не предоставляет, достаточно всего лишь перейти в соседнюю консоль с помощью сочетания клавиш Ctrl+Alt+F2 (где номер функциональной клавиши — это номер вызываемой tty).

Создать массив очень просто. Командой fdisk -l смотрим, какие диски присутствуют в системе. В нашем случае это 4 диска:

Проверяем, чтобы на дисках не было метаданных, например, от предыдущего массива:

В случае, если на одном или нескольких дисках будут метаданные, удалить их можно следующим образом (где sdX — требуемый диск):

Создадим на каждом диске разделы для будущего массива c помощью fdisk. В качестве типа раздела следует указать fd (Linux RAID autodetect).

Собираем массив RAID 10 из созданных разделов с помощью команды:

Сразу после этого будет создан массив /dev/md0 и будет запущен процесс перестроения данных на дисках. Для отслеживания текущего статуса процесса введите:

Пока процесс перестроения данных не будет завершен, скорость работы дискового массива будет снижена.

После установки операционной системы и Bitrix24 на созданный массив мы запустили стандартный тест и получили следующие результаты:

StorCLI

Скачиваю утилиту storcli . Доступна версия MR 7.19.

Это очень мощная утилита по управлению RAID контроллером. Сегодня нам понадобится минимум функционала для просмотра информации о дисках. Данную утилиту я планирую использовать для автоматизированного мониторинга за дисками сервера.

В архиве имеются версии storcli для разных операционных систем. Нас интересует папка Windows. Копирую оттуда утилиту storcli64.exe в удобную для себя директорию C:\zabbix\scripts .

Работать с утилитой следует с помощью командной строки.

Данная команда выведет детальную информацию.

Здесь мы увидим модель и состояние нашего контроллера AVAGO MegaRAID SAS 9460-8i. Видим что есть батарейка в состоянии Opt . Видим, что к контроллеру подключены два физических диска.

Получим список виртуальных дисков для контроллера:

Небольшое отступление. Синтаксис команды гибкий, вы можете писать параметры со слешами двумя способами: с отступами и без отступов. При работе в командной строке я предпочитаю ставить отступы, а при написании скриптов пишу без отступов, мне так удобнее.

Найден один массив RAID1 объёмом 6.985 TB в состоянии Optimal . В операционной системе это Disk 0 .

Посмотрим на физические диски:

Вижу один NVMe диск в слоте 6 и корпусе 74. Так, а где второй диск? Не знаю как устроена структура этого контроллера, но второй диск я-таки нашёл:

Вижу второй NVMe диск тоже в слоте 6 и без корпуса. Оказывается, параметр /eall отображает все диски во каждом Enclosure, а бывают диски, которые не привязаны к корпусам, это было для меня новостью.

Есть способ отобразить все диски, нужно обратиться к дисковым группам:

Заключение

Использование аппаратного RAID-контроллера оправдано в большинстве случаев, когда требуется высокая скорость и надежность работы дисковой подсистемы.

Системные инженеры Selectel бесплатно выполнят базовую настройку дискового массива на аппаратном RAID-контроллере при заказе сервера произвольной конфигурации. В случае, если потребуется дополнительная помощь с настройкой, мы будем рады помочь в рамках нашей услуги администрирования. Также мы подготовили для наших читателей небольшую памятку по командам утилиты arcconf.

В данной статье мы расскажем про разные способы организации RAID-массивов, а также покажем один из первых аппаратных RAID-контроллеров с поддержкой NVMe.

Все разнообразие применений технологии RAID встречается в серверном сегменте. В клиентском сегменте чаще всего используется исключительно программный RAID0 или RAID1 на два диска.

В этой статье будет краткий обзор технологии RAID, небольшая инструкция по созданию RAID-массивов с помощью трех разных инструментов и сравнение производительности виртуальных дисков при использовании каждого из способов.

Температура

Вначале хотелось бы затронуть такую важную вещь, как температурный режим аппаратных RAID-контроллеров Adaptec. Все они оснащены небольшими пассивными радиаторами, что может вызвать ложное представление о небольшом тепловыделении.

Производитель контроллера приводит в качестве рекомендуемого значения воздушного потока — 200 LFM (linear feet per minute), что соответствует показателю 8,24 литра в секунду (или 1,02 метра в секунду). Рассчитаны такие контроллеры исключительно на установку в rackmount-корпусы, где такой воздушный поток создается скоростными штатными кулерами.

От 0°C до 40-55°C — рабочая температура большинства RAID-контроллеров Adaptec (в зависимости от наличия установленных модулей), рекомендованная производителем. Максимальная рабочая температура чипа составляет 100°C. Функционирование контроллера при повышенной температуре (более 85°C) может вывести его из строя. Удобства ради приводим под спойлером табличку рекомендуемых температур для разных серий контроллеров Adaptec.

| Series 2 (2405, 2045, 2805) and 2405Q | 55°C без модулей |

| Series 5 (5405, 5445, 5085, 5805, 51245, 51645, 52445) | 55°C без батарейного модуля, 40°C с батарейным модулем ABM-800 |

| Series 5Z (5405Z, 5445Z, 5805Z, 5805ZQ) | 50°C с модулем ZMCP |

| Series 5Q (5805Q) | 55°C без батарейного модуля, 40°C с батарейным модулем ABM-800 |

| Series 6E (6405E, 6805E) | 55°C без модулей |

| Series 6/6T (6405, 6445, 6805, 6405T, 6805T) | 55°C без ZMCP модуля, 50°C с ZMCP модулем AFM-600 |

| Series 6Q (6805Q, 6805TQ) | 50°C с ZMCP модулем AFM-600 |

| Series 7E (71605E) | 55°C без модулей |

| Series 7 (7805, 71605, 71685, 78165, 72405) | 55°C без ZMCP модуля, 50°C с ZMCP модулем AFM-700 |

| Series 7Q (7805Q, 71605Q) | 50°C с ZMCP модулем AFM-700 |

| Series 8E (8405E, 8805E) | 55°C без модулей |

| Series 8 (8405, 8805, 8885) | 55°C без ZMCP модуля, 50°C с ZMCP модулем AFM-700 |

| Series 8Q (8885Q, 81605Z, 81605ZQ) | 50°C с ZMCP модулем AFM-700 |

Нашим клиентам не приходится беспокоиться о перегреве контроллеров, поскольку в наших дата-центрах поддерживается постоянный температурный режим, а сборка серверов произвольной конфигурации происходит с учетом особенностей таких комплектующих (о чем мы упоминали в нашей предыдущей статье).

Как работает RAID массив

Принцип работы RAID состоит в том, что технология позволяет размещать данные, например, одного приложения сразу на нескольких дисках. А операции ввода и вывода обрабатываются общими усилиями так, что повышается суммарная производительность.

Дополнительный бонус технологии — повышенная отказоустойчивость, вызванная более высоким объемом памяти. Таким образом, шанс потерять личные файлы стремительно падает.

RAID массив отображается в интерфейсе компьютера как один логический диск. Тем не менее принцип его работы может быть разным: зеркальным и чередующим. Зеркальный метод подразумевает копирование идентичных данных на несколько дисков, а чередующий позволяет равномерно распределять информацию по ним. Зеркалирование и чередование дисков могут быть объединены в одном массиве.

Любая технология имеет свои сильные и слабые стороны. Давайте рассмотрим возможности и недостатки RAID подробнее.

Скорость работы

Для того чтобы продемонстрировать, как наличие аппаратного RAID-контроллера способствует увеличению скорости работы сервера, мы решили собрать тестовый стенд со следующей конфигурацией:

- CPU Intel Xeon E3-1230v5;

- RAM 16 Gb DDR4 2133 ECC;

- 4 HDD емкостью по 1 ТБ.

Затем в этот же стенд поставим RAID-контроллер Adaptec ASR 7805 с модулем защиты кэша AFM-700, подключим к нему эти же жесткие диски и выполним точно такое же тестирование.

Тестовый стенд

Каждый из способов организации дисковых массивов имеет свои физические плюсы и минусы. Но есть ли разница в производительности при работе с дисковыми массивами?

Для достижения максимальной справедливости все тесты будут проведены на одном и том же сервере. Его конфигурация:

- 2x Intel® Xeon® 6240;

- 12x DDR4-2666 16 GB;

- LSI MegaRAID 9460-8i;

- Intel® VROC Standard Hardware Key;

- 4x Intel® SSD DC P4510 U.2 2TB;

- 1x Samsung 970 EVO Plus M.2 500GB.

Негативные стороны применения RAID массивов

Высокая стоимость.

Помимо обычных RAID массивов существуют и гибридные, “Nested” массивы. Они могут содержать, например RAID 1+0, 0+3 и другие комбинации. Стоимость таких устройств ощутимо выше и может ударить по карману.

Риск цепного самоуничтожения.

Несмотря на то, что RAID массивы надежны и шанс повреждения дисков довольно низок, всегда есть вероятность старта цепной реакции “смерти”. Например, если один из дисков вышел из строя, вполне вероятно, что и другие тоже скоро постигнут его участь. Обратите внимание, что такие риски существуют только при полном отказе. Пара битых секторов должны вас насторожить, но не должны вгонять в панику.

Какие преимущества дают RAID массивы

Экономическая составляющая.

В RAID массиве вы можете использовать несколько дешевых жестких дисков, получая в результате большие объемы памяти с минимальными затратами. Идеально для хранения личной информации, такой как, например, фильмы или семейные фотографии.

Производительность.

Используя RAID массив с несколькими жесткими дисками, вы получаете гораздо более высокую производительность, чем при одном активном устройстве. До уровня SSD, конечно, диски не дотянут, но скорость чтения-записи существенно возрастет. Как следствие, если ваша система установлена на HDD, скорость запуска компьютера будет выше.

Надежность.

Шанс того, что информация на вашем компьютере будет повреждена и недоступна для восстановления стремительно падает. Ведь чем больше суммарный объем памяти, тем большему количеству секторов надо сломаться прежде чем ситуация станет критической. А шанс того, что будет поврежден нужный вам файл вообще мизерный.

Отказоустойчивость.

Если вы используете массива RAID 5 с функцией “отзеркаливания”, вы можете свободно иметь два диска с идентичными данными. Повредился один — не проблема, все хранится в целости и сохранности на втором устройстве.

Методика тестирования скоростных показателей

Собственно, детальные исследования производительности контроллера AAR-2410SA в данном случае не были главной целью при рассмотрении нами набора Adaptec 2410SA Enclosure Kit. Тем не менее, некоторые тесты контроллера мы все же провели — на четырехдисковом массиве RAID 10 в сравнении с парой контроллеров других производителей: заслуженным 3ware Escalade 8500-4 для шины PCI64

и бюджетным популярным 4-портовым Silicon Image SiI3114 (референс-плата) для шины PCI32 (33 или 66 МГц). Последний участвует в данном обзоре в двух вариантах включения — на шине PCI-X и на шине PCI32/33 МГц (в последнем случае возможно ограничение скорости массива из-за недостаточной полосы пропускания «бытовой» шины PCI). Напомним, что AAR-2410SA и Esclalde 8500-4 примерно равноценны по классу (оба — профессиональный RAID-контроллеры с поддержкой RAID уровня 5, набортной кэш-памятью и массой сервисных функций), тогда как SiI3114 способен лишь на RAID 0, 1 и 10 и не имеет кэш-памяти. Тем интереснее будет выяснить, кто из них наиболее быстр в несложном для расчетов массиве RAID 10.

Испытания проводились при помощи четырех жестких дисков Western Digital Caviar RAID Edition WD1200SD емкостью по 120 Гбайт. Для контроллеров AAR-2410SA и Escalade 8500-4 размер блока чередования по дефолту для RAID 10 равнялся 256 Кбайт, кэширование записи было включено. Для SiI3114 также использовались настройки по умолчанию, BIOS версии 5.0.44 и драйвер версии 1.0.0.7. Для контроллера Adaptec версии BIOS и драйверов — 7.3.4.8, а для контроллера 3ware — BIOS 7.7.1 и драйвер 1.15.00.014.

- Процессор Intel Pentium 4 3.0C

- Материнская плата Gigabyte GA-8KNXP Ultra-64 на чипсете Intel E7210 (MCH i875P + южный мост Intel Hance Rapids 6300ESB с шиной PCI-X)

- Системная память 2×256 Мбайт DDR400 (тайминги 2.5-3-3-6)

- Системный жесткий диск Maxtor 6E040L0

- Блок питания Zalman ZM400A-APF, 400 ватт

- Корпус Arbyte YY-W201BK-A

Испытания проводились под управлением операционной системы MS Windows XP Professional SP2. Массивы тестировались как неразмеченными на разделы (в тестах Intel Iometer версии 2003.5.10, H2Benchw 3.6 и AIDA32), так и разбивались и форматировались штатными средствами операционной системы в зависимости от вида теста: одним NTFS-разделом максимально возможной емкости для тестов среднего времени доступа и снятия графика скорости чтения в WinBench 99 и двумя равновеликими разделами NTFS или FAT32 для остальных тестов (WinBench Disk WinMark 99 2.0, ATTO Disk Benchmark, многопотокового чтения/записи и теста в программе Adobe Photoshop CS). Разделы NTFS имели размер в половину объема диска каждый (то есть второй раздел начинался ровно со второй половины диска), а разделы FAT32 имели размер по 32768 Мбайт, причем первый начинался в начале диска (на самых «быстрых» дорожках), а второй — ровно с середины диска по объему. Размер кластеров NTFS и FAT32 выбирался по умолчанию — 4 и 16 Кбайт соответственно.

Следует оговориться, что попытки оттестировать контроллеры Adaptec и 3ware на шине PCI-X в данной системе потерпели неудачу — наблюдались сбои. В результате, шина перемычкой на плате была переведена в режим PCI64.

Организация единого дискового пространства — задача, легко решаемая с помощью аппаратного RAID-контроллера. Однако следует вначале ознакомиться с особенностями использования и управления таким контроллером. Об этом сегодня расскажем в нашей статье.

Надежность и скорость работы дисковых накопителей — вопрос, волнующий каждого системного администратора. Несмотря на заверения производителей о качестве собственных устройств — HDD и SSD продолжают выходить из строя в самое неподходящее время, теряя драгоценные данные. Технология S.M.A.R.T. в большинстве случаев дает возможность оценить «здоровье» накопителя, но это не гарантирует того, что диск будет продолжать беспроблемно работать.

Предсказать выход диска из строя со 100%-ой точностью невозможно, поэтому следует предусмотреть вариант, при котором это не станет проблемой или причиной остановки сервисов. Использование RAID-массивов решает эту задачу. Рассмотрим три основных подхода, применяющихся для этой задачи:

- Программный RAID — наименее затратный вариант, но и наименее производительный. Массив создается средствами операционной системы, вся нагрузка по обработке данных «ложится на плечи» центрального процессора.

- Интегрированный аппаратный RAID (еще его часто называют Fake-RAID) — микрочип, установленный на материнскую плату, который берет на себя часть функционала аппаратного RAID-контроллера, работая в паре с центральным процессором. Этот подход работает чуть быстрее, чем программный RAID, но надежность у такого массива оставляет желать лучшего.

- Аппаратный RAID — это отдельный контроллер с собственным процессором и кэширующей памятью, полностью забирающий на себя выполнение всех дисковых операций. Наиболее затратный, однако, самый производительный и надежный вариант для использования.

Результат

Мы выяснили, что на сервере есть RAID1 массив из двух NVMe дисков.

Реализация нумерации корпусов и слотом странная. Кстати, в BIOS отображается с такими же EID:Slot. Утилита LSA для Windows тоже видит диски именно так. Установка последней прошивки контроллера ситуацию не изменила. Этот массив я не собирал, а получил готовую сборку вместе с сервером, так что прокомментировать этот момент не могу. Вероятно, это такая фича для NVMe дисков.

Ещё для меня стало новостью, что диски в контроллере могут быть не привязаны к Enclosure. Это привело к тому, что пришлось переписать шаблон для мониторинга LSI контроллеров в Zabbix, добавив автообнаружение именно таких дисков.

Устройство и технические характеристики

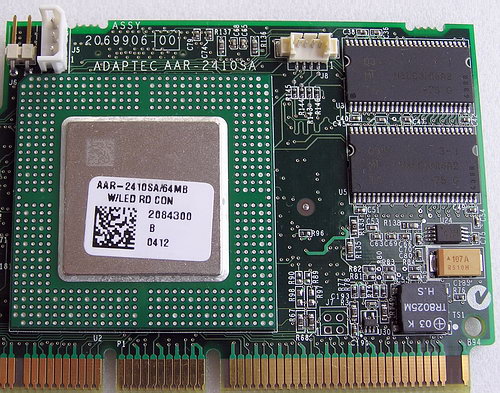

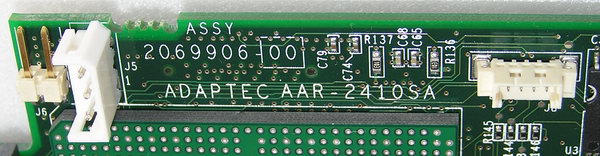

Основой набора служит изготовленный на сингапурском заводе компании

известный низкопрофильный четырехпортовый SATA RAID контроллер Adaptec AAR-2410SA для шины PCI 64 бит/66 МГц (совместимый с шиной PCI 32 бит/33 МГц) с поддержкой дисковых массивов уровней 0, 1, 5, 10 и JBOD, позиционируемый производителем как «идеальное решение для рабочих станций и серверов начального уровня».

Контроллер этот уже относительно старый — времен первого появления на рынке интерфейса SATA. Он базируется на двух едва ли не самых первых (и, кстати, весьма удачных) двухпортовых SATA-чипах SiI3112A от Silicon Image со скоростью интерфейса 1,5 Гбит/с,

которые были выбраны, очевидно, потому, что изначально спроектированы как Serial ATA-продукт (без «тяжелого» груза и остатков UltraATA-интерфейса). Они могли работать от 66-мегагерцовой шины PCI, лучше всех на тот период поддерживали горячее подключение/отключение дисков и обладали наилучшей совместимостью с различными накопителями (SiI3112A в обязательном порядке был базой для предварительных и финальных тестирований всех накопителей).

Для «объединения» двух двухпортовых контроллеров SiI3112A в один четырехпортовый с поддержкой RAID 5 и 10 послужил процессор Intel GC80302, который Adaptec традиционно использует в своих продуктах, и для которого годами отлажен универсальный Adaptec RAID код:

Кроме того, контроллер AAR-2410SA несет «на борту» 64 Мбайт достаточно быстрой (133 МГц) кэш-памяти,

которая характеризует данный продукт как предназначенный для профессиональных систем.

Кстати, и цена на данный контроллер тоже «недетская» — от 270 долларов в московской рознице за один только контроллер (без корзины, с которой производитель цену примерно удваивает). Напомним, что простейшие «бытовые» двухпортовые SATA-карточки на SiI3112A уже опустились до 15-20 долларов.

Пожалуй, основным отличием просто контроллера AAR-2410SA от аналогичного в составе 2410SA Enclosure Kit, является наличие на плате последнего специального 4-контактного разъема (на фото он справа),

предназначенного для подключения сигнального кабеля связи с корзиной, через который происходит управление светодиодами на ее передней панели.

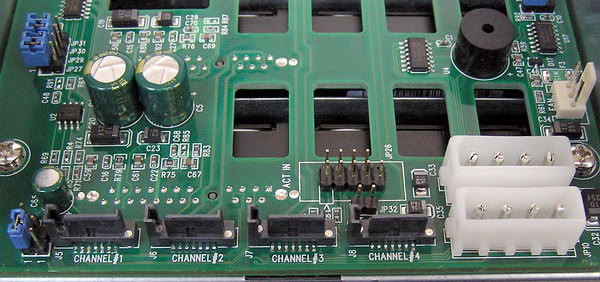

Собственно корзина из набора Adaptec 2410SA Enclosure Kit — это двустенный жестяной корпус для трех «пятидюймовых» отсеков системного блока,

с четырьмя салазками из толстой жести для жестких дисков,

которые будучи установлены в «стоячем» корпусе блока занимают вертикальное положение.

Каждый индивидуальный отсек снабжен откидной ручкой для извлечения и фиксатором-защелкой (без возможности запирания дисков «на ключ»). Салазки для дисков пронумерованы от Port 0 до Port 3 (поэтому при установке дисков в корзину эту последовательность следует соблюдать) и снабжены двумя световыми индикаторами (обращение к диску и питание отсека) каждая.

А сама корзина дополнительно имеет еще два индикатора сбоку — режим работы общего вентилятора и индикатор перегрева системы.

Несмотря на то, что «фасад» несет гордую надпись «Adaptec», в корзине легко угадывается известный продукт CSE-M34T компании Supermicro, о чем свидетельствует и надпись на печатной плате внутри корзины:

Корзина оснащена одним «выдувающим» вентилятором диаметром 90 мм,

скорость которого может регулироваться электроникой на плате корзины в зависимости от текущей температуры внутри (для этого на плате предусмотрены соответствующие джамперы).

Порты (каналы) Serial ATA на плате пронумерованы,

с «обратной» стороны платы корзины в нужных местах расположены четыре SATA-разъема с «отфильтрованным» питанием,

так что механические операции по установке и замене дисков даже при включенной системе не доставляют никаких хлопот. Около каждого из этих разъемов на плате расположены пары бескорпусных светодиодов (см. фото разъема выше), свет которых при помощи пластиковых световодов (они расположены на салазках «под» диском) «доставляется» на переднюю панель корзины.

Наконец, сзади есть специальный pin-разъем для подключения четырехпроводного кабеля связи с контроллером AAR-2410SA,

через который контроллер при помощи встроенного в свой BIOS кода может индицировать миганием светодиода на передней панели корзины неисправный диск массива. Для справки приведу назначение контактов разъема LEDs (ACT IN, JP26), взятое из мануала на корзину CSE-M34 от Supermicro (Adaptec, к сожалению, подробной документации на корзину не предоставляет):

В спецификациях набора Adaptec 2410SA Enclosure Kit прежде всего подчеркивается возможность горячей замены дисков, обновление массива(ов) на ходу, улучшенные возможности технологии RAID (для уровней 0, 1, 5, 10 и JBOD), пришедшие от SCSI-контроллеров Adaptec, включая функции OCE (Online Capacity Expansion — изменение на ходу объема массива), RLM (RAID Laval Migration — перестройка на ходу уровня массива, например, из RAID 0 в 5 или 10, из RAID 1 в 0, 5 или 10, из RAID 5 в 0 или 10, из RAID 10 в 0 или 5), создание нескольких массивов на одном наборе дисков и оптимизацию использования диска. Поддерживаются также основные функции контроля, такие как управление блоком, S.M.A.R.T. и SNMP. В число поддерживаемых операционных систем входят Windows 2000/XP/Server2003, NetWare 6.0 и выше, RedHat Linux, SuSE Linux, SCO UnixWare и Caldera Open Unix. BIOS контроллера содержит фирменную утилиту для контроля и настройки параметров работы контроллера и подключенных к нему дисков. Множество полезных функций менеджмента массивов доступны из-под Windows через утилиту Adaptec Storage Manager.

Разумеется, ни поддержки NCQ, ни 3 Гбит/с, ни мультипликации портов, ни последовательной раскрутки дисков здесь нет (виноват устаревший чип SiI3112A). Очевидно, что не поддерживается и новейшая технология Adaptec R.O.C. (RAID-on-Chip). Впрочем, учитывая малую пока распространенность SATA-дисков с поддержкой этих функций контроллер AAR-2410SA смотрится вполне на уровне для современных решений данного класса. Тем более что 2410SA Enclosure Kit представляет собой полностью оттестированный в сборе комплект.

Внешний вид

Мы выбрали решения Adaptec от компании Microsemi. Это RAID-контроллеры, зарекомендовавшие себя удобством использования и высокой производительностью. Их мы устанавливаем, если наш клиент решил заказать сервер произвольной или фиксированной конфигурации.

Для подключения дисков используются специальные интерфейсные кабели. Со стороны контроллера используются разъемы SFF8643. Каждый кабель позволяет подключить до 4-х дисков SAS или SATA (в зависимости от модели). Помимо этого интерфейсный кабель еще имеет восьмипиновый разъем SFF-8485 для шины SGPIO, о назначении которой поговорим чуть позже.

Помимо самого RAID-контроллера существует еще два дополнительных устройства, позволяющих увеличить надежность:

-

BBU (Battery Backup Unit) — модуль расширения с литий-ионной батареей, позволяющий поддерживать напряжение на энергозависимой микросхеме кэша. В случае внезапного обесточивания сервера его использование позволяет временно сохранить содержимое кэша, которое еще не было записано на диски.

Это особенно важно, когда включен режим отложенной записи кэша (Writeback). При пропадании электропитания содержимое кэша не будет сброшено на диски, что приведет к потере данных и, как следствие, штатная работа дискового массива будет нарушена.

Виды RAID-контроллеров

Существует два способа создать и использовать RAID-массивы: аппаратный и программный. Мы рассмотрим следующие решения:

- Linux Software RAID.

- Intel® Virtual RAID On CPU.

- LSI MegaRAID 9460-8i.

Прошивка

Необходимость прошивки RAID-контроллера возникает чаще всего для исправления выявленных производителем проблем с работой устройства. Несмотря на то, что прошивки доступны для самостоятельного обновления, к этой операции следует подойти очень ответственно, особенно если процедура выполняется на «боевой» системе.

Если нашему клиенту требуется сменить версию прошивки контроллера, то ему достаточно создать тикет в нашей панели управления. Системные инженеры выполнят перепрошивку RAID-контроллера до требуемой версии в указанное время и сделают это максимально корректно.

Важно — не следует выполнять перепрошивку самостоятельно, поскольку любая ошибка может привести к потере данных!

StorCLI

Скачиваю утилиту storcli . Доступна версия MR 7.19.

Это очень мощная утилита по управлению RAID контроллером. Сегодня нам понадобится минимум функционала для просмотра информации о дисках. Данную утилиту я планирую использовать для автоматизированного мониторинга за дисками сервера.

В архиве имеются версии storcli для разных операционных систем. Нас интересует папка Windows. Копирую оттуда утилиту storcli64.exe в удобную для себя директорию C:\zabbix\scripts .

Работать с утилитой следует с помощью командной строки.

Данная команда выведет детальную информацию.

Здесь мы увидим модель и состояние нашего контроллера AVAGO MegaRAID SAS 9460-8i. Видим что есть батарейка в состоянии Opt . Видим, что к контроллеру подключены два физических диска.

Получим список виртуальных дисков для контроллера:

Небольшое отступление. Синтаксис команды гибкий, вы можете писать параметры со слешами двумя способами: с отступами и без отступов. При работе в командной строке я предпочитаю ставить отступы, а при написании скриптов пишу без отступов, мне так удобнее.

Найден один массив RAID1 объёмом 6.985 TB в состоянии Optimal . В операционной системе это Disk 0 .

Посмотрим на физические диски:

Вижу один NVMe диск в слоте 6 и корпусе 74. Так, а где второй диск? Не знаю как устроена структура этого контроллера, но второй диск я-таки нашёл:

Вижу второй NVMe диск тоже в слоте 6 и без корпуса. Оказывается, параметр /eall отображает все диски во каждом Enclosure, а бывают диски, которые не привязаны к корпусам, это было для меня новостью.

Есть способ отобразить все диски, нужно обратиться к дисковым группам:

С аппаратным RAID

Прежде чем сервер сможет использовать единое дисковое пространство RAID-массива, необходимо выполнить базовую настройку контроллера и логических дисков. Сделать это можно двумя способами:

- при помощи внутренней утилиты контроллера,

- утилитой из операционной системы.

Утилита позволяет не только управлять настройками контроллера, но и логическими устройствами. Инициализируем физические диски (вся информация на дисках при инициализации будет уничтожена) и создадим массив RAID-10 с помощью раздела Create Array. При создании система запросит желаемый размер страйпа, то есть размер блока данных за одну I/O-операцию:

- больший размер страйпа идеален для работы с файлами большого размера;

- меньший размер страйпа подойдет для обработки большого количества файлов небольшого размера.

Важно — размер страйпа задается только один раз (при создании массива) и это значение в дальнейшем изменить нельзя.

Сразу после того, как контроллеру отдана команда создания массива, также, как и с программным RAID, начинается процесс перестроения данных на дисках. Этот процесс работает в фоновом режиме, при этом логический диск становится сразу доступен для BIOS. Производительность дисковой подсистемы будет также снижена до завершения процесса. В случае, если было создано несколько массивов, то необходимо определить загрузочный массив с помощью сочетания клавиш Ctrl + B.

После того как статус массива изменился на Optimal, мы установили Bitrix24 и провели точно такой же тест. Результат теста:

Сразу становится понятно, что аппаратный RAID-контроллер ускоряет операции чтения и записи на дисковый носитель за счет использования кэша, что позволяет быстрее обрабатывать массовые обращения пользователей.

Настройка мониторинга

Вопрос мониторинга статуса работы оборудования и возможности оповещения стоит достаточно остро для любого системного администратора. Для того чтобы настроить «связку» из Zabbix и RAID-контроллера Adaptec рекомендуем воспользоваться перечисленными решениями.

Зачастую требуется отслеживать состояние контроллера напрямую из гипервизора, например, VMware ESXi. Задача решается с помощью установки CIM-провайдера с помощью инструкции Microsemi.

Технические характеристики

LSI MegaRAID 9460-8i

Внешний вид контроллера LSI MegaRAID 9460-8i

RAID-контроллер является самостоятельным аппаратным решением. Контроллер работает только с накопителями, подключенными непосредственно к нему. Данный RAID-контроллер поддерживает до 24 накопителей с интерфейсом NVMe. Именно поддержка NVMe выделяет этот контроллер из множества других.

Главное меню аппаратного контроллера

При использовании режима UEFI настройки контроллера интегрируются в Setup Utility. В сравнении с VROC меню аппаратного контроллера выглядит значительно сложнее.

Создание RAID1 на двух дисках

Объяснение настройки дисковых массивов на аппаратном контроллере является достаточно тонкой темой и может стать поводом для полноценной статьи. Здесь же мы просто ограничимся созданием RAID0 и RAID1 с настройками по умолчанию.

Диски, подключенные в аппаратный контроллер, не видны операционной системе. Вместо этого контроллер «маскирует» все RAID-массивы под SAS-накопители. Накопители, подключенные в контроллер, но не входящие в состав дискового массива, не будут доступны ОС.

Несмотря на маскировку под SAS-накопители, массивы с NVMe будут работать на скорости PCIe. Однако такая особенность позволяет загружаться с NVMe в Legacy.

Управление контроллером

Непосредственно из операционной системы управление контроллером производится с помощью программного обеспечения, доступного для скачивания с сайта производителя. Доступны варианты для большинства операционных систем и гипервизоров:

- Debian,

- Ubuntu,

- Red Hat Linux,

- Fedora,

- SuSE Linux,

- FreeBSD,

- Solaris,

- Microsoft Windows,

- Citrix XenServer,

- VMware ESXi.

С помощью указанных утилит можно, не прерывая работу сервера, легко управлять логическими и физическими дисками. Также можно задействовать такой полезный функционал, как «подсветка диска». Мы уже упоминали про пятый кабель для подключения SGPIO — этот кабель подключается напрямую в бэкплейн (от англ. backplane — соединительная плата для накопителей сервера) и позволяет RAID-контроллеру полностью управлять световой индикацей каждого диска.

Следует помнить, что бэкплэйны поддерживают не только SGPIO, но и I2C. Переключение между этими режимами осуществляется чаще всего с помощью джамперов на самом бэкплэйне.

Каждому устройству, подключенному к аппаратному RAID-контроллеру Adaptec, присваивается идентификатор, состоящий из номера канала и номера физического диска. Номера каналов соответствуют номерам портов на контроллере.

Замена диска — штатная операция, впрочем, требующая однозначной идентификации. Если допустить ошибку при этой операции, можно потерять данные и прервать работу сервера. С аппаратным RAID-контроллером такая ошибка является редкостью.

Делается это очень просто:

-

Запрашивается список подключенных дисков к контроллеру:

Например, на платформах Supermicro штатная работа диска — зеленый или синий цвет, а «подсвеченный» диск будет моргать красным. Перепутать диски в этом случае невозможно, что позволит избежать ошибки из-за человеческого фактора.

Что такое RAID?

RAID (англ. Redundant Array of Independent Disks — избыточный массив независимых (самостоятельных) дисков) — технология виртуализации данных для объединения нескольких физических дисковых устройств в логический модуль для повышения отказоустойчивости и производительности.

Конфигурация дисковых массивов и используемые при этом технологии зависят от выбранного уровня RAID (RAID level). Уровни RAID стандартизированы в спецификации Common RAID Disk Data Format. Она описывает множество уровней RAID, однако самыми распространенными принято считать RAID0, RAID1, RAID5 и RAID6.

RAID0, или Stripes, — это уровень RAID, который объединяет два или более физических диска в один логический. Объем логического диска при этом равен сумме объемов физических дисков, входящих в массив. На этом уровне RAID отсутствует избыточность, а выход из строя одного диска может привести к потере всех данных в виртуальном диске.

Уровень RAID1, или Mirror, создает идентичные копии данных на двух и более дисках. Объем виртуального диска при этом не превышает объема минимального из физических дисков. Данные на виртуальном диске RAID1 будут доступны, пока хотя бы один физический диск из массива работает. Использование RAID1 добавляет избыточности, но является достаточно дорогим решением, так как в массивах из двух и более дисков доступен объем только одного.

Уровень RAID5 решает проблему дороговизны. Для создания массива с уровнем RAID5 необходимо как минимум 3 диска, при этом массив устойчив к выходу из строя одного диска. Данные в RAID5 хранятся блоками с контрольными суммами. Нет строгого деления на диски с данными и диски с контрольными суммами. Контрольные суммы в RAID5 — это результат операции XOR, примененной к N-1 блокам, каждый из которых взят со своего диска.

Хотя RAID-массивы повышают избыточность и предоставляют резервирование, они не подходят для хранения резервных копий.

После краткого экскурса по видам RAID-массивов можно переходить к устройствам и программам, которые позволяют собирать и использовать дисковые массивы.

Настройка кэширования

Теперь пару слов о вариантах работы кэша на запись. Вариант Write Through означает, что контроллер сообщает операционной системе об успешном выполнении операции записи только после того, как данные будут фактически записаны на диски. Это повышает надежность сохранности данных, но никак не увеличивает производительность.

Чтобы достичь максимальной скорости работы, необходимо использовать вариант Write Back. При такой схеме работы контроллер будет сообщать операционной системе об успешной IO-операции сразу после того, как данные поступят в кэш.

Важно — при использовании Write Back настоятельно рекомендуется использовать BBU или ZMCP-модуль, поскольку без него при внезапном отключении электричества часть данных может быть утеряна.

Читайте также: