Datastore vmware что это

VASA это набор API, предоставляемый VMware и предназначенный для разработки провайдеров хранилищ (storage providers) для инфраструктуры vSphere. Storage provider-ы это программные компоненты, предоставляемые vSphere или разрабатываемые 3-ей стороной, предназначенные для интеграции (отслеживания) хранилищ (программных и аппаратных СХД) и фильтров ввода-вывода (VAIO) с инфраструктурой vSphere.

Storage provider (VASA-провайдер) нужен для того, чтобы виртуальная инфраструктура:

- получала информацию о статусе, характеристиках и возможностях СХД;

- могла работать с такими сущностями как Virtual SAN and Virtual Volumes;

- могла взаимодействовать с фильтры ввода-вывода (VAIO).

VASA-провайдеры сторонних разработчиков используются как сервисы отслеживания информации о данном хранилище для vSphere. Такие провайдеры требуют отдельной регистрации и установки соответствующих плагинов.

Встроенные storage provider-ы являются компонентами vSphere и не требуют регистрации. Так, например, провайдер для Virtual SAN автоматически регистрируется при её развертывании.

vSphere посредством storage provider собирает информацию о хранилищах (характеристики, статус, возможности) и сервисах данных (фильтрах VAIO) во всей инфраструктуре, данная информация становится доступной для мониторинга и принятия решений через vSphere Web Client.

Информацию, собираемую VASA-провайдерами, можно разделить на 3 категории:

- Возможности и сервисы хранилища. Это как раз то, на основе чего формируются правила Common rules и Rules Based on Storage-Specific Data Services в SPBM – возможности и сервисы, предоставляемые Virtual SAN, vVol и фильтрами ввода-вывода.

- Состояние хранилища. Информация о состоянии и событиях на стороне хранилищ, в т.ч. тревожные события, изменения конфигурации.

- Информация Storage DRS. Данная информация позволяет учитывать внутренние процессы управления хранилищами в работе механизма Storage DRS.

К одному storage provider-у могут одновременно обращаться несколько серверов vCenter. Один vCenter может одновременно взаимодействовать с множеством storage provider-ов (несколько массивов и фильтров ввода-вывода).

VAAI — vSphere API for Array Integration / Набор API для интеграции массива

API данного типа можно разделить на 2 категории:

- Hardware Acceleration APIs. Предназначены для прозрачного переноса нагрузок по выполнению отдельных операций связанных с хранением с гипервизоров на СХД.

- Array Thin Provisioning APIs. Предназначены для мониторинга пространства на «тонких» разделах массивов для предотвращения ситуаций с нехваткой места и выполнения отзыва (неиспользуемого) пространства.

Storage Hardware Acceleration (VAAI для Hardware Acceleration)

Данный функционал обеспечивает интеграцию хостов ESXi и совместимых СХД, позволяет перенести выполнение отдельных операций по сопровождению ВМ и хранилища с гипервизора (хоста ESXi) на массив (СХД), благодаря чему увеличивается скорость выполнения данных операций, при этом снижается нагрузка на процессор и память хоста, а также на сеть хранения данных.

Storage Hardware Acceleration поддерживается для блочных (FC, iSCSI) и файловых (NAS) СХД. Для работы технологии необходимо, чтобы блочное устройство поддерживало стандарт T10 SCSI либо имело VAAI-плагин. Если блочный массив поддерживает стандарт T10 SCSI, то VAAI-плагин для поддержки Hardware Acceleration не нужен, все заработает напрямую. Файловые хранилища требуют наличия отдельного VAAI-плагина. Разработка VAAI-плагинов ложится на плечи производителя СХД.

В целом VAAI для Hardware Acceleration позволяют оптимизировать и переложить на массив следующие процессы:

- Миграция ВМ посредством Storage vMotion.

- Развертывание ВМ из шаблона.

- Клонирование ВМ или шаблонов ВМ.

- Блокировки VMFS и операции с метаданными для ВМ.

- Работа с «толстыми» дисками (блочный и файловый доступ, eager-zero диски).

- Full copy (clone blocks или copy offload). Позволяет массиву делать полную копию данных, избегая операций чтения-записи хостом. Данная операция сокращает время и сетевую нагрузку при клонировании, развертывании из шаблона или миграции (перемещении диска) ВМ.

- Block zeroing (write same). Позволяет массиву обнулять большое количество блоков, что значительно оптимизирует создание дисков типа «eager zero thick» для ВМ.

- Hardware assisted locking (atomic test and set — ATS). Позволяет избежать блокировки LUN-а с VMFS целиком (нет необходимости использовать команду SCSI reservation) благодаря поддержке выборочной блокировки отдельных блоков. Исключается потеря (снижается вероятность потери) производительности хранилища при внесении гипервизором изменений в метаданные на LUN с VMFS.

Пояснение

VMFS является кластерной ФС (файловая система) и поддерживает параллельную работу нескольких хостов ESXi (гипервизоров) с одним LUN-ом (который под неё отформатирован). На LUN-е с VMFS может размешаться множество файлов ВМ, а также метаданные. В обычном режиме, пока не вносятся изменения в метаданные, все работает параллельно, множество хостов обращается в VMFS, никто никому не мешает, нет никаких блокировок.

Если Hardware Acceleration (VAAI) не поддерживаются блочным устройством, то для внесения изменений в метаданные на VMFS каким-либо хостом приходится использовать команду SCSI reservation, LUN при этом передается в монопольное использование данному хосту, для остальных хостов на момент внесения изменений в метаданные этот LUN становится недоступен, что может вызвать ощутимую потерю производительности.

Метаданные содержат информацию о самом разделе VMFS и о файлах ВМ. Изменения метаданных происходят в случае: включения/выключения ВМ, создания фалов ВМ (создание ВМ, клонирование, миграция, добавление диска, создание снапшота), удаление файлов (удаление ВМ или дисков ВМ), смена владельца файла ВМ, увеличение раздела VMFS, изменение размера файлов ВМ (если у ВМ «тонкие» диски или используются снапшоты – это происходит постоянно).

Hardware Acceleration для VMFS не отработает и нагрузка ляжет на хост если:

- VMFS разделы источника и назначения имеют разные размеры блока

- Файл источник имеет формат RDM, файл назначения не-RDM

- Исходный файл «eager-zeroed-thick», файл назначения «тонкий»

- ВМ имеет снапшоты

- VMFS растянута на несколько массивов

- Full File Clone. Позволяет клонировать файлы ВМ на уровне устройства NAS.

- Reserve Space. Позволяет резервировать пространство для ВМ с «толстыми» дисками (по умолчанию NFS не резервирует пространство и не позволяет делать «толстые» диски).

- Native Snapshot Support. Поддержка создания снапшотов ВМ на уровне массива.

- Extended Statistics. Даёт возможность увидеть использование пространства на массиве.

Multipathing Storage APIs — Pluggable Storage Architecture (PSA) / Набор API для мультипафинга

Для управления мультипафингом гипервизор ESXi использует отдельный набор Storage APIs называемый Pluggable Storage Architecture (PSA). PSA – открытый модульный каркас (framework), координирующий одновременную работу множества плагинов мультипафинга (multipathing plug-ins – MPPs). PSA позволяет производителям разрабатывать (интегрировать) собственные технологии мультипафинга (балансировки нагрузки и восстановления после сбоя) для подключения своих СХД к vSphere.

PSA выполняет следующие задачи:

- Загружает и выгружает плагины мультипафинга

- Скрывает от ВМ специфику работы плагинов мультипафинга

- Направляет запросы ввода-вывода MPP

- Обрабатывает очереди ввода-вывода

- Распределяет полосу пропускания между ВМ

- Выполняет обнаружение и удаление физических путей

- Собирает статистику ввода-вывода

NMP в свою очередь также является расширяемым модулем, управляющим двумя наборами плагинов: Storage Array Type Plug-Ins (SATPs), and Path Selection Plug-Ins (PSPs). SATPs и PSPs могут быть встроенными плагинами VMware или разработками сторонних производителей. При необходимости разработчик СХД может создать собственный MPP для использования в дополнение или вместо NMP.

SATP отвечает за восстановление пути посте сбоя (failover): мониторинг состояния физических путей, информирование об изменении их состояния, переключение со сбойного пути на рабочий. NMP предоставляет SATPs для всех возможных моделей массивов, поддерживаемых vSphere, и осуществляет выбор подходящего SATP.

PSP отвечает за выбор физического пути передачи данных. NMP предлагает 3 встроенных варианта PSP: Most Recently Used, Fixed, Round Robin. Основываясь на выбранном для массива SATP, модуль NMP делает выбор варианта PSP по умолчанию. При этом vSphere Web Client дает возможность выбрать вариант PSP вручную.

Принцип работы вариантов PSP:

-

Most Recently Used (MRU) – хост выбирает путь который использовался последним (недавно). Если этот путь становится недоступен, то хост переходит на альтернативный путь. Возврат к первоначальному пути после его восстановления не происходит. Возможность задания предпочитаемого пути отсутствует. MRU – вариант по умолчанию для большинства active-passive массивов.

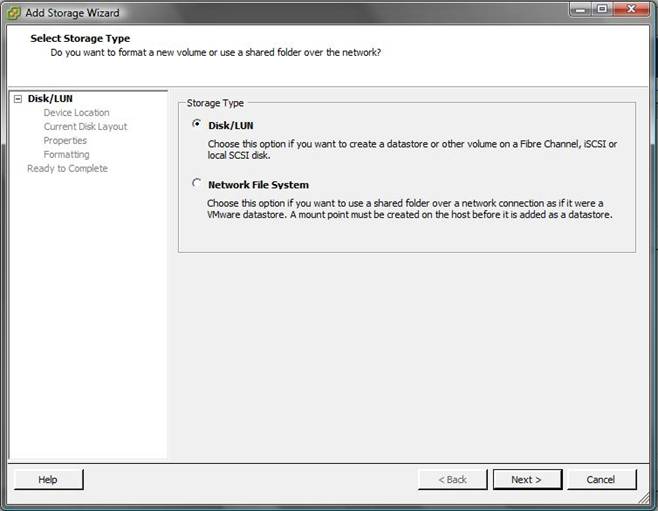

Перед тем, как приступить к созданию разделов VMFS , следует уяснить один нюанс: VMFS хранилище может находится только на устройстве хранения SCSI.

Это может быть локальный SCSI диск (с или без RAID), или общее хранилище (shared storage), такое как SAN устройство (iSCSI или Fibre Channel) или же NFS.

Устройство хранения и сервер ESX должны быть настроены таким образом, чтобы хранилище было видно и доступно серверу ESX.

Предварительно рекомендую познакомится со статьями: основы настройки хранилищ iSCSI, а также iSCSI с аутентификацией CHAP.

Мы предполагаем, что эти настройки уже выполнены, поэтому мы можем продолжить.

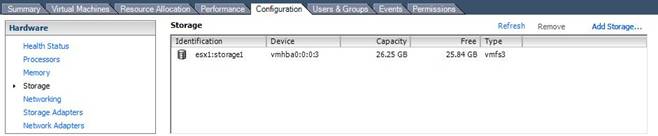

1. Перейдите на вкладку сервера «Configuration», затем выберите раздел «Storage».

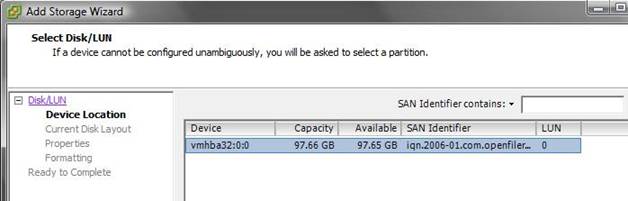

4. Перед вами появится список еще не задействованных LUN. Выберите LUN, который вы планируете использовать как хранилище VMFS и нажмите Далее.

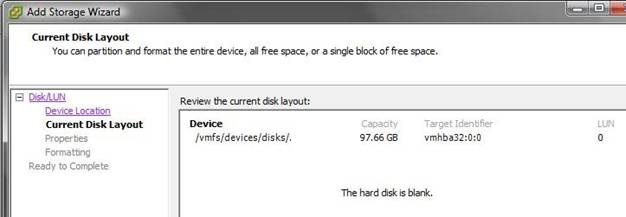

5. Еще раз познакомьтесь со свойствами диска, после чего нажмите кнопку Далее

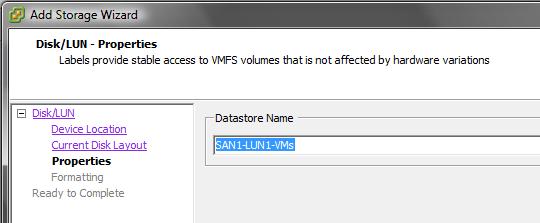

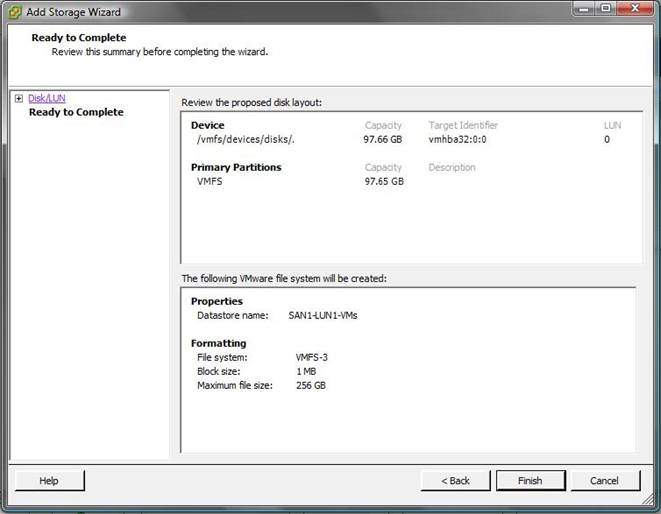

6. Укажите имя создаваемого хранилища имя, это имя в дальнейшем будет использоваться вами для его идентификации. Нажмите Далее.

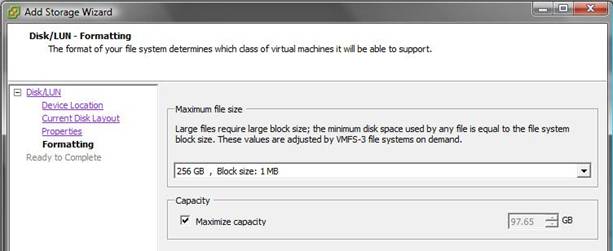

В том случае, если у вас не будет виртуальных дисков размером больше чем 256 Гб каждый, то можете выбрать размер блока равный 1 Мб. Нажмите Далее …

9. Запустится задача (task) с именем «Create VMFS Datastore». После окончания этого процесса, новое хранилище VMFS готово к использованию.

10. Это хранилище теперь видимо и доступно на вкладке «Storage» в разделе настроек сервера.

В этой статье мы опишем типы хранилищ данных, которые используются в VMware vSphere 7.0.

Файловая система виртуальной машины (VMFS)

Virtual Machine File System (VMFS) – это тип хранилища данных, который развертывается на блочных устройствах хранения, и представляет собой специальный формат высокопроизводительной файловой системы, оптимизированный для хранения виртуальных машин.

Вы можете создавать хранилища данных VMFS на Fibre Channel, iSCSI, FCoE и локальных устройствах хранения. ESXi 7.0 поддерживает VMFS версий 5 и 6 для чтения и записи. ESXi 7.0 не поддерживает VMFS версии 3.

При работе с хранилищами данных VMFS в vSphere 7.0 учитывайте следующее:

Размер блока: Размер блока в хранилище данных VMFS определяет максимальный размер файла и объем пространства, занимаемого файлом. Хранилища данных VMFS версий 5 и 6 поддерживают размер блока 1 МБ.

Storage vMotion: Storage vMotion поддерживает миграцию между хранилищами данных VMFS, vSAN и vVols. vCenter Server выполняет проверку совместимости для подтверждения Storage vMotion между различными типами хранилищ данных.

Storage DRS: VMFS версии 5 и версии 6 могут сосуществовать в одном кластере хранилищ данных. Однако все хранилища данных в кластере должны использовать однородные устройства хранения. Не смешивайте устройства разных форматов в одном кластере хранилищ данных.

Форматы разделов устройств: Любое новое хранилище данных VMFS версии 5 или 6 использует таблицу разделов GUID (GPT) для форматирования устройства хранения, что означает возможность создания хранилищ данных размером более 2 ТБ. Если ваше хранилище данных VMFS версии 5 было ранее обновлено с VMFS версии 3, оно продолжает использовать формат разделов Master Boot Record (MBR), характерный для VMFS версии 3. Преобразование в GPT происходит только после расширения хранилища данных до размера более 2 ТБ.

Сетевая файловая система (NFS)

Клиент NFS, встроенный в ESXi, использует протокол Network File System (NFS) через TCP/IP для доступа к тому NFS, расположенному на сервере NAS.

Хост ESXi может смонтировать том и использовать его в качестве хранилища данных NFS.

Вы можете создавать хранилища данных NFS на устройствах NAS. ESXi 7.0 поддерживает NFS версий 3 и 4.1. Для поддержки обеих версий ESXi 7.0 использует два разных клиента NFS.

VMware vSAN – это распределенный уровень программного обеспечения, который работает как часть гипервизора.

vSAN объединяет локальные или подключенные напрямую устройства хранения кластера хостов ESXi и создает единый пул хранения, общий для всех хостов в кластере vSAN.

В кластере vSAN можно создать хранилище данных vSAN. vSAN – это гиперконвергентное решение для хранения данных, которое объединяет хранение, вычисления и виртуализацию на одном физическом сервере или кластере.

В следующем разделе описаны концепции, преимущества и терминология, связанные с vSAN.

Виртуальные тома VMware vSphere (vVols)

Функциональность VMware vSphere Virtual Volumes (vVols) изменяет парадигму управления хранением данных: от управления пространством внутри хранилищ данных к управлению абстрактными объектами хранения, обрабатываемыми массивами хранения.

С vVols единицей управления хранением становится отдельная виртуальная машина, а не хранилище данных. А оборудование хранения получает полный контроль над содержимым виртуальных дисков, их расположением и управлением.

Вы можете создать хранилище данных vVols в среде с совместимой системой хранения.

Виртуальный том, созданный и управляемый вне группы провайдером vSphere APIs for Storage Awareness (VASA), представляет собой контейнер хранения в vSphere.

Провайдер VASA сопоставляет объекты виртуальных дисков и их производные, такие как клоны, моментальные снимки и реплики, непосредственно с виртуальными томами на системе хранения.

Хосты ESXi получают доступ к виртуальным томам через промежуточную точку в пути данных, называемую конечной точкой протокола.

Конечные точки протокола служат шлюзами для ввода-вывода между хостами ESXi и системой хранения данных, используя Fibre Channel, FCoE, iSCSI или NFS.

Заключение

Датасторы – это важнейшие компоненты VMware vSphere 7, используемые для хранения виртуальных машин, ISO и другой важной информации.

VMFS и NFS – это традиционные модели виртуализации хранилищ, которые относятся к логической абстракции физических ресурсов и емкостей хранения от виртуальных машин и их приложений.

VMware vSAN и VMware vSphere Virtual Volumes (vVols) – это программно-определяемые модели хранения, которые абстрагируют возможности хранения.

В программно-определяемой модели хранения ВМ становится единицей предоставления хранилища и может управляться с помощью гибкого механизма на основе политик.

Представляю вашему вниманию заключительную публикацию о технологиях хранения VMware vSphere 6. В ней будет рассмотрена технология VVOL.

Описание технологии VVOL

Во всех редакциях VMware до vSphere 6 ВМ (виртуальные машины) хранились в виде файлов в файловой системе. В случае массива с блочным доступом использовалась собственная файловая система VMware – VMFS, для файловых хранилищ использовались NFS. Емкость массива делилась на LUNы или NFS-шары и презентовалась (монтировалась к) хостам ESXi в виде датастор (datastore). Датасторы, как правило, имеют большой объем (от 1 ТБ) и размещают на себе множество ВМ (5-10 и более). В первую очередь это связано с тем, что выделение отдельной datastore под каждую ВМ слишком неудобно и трудозатратно в плане администрирования.

При таком подходе гранулярность операций сопровождения хранилища ВМ силами массива находится на уровне datastore (LUN или NFS-шара целиком), а не на уровне отдельных ВМ. Имеются в виду такие операции, как снапшоты, репликация, дедупликация, шифрование, QoS. Они выполняются на уровне СХД, а не средствами гипервизора, что позволяет осуществлять их быстрее, при этом разгружая вычислительные ресурсы хостов и сеть передачи данных. В первую очередь это касается блочного доступа с VMFS, некоторые модели файловых массивов (например, NetApp) дают гранулярность на уровне отдельных ВМ – например, СХД позволяет сделать снапшот отдельной ВМ, а не datastore целиком.

Описанная выше традиционная технология хранения ВМ в vSphere 6 по прежнему поддерживается, но в дополнение к ней была разработана концепция Virtual Volumes (VVOL), предполагающая объектное хранение ВМ на массивах, поддерживающих данную технологию, независимо от их типа (блочные или файловые).

VVOL – это объект, содержащий файлы ВМ, виртуальные диски и их производные. СХД с поддержкой VVOL получает возможность непосредственной работы с данными объектами за счет собственных аппаратных ресурсов. Как правило, каждый VVOL имеет уникальный GUID для идентификации. Нет необходимости заранее выделять пространство под VVOL, они создаются автоматом при выполнении операций с ВМ: создание, клонирование, снапшотинг.

vSphere (хосты ESXi и vCenter) ассоциирует с ВМ один или несколько VVOL:

• VVOL данных, соответствующий файлу виртуального диска (.vmdk);

• VVOL конфигурации — небольшая домашняя директория, содержащая метаданные ВМ (включая файл .vmx, файлы дескрипторы виртуальных дисков, log-файлы и т.п.). Данный тип VVOL форматируется в VMFS или NFS, в зависимости от типа СХД (блочная или файловая).

• Дополнительные VVOL могут создаваться для остальных компонент ВМ (например, VVOL для swap-файла или файла ОЗУ ВМ для снапшота) или производных виртуальных дисков (клоны, реплики, снапшоты).

Благодаря VVOL мы получаем гранулярность управления хранилищем на уровне отдельных ВМ и можем напрямую задействовать для этого ресурсы СХД. VVOL позволяют использовать гибкие возможности управления хранилищем на основе политик SPBM. Деление данных ВМ на VVOL нескольких типов позволяет размещать их на хранилища с разным уровнем сервиса: VVOL данных на производительный tier с высоким уровнем сервиса, VVOL с конфигурацией или второстепенным диском ВМ на более простые tier.

Для хранения VVOL не нужны классические LUNы или NFS-шары. VVOL хранятся на условно «сыром» пространстве СХД в объектах, называемых storage container. Storage container-ы это логические единицы пространства массива, их количество и ёмкость определяются конкретной СХД и инфраструктурой. Как минимум 1 storage container должен быть создан на СХД, нельзя растягивать 1 storage container на несколько физических массивов.

Storage container-ы логически группируют VVOL из соображений администрирования или управления: можно создавать отдельные storage container-ы для разных заказчиков, департаментов или групп ВМ. Один storage container может включать несколько профилей сервиса, таким образом, на одном и том же storage container могут размещаться ВМ с разными требованиями к обслуживанию и политиками хранения.

Для интеграции СХД с vSphere, для того, чтобы vCenter и гипервизоры могли работать с VVOL и подключиться к storage container необходимо развертывание и регистрация на vCenter специального storage provider-а на базе VASA (VMware APIs for Storage Awareness) для VVOL, который должен разрабатываться и предоставляться производителем СХД.

Для доступа хостов ESXi к VVOL используются логические прокси ввода-вывода, называемы protocol endpoints. ESXi использует protocol endpoints для установления data-path по требованию между ВМ и её VVOL. Каждый VVOL подключен к определенному protocol endpoints. Как правило, СХД требует небольшое количество protocol endpoints, поскольку 1 protocol endpoints может обслуживать множество ВМ (сотни и тысячи).

VVOL поддерживают основные протоколы СХД: Fibre Channel, FCoE, iSCSI, и NFS, аналогично традиционном хранилищам vSphere.

Для поддержки VVOL необходимо использование HBA-адаптеров и версий драйверов для них, адаптированных к работе с (поддерживающих) VVOL.

На стороне СХД происходит конфигурирование protocol endpoints – по одному или несколько на storage container. Protocol endpoints являются частью СХД и предоставляются хостам вместе с ассоциированными storage container-ами через storage provider. vSphere Web Client отображает protocol endpoints, подключенные к инфраструктуре, через T10-based LUN WWN для блочных массивов и IP/DNS для файловых. Protocol endpoints поддерживают мультипафинг только для SCSI-вариантов подключений (для NFS не поддерживается).

Storage container-ы подключаются к инфраструктуре в виде virtual datastore, эти сущности являются их прямым отображением в vSphere Web Client. Virtual datastore аналогичны обычным datastore vSphere, могут отображать VVOL по именам ВМ, их можно монтировать и размонтировать. Однако их конфигурирование, в т.ч. изменение размера осуществляется на уровне СХД за пределами vSphere. Virtual datastore могут использоваться совместно с обычными VMFS и NFS datastore, а также с Virtual SAN.

Размещение ВМ на virtual datastore (с использованием VVOL) требует наличия политик хранения (SPBM). Политика хранения ВМ (VM storage policy) содержит наборы правил по размещению и качеству сервиса для ВМ и гарантирует их выполнение. При отсутствии конкретных политик система будет использовать политику по умолчанию без ограничений, в этом случае массив самостоятельно выберет оптимальное размещение ВМ на свое усмотрение.

Преимущества и недостатки VVOL

Важными преимуществами технологии являются поддержка создания снапшотов и клонов отдельных ВМ на уровне и за счет ресурсов СХД, а также обеспечение таких сервисов как репликация, шифрование, дедупликация и сжатие отдельных виртуальных дисков. Отдельно следует отметить поддержку SPBM, которая открывает большой потенциал управления хранением ВМ на основе политик.

Продукты VMware поддерживающие VVOL:

• VMware vSphere 6.0.x

• VMware vRealize Automation 6.2.x

• VMware Horizon 6.1.x

• VMware vSphere Replication 6.0.x

Продукты VMware НЕ поддерживающие VVOL:

• VMware vRealize Operations Manager 6.0.x to 6.1.0

• VMware Site Recovery Manager 5.x to 6.1.0

• VMware vSphere Data Protection 5.x to 6.1.0

• VMware vCloud Director 5

Технологии VMware поддерживающие VVOL:

• High Availability (HA)

• Linked Clones

• Native Snapshots

• NFS version 3.x

• Storage Policy Based Management (SPBM)

• Storage vMotion

• Thin Provisioning

• View Storage Accelerator/Content Based Read Cache (CBRC)

• Virtual SAN (VSAN)

• vSphere Auto Deploy

• vSphere Flash Read Cache

• vSphere Software Development Kit (SDK)

• vSphere API for I/O Filtering (VAIO)

• vMotion

• xvMotion

• VADP

Технологии VMware НЕ поддерживающие VVOL:

• Fault Tolerance (FT)

• IPv6

• Microsoft Failover Clustering

• NFS version 4.1

• Raw Device Mapping (RDM)

• SMP-FT

• Storage Distributed Resource Scheduler (SDRS)

• Storage I/O Control

Есть предположение, что VMware делает ставку на VVOL, их развитие, и в скором будущем технология станет совместима со всеми решениями вендора. Возможно, в перспективе VVOL станут основной технологией хранения VMware, которая приведет к постепенному уходу от устаревших традиционных хранилищ и прекращению их поддержки.

На момент публикации статьи из 200 (примерно) производителей систем хранения, продукты которых совместимых с vSphere (согласно VMware Compatibility Guide), лишь 18 поддерживают VVOL. Реальных отзывов о практическом использовании VVOL мне найти не удалось: ни в Интернетах, ни на форуме VMware VMUG (даже на буржуйском). Отсутствие совместимости VVOL c перечисленными выше технологиями на данном этапе заставит многих заказчиков отказаться от VVOL, поскольку несовместимая с VVOL технология или их набор зачастую могут оказаться важнее для многих инфраструктур.

Из этого можно сделать вывод, что теоретически технология VVOL очень интересная и полезная. Однако, на данном этапе её практичность и необходимость внедрения вызывают сомнения. Нужен положительный опыт применения в продакшене и нужна совместимость с другими важными фичами vSphere, пока этого нет.

Спасибо за внимание, на этом цикл статей по технологиям хранения vSphere 6 закончен. В следующей статье будут рассмотрены решения VMware для репликации и аварийного восстановления (DR): vSphere Replication и Site Recovery Manager (SRM).

In VMware vSphere we can use the iSCSI Storage as a shared storage for our ESXi hosts. We can create the datastore from the iSCSI Storage LUN’s. So in this post we will see on how to add iSCSI datastore to your vSphere so that you can use it as shared storage.

Configuring the ISCSi Software Adapter in vCenter:-

Step 1:

Login to vSphere Web Client.

Choose the Hosts & Clusters from the Home Screen.

Step 2:

Choose the Host on which you want to add iSCSI Storage.

Click on Manage.

Click on Storage.

Click on Storage Adapters.

Now you will see small Green plus icon click on it & choose “Software iSCSI adapter”.

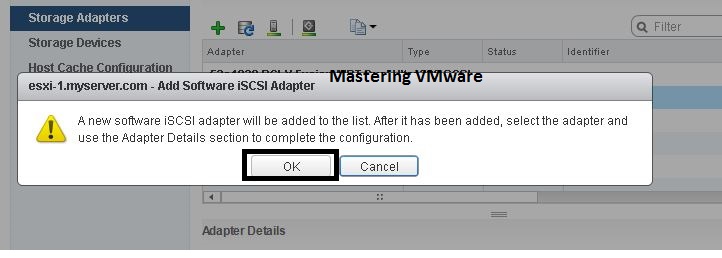

Step 3:

You might get warning message don’t worry just click OK to add new adapter.

Step 4:

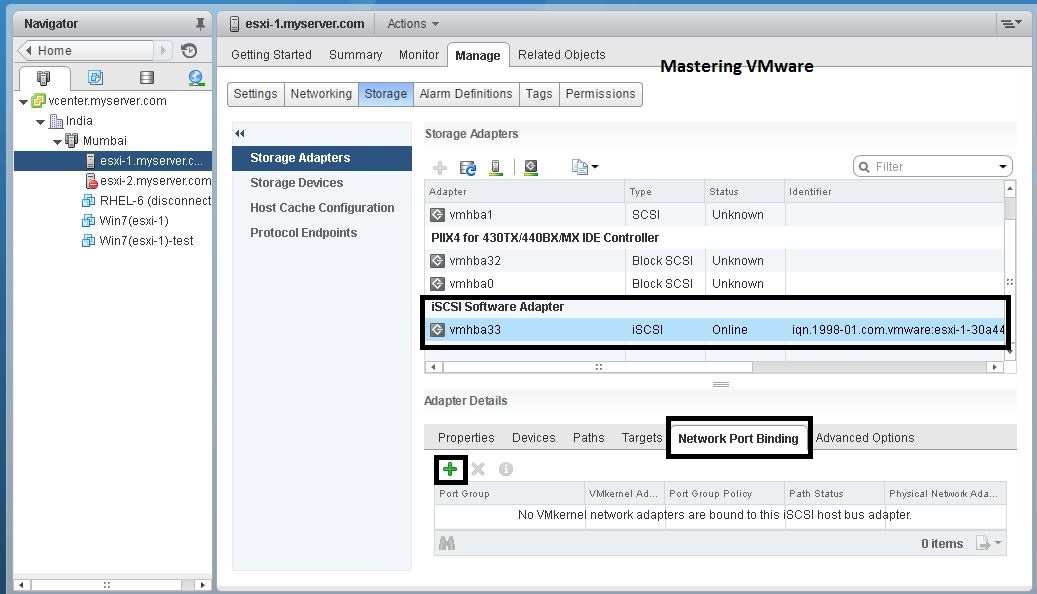

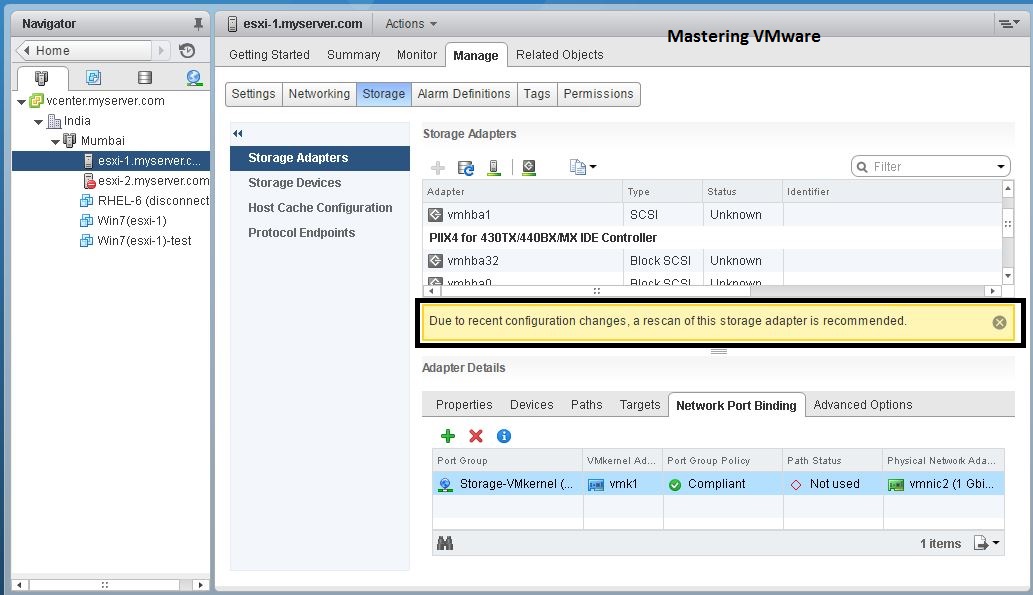

Now you can see that your iSCSI Software Adapter is listed.

Click on Network Port Binding Tab.

Click on Green plus icon.

Step 5:

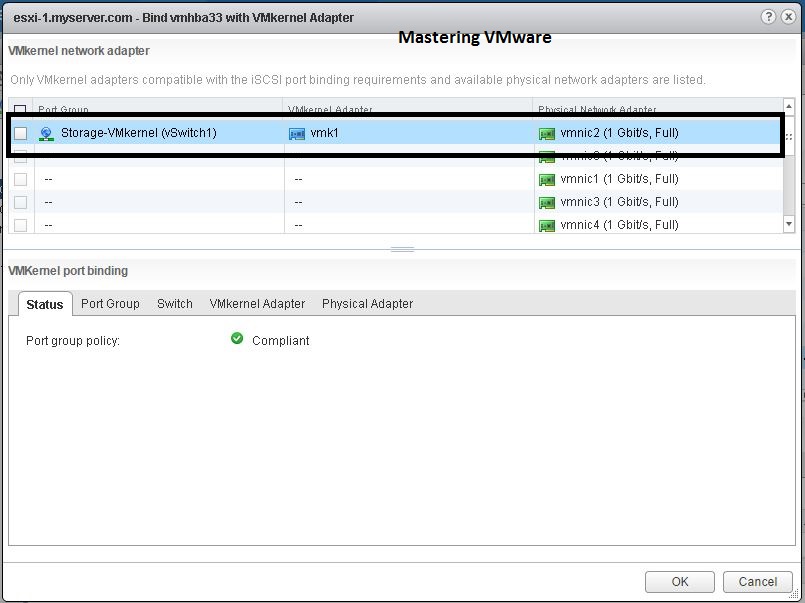

You will require the VMkernel Adapter to add iscsi storage.

So either you can create new standard switch or you can use existing but it is recommended to use different switch for storage.

Now here choose the Switch you want to use .

Click OK to add.

Step 6:

Now you will see that your switch is listed in Network Port Binding.

You might see the Message to re scan configuration don’t worry you can close it.

Step 7:

Now click on Targets Tab.

Choose Dynamic Discovery.

Click Add button.

Step 8:

Provide the IP address or host name of your iSCSI Target Server in my case i have created iSCSI Target Server in Windows server so i am providing that IP address.

Leave Port as it is.

Click OK to add.

Step 9:

Click on Paths Tab if you don’t see your iSCSI Target Server choose the icon to Rescan all the Storage Adapters.

It will rescan all the available storage adapters & vmfs.

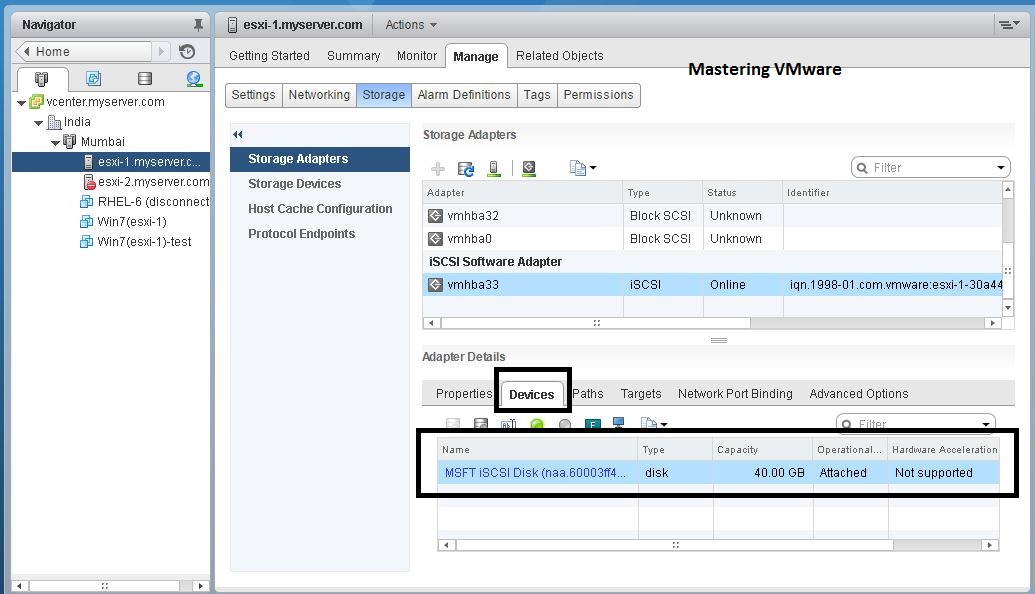

Step 10:

Now click on Devices Tab you can see your iSCSI Target Server is listed here.

Now we have successfully added the iSCSI Target Server now we will add the new datastore for the iSCSI Storage.

So Now let’s see step by step How to add ISCSi Datastore.

Step 11:

Choose the Host on which you want to add datastore.

Right click > Storage > New Datastore.

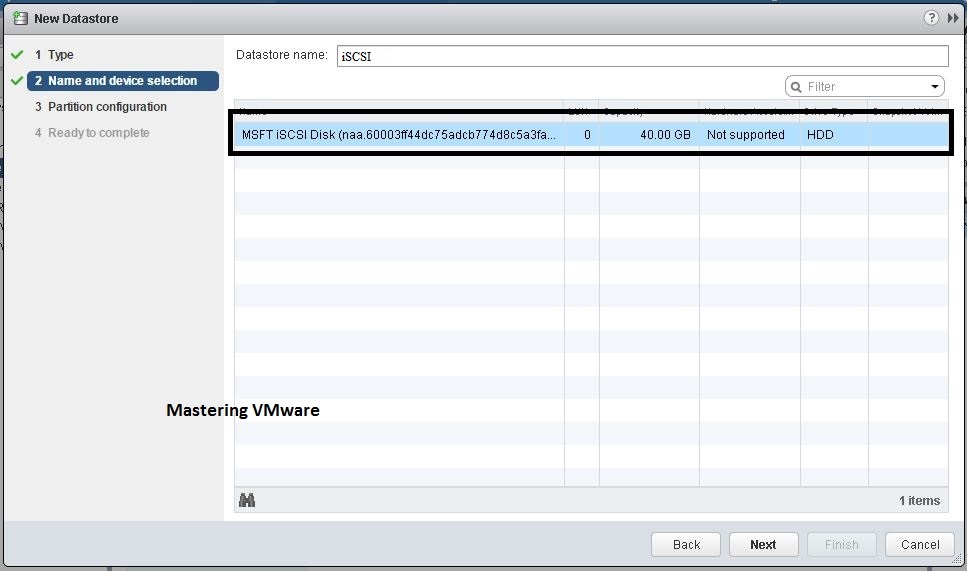

Step 12:

New Datastore wizard will open.

Choose the Type of the datastore.

We will be using VMFS so choose the VMFS .

Click Next to proceed.

Step 13:

Here you can provide the datastore name.

Choose your iSCSI Target Server which is listed.

Click Next to continue.

Step 14:

Here you have to provide the how much datastore size you want to allocate.

You can specify it according to your requirement.

Click Next to proceed.

Step 15:

Review all the configurations & click Finish to save & add the datastore.

Now you can see your iSCSI datastore is listed successfully.

That’s it you have successfully add iSCSI Target Server to vSphere & added iSCSI datastore. But this we have added for one host for adding it to another host you have to follow all the steps again.

So now you can have shared storage between the multiple hosts.

Checkout Our Posts on creating & configuring the iSCSI Storage in Windows Server & Openfiler :-

Creating & Configuring iSCSI in Windows Server 2012 R2:-

- How to install iSCSI Target Server in Windows Server ?

- How to create iSCSI Target Server in Windows Server Part-1.

- How to create iSCSI Target Server in Windows Server Part-2.

Creating & Configuring iSCSI in Openfiler :-

That’s it for Today Friends. I Hope you liked reading this post & If you find anything more to be added or removed feel free to write it in our comments. If you find it useful You are Feel free to share this on social media to help others & spread knowledge.

If you have any query on any thing you are free to write it in our comments section & we will make sure to provide you the better solution as soon as possible.

Checkout our Facebook Group for discussions & more.

You can also Like & Share our Facebook Page for Latest Updates.

Читайте также: