Что такое пиксельная частота

Современные графические процессоры содержат множество функциональных блоков, от количества и характеристик которых зависит и итоговая скорость рендеринга, влияющая на комфортность игры. По сравнительному количеству этих блоков в разных видеочипах можно примерно оценить, насколько быстр тот или иной GPU. Характеристик у видеочипов довольно много, в этом разделе мы рассмотрим самые важные из них.

Тактовая частота видеочипа

Рабочая частота GPU измеряется в мегагерцах, в миллионах тактов в секунду. Эта характеристика прямо влияет на производительность видеочипа, чем она выше, тем больший объем работы чип может выполнить в единицу времени, обработать большее количество вершин и пикселей. Пример из реальной жизни: частота видеочипа, установленного на плате RADEON X1900 XTX равна 650 МГц, а точно такой же чип на RADEON X1900 XT работает на частоте в 625 МГц. Соответственно будут отличаться и все основные характеристики производительности. Но далеко не только рабочая частота чипа однозначно определяет производительность, на его скорость сильно влияет и архитектура: количество различных исполнительных блоков, их характеристики и т.п.

В последнее время участились случаи, когда тактовая частота для отдельных блоков GPU отличается от частоты работы всего остального чипа. То есть, разные части GPU работают на разных частотах, и сделано это для увеличения эффективности, ведь некоторые блоки способны работать на повышенных частотах, а другие — нет. Из последних примеров можно назвать семейство GeForce 8800 от NVIDIA, видеочип модели GTS работает на частоте 512 МГц, но универсальные шейдерные блоки тактуются на значительно более высокой частоте — 1200 МГц.

Скорость заполнения (филлрейт)

Скорость заполнения показывает, с какой скоростью видеочип способен отрисовывать пиксели. Различают два типа филлрейта: пиксельный (pixel fill rate) и текстурный (texel rate). Пиксельная скорость заполнения показывает скорость отрисовки пикселей на экране и зависит от рабочей частоты и количества блоков ROP (блоков операций растеризации и блендинга), а текстурная — это скорость выборки текстурных данных, которая зависит от частоты работы и количества текстурных блоков.

Например, пиксельный филлрейт у GeForce 7900 GTX равен 650 (частота чипа) * 16 (количество блоков ROP) = 10400 мегапикселей в секунду, а текстурный — 650 * 24 (кол-во блоков текстурирования) = 15600 мегатекселей/с. Чем больше первое число - тем быстрее видеокарта может отрисовывать готовые пиксели, а чем больше второе - тем быстрее производится выборка текстурных данных. Оба параметра важны для современных игр, но они должны быть сбалансированы. Именно поэтому количество блоков ROP в чипах семейства G7x, на которых построено семейство GeForce 7, меньше количества текстурных и пиксельных блоков.

Количество блоков пиксельных шейдеров (или пиксельных процессоров)

Пиксельные процессоры — это одни из главных блоков видеочипа, которые выполняют специальные программы, известные также как пиксельные шейдеры. По числу блоков пиксельных шейдеров и их частоте можно сравнивать шейдерную производительность разных видеокарт. Так как большая часть игр сейчас ограничена производительностью исполнения пиксельных шейдеров (см. технологические обзоры игр), то количество этих блоков очень важно! Если одна модель видеокарты основана на GPU с 8 блоками пиксельных шейдеров, а другая из той же линейки — 16 блоками, то при прочих равных вторая будет вдвое быстрее обрабатывать пиксельные программы, и в целом будет производительнее. Но на основании одного лишь количества блоков делать однозначные выводы нельзя, обязательно нужно учесть и тактовую частоту и разную архитектуру блоков разных поколений и производителей чипов. Чисто по этим цифрам прямо можно сравнивать чипы только в пределах одной линейки одного производителя: AMD(ATI) или NVIDIA. В других же случаях нужно обращать внимание на тесты производительности в интересующих играх.

Количество блоков вершинных шейдеров (или вершинных процессоров)

Аналогично предыдущему пункту, эти блоки выполняют программы шейдеров, но уже вершинных. Данная характеристика важна для некоторых игр, но не так явно, как предыдущая, так как даже современными играми блоки вершинных шейдеров почти никогда не бывают загружены даже наполовину. И, так как производители балансируют количество разных блоков, не позволяя возникнуть большому перекосу в распределении сил, количеством вершинных процессоров при выборе видеокарты вполне можно пренебречь, учитывая их только при прочих равных характеристиках.

Количество унифицированных шейдерных блоков (или универсальных процессоров)

Унифицированные шейдерные блоки объединяют два типа перечисленных выше блоков, они могут исполнять как вершинные, так и пиксельные программы (а также геометрические, которые появились в DirectX 10). Впервые унифицированная архитектура была применена в видеочипе игровой консоли Microsoft Xbox 360, этот графический процессор был разработан компанией ATI. А в видеочипах для персональных компьютеров унифицированные шейдерные блоки появились не так давно, с появлением плат NVIDIA GeForce 8800. И, похоже, что все DirectX 10 совместимые видеочипы будут основаны на подобной унифицированной архитектуре. Унификация блоков шейдеров значит, что код разных шейдерных программ (вершинных, пиксельных и геометрических) универсален, и соответствующие унифицированные процессоры могут выполнить любые программы из вышеперечисленных. Соответственно, в новых архитектурах число пиксельных, вершинных и геометрических шейдерных блоков как бы сливается в одно число — количество универсальных процессоров.

Блоки текстурирования (TMU)

Эти блоки работают совместно с шейдерными процессорами всех указанных типов, ими осуществляется выборка и фильтрация текстурных данных, необходимых для построения сцены. Число текстурных блоков в видеочипе определяет текстурную производительность, скорость выборки из текстур. И хотя в последнее время большая часть расчетов осуществляется блоками шейдеров, нагрузка на блоки TMU до сих пор довольно велика, и с учетом упора некоторых игр в производительность блоков текстурирования, можно сказать, что количество блоков TMU и соответствующая высокая текстурная производительность являются одними из важнейших параметров видеочипов. Особое влияние этот параметр оказывает на скорость при использовании трилинейной и анизотропной фильтраций, требующих дополнительных текстурных выборок.

Блоки операций растеризации (ROP)

Блоки растеризации осуществляют операции записи рассчитанных видеокартой пикселей в буферы и операции их смешивания (блендинга). Как мы уже отмечали выше, производительность блоков ROP влияет на филлрейт и это — одна из основных характеристик видеокарт всех времен. И хотя в последнее время её значение несколько снизилось, еще попадаются случаи, когда производительность приложений сильно зависит от скорости и количества блоков ROP (см. технологические обзоры игр). Чаще всего это объясняется активным использованием фильтров постобработки и включенным антиалиасингом при высоких игровых настройках.

Нужно еще раз отметить, что современные видеочипы нельзя оценивать только числом разнообразных блоков и их частотой. Каждая серия GPU использует новую архитектуру, в которой исполнительные блоки сильно отличаются от старых, да и соотношение количества разных блоков может отличаться. Компания ATI первой применила архитектуру, в которой количество блоков пиксельных шейдеров было в разы больше числа блоков текстурирования. Это было сделано немного преждевременно, на наш взгляд, но в некоторых приложениях пиксельные блоки используются более активно, чем остальные и для таких приложений подобное решение будет неплохим вариантом, не говоря уже о будущем. Также, в предпоследней архитектуре AMD(ATI) нет отдельных пиксельных конвейеров, пиксельные процессоры не «привязаны» к блокам TMU. Впрочем, у NVIDIA в GeForce 8800 получилось еще сложнее.

Рассмотрим ситуацию на примере видеокарт GeForce 7900 GT и GeForce 7900 GS. Обе они имеют одинаковые рабочие частоты, интерфейс памяти и даже одинаковый видеочип. Но модификация 7900 GS использует GPU с 20 активными блоками пиксельных шейдеров и текстурных блоков, а видеокарта 7900 GT — по 24 блока каждого типа. Рассмотрим разницу в производительности этих двух решений в игре Prey:

Разница в количестве основных исполнительных блоков в 20% дала разный прирост скорости в тестовых разрешениях. Значение 20% оказалось недостижимо потому, что производительность в Prey не ограничена на этих видеокартах только скоростью блоков TMU и ROP. Разница в разрешении 1024x768 составила меньше 8%, а в более высоких достигла 12%, что ближе к теоретической разности в количестве исполнительных блоков.

Объем видеопамяти

Собственная память используется видеочипами для хранения необходимых данных: текстур, вершин, буферов и т.п. Казалось бы, что чем её больше — тем лучше. Но не всё так просто, оценка мощности видеокарты по объему видеопамяти — это наиболее распространенная ошибка! Значение объема памяти неопытные пользователи переоценивают чаще всего, используя его для сравнения разных моделей видеокарт. Оно и понятно — раз параметр, указываемый во всех источниках одним из первых, в два раза больше, то и скорость у решения должна быть в два раза выше, считают они. Реальность же от этого мифа отличается тем, что рост производительности растет до определенного объема и после его достижения попросту останавливается.

В каждой игре есть определенный объем видеопамяти, которого хватает для всех данных, и хоть 4 ГБ туда поставь — у нее не появится причин для ускорения рендеринга, скорость будут ограничивать исполнительные блоки, о которых речь шла выше. Именно поэтому почти во всех случаях видеокарта с 320 Мбайт видеопамяти будет работать с той же скоростью, что и карта с 640 Мбайт (при прочих равных условиях). Ситуации, когда больший объем памяти приводит к видимому увеличению производительности, существуют, это очень требовательные игры в высоких разрешениях и при максимальных настройках. Но такие случаи весьма редки, поэтому, объем памяти учитывать нужно, но не забывая о том, что выше определенного объема производительность просто не растет, есть более важные параметры, такие как ширина шины памяти и ее рабочая частота. Подробнее о выборе объема видеопамяти читайте во второй части статьи.

Ширина шины памяти

Частота видеопамяти

Рассмотрим относительную производительность видеокарт с разной пропускной способностью на примере видеокарт RADEON X1900 XTX и RADEON X1950 XTX, которые используют почти одинаковые GPU с одними характеристиками и частотой. Основные их отличия состоят в типе и частоте используемой памяти — GDDR3 на частоте 775(1550) МГц и GDDR4 на 1000(2000) МГц, соответственно.

Хорошо видно, как отстает карта с меньшей пропускной способностью памяти, хотя разница никогда не достигает теоретических 29%. Разница между достигнутой частотой кадров растет с увеличением разрешения, начинаясь с 8% в 1024x768 и достигая 12-13% в максимальных режимах. Но это сравнение видеокарт с небольшой разницей в ПСП, а особенное внимание на параметры ширины шины памяти и частоты ее работы следует уделять при покупке недорогих видеокарт, на многие из которых ставят лишь 64-битные интерфейсы, что сильно сказывается на их производительности. Вообще, покупка решений на базе 64-бит шины для игр вовсе не рекомендуется.

Типы памяти

На видеокарты устанавливают несколько различных типов памяти. Старую SDR память с одинарной скоростью передачи мы рассматривать не будем, её уже почти нигде не встретишь. Все современные типы памяти DDR и GDDR позволяют передавать в два раза большее количество данных на той же тактовой частоте за единицу времени, поэтому цифру её рабочей частоты зачастую указывают удвоенной (умножают на два). Так, если для DDR памяти указана частота 1400 МГц, то эта память работает на физической частоте в 700 МГц, но указывают так называемую «эффективную» частоту, то есть ту, на которой должна работать SDR память, чтобы обеспечить такую же пропускную способность.

Основное преимущество DDR2 памяти заключается в возможности работы на больших тактовых частотах, а соответственно — увеличении пропускной способности по сравнению с предыдущими технологиями. Это достигается за счет увеличенных задержек, которые, впрочем, не так важны для видеокарт. Первой платой, использующей DDR2 память, стала NVIDIA GeForce FX 5800 Ultra. По сути, на ней стояла GDDR2 память, которая не настоящая DDR2, а нечто среднее между технологиями DDR и DDR2. После применения GDDR2 в серии GeForce FX 5800, последующие видеокарты NVIDIA использовали DDR память, но эта память получила дальнейшее распространение в GeForce FX 5700 Ultra и в некоторых более поздних mid-end видеокартах. С тех пор технологии графической памяти продвинулись дальше, был разработан стандарт GDDR3, который близок к спецификациям DDR2, с некоторыми изменениями, сделанными специально для видеокарт.

GDDR3 — это специально предназначенная для видеокарт память, с теми же технологиями, что и DDR2, но с улучшениями характеристик потребления и тепловыделения, что позволило создать микросхемы, работающие на более высоких тактовых частотах. И опять же, несмотря на то, что стандарт был разработан в ATI, первой видеокартой, ее использующей, стала вторая модификация NVIDIA GeForce FX 5700 Ultra, а следующей стала GeForce 6800 Ultra.

Ну а GDDR4 — это последнее поколение "графической" памяти, работающее почти в два раза быстрее, чем GDDR3. Основными отличиями GDDR4 от GDDR3, существенными для пользователей, являются в очередной раз повышенные рабочие частоты и сниженное энергопотребление. Технически, память GDDR4 не сильно отличается от GDDR3, это дальнейшее развитие тех же идей. Первыми видеокартами с чипами GDDR4 на борту стали RADEON X1950 XTX, а у компании NVIDIA продукты на базе этого типа памяти еще не вышли. Преимущества новых микросхем памяти перед GDDR3 в том, что энергопотребление модулей может быть примерно на треть ниже. Это достигается за счет более низкого номинального напряжения для GDDR4.

Итак, видеопамять самых современных типов: GDDR3 и GDDR4, отличается от DDR некоторыми деталями, но также работает с удвоенной передачей данных. В ней применяются некоторые специальные технологии, позволяющие поднять частоту работы. Так, GDDR2 память обычно работает на более высоких частотах, по сравнению с DDR, GDDR3 — на еще более высоких, ну а GDDR4 обеспечивает максимальную частоту и пропускную способность.

Руководство покупателя игровой видеокарты

Современные графические процессоры содержат множество функциональных блоков, от количества и характеристик которых зависит и итоговая скорость рендеринга, влияющая на комфортность игры. По сравнительному количеству этих блоков в разных видеочипах можно примерно оценить, насколько быстр тот или иной GPU. Характеристик у видеочипов довольно много, в этом разделе мы рассмотрим лишь самые важные из них.

Тактовая частота видеочипа

Рабочая частота GPU обычно измеряется в мегагерцах, т. е. миллионах тактов в секунду. Эта характеристика прямо влияет на производительность видеочипа — чем она выше, тем больший объем работы GPU может выполнить в единицу времени, обработать большее количество вершин и пикселей. Пример из реальной жизни: частота видеочипа, установленного на плате Radeon HD 6670 равна 840 МГц, а точно такой же чип в модели Radeon HD 6570 работает на частоте в 650 МГц. Соответственно будут отличаться и все основные характеристики производительности. Но далеко не только рабочая частота чипа определяет производительность, на его скорость сильно влияет и сама графическая архитектура: устройство и количество исполнительных блоков, их характеристики и т. п.

В некоторых случаях тактовая частота отдельных блоков GPU отличается от частоты работы остального чипа. То есть, разные части GPU работают на разных частотах, и сделано это для увеличения эффективности, ведь некоторые блоки способны работать на повышенных частотах, а другие — нет. Такими GPU комплектуется большинство видеокарт GeForce от NVIDIA. Из свежих примеров приведём видеочип в модели GTX 580, большая часть которого работает на частоте 772 МГц, а универсальные вычислительные блоки чипа имеют повышенную вдвое частоту — 1544 МГц.

Скорость заполнения (филлрейт)

Скорость заполнения показывает, с какой скоростью видеочип способен отрисовывать пиксели. Различают два типа филлрейта: пиксельный (pixel fill rate) и текстурный (texel rate). Пиксельная скорость заполнения показывает скорость отрисовки пикселей на экране и зависит от рабочей частоты и количества блоков ROP (блоков операций растеризации и блендинга), а текстурная — это скорость выборки текстурных данных, которая зависит от частоты работы и количества текстурных блоков.

Например, пиковый пиксельный филлрейт у GeForce GTX 560 Ti равен 822 (частота чипа) × 32 (количество блоков ROP) = 26304 мегапикселей в секунду, а текстурный — 822 × 64 (кол-во блоков текстурирования) = 52608 мегатекселей/с. Упрощённо дело обстоит так — чем больше первое число — тем быстрее видеокарта может отрисовывать готовые пиксели, а чем больше второе — тем быстрее производится выборка текстурных данных.

Хотя важность "чистого" филлрейта в последнее время заметно снизилась, уступив скорости вычислений, эти параметры всё ещё остаются весьма важными, особенно для игр с несложной геометрией и сравнительно простыми пиксельными и вершинными вычислениями. Так что оба параметра остаются важными и для современных игр, но они должны быть сбалансированы. Поэтому количество блоков ROP в современных видеочипах обычно меньше количества текстурных блоков.

Количество вычислительных (шейдерных) блоков или процессоров

Пожалуй, сейчас эти блоки — главные части видеочипа. Они выполняют специальные программы, известные как шейдеры. Причём, если раньше пиксельные шейдеры выполняли блоки пиксельных шейдеров, а вершинные — вершинные блоки, то с некоторого времени графические архитектуры были унифицированы, и эти универсальные вычислительные блоки стали заниматься различными расчётами: вершинными, пиксельными, геометрическими и даже универсальными вычислениями.

Впервые унифицированная архитектура была применена в видеочипе игровой консоли Microsoft Xbox 360, этот графический процессор был разработан компанией ATI (впоследствии купленной AMD). А в видеочипах для персональных компьютеров унифицированные шейдерные блоки появились ещё в плате NVIDIA GeForce 8800. И с тех пор все новые видеочипы основаны на унифицированной архитектуре, которая имеет универсальный код для разных шейдерных программ (вершинных, пиксельных, геометрических и пр.), и соответствующие унифицированные процессоры могут выполнить любые программы.

По числу вычислительных блоков и их частоте можно сравнивать математическую производительность разных видеокарт. Большая часть игр сейчас ограничена производительностью исполнения пиксельных шейдеров, поэтому количество этих блоков весьма важно. К примеру, если одна модель видеокарты основана на GPU с 384 вычислительными процессорами в его составе, а другая из той же линейки имеет GPU с 192 вычислительными блоками, то при равной частоте вторая будет вдвое медленнее обрабатывать любой тип шейдеров, и в целом будет настолько же производительнее.

Хотя, исключительно на основании одного лишь количества вычислительных блоков делать однозначные выводы о производительности нельзя, обязательно нужно учесть и тактовую частоту и разную архитектуру блоков разных поколений и производителей чипов. Только по этим цифрам можно сравнивать чипы только в пределах одной линейки одного производителя: AMD или NVIDIA. В других же случаях нужно обращать внимание на тесты производительности в интересующих играх или приложениях.

Блоки текстурирования (TMU)

Эти блоки GPU работают совместно с вычислительными процессорами, ими осуществляется выборка и фильтрация текстурных и прочих данных, необходимых для построения сцены и универсальных вычислений. Число текстурных блоков в видеочипе определяет текстурную производительность — то есть скорость выборки текселей из текстур.

Хотя в последнее время больший упор делается на математические расчеты, а часть текстур заменяется процедурными, нагрузка на блоки TMU и сейчас довольно велика, так как кроме основных текстур, выборки необходимо делать и из карт нормалей и смещений, а также внеэкранных буферов рендеринга render target.

С учётом упора многих игр в том числе и в производительность блоков текстурирования, можно сказать, что количество блоков TMU и соответствующая высокая текстурная производительность также являются одними из важнейших параметров для видеочипов. Особенное влияние этот параметр оказывает на скорость рендеринга картинки при использовании анизотропной фильтрации, требующие дополнительных текстурных выборок, а также при сложных алгоритмах мягких теней и новомодных алгоритмах вроде Screen Space Ambient Occlusion.

Блоки операций растеризации (ROP)

Блоки растеризации осуществляют операции записи рассчитанных видеокартой пикселей в буферы и операции их смешивания (блендинга). Как мы уже отмечали выше, производительность блоков ROP влияет на филлрейт и это — одна из основных характеристик видеокарт всех времён. И хотя в последнее время её значение также несколько снизилось, всё ещё попадаются случаи, когда производительность приложений зависит от скорости и количества блоков ROP. Чаще всего это объясняется активным использованием фильтров постобработки и включенным антиалиасингом при высоких игровых настройках.

Ещё раз отметим, что современные видеочипы нельзя оценивать только числом разнообразных блоков и их частотой. Каждая серия GPU использует новую архитектуру, в которой исполнительные блоки сильно отличаются от старых, да и соотношение количества разных блоков может отличаться. Так, блоки ROP компании AMD в некоторых решениях могут выполнять за такт больше работы, чем блоки в решениях NVIDIA, и наоборот. То же самое касается и способностей текстурных блоков TMU — они разные в разных поколениях GPU разных производителей, и это нужно учитывать при сравнении.

Вплоть до последнего времени, количество блоков обработки геометрии было не особенно важным. Одного блока на GPU хватало для большинства задач, так как геометрия в играх была довольно простой и основным упором производительности были математические вычисления. Важность параллельной обработки геометрии и количества соответствующих блоков резко выросли при появлении в DirectX 11 поддержки тесселяции геометрии. Компания NVIDIA первой распараллелила обработку геометрических данных, когда в её чипах семейства GF1xx появилось по несколько соответстующих блоков. Затем, похожее решение выпустила и AMD (только в топовых решениях линейки Radeon HD 6700 на базе чипов Cayman).

В рамках этого материала мы не будем вдаваться в подробности, их можно прочитать в базовых материалах нашего сайта, посвященных DirectX 11-совместимым графическим процессорам. В данном случае для нас важно то, что количество блоков обработки геометрии очень сильно влияет на общую производительность в самых новых играх, использующих тесселяцию, вроде Metro 2033, HAWX 2 и Crysis 2 (с последними патчами). И при выборе современной игровой видеокарты очень важно обращать внимание и на геометрическую производительность.

Собственная память используется видеочипами для хранения необходимых данных: текстур, вершин, данных буферов и т. п. Казалось бы, что чем её больше — тем всегда лучше. Но не всё так просто, оценка мощности видеокарты по объему видеопамяти — это наиболее распространенная ошибка! Значение объёма видеопамяти неопытные пользователи переоценивают чаще всего, до сих пор используя именно его для сравнения разных моделей видеокарт. Оно и понятно — этот параметр указывается в списках характеристик готовых систем одним из первых, да и на коробках видеокарт его пишут крупным шрифтом. Поэтому неискушённому покупателю кажется, что раз памяти в два раза больше, то и скорость у такого решения должна быть в два раза выше. Реальность же от этого мифа отличается тем, что память бывает разных типов и характеристик, а рост производительности растёт лишь до определенного объёма, а после его достижения попросту останавливается.

Так, в каждой игре и при определённых настройках и игровых сценах есть некий объём видеопамяти, которого хватит для всех данных. И хоть ты 4 ГБ видеопамяти туда поставь — у неё не появится причин для ускорения рендеринга, скорость будут ограничивать исполнительные блоки, о которых речь шла выше, а памяти просто будет достаточно. Именно поэтому во многих случаях видеокарта с 1,5 ГБ видеопамяти работает с той же скоростью, что и карта с 3 ГБ (при прочих равных условиях).

Ситуации, когда больший объём памяти приводит к видимому увеличению производительности, существуют — это очень требовательные игры, особенно в сверхвысоких разрешениях и при максимальных настройках качества. Но такие случаи встречаются не всегда и объём памяти учитывать нужно, не забывая о том, что выше определённого объема производительность просто уже не вырастет. Есть у чипов памяти и более важные параметры, такие как ширина шины памяти и её рабочая частота. Эта тема настолько обширна, что подробнее о выборе объёма видеопамяти мы ещё остановимся в шестой части нашего материала.

Ширина шины памяти

Современные игровые видеокарты используют разную ширину шины: от 64 до 384 бит (ранее были чипы и с 512-битной шиной), в зависимости от ценового диапазона и времени выпуска конкретной модели GPU. Для самых дешёвых видеокарт уровня low-end чаще всего используется 64 и реже 128 бит, для среднего уровня от 128 до 256 бит, ну а видеокарты из верхнего ценового диапазона используют шины от 256 до 384 бит шириной. Ширина шины уже не может расти чисто из-за физических ограничений — размер кристалла GPU недостаточен для разводки более чем 512-битной шины, и это обходится слишком дорого. Поэтому наращивание ПСП сейчас осуществляется при помощи использования новых типов памяти (см. далее).

На современные видеокарты устанавливается сразу несколько различных типов памяти. Старую SDR-память с одинарной скоростью передачи уже нигде не встретишь, но и современные типы памяти DDR и GDDR имеют значительно отличающиеся характеристики. Различные типы DDR и GDDR позволяют передавать в два или четыре раза большее количество данных на той же тактовой частоте за единицу времени, и поэтому цифру рабочей частоты зачастую указывают удвоенной или учетверённой, умножая на 2 или 4. Так, если для DDR-памяти указана частота 1400 МГц, то эта память работает на физической частоте в 700 МГц, но указывают так называемую «эффективную» частоту, то есть ту, на которой должна работать SDR-память, чтобы обеспечить такую же пропускную способность. То же самое с GDDR5, но частоту тут даже учетверяют.

Основное преимущество новых типов памяти заключается в возможности работы на больших тактовых частотах, а соответственно — в увеличении пропускной способности по сравнению с предыдущими технологиями. Это достигается за счет увеличенных задержек, которые, впрочем, не так важны для видеокарт. Первой платой, использующей память DDR2, стала NVIDIA GeForce FX 5800 Ultra. С тех пор технологии графической памяти значительно продвинулись, был разработан стандарт GDDR3, который близок к спецификациям DDR2, с некоторыми изменениями специально для видеокарт.

GDDR3 — это специально предназначенная для видеокарт память, с теми же технологиями, что и DDR2, но с улучшенными характеристиками потребления и тепловыделения, что позволило создать микросхемы, работающие на более высоких тактовых частотах. Несмотря на то, что стандарт был разработан в компании ATI, первой видеокартой, её использующей, стала вторая модификация NVIDIA GeForce FX 5700 Ultra, а следующей стала GeForce 6800 Ultra.

GDDR4 — это дальнейшее развитие «графической» памяти, работающее почти в два раза быстрее, чем GDDR3. Основными отличиями GDDR4 от GDDR3, существенными для пользователей, являются в очередной раз повышенные рабочие частоты и сниженное энергопотребление. Технически, память GDDR4 не сильно отличается от GDDR3, это дальнейшее развитие тех же идей. Первыми видеокартами с чипами GDDR4 на борту стали ATI Radeon X1950 XTX, а у компании NVIDIA продукты на базе этого типа памяти не выходили вовсе. Преимущества новых микросхем памяти перед GDDR3 в том, что энергопотребление модулей может быть примерно на треть ниже. Это достигается за счет более низкого номинального напряжения для GDDR4.

Впрочем, GDDR4 не получила широкого распространения даже в решениях AMD. Начиная с GPU семейства RV7x0, контроллерами памяти видеокарт поддерживается новый тип памяти GDDR5, работающий на эффективной учетверённой частоте до 5,5 ГГц и выше (теоретически возможны частоты до 7 ГГц), что даёт пропускную способность до 176 ГБ/с с применением 256-битного интерфейса. Если для повышения ПСП у памяти GDDR3/GDDR4 приходилось использовать 512-битную шину, то переход на использование GDDR5 позволил увеличить производительность вдвое при меньших размерах кристаллов и меньшем потреблении энергии.

Видеопамять самых современных типов — это GDDR3 и GDDR5, она отличается от DDR некоторыми деталями и также работает с удвоенной/учетверённой передачей данных. В этих типах памяти применяются некоторые специальные технологии, позволяющие поднять частоту работы. Так, память GDDR2 обычно работает на более высоких частотах по сравнению с DDR, GDDR3 — на еще более высоких, а GDDR5 обеспечивает максимальную частоту и пропускную способность на данный момент. Но на недорогие модели до сих пор ставят «неграфическую» память DDR3 со значительно меньшей частотой, поэтому нужно выбирать видеокарту внимательнее.

Всем привет! С вами Zero, и сегодня я расскажу, почему я предпочитаю 24-дюймовый FullHD монитор с частотой обновления 144 Гц более крупным моделям с более высокими разрешениями, а в дальнейшем, вероятно, снова куплю 24-дюймовую FullHD модель, но уже на 240+, а скорее всего, на 360+ Гц с поддержкой технологий адаптивной синхронизации.

Есть ли смысл от частоты кадров выше 60 на 60 Гц мониторе и что такое фреймтайм

![]()

Теперь кратко расскажу о том, есть ли смысл от, условно говоря, 200+ FPS на 60 Гц мониторе или от 300+ на 144 Гц мониторе. Да, есть! Во-первых, всегда стоит иметь запас как минимум в несколько десятков кадров в секунду превышения над комфортным FPS, чтобы в особо нагруженных сценах не ощутить неприятную просадку, которая будет выглядеть как микрофриз. Во-вторых, если ПК способен выдать в секунду больше кадров, то и на мониторе может быть показан более актуальный и свежий кадр, хотя, конечно, если ваше железо выдает много FPS – лучше купите и подходящий монитор на 240-360+ Гц. К счастью, сейчас уже хватает приличных моделей на IPS и VA матрицах, и мириться с недостатками TN нет необходимости. Но, повторюсь, больше FPS – всегда хорошо, даже если у вас монитор на 60 Гц, поскольку он будет отображать максимально актуальную картинку. Есть ли какой-то предел, свыше которого FPS наращивать нерационально? Не знаю, тут нужны двойные слепые плацебо-контролируемые исследования, как при проверке медицинских препаратов – надеюсь, компании, выпускающие оборудование для геймеров, игровые СМИ или блогеры со временем их проведут, причем с соблюдением научных стандартов для таких исследований, чтобы их можно было потом воспроизвести. Предположу, что фреймтайма в 1-2 мс будет хватать с лихвой.

Фреймтайм (время отрисовки кадра) – это время, которое кадр находится на экране, пока готовится следующий кадр. Например, при 60 постоянных FPS и 60 Гц кадр будет меняться примерно каждые 16.7 мс, а при 150 постоянных FPS и Гц — примерно каждые 6.7 мс. Адаптивные возможности человеческого организма, включая зрительный аппарат и мелкую моторику, велики, и со временем вы научитесь извлекать выгоду от меньшего фреймтайма, особенно в шутерах. Так, NVIDIA сообщает, что при 180 FPS результаты игроков в CS: GO и PUBG значительно лучше, чем при 60 FPS.

Не стоит забывать и о том, что из-за разной нагруженности сцен, например, при 30 средних FPS фреймтайм каждого кадра может быть 33.3 мс, но если одни сцены очень «легкие» а другие, напротив, «тяжелые» (взрывы, дым и другие эффекты), то одни кадры могут отрисовываться за 15 мс, а другие – за 80 мс, что будет восприниматься как неприятные тормоза и микрофризы. Запомните: «больше FPS – всегда хорошо»! Разница между 15 мс и 80 мс колоссальна и легко ощущается людьми на глаз, а вот увидит ли среднестатистический homo sapiens разницу между 1 и 4 или 3 и 6 мс – вопрос, на который могут ответить только исследования. В идеале, ваше железо должно выдавать столько кадров в секунду, чтобы даже очень редкие 0.1% low FPS события оставались в рамках комфортного фреймтайма. Для тех, кто не понимает, о чем речь – на оверах есть хорошая, хотя и слишком математическая для большинства читателей статья, «Показатели игровой производительности».

Стандартные и нестандартные стандарты

Современным мониторам и видеокартам нет никакого дела до фиксированных разрешений и таймингов времен DMT, они могут работать в широком диапазоне разрешений и частот обновления. Давайте посмотрим в техпаспорт моего монитора:

| Поддерживаемая горизонтальная частота развертки | 31-140 кГц |

| Поддерживаемая вертикальная частота развертки | 29-76 Гц |

| Режим | Частота горизонтальной развертки | Частота вертикальной развертки | Частота пикселизации | Полярность синхронизации |

|---|---|---|---|---|

| VESA, 3840×2160 | 133.3 кГц | 60.0 Гц | 533.25 МГц | H+/V- |

Дело в частоте пикселизации. Многие видеокарты, а тем более интегрированное в процессор видео, имеют железные ограничения частоты пикселизации, а из-за того, что в EDID монитора нет максимального разрешения с меньшей частотой вертикальной развертки вследствие ограниченности его размера, компьютер не может использовать максимальное разрешение.

К сожалению, производители редко публикуют максимальную частоту пикселизации видеочипов, ограничиваясь максимальным поддерживаемым разрешением, но для интересующих меня карт я нашел необходимую информацию:

Intel HD 3000 (Sandy Bridge): 389 кГц

Haswell ULT (-U): 450 кГц

Haswell ULX (-Y): 337 кГц

Предыстория

Давным-давно, когда все мониторы были большими и кинескопными, компьютеры использовали фиксированные разрешения и тайминги для вывода изображения на экран. Тайминги были описаны в стандарте Display Monitor Timings (DMT), и не существовало универсального метода расчета таймингов для использования нестандартного разрешения. Мониторы отправляли компьютеру информацию о себе через специальный протокол Extended display identification data (EDID), который содержал DMT-таблицу с поддерживаемыми режимами. Шло время, мониторам стало не хватать разрешений из DMT. В 1999 году VESA представляет Generalized Timing Formula (GTF) — универсальный способ расчета таймингов для любого разрешения (с определенной точностью). Всего через 3 года, в 2002 году, его заменил стандарт Coordinated Video Timings (CVT), в котором описывается способ чуть более точного рассчитывания таймингов.

Оба стандарта были созданы с учетом особенностей хода луча в электро-лучевой трубке, вводились специальные задержки для того, чтобы магнитное поле успело измениться. Жидкокристаллические мониторы, напротив, таких задержек не требуют, поэтому для них был разработан стандарт CVT Reduced Blanking (CVT-R или CVT-RB), который является копией CVT без задержек для CRT, что позволило значительно снизить требуемую пропускную способность интерфейса. В 2013 году вышло обновление CVT-R c индексом v2, но, к сожалению, открытого описания стандарта в интернете нет, а сама VESA продает его за $350.

Почему показатели FPS и Гц для меня важнее, чем разрешение

![]()

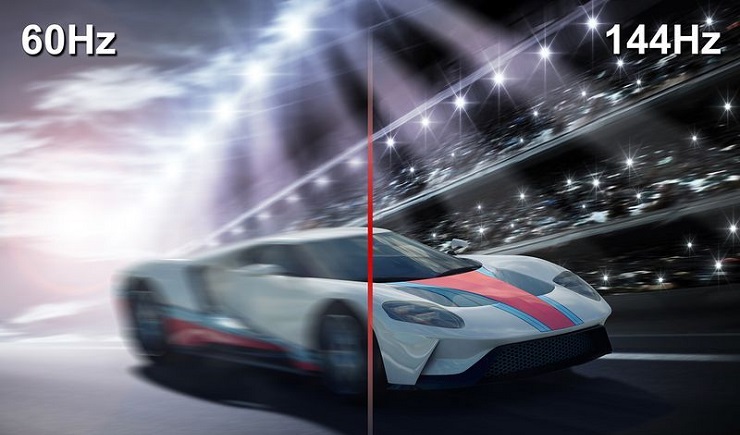

Думаю, из моего предисловия вы поняли, почему низкая частота кадров – это плохо. Если не поняли – попробуйте в какой-нибудь игре искусственно ограничить FPS – поставьте сначала 8, потом 16, потом 24, 30, 48, 60, а дальше – 120 или 144 и без ограничений. При низком FPS вместо приятной плавности в динамичных сценах мы видим размытые силуэты и рывки или микрофризы. На мой взгляд, играть с разрешением FullHD (1920 на 1080 пикселей) и частотой кадров 144+ НАМНОГО приятнее, чем с разрешением 4K (3840 × 2160 пикселей) и частотой кадров 30+ или даже 60. «А почему бы не совместить?» – спросите вы. Потому что видеокарты не тянут в требовательных современных играх разрешение 4K, максимальные настройки графики, а также хотя бы 120+ кадров в секунду. В Cyberpunk 2077, если поставить 4K и выкрутить все ползунки на максимум, не выдаст нужной частоты кадров даже RTX 3090.

реклама

У меня сейчас RTX 3060 Ti, и играть с ней в уже не новые тайтлы вроде The Witcher 3 очень комфортно и приятно – в «Ведьмаке» частота кадров не опускается ниже 144. Как консольщики играют в режиме 30 FPS – не понимаю, я пробовал искусственно поставить такой лимит. Рывки, размытость при резком повороте камеры…еще и настройка часто в консольных играх для размытия специальная есть – якобы это не стремное железо и плохая оптимизация, а «кинематографичная» фишка такая. Ага, фишка…

Что такое разрешение, частота обновления, соотношение сторон, плотность пикселей

Pixel

Пиксель – это самый маленький элемент, который можно отобразить на экране. Это не что иное, как точка на экране. Скопления этих точек загораются вместе, образуя изображение на дисплее.

Теперь давайте начнем с резолюции.

Разрешение

Размер дисплея измеряется физическим размером расстояния между 2 диагонально противоположными углами дисплея. Это обычно измеряется в дюймах или сантиметрах. Но это не делает никакой справедливости, позволяя нам судить о качестве дисплея. Следовательно, нам нужно знать точные горизонтальные и вертикальные размеры дисплея. Это просто обозначено в резолюции. Количество пикселей, расположенных по горизонтали на количество пикселей, расположенных по вертикали, является разрешением дисплея. Это означает, что чем больше пикселей внутри дисплея, тем лучше будет качество изображения и тем четче будет изображение. Но это не совсем так. Мы обсудим это дальше.

Ниже приведены некоторые из распространенных разрешений экрана:

- 2560 x 1440 (1440p)

- 1920 x 1080 (FHD или Full HD или 1080p)

- 1600 х 900

- 1024 х 768

- 1280 x 720 (HD или 720p)

Вы можете изменить разрешение вашего дисплея, выполнив следующие действия,

Откройте Настройки Windows . Перейдите по этому пути, Система> Показать . Здесь вы можете изменить разрешение в раскрывающемся меню в разделе Масштаб и макет.

Пиксельная плотность

Плотность пикселей дисплея обозначается тем, что количество пикселей отображается на дюйм на дисплее. Общее количество пикселей на экране является произведением горизонтально расположенных и вертикально расположенных пикселей дисплея. Это разрешение дисплея. Например, для дисплея Full HD количество пикселей на дисплее составляет 1920 * 1080, что составляет 2073600 пикселей. Теперь фактическая плотность пикселей дисплея рассчитывается по этой формуле:

Следовательно, для 1080p Full HD дисплея размером 15 дюймов будет,

Квадратный корень ((1920) ^ 2 + (1080) ^ 2)/15

Это будет равно 146,86 PPI или 146,86 пикселей на дюйм.

Следовательно, чем меньше пикселей на дисплее, чем меньше его физическая площадь, тем четче будет изображение.

Соотношение сторон

Соотношение сторон дисплея – это соотношение горизонтального и вертикального расположения пикселей на дисплее. Это означает, что разрешение дисплея решает, каким будет соотношение сторон того же дисплея. Следовательно, дисплей с разрешением Full HD 1920 x 1080, соотношение сторон будет 16: 9. Другие действительно известные соотношения сторон, которые мы видим на дисплеях:

Чем больше соотношение сторон, тем больше будет физический, а также виртуальный отпечаток и область просмотра изображения. Наиболее известные соотношения сторон для ПК и ноутбуков – 16: 9 и 4: 3. В то время как для мобильных телефонов 16: 9 считался обычным явлением, но в последнее время в отрасли наблюдается тенденция 18: 9.

Частота обновления

Этот термин говорит само за себя. Это способность дисплея, с помощью которой он меняет изображения на дисплее. Наиболее часто встречающиеся частоты обновления – 50 Гц и 60 Гц. Это также можно рассчитать как 50 кадров в секунду (кадров в секунду) и 60 кадров в секунду. Это означает, что на дисплее может отображаться 60 различных экземпляров изображения на дисплее, если установлено значение 60 Гц или 60 кадров в секунду. Это означает, что чем выше частота обновления экрана, тем более плавный переход изображения будет отображаться на экране.

Вы можете установить его по своему выбору в Windows 10 следующим образом:

Откройте «Настройки Windows» и перейдите к «Система»> «Экран»> «Дополнительные параметры дисплея»> «Свойства адаптера дисплея для дисплея X». Здесь X обозначает номер дисплея, который используется вашим компьютером.

Откроется новое мини-окно со свойствами вашего дисплея. Переключитесь на вкладку под названием Монитор. И теперь вы можете переключать частоту обновления для вашего дисплея.

Существуют различные программы, которые утверждают, что могут переключать эти аппаратно-зависимые функции с помощью программного обеспечения компьютера. Но они ограничены в функциональности. Они не могут обеспечить качество из-за ограничений, налагаемых реальным оборудованием. Следовательно, долгое их использование может не дать должного опыта, как задумано.

Предисловие

реклама

Кто бы что ни говорил, разница между 30 и 60 FPS хорошо заметна. Включите какой-нибудь фильм с 24-30 кадрами в секунду и остановите кадр на динамичной сцене, например, демонстрирующей быстрое движение автомобиля или бег человека. Вместо четкого объекта вы увидите его размытый силуэт. Некоторые кинолюбители считают motion blur художественным приемом, который якобы только улучшает восприятие фильма – по их словам, с большим количеством кадров кино выглядит «как новостной сюжет или любительская съемка», но это все чушь.

На самом деле, 24-30 кадров в фильмах – отвратительное, анахроничное наследие эпохи кинопленки. Сейчас при помощи специальных цифровых камер можно снимать хоть 240, хоть 360, хоть 960 кадров в секунду – существуют и устройства с гораздо более высокими значениями, но они уже нужны только для отдельных задач вроде замедленной съемки лопастей вентилятора, крыльев насекомого, а то и вовсе лучей света. Лично я хочу иметь возможность в любой момент остановить фильм и рассмотреть детали сцены в кристальной четкости, а для этого нужно много кадров в секунду, а не нынешние 24-30 или даже 48. Надеюсь, со временем киноиндустрия уйдет от устаревших стандартов – это все равно что, если бы сейчас мы смотрели не цветное кино, а черно-белое. Может, в отдельных картинах, где это подчеркивает идею режиссера, это и уместно, но в целом – нет.

Заключение

Полагаю, в рамках этой статьи я достаточно подробно изложил, почему считаю, что FPS, фреймтайм и частота обновления экрана гораздо важнее для комфортной игры, чем разрешение, хотя среди геймеров на эту тему бытуют разные мнения. А что по этому поводу думаете вы? Пишите в комментариях. Если нашли какие-то технические ошибки – тоже пишите, я открыт к критике.

Подпишитесь на наш канал в Яндекс.Дзен или telegram-канал @overclockers_news - это удобные способы следить за новыми материалами на сайте. С картинками, расширенными описаниями и без рекламы.

Засматриваетесь на 4K UHD-мониторы, но ваш лаптоп не поддерживает высокие разрешения? Купили монитор и миритесь с частотой обновления в 30Гц? Повремените с апгрейдом.

TL;DR: 3840×2160@43 Гц, 3200×1800@60 Гц, 2560×1440@86 Гц на Intel HD 3000 Sandy Bridge; 3840×2160@52 Гц на Intel Iris 5100 Haswell.

Что не так с вертикальной синхронизацией

![]()

реклама

Упомяну в статье и про вертикальную синхронизацию (программную, в настройках игры или драйвера видеокарты). Задача этой технологии – предотвращать разрывы кадра вроде того, что на картинке выше, и она успешно это делает…но ценой увеличения фреймтайма и инпут-лага (задержки управления). Для большинства одиночных игр это не критично, если же вы предпочитаете сетевые проекты, и при этом играете на 60 Гц мониторе с высоким FPS, например, 150+, лучше не включайте V-Sync. Включение этой технологии нивелирует ваше преимущество над игроками с менее мощным железом. Если у вас обоих пинг 50 мс, и вы одновременно выбегаете из-за разных углов на открытое пространство, то, при прочих равных, у кого больше FPS, тот находится в более выгодном положении, а включая V-Sync, вы отказываетесь от этого бонуса.

Следующий логичный вопрос – а когда же вертикальную синхронизацию включать стоит? Если ваш монитор не поддерживает технологии адаптивной синхронизации, включать V-Sync стоит в одиночных играх, в которых сильно бросаются в глаза разрывы изображения. Чаще всего они заметны в катсценах, но иногда и непосредственно в процессе игры. Если ваш монитор поддерживает G-Sync, AMD FreeSync или Adaptive-Sync – лучше попробуйте их.

У меня не получается!

Убедитесь, что вы подключаете монитор через DisplayPort 1.2. HDMI 1.4 не позволяет использовать частоту пикселизации выше 340 МГц, в то время как для DisplayPort (HBR2) верхнее ограничение равно 540 МГц. Также удостоверьтесь, что ваш монитор поддерживает частоту обновления выше 30 Гц на максимальном разрешении, т.к. ранние модели этим грешили.

История

Почему я не хочу брать для игр монитор больше 24-27 дюймов, и что такое ppi

Расскажу и о том, почему мне максимально комфортно c 24-дюймовым FullHD монитором. Если монитор слишком крупный, с большой диагональю, в процессе гейминга придется слишком много «бегать» глазами – дальнее периферическое зрение улавливает изображение гораздо хуже, чем центральное, хорошо улавливает оно в основном только движение. Мои глаза находятся примерно на расстоянии 80-100 см от экрана монитора (я специально взял рулетку и измерил), и при зрении, близком к «единице», я не вижу на нем отдельных пикселей, но охватываю центральным и центрально-периферическим зрением значительную его часть.

реклама

Если бы я купил, например, 34-дюймовый монитор, то в играх не смог бы следить за всем сразу с таким же комфортом, как сейчас – пришлось бы постоянно переводить взгляд с одной зоны дисплея на другую. Вот телевизор можно брать гораздо более крупный, потому что зритель сидит от него на расстоянии нескольких метров. Но у меня телевизора вообще нет, потому что, если долго его смотреть, можно начать считать, что Путин – великий президент, в России все хорошо, нет ни падения реальных доходов, ни цензуры, и на внешнеполитической арене страна тоже действует правильно, только вот злой Запад строит козни, иначе бы уже всех догнали и перегнали.

Теперь о показателе ppi. Ppi – это сокращение от «pixels per inch», «пиксели на дюйм». Это единица измерения разрешающей способности монитора. Вычислить ppi можно по формуле:

Если показатель ppi слишком низкий, изображение выглядит «зернистым», что особенно хорошо заметно при увеличении. Это наглядно демонстрирует картинка ниже:

Какой показатель ppi считать комфортным? Это зависит от вашего зрения, личных предпочтений и того, как далеко ваши глаза находятся от экрана. Лично мне при использовании 24-дюймового FullHD монитора хватает и ppi чуть выше 90, кому-то же такая картинка может показаться недостаточно четкой. Но, на мой взгляд, для большинства игр важнее непосредственно игровые настройки графики и FPS/фреймтайм/герцы, а не разрешение.

Заключение

Не стоит слепо верить технической документации на монитор. В ходе исследований оказалось, что ограничение по вертикальной частоте аж 86 Гц, вместо 76 Гц по заявлению производителя. Таким образом, я могу наслаждаться плавной картинкой, хоть и в не в самом высоком разрешении

Windows

Всякий раз, когда вы читаете о мониторе или выходите в магазин за такими мониторами, как телевизор или монитор для компьютера, вы наверняка слышали о различных параметрах, по которым можно судить об основном качестве и производительности дисплея. Разрешение, частота обновления, соотношение сторон и плотность пикселей – все эти параметры являются обязательными для получения правильного, четкого и правильно насыщенного цвета изображения. Дисплей является наиболее ценным для геймеров. Чем лучше Frames выполняет свои процессы в секунду, тем плавнее выглядит игровой процесс.

Давайте просто проверим эти термины немного подробнее.

Что делать и что сделать?

Ответ очевиден — нужно уменьшить частоту пикселизации! Ее уменьшение приведет и к уменьшению частоты обновления монитора. Как нам это сделать? Нам нужно сгенерировать так называемый modeline — информацию о таймингах для видеокарты и монитора. В сети можно найти множество генераторов modeline, но большинство из них безнадежно устарели и ничего не знают о стандарте CVT-R, который мы и будем использовать. Я рекомендую вам воспользоваться umc под Linux, PowerStrip под Windows и SwitchResX под Mac OS. К слову, SwitchResX — единственная программа, которая может рассчитывать modeline по стандарту CVT-R2, но мой монитор его не поддерживает.

Modeline содержит следующую структуру:

Посмотрите на таблицу выше: минимальная вертикальная частота обновления моего монитора может равняться 29 Гц.

Давайте сгенерируем modeline для разрешения 3840×2160 с частотой обновления в 30 Гц:

Как видим, частота пикселизации с данным режимом будет установлена в 262.75 МГц, что далеко от ограничений моего видеоадаптера.

Давайте попробуем установить и активировать наш режим:

Если все прошло удачно, вы увидите картинку в «неподдерживаемом» вашей картой разрешении на мониторе. Ура!

У нас все еще есть большой запас по частоте пикселизации, да и вряд ли кому-то будет комфортно использовать монитор с частотой обновления в 30 Гц, поэтому мы будем увеличивать ее до тех пор, пока частота пикселизации не приблизится к значению в 389 МГц — пределу моего видеоадаптера. Путем нехитрых манипуляций удалось установить, что при такой частоте мы получаем вертикальную развертку в 44.1 Гц.

Не блеск, но жить можно!

Как можно заметить, частота горизонтальной развертки — 97.25 кГц — вполне в диапазоне поддерживаемых монитором. Как в случае с вертикальной разверткой, так и в случае с разрешением, монитору нет дела до конкретных режимов, поэтому мы можем использовать 3200×1800 при 60 Гц — еще не такое низкое разрешение, как 2560×1440, и с привычной частотой обновления.

- Отредактировать EDID монитора и указывать его драйверу

- Добавить modeline в настройки Xorg

Для второго способа достаточно создать файл с Xorg-секцией «Monitor» и поместить его в /etc/X11/xorg.conf.d/ :

Где Identifier — название вашего видеовыхода согласно xrandr. Опцией «PreferredMode» можно задать режим, который будет выбран по умолчанию.

Читайте также: