Сайт с информацией о себе на основе запросов в браузере

Ниже рассмотрим варианты использования инструментов извлечения данных и десятку лучших сервисов, которые помогут собрать информацию, без необходимости написания специальных программных кодов. Инструменты парсинга могут применяться с разными целями и в различных сценариях, рассмотрим наиболее распространенные случаи использования, которые могут вам пригодиться. И дадим краткую правовую оценку парсинга в России.

Важно заранее упомянуть, что нахождение частной информации даже в открытом виде на одних сайтах не даёт однозначного права использовать эти данные третьими лицами. Но правовую основу парсинга рассмотрим более подробно в конце данной статьи.

1. Сбор данных для исследования рынка. Веб-сервисы извлечения данных помогут следить за ситуацией в том направлении, куда будет стремиться компания или отрасль в следующие шесть месяцев, обеспечивая мощный фундамент для исследования рынка. Программное обеспечение парсинга способно получать данные от множества провайдеров, специализирующихся на аналитике данных и у фирм по исследованию рынка, и затем сводить эту информацию в одно место для референции и анализа.

2. Извлечение контактной информации. Инструменты парсинга можно использовать, чтобы собирать и систематизировать такие данные, как почтовые адреса, контактную информацию с различных сайтов и социальных сетей. Это позволяет составлять удобные списки контактов и всей сопутствующей информации для бизнеса – данные о клиентах, поставщиках или производителях.

3. Решения по загрузке с StackOverflow. С инструментами парсинга сайтов можно создавать решения для оффлайнового использования и хранения, собрав данные с большого количества веб-ресурсов (включая StackOverflow). Таким образом можно избежать зависимости от активных интернет соединений, так как данные будут доступны независимо от того, есть ли возможность подключиться к интернету.

4. Поиск работы или сотрудников. Для работодателя, который активно ищет кандидатов для работы в своей компании, или для соискателя, который ищет определенную должность, инструменты парсинга тоже станут незаменимы: с их помощью можно настроить выборку данных на основе различных прилагаемых фильтров и эффективно получать информацию, без рутинного ручного поиска.

5. Отслеживание цен в разных магазинах. Такие сервисы будут полезны и для тех, кто активно пользуется услугами онлайн-шоппинга, отслеживает цены на продукты, ищет вещи в нескольких магазинах сразу.

В обзор ниже не попал наш сервис парсинга сайтов и последующего мониторинга цен, который в основном ориентирован на так называемый full-site web scraping (парсинг всего сайта). В отличии от инструментов ниже мы просто ежедневно отдаем "слепок" сайта в формате CSV/Excel для последующего анализа (ассортимент и цены), а инструменты ниже требуют некоторых усилий и подойдут для тех, кто готов "поработать руками" и кому нужна гибкость в парсинге.

Попробуем рассмотреть 10 лучших доступных инструментов парсинга. Некоторые из них бесплатные, некоторые дают возможность бесплатного ознакомления в течение ограниченного времени, некоторые предлагают разные тарифные планы.

Import.io предлагает разработчику легко формировать собственные пакеты данных: нужно только импортировать информацию с определенной веб-страницы и экспортировать ее в CSV. Можно извлекать тысячи веб-страниц за считанные минуты, не написав ни строчки кода, и создавать тысячи API согласно вашим требованиям.

Для сбора огромных количеств нужной пользователю информации, сервис использует самые новые технологии, причем по низкой цене. Вместе с веб-инструментом доступны бесплатные приложения для Windows, Mac OS X и Linux для создания экстракторов данных и поисковых роботов, которые будут обеспечивать загрузку данных и синхронизацию с онлайновой учетной записью.

2. Webhose.io

Webhose.io обеспечивает прямой доступ в реальном времени к структурированным данным, полученным в результате парсинга тысяч онлайн источников. Этот парсер способен собирать веб-данные на более чем 240 языках и сохранять результаты в различных форматах, включая XML, JSON и RSS.

Webhose.io – это веб-приложение для браузера, использующее собственную технологию парсинга данных, которая позволяет обрабатывать огромные объемы информации из многочисленных источников с единственным API. Webhose предлагает бесплатный тарифный план за обработку 1000 запросов в месяц и 50 долларов за премиальный план, покрывающий 5000 запросов в месяц.

3. Dexi.io (ранее CloudScrape)

CloudScrape также обеспечивает анонимный доступ к данным, предлагая ряд прокси-серверов, которые помогают скрыть идентификационные данные пользователя. CloudScrape хранит данные на своих серверах в течение 2 недель, затем их архивирует. Сервис предлагает 20 часов работы бесплатно, после чего он будет стоить 29 долларов в месяц.

4. Scrapinghub

Scrapinghub – это облачный инструмент парсинга данных, который помогает выбирать и собирать необходимые данные для любых целей. Scrapinghub использует Crawlera, умный прокси-ротатор, оснащенный механизмами, способными обходить защиты от ботов. Сервис способен справляться с огромными по объему информации и защищенными от роботов сайтами.

Scrapinghub преобразовывает веб-страницы в организованный контент. Команда специалистов обеспечивает индивидуальный подход к клиентам и обещает разработать решение для любого уникального случая. Базовый бесплатный пакет дает доступ к одному поисковому роботу (обработка до 1 Гб данных, далее — 9$ в месяц), премиальный пакет дает четырех параллельных поисковых ботов.

ParseHub может парсить один или много сайтов с поддержкой JavaScript, AJAX, сеансов, cookie и редиректов. Приложение использует технологию самообучения и способно распознать самые сложные документы в сети, затем генерирует выходной файл в том формате, который нужен пользователю.

ParseHub существует отдельно от веб-приложения в качестве программы рабочего стола для Windows, Mac OS X и Linux. Программа дает бесплатно пять пробных поисковых проектов. Тарифный план Премиум за 89 долларов предполагает 20 проектов и обработку 10 тысяч веб-страниц за проект.

6. VisualScraper

VisualScraper – это еще одно ПО для парсинга больших объемов информации из сети. VisualScraper извлекает данные с нескольких веб-страниц и синтезирует результаты в режиме реального времени. Кроме того, данные можно экспортировать в форматы CSV, XML, JSON и SQL.

Пользоваться и управлять веб-данными помогает простой интерфейс типа point and click. VisualScraper предлагает пакет с обработкой более 100 тысяч страниц с минимальной стоимостью 49 долларов в месяц. Есть бесплатное приложение, похожее на Parsehub, доступное для Windows с возможностью использования дополнительных платных функций.

Spinn3r позволяет парсить данные из блогов, новостных лент, новостных каналов RSS и Atom, социальных сетей. Spinn3r имеет «обновляемый» API, который делает 95 процентов работы по индексации. Это предполагает усовершенствованную защиту от спама и повышенный уровень безопасности данных.

Spinn3r индексирует контент, как Google, и сохраняет извлеченные данные в файлах формата JSON. Инструмент постоянно сканирует сеть и находит обновления нужной информации из множества источников, пользователь всегда имеет обновляемую в реальном времени информацию. Консоль администрирования позволяет управлять процессом исследования; имеется полнотекстовый поиск.

80legs – это мощный и гибкий веб-инструмент парсинга сайтов, который можно очень точно подстроить под потребности пользователя. Сервис справляется с поразительно огромными объемами данных и имеет функцию немедленного извлечения. Клиентами 80legs являются такие гиганты как MailChimp и PayPal.

Опция «Datafiniti» позволяет находить данные сверх-быстро. Благодаря ней, 80legs обеспечивает высокоэффективную поисковую сеть, которая выбирает необходимые данные за считанные секунды. Сервис предлагает бесплатный пакет – 10 тысяч ссылок за сессию, который можно обновить до пакета INTRO за 29 долларов в месяц – 100 тысяч URL за сессию.

Scraper – это расширение для Chrome с ограниченными функциями парсинга данных, но оно полезно для онлайновых исследований и экспортирования данных в Google Spreadsheets. Этот инструмент предназначен и для новичков, и для экспертов, которые могут легко скопировать данные в буфер обмена или хранилище в виде электронных таблиц, используя OAuth.

Scraper – бесплатный инструмент, который работает прямо в браузере и автоматически генерирует XPaths для определения URL, которые нужно проверить. Сервис достаточно прост, в нем нет полной автоматизации или поисковых ботов, как у Import или Webhose, но это можно рассматривать как преимущество для новичков, поскольку его не придется долго настраивать, чтобы получить нужный результат.

10. OutWit Hub

OutWit Hub – это дополнение Firefox с десятками функций извлечения данных. Этот инструмент может автоматически просматривать страницы и хранить извлеченную информацию в подходящем для пользователя формате. OutWit Hub предлагает простой интерфейс для извлечения малых или больших объемов данных по необходимости.

OutWit позволяет «вытягивать» любые веб-страницы прямо из браузера и даже создавать в панели настроек автоматические агенты для извлечения данных и сохранения их в нужном формате. Это один из самых простых бесплатных веб-инструментов по сбору данных, не требующих специальных знаний в написании кодов.

Ниже мы привели краткую выдержку из заключения наших юристов. Сразу отметим, что будет опубликована еще одна статья, где правовой вопрос парсинга будет рассмотрен более детально, а сейчас приводим информацию для тех, кто сразу хочет воспользоваться перечисленными выше инструментами!

Итак, вправе ли организация осуществлять автоматизированный сбор информации, размещенной в открытом доступе на сайтах в сети интернете (парсинг)?

В соответствии с действующим в Российской Федерации законодательством разрешено всё, что им не запрещено.

Парсинг является законным, в том случае, если при его осуществлении не происходит нарушений установленных законодательством запретов. Таким образом, при автоматизированном сборе информации необходимо соблюдать действующее законодательство, а законодательством Российской Федерации установлены следующие ограничения, имеющие отношение к сети интернет:

1. Не допускается нарушение Авторских и смежных прав.

2. Не допускается неправомерный доступ к охраняемой законом компьютерной информации.

3. Не допускается сбор сведений, составляющих коммерческую тайну, незаконным способом.

4. Не допускается заведомо недобросовестное осуществление гражданских прав (злоупотребление правом).

5. Не допускается использование гражданских прав в целях ограничения конкуренции.

Из вышеуказанных запретов следует, что организация вправе осуществлять автоматизированный сбор информации, размещенной в открытом доступе на сайтах в сети интернет если соблюдаются следующие условия:

1. Информация находится в открытом доступе и не защищается законодательством об авторских и смежных правах. Иными словами - вы можете парсить информацию, а вот ее дальнейшее использование может быть (а может и не быть) ограничено авторским правом!

2. Автоматизированный сбор осуществляется законными способами.

3. Автоматизированный сбор информации не приводит к нарушению в работе сайтов в сети интернет. Иными словами, вы не занимаетесь взломом и DDoS атакой.

4. Автоматизированный сбор информации не приводит к ограничению конкуренции (к слову, мониторинг цен, как следствие парсинга, только повышает конкуренцию :).

Не секрет, что подавляющее число IT-компаний обладают прямо таки маниакальным желанием отслеживать действия потребителей своих продуктов. То есть нас, обычных пользователей. Например, многие догадываются, а некоторые знают наверняка, что даже самая распространённая операционная система Windows представляет из себя, по сути, одно сплошное громадное шпионское ПО. Не лучше, а пожалуй, даже ещё хуже с этим ситуация и во Всемирной Паутине. И здесь к числу самых «любопытствующих», естественно, относится корпорация Google, фиксирующая и сохраняющая всё, до чего только способна дотянуться.

Хочешь посмотреть, какие сведения «корпорация добра» успела насобирать о тебе? Если да - читай статью дальше, нет - закрывай страницу с чистой совестью.

Остался? Читаешь? Ну тогда «поехали» дальше.

Естественно, всю накопленную информацию Google тебе никогда не покажет. Но вот некоторую её часть можно будет глянуть «хотя бы краешком глаза», если проследовать по тем семи ссылкам, которые я для тебя опубликую ниже. Кстати, кое-что из этой инфы ты сможешь даже скачать. Конечно, если осилишь эту статью до конца и прочитаешь завершающий её бонус.

Да, кстати, для «танкистов». Чтобы иметь возможность реально посмотреть свои данные, у тебя («внезапно») должен быть действующий аккаунт в любом из сервисов Google. Повторяю - в любом. Это может быть акк в «гуглопочте» или на Youtube, в социальной сети Google+ или Hangouts, Google Docs или аккаунт в твоём смартфоне на Android, или какой-нибудь ещё - без разницы, лишь бы он у тебя был, и ты смог авторизоваться с этими данными по любой из моих ссылок.

Итак, начнём с начала:

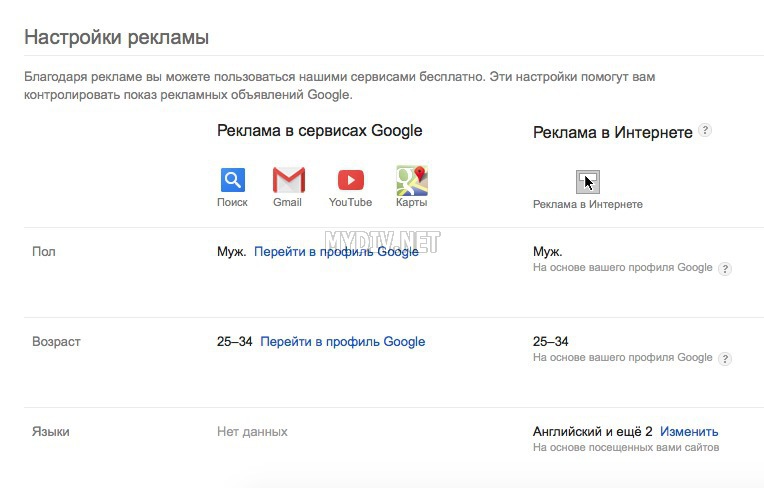

1. Твой профиль - именно таким Google тебя видит

Это твой общий «портрет», и все данные для него ты заполняешь САМ. Естественно, можно соврать. Только зачем? Да и подозреваю, что Google имеет и другие механизмы верификации твоих данных, в которых он тебе никогда не признается.

Здесь есть твой возраст, пол, интересы и т.д. и т.п. Сведения здесь собираются для того, чтобы показывать наиболее релевантную (то есть интересную только тебе) рекламу в таких сервисах от Google, как Поиск, Gmail, YouTube и Google Maps. Это, как бы, официальная версия разъяснений.

Кстати, все данные на этой странице ты сможешь поменять сам. А заодно слегка настроить показ рекламы либо вообще его отключить. Маленькое уточнение - это не значит, что если ты тут что-то совсем отключишь, то рекламы больше не будет. Будет, ещё как будет. Просто рекламные объявления станут сыпаться подряд без разбора, абсолютно не учитываю, интересует тебя это или нет.

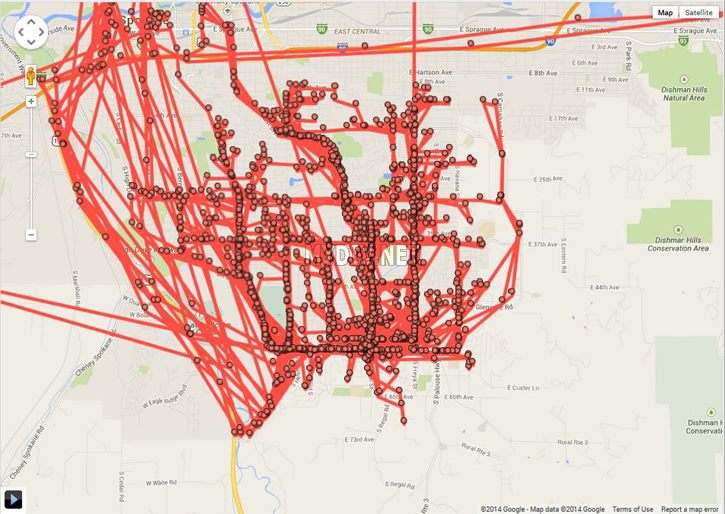

2. Как Google отслеживает твои перемещения по городу

Если ты являешь счастливым обладателем смартфона или планшета на Android, то «корпорация добра» может отслеживать все твои перемещения по точным географическим координатам с жёсткой привязкой по времени - все твои похождения, путешествия и поездки, вплоть до дайвинга на Красном море или похода в ближайший ларёк за баночкой пива для пересохшего горла. Или вечерних проводов новой знакомой до дома, плавно перетекших в утренний кофе в её обществе - у неё ведь тоже есть смартфон на Андроиде, правда? - и ваши с ней географические координаты в понимании Google всю ночь накладывались друг на друга.

А вот обладателям продукции со слегка обгрызанным яблоком на девайсе здесь зубоскалить не следует - у них в этом плане ситуация еще печальнее.

Кстати, как пример можешь глянуть на скриншот ниже - это перемещения одного из разносчиков пиццы.

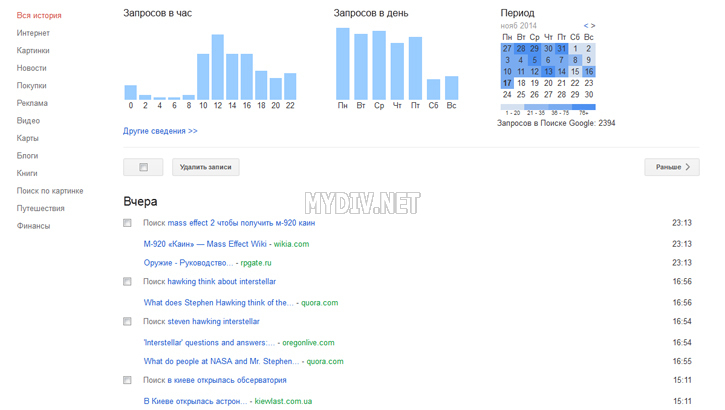

3. Всё, чем ты интересовался во Всемирной Паутине

Не секрет, что каждый поисковый запрос, который мы скармливаем сервису Google, сохраняется практически навечно.

И сохраняются не только непосредственные запросы, но и все данные о рекламе, по которой мы кликаем. И всё это снова используется опять же для показа тебе рекламы.

Всё, что в этом плане касается непосредственно тебя, можешь глянуть ЗДЕСЬ.

Настоятельно рекомендую исследовать страницу самым внимательным образом - здесь можно задать варианты сортировки по датам, видам, тематике и т.п., поиск по картинкам, словам и т.д., что позволит тебе провести минимальный анализ. А также изучить свои любимые сайты и запросы (основываясь на истории поиска, естественно).

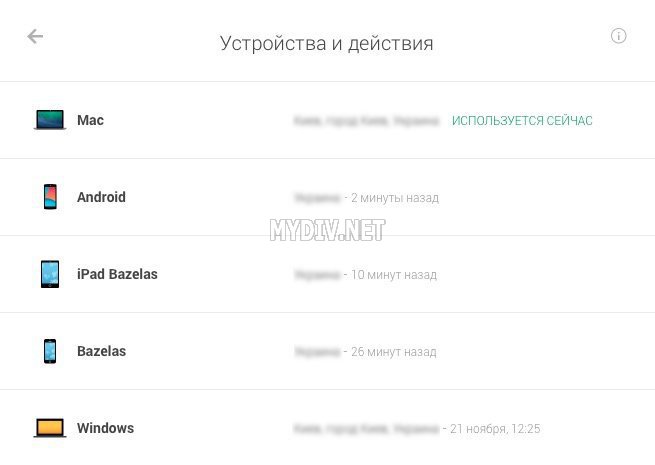

4. Все устройства, которые подключались к твоему аккаунту - твои и чужие

Вот ССЫЛКА для доступа в данный раздел.

Всё, что здесь находится, касается в первую очередь безопасности. Попав сюда, ты сможешь увидеть сводную инфу обо всех устройствах, которые подключались к твоему акку, и «зорким глазом» определить, твои ли они были или бродил кто-то чужой.

По клику на любом из показанных девайсов разворачивается более подробная информация - можно глянуть IP-адрес подключавшегося, время соединения, версию браузера, операционную систему и т.п. И даже увидеть геолокацию, место, откуда шло подключение - проверь, а ты ли это был? А если это был не ты, то тут же можно попробовать определить, где географически находится в данный момент то самое устройство, которое подключалось к твоему аккаунту. Правда, шансы определить это 50/50. Но всё же.

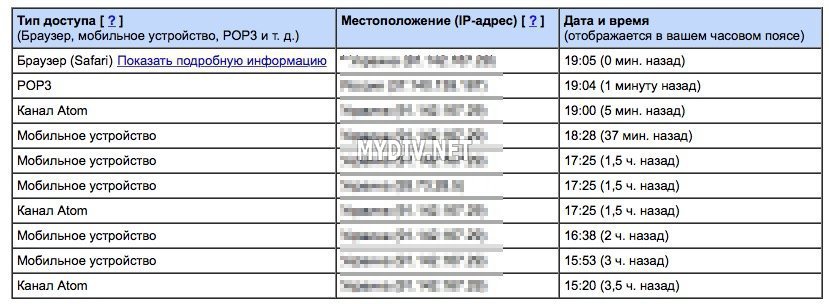

Кстати, аналогичные сводки можно получить и в отдельных сервисах Google. Например, на странице Gmail внизу есть линк «Дополнительная информация». Кликнув по нему, получишь похожую инфу.

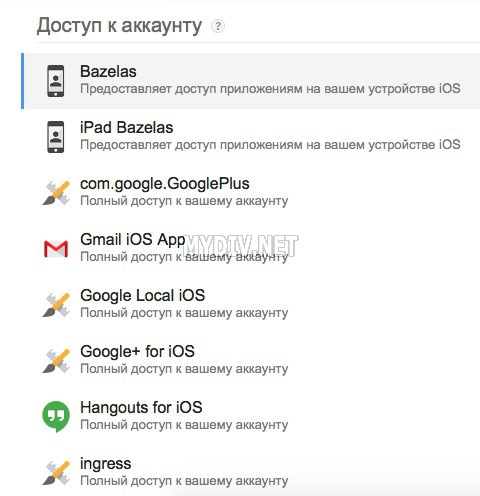

5. Все программы и расширения, которые имеют доступ к твоим данным в Google

Проверить, какие именно приложения и дополнения нагло пользуются привилегией доступа к твоим данным ты можешь ЗДЕСЬ.

Кстати, приложения, тут отмеченные, не только имеют этот самый доступ, но и могут использовать твои данные вообще без каких-либо ограничений. Прогляди список внимательно - а надо ли тебе такое? Может, в этом перечне ты и увидишь те самые софтины, которые давно собирался прибить, да «всё руки не доходили». Возможно «дойдут» сейчас.

В крайнем случае, на этой странице у многих сторонних программ можно, как минимум, отозвать разрешение использовать твои данные.

6. История поиска и просмотра на YouTube

Всё, что ты искал на знаменитом видеохостинге, а также, что уже нашёл и смотрел - забавных котиков, или наоборот, не совсем котиков - ты увидишь, пройдя по ЭТОЙ ССЫЛКЕ.

Переключиться между показом твоих поисковых запросов и уже просмотренными роликами можно вверху. Там же можно найти кнопки, очищающие всю твою историю, а также кнопки, приостанавливающие запись твоих похождений на YouTube (правда, будет или нет работать это отключение записи, я гарантировать не могу - возможно, запись будет происходить как и раньше, вот только тебе будет показываться пустая страница, будто бы твои похождения больше не фиксируются).

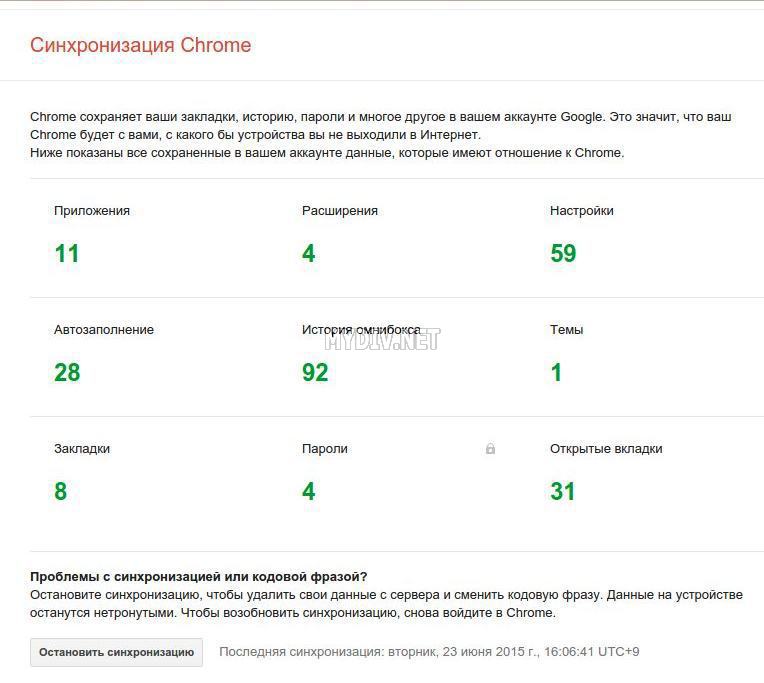

7. Синхронизация личных данных

Пользуешься ли ты браузером Google Chrome на своём настольном ПК, или же мобильном устройстве - неважно, любая его версия через определённые промежутки времени автоматически синхронизируется через Сеть. При этом все старательно собранные браузером о тебе данные передаются и хранятся на серверах Google.

Данные эти могут быть различными - например, твои пароли, список закладок, посещённые сайты и т.д. и т.п. Разумеется, всё это можно как-то настроить, выбрать, что синхронизировать, а что нет. Но многие ли из нас с этим заморачиваются? А некоторые так вообще об этом даже не подозревают.

Поэтому, если ты хотя бы на одном из своих устройств используешь браузер выделки от Google, то весьма настоятельно я рекомендую заглянуть вот СЮДА и внимательно ознакомиться с тем, что эта вредная софтина уже успела о тебе слить.

Лично я Chrome от Google практически не использую, и запускается он у меня «раз в пятилетку». Однако на скрине ниже ты можешь увидеть, сколько инфы этот браузер уже успел обо мне передать на гугловские сервера.

Ну а вообще, решая вопрос синхронизации своих данных между различными устройствами, лучше не использовать сторонних интернет-посредников, а делать это напрямую между девайсами. В крайнем случае, юзать онлайн-сервисы, на которых возможно задействовать дополнительные меры по сохранению личных данных. Но это темы уже других серьёзных и немаленьких статей.

Ну, и на десерт обещанный.

БОНУС

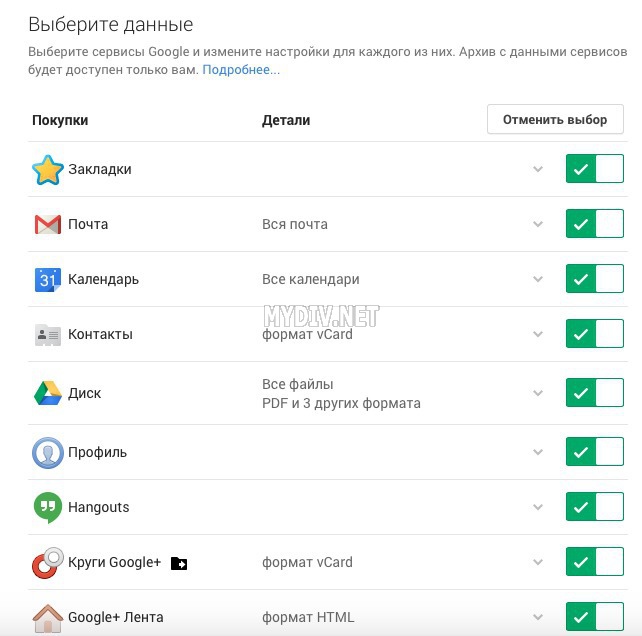

Все твои данные из Google можно экспортировать, чтобы не спеша разобраться с ними «в тёплой и уютной домашней обстановке».

Смотри, разбирайся. На этой странице Google позволяет экспортировать практически все твои данные - контакты, письма, закладки, файлы с Google Drive, видео YouTube, календари, задачи, историю похождений оффлайн и т.д. - выбирай и настраивай условия экспорта.

Всё выбранное можно загрузить на другой сайт, либо сохранить в собственном архиве. Во втором случае ты получишь несколько zip-файлов, которые сможешь использовать по своему усмотрению.

Например, для справки: выбранный формат vCard позволит тебе открыть свои контакты в подавляющем числе почтовых клиентов, включая Microsoft Outlook и Apple Mail.

Надеюсь, выданная мной информация тебе пригодится. Ну, или хотя бы не будет лишней.

P.S. На самом деле все эти ссылки секретными совсем не являются. Они есть, и их ни от кого не прячут. Однако в своём ежедневном использовании сервисов Google мало кто из нас обращает на них внимание, тем более, что обычно ютятся они скромненько где-нибудь в самом неприметном углу страницы. И что до использования «секретных» слов в заголовке статьи. Но ты же ведь прочитал её, правда? И даже, возможно, поставишь закладку на эту страницу, чтобы вернуться к статье ещё раз, когда она понадобится. А так бы прошёл мимо.

Многие люди не знают, как работать с трендами в интернете, где их искать. Перед тем, как начинать бизнес не знают, где посмотреть будет ли этот бизнес вообще популярен и нужен ли он. Поэтому напишу полный туториал, чтобы закрыть все вопросы по этой тематике.

Работать мы будем со специальным сервисом по сбору поисковых запросов пользователей Яндекса Вордстатом, интерфейс которого довольно прост и понятен:

В начале, по традиции, поставлю цели:

- Понять весь функционал и научиться работать с Вордстатом;

- Как правильно собирать семантику с максимальной релевантностью и CTR >50%;

- Так как мы на Хабре, поработаем с API Wordstat напрямую.

Ключевая роль сервиса заключается в том, что он помогает оценить пользовательский интерес к трендам, различным тематикам и подобрать ключевые слова для контекстной рекламы.

Знакомство с сервисом

Для того, чтобы начать пользоваться Вордстатом нам необходимо авторизоваться в аккаунте Яндекса:

После авторизации мы можем пользоваться сервисом. Просмотр данных поисковых запросов нам доступен во вкладке «По словам»:

В левой колонке мы видим статистику по словам, которые были вместе с вашим поисковым запросом и показы в месяц по ним. Для того, чтобы мы нашли наше слово в точном соответствии мы должны использовать операторы. В правой колонке показываются похожие по смыслу запросы на заданную нами фразу.

Наглядный пример использования ключевых слов с операторами:

Оператор "!" — фиксирует форму слова (число, падеж, время);

Оператор "[]" — Фиксирует порядок слов. При этом учитываются все словоформы и стоп-слова.

Подробнее об операторах читаем здесь.

По умолчанию Вордстат показывает запросы по всем типам устройств. Настройки можно изменять: десктоп/мобайл/только телефоны/только планшеты. В нашем случае отфильтруем только десктопы.

По умолчанию статистика показывается для всех регионов. Выбрать отображение статистики по интересующему нас региону можно во вкладке «Все регионы»:

Во вкладке «По регионам» отображаются данные со всех регионов, а также региональная популярность — доля, которую занимает регион в показах по слову, деленная на долю всех показов результатов поиска, пришедшихся на этот регион.

Для удобства эти же данные отображаются на карте:

Во вкладке «История запросов» мы видим данные по запросу, обычно за 1,5 года. Здесь наглядно можем оценить тренды и влияние их на определенные запросы.

Статистику можно смотреть как в абсолютных значениях, так и в относительных. Для получения относительного значения абсолютная цифра нормируется на количество показов результатов поиска Яндекса за соответствующий месяц.

На этом изучение инструменты можно закончить и приступить к следующей нашей цели — правильный сбор семантического ядра.

Правильный сбор семантического ядра

В интернете уйма сервисов и способов для сбора семантического ядра, а также искусственного его создания. Мы не будем создавать велосипед и танцевать с бубном, а соберем семантику легко, просто и бесплатно.

Для того, чтобы нам собрать нашу семантику, первым делом мы скачиваем с официального сайта Яндекса Директ Коммандер последней версии.

После загрузки запускаем программу, логинимся и создаем (без разницы с каким названием) кампанию:

Добавляем группу объявлений (по прежнему нет смысле заморачиваться с его названием):

Переходим во вкладку «Подбор фраз», и вуаля! Это тот же самый Вордстат, только в программе Директ Коммандер. Логика работы с ним такая же, только в отличии от веб версии Вордстата здесь мы можем сразу указать минус слова:

После того как мы тщательно отфильтруем весь список поисковых запросов от лишних запросов, можно приступать к экспорту нашей кампании в csv файл. Все, что остается нам сделать, это удалить лишние столбцы. Наше семантическое ядро находится в столбце «Фраза (с минус-словами)»:

Плюсы сбора семантики таким способом:

- Охват запросов с частотностью до 1 в месяц;

- Не наращиваем искусственную семантику, в которой наверняка будут запросы, которых в реальной истории поиска на самом деле нет;

- Увеличиваем CTR объявлений максимально (конечно не только благодаря семантике, но и правильному разбиению объявлений по кластерам запросов и их текстам. Однако все это на основе нашей семантики);

- Клики становятся для нас дешевле;

- Это абсолютно бесплатно.

Работа с API Wordstat

Прежде чем начать, ознакомимся с базовой информацией из справки Яндекс Директа.

Описание параметров

Обязательные GET параметры

request — Данные запроса

GET параметры

lr — код региона, если 0 — то все регионы

imp — если 1 — то важный запрос

Ответ содержит

status — Код статуса (0 — нет ошибок)

err_msg — Текст ошибок

data — Количество показов в месяц

На этом все цели, которые мы поставили перед собой, в конце статьи были достигнуты.

Как отключить рекламу и ограничить слив собственной личной информации в Интернет. Рекомендации отключения сбора персональной информации в популярных браузерах и соцсетях. Но учтите, зачастую подключенное к интернету устройство продолжает собирать информацию о пользователе даже с вынутой SIM-картой и выключенной геолокацией.

Тотальная слежка, которую ведут за нами интернет-сайты, доводит до абсурда, когда после поиска из дома адреса женской консультации на рабочий компьютер начинает регулярно приходить соответствующая реклама. Серверы Яндекса, Google, Mail, Opera или Mozilla следят за вами.

Браузер собирает информацию о своих пользователях, чтобы более точно отвечать на поисковые запросы и показывать рекламу в соответствии с предпочтениями конкретного человека. И даже когда вы выходите в Сеть с другого устройства, браузер идентифицирует вас как одно и тоже лицо.

Отключаем «слежку» в Google и Яндекс

Совсем избавиться от рекламы невозможно, но можно отключить персонализацию рекламных объявлений. Тогда поисковик не сможет собирать данные о вас и использовать их в рекламных целях. В Яндексе, достаточно в рубрике «Настройка рекламы» убрать галочки в графах «Учитывать мои интересы», «Учитывать мое местоположение», «Показывать рекламу». Не забываем сохранить изменения. В Google в графе «Персонализация рекламы» жмем «Отключить», после чего окно с индивидуальными настройками станет неактивным.

Отключаем «слежку» в IOS

Владельцам гаджетов Apple стоит особенно заботиться о том, чтобы их информация никуда не утекала. Для этого нужно зайти на страницу «Отказ от предоставления Apple рекламы на основе интересов». Там же есть предупреждение, что вы будете видеть рекламу в том же объеме, но она будет меньше вам подходить.

Отключаем «слежку» в соцсетях

Соцсети, в отличие от браузеров, анализируют не наши поисковые запросы, а «лайки», которые мы ставим друзьям и понравившимся страницам. Лайкнули новость о велогонке – получите рекламу велосипедов.

Кроме этого, многие онлайн-сервисы используют аккаунты в соцсетях в качестве быстрой замены регистрации. Таким образом, они получают доступ к вашей личной информации. Не исключено, что вы давно уже не пользуетесь сервисом, а разрешение для него продолжает храниться, поэтому есть смысл периодически отключать ненужные сторонние приложения, привязанные к вашему аккаунту. Отключить сторонние сервисы можно «ВКонтакте», «Одноклассниках», Facebook, Google.

Блогеры и создатели веб-контента должны знать о посетителях своих ресурсов, поисковых запросах, которые те делали, о просмотрах страниц и использовании контента. Получать подобную информацию позволяет Google Analytics — облачный сервис от Google.

Однако некоторым пользователям может потребоваться собственное решение для контроля, другим нужна лишь небольшая чёткая статистика, третьи хотят управлять данными своих посетителей самостоятельно, что разумно, с точки зрения конфиденциальности и безопасности.

Мы создали этот список приложений с открытым исходным кодом, чтобы помочь вам найти решение для веб-аналитики, которое соответствует вашим потребностям. Некоторые из них могут потребовать продвинутых навыков для установки и управления, некоторые являются довольно новыми, но весьма перспективными.

Существует два типа программного обеспечения для веб-аналитики: облачные сервисы, которые используют отслеживающее программное обеспечение на основе javascript, установленное на отслеживаемом веб-сайте; и серверные системы, которые анализируют файлы журнала сервера, и передают пользователю необходимую информацию (посетители, просмотры страниц, страны, IP-адреса и т.д.).

Программное обеспечение для анализа логов сервера очень полезно, когда веб-сайт/веб-проект, о котором идёт речь, должен соответствовать строгой политике безопасности или строгим правилам конфиденциальности конечных пользователей.

OWA (Open Web Analytics)

Open Web Analytics (OWA) — это автономная система веб-аналитики, имеющая открытое исходное кодирование. OWA является удобной для пользователей программой, написанной на PHP и предлагающей разработчикам различные варианты расширения.

Open Web Analytics поддерживается многими серверами, её легко установить, настроить и использовать. OWA обеспечивает поддержку Wordpress и MediaWiki с помощью простых в установке и интеграции плагинов.

Open Web Analytics — это не просто аналитическая система, это полноценная платформа веб-аналитики, которая позволяет разработчикам создавать расширения, и встраивать их в свои веб-сайты. OWA также предоставляет несколько трекеров, включая пользовательский сценарий отслеживания действий, удобный для браузеров javascript-трекер, трекер электронной коммерции и трекер конверсии.

Если вы ищете мощное средство веб-аналитики, похожее на Google Analytics, Open Web Analytics (OWA) — это правильный выбор.

Matomo

Matomo (ранее известный как Piwik) является бесплатной системой веб-аналитики с открытым исходным кодом. Это реальная альтернатива Google Analytics. Данной системе отдали предпочтение многие предприятия и компании по всему миру.

По мнению опытных пользователей, Matomo оказался надёжным, легко настраиваемым и безопасным. С его помощью легче понять, как улучшить свой веб-сайт.

Matomo имеет опцию анализа в реальном времени и целый ряд других аналитических функций. Визуализация результатов анализа красочна и содержательна. Система отслеживает посетителей, их поведение, а также местоположение, визуализированное с помощью интерактивной карты. Кроме того, Matomo предоставляет информацию о языках посетителей, их компьютерах и браузерах.

Благодаря Matomo вы узнаете, сколько времени пользователь оставался на странице и каков показатель отказов. Настраиваемая панель похожа на панель Google Analytics, но имеет гораздо большее количество виджетов. Пользователь может сам создать панель мониторинга, выбрав макет и виджеты для отображения, а затем организовать/настроить их.

Matomo представляет собой богатую аналитическую платформу. Большинство расширений, нацеленных на увеличение функциональных возможностей Matomo, бесплатны, некоторые же являются коммерческими продуктами, но поставляются в основном по доступным ценам.

AWStats

AWStats доступен через интерфейс командной строки или через веб-порт, который использует CGI. Данный веб-анализатор существует уже много лет, но всё ещё получает частые обновления.

GoAccess

GoAccess — это анализатор лог-файлов веб-сервера, работающий в режиме реального времени, и интерактивный просмотрщик, который запускается через терминал *nix-систем или через ваш браузер.

В отличие от многих других рассматриваемых облачных проектов, данный анализатор логов запускается из терминала и не требует сложной установки или базы данных. GoAccess написан на Си, так что ожидайте от него хорошую производительность и скорость.

GoAccess поддерживает все известные форматы логов, в том числе Apache, Nginx, Amazon S3, Elastic Load Balancing и CloudFront. Он в реальном времени отображает статистику веб-сервера. Вы получите информацию о посетителях, их IP-адресах, браузерах, платформах, географическом местоположении, а также запросах, обращениях, пропускной способности, использовании ресурсов, ключевых словах поиска в Google и т.д.

W3Perl

W3Perl — это свободно распространяемый, имеющий открытый исходный код анализатор лог-файлов сервера. Он поддерживает множество типов лог-файлов, в том числе логи веб-серверов, FTP, SSH, Mail, Squid и DHCP. Будучи анализатором лог-файлов, W3Perl не требует установки программного обеспечения на сайтах, которые нужно отслеживать.

W3Perl работает быстро и поставляется с изящным пользовательским интерфейсом, хотя последний может показаться старомодным по сравнению с современными стандартами веб-дизайна. W3Perl имеет плагины для расширения своих функций, такие как анализ геолокации, размеры экрана компьютера посетителя и т.д. W3Perl обладает богатым инструментарием отчётности с опциями экспорта и отсылки уведомлений по электронной почте. Он прост в установке и работает на самых разных платформах (Unix, Windows, MacOS).

W3Perl написан на Perl и переведён на многие языки.

Fathom

Fathom поддерживает отслеживание нескольких сайтов и настройку докера. Он написан с использованием языка Go и выпущен под лицензией MIT, поэтому ожидайте бесперебойной работы.

Frequency

Frequency Analytics — это устанавливаемая на сервере система веб-аналитики с открытым исходным кодом. Frequency Analytics была написана на языке Go. Система не нарушает конфиденциальность посетителей веб-ресурса, поскольку может работать без использования cookie-файлов браузера. Frequency отображает статистику сайта в режиме реального времени, в том числе информацию о текущих посетителях и активных страницах, а также об ежедневных посетителях, уникальных просмотрах, платформах и местоположении посетителей. Frequency Analytics создана и управляется хостинговой компанией, специализирующейся на размещении облачных приложений с открытым исходным кодом.

Ackee

Ackee — это бесплатная система веб-аналитики с открытым исходным кодом, использующая Node.js и MongoDB. Ackee — это легковесное приложение, не потребляющее много ресурсов сервера, поскольку база данных MongoDB может быть размещена на удалённом сервере/сервисе для резервного копирования и управления.

Опция API порадует разработчиков, так как Ackee имеет мощный REST-API. Через безопасные токены разработчики имеют доступ к доменам (веб-сайтам), записям и представлениям. Конечные точки могут быть простыми, но этого достаточно.

Ackee — это решение, ориентированное на обеспечение конфиденциальности, поскольку оно не требует использования cookie-файлов или использует уникальный пользовательский трекер. Ackee находится в активной разработке.

Visitors

Visitors — это бесплатный анализатор лог-файлов веб-сервера, имеющий открытый исходный код (лицензия GPL). Это крошечный скрипт, но с огромными возможностями, поскольку он способен обрабатывать до 150 тысяч строк записей журнала сервера в секунду и выполнять анализ данных в режиме реального времени с непрерывным потоком посетителей. Visitors написан на языке Си. Его можно легко скомпилировать и установить на сервере.

Скрипт Visitors генерирует небольшой, но подробный HTML-отчёт в виде одного файла, который не связан с внешними CSS-файлами или изображениями. Это позволяет легко обмениваться отчётами, отправляя их, например, по электронной почте. В HTML-отчёте отображается статистика посещений: запрошенные страницы и изображения, уникальные посетители, доступ ботов и сканеров, посещения из поисковых систем, шаблоны навигации посетителей по сайту, ключевые слова в поисковых системах, пользовательские браузеры и операционные системы, страницы ошибок и т.д.

Webalizer

Webalizer — это анализатор лог-файлов сервера с открытым исходным кодом. Он существует уже много лет и начинает использоваться системными администраторами по всему миру. Webalizer написан на языке Си, благодаря чему обеспечивается его высокая производительность и скорость. Webalizer поддерживает множество форматов журналов, включая журналы, сжатые с использованием gzip (.gz) и bzip2 (.bz2).

Webalizer генерирует визуализированные отчёты, вид которых можно легко настроить. Он поставляется с многоязычной поддержкой (более 20 языков).

Pimp my Log

Pimp my Log — это PHP-решение для анализа и отображения лог-файлов сервера. Pimp my Log представляет собой проект с открытым исходным кодом, выпущенный под лицензией GPL v3.0. Этой системе отдали предпочтение многие компании.

FireStats

FireStats является бесплатной веб-аналитической системой с открытым исходным кодом, предназначенной для некоммерческого использования. Этот плагин предоставляет пользователю простую статистику, уведомляя его о трафике сайта, количестве посетителей и их поисковых запросах. Аналитический отчёт включает в себя ссылки, поисковые запросы, последние популярные страницы, браузеры и операционные системы посетителей, а также их страны.

FireStats прост в использовании (возможно, это именно то, что требуется многим веб-сайтам). FireStats имеет свой API для PHP-разработчиков, что позволяет легко настраивать, интегрировать и расширять систему.

Для коммерческого использования лицензия FireStats стоит 25$ за установку, что, согласитесь, вполне доступно.

Trackingco.de

Trackingco.de — это довольно новое программное обеспечение с открытым исходным кодом, предназначенное для анализа продуктивности веб-ресурса. Trackingco.de написан на языке Go и использует такие возможности Go, как скорость и параллельная обработка.

Для установки Trackingco.de требуются навыки системного администратора или опыт работы в Linux (средний или продвинутый уровень).

Insightful

Insightful — это автономная веб-аналитическая платформа с открытым исходным кодом, поддерживающая мониторинг нескольких сайтов и управление несколькими пользователями. Insightful написан с использованием Django и применяет Javascript для отслеживания веб-сайта. Проект не обновлялся в течение уже нескольких лет.

Crumby

Crumby — это небольшой проект, написанный на языке Python и предназначенный для предоставления веб-сайту быстрого аналитического пакета. Он рассчитан на разработчиков, имеющих опыт работы с Python-Flask. Crumby содержит отслеживающий скрипт и модуль отчётности для генерации и отображения собранной статистики.

Hummingbird

Hummingbird — это платформа веб-аналитики, созданная на основе Node.js. Она не обновлялась годами, но тем не менее приобрела популярность среди разработчиков Node.js.

Ahoy — это веб-аналитическая платформа с открытым исходным кодом, созданная с использованием фреймворка Ruby on Rails. Она предназначена для разработчиков, которые смогут добавлять веб-аналитику в свои продукты на основе Rails. Ahoy используется многими Rails-разработчиками и регулярно получает обновления от мейнтейнеров.

Создатели Ahoy выпустили ещё один аналитический проект для отслеживания электронной почты — Ahoy Email.

MotionTracker

PicoStats

PicoStats — это система веб-аналитики с открытым исходным кодом, написанная на языке Go. Она призвана служить автономной альтернативой для Google Analytics с гораздо простым выводом. Хотя проект был выпущен несколько лет назад, до сих пор нет достаточного количества информации об его использовании, поскольку до сих пор не было опубликовано ни инструкций по установке, ни какой-либо другой документации.

Go-Web Analytics

Go-Web Analytics — это простая веб-аналитическая программа, написанная на языке Go. Она предоставляет пользователю информацию о посещениях, платформах и браузерах посетителей, просмотренных ими страницах. В своей работе Go-Web Analytics использует скрипты отслеживания PostgreSQL и Javascript.

PiwikR

Если вы пользуетесь Matomo и хотите использовать язык R для статистического анализа данных, этот проект для вас. PiwikR прост в установке и использовании для R-кодеров. Поставляется он с набором аналитических функций для предоставления подробной информации о посетителях, платформах, просмотрах страниц, рефералах и источниках трафика.

Применение PiwikR даст вам хорошую возможность для изучения и практики языка R на реальном объекте. Главной ценностью этого проекта является интеграция веб-аналитики с R, поскольку это облегчает создание отчётов и улучшает веб-аналитику. Единственным недостатком PiwikR является отсутствие достаточного количества документации. Кроме того, для его использования требуется хорошее знание языков R и R-Studio.

Logstalgia

Logstalgia — это инструмент для визуализации логов сервера в режиме реального времени. Он предназначен для мониторинга потока логов и отображения его с помощью изящной анимации. Logstalgia требует OpenGL для визуализации данных и поддержки воспроизведения.

Плагины для веб-аналитики:

● Django tracking (Python-Django): аналитическое приложение/модуль для проектов Django.

● Impressionist (Ruby-Rails): облегчённые плагины веб-аналитики для проектов Rails.

Читайте также: