Бесплатные программы для парсинга номеров телефонов

Парсинг сайтов — бесплатные инструменты для парсинга информации в интернете под разные задачи.

Бесплатный парсер сайтов — Octoparse

Octoparse — бесплатный парсер сайтов для сбора данных без кодирования. Приложение Octoparse (в переводе Осьминог) ориентировано на широкий круг пользователей, как начинающих, так и более опытных.

Простой парсер информации с сайтов

Для облегчения рутинной работы по сбору информации, предназначен простой парсер сайтов — Scraper. Парсер Scraper – это расширение для браузера Chrome с ограниченными функциями парсинга данных, но оно будет полезно многим для анализа и экспорта данных в Google Spreadsheets.

Есть ли защита от парсинга сайта

Любому вебмастеру бывает знакома ситуация, когда позиции его сайта в поисковой выдаче вдруг резко проседают. Затратив много усилий на пересмотр всех технических нюансов, он начинает понимать, что корень проблемы вовсе не в технической составляющей. Все проще – контент был разворован.

Что такое парсинг?

Что такое парсинг сайтов: польза и вред Открыто говорить о том, что «парсят» конкурентов, люди обычно стесняются. При том, что далеко не каждый имеет четкое представление о том, что такое парсинг, в обществе он считается занятием несколько стыдным, и публично порицается. И однако, парсингом занимаются все.

Парсер контента сайтов — Top Analyzer

Вебмастера, блоггеры и

любители по

самостоятельной

раскрутке сайтов

вынуждены собирать и

анализировать огромное

количество данных о

вебсайтах, страницах,

ссылках и других мета

данных. Постоянно

обработывать большое

кличество информации

без использования софта

практически нереально.

Top Analyzer — бесплатная

программа для анализа

контента сайтов

конкурентов из ТОПа ПС.

Без этой информации

трудно рассчитывать на

высокие позиции в

поиске, не зная как идут

дела у конкурентов.

Программа предназначена

для сбора ссылок,

описаний, заголовков,

ключевых слов и других

данных релевантых

страниц конкурентов из

ТОПа поисковых систем

Яндекса и Гугла.

Своеобразный парсер

поисковой выдачи

контента ваших

конкурентов.

Возможности программы:

Сбор позиций по

ключевым словам Сбор

адресов ссылок Собирает

МЕТА заголовки,

описания,

Как и кому стать программистом?

Для того, чтобы стать хорошим программистом, никаких особых или выдающихся способностей не нужно. Если есть желание и главное готовность учиться, то вы сможете гарантированно научиться программировать. Прочитав эту брошюру, вы сами поймете, можете ли вы стать программистом. Ведь многие даже не догадываются, что это доступно каждому человеку.

Инструменты web scraping (парсинг) разработаны для извлечения, сбора любой открытой информации с веб-сайтов. Эти ресурсы нужны тогда, когда необходимо быстро получить и сохранить в структурированном виде любые данные из интернета. Парсинг сайтов – это новый метод ввода данных, который не требует повторного ввода или копипастинга.

Такого рода программное обеспечение ищет информацию под контролем пользователя или автоматически, выбирая новые или обновленные данные и сохраняя их в таком виде, чтобы у пользователя был к ним быстрый доступ. Например, используя парсинг можно собрать информацию о продуктах и их стоимости на сайте Amazon. Ниже рассмотрим варианты использования веб-инструментов извлечения данных и десятку лучших сервисов, которые помогут собрать информацию, без необходимости написания специальных программных кодов. Инструменты парсинга могут применяться с разными целями и в различных сценариях, рассмотрим наиболее распространенные случаи использования, которые могут вам пригодиться. И дадим правовую оценку парсинга в России.

1. Сбор данных для исследования рынка

Веб-сервисы извлечения данных помогут следить за ситуацией в том направлении, куда будет стремиться компания или отрасль в следующие шесть месяцев, обеспечивая мощный фундамент для исследования рынка. Программное обеспечение парсинга способно получать данные от множества провайдеров, специализирующихся на аналитике данных и у фирм по исследованию рынка, и затем сводить эту информацию в одно место для референции и анализа.

2. Извлечение контактной информации

Инструменты парсинга можно использовать, чтобы собирать и систематизировать такие данные, как почтовые адреса, контактную информацию с различных сайтов и социальных сетей. Это позволяет составлять удобные списки контактов и всей сопутствующей информации для бизнеса – данные о клиентах, поставщиках или производителях.

3. Решения по загрузке с StackOverflow

С инструментами парсинга сайтов можно создавать решения для оффлайнового использования и хранения, собрав данные с большого количества веб-ресурсов (включая StackOverflow). Таким образом можно избежать зависимости от активных интернет соединений, так как данные будут доступны независимо от того, есть ли возможность подключиться к интернету.

4. Поиск работы или сотрудников

Для работодателя, который активно ищет кандидатов для работы в своей компании, или для соискателя, который ищет определенную должность, инструменты парсинга тоже станут незаменимы: с их помощью можно настроить выборку данных на основе различных прилагаемых фильтров и эффективно получать информацию, без рутинного ручного поиска.

5. Отслеживание цен в разных магазинах

Такие сервисы будут полезны и для тех, кто активно пользуется услугами онлайн-шоппинга, отслеживает цены на продукты, ищет вещи в нескольких магазинах сразу.

10 лучших веб-инструментов для сбора данных:

Попробуем рассмотреть 10 лучших доступных инструментов парсинга. Некоторые из них бесплатные, некоторые дают возможность бесплатного ознакомления в течение ограниченного времени, некоторые предлагают разные тарифные планы.

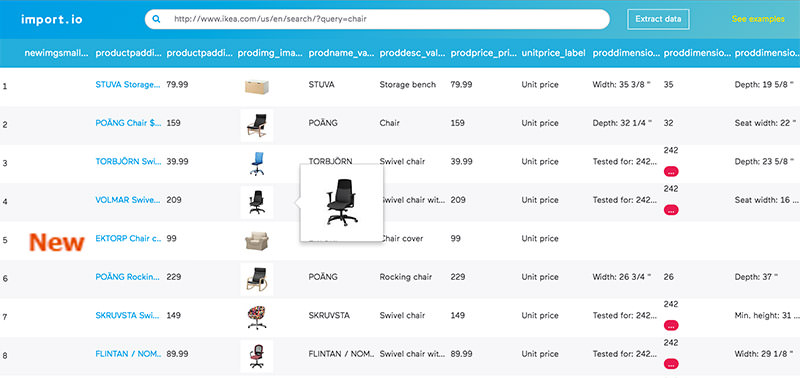

Import.io предлагает разработчику легко формировать собственные пакеты данных: нужно только импортировать информацию с определенной веб-страницы и экспортировать ее в CSV. Можно извлекать тысячи веб-страниц за считанные минуты, не написав ни строчки кода, и создавать тысячи API согласно вашим требованиям.

Для сбора огромных количеств нужной пользователю информации, сервис использует самые новые технологии, причем по низкой цене. Вместе с веб-инструментом доступны бесплатные приложения для Windows, Mac OS X и Linux для создания экстракторов данных и поисковых роботов, которые будут обеспечивать загрузку данных и синхронизацию с онлайновой учетной записью.

2. Webhose.io

Webhose.io обеспечивает прямой доступ в реальном времени к структурированным данным, полученным в результате парсинга тысяч онлайн источников. Этот парсер способен собирать веб-данные на более чем 240 языках и сохранять результаты в различных форматах, включая XML, JSON и RSS.

Webhose.io – это веб-приложение для браузера, использующее собственную технологию парсинга данных, которая позволяет обрабатывать огромные объемы информации из многочисленных источников с единственным API. Webhose предлагает бесплатный тарифный план за обработку 1000 запросов в месяц и 50 долларов за премиальный план, покрывающий 5000 запросов в месяц.

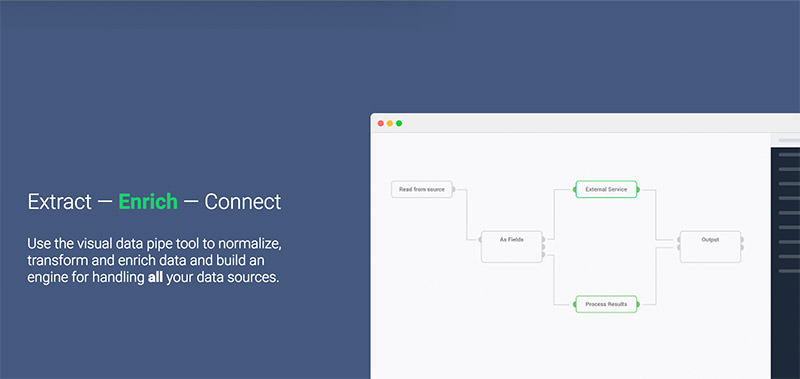

3. Dexi.io (ранее CloudScrape)

CloudScrape также обеспечивает анонимный доступ к данным, предлагая ряд прокси-серверов, которые помогают скрыть идентификационные данные пользователя. CloudScrape хранит данные на своих серверах в течение 2 недель, затем их архивирует. Сервис предлагает 20 часов работы бесплатно, после чего он будет стоить 29 долларов в месяц.

4. Scrapinghub

Scrapinghub – это облачный инструмент парсинга данных, который помогает выбирать и собирать необходимые данные для любых целей. Scrapinghub использует Crawlera, умный прокси-ротатор, оснащенный механизмами, способными обходить защиты от ботов. Сервис способен справляться с огромными по объему информации и защищенными от роботов сайтами.

Scrapinghub преобразовывает веб-страницы в организованный контент. Команда специалистов обеспечивает индивидуальный подход к клиентам и обещает разработать решение для любого уникального случая. Базовый бесплатный пакет дает доступ к одному поисковому роботу (обработка до 1 Гб данных, далее — 9$ в месяц), премиальный пакет дает четырех параллельных поисковых ботов.

ParseHub может парсить один или много сайтов с поддержкой JavaScript, AJAX, сеансов, cookie и редиректов. Приложение использует технологию самообучения и способно распознать самые сложные документы в сети, затем генерирует выходной файл в том формате, который нужен пользователю.

ParseHub существует отдельно от веб-приложения в качестве программы рабочего стола для Windows, Mac OS X и Linux. Программа дает бесплатно пять пробных поисковых проектов. Тарифный план Премиум за 89 долларов предполагает 20 проектов и обработку 10 тысяч веб-страниц за проект.

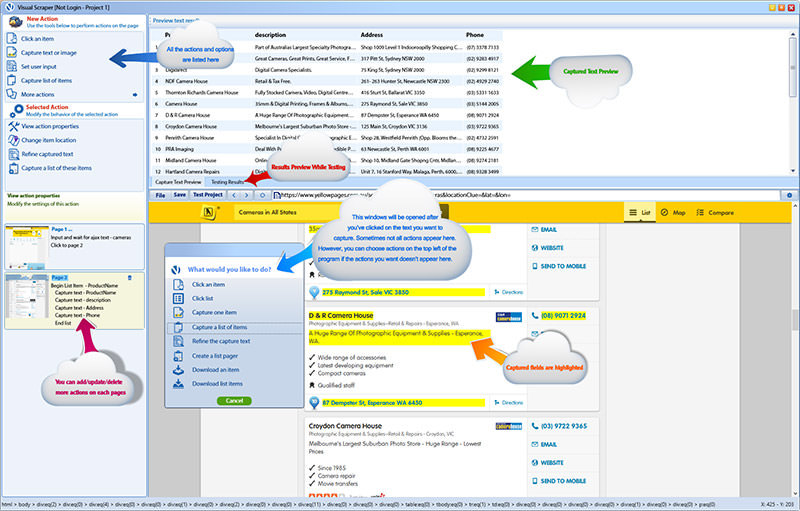

6. VisualScraper

VisualScraper – это еще одно ПО для парсинга больших объемов информации из сети. VisualScraper извлекает данные с нескольких веб-страниц и синтезирует результаты в режиме реального времени. Кроме того, данные можно экспортировать в форматы CSV, XML, JSON и SQL.

Пользоваться и управлять веб-данными помогает простой интерфейс типа point and click. VisualScraper предлагает пакет с обработкой более 100 тысяч страниц с минимальной стоимостью 49 долларов в месяц. Есть бесплатное приложение, похожее на Parsehub, доступное для Windows с возможностью использования дополнительных платных функций.

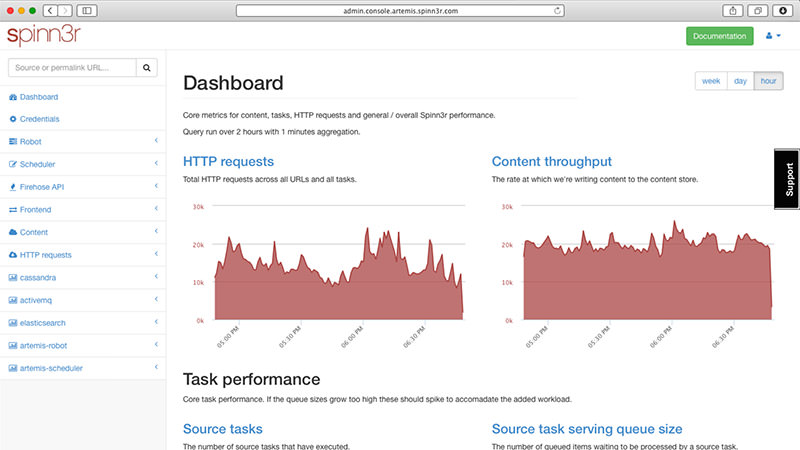

Spinn3r позволяет парсить данные из блогов, новостных лент, новостных каналов RSS и Atom, социальных сетей. Spinn3r имеет «обновляемый» API, который делает 95 процентов работы по индексации. Это предполагает усовершенствованную защиту от спама и повышенный уровень безопасности данных.

Spinn3r индексирует контент, как Google, и сохраняет извлеченные данные в файлах формата JSON. Инструмент постоянно сканирует сеть и находит обновления нужной информации из множества источников, пользователь всегда имеет обновляемую в реальном времени информацию. Консоль администрирования позволяет управлять процессом исследования; имеется полнотекстовый поиск.

80legs – это мощный и гибкий веб-инструмент парсинга сайтов, который можно очень точно подстроить под потребности пользователя. Сервис справляется с поразительно огромными объемами данных и имеет функцию немедленного извлечения. Клиентами 80legs являются такие гиганты как MailChimp и PayPal.

Опция «Datafiniti» позволяет находить данные сверх-быстро. Благодаря ней, 80legs обеспечивает высокоэффективную поисковую сеть, которая выбирает необходимые данные за считанные секунды. Сервис предлагает бесплатный пакет – 10 тысяч ссылок за сессию, который можно обновить до пакета INTRO за 29 долларов в месяц – 100 тысяч URL за сессию.

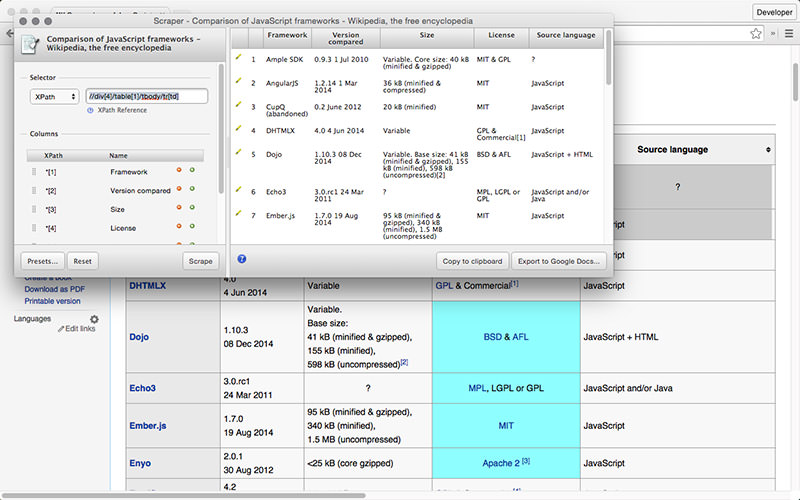

Scraper – это расширение для Chrome с ограниченными функциями парсинга данных, но оно полезно для онлайновых исследований и экспортирования данных в Google Spreadsheets. Этот инструмент предназначен и для новичков, и для экспертов, которые могут легко скопировать данные в буфер обмена или хранилище в виде электронных таблиц, используя OAuth.

Scraper – бесплатный инструмент, который работает прямо в браузере и автоматически генерирует XPaths для определения URL, которые нужно проверить. Сервис достаточно прост, в нем нет полной автоматизации или поисковых ботов, как у Import или Webhose, но это можно рассматривать как преимущество для новичков, поскольку его не придется долго настраивать, чтобы получить нужный результат.

10. OutWit Hub

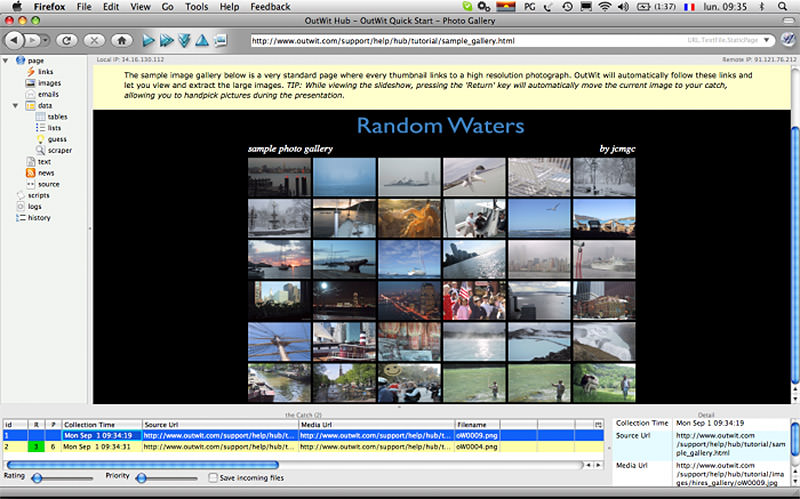

OutWit Hub – это дополнение Firefox с десятками функций извлечения данных. Этот инструмент может автоматически просматривать страницы и хранить извлеченную информацию в подходящем для пользователя формате. OutWit Hub предлагает простой интерфейс для извлечения малых или больших объемов данных по необходимости.

OutWit позволяет «вытягивать» любые веб-страницы прямо из браузера и даже создавать в панели настроек автоматические агенты для извлечения данных и сохранения их в нужном формате. Это один из самых простых бесплатных веб-инструментов по сбору данных, не требующих специальных знаний в написании кодов.

Самое главное — правомерность парсинга?!

Вправе ли организация осуществлять автоматизированный сбор информации, размещенной в открытом доступе на сайтах в сети интернете (парсинг)?

В соответствии с действующим в Российской Федерации законодательством разрешено всё, что не запрещено законодательством. Парсинг является законным, в том случае, если при его осуществлении не происходит нарушений установленных законодательством запретов. Таким образом, при автоматизированном сборе информации необходимо соблюдать действующее законодательство. Законодательством Российской Федерации установлены следующие ограничения, имеющие отношение к сети интернет:

1. Не допускается нарушение Авторских и смежных прав.

2. Не допускается неправомерный доступ к охраняемой законом компьютерной информации.

3. Не допускается сбор сведений, составляющих коммерческую тайну, незаконным способом.

4. Не допускается заведомо недобросовестное осуществление гражданских прав (злоупотребление правом).

5. Не допускается использование гражданских прав в целях ограничения конкуренции.

Из вышеуказанных запретов следует, что организация вправе осуществлять автоматизированный сбор информации, размещенной в открытом доступе на сайтах в сети интернет если соблюдаются следующие условия:

1. Информация находится в открытом доступе и не защищается законодательством об авторских и смежных правах.

2. Автоматизированный сбор осуществляется законными способами.

3. Автоматизированный сбор информации не приводит к нарушению в работе сайтов в сети интернет.

4. Автоматизированный сбор информации не приводит к ограничению конкуренции.

При соблюдении установленных ограничений Парсинг является законным.

p.s. по правовому вопросу мы подготовили отдельную статью, где рассматривается Российский и зарубежный опыт.

Какой инструмент для извлечения данных Вам нравится больше всего? Какого рода данные вы хотели бы собрать? Расскажите в комментариях о своем опыте парсинга и свое видение процесса…

Если вы занимаетесь холодными звонками, рассылками или таргетированной рекламой, вы задавали себе вопрос где же брать базу номеров телефонов. Базу конечно можно приобрести в интернете, но лучшим вариантом будет собрать базу с помощью онлайн парсера. Я для себя открыл два вида парсеров. Это онлайн парсеры и программы которые устанавливаются на компьютер.

Онлайн парсеры телефоновдостаточно интересны тем что базу можно орать в любое время в любом месте. Можно зайти с телефона, выбрать нужную рубрику к примеру на авито и вставить ссылку в онлайн парсер. Самым простым и быстрым онлайн парсером на мой взгляд оказался онлайн парсер Лидозвона. Вы просто копируете ссылку с предположим авито и вставляете в парсер. Он за считанные минуты выкачиваете тысячи объявлений, так же базу можно сразу добавлять в вашу CRM систему. Ещё один плюс данного парсера что можно запускать автообзвон роботом. То есть вы так же вставляете ссылку с авито по выбронному фильтр и запускаете парсер + автообзвон роботом. Заинтересованных клиентов можно сразу переводить в CRM.

Ещё одна уникальная вещь такая как Автопарсер. Он автоматически соберет новые объявления. К примеру вы реэлтор и вам постоянно нужно обзванивать новые предложения по продаже квартир с сайта авито. Автопарсер будет каждый раз мониторить такие объявления и выгружать в вашу CRM, либо совершать звонок роботом и выявлять только заинтересованных в услугах клиентов. Кому интересно как работает онлайн парсер телефонов в связке с CRM и автообзвоном, можете зайти на сайт Лидозвон и все посмотреть.

Так же есть программы которые вы ставите на сервер или свой компьютер, они конечно не на столько удобны и функциональный, но по стоимости получаются чуть ниже чем онлайн парсеры. Принцип работы такой же, заходите на авито, копируете ссылку и вставляете в парсер. Лично я пользовался парсером авито от Dijex Media он соберет около 5000 объявлений за один час. То есть за один рабочий день можно спарсить более 50000 телефонов.

Как я использую телефоны после парсинг?

Все это я тоже автоматизировали через сервис Лидозвон в связке с Битрикс24.

Цены на парсеры телефонов

Стоимость онлайн парсера 3 коп за контакт. То есть за 1000 контактов всего 30 рублей. А автообзвон у меня выходит около 70 коп за звонок. То есть на обзвон 1000 клиентов я трачу около 700 - 800 рублей и с этого получаю около 25 лидов. Цена Лида реально очень маленькая, поэтому данный способ очень результативный по сравнению с контекстной и таргетированной рекламой.

Стоимость парсера программы 590 рублей на месяц. Вы можете качать неограниченное количество объявлений.

Вот так вот просто в 2020 году можно автоматизировать сбор телефонов с помощью парсера. А ещё круче делать связки парсеров с CRM системами и автообзвоном. Настроил за 5 минут а результат просто наивысший.

Если у вас есть какие то вопросы по поводу парсеров телефонов, можете писать в комментарии, постараюсь дать максимально чёткий ответ на любой вопрос.

Как быстро спарсить номера с Авито? С помощью данной подборки вы сможете легко собрать контактную базу номеров с Авито. Парсеры авито в виде Saas сервисов а так же програмного обеспечения помогут Вам собрать тысячи номеров за считанные минуты. Парсим авито вместе с Dijex Media

Сегодня расскажу Вам про 3 парсера которые помогут Вам собрать базу авито за считанные минуты. Данные базы можно продавать либо использовать в личных целях. И так как всегда без воды, начнём!

1. Первый парсер (бесплатный онлайн парсер)

1. Это единственный на рынке 100% бесплатный онлайн парсер Авито. Сервис зарабатывает с голосовых рассылок и предоставляет парсер авито всем пользователям абсолютно бесплатно

2. Работает в облаке. Можно пропарсить базу авито как с телефона так и с компьютера либо планшета. Скорость парсинга 20000 контактов за 5 минут

3. Конфигурация фильтров. Фильтрует дубли, защищенные номера, и ряд других парамметров которые необходимы при обработке базы.

4. Парсер новых объявлений. Парсер собирает только вышедшие объявления и отправляет уведомления на почту, либо сразу можно запустить голосовую рассылку роботом

2. Второй парсер Авито

Это онлайн парсер авито которым можно пользоваться бесплатно.

В день можно легко парсить до 100 000 контактов.

В соотношении стоимости данный парсер занимает лидирующую позицию

Работает в многопоточном режиме

3. Последний парсер ссылка

Многофункциональный парсер авито который устанавливается на Ваш компьютер.

Данный парсер стоит 490 рублей в месяц и обладает большим функционалом

В сравнении с первыми двумя парсерами он будет немножко посложнее, но соответственно стоимость и функционал говорят о своём.

Можно сказать что этот парсер стоит стоит свои вложенных денег.

Так же данный парсер обладает большим функционалом, подробнее можете ознакомиться на основной странице парсера.

Ещё есть один крутой парсер, но не авито а яндекс карт

Как использовать номера телефонов с авито?

Номера можно использовать для WhatsApp и СМС рассылок о которых мы рассказываем в других статьях на нашем блоге.

Вы ищете работу или нуждаетесь в контактах с персоналом учреждений? Или Вы хотите обратиться к конкретному адресу одной из организаций. В этом вам может помочь бесплатный парсер контактов — Email Sourcer. В интернете достаточно открытых и законных источников контактной информации для поиска нужных источников.

Email Sourcer — это бесплатный инструмент поиска контактов для всех нужд, от поиска работы до корпоративного поиска. Парсер контактов позволяет вам просматривать и легко получать информацию в Интернете, собирать адреса электронной почты и другую контактную информацию. Он может собрать номера телефонов и факсов, почтовый адрес, имя, фамилию, данные с веб-сайтов, общедоступных каталогов и других источников в Интернете, в несколько кликов.

Программа заключена в доступный и хорошо структурированный интерфейс, разделенный на две отдельные панели, веб-браузер и таблицу элементов. Результаты отображаются внизу списка, за ними следуют их идентификатор, исходный URL, домен, заголовок страницы, адрес электронной почты, а также полное имя, телефон, адрес и город. Основная задача парсера — спарсить все адреса электронной почты и попытаться связать все дополнительно найденные данные.

Приложение позволяет распознать информацию и оценить структуру данных, которые вы хотите извлечь. База данных может быть легко экспортирована в форматы файлов HTML, HTM, TXT, Excel, CSV и XML. Если текст ячейки не является ссылкой, двойной щелчок по ней дает вам возможность редактировать ее содержимое. С другой стороны, если это действительный сайт, то он переключается в режим просмотра.

Можно изменить отображаемый текст, используя элементы редактирования (вырезать, скопировать, вставить), а также вставить новые строки и столбцы, щелкнув правой кнопкой мыши по списку. Приложение выделяет URL той же группы или уровня, чтобы упростить процесс. Еще одна полезная функция — это панель поиска, которая позволяет вам просмотреть конкретную запись, и когда она найдена, она выделяется другим цветом.

Email Sourcer имеет большое количество функций распознавания и извлечения данных. Это значительно упрощает вам поиск в Интернете, сортировку и организацию вашей информации так, как вы хотите. Работа с программой не требует навыков программирования или технических знаний. Вы можете запускать автоматические проверки для сбора и форматирования информации, которую вы ищете. На автомате просматривайте страницы, собирайте и форматируйте информацию.

Приложение доступно обычным пользователям для быстрого извлечения данных, со скоростью необходимой для профессионального использования в автоматизированных рабочих процессах. Программа охватывает широкий спектр потребностей, от поиска деловых контактов в компании до построения крупных баз данных по территориям бизнес секторов.

Парсер контактов работает на компьютере с Windows, MacOS или Linux. Email Sourcer 8.0.0.57 имеет размер файла 53,09 МБ — портабельная версия. Также существует, как дополнение к браузеру Firefox.

Читайте также: